英偉達(dá)a100和h100哪個(gè)強(qiáng)? 就A100和H100這兩個(gè)產(chǎn)品來(lái)說(shuō),它們雖然都是英偉達(dá)公司的高性能計(jì)算產(chǎn)品,但是面向的市場(chǎng)和應(yīng)用場(chǎng)景不同,所以不能簡(jiǎn)單地說(shuō)哪個(gè)更強(qiáng)。 NVIDIA A100是一款

2023-08-09 17:31:33 51339

51339 越來(lái)越多的應(yīng)用正在使用 AI 加速,而無(wú)論工作站的大小或形態(tài)如何,都有越來(lái)越多的用戶(hù)需要 AI 性能。NVIDIA RTX PRO 2000 Blackwell 是全新 NVIDIA

2025-11-28 09:39:42 5098

5098

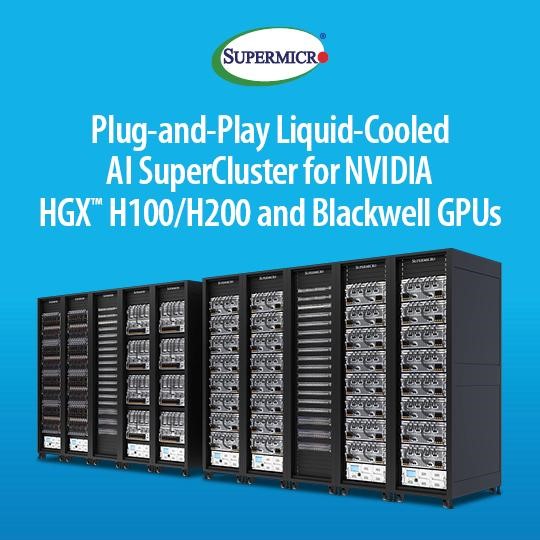

機(jī)架中的NVIDIA HGX B200 8-GPU系統(tǒng)數(shù)量,與Supermicro目前領(lǐng)先業(yè)界的搭載NVIDIA HGX H100和H200的液冷型SuperCluster相比,GPU計(jì)算密度得到大幅提升。此

2024-11-25 10:39:23 1211

1211

。gamebcgs.com 迄今為止,NVIDIA還沒(méi)有自己發(fā)布過(guò)平板電腦,而是和自己的合作伙伴共同開(kāi)發(fā),比如華碩、宏碁、微軟等等,都采用過(guò)Tegra系列芯片。而自從NVIDIA自己推出了Shield掌上游戲機(jī)后,沒(méi)準(zhǔn)自己推出個(gè)平板電腦也就不是什么稀奇事了。■ dar2ed5

2013-08-10 15:54:40

H100 Tensor Core GPU 快 6 倍。

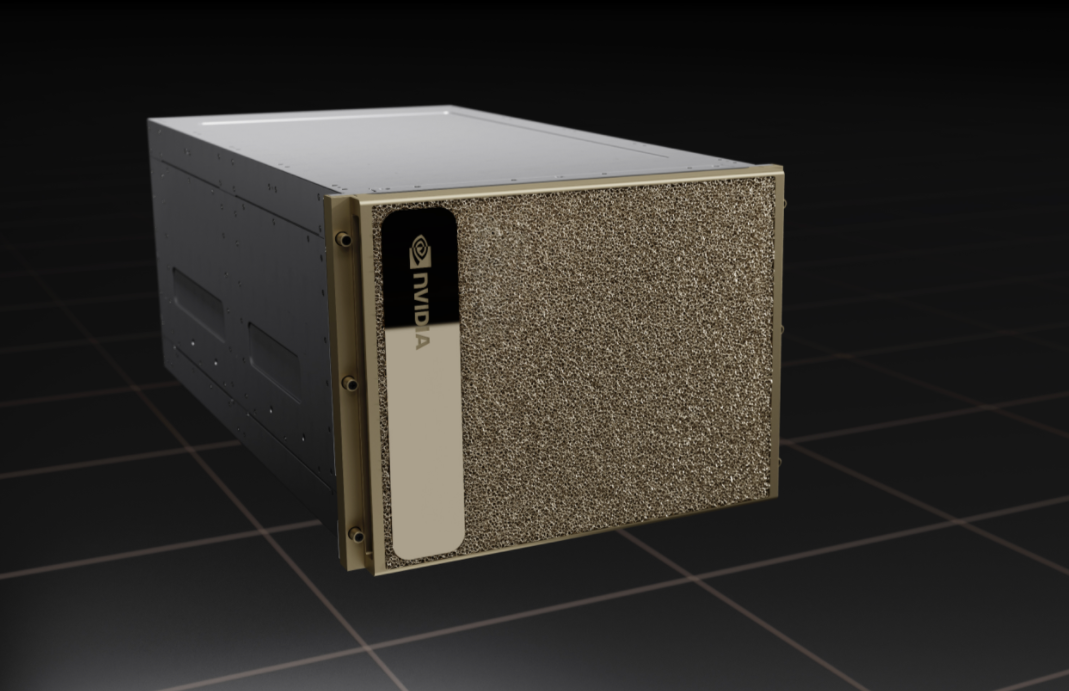

采用液體冷卻的 GB200 計(jì)算托盤(pán)可實(shí)現(xiàn)高能效和高計(jì)算精密度

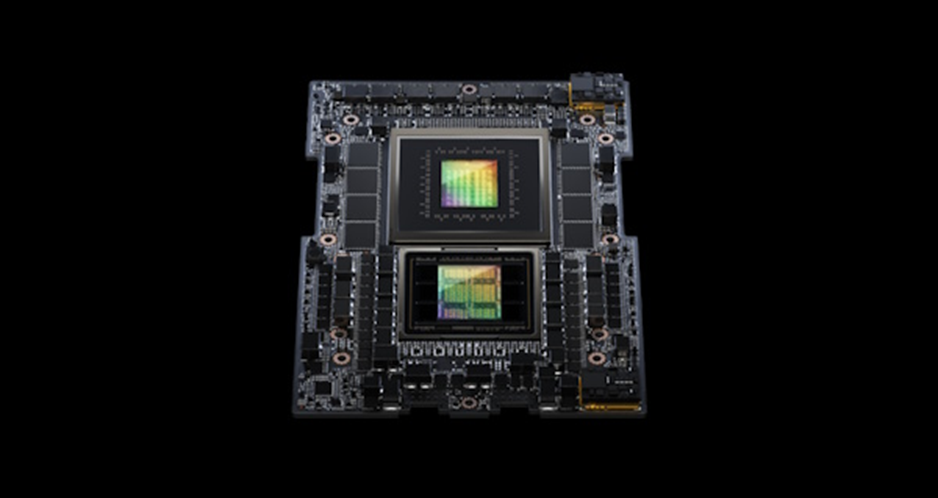

NVIDIA GB200 Grace Blackwell超級(jí)芯片是GB200

2024-05-13 17:16:22

NVIDIA于今日發(fā)布NVIDIA A100 80GB GPU,這一創(chuàng)新將支持NVIDIA HGX AI超級(jí)計(jì)算平臺(tái)。該GPU內(nèi)存比上一代提升一倍,能夠?yàn)檠芯咳藛T和工程師們提供空前的速度和性能,助力實(shí)現(xiàn)新一輪AI和科學(xué)技術(shù)突破。

2020-11-17 09:59:52 3314

3314 結(jié)合全新 NVLink Switch系統(tǒng),每臺(tái) DGX SuperPOD 可提供 1 Exaflops 的 AI 性能;全新 NVIDIA Eos 超級(jí)計(jì)算機(jī)有望成為全球運(yùn)行速度最快的 AI 系統(tǒng);通過(guò)擴(kuò)展的 DGX Foundry 服務(wù)即刻助力客戶(hù)啟程。

2022-03-23 11:20:29 2538

2538

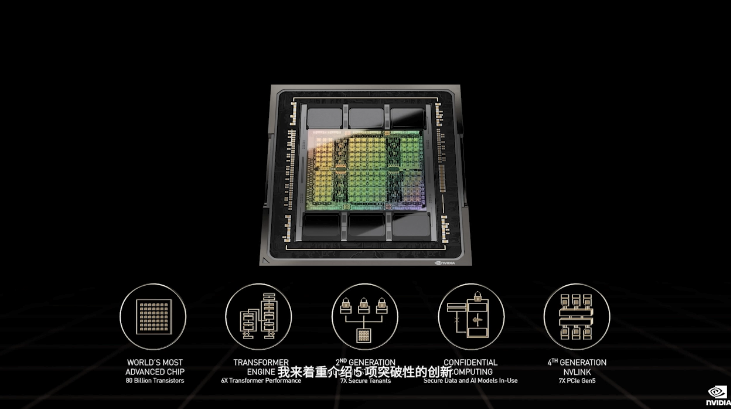

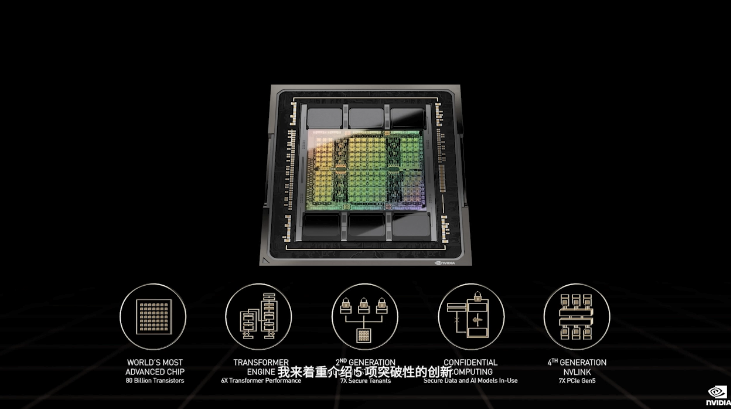

NVIDIA發(fā)布新一代產(chǎn)品—NVIDIA H100,H100是一款超大的芯片,采用TSMC 4N工藝,具有800億個(gè)晶體管,也是首款采用HBM3標(biāo)準(zhǔn)的GPU。

2022-03-23 17:21:42 3450

3450

GTC2022大會(huì)黃仁勛:NVIDIA H100的5項(xiàng)突破性創(chuàng)新,擁有強(qiáng)大的性能,新的Tensor處理格式:FP8等,是首個(gè)實(shí)現(xiàn)性能擴(kuò)展至700瓦的GPU。

2022-03-23 17:37:18 2744

2744

NVIDIA 近日宣布推出第四代 NVIDIA? DGX? 系統(tǒng),這是世界上第一個(gè)使用全新NVIDIA H100 Tensor Core GPU 構(gòu)建的 AI 平臺(tái)。

2022-03-25 11:44:23 5729

5729 藍(lán)海大腦宣布服務(wù)器產(chǎn)品線全力支持最新的 NVIDIA H100 GPU。藍(lán)海大腦服務(wù)器產(chǎn)品在單機(jī)上最多可支持4、8甚至9個(gè)H100 GPU,可為多種人工智能場(chǎng)景提供超強(qiáng)算力、靈活的資源調(diào)度和成熟的生態(tài)支持。

2022-03-31 11:47:09 1975

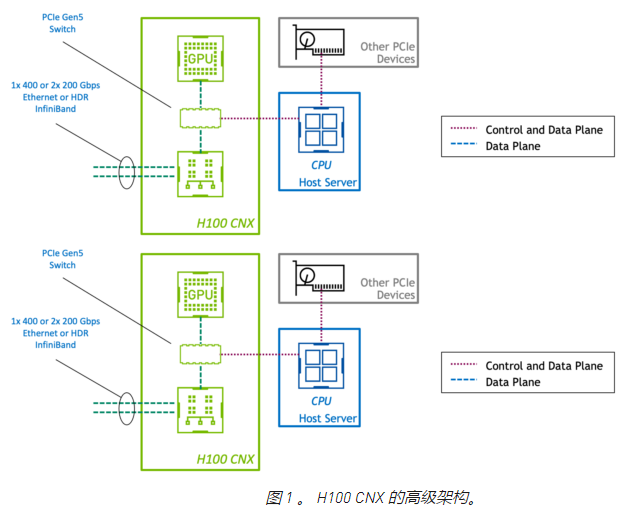

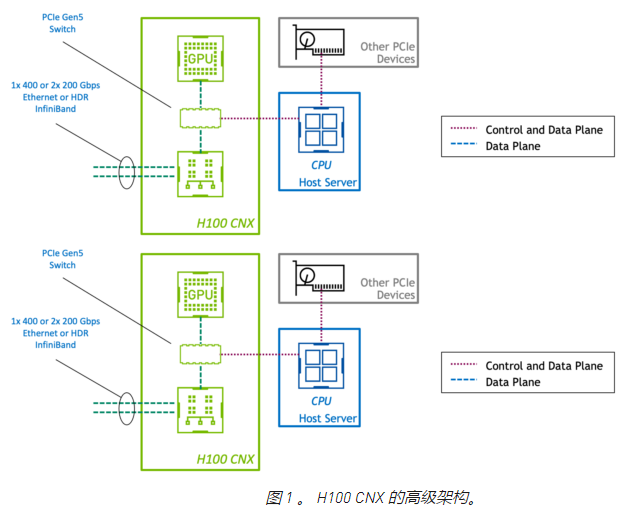

1975 NVIDIA H100 CNX 預(yù)計(jì)可在今年下半年購(gòu)買(mǎi)。如果你有一個(gè)用例可以從這個(gè)獨(dú)特而創(chuàng)新的產(chǎn)品中受益,請(qǐng)聯(lián)系你最喜歡的系統(tǒng)供應(yīng)商,詢(xún)問(wèn)他們計(jì)劃何時(shí)將其與服務(wù)器一起提供。

2022-03-31 14:49:27 2618

2618

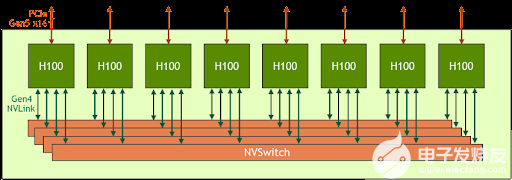

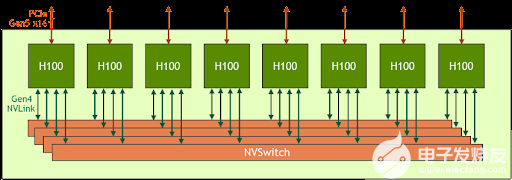

HGX H100 8- GPU 是新一代 Hopper GPU 服務(wù)器的關(guān)鍵組成部分。它擁有八個(gè) H100 張量核 GPU 和四個(gè)第三代 NV 交換機(jī)。每個(gè) H100 GPU 都有多個(gè)第四代

2022-04-20 10:54:19 4176

4176

5月24日,在全球科技盛會(huì)“Computex 2022”期間,NVIDIA正式推出A100 80GB PCIe液冷式GPU。作為NVIDIA的重要合作伙伴,紫光股份旗下新華三集團(tuán)H

2022-05-25 10:34:58 2446

2446 電動(dòng)汽車(chē)制造商蔚來(lái)正在使用 NVIDIA HGX A100 構(gòu)建綜合全面的數(shù)據(jù)中心基礎(chǔ)設(shè)施,并在此基礎(chǔ)上開(kāi)發(fā) AI 驅(qū)動(dòng)的軟件定義汽車(chē)。

2022-06-17 10:45:25 2361

2361 今年的 GTC22 上 NVIDIA 發(fā)布其首款基于 Hopper 架構(gòu)的 GPU —NVIDIA H100。

2022-07-18 10:35:23 2913

2913 在行業(yè)標(biāo)準(zhǔn) AI 推理測(cè)試中,NVIDIA H100 GPU 創(chuàng)造多項(xiàng)世界紀(jì)錄、A100 GPU 在主流性能方面展現(xiàn)領(lǐng)先優(yōu)勢(shì)、Jetson AGX Orin 在邊緣計(jì)算方面處于領(lǐng)先地位。

2022-09-13 15:29:19 4221

4221 NVIDIA 于今日宣布 NVIDIA H100 Tensor Core GPU 全面投產(chǎn),NVIDIA 全球技術(shù)合作伙伴計(jì)劃于 10 月推出首批基于開(kāi)創(chuàng)性 NVIDIA Hopper 架構(gòu)的產(chǎn)品和服務(wù)。

2022-09-22 10:45:01 1712

1712 在H100發(fā)布之際,英偉達(dá)還帶來(lái)一個(gè)“重磅產(chǎn)品”——Transformer Engine。在Transformer大火之際推出這么一個(gè)產(chǎn)品,無(wú)疑是煉丹師福音。

2022-10-24 15:26:29 5603

5603 華碩今日宣布正式推出旗下搭載英偉達(dá)(NVIDIA)HGX H100的AI高階服務(wù)器產(chǎn)品,且新品未上市就已有超高詢(xún)問(wèn)度,目前手上訂單已滿(mǎn)到明年。

2023-07-20 16:32:20 1505

1505 AI硬件市場(chǎng)上,NVIDIA可謂呼風(fēng)喚雨,旗下的A100、H100加速器炙手可熱。

2023-08-07 09:47:33 1420

1420

英偉達(dá)a100和h100哪個(gè)強(qiáng)? 英偉達(dá)A100比H100更強(qiáng)。英偉達(dá)A100在處理大型模型和數(shù)據(jù)集時(shí)可能比V100表現(xiàn)更優(yōu)秀。 H100 是一款針對(duì)大模型專(zhuān)門(mén)優(yōu)化過(guò)的芯片,使用臺(tái)積電 5nm 定制

2023-08-07 17:32:59 17613

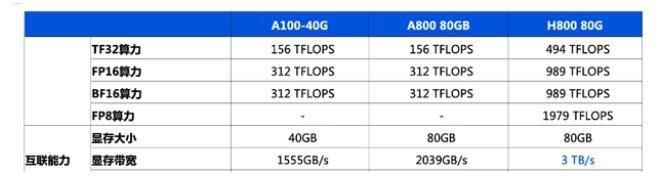

17613 英偉達(dá)A100和H100的區(qū)別 英偉達(dá)A100和H100是兩種不同的產(chǎn)品。A100是英偉達(dá)在2020年推出的一款基于Ampere架構(gòu)的數(shù)據(jù)中心GPU,主要用于高性能計(jì)算和人工智能應(yīng)用。A100具有

2023-08-07 18:06:03 33464

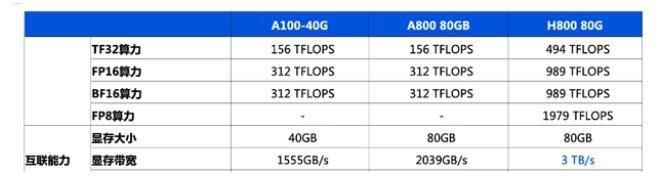

33464 不足,反而更貴。 NVIDIA H100 的中國(guó)版本就是:NVIDIA H800。 ? ? ? ?H800的的帶寬僅為H100(900 GB/s)的約一半。 NVIDIA H100 搭載多項(xiàng)先進(jìn)技術(shù)可將推理

2023-08-08 16:06:55 56529

56529

gh200和h100性能對(duì)比 隨著計(jì)算機(jī)的普及和技術(shù)的不斷提高,CPU發(fā)熱問(wèn)題越來(lái)越重要。因此,散熱器作為一種重要的CPU散熱裝置,起到了非常重要的作用。其中,GH200和H100散熱器都是較為知名

2023-08-16 17:33:27 1773

1773 gh200和h100哪個(gè)更好 在冷靜分析的基礎(chǔ)上,我認(rèn)為GH200和H100各有優(yōu)缺點(diǎn),沒(méi)有絕對(duì)的好與不好之分。以下是我對(duì)GH200和H100性能、價(jià)格、安裝等方面做出的詳細(xì)比較和評(píng)價(jià),希望能對(duì)你

2023-08-16 17:33:58 1979

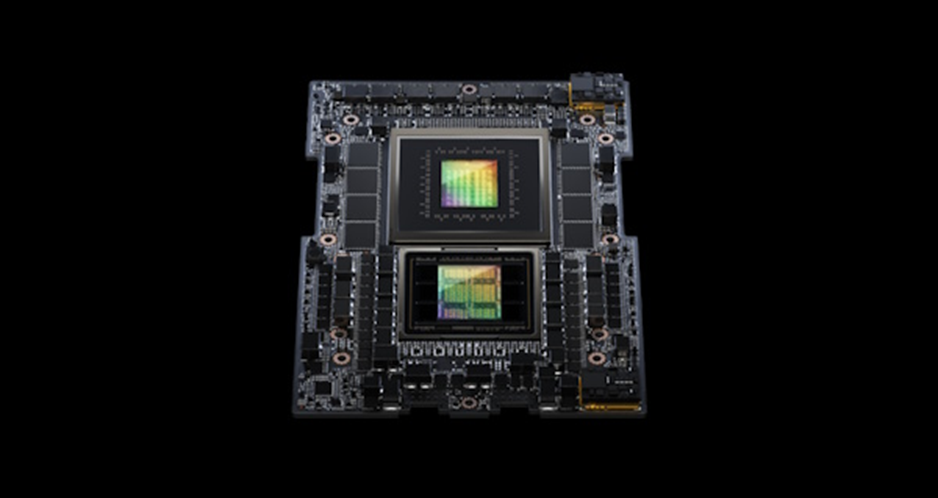

1979 NVIDIA Grace Hopper Superchip將節(jié)能、高帶寬的 NVIDIA Grace CPU 與功能強(qiáng)大的 NVIDIA H100 Hopper GPU 結(jié)合使用 NVLink-C2C,以最大限度地提高強(qiáng)大的高性能計(jì)算 (HPC) 和巨型 AI 工作負(fù)載的能力。

2023-08-30 10:45:44 2655

2655

從云端到網(wǎng)絡(luò)邊緣,NVIDIA GH200、H100 和 L4 GPU 以及 Jetson Orin 模組在運(yùn)行生產(chǎn)級(jí) AI 時(shí)均展現(xiàn)出卓越性能。 NVIDIA GH200 Grace Hopper

2023-09-12 20:40:04 900

900 從云端到網(wǎng)絡(luò)邊緣,NVIDIA GH200、H100和L4 GPU以及Jetson Orin模組在運(yùn)行生產(chǎn)級(jí) AI 時(shí)均展現(xiàn)出卓越性能。 ? ? ? NVIDIA GH200 Grace

2023-09-13 09:45:40 1159

1159

也即將在 OCI Compute 上推出。 OCI 上的 NVIDIA? H100 Tensor Core GPU 實(shí)例 OCI Co mpute 裸機(jī)實(shí)例配備了具有? NVIDIA Hopper ? 架構(gòu) 的 NVIDIA H

2023-09-25 20:40:02 1219

1219

市場(chǎng)研究公司Omdia近日發(fā)布報(bào)告稱(chēng),預(yù)計(jì)英偉達(dá)二季度用于AI和高性能計(jì)算應(yīng)用的H100 GPU的出貨量超過(guò)了900噸。并且預(yù)計(jì)其在未來(lái)幾個(gè)季度的GPU銷(xiāo)量將大致相同,因此英偉達(dá)今年將銷(xiāo)售約3600 噸重的H100 GPU。

2023-09-28 14:50:55 2255

2255

首先,我們首先要說(shuō)的是,如果您現(xiàn)在想要訓(xùn)練基礎(chǔ)模型(例如 ChatGPT),那么 NVIDIA H100 80GB SXM5 仍然是首選 GPU。一旦基礎(chǔ)模型經(jīng)過(guò)訓(xùn)練,通常可以在成本和功耗顯著降低的部件上根據(jù)特定領(lǐng)域的數(shù)據(jù)或推理來(lái)定制模型。

2023-11-08 15:35:53 2249

2249

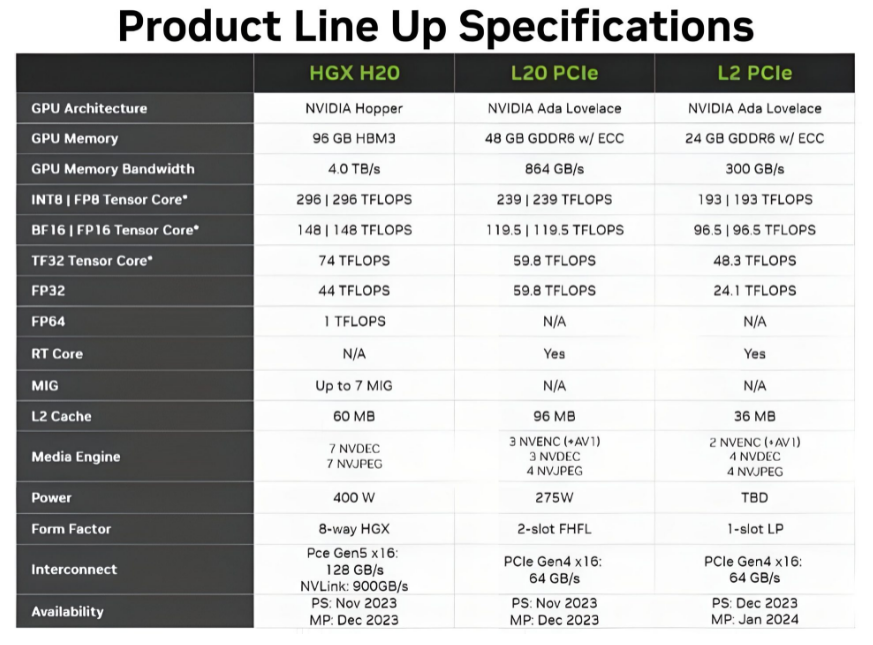

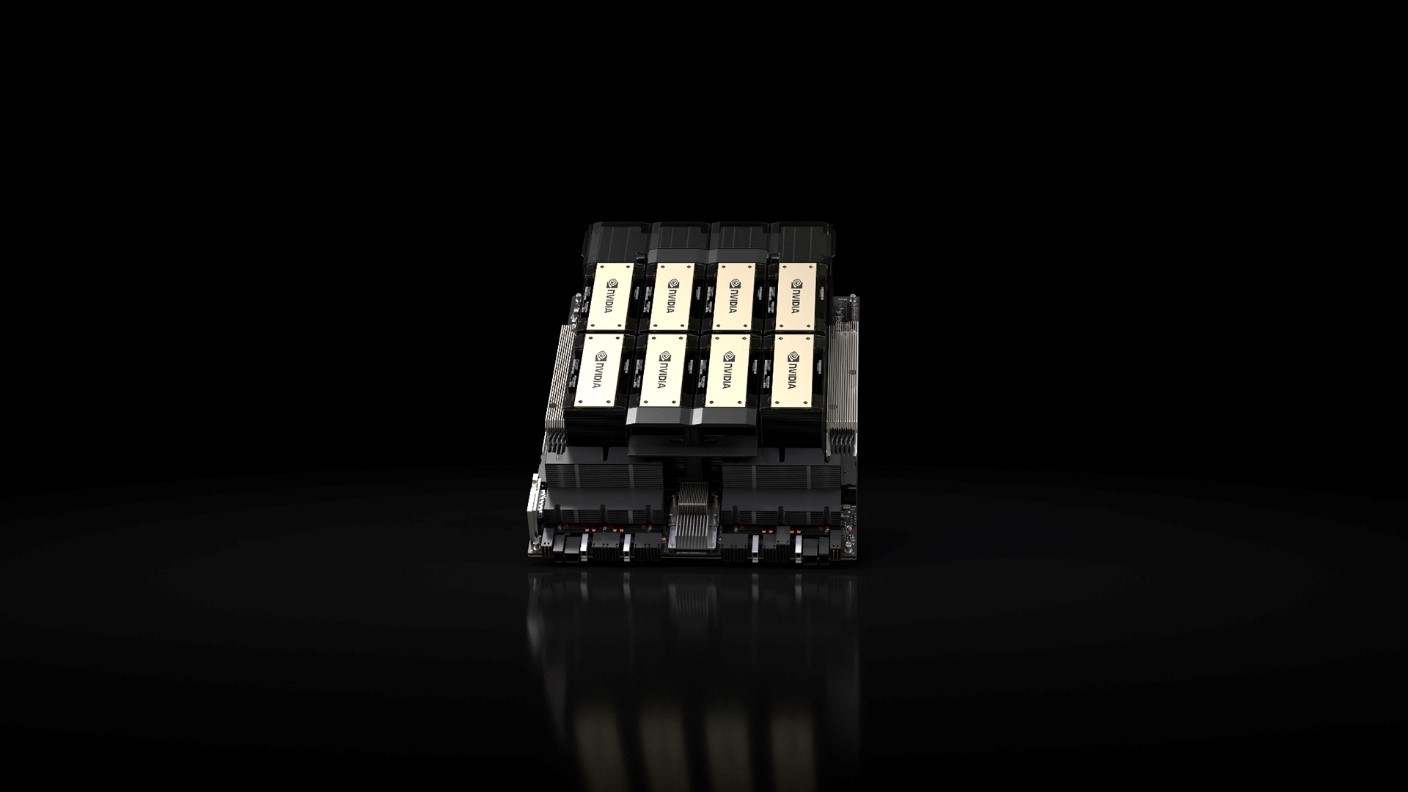

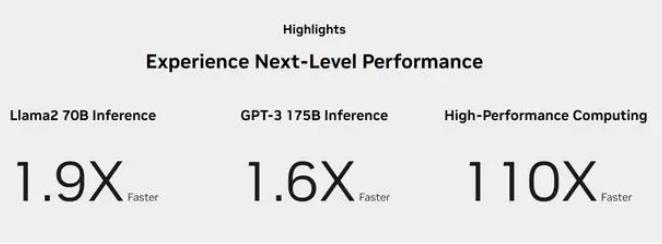

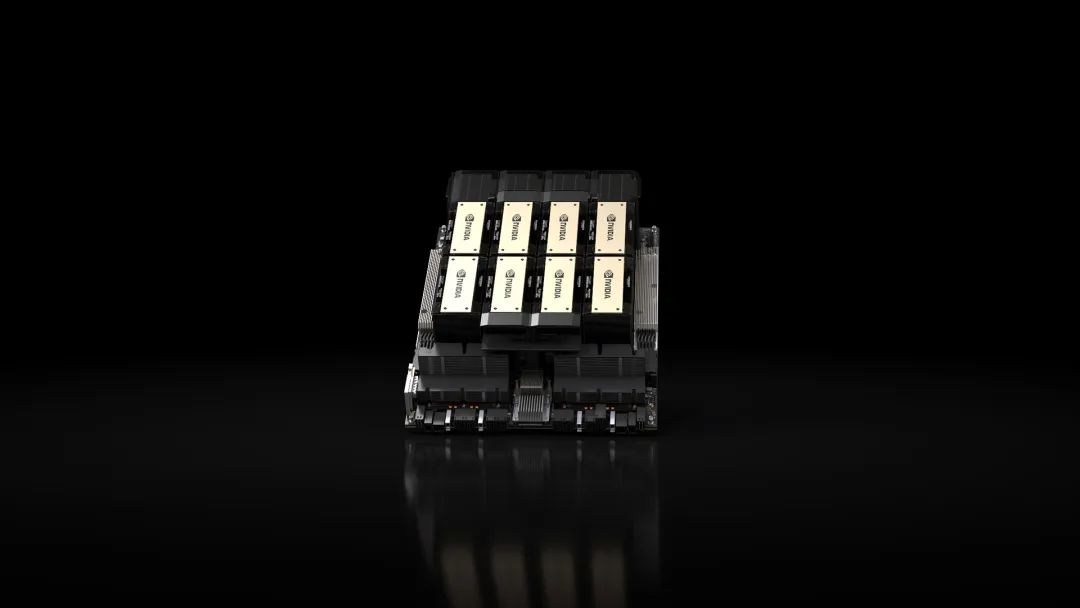

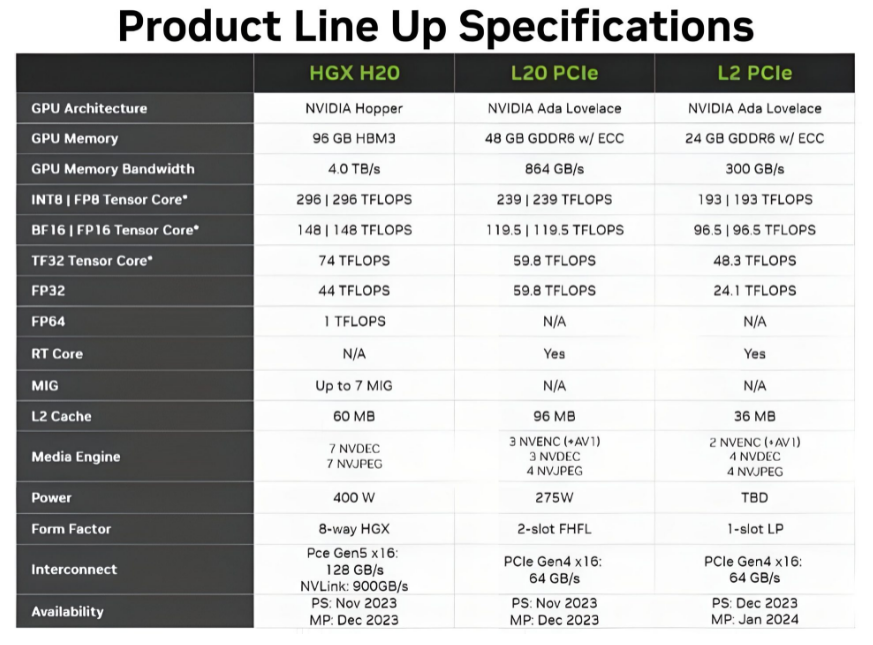

但據(jù)悉,三種新型AI芯片不是“改良型”,而是“縮小型”。用于ai模型教育的hgx h20的帶寬和計(jì)算速度是有限的。整體計(jì)算能力理論上比nvidia的h100 gpu芯片低80%左右。h20是h100的20%的綜合計(jì)算性能。

2023-11-13 09:41:58 3964

3964 據(jù)報(bào)道,nvidia的3種ai芯片不是“改良版”,而是“縮水版”,分別是hgx h20、l20 pcle和l2 pcle。用于ai模型訓(xùn)練的hgx h20雖然帶寬和計(jì)算速度有限,但整體計(jì)算能力理論上比英偉達(dá)h100 gpu芯片低80%左右。

2023-11-13 10:46:07 1346

1346 目前,用于高端推理的 GPU 主要有三種:

NVIDIA A

100、

NVIDIA H100 和新的

NVIDIA L40S。我們將跳過(guò)

NVIDIA L4 24GB,因?yàn)樗袷堑投送评砜ā?/div>

2023-11-13 16:13:31 2980

2980

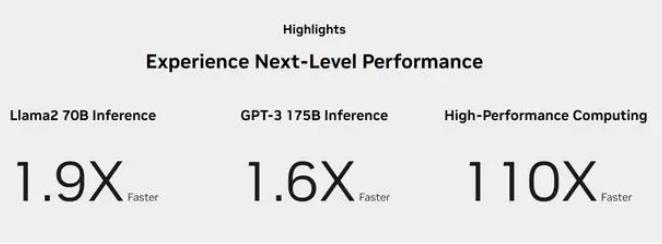

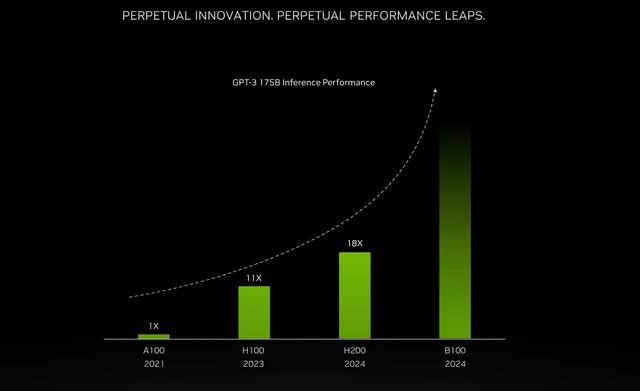

在備受關(guān)注的人工智能領(lǐng)域,英偉達(dá)表示,h200將進(jìn)一步提高性能。llama 2(700億個(gè)llm)的推理速度是h100的兩倍。未來(lái)的軟件更新有望為h200帶來(lái)更多的性能和改進(jìn)。

2023-11-14 10:49:16 1902

1902 報(bào)告稱(chēng),雖然對(duì)被稱(chēng)為“ai加速器芯片”的英偉達(dá)h100的最新版本的需求很大,但amd表示,將在第四季度推出本公司的競(jìng)爭(zhēng)產(chǎn)品mi300,而英特爾將推出比h100更快的“guardi 2”。

2023-11-14 11:18:27 1423

1423 世界頂級(jí)服務(wù)器制造商和云服務(wù)提供商即將推出 HGX H200 系統(tǒng)與云實(shí)例 ? ? 丹佛 - SC23 - 太平洋 時(shí)間 2023 年 11 月 13 日 - NVIDIA 于今日宣布推出

2023-11-14 14:30:01 827

827

生成式AI火爆全球之后,英偉達(dá)的AI芯片一張難求,就在英偉達(dá)重量級(jí)選手H100 AI芯片目前依然是一貨難求的情況下,英偉達(dá)推出新款AI芯片H200。 H100目前算是算力市場(chǎng)硬通貨,而H200則更強(qiáng)

2023-11-14 16:45:50 3283

3283

世界頂級(jí)服務(wù)器制造商和云服務(wù)提供商即將推出 HGX H200 系統(tǒng)與云實(shí)例。 11月13日,NVIDIA 宣布推出 NVIDIA HGX H200 ,為 Hopper 這一全球領(lǐng)先的 AI 計(jì)算平臺(tái)

2023-11-14 20:05:01 923

923

基于英偉達(dá)的“Hopper”架構(gòu)的H200也是該公司第一款使用HBM3e內(nèi)存的芯片,這種內(nèi)存速度更快,容量更大,因此更適合大語(yǔ)言模型。英偉達(dá)稱(chēng):借助HBM3e,H200以每秒4.8TB的速度提供141GB的內(nèi)存,與A100相比,容量幾乎是其兩倍,帶寬增加了2.4倍。

2023-11-15 11:17:31 1955

1955 近日,英偉達(dá)推出了一款用于人工智能工作的頂級(jí)芯片HGX H200。新的GPU升級(jí)了需求巨大的H100,內(nèi)存帶寬增加了1.4倍,內(nèi)存容量增加了1.8倍,提高了其處理密集生成人工智能工作的能力。 在

2023-11-15 14:34:50 2634

2634 HGX H200 由 NVIDIA NVLink 和 NVSwitch 高速互連提供支持,可為各種應(yīng)用工作負(fù)載提供最高性能,包括針對(duì)超過(guò) 1750 億個(gè)參數(shù)的最大模型的 LLM 訓(xùn)練和推理。英偉達(dá)

2023-11-15 16:09:35 2505

2505

很明顯,如果能在相同的功率范圍之內(nèi)實(shí)現(xiàn) 2 倍的性能提升,就意味著實(shí)際能耗和總體擁有成本降低了 50%。所以從理論上講,英偉達(dá)似乎可以讓 H200 GPU 的價(jià)格與 H100 持平。

2023-11-22 17:14:00 3644

3644

這樣,在云端使用 H100 GPU 的排隊(duì)時(shí)間可能會(huì)縮短。數(shù)據(jù)中心提供商和前比特幣挖礦公司正在開(kāi)設(shè)具有 H100 集群的數(shù)據(jù)中心。這些公司承諾以大型云提供商成本的一小部分提供 H100 GPU 計(jì)算,而大型云提供商對(duì) H100 GPU 加速的虛擬機(jī)收取高價(jià)。

2023-11-23 15:59:22 2728

2728 根據(jù)預(yù)測(cè),若H100的年利用率保持在61%,那么單臺(tái)設(shè)備每年將耗電3740千瓦小時(shí)左右。如果英偉達(dá)在2023年售出150萬(wàn)塊H100,2024年再增加至200萬(wàn)塊,那么到2024年底,將有350萬(wàn)塊H100芯片投入使用,其總年用電量將高達(dá)130.91億千瓦小時(shí)(13091.82GWh)。

2023-12-28 09:29:47 4192

4192 據(jù)之前所披露的詳細(xì)數(shù)據(jù),英偉達(dá)HGX H20雖屬與H100和H200同系列,共享英偉達(dá)Hopper架構(gòu),但擁有高達(dá)96GB的HBM3顯存及4.0TB/s的顯存帶寬,計(jì)效包括FP8達(dá)到296TFLOPS和FP16高達(dá)148TFLOPS。其能力僅比當(dāng)前被譽(yù)為“最強(qiáng)者”的AI芯片H200低1/13。

2024-01-03 09:25:19 1851

1851

近期市場(chǎng)風(fēng)傳,英偉達(dá)在中國(guó)大陸的業(yè)務(wù)正面臨萎縮,其他多地市場(chǎng)難以彌補(bǔ)此空缺。除此以外,取代H100的HGX H200新型GPU將在第二季度推出,第三季度其銷(xiāo)售額或呈現(xiàn)增長(zhǎng)趨勢(shì)。然而,客戶(hù)針對(duì)既有H100以及新款H200芯片的訂單調(diào)整帶來(lái)了不確定性。

2024-01-11 09:58:10 1047

1047 是更快、更大的內(nèi)存,可加速生成式AI。H200芯片定于2024年第二季度發(fā)布,Nvidia表示將與“全球系統(tǒng)制造商和云服務(wù)提供商”合作以實(shí)現(xiàn)廣泛可用性。JAEALO

2024-01-17 08:25:26 1867

1867

Supermicro首席執(zhí)行官梁見(jiàn)后先生高瞻遠(yuǎn)矚地指出:針對(duì)AI和ML應(yīng)用的加速處理,我們推薦配置以每機(jī)柜20 PB高速閃存為主,配備四個(gè)NVIDIA HGX H100系列優(yōu)化版8-GPU氣冷服務(wù)器或者八個(gè)同款液冷服務(wù)器。

2024-02-03 14:46:40 1309

1309 為搶占AI商機(jī),英特爾和AMD都緊跟著NVIDIA腳步,在NVIDIA率先推出采用臺(tái)積電4nm的H100后,AMD于去年推出首批應(yīng)用于AI和HPC的“Instinct MI300系列”,其中MI300X更是在部分參數(shù)上超越了NVIDIA H100。

2024-02-21 14:16:28 1985

1985

英偉達(dá)H200是一款新一代AI芯片,于2023年11月14日正式發(fā)布,主要被設(shè)計(jì)用來(lái)處理生成式人工智能負(fù)載的海量數(shù)據(jù)。

2024-03-07 15:48:16 5632

5632 英偉達(dá)H200和H100是兩款不同的AI芯片,它們各自具有獨(dú)特的特點(diǎn)和優(yōu)勢(shì)。以下是關(guān)于這兩款芯片的一些比較。

2024-03-07 15:53:52 9582

9582 英偉達(dá)于2023年11月13日發(fā)布了新一代AI芯片H200,但具體的上市時(shí)間可能因各種因素有所調(diào)整。近期有消息傳出,英偉達(dá)H200預(yù)計(jì)將于2024年第二季度正式上市。然而,這仍然是一個(gè)預(yù)測(cè),并非官方確認(rèn)的上市日期。

2024-03-07 16:04:54 1997

1997 英偉達(dá)H200顯卡的具體價(jià)格尚未公布。根據(jù)上一代H100顯卡的價(jià)格范圍,預(yù)計(jì)H200的單片價(jià)格將超過(guò)40000美元。由于新芯片通常定價(jià)較高,因此可以推斷H200的價(jià)格會(huì)比H100高出許多。

2024-03-07 16:09:03 10369

10369 英偉達(dá)H200不能作為普通顯卡使用。H200是一款專(zhuān)為AI計(jì)算設(shè)計(jì)的芯片,它并不具備普通顯卡的圖形渲染能力。H200的主要用途是處理生成式人工智能負(fù)載的海量數(shù)據(jù),提供強(qiáng)大的計(jì)算能力和高效的內(nèi)存帶寬,以滿(mǎn)足AI任務(wù)的需求。

2024-03-07 16:13:44 4403

4403 英偉達(dá)H200的算力非常強(qiáng)大。作為新一代AI芯片,H200在性能上有了顯著的提升,能夠處理復(fù)雜的AI任務(wù)和大數(shù)據(jù)分析。然而,具體的算力數(shù)值可能因芯片配置、應(yīng)用場(chǎng)景以及優(yōu)化方向等因素而有所不同。

2024-03-07 16:15:04 4437

4437 英偉達(dá)H200和A100在多個(gè)方面存在差異。

2024-03-07 16:18:22 6096

6096 英偉達(dá)H200和A100兩款芯片在性能、架構(gòu)、內(nèi)存以及應(yīng)用場(chǎng)景等多個(gè)方面存在顯著的區(qū)別。

2024-03-07 16:23:44 6674

6674 英偉達(dá)H200和H800在多個(gè)方面存在一些關(guān)鍵性的區(qū)別。

2024-03-07 16:30:09 11462

11462 英偉達(dá)H200性能卓越,集成了高性能CPU和GPU,通過(guò)高速NVLink連接,消除了傳統(tǒng)計(jì)算瓶頸。其配備了高達(dá)141GB的HBM3e高帶寬內(nèi)存,大幅提升了數(shù)據(jù)處理能力。H200能輕松應(yīng)對(duì)TB級(jí)別的模型運(yùn)算,如GPT-4等,相比前代產(chǎn)品性能提升顯著。

2024-03-07 16:39:14 2706

2706 英偉達(dá)H200帶寬的顯著提升主要得益于其強(qiáng)大的硬件配置和先進(jìn)的技術(shù)創(chuàng)新。H200配備了高達(dá)141GB的HBM3e顯存,與前代產(chǎn)品H100相比,內(nèi)存容量提升了76%。更重要的是,H200的顯存帶寬從H100的3.35TB/s增加到了4.8TB/s,提升幅度達(dá)到了43%。

2024-03-07 16:44:49 2266

2266 英偉達(dá)H200于2023年11月13日正式發(fā)布。然而,由于HBM3e芯片供應(yīng)問(wèn)題,其實(shí)際開(kāi)售時(shí)間有所延遲。英偉達(dá)表示,H200產(chǎn)品預(yù)計(jì)將在2024年第二季度正式開(kāi)售。因此,雖然H200在2023年已經(jīng)發(fā)布,但真正的上市時(shí)間是在2024年的第二季度。

2024-03-07 16:46:04 4390

4390 英偉達(dá)H200顯卡是一款表現(xiàn)出色的產(chǎn)品,其在性能、技術(shù)、應(yīng)用等方面都有顯著的優(yōu)勢(shì)。

2024-03-07 16:50:26 3826

3826 英偉達(dá)H200顯卡的參數(shù)非常出色,主要表現(xiàn)在以下幾個(gè)方面。

2024-03-07 17:02:52 6999

6999 該分析師特別指出,英偉達(dá)已在AI GPU市場(chǎng)擁有絕對(duì)優(yōu)勢(shì),現(xiàn)階段主流產(chǎn)品H100 AI GPU表現(xiàn)強(qiáng)勁,預(yù)計(jì)明后年還將推出H200 AI GPU以及Blackwell B100 AI GPU等新品。

2024-03-14 14:36:50 1487

1487 ——? NVIDIA 于今日發(fā)布新一代 AI 超級(jí)計(jì)算機(jī) —— 搭載 NVIDIA GB200 Grace Blackwell 超級(jí)芯片的 NVIDIA DGX SuperPOD?。這臺(tái) AI 超級(jí)計(jì)算機(jī)可以用于處理萬(wàn)億參數(shù)模型,能夠保證

2024-03-19 10:56:35 1126

1126

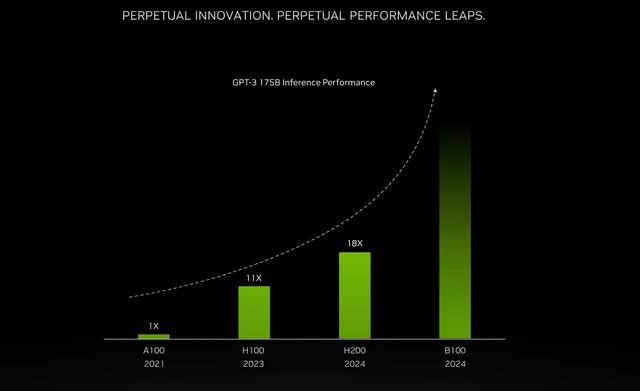

得益于NVIDIA每?jī)赡赀M(jìn)行一次GPU架構(gòu)升級(jí)以提高性能的策略,全新的基于Blackwell的加速卡比之前的H100更為強(qiáng)大,尤其適用于AI相關(guān)任務(wù)。

2024-03-19 12:04:04 1995

1995 NVIDIA 于太平洋時(shí)間 3 月 18 日發(fā)布新一代 AI 超級(jí)計(jì)算機(jī) —— 搭載 NVIDIA GB200 Grace Blackwell 超級(jí)芯片的 NVIDIA DGX SuperPOD?。

2024-03-21 09:49:29 1927

1927 全新 DGX SuperPOD 采用新型高效液冷機(jī)架級(jí)擴(kuò)展架構(gòu),基于 NVIDIA DGX GB200 系統(tǒng)構(gòu)建而成,在 FP4 精度下可提供 11.5 exaflops 的 AI 超級(jí)計(jì)算性能和 240 TB 的快速顯存,且可通過(guò)增加機(jī)架來(lái)擴(kuò)展性能。

2024-03-21 09:49:47 698

698 超微電腦Supermicro近日宣布,其全新一代人工智能系統(tǒng)已正式問(wèn)世,該系統(tǒng)基于NVIDIA的革命性Blackwell架構(gòu),展現(xiàn)了前所未有的人工智能性能。該系列新品包括NVIDIA GB200

2024-03-25 10:27:44 1419

1419 同一天,NVIDIA發(fā)布了H200的性能評(píng)估報(bào)告,表明在與美國(guó)Meta公司的大型語(yǔ)言模型——LLM“Llama 2”的對(duì)比中,H200使AI導(dǎo)出答案的處理速度最高提升了45%。

2024-04-01 09:36:59 2136

2136 為應(yīng)對(duì)AI行業(yè)對(duì)高性能芯片的巨大需求,英特爾推出了全新Gaudi 3芯片,據(jù)稱(chēng)這一款芯片在訓(xùn)練大語(yǔ)言模型方面的速度較之NVIDIA最新H100處理器要快50%。而且,其推理運(yùn)算速度也超過(guò)了部分H100芯片。

2024-04-10 09:26:46 835

835 OpenAI總裁兼聯(lián)合創(chuàng)始人Greg Brockman分享了他與山姆?阿爾特曼(Sam Altman)、黃仁勛以及自己的合影,他們的眼前正是這臺(tái)首次亮相的DGX H200。

2024-04-25 13:50:24 966

966 微軟將大規(guī)模采用AMD的旗艦產(chǎn)品MI300X,并通過(guò)Azure云計(jì)算平臺(tái)向用戶(hù)提供計(jì)算集群服務(wù)。鑒于Nvidia的H100和H200芯片供應(yīng)緊張,微軟決定提供備選方案。

2024-05-17 16:38:25 1383

1383 中國(guó)臺(tái)灣當(dāng)?shù)卣思瘓F(tuán)5月27日宣布,將與日本公司Ubitus共同打造人工智能(AI)計(jì)算中心,其中第一期將導(dǎo)入128個(gè)機(jī)柜,共計(jì)1024張英偉達(dá)H100旗艦計(jì)算卡,旨在構(gòu)建臺(tái)灣最大的AI計(jì)算中心。

2024-05-29 10:05:59 2389

2389 ,到2022年的Hopper,再到2024年的Blackwell,每次的革新都為AI應(yīng)用帶來(lái)了巨大的飛躍。以H100為例,作為Hopper架構(gòu)的代表,市場(chǎng)反響熱烈;而B(niǎo)200作為Blackwell架構(gòu)的最新力作,性能更為出色。

2024-06-05 15:28:38 1729

1729 在科技界的前沿陣地上,埃隆·馬斯克再次以其前瞻性的視野和大膽的嘗試引領(lǐng)著新的風(fēng)潮。近日,馬斯克在社交媒體X上的一則回應(yīng),不經(jīng)意間透露了其即將推出的AI聊天機(jī)器人Grok 3背后的驚人秘密——這款被馬斯克譽(yù)為“非常特別”的AI產(chǎn)品,竟然是通過(guò)10萬(wàn)塊英偉達(dá)H100芯片的訓(xùn)練才得以誕生的。

2024-07-03 14:16:42 1632

1632 在科技日新月異的今天,每一次技術(shù)的飛躍都預(yù)示著行業(yè)格局的深刻變革。7月3日,臺(tái)灣媒體《工商時(shí)報(bào)》傳來(lái)重磅消息,英偉達(dá)(NVIDIA)的旗艦級(jí)AI計(jì)算產(chǎn)品——H200,已在二季度末正式邁入量產(chǎn)階段

2024-07-03 16:22:54 1877

1877 英偉達(dá)AI GPU市場(chǎng)迎來(lái)新動(dòng)態(tài),其H200型號(hào)上游芯片端已于第二季度下旬正式進(jìn)入量產(chǎn)階段,預(yù)示著該產(chǎn)品將在第三季度后迎來(lái)大量交付。然而,英偉達(dá)Blackwell平臺(tái)的提前上市,至少領(lǐng)先H200一到兩個(gè)季度,這一變化對(duì)終端客戶(hù)的采購(gòu)意愿產(chǎn)生了顯著影響。

2024-07-04 10:29:23 1806

1806 旨在替代H100/H200的B200 GPU、與Grace CPU深度融合的GB200以及GB200 NVL36/NVL72計(jì)算平臺(tái)等多種型號(hào)。值得期待的是,未來(lái)英偉達(dá)還將會(huì)推出更多種類(lèi)和規(guī)格的新品。據(jù)悉,這些基于Blackwell架構(gòu)的各類(lèi)產(chǎn)品將于今年下半年開(kāi)始陸續(xù)出貨。

2024-07-25 15:27:00 1019

1019 隨著人工智能技術(shù)的飛速發(fā)展,AI服務(wù)器的算力與功耗需求同步飆升,NVIDIA即將推出的下一代Blackwell平臺(tái)更是將這一趨勢(shì)推向了新的高度。集邦咨詢(xún)最新報(bào)告指出,隨著Blackwell平臺(tái)的臨近

2024-08-01 16:35:41 2415

2415 今年3月份,英偉達(dá)在美國(guó)加利福尼亞州圣何塞會(huì)議中心召開(kāi)的GTC 2024大會(huì)上推出了Blackwell架構(gòu)GPU。原定于今年底出貨的B100/B200被寄予厚望,將替代現(xiàn)行H100/H200,并有與Grace CPU協(xié)作的GB200等待發(fā)布。然而,近日有消息稱(chēng),英偉達(dá)可能放棄B100,轉(zhuǎn)而使用B200A。

2024-08-08 17:19:57 1580

1580 Supermicro, Inc.,作為人工智能(AI)、云端、存儲(chǔ)和5G/Edge領(lǐng)域的整體IT解決方案提供商,近日宣布推出面向人工智能數(shù)據(jù)中心的液冷超級(jí)集群。該集群由英偉達(dá)GB200 NVL72和英偉達(dá)HGX B200系統(tǒng)提供支持,開(kāi)創(chuàng)了高能效超大規(guī)模計(jì)算的新紀(jì)元。

2024-10-22 17:37:43 1330

1330 隨著英偉達(dá)新一代AI芯片GB200需求的不斷攀升,其上一代明星產(chǎn)品H100芯片卻遭遇了市場(chǎng)的冷落。據(jù)業(yè)內(nèi)人士透露,搭載H100的服務(wù)器通常以8卡的形式進(jìn)行出售或出租,而在去年,這類(lèi)服務(wù)器的售價(jià)普遍

2024-10-28 15:42:17 2519

2519 NVIDIA 推出個(gè)人 AI 超級(jí)計(jì)算機(jī) NVIDIA Project DIGITS,全球的 AI 研究員、數(shù)據(jù)科學(xué)家和學(xué)生都可獲取 NVIDIA Grace Blackwell 平臺(tái)的強(qiáng)大功能。

2025-01-08 11:03:32 1221

1221 Supermicro, Inc.,作為人工智能/機(jī)器學(xué)習(xí)、高性能計(jì)算、云、存儲(chǔ)和5G/Edge領(lǐng)域的整體IT解決方案提供商,近日宣布其基于NVIDIA Blackwell平臺(tái)加速的端對(duì)端人工智能

2025-02-11 09:45:04 717

717 英偉達(dá)GTC25亮點(diǎn):NVIDIA Blackwell Ultra 開(kāi)啟 AI 推理新時(shí)代

2025-03-20 15:35:40 1299

1299 NVIDIA Blackwell數(shù)據(jù)手冊(cè)與NVIDIA Blackwell 架構(gòu)技術(shù)解析

2025-03-20 17:19:09 2004

2004 NVIDIA Blackwell白皮書(shū):NVIDIA Blackwell Architecture Technical Brief

2025-03-20 18:35:10 2673

2673 NVIDIA GTC 推出新一代專(zhuān)業(yè)級(jí) GPU 和 AI 賦能的開(kāi)發(fā)者工具—同時(shí),ChatRTX 更新現(xiàn)已支持 NVIDIA NIM,RTX Remix 正式結(jié)束測(cè)試階段,本月的 NVIDIA Studio 驅(qū)動(dòng)現(xiàn)已開(kāi)放下載。

2025-03-28 09:59:22 1161

1161 今天我們帶來(lái)全新 NVIDIA Blackwell 架構(gòu) GPU —— NVIDIA RTX PRO 4500 Blackwell 的測(cè)試,對(duì)比上一代產(chǎn)品 NVIDIA RTX 4500 Ada Generation 具體有哪些提升。

2025-08-28 11:02:12 3473

3473

上市。目前,Supermicro 正向全球客戶(hù)交付支持即插即用 (PnP) 的 NVIDIA HGX B300 系統(tǒng)和 GB300 NVL72 機(jī)架。

2025-09-17 17:00:40 735

735 、H100和H200。 ? 報(bào)道,有知情人士透露最近幾周,美國(guó)政府官員一直在私下討論美國(guó)可以對(duì)華出售哪些芯片。一些人認(rèn)為,與英偉達(dá)Blackwell先進(jìn)芯片相比,向中國(guó)出售H200處理器是一種妥協(xié)方案;還有一些人支持向中國(guó)提供更先進(jìn)的處理器,例如Blackwell和Hopper。此外

2025-11-24 11:10:17 812

812 一種“妥協(xié)”。此前,英偉達(dá)一直希望向中國(guó)銷(xiāo)售其更先進(jìn)的Blackwell系列芯片,但美政府目前仍明確表示不贊成。H200芯片性能雖低于Blackwell,但強(qiáng)于此前已獲準(zhǔn)對(duì)華出口的H20芯片,主要用于AI模型的訓(xùn)練和運(yùn)行。

2025-12-09 17:58:20 1276

1276 NVIDIA RTX PRO 5000 72GB Blackwell GPU 現(xiàn)已全面上市,將基于 NVIDIA Blackwell 架構(gòu)的強(qiáng)大代理式與生成式 AI 能力帶到更多桌面和專(zhuān)業(yè)用戶(hù)手中。

2025-12-24 10:32:04 466

466

兼容,在推理速度上幾乎達(dá)到H100的兩倍。H200預(yù)計(jì)將于明年二季度開(kāi)始交付。此外,英偉達(dá)還透露,下一代Blackwell B100 GPU也將在2024年推出。 ? 英偉達(dá)預(yù)計(jì)在2024年推出H200

2023-11-15 01:15:00 5794

5794

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論