NVIDIA 的使命是加快我們的時代達芬奇和愛因斯坦的工作,并賦予他們解決社會的巨大挑戰(zhàn)。隨著 人工智能 ( AI )、 高性能計算 ( HPC )和數據分析的復雜性呈指數級增長,科學家需要一個先進的計算平臺,能夠在一個十年內實現百萬次的加速,以解決這些非同尋常的挑戰(zhàn)。

為了回答這個需求,我們介紹了NVIDIA HGX H100 ,一個由 NVIDIA Hopper 架構 供電的密鑰 GPU 服務器構建塊。這一最先進的平臺安全地提供了低延遲的高性能,并集成了從網絡到數據中心級計算(新的計算單元)的全套功能。

在這篇文章中,我將討論NVIDIA HGX H100 是如何幫助我們加速計算數據中心平臺的下一個巨大飛躍。

HGX H100 8-GPU

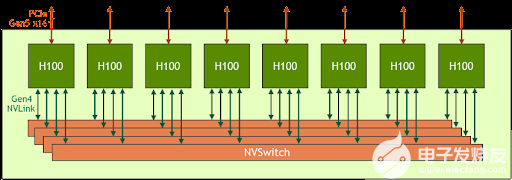

HGX H100 8- GPU 是新一代 Hopper GPU 服務器的關鍵組成部分。它擁有八個 H100 張量核 GPU 和四個第三代 NV 交換機。每個 H100 GPU 都有多個第四代 NVLink 端口,并連接到所有四個 NVLink 交換機。每個 NVSwitch 都是一個完全無阻塞的交換機,完全連接所有八個 H100 Tensor Core GPU 。

圖 1 。 HGX H100 8-GPU 的高級框圖

NVSwitch 的這種完全連接的拓撲結構使任何 H100 都可以同時與任何其他 H100 通話。值得注意的是,這種通信以每秒 900 千兆字節(jié)( GB / s )的 NVLink 雙向速度運行,這是當前 PCIe Gen4 x16 總線帶寬的 14 倍多。

第三代 NVSwitch 還為集體運營提供了新的硬件加速,多播和 NVIDIA 的網絡規(guī)模大幅縮減。結合更快的 NVLink 速度,像all-reduce這樣的普通人工智能集體操作的有效帶寬比 HGX A100 增加了 3 倍。集體的 NVSwitch 加速也顯著降低了 GPU 上的負載。

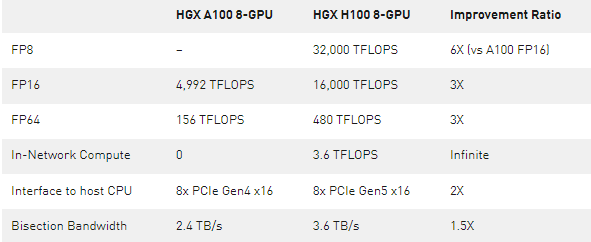

表 1 。將 HGX A100 8- GPU 與新的 HGX H100 8-GPU 進行比較

*注: FP 性能包括稀疏性

HGX H100 8- GPU 支持 NVLink 網絡

新興的 exascale HPC 和萬億參數人工智能模型(用于精確對話人工智能等任務)需要數月的訓練,即使是在超級計算機上。將其壓縮到業(yè)務速度并在數小時內完成培訓需要服務器集群中每個 GPU 之間的高速、無縫通信。

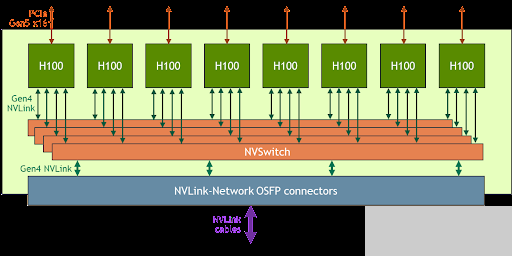

為了解決這些大的使用案例,新的 NVLink 和 NVSwitch 旨在使 HGX H100 8- GPU 能夠通過新的 NVLink 網絡擴展并支持更大的 NVLink 域。 HGX H100 8- GPU 的另一個版本具有這種新的 NVLink 網絡支持。

圖 2 。支持 NVLink 網絡的 HGX H100 8- GPU 的高級框圖

使用 HGX H100 8- GPU 和 NVLink 網絡支持構建的系統(tǒng)節(jié)點可以通過八進制小尺寸可插拔( OSFP ) LinkX 電纜和新的外部 NVLink 交換機完全連接到其他系統(tǒng)。此連接最多支持 256 個 GPU NVLink 域。圖 3 顯示了集群拓撲。

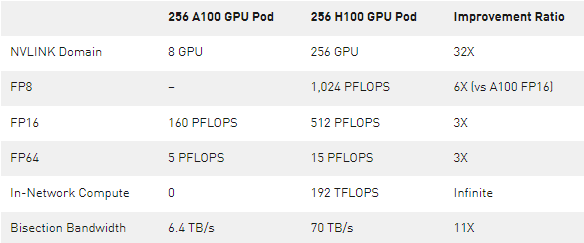

表 2 。比較 256 個 A100 GPU 吊艙和 256 個 H100 GPU 吊艙

*注: FP 性能包括稀疏性

目標用例和性能優(yōu)勢

隨著 HGX H100 計算和網絡能力的大幅增加, AI 和 HPC 應用程序的性能得到了極大的提高。

今天的主流 AI 和 HPC 模型可以完全駐留在單個節(jié)點的聚合 GPU 內存中。例如, BERT -Large 、 Mask R-CNN 和 HGX H100 是最高效的培訓解決方案。

對于更先進、更大的 AI 和 HPC 模型,該模型需要多個聚合 GPU 內存節(jié)點才能適應。例如,具有 TB 級嵌入式表的深度學習推薦模型( DLRM )、大量混合專家( MoE )自然語言處理模型,以及具有 NVLink 網絡的 HGX H100 加速了關鍵通信瓶頸,是此類工作負載的最佳解決方案。

圖 4 來自 NVIDIA H100 GPU 體系結構 白皮書顯示了 NVLink 網絡帶來的額外性能提升。

所有性能數據都是基于當前預期的初步數據,可能會隨著運輸產品的變化而變化。 A100 集群: HDR IB 網絡。 H100 集群: NDR IB 網絡和 NVLink 網絡,如圖所示。

# GPU :氣候建模 1K , LQCD 1K ,基因組學 8 , 3D-FFT 256 , MT-NLG 32 (批次大小: A100 為 4 , 1 秒 H100 為 60 , A100 為 8 , 1.5 和 2 秒 H100 為 64 ), MRCNN 8 (批次 32 ), GPT-3 16B 512 (批次 256 ), DLRM 128 (批次 64K ), GPT-3 16K (批次 512 ), MoE 8K (批次 512 ,每個 GPU 一名專家)?

HGX H100 4-GPU

除了 8- GPU 版本外, HGX 系列還具有一個 4-GPU 版本,該版本直接與第四代 NVLink 連接。

H100 對 H100 點對點對等 NVLink 帶寬為 300 GB / s 雙向,比今天的 PCIe Gen4 x16 總線快約 5 倍。

HGX H100 4- GPU 外形經過優(yōu)化,可用于密集 HPC 部署:

多個 HGX H100 4- GPU 可以裝在 1U 高液體冷卻系統(tǒng)中,以最大化每個機架的 GPU 密度。

帶有 HGX H100 4- GPU 的完全無 PCIe 交換機架構直接連接到 CPU ,降低了系統(tǒng)材料清單并節(jié)省了電源。

對于 CPU 更密集的工作負載, HGX H100 4- GPU 可以與兩個 CPU 插槽配對,以提高 CPU 與 GPU 的比率,從而實現更平衡的系統(tǒng)配置。

人工智能和高性能計算的加速服務器平臺

NVIDIA 正與我們的生態(tài)系統(tǒng)密切合作,在今年晚些時候將基于 HGX H100 的服務器平臺推向市場。我們期待著把這個強大的計算工具交給你們,使你們能夠以人類歷史上最快的速度創(chuàng)新和完成你們一生的工作。

關于作者

William Tsu NVIDIA HGX 數據中心產品線的產品管理。他與客戶和合作伙伴合作,將世界上性能最高的人工智能、深度學習和 HPC 服務器平臺推向市場。威廉最初加入NVIDIA 是作為一名圖形處理器芯片設計師。他是最初的 PCI Express 行業(yè)標準規(guī)范的共同作者,也是 12 項專利的共同發(fā)明人。威廉獲得了他的學士學位,碩士學位在計算機科學和 MBA 從加利福尼亞大學,伯克利。

審核編輯:郭婷

-

NVIDIA

+關注

關注

14文章

5592瀏覽量

109720 -

數據中心

+關注

關注

18文章

5647瀏覽量

75009 -

人工智能

+關注

關注

1817文章

50094瀏覽量

265298 -

H100

+關注

關注

0文章

33瀏覽量

588

發(fā)布評論請先 登錄

微軟Azure數據中心國際版全面對接NVIDIA Rubin平臺

48V電壓在數據中心計算平臺中至關重要

科通技術亮相2025上海國際數據中心及云計算產業(yè)展覽會

Cadence 借助 NVIDIA DGX SuperPOD 模型擴展數字孿生平臺庫,加速 AI 數據中心部署與運營

加速AI未來,睿海光電800G OSFP光模塊重構數據中心互聯標準

中型數據中心中的差分晶體振蕩器應用與匹配方案

小型數據中心晶振選型關鍵參數全解

磁懸浮冷站引領綠色革命,維諦技術(Vertiv)助力中國電信江西云計算數據中心制冷系統(tǒng)實現PUE1.2

利用NVIDIA技術構建從數據中心到邊緣的智慧醫(yī)院解決方案

GPU 維修干貨 | 英偉達 GPU H100 常見故障有哪些?

適用于數據中心和AI時代的800G網絡

NVIDIA加速的Apache Spark助力企業(yè)節(jié)省大量成本

利用NVIDIA HGX H100加速計算數據中心平臺應用

利用NVIDIA HGX H100加速計算數據中心平臺應用

評論