面向表格數(shù)據(jù)的大模型推理綜述

1.介紹

面向表格數(shù)據(jù)的推理任務(wù),在計(jì)算機(jī)領(lǐng)域,特別是自然語(yǔ)言處理(Natural Language Processing,NLP)領(lǐng)域的研究中扮演著重要角色[1]。該任務(wù)要求模型在給定一個(gè)或多個(gè)表格的情況下,按照任務(wù)要求,生成相應(yīng)的結(jié)果作為答案(例如:表格問答、表格事實(shí)判斷)。尤其在大數(shù)據(jù)時(shí)代,從海量數(shù)據(jù)中獲取用戶所需信息變得尤為困難,而這些數(shù)據(jù)的主要存儲(chǔ)形式就是結(jié)構(gòu)化數(shù)據(jù)(例如:表格、數(shù)據(jù)庫(kù))。因此,構(gòu)建能夠從龐雜的結(jié)構(gòu)化數(shù)據(jù)中高效準(zhǔn)確地推理出所需信息的系統(tǒng)變得越來越重要,表明了表格推理任務(wù)的重要性。為了簡(jiǎn)潔,在本文中我們將“面向表格數(shù)據(jù)的推理任務(wù)”簡(jiǎn)稱為“表格推理任務(wù)”。

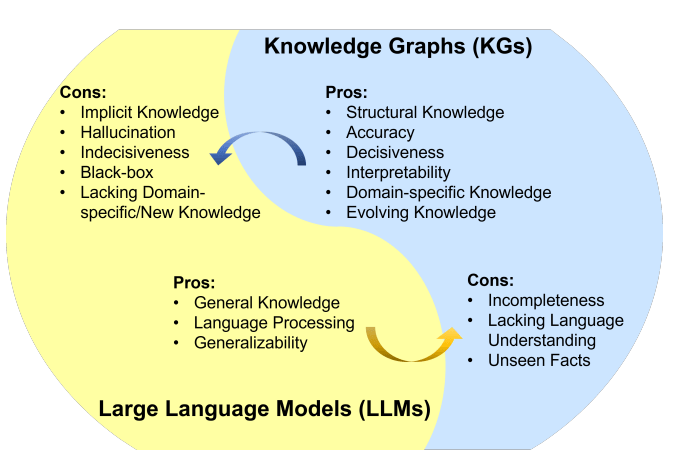

過去表格推理的研究大致經(jīng)過了基于規(guī)則[2]、基于神經(jīng)網(wǎng)絡(luò)[3]以及基于預(yù)訓(xùn)練模型[4](Pre-Trained Language Model)幾個(gè)階段。最近的研究表明,大規(guī)模語(yǔ)言模型(Large Language Model,LLM)在各個(gè)NLP任務(wù)上都表現(xiàn)出了引人注目的性能[5],尤其是,無(wú)需大規(guī)模數(shù)據(jù)微調(diào)就能遷移到各個(gè)任務(wù)上的上下文學(xué)習(xí)能力,極大地降低了標(biāo)注需求。考慮到表格推理多樣的任務(wù)與較高的標(biāo)注開銷,已有許多工作將LLM應(yīng)用到表格推理任務(wù)上,增強(qiáng)LLM的表格推理能力,取得了非常優(yōu)異的結(jié)果。然而,由于基于LLM的研究與過去的研究范式存在較顯著的差異,而目前缺乏對(duì)基于LLM的表格推理的工作的總結(jié)與分析,一定程度上阻礙了該方向的研究。

因此,我們?cè)诒疚膶?duì)現(xiàn)有的基于LLM的表格推理相關(guān)工作進(jìn)行梳理,來促進(jìn)該領(lǐng)域上的研究。本文的結(jié)構(gòu)組織如下:第2節(jié),我們介紹表格推理任務(wù)的定義與主流數(shù)據(jù)集,來作為我們后續(xù)分析的基礎(chǔ);第3節(jié),我們給出了基于LLM的表格推理方法的分類,并總結(jié)了該任務(wù)現(xiàn)有的研究工作,來幫助研究者了解表格推理任務(wù)未來可能的研究方向;第4節(jié),我們給出了各個(gè)研究方向的可能改進(jìn),啟發(fā)未來的研究思路。

2. 背景

2.1. 任務(wù)定義

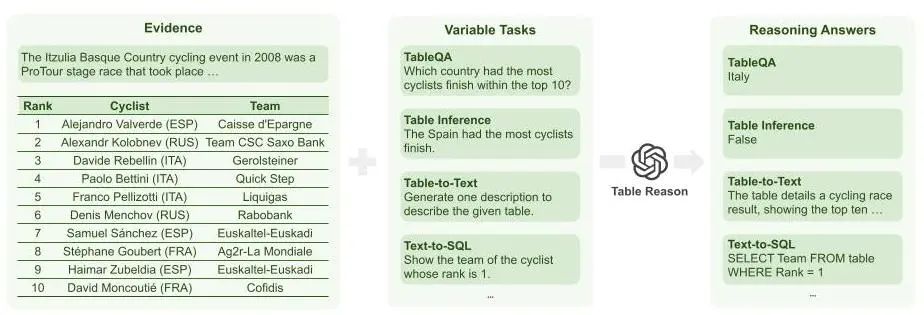

圖1:表格推理示意圖

作為我們后續(xù)討論的基礎(chǔ),在這一小節(jié),我們簡(jiǎn)要給出表格推理任務(wù)的定義。

在表格推理任務(wù)中,模型的輸入是用戶對(duì)模型提出的要求或問題、結(jié)構(gòu)化數(shù)據(jù),以及可選的表格文字說明,輸出則是對(duì)用戶提出的要求或問題的回答,具體包括表格問答、事實(shí)驗(yàn)證、table-to-text以及text-to-SQL等,相關(guān)表格推理任務(wù)的總結(jié)如圖1所示。

2.2. 相關(guān)數(shù)據(jù)集

盡管目前主流工作在使用LLM解決表格推理任務(wù)時(shí),一般會(huì)使用基于上下文學(xué)習(xí)的方法來進(jìn)行預(yù)測(cè),而無(wú)需數(shù)據(jù)進(jìn)行訓(xùn)練,但人們依然需要依賴標(biāo)注數(shù)據(jù),來驗(yàn)證LLM在解決表格推理任務(wù)時(shí)的性能。因此在這一小節(jié),我們將針對(duì)四個(gè)目前主流的表格推理任務(wù),分別介紹相關(guān)的主流數(shù)據(jù)集:

表格問答:WikiTableQuestions[3]數(shù)據(jù)集作為第一個(gè)表格問答類的數(shù)據(jù)集,由于其開放域的表格和復(fù)雜的查詢問題,使得該數(shù)據(jù)集能夠充分驗(yàn)證模型的表格問答能力;

表格事實(shí)驗(yàn)證:TabFact[6]數(shù)據(jù)集作為第一個(gè)表格事實(shí)驗(yàn)證類的數(shù)據(jù)集,其大規(guī)模跨領(lǐng)域的表格數(shù)據(jù)和復(fù)雜的推理需求,可以有效檢驗(yàn)?zāi)P驮诒砀袷聦?shí)驗(yàn)證任務(wù)上的能力;

table-to-text:ToTTo[7]數(shù)據(jù)集通過高亮特定的表格內(nèi)容生成相關(guān)描述,因其大規(guī)模高質(zhì)量的表格數(shù)據(jù)及對(duì)應(yīng)描述能很好地驗(yàn)證模型的table-to-text能力,而成為table-to-text任務(wù)的主流數(shù)據(jù)集;

text-to-SQL:Spider[8]是第一個(gè)text-to-SQL任務(wù)上多領(lǐng)域、多表格的數(shù)據(jù)集,在text-to-SQL任務(wù)上被廣泛使用。

3. 前沿進(jìn)展

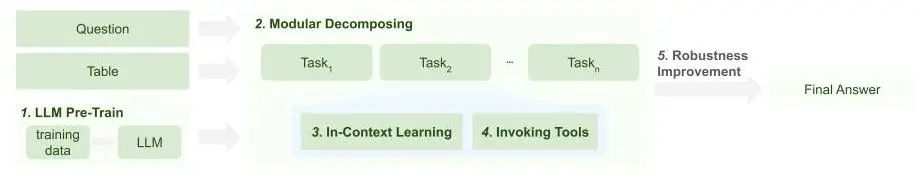

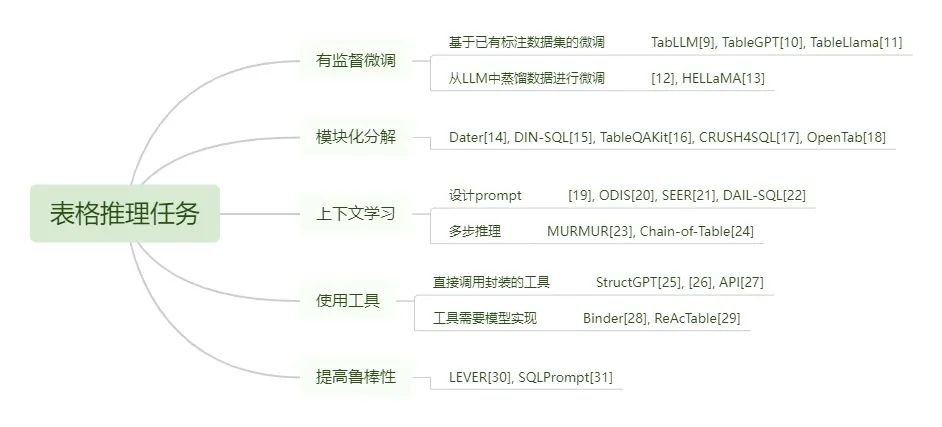

圖2:表格推理方法分類

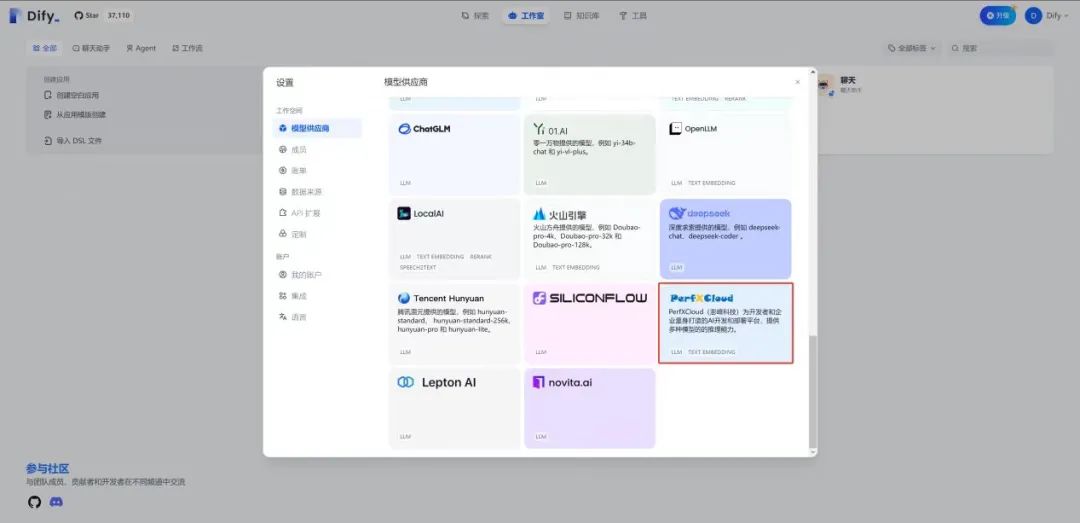

為了幫助研究者們更深入地了解從何種角度提升模型的表格推理能力,我們將現(xiàn)有基于LLM的表格推理相關(guān)研究分為5類,分別為:有監(jiān)督微調(diào)(LLM Pre-Train)、模塊化分解(Decomposed Pipeline)、上下文學(xué)習(xí)(In-Context Learning)、使用工具(Invoking Tools),以及提高魯棒性(Robustness Improvement),各個(gè)分類間的關(guān)系如圖2所示。我們將在本節(jié)詳細(xì)介紹這種分類標(biāo)準(zhǔn)的原因以及具體分類信息。并且,為了讀者更好地了解現(xiàn)有研究的進(jìn)展,我們將詳細(xì)介紹這5種類別下研究者們解決表格推理任務(wù)的具體措施,如圖3所展現(xiàn)。同時(shí),為了幫助人們更好地理解與PLM時(shí)代研究的差異,我們還討論了每個(gè)分類下,基于LLM的研究相較于基于PLM研究的變化。

圖3:表格推理前沿進(jìn)展總結(jié)

3.1. 有監(jiān)督微調(diào)

有監(jiān)督微調(diào)是指用有標(biāo)注數(shù)據(jù)微調(diào)LLM,從而增強(qiáng)LLM的表格推理能力。現(xiàn)有的研究結(jié)果表明,部分開源大模型解決表格相關(guān)任務(wù)的能力較弱,所以希望通過有監(jiān)督微調(diào)提升模型的表格推理能力。

現(xiàn)有的LLM表格推理的有監(jiān)督微調(diào)工作分為兩類:基于已有標(biāo)注數(shù)據(jù)集的微調(diào),以及從LLM中蒸餾數(shù)據(jù)進(jìn)行微調(diào)。

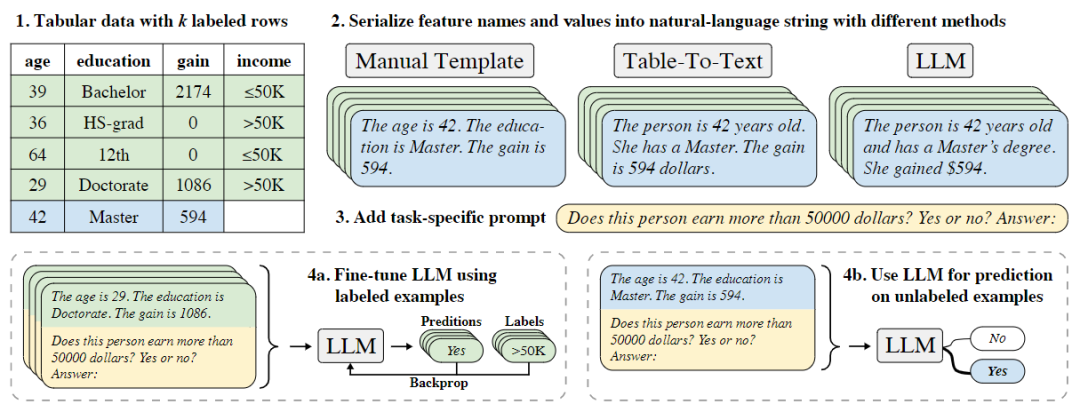

關(guān)于基于已有標(biāo)注數(shù)據(jù)集進(jìn)行微調(diào)的工作,受到LLM能夠在少量或沒有標(biāo)注數(shù)據(jù)的情況下達(dá)到很好的性能的啟發(fā),TabLLM[9],如圖4所示,通過用少量有標(biāo)注數(shù)據(jù)微調(diào)T0有效提升了模型在表格數(shù)據(jù)分類任務(wù)上的性能。TableGPT[10]觀察到LLM在解決領(lǐng)域內(nèi)問題時(shí)性能下降,所以使用精心選擇的領(lǐng)域內(nèi)數(shù)據(jù)微調(diào)LLM以增強(qiáng)模型的領(lǐng)域內(nèi)知識(shí)。TableLlama[11]考慮到前人工作只支持特定類型的表格和任務(wù),或者模型微調(diào)只能學(xué)習(xí)到進(jìn)行預(yù)定義的表格操作,因此從廣泛使用的數(shù)據(jù)集中選擇具有代表性的表格任務(wù)構(gòu)建了TableInstruct數(shù)據(jù)集,并在此上微調(diào)LLM很好地提升了模型泛化性。

圖4:TabLLM方法示意圖

而關(guān)于從LLM中蒸餾數(shù)據(jù)的工作,[12]觀察到開源小模型缺乏在復(fù)雜推理的table-to-text任務(wù)上的性能落后于LLM,于是使用LLM作為教師模型蒸餾CoT推理和表格描述,并用蒸餾數(shù)據(jù)微調(diào)開源模型,有效地將表格推理能力轉(zhuǎn)移到較小的模型上。而HELLaMA[13]關(guān)注到部分通用模型缺乏根據(jù)輸入在表格中定位依據(jù)的能力,因此通過使用其他LLM預(yù)測(cè)表格描述定位在表格中的位置獲得訓(xùn)練數(shù)據(jù)微調(diào)開源模型,而且微調(diào)模型完成根據(jù)突出顯示的表格部分完成表格摘要。

基于已有數(shù)據(jù),或者蒸餾數(shù)據(jù)微調(diào)的兩種方法體現(xiàn)了LLM時(shí)代研究者進(jìn)行有監(jiān)督微調(diào)的兩種思路,通過不同的途徑收集標(biāo)注數(shù)據(jù)用來訓(xùn)練。

在PLM時(shí)代,研究者也會(huì)對(duì)模型有監(jiān)督微調(diào),但與LLM時(shí)代不同,研究者只能期待提升模型在某一類表格推理任務(wù)上的性能[32],受限于預(yù)訓(xùn)練模型的能力,無(wú)法通過微調(diào)提升模型在所有表格推理任務(wù)上的泛化能力。

3.2. 模塊化分解

模塊化分解指將復(fù)雜任務(wù)顯式地分解為多個(gè)子任務(wù),來完成表格推理任務(wù)。研究者發(fā)現(xiàn)將任務(wù)分解為簡(jiǎn)單的子任務(wù)后,完成各個(gè)子任務(wù)比完成整個(gè)復(fù)雜任務(wù)更為容易,可以提升LLM在復(fù)雜任務(wù)上的性能,所以希望通過合理分解復(fù)雜表格推理任務(wù)來提升模型性能。

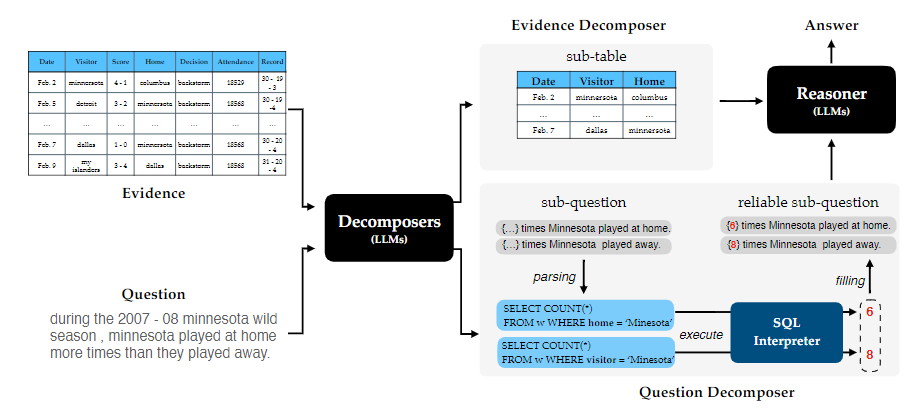

DATER[14]和 DIN-SQL[15]都注意到將復(fù)雜問題分解為簡(jiǎn)單子問題可以有效促進(jìn)大模型多步推理,因此兩篇文章分別針對(duì)表格推理任務(wù),以及單獨(dú)的text-to-SQL任務(wù)設(shè)計(jì)了不同的流水線方法將復(fù)雜推理任務(wù)分解來降低模型推理難度。

圖5:DATER方法示意圖

TableQAKit[16]發(fā)現(xiàn)TableQA任務(wù)面臨著有巨大差異的數(shù)據(jù)和任務(wù)形式,阻礙了研究的便利性。因此提出了TableQAKit,一個(gè)能夠支持幾乎所有TableQA場(chǎng)景、支持LLM的統(tǒng)一工具包。TableQAKit將TableQA的任務(wù)框架分成了配置模塊、統(tǒng)一數(shù)據(jù)形式模塊、使用模型模塊,以及評(píng)估模塊。

CRUSH4SQL[17]和OpenTab[18]則關(guān)注到開放域的表格推理任務(wù),通過將任務(wù)分解為先檢索問題相關(guān)表格,再用LLM推理的過程,緩解了大量無(wú)關(guān)信息的輸入給模型帶來推理難度增加的問題。在用PLM解決表格推理任務(wù)時(shí),人們也會(huì)通過將任務(wù)模塊化分解為簡(jiǎn)單子任務(wù)來降低整體任務(wù)難度,但針對(duì)每一個(gè)子任務(wù)都需要額外的訓(xùn)練數(shù)據(jù)單獨(dú)訓(xùn)練一個(gè)模型來解決[32],而LLM可以很好地利用其上下文學(xué)習(xí)能力及泛化性,不再需要對(duì)每一個(gè)表格類子任務(wù)專門訓(xùn)練。

3.3. 上下文學(xué)習(xí)

上下文學(xué)習(xí)是指LLM在不用微調(diào)的情況下,通過設(shè)計(jì)prompt來增強(qiáng)表格推理能力。研究者們認(rèn)為部分LLM無(wú)需微調(diào)就已經(jīng)具備表格推理能力。但由于LLM的表現(xiàn)性能嚴(yán)重依賴于輸入的上下文,如何通過上下文學(xué)習(xí)更好地激發(fā)模型的表格推理能力成為一個(gè)需要研究的問題。

為了增強(qiáng)LLM的上下文學(xué)習(xí)能力,現(xiàn)有的工作主要遵循兩條研究思路:通過設(shè)計(jì)prompt,來直接增強(qiáng)LLM的上下文學(xué)習(xí)能力;通過將推理過程分解為多步,來降低單步LLM的上下文學(xué)習(xí)的難度。

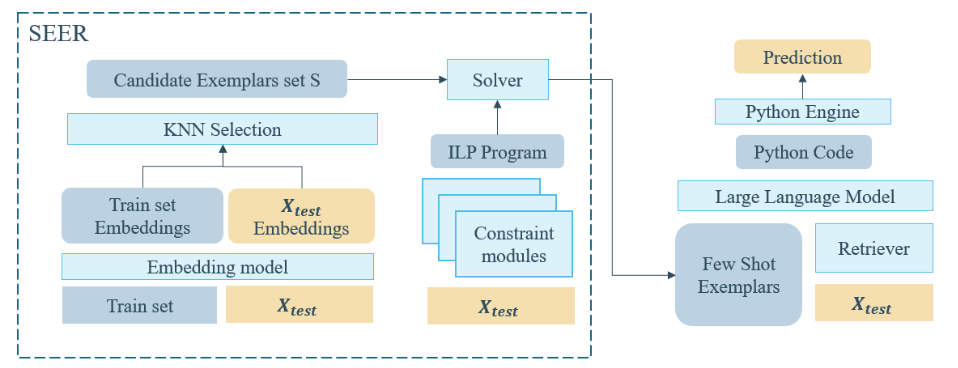

關(guān)于直接設(shè)計(jì)prompt的相關(guān)工作,[19]工作最先探索并證明了LLM具有上下文學(xué)習(xí)的表格推理能力。ODIS[20]觀察到前人工作在上下文學(xué)習(xí)時(shí)不提供示例,或只提供領(lǐng)域外的示例但研究表明,領(lǐng)域內(nèi)示例可以顯著提高LLM性能,因此提出基于SQL相似度合成領(lǐng)域內(nèi)SQL,再用LLM生成對(duì)應(yīng)問題作為領(lǐng)域內(nèi)示例。DAIL-SQL[21]為了系統(tǒng)探索高效prompt工程,提出了基于掩碼后問題的相似度選擇示例,并且省略其數(shù)據(jù)庫(kù)模式以減少輸入長(zhǎng)度。而SEER[22]為了解決HybridQA任務(wù)在上下文學(xué)習(xí)中示例選擇的挑戰(zhàn),尤其是用戶問題和示例中推理路徑的相關(guān)性小的問題,如圖6所示,根據(jù)問題向量之間的相似度,以及分類器預(yù)測(cè)的問題的推理鏈,從數(shù)據(jù)中選擇示例。

圖6:SEER方法示意圖

關(guān)于prompt分解推理過程的工作,MURMUR[23]發(fā)現(xiàn)data-to-text任務(wù)直接提示LLM推理易導(dǎo)致幻覺,而提示CoT推理缺乏推理步驟之間的明確條件,損害正確性,并且以不同的順序線性化數(shù)據(jù)易造成較大的方差。因此,MURMUR提出首先依據(jù)預(yù)先定義的語(yǔ)法規(guī)則在每一步使用束搜索算法選擇可能正確的模型范圍,再根據(jù)打分模型選擇最好的模型,以及相應(yīng)的輸入形式。CHAIN-OF-TABLE[24]則為了降低單跳LLM上下文學(xué)習(xí)的難度,提供給LLM預(yù)定義的表格操作,需要LLM從中選擇一種操作并執(zhí)行構(gòu)成操作鏈。

設(shè)計(jì)prompt的方法和用prompt分解推理過程的方法并不是非此即彼的,二者可以組合使用,提示LLM將分解推理后,通過在每一步設(shè)計(jì)不同的prompt來更好地進(jìn)行推理。

LLM的上下文學(xué)習(xí)能力很好地緩解了PLM對(duì)每個(gè)表格推理任務(wù)都需要大量訓(xùn)練的問題,但也帶來了新的挑戰(zhàn)。由于人們尚不能探明LLM上下文學(xué)習(xí)能力的機(jī)理,所以只能從上下文學(xué)習(xí)帶來表格推理性能提升的角度試圖探索不同的prompt對(duì)不同模型的影響。

3.4. 使用工具

使用工具是指LLM調(diào)用其他工具或模型,從而改進(jìn)表格推理相關(guān)的特定子任務(wù)上的性能。研究者在將復(fù)雜表格推理任務(wù)分解后,發(fā)現(xiàn)LLM并不適用于求解所有子任務(wù),在諸如檢索、數(shù)值計(jì)算等的任務(wù)上LLM落后于現(xiàn)有工具或方法,造成總體性能不佳。所以如何令LLM使用合適的工具以更好地完成表格推理任務(wù)成為一種挑戰(zhàn)。

目前的研究工作主要分為兩條研究思路:一種LLM調(diào)用的工具是已經(jīng)寫好并封裝的,LLM只需生成調(diào)用工具的代碼,另一種需要LLM分析需求后,根據(jù)具體需求生成代碼,比如python、SQL等來實(shí)現(xiàn)某一模塊或工具的功能。

關(guān)于直接調(diào)用封裝工具的工作,StructGPT[25]觀察到結(jié)構(gòu)化數(shù)據(jù)的數(shù)量過于龐大,很難全部輸入,所以提供了抽取數(shù)據(jù)的接口,如圖7所示,模型通過調(diào)用相應(yīng)接口獲得有效數(shù)據(jù),再將其輸入模型進(jìn)行推理。[26]為了同時(shí)探索并進(jìn)一步評(píng)估LLM智能體采取行動(dòng)和推理的能力,提出長(zhǎng)對(duì)話的數(shù)據(jù)庫(kù)問答任務(wù),LLM需要先根據(jù)歷史進(jìn)行推理,決定與外部模型的交互策略,再采取行動(dòng)生成具體的交互命令以調(diào)用模型。API[27]在將表格問題翻譯成程序后,通過調(diào)用其它LLM的API實(shí)現(xiàn)了查詢知識(shí)以及對(duì)表格執(zhí)行程序以外的操作。

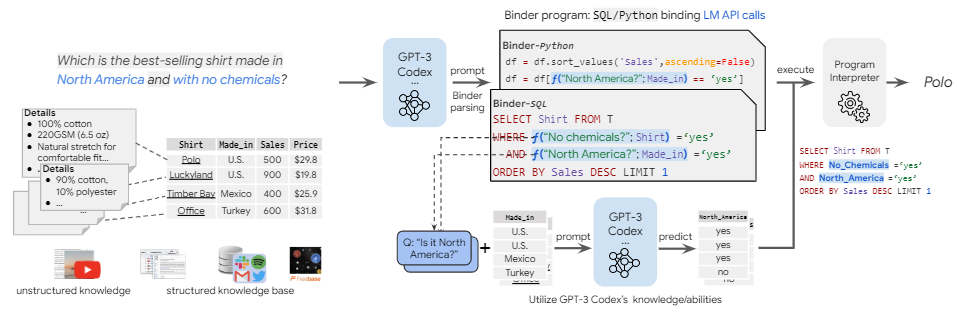

圖7:BINDER方法示意圖

關(guān)于需要LLM根據(jù)需求實(shí)現(xiàn)工具功能的工作,BINDER[28]注意到神經(jīng)系統(tǒng)缺少可解釋性,而符號(hào)方法被符號(hào)語(yǔ)言的語(yǔ)法限制,但現(xiàn)有的融合方法只針對(duì)特定模型和語(yǔ)言,且需要大量訓(xùn)練數(shù)據(jù),因此提出首先解析問題中不可以轉(zhuǎn)換成目標(biāo)程序語(yǔ)言的部分,將其調(diào)用大模型的API求解,再將生成結(jié)果集成到編程語(yǔ)言中。ReAcTable[29]注意到根據(jù)問題對(duì)任意表及其列自動(dòng)轉(zhuǎn)化的挑戰(zhàn)性,提出通過每一步令LLM選擇生成不同形式的代碼,并調(diào)用此代碼得到中間結(jié)果的表格,來逐步得到答案。

LLM既可以調(diào)用現(xiàn)成的函數(shù),也可以先生成代碼接口再調(diào)用,這兩種方法并不沖突,可以被同時(shí)用在LLM的推理過程中。

PLM并不具有使用工具的能力,而LLM借用工具進(jìn)一步增強(qiáng)了模型的專業(yè)能力,但在表格推理過程中,何時(shí)使用工具,使用何種工具,以及如何使用工具成為了新的挑戰(zhàn)。

3.5. 提高魯棒性

魯棒性是指LLM在輸入發(fā)生微小變化時(shí),依然能保持生成正確結(jié)果的能力(例如:隨機(jī)數(shù)種子、問題中的無(wú)意義詞)。經(jīng)過研究發(fā)現(xiàn)LLM在生成答案時(shí)缺少魯棒性會(huì)導(dǎo)致模型性能衰退。為了提升模型魯棒性,研究者們提出一系列方法以提升模型性能。

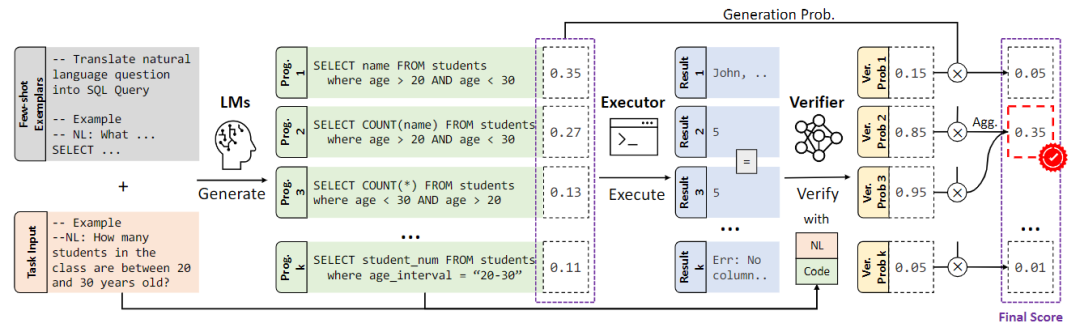

遵循前人工作,現(xiàn)有的提高LLM表格推理的魯棒性的方法,主要采用先生成多個(gè)結(jié)果,然后從多個(gè)結(jié)果中選取答案的方式。依照該設(shè)計(jì)思路,如圖8所示,LEVER[30]專門訓(xùn)練一個(gè)打分器對(duì)每個(gè)生成的答案進(jìn)行打分,選擇相應(yīng)分?jǐn)?shù)最高的答案作為結(jié)果。而SQLPrompt[31]注意到在固定prompt的情況下,LLM生成結(jié)果的多樣性較差,導(dǎo)致生成結(jié)果可能集中于特定的錯(cuò)誤答案。為了解決這個(gè)問題,SQLPrompt提出根據(jù)多個(gè)prompt分別生成結(jié)果,然后集成,從而避免生成答案集中于特定結(jié)果。

圖8:LEVER方法示意圖

提升模型魯棒性的挑戰(zhàn)在PLM時(shí)代就已經(jīng)存在,之前人們普遍通過額外訓(xùn)練來提升PLM在表格推理任務(wù)上的魯棒性[33],但LLM時(shí)代人們目前只是通過對(duì)生成結(jié)果的處理來提升表格推理結(jié)果的魯棒性。

4. 未來方向

為了啟發(fā)未來研究,在本節(jié),我們將介紹如何改進(jìn)各類方法,來提升LLM的表格推理能力。

4.1. 有監(jiān)督微調(diào)

現(xiàn)有方法只考慮到了增強(qiáng)模型在某一領(lǐng)域或某一表格任務(wù)上的性能,或挑選對(duì)應(yīng)不同任務(wù)的數(shù)據(jù)集聯(lián)合訓(xùn)練,所涉及的領(lǐng)域以及難度范圍有限,導(dǎo)致微調(diào)后模型的泛化性也有限。參考WizardLM[34]、WizardCoder[35],我們期待可以使用LLM蒸餾數(shù)據(jù),提示LLM產(chǎn)生不同領(lǐng)域、不同任務(wù)、不同難度等級(jí)的大規(guī)模高質(zhì)量訓(xùn)練數(shù)據(jù),以提升模型在表格推理任務(wù)上的綜合能力以及泛化性。

并且現(xiàn)有方法與其他NLP任務(wù)采用了統(tǒng)一的模型架構(gòu),并沒有針對(duì)表格任務(wù)做適應(yīng)性修改。參考TaPas[4],我們可以通過設(shè)計(jì)新的適用于結(jié)構(gòu)化數(shù)據(jù)的模型架構(gòu)來解決表格任務(wù)。

4.2. 模塊化分解

現(xiàn)有方法需要人工預(yù)先將任務(wù)分解為流水線,但這種分解只適用于某一類表格任務(wù),并不具有普適性,而針對(duì)所有表格任務(wù)的分解又太過概括,并不能很好地降低推理難度。參考ReAct[36],希望能夠待無(wú)需為L(zhǎng)LM解決某一表格問題指定流水線,而是令LLM能夠根據(jù)問題自主將任務(wù)顯示分解,能很好地適用于所有表格任務(wù)并且減少人工參與。

現(xiàn)有方法在將任務(wù)分解后并沒有研究對(duì)分解后的子任務(wù)進(jìn)行改進(jìn)提升,使系統(tǒng)受錯(cuò)誤級(jí)聯(lián)的影響較大,受[37]啟發(fā),我們希望LLM能夠?qū)Ψ纸獾闹虚g步驟敏感,自主檢測(cè)并修正錯(cuò)誤的中間結(jié)果,進(jìn)一步推理出正確的結(jié)果。

4.3. 上下文學(xué)習(xí)

現(xiàn)有研究均是從有限范圍內(nèi)人工比較或設(shè)計(jì)算法選擇更好的prompt作為輸入,由于比較的范圍有限,所以模型性能的提升也是有限的,并且不適用于可獲取數(shù)據(jù)有限的場(chǎng)景。為了獲得更好的輸入上下文,參考[38],能夠借助LLM自動(dòng)生成上下文,并根據(jù)表格和任務(wù)對(duì)prompt打分以及優(yōu)化,更好地幫助模型理解并解決這個(gè)問題。

并且現(xiàn)有研究并沒有關(guān)注如何針對(duì)結(jié)構(gòu)化、半結(jié)構(gòu)化數(shù)據(jù)改進(jìn)LLM的嵌入層。參考[39],我們期待可以訓(xùn)練一個(gè)適用于LLM的嵌入層,能夠嵌入表格的結(jié)構(gòu)、單元和對(duì)齊的文本描述,更好地編碼結(jié)構(gòu)化數(shù)據(jù),有助于模型理解表格并推理。

4.4. 使用工具

現(xiàn)有研究沒有關(guān)注到表格推理任務(wù)中面臨的知識(shí)密集場(chǎng)景,不能靈活運(yùn)用外部數(shù)據(jù)進(jìn)行知識(shí)注入。參考WebGPT[40],我們希望處理專家問題時(shí)LLM能夠自主借助搜索引擎查詢相關(guān)領(lǐng)域內(nèi)知識(shí),并且將查詢結(jié)果用于計(jì)算或推理。

4.5. 提高魯棒性

現(xiàn)有工作都是針對(duì)模型生成結(jié)果進(jìn)行集成以提升性能,并沒有關(guān)注到推理路徑的多樣性以及對(duì)結(jié)果魯棒性的影響。參考[41],LLM可以在表格推理的路徑上做集成,充分利用多步推理的中間過程及中間結(jié)果,逐步提升模型的魯棒性。

并且現(xiàn)有方法在對(duì)候選結(jié)果選擇時(shí),要額外訓(xùn)練小模型對(duì)結(jié)果打分。參考[42]以及[43],期待可以無(wú)需訓(xùn)練,直接使用LLM對(duì)生成結(jié)果進(jìn)行判別、選擇,節(jié)省訓(xùn)練時(shí)間以及成本。

5. 總結(jié)

本文旨在向研究者們提供一份對(duì)LLM時(shí)代表格推理相關(guān)研究的總結(jié)以及展望。為了更好地幫助研究者思考從何種角度提升LLM在表格推理任務(wù)上的性能,我們從方法以及挑戰(zhàn)的角度將現(xiàn)有研究分為5類,并詳細(xì)闡述了我們的分類標(biāo)準(zhǔn)。為了讀者更好地了解表格任務(wù)的現(xiàn)有進(jìn)展,我們從有監(jiān)督微調(diào)、模塊化分解、上下文學(xué)習(xí)、使用工具以及提高魯棒性的角度回顧梳理了現(xiàn)有工作;最后,我們依據(jù)這5類方法討論了未來潛在的改進(jìn)方向,以希望本文可以在LLM時(shí)代如何改進(jìn)表格推理性能方面帶給讀者更多啟發(fā)。

參考文獻(xiàn)

[1]Biehler, R., Frischemeier, D., Reading, C., & Shaughnessy, J. (2018). Reasoning About Data.

[2]Xu, X., Liu, C., & Song, D.X. (2017). SQLNet: Generating Structured Queries From Natural Language Without Reinforcement Learning. ArXiv, abs/1711.04436.

[3]Pasupat, P., & Liang, P. (2015). Compositional Semantic Parsing on Semi-Structured Tables. Annual Meeting of the Association for Computational Linguistics.

[4]Herzig, J., Nowak, P.K., Müller, T., Piccinno, F., & Eisenschlos, J.M. (2020). TaPas: Weakly Supervised Table Parsing via Pre-training. Annual Meeting of the Association for Computational Linguistics.

[5]Zhao, W.X., Zhou, K., Li, J., Tang, T., Wang, X., Hou, Y., Min, Y., Zhang, B., Zhang, J., Dong, Z., Du, Y., Yang, C., Chen, Y., Chen, Z., Jiang, J., Ren, R., Li, Y., Tang, X., Liu, Z., Liu, P., Nie, J., & Wen, J. (2023). A Survey of Large Language Models. ArXiv, abs/2303.18223.

[6]Chen, W., Wang, H., Chen, J., Zhang, Y., Wang, H., LI, S., Zhou, X., & Wang, W.Y. (2019). TabFact: A Large-scale Dataset for Table-based Fact Verification. ArXiv, abs/1909.02164.

[7]Parikh, A.P., Wang, X., Gehrmann, S., Faruqui, M., Dhingra, B., Yang, D., & Das, D. (2020). ToTTo: A Controlled Table-To-Text Generation Dataset. ArXiv, abs/2004.14373.

[8]Yu, T., Zhang, R., Yang, K., Yasunaga, M., Wang, D., Li, Z., Ma, J., Li, I.Z., Yao, Q., Roman, S., Zhang, Z., & Radev, D.R. (2018). Spider: A Large-Scale Human-Labeled Dataset for Complex and Cross-Domain Semantic Parsing and Text-to-SQL Task. ArXiv, abs/1809.08887.

[9]Hegselmann, S., Buendia, A., Lang, H., Agrawal, M., Jiang, X., & Sontag, D.A. (2022). TabLLM: Few-shot Classification of Tabular Data with Large Language Models. ArXiv, abs/2210.10723.

[10]Zha, L., Zhou, J., Li, L., Wang, R., Huang, Q., Yang, S., Yuan, J., Su, C., Li, X., Su, A., Tao, Z., Zhou, C., Shou, K., Wang, M., Zhu, W., Lu, G., Ye, C., Ye, Y., Ye, W., Zhang, Y., Deng, X., Xu, J., Wang, H., Chen, G., & Zhao, J.J. (2023). TableGPT: Towards Unifying Tables, Nature Language and Commands into One GPT. ArXiv, abs/2307.08674.

[11]Zhang, T., Yue, X., Li, Y., & Sun, H. (2023). TableLlama: Towards Open Large Generalist Models for Tables. ArXiv, abs/2311.09206.

[12]Yang, B., Tang, C., Zhao, K., Xiao, C., & Lin, C. (2023). Effective Distillation of Table-based Reasoning Ability from LLMs. ArXiv, abs/2309.13182.

[13]Bian, J., Qin, X., Zou, W., Huang, M., & Zhang, W. (2023). HELLaMA: LLaMA-based Table to Text Generation by Highlighting the Important Evidence. ArXiv, abs/2311.08896.

[14]Ye, Y., Hui, B., Yang, M., Li, B., Huang, F., & Li, Y. (2023). Large Language Models are Versatile Decomposers: Decomposing Evidence and Questions for Table-based Reasoning. Proceedings of the 46th International ACM SIGIR Conference on Research and Development in Information Retrieval.

[15]Pourreza, M.R., & Rafiei, D. (2023). DIN-SQL: Decomposed In-Context Learning of Text-to-SQL with Self-Correction. ArXiv, abs/2304.11015.

[16]Lei, F., Luo, T., Yang, P., Liu, W., Liu, H., Lei, J., Huang, Y., Wei, Y., He, S., Zhao, J., & Liu, K. (2023). TableQAKit: A Comprehensive and Practical Toolkit for Table-based Question Answering. ArXiv, abs/2310.15075.

[17]Kothyari, M., Dhingra, D., Sarawagi, S., & Chakrabarti, S. (2023). CRUSH4SQL: Collective Retrieval Using Schema Hallucination For Text2SQL. ArXiv, abs/2311.01173.

[18]Anonymous. OPENTAB: ADVANCING LARGE LANGUAGE MODELS AS OPEN-DOMAIN TABLE REASONERS. Submitted to The Twelfth International Conference on Learning Representations.

[19]Chen, W. (2022). Large Language Models are few(1)-shot Table Reasoners. ArXiv, abs/2210.06710.

[20]Chang, S., & Fosler-Lussier, E. (2023). Selective Demonstrations for Cross-domain Text-to-SQL. ArXiv, abs/2310.06302.

[21]Tonglet, J., Reusens, M., Borchert, P., & Baesens, B. (2023). SEER : A Knapsack approach to Exemplar Selection for In-Context HybridQA. ArXiv, abs/2310.06675.

[22]Gao, D., Wang, H., Li, Y., Sun, X., Qian, Y., Ding, B., & Zhou, J. (2023). Text-to-SQL Empowered by Large Language Models: A Benchmark Evaluation. ArXiv, abs/2308.15363.

[23]Saha, S., Yu, X.V., Bansal, M., Pasunuru, R., & Celikyilmaz, A. (2022). MURMUR: Modular Multi-Step Reasoning for Semi-Structured Data-to-Text Generation. ArXiv, abs/2212.08607.

[24]Anonymous. CHAIN-OF-TABLE: EVOLVING TABLES IN THE REASONING CHAIN FOR TABLE UNDERSTANDING. Submitted to The Twelfth International Conference on Learning Representations.

[25]Jiang, J., Zhou, K., Dong, Z., Ye, K., Zhao, W.X., & Wen, J. (2023). StructGPT: A General Framework for Large Language Model to Reason over Structured Data. ArXiv, abs/2305.09645.

[26]Nan, L., Zhang, E., Zou, W., Zhao, Y., Zhou, W., & Cohan, A. (2023). On Evaluating the Integration of Reasoning and Action in LLM Agents with Database Question Answering. ArXiv, abs/2311.09721.

[27]Cao, Y., Chen, S., Liu, R., Wang, Z., & Fried, D. (2023). API-Assisted Code Generation for Question Answering on Varied Table Structures. ArXiv, abs/2310.14687.

[28]Cheng, Z., Xie, T., Shi, P., Li, C., Nadkarni, R., Hu, Y., Xiong, C., Radev, D.R., Ostendorf, M., Zettlemoyer, L., Smith, N.A., & Yu, T. (2022). Binding Language Models in Symbolic Languages. ArXiv, abs/2210.02875.

[29]Zhang, Y., Henkel, J., Floratou, A., Cahoon, J., Deep, S., & Patel, J.M. (2023). ReAcTable: Enhancing ReAct for Table Question Answering. ArXiv, abs/2310.00815.

[30]Ni, A., Iyer, S., Radev, D.R., Stoyanov, V., Yih, W., Wang, S.I., & Lin, X.V. (2023). LEVER: Learning to Verify Language-to-Code Generation with Execution. ArXiv, abs/2302.08468.

[31]Sun, R., Arik, S.?., Sinha, R., Nakhost, H., Dai, H., Yin, P., & Pfister, T. (2023). SQLPrompt: In-Context Text-to-SQL with Minimal Labeled Data. ArXiv, abs/2311.02883.

[32]Wang, B., Shin, R., Liu, X., Polozov, O., & Richardson, M. (2019). RAT-SQL: Relation-Aware Schema Encoding and Linking for Text-to-SQL Parsers. Annual Meeting of the Association for Computational Linguistics.

[33]Pi, X., Wang, B., Gao, Y., Guo, J., Li, Z., & Lou, J. (2022). Towards Robustness of Text-to-SQL Models Against Natural and Realistic Adversarial Table Perturbation. Annual Meeting of the Association for Computational Linguistics.

[34]Xu, C., Sun, Q., Zheng, K., Geng, X., Zhao, P., Feng, J., Tao, C., & Jiang, D. (2023). WizardLM: Empowering Large Language Models to Follow Complex Instructions. ArXiv, abs/2304.12244.

[35]Luo, Z., Xu, C., Zhao, P., Sun, Q., Geng, X., Hu, W., Tao, C., Ma, J., Lin, Q., & Jiang, D. (2023). WizardCoder: Empowering Code Large Language Models with Evol-Instruct. ArXiv, abs/2306.08568.

[36]Yao, S., Zhao, J., Yu, D., Du, N., Shafran, I., Narasimhan, K., & Cao, Y. (2022). ReAct: Synergizing Reasoning and Acting in Language Models. ArXiv, abs/2210.03629.

[37]Lightman, H., Kosaraju, V., Burda, Y., Edwards, H., Baker, B., Lee, T., Leike, J., Schulman, J., Sutskever, I., & Cobbe, K. (2023). Let's Verify Step by Step. ArXiv, abs/2305.20050.

[38]Yang, C., Wang, X., Lu, Y., Liu, H., Le, Q.V., Zhou, D., & Chen, X. (2023). Large Language Models as Optimizers. ArXiv, abs/2309.03409.

[39]Sun, C., Li, Y., Li, H., & Qiao, L. (2023). TEST: Text Prototype Aligned Embedding to Activate LLM's Ability for Time Series. ArXiv, abs/2308.08241.

[40]Nakano, R., Hilton, J., Balaji, S.A., Wu, J., Long, O., Kim, C., Hesse, C., Jain, S., Kosaraju, V., Saunders, W., Jiang, X., Cobbe, K., Eloundou, T., Krueger, G., Button, K., Knight, M., Chess, B., & Schulman, J. (2021). WebGPT: Browser-assisted question-answering with human feedback. ArXiv, abs/2112.09332.

[41]Xie, Y., Kawaguchi, K., Zhao, Y., Zhao, X., Kan, M., He, J., & Xie, Q. (2023). Self-Evaluation Guided Beam Search for Reasoning.

[42]Madaan, A., Tandon, N., Gupta, P., Hallinan, S., Gao, L., Wiegreffe, S., Alon, U., Dziri, N., Prabhumoye, S., Yang, Y., Welleck, S., Majumder, B., Gupta, S., Yazdanbakhsh, A., & Clark, P. (2023). Self-Refine: Iterative Refinement with Self-Feedback. ArXiv, abs/2303.17651.

[43]Li, X., Zhu, C., Li, L., Yin, Z., Sun, T., & Qiu, X. (2023). LLatrieval: LLM-Verified Retrieval for Verifiable Generation. ArXiv, abs/2311.07838.

審核編輯:黃飛

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論