TensorRT-LLM 在 NVIDIA Blackwell GPU 上創下了 DeepSeek-R1 推理性能的世界紀錄,Multi-Token Prediction (MTP) 實現了大幅提速

2025-08-30 15:47:07 4157

4157

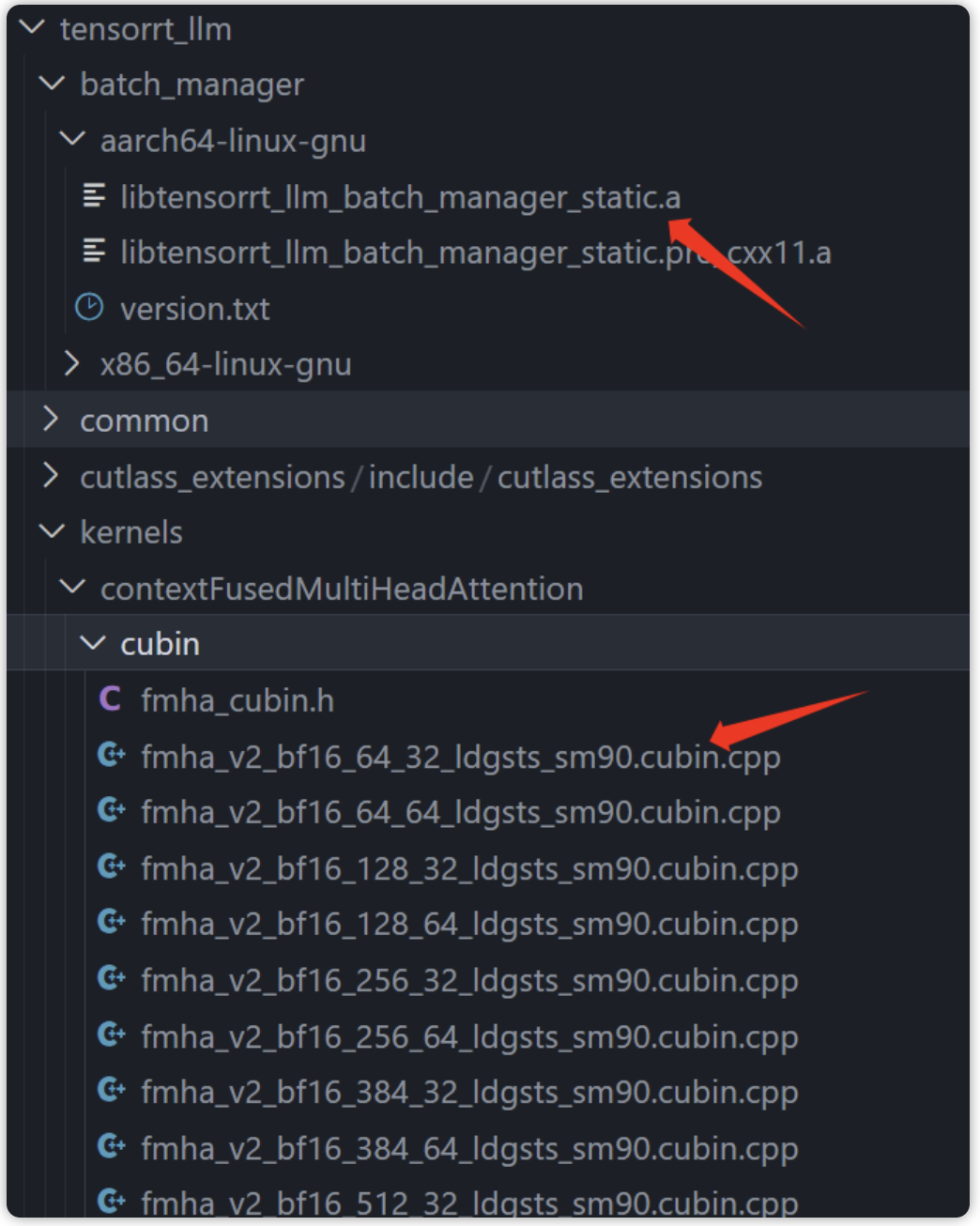

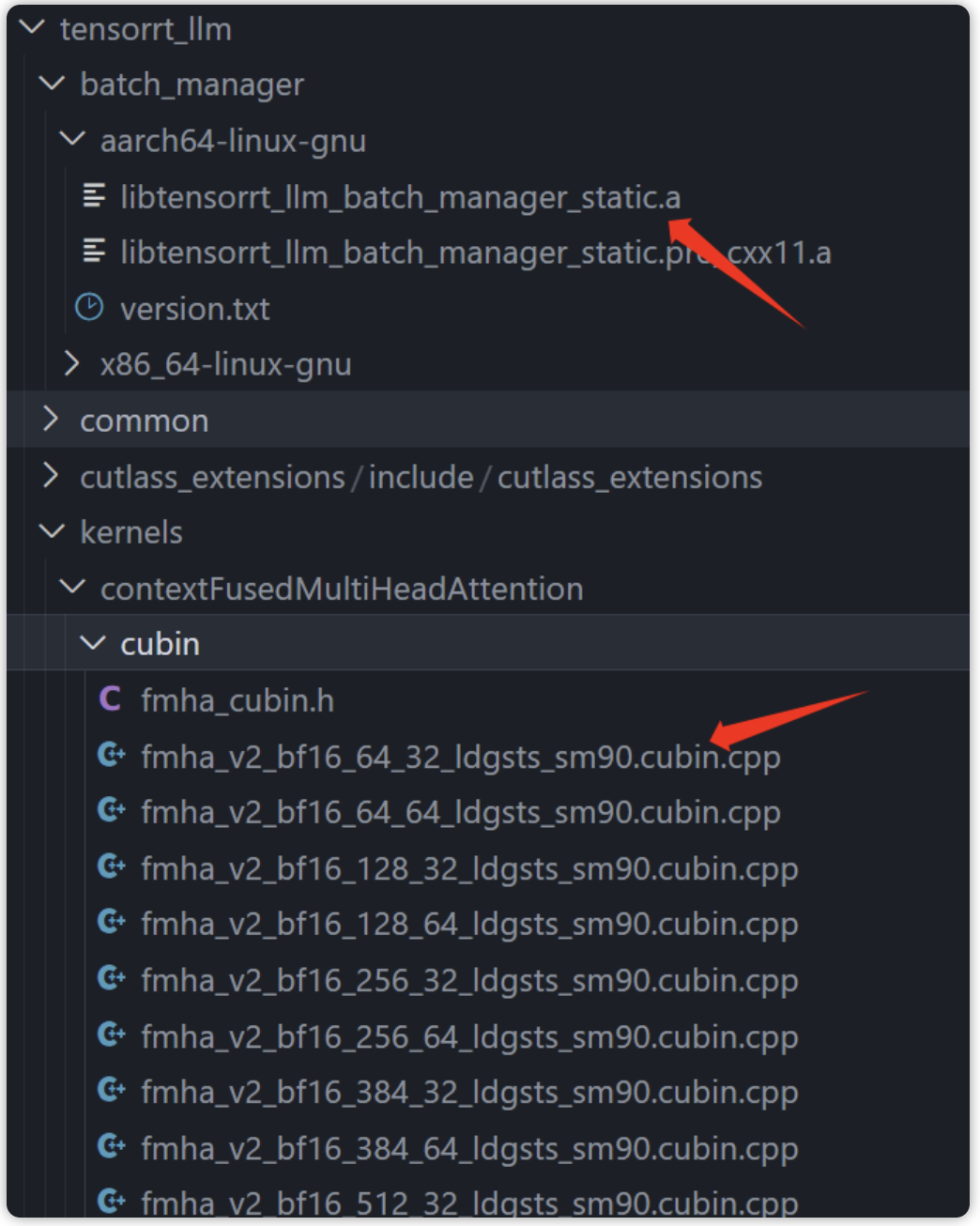

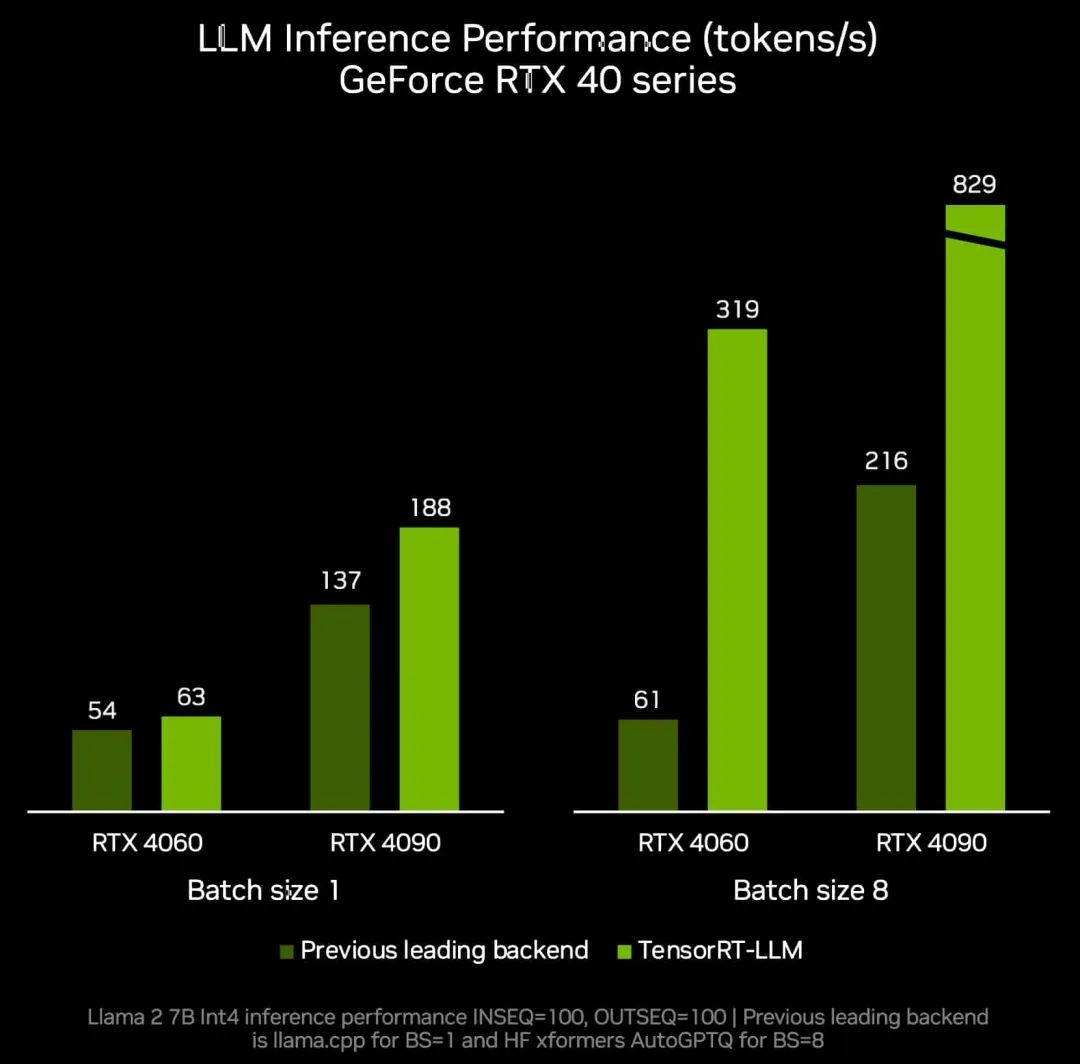

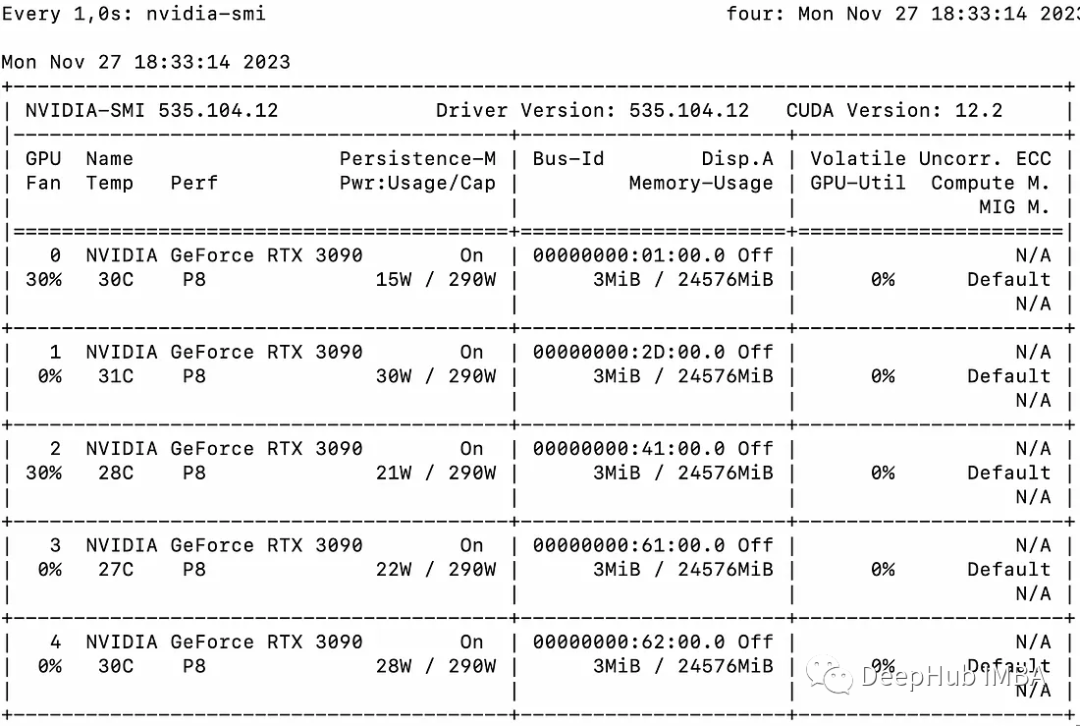

TensorRT-LLM正式出來有半個月了,一直沒有時間玩,周末趁著有時間跑一下。

2023-11-16 17:39:34 2209

2209

針對大語言模型 (LLM) 在部署過程中的性能需求,低比特量化技術一直是優化效果最佳的方案之一,本文將探討低比特量化技術如何幫助 LLM 提升性能,以及新版 OpenVINO 對于低比特量化技術的支持。

2023-12-08 15:26:45 2273

2273

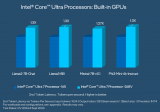

英特爾 Extension for Transformers是英特爾推出的一個創新工具包,可基于英特爾 架構平臺,尤其是第四代英特爾 至強 可擴展處理器(代號 SapphireRapids,SPR)顯著加速基于Transformers的大語言模型( LargeLanguageModel,LLM)。

2024-01-22 11:11:06 4028

4028

熱門的深度學習框架尤為突出,許多企業均會選擇其作為開發 AI 應用的庫。通過部署 Arm Kleidi 技術,Arm 正在努力優化 PyTorch,以加速在基于 Arm 架構的處理器上運行 LLM 的性能。Arm 通過將 Kleidi 技術直接集成到 PyTorch 中,簡化了開發者訪問該技術的方式。

2024-12-03 17:05:23 2006

2006

針對基于 Diffusion 和 LLM 類別的 TTS 模型,NVIDIA Triton 和 TensorRT-LLM 方案能顯著提升推理速度。在單張 NVIDIA Ada Lovelace

2025-06-12 15:37:40 1472

1472

TensorRT-LLM 作為 NVIDIA 專為 LLM 推理部署加速優化的開源庫,可幫助開發者快速利用最新 LLM 完成應用原型驗證與產品部署。

2025-07-04 14:38:47 1887

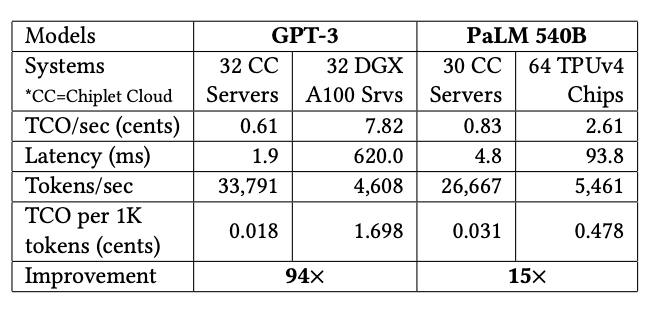

1887 電子發燒友網報道(文/周凱揚)雖說最近靠著GPT大語言模型的熱度,英偉達之類的主流GPU公司賺得盆滿缽滿,但要說仗著GPU的高性能就能高枕無憂的話,也就未免有些癡人說夢了。未來隨著LLM的繼續發展

2023-07-18 00:15:00 2080

2080

LLM3225 - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R15H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R18H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R33H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R56H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

LLM3225-R68H - Wire Wound Chip Inductors - TOKO, Inc

2022-11-04 17:22:44

想在DE2-115的開發板上完成h.264視頻編解碼,自己的想法是在已有的tpad_camer代碼上加一軟核,但一直失敗,希望有相關經驗的高手指點下?

2014-03-05 16:24:19

適用于語音通信、聯網音頻甚至高性能音頻處理應用。較之 ARM 等通用處理器,此設計還通過在 DSP 上實現 Opus 編解碼器來提升性能。根據通用處理器上所運行代碼的優化級別,通過在 C66x TI

2022-09-22 06:32:42

AVS與其他主要主要編解碼技術對比編碼工具AVSH.264MPEG2幀內預測基于8*8塊,5種亮度預測模式,4種色度預測模塊基于4*4塊,9種亮度預測模式,4種色度預測模式只有頻域內進行DC系數差分

2011-02-13 20:34:47

為什么FPGA在解碼方面用的更多

2023-10-30 08:52:22

MTK解碼芯片對比表General Features For Amoi OnlyChip Version 79 89B 89C 89D 89E 89HDVideo compression MPEG

2008-08-05 12:46:31

STM32的音頻編碼與在PC端的解碼簡介STM32F4移植編碼PC移植解碼結尾簡介能看到這篇文章的基本上都是有迫切需求的人,話不多說,切入正題編解碼庫:Speex編碼硬件平臺:STM32F411

2021-08-12 07:45:40

一種基于LLM的可通過圖像語音控制的元件庫管理工具

項目概述

? 庫存管理在我們的生活中幾乎無處不在,在許多小型的庫存當中,比如實驗室中的庫存管理,往往沒有人去專職維護,這就會導致在日積月累中逐漸

2025-11-12 19:32:21

。環境變量的配置,未來在具體項目中我們會再次提到。

下面我們正式開始項目。項目從輸入到輸出分別涉及了語音識別,圖像識別,LLM,TTS這幾個與AI相關的模塊。先從最核心的LLM開始。

由于LLAMA3

2024-06-25 15:02:29

使用 conda create -n ov-nb-demos python=3.11 創建運行 llm-agent-rag-llamaindex notebook 的環境。

執行“創建

2025-06-23 06:26:50

firefly-rk3288 linux上H264、H265解碼一直都是軟解,下面將介紹如何基于ffmpeg,在ubuntu系統上添加硬解支持,首先安裝硬解驅動庫。這里使用的是國外友人mac_l1

2022-06-14 09:30:16

能在硬件上實現紅外信號解碼器嗎?或者我應該只產生一個中斷信號的下降沿,然后解碼所有的軟件嗎?我已經在不同的項目做了好幾次,而使用傳統的微處理器和軟件做這一切。我主要只是計數增量(信號保持高或低的時間

2019-02-14 14:35:23

無法在 OVMS 上運行來自 Meta 的大型語言模型 (LLM),例如 LLaMa2。

從 OVMS GitHub* 存儲庫運行 llama_chat Python* Demo 時遇到錯誤。

2025-03-05 08:07:06

話很不理解:IRCOM[j]=IRCOM[j] >> 1; //高位補0按照程序的思路,解碼后的值就存儲在 IRCOM[2] 里面,然后跟鍵碼表RecvData[] 進行對比:for(j=0

2017-06-10 16:42:53

超級電容與電池對比具有哪些明顯的特性?超級電容在智能電表上的應用是什么?

2021-10-13 08:05:23

在小尺寸DSP上實現2D條形碼解碼

2010-10-13 15:28:37 31

31 MG3500SoC是支持H.264高清編解碼器的片上系統,內部集成一個嵌入式ARM926處理器,支持高清H.264編解碼、MPEG鄄2解碼和JPEG編解碼。介紹了MG3500SoC的主要性能特點、引腳排列、主要接口功

2010-12-25 16:44:14 32

32 介紹了MP3 解碼器在Openrisc 開發系統上實現的過程。Openrisc 是源代碼公開的32 位RISC 內核,使用之前經過了嚴格的仿真、測試。項目中,針對Openrisc 系統環境對MP3 的解碼算法也作了很多優

2011-06-27 15:47:30 41

41 G.7xx語音編解碼模塊及在AD218X上的實現,PPT教程。

2016-04-14 17:59:41 0

0 在TMS320C6455上實現了音視頻編碼標準(Audio and video coding standard,AVS)視頻標準標清視頻的實時編碼,高清視頻碼流的實時解碼。以AVS參考代碼RM52i

2018-03-06 17:05:11 2

2 出色的視頻質量是目前在DM365設備為各種各樣的決議。這已由一個非常高效的編解碼實現,以設備能力帳戶。在設備的限制,視頻編碼器有效實施正確的視頻編解碼器工具,提供最大的質量的提高。然而,有應用場景,可以進一步利用顯著提高整體視頻質量的同時,其余的在設備的能力。

2018-04-18 17:10:14 4

4 關鍵詞:IPTV , 編解碼 , 視頻 1、引言 IPTV業務是指基于寬帶互聯網與寬帶接入,以機頂盒或其它具有視頻編解碼能力的數字化設備作為終端,通過聚合SP的各種流媒體服務內容和增值應用,為用戶

2019-01-03 17:04:01 1811

1811 關于正交解碼,我先解釋何為正交解碼,,,,其實名字挺高大上的,,,,還是先說編碼器吧

2019-05-16 18:05:00 5

5 EE-320:在SHARC?處理器上實現Ogg Vorbis解碼器

2021-05-20 16:59:56 1

1 STM32的音頻編碼與在PC端的解碼簡介STM32F4移植編碼PC移植解碼結尾簡介能看到這篇文章的基本上都是有迫切需求的人,話不多說,切入正題編解碼庫:Speex編碼硬件平臺:STM32F411

2021-12-16 16:53:02 25

25 在QT上構建ffmpeg環境,實現音頻的解碼

2022-06-09 09:05:44 1731

1731

移相全橋和LLC技術在電推進PPU上的應用對比

2022-09-20 15:34:06 2

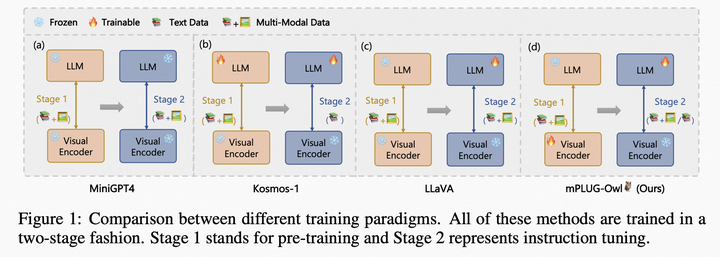

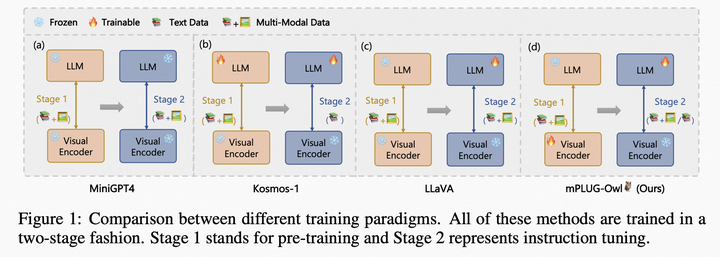

2 大型語言模型LLM(Large Language Model)具有很強的通用知識理解以及較強的邏輯推理能力,但其只能處理文本數據。雖然已經發布的GPT4具備圖片理解能力,但目前還未開放多模態輸入接口并且不會透露任何模型上技術細節。因此,現階段,如何利用LLM做一些多模態任務還是有一定的研究價值的。

2023-05-11 17:09:16 1571

1571

現在是2023年5月,截止目前,網絡上已經開源了眾多的LLM,如何用較低的成本,判斷LLM的基礎性能,選到適合自己任務的LLM,成為一個關鍵。 本文會涉及以下幾個問題: 影響LLM性能的主要因素

2023-05-22 15:26:20 2652

2652

? 最近幾年,GPT-3、PaLM和GPT-4等LLM刷爆了各種NLP任務,特別是在zero-shot和few-shot方面表現出它們強大的性能。因此,情感分析(SA)領域也必然少不了LLM的影子

2023-05-29 17:24:41 3393

3393

近年來,像 GPT-4 這樣的大型語言模型 (LLM) 因其在自然語言理解和生成方面的驚人能力而受到廣泛關注。但是,要根據特定任務或領域定制LLM,定制培訓是必要的。本文提供了有關自定義訓練 LLM 的詳細分步指南,其中包含代碼示例和示例。

2023-06-12 09:35:43 3709

3709 盡管指令調整的大型語言模型 (LLM) 在各種 NLP 任務中表現出卓越的能力,但它們在文本以外的其他數據模式上的有效性尚未得到充分研究。在這項工作中,我們提出了 Macaw-LLM,一種新穎的多模式 LLM,它無縫集成了視覺、音頻和文本信息。

2023-06-19 10:35:33 2186

2186

本文旨在更好地理解基于 Transformer 的大型語言模型(LLM)的內部機制,以提高它們的可靠性和可解釋性。 隨著大型語言模型(LLM)在使用和部署方面的不斷增加,打開黑箱并了解它們的內部

2023-06-25 15:08:49 2367

2367

LLM 是黑箱模型,缺乏可解釋性,因此備受批評。LLM 通過參數隱含地表示知識。因此,我們難以解釋和驗證 LLM 獲得的知識。此外,LLM 是通過概率模型執行推理,而這是一個非決斷性的過程。對于 LLM 用以得出預測結果和決策的具體模式和功能,人類難以直接獲得詳情和解釋。

2023-07-10 11:35:00 3778

3778

ChatGLM2-6b是清華開源的小尺寸LLM,只需要一塊普通的顯卡(32G較穩妥)即可推理和微調,是目前社區非常活躍的一個開源LLM。

2023-07-24 09:04:22 2390

2390

LLM 對軟件研發的單點提效,我之前錄制過一段視頻,大家可以直接觀看,里面有詳細的演示,我在這里就不再贅述了。

2023-07-24 15:39:06 1544

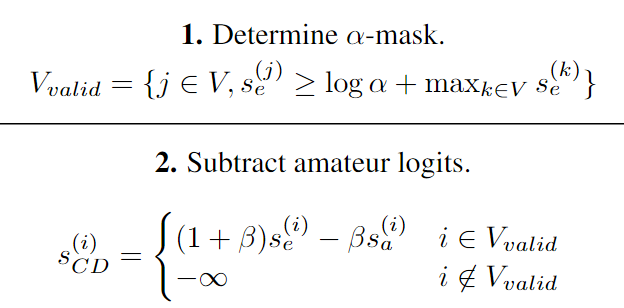

1544 蘇神最早提出的擴展LLM的context方法,基于bayes啟發得到的公式

2023-07-28 17:37:43 2584

2584

MLC-LLM部署在各種硬件平臺的需求,然后我就開始了解MLC-LLM的編譯部署流程和RWKV World模型相比于MLC-LLM已經支持的Raven系列模型的特殊之處。 MLC-LLM的編譯部署流程

2023-09-04 09:22:46 4305

4305

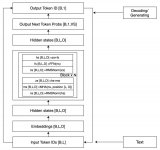

OpenAI 研究科學家 Andrej Karpathy 前段時間在微軟 Build 2023 大會上做過一場關于 GPT 模型現狀的分享 State of GPT[3],這場演講前半部分分享了

2023-09-08 16:39:55 2603

2603

在 MLC-LLM 部署RWKV World系列模型實戰(3B模型Mac M2解碼可達26tokens/s) 中提到要使用mlc-llm部署模型首先需要一個編譯過程,將原始的基于Realx搭建的模型

2023-09-26 12:25:55 2772

2772

本文介紹一篇 LLM 推理加速技術 相關的文章,值得讀一讀。 LLMs 在現實應用中的計算成本主要由服務成本所主導,但是傳統的批處理策略存在低效性。在這篇文章中,我們將告訴你

2023-10-15 20:25:02 1409

1409

在不同的硬件平臺上評估LLM對于理解傳統和非傳統體系結構的能力和局限性至關重要。先前的工作已經在超級計算機上研究了LLM,并使用傳統的深度學習基準來提供對其能力的詳細評估與分析。

2023-10-25 11:49:38 1564

1564

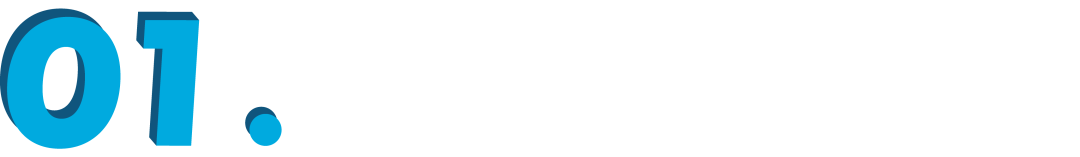

、其他熱門 LLM Windows PC 上的 AI 標志著科技史上的關鍵時刻,它將徹底改變玩家、創作者、主播、上班族、學生乃至普通 PC 用戶的體驗。 AI 為 1 億多臺采用 RTX GPU

2023-11-16 21:15:03 1346

1346

LLM的訓練分為預訓練和安全訓練。預訓練是指在大規模語料庫上進行訓練,因此LLM獲得了各種強大的能力,如文本生成、推理和主題知識等。安全訓練使用有監督的微調、RLHF、RLAIF和其他技術來對齊模型偏好與人類價值偏好,從而為LLM建立安全護欄。

2023-11-20 17:41:57 1575

1575

幻覺被描述為無意義或不忠實于所提供源內容的生成內容。根據與源內容的矛盾,這些幻覺又進一步分為內在幻覺和外在幻覺。在LLMs中,幻覺的范圍包含了一個更廣泛、更全面的概念,主要集中在事實錯誤上。本文重新定義了幻覺的分類,為LLM應用程序提供了一個更定制的框架。

2023-11-22 17:40:41 2321

2321

解碼CXL存儲器擴展設備(上)

2023-12-04 15:33:54 949

949

的限制:當前許多LLM受資源限制,主要是在較短的文本上進行預訓練,使它們對現實世界中常見的較長的上下文提示不太有效。本文對基于Transformer的LLM模型架構的進展進行了全面的介紹。

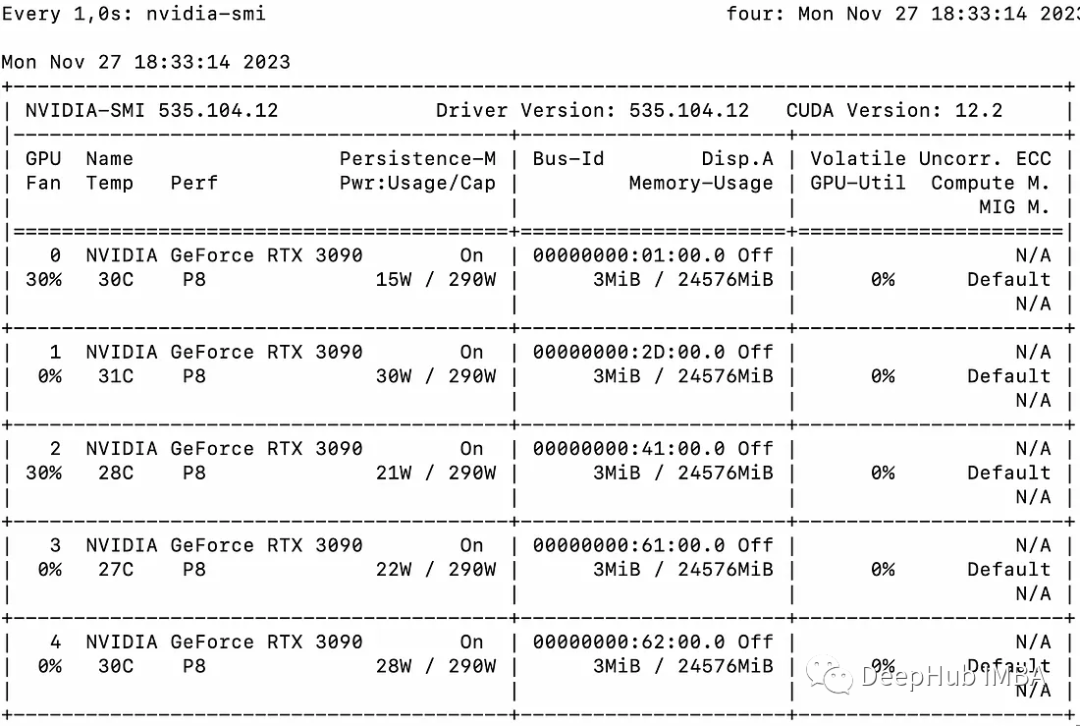

2023-11-27 17:37:36 4000

4000

Ambarella前不久展示了在其CV3-AD芯片上運行LLM的能力。這款芯片是CV3系列中最強大的,專為自動駕駛設計。

2023-11-28 09:05:31 2572

2572

大型語言模型(llm)已經徹底改變了自然語言處理領域。隨著這些模型在規模和復雜性上的增長,推理的計算需求也顯著增加。

2023-12-01 10:24:52 2430

2430

去完成一些更復雜的任務。簡單來說,LangChain 可以讓你的 LLM 在回答問題時參考自定義的知識庫,實現更精確的答案輸出。例如在以下這個Retrieval Augmented Generation

2023-12-05 09:58:14 1316

1316 internal feedback:使用LLM去預測生成的plan取得成功的概率、Tree of Thought去對比不同的plan(有點類似AlphaGo的蒙特卡諾搜索的意思)、對中間結果進行評估并作為長期記憶存儲

2023-12-05 14:49:47 4560

4560

LLM 中非常重要的一個概念是 Token,我們輸入給 LLM 和它輸出的都是 Token。Token 在這里可以看做語言的基本單位,中文一般是詞或字(其實字也是詞)。比如:”我們喜歡 Rust

2023-12-25 10:38:38 4779

4779

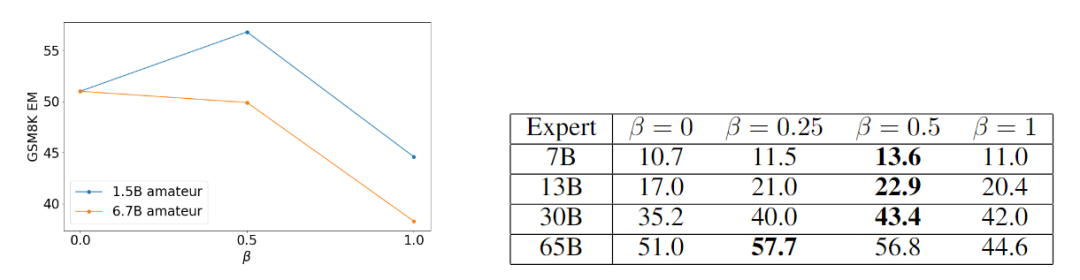

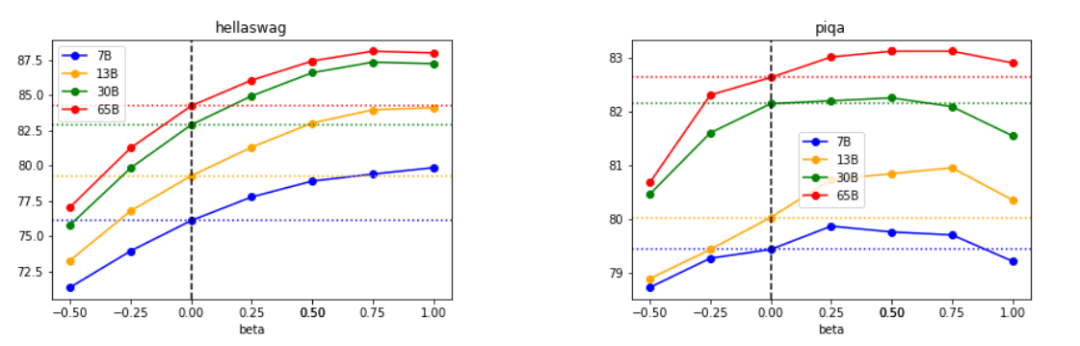

這個問題隨著LLM規模的增大愈發嚴重。并且,如下左圖所示,目前LLM常用的自回歸解碼(autoregressive decoding)在每個解碼步只能生成一個token。這導致GPU計算資源利用率

2024-01-29 15:54:24 5984

5984

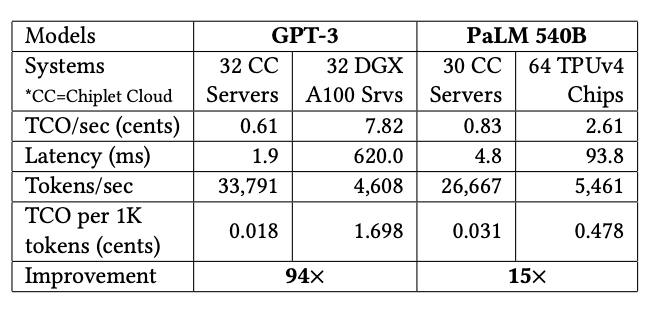

ChatGPT的人性口語化回復相信許多人已體驗過,也因此掀起一波大型語言模型(Large Language Model, LLM)熱潮,LLM即ChatGPT背后的主運作技術,但LLM運作需要龐大運算力,因此目前多是在云端(Cloud)上執行。

2024-02-29 16:29:59 2411

2411

本文將分享阿里云人工智能平臺 PAI 團隊與 NVIDIA Megatron-Core 團隊在 MoE (Mixture of Experts) 大語言模型(LLM)實現與訓練優化上的創新工作。

2024-03-22 09:50:37 2400

2400

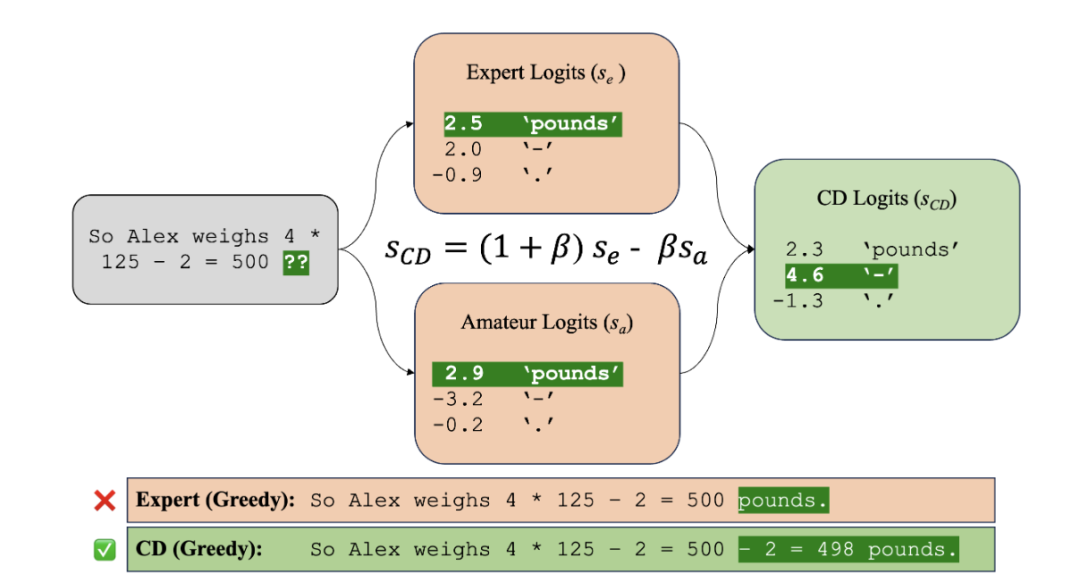

當前,業界在將傳統優化技術引入 LLM 推理的同時,同時也在探索從大模型自回歸解碼特點出發,通過調整推理過程和引入新的模型結構來進一步提升推理性能。

2024-04-10 11:48:47 1564

1564

自2022年,ChatGPT發布之后,大語言模型(LargeLanguageModel),簡稱LLM掀起了一波狂潮。作為學習理解LLM的開始,先來整體理解一下大語言模型。一、發展歷史大語言模型的發展

2024-06-04 08:27:47 2712

2712

近日,科技巨頭Meta在其X平臺上正式宣布推出了一款革命性的LLM編譯器,這一模型家族基于Meta Code Llama構建,并融合了先進的代碼優化和編譯器功能。LLM編譯器的推出,標志著Meta在人工智能領域的又一重大突破,將為軟件開發和編譯器優化帶來全新的可能性。

2024-06-29 17:54:01 2202

2202 隨著人工智能技術的飛速發展,大型語言模型(Large Language Model,簡稱LLM)逐漸成為自然語言處理(NLP)領域的研究熱點。LLM以其強大的文本生成、理解和推理能力,在文本

2024-07-02 11:45:26 18413

18413 在本文中,我們將深入探討LLM(Large Language Model,大型語言模型)的應用領域。LLM是一種基于深度學習的人工智能技術,它能夠理解和生成自然語言文本。近年來,隨著計算能力的提高

2024-07-09 09:52:17 2024

2024 LLM(Large Language Model)是指大型語言模型,它們是一類使用深度學習技術構建的自然語言處理(NLP)模型。LLM模型可以處理各種語言任務,如文本生成、文本分類、機器翻譯等。目前

2024-07-09 09:55:49 2494

2494 在重復測量或分層數據中。 LMM(線性混合效應模型)是一種特殊類型的線性混合模型,它包括固定效應和隨機效應。它通常用于分析具有多個層次的數據結構,例如在多層次或分組數據中。 固定效應與隨機效應: 在LLM中,固定效應是指在整個研究中對

2024-07-09 09:57:46 3828

3828 LLM(Large Language Model,大型語言模型)是一種深度學習模型,主要用于處理自然語言處理(NLP)任務。LLM模型的格式多種多樣,以下是一些常見的LLM模型格式

2024-07-09 09:59:52 2008

2008 在當今的人工智能領域,LLM(Large Language Model,大型語言模型)已經成為了一種非常受歡迎的技術。它們在自然語言處理(NLP)任務中表現出色,如文本生成、翻譯、摘要、問答等。然而

2024-07-09 10:14:49 1722

1722 在人工智能領域,大模型(Large Language Model, LLM)和ChatGPT等自然語言處理技術(Natural Language Processing, NLP)正逐步改變著人類

2024-07-10 10:38:40 12817

12817 在人工智能和自然語言處理(NLP)領域,大型語言模型(Large Language Model,簡稱LLM)的興起極大地推動了技術的進步和應用的發展。LLM通過在大規模文本數據上進行預訓練,獲得了

2024-07-10 11:03:48 4563

4563 LLM(大型語言模型)大模型推理加速是當前人工智能領域的一個研究熱點,旨在提高模型在處理復雜任務時的效率和響應速度。以下是對LLM大模型推理加速關鍵技術的詳細探討,內容將涵蓋模型壓縮、解碼方法優化、底層優化、分布式并行推理以及特定框架和工具的應用等方面。

2024-07-24 11:38:19 3037

3037 本次新版本在整個 OpenVINO 產品系列中引入了重要的功能和性能變化,使大語言模型 (LLM) 的優化和部署在所有支持的場景中更容易、性能更高,包括邊緣和數據中心環境的部署。

2024-10-12 09:41:45 1350

1350

在本文中,我們將探討一種廣泛采用的技術,用于減小大型語言模型(LLM)的大小和計算需求,以便將這些模型部署到邊緣設備上。這項技術稱為模型量化。它使得人工智能模型能夠在資源受限的設備上高效部署。在當

2024-10-25 11:26:01 1147

1147

在人工智能領域,LLM(Large Language Models,大型語言模型)和傳統機器學習是兩種不同的技術路徑,它們在處理數據、模型結構、應用場景等方面有著顯著的差異。 1. 模型結構

2024-11-08 09:25:41 2941

2941 。 一、LLM技術在人工智能領域的應用 自然語言處理(NLP) LLM技術在自然語言處理領域發揮著重要作用。通過訓練模型識別和生成語言模式,LLM技術使得機器能夠執行語言翻譯、情感分析、文本摘要等任務,極大地提高了語言處理的準確性和效率。

2024-11-08 09:28:34 2537

2537 訓練自己的大型語言模型(LLM)是一個復雜且資源密集的過程,涉及到大量的數據、計算資源和專業知識。以下是訓練LLM模型的一般步驟,以及一些關鍵考慮因素: 定義目標和需求 : 確定你的LLM將用

2024-11-08 09:30:00 2053

2053 本文將分享 TensorRT-LLM 中低精度量化內容,并從精度和速度角度對比 FP8 與 INT8。首先介紹性能,包括速度和精度。其次,介紹量化工具 NVIDIA TensorRT Model

2024-11-19 14:29:27 2374

2374

所未有的精度和效率處理和生成自然語言。 LLM的基本原理 LLM基于深度學習技術,尤其是變換器(Transformer)架構。變換器模型因其自注意力(Self-Attention)機制而聞名,這種機制使得模型能夠捕捉文本中的長距離依賴關系。LLM通過在大規模語料庫上

2024-11-19 15:32:24 4615

4615 感謝眾多用戶及合作伙伴一直以來對NVIDIA TensorRT-LLM的支持。TensorRT-LLM 的 Roadmap 現已在 GitHub 上公開發布!

2024-11-28 10:43:18 1254

1254

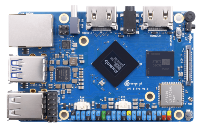

在OrangePi5Pro上訪問NPU需要安裝最新版Ubuntu的定制版本,還需要安裝特殊軟件,讓你能在NPU而不是CPU上運行專門轉換的LLM。整個過程肯定要比運行Ollama復雜得多,但如果你

2024-11-28 14:55:28 2053

2053

大型語言模型(LLM)通過其卓越的文本理解與生成能力,為機器智能帶來了革命性的進步。然而,這些模型的運行通常需要消耗大量的計算資源,因此它們主要部署在性能強大的服務器上。 隨著技術的發展和邊緣計算

2024-12-02 09:43:14 2247

2247

Recurrent Drafting (簡稱 ReDrafter) 是蘋果公司為大語言模型 (LLM) 推理開發并開源的一種新型推測解碼技術,該技術現在可與 NVIDIA TensorRT-LLM 一起使用。

2024-12-25 17:31:19 1320

1320

隨著大規模語言模型(LLM)在性能、成本和應用前景上的快速發展,越來越多的團隊開始探索如何自主訓練LLM模型。然而,是否從零開始訓練一個LLM,并非每個組織都適合。本文將根據不同的需求與資源,幫助

2025-01-09 12:12:07 1664

1664

領域的最新研究進展,特別是自DeepSeekR1發布后興起的推理時間計算擴展相關內容。在LLM中實施和改進推理簡單來說,基于LLM的推理模型是一種旨在通過生成中間

2025-04-03 12:09:48 1383

1383

TensorRT LLM 作為 NVIDIA 為大規模 LLM 推理打造的推理框架,核心目標是突破 NVIDIA 平臺上的推理性能瓶頸。為實現這一目標,其構建了多維度的核心實現路徑:一方面,針對需

2025-10-21 11:04:24 923

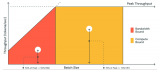

923 作者:AlexPim,Imagination軟件架構Fellow在Imagination,我們致力于加速大語言模型在日常設備上的運行。在本系列關于大語言模型性能與加速的兩篇博客的首篇中,我們將介紹

2025-12-10 08:34:34 202

202

在物聯網和嵌入式應用中,圖像處理早已不再是高性能處理器的專屬任務。越來越多的場景需要在資源受限的微控制器(MCU)上實現圖像顯示,而JPEG (Joint Photographic Experts

2025-12-26 10:29:40 419

419

電子發燒友App

電子發燒友App

評論