LLM,全稱大語言模型(Large Language Model)。是一種基于深度學習的人工智能模型。它通過大量文本數據進行訓練,從而能夠進行對話、回答問題、撰寫文本等其他任務。

New

Module LLM

LLM Module是一款集成化的離線大語言模型(LLM)推理模塊,無需云端,即可提供流暢自然的 AI 體驗。產品搭載愛芯元智 AX630C SoC 先進處理器,集成 3.2TOPs@Int8 高能效 NPU,原生支持 Transformer 模型,輕松應對復雜 AI 任務。且配備 4GB LPDDR4 內存和32GB eMMC存儲,支持多模型并行加載與串聯推理,確保多任務處理流暢無阻。運行功耗僅約 1.5W,遠低于同類產品,節能高效,適合長時間運行。

無需云端支持

模塊無需依賴云端,確保用戶隱私安全和系統穩定性,適合各種對數據安全有高要求的應用場景。集成 StackFlow 框架,配合 Arduino/UiFlow 庫,幾行代碼就可輕松實現端側智能。

高算力,低能耗

搭載愛芯元智AX630C SoC 處理器,集成 3.2TOPs@Int8 高效 NPU,提供強大的計算能力,原生支持 Transformer 模型,運行功耗僅約 1.5W,確保節能高效。

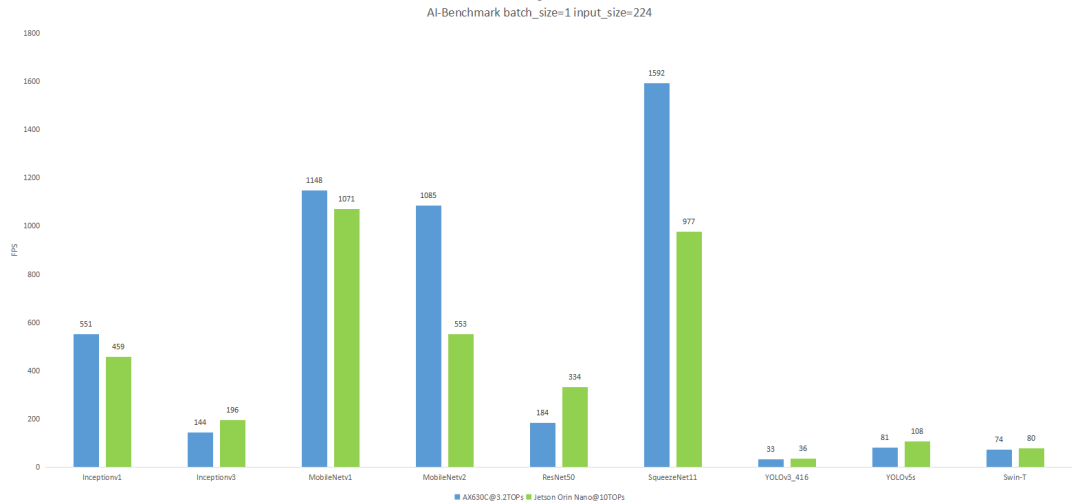

AI Benchmark 對比

支持多模型并行

配備 4GB LPDDR4 內存(其中1GB供用戶使用,3GB專用于硬件加速)和32GB eMMC存儲,支持多模型并行加載與串聯推理,確保多任務處理流暢無阻。

內置外設

集成麥克風,揚聲器,TF存儲卡,USB OTG 及 RGB狀態燈,滿足多樣化應用需求,輕松實現語音交互與數據傳輸。

靈活拓展

板載 SD 卡槽支持固件冷/熱升級,UART 通信接口簡化連接與調試,確保模塊功能持續優化與擴展。USB 口支持主從自動切換,既可以做調試口,也可以外接更多 USB 設備如攝像頭。

視覺識別能力

支持 CLIP,YoloWorld 等 Open world 模型,未來將持續更新 DepthAnything,SegmentAnything 等先進模型,賦能智能識別與分析。

即插即用

出廠預裝 Qwen2.5-0.5B 大語言模型,內置KWS(喚醒詞),ASR(語音識別),LLM(大語言模型)及TTS(文本轉語音)功能,且支持分開調用或 pipeline 自動流轉,方便開發。后續將支持Qwen2.5-1.5B、Llama3.2-1B及InternVL2-1B等多種端側LLM/VLM模型,支持熱更新模型,緊跟社區潮流,適應不同復雜度的AI任務。搭配M5主機即可實現即插即用的AI交互體驗。

LLM Module可作為離線語音助手,無需聯網即可進行精準語音識別與響應,提升設備使用的智能和便捷性。或者是通過語音指令輕松控制家中智能設備,實現智能化生活。產品推薦搭配M5系列主機進行使用,無需繁瑣設置,即插即用。

-

Module

+關注

關注

0文章

76瀏覽量

13577 -

語言模型

+關注

關注

0文章

572瀏覽量

11336 -

LLM

+關注

關注

1文章

349瀏覽量

1381

發布評論請先 登錄

什么是大模型,智能體...?大模型100問,快速全面了解!

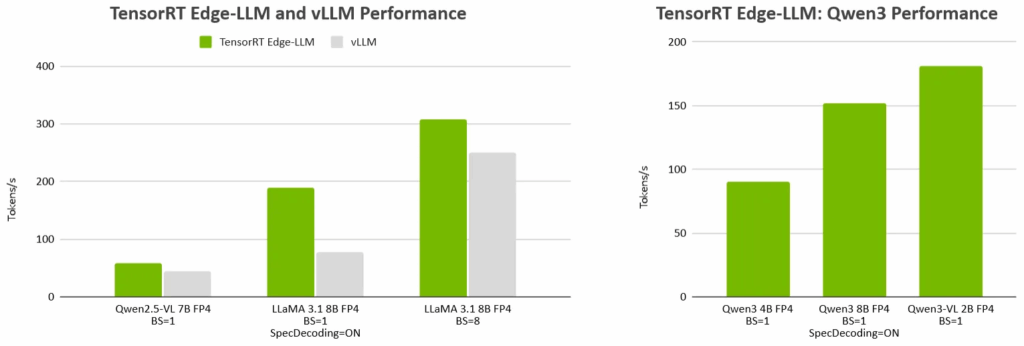

NVIDIA TensorRT Edge-LLM在汽車與機器人行業的落地應用

新品 | Module ASR,AI智能離線語音模塊

廣和通發布端側情感對話大模型FiboEmo-LLM

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

3萬字長文!深度解析大語言模型LLM原理

基于米爾瑞芯微RK3576開發板的Qwen2-VL-3B模型NPU多模態部署評測

Votee AI借助NVIDIA技術加速方言小語種LLM開發

歐洲借助NVIDIA Nemotron優化主權大語言模型

從FA模型切換到Stage模型時:module的切換說明

新品 | 服務:InfineonSpice 離線仿真工具

新品|LLM Module,離線大語言模型模塊

新品|LLM Module,離線大語言模型模塊

評論