“魔搭社區是中國最具影響力的模型開源社區,致力給開發者提供模型即服務的體驗。魔搭社區利用NVIDIA TensorRT-LLM,大大提高了大語言模型的推理性能,方便了模型應用部署,提高了大模型產業應用效率,更大規模地釋放大模型的應用價值。”

——周文猛,魔搭社區技術負責人,阿里巴巴通義實驗室技術總監

魔搭上線 NVIDIA TensorRT-LLM

支持開源LLM 推理加速

魔搭社區于 2022 年 11 月初創建,首次在業界提出了 “模型即服務” (MaaS, Model as a Service) 的理念。在過去一年半的時間里,MaaS 這一理念不僅實現了技術落地,也被行業廣泛接納,并成為繼 IaaS、PaaS、SaaS 服務的又一新的技術范式。

2023 年 7 月,Meta 宣布開源 Llama 2 模型,改變了整個大語言模型 (LLM) 行業的競爭格局。通過繁榮的開源生態,大語言模型迎來了群策群力的技術迭代和突破。

國內外優秀的大語言模型,如 ChatGLM、零一萬物、書生·浦語系列、通義千問等,都將魔搭社區作為開源模型首發平臺。魔搭社區成為了大模型發展的技術風向標,在中國的開發者群體中,形成了廣泛的 “找模型,用模型,上魔搭社區” 的觀念認同,從而建成了中國最大開源模型社區。

魔搭社區現在上線了 NVIDIA TensorRT-LLM,TensorRT-LLM 提供了易于使用的應用程序編程接口 (API),以定義和運行大語言模型,支持社區上的各類開源大語言模型 (LLM) 的推理加速。開發者僅通過簡短幾行代碼即可將優化的模型部署到 GPU 上。

目前 NVIDIA TensorRT-LLM 在魔搭社區上已支持的模型類型和推理精度,幾乎涵蓋了所有主流的大語言/多模態模型以及常用的量化方法,包括 FP32、FP16、BF16、INT8 和 INT4,適用于不同的環境。

LLM 推理面臨的挑戰

計算資源消耗巨大:開源大語言模型參數規模越來越大,比如 Qwen1.5-110B 參數規模高達千億級,對計算資源的需求龐大。在沒有優化的情況下直接部署,不僅成本高昂,而且對硬件要求高。

推理延遲高:大語言模型的推理時間長,尤其是在實時交互式應用中,如聊天機器人、語音助手等,高延遲會嚴重影響用戶體驗。

能效比低:計算密集型工作流意味著更高的能耗,這對于追求綠色計算和可持續發展的現代數據中心而言是一個重要問題。

部署復雜度高:模型優化、適配不同硬件平臺、以及持續維護升級等都是挑戰,尤其對于非專業用戶來說,部署一個高性能的語言模型服務并不容易。

NVIDIA TensorRT-LLM

如何提升 LLM 推理效率

極致性能優化:NVIDIA TensorRT-LLM 是基于 NVIDIA TensorRT API 生態系統構建的,專為大規模語言模型優化的推理引擎。它利用 GPU 的強大并行計算能力,通過算法優化、層融合、量化等技術顯著減少模型推理所需的計算量和內存占用,從而提升推理速度,降低延遲。

高效率與低功耗:通過精心設計的優化策略,TensorRT-LLM 能夠在不犧牲模型精度的前提下,大幅提高能效比,這對于數據中心的成本控制和環境友好至關重要。

簡化部署流程:提供一鍵式的模型優化與部署工具,簡化了從訓練到推理的整個流程。即便是復雜的模型結構,開發者也能輕松地將其部署到 GPU 上,大大降低了技術門檻,加速了產品上市時間。

廣泛兼容性與可擴展性:支持魔搭社區的多種主流的深度學習框架和開源模型架構,如 Transformer 系列模型。TensorRT-LLM 設計靈活,便于未來適應更多先進的模型技術和算法創新的更新,保持技術領先性。

在 NVIDIA TensorRT-LLM 和NVIDIA Triton 推理服務器的加持下,魔搭社區正在為開發者提供更為全面、高效、快捷的模型推理部署方案。未來,魔搭社區計劃將在生成式 AI 的模型和軟件加速庫層面,與 NVIDIA 相關團隊繼續開展合作,推動大語言模型的廣泛應用和落地。

-

NVIDIA

+關注

關注

14文章

5594瀏覽量

109743 -

模型

+關注

關注

1文章

3752瀏覽量

52111 -

LLM

+關注

關注

1文章

346瀏覽量

1331

原文標題:魔搭社區利用 NVIDIA TensorRT-LLM 加速開源大語言模型推理

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

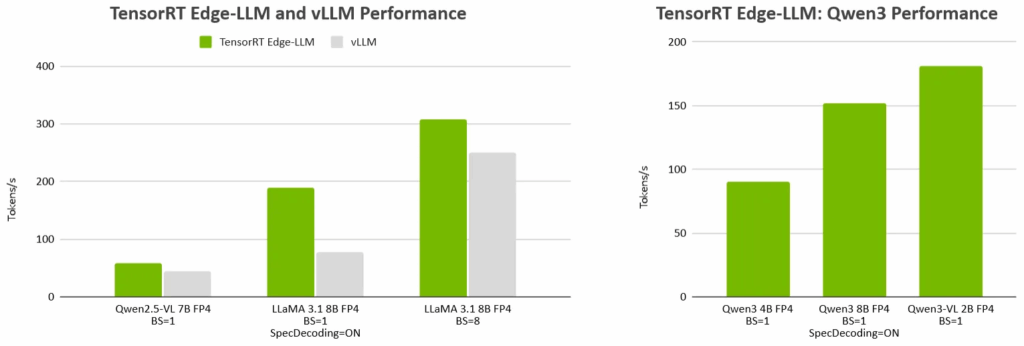

NVIDIA TensorRT Edge-LLM在汽車與機器人行業的落地應用

NVIDIA TensorRT LLM 1.0推理框架正式上線

大規模專家并行模型在TensorRT-LLM的設計

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

TensorRT-LLM中的分離式服務

Votee AI借助NVIDIA技術加速方言小語種LLM開發

如何在魔搭社區使用TensorRT-LLM加速優化Qwen3系列模型推理部署

NVIDIA Blackwell GPU優化DeepSeek-R1性能 打破DeepSeek-R1在最小延遲場景中的性能紀錄

使用NVIDIA Triton和TensorRT-LLM部署TTS應用的最佳實踐

新品 | Module LLM Kit,離線大語言模型推理模塊套裝

魔搭社區借助NVIDIA TensorRT-LLM提升LLM推理效率

魔搭社區借助NVIDIA TensorRT-LLM提升LLM推理效率

評論