感謝眾多用戶及合作伙伴一直以來對NVIDIA TensorRT-LLM的支持。TensorRT-LLM 的 Roadmap 現已在 GitHub 上公開發布!

TensorRT-LLM

持續助力用戶優化推理性能

TensorRT-LLM 可在 NVIDIA GPU 上加速和優化最新的大語言模型(Large Language Models)的推理性能。該開源程序庫在 /NVIDIA/TensorRT-LLM GitHub 資源庫中免費提供。

近期,我們收到了許多用戶的積極反饋,并表示,TensorRT-LLM 不僅顯著提升了性能表現,還成功地將其應用集成到各自的業務中。TensorRT-LLM 強大的性能和與時俱進的新特性,為客戶帶來了更多可能性。

Roadmap 現已公開發布

過往,許多用戶在將 TensorRT-LLM 集成到自身軟件棧的過程中,總是希望能更好地了解 TensorRT-LLM 的 Roadmap。即日起,NVIDIA 正式對外公開 TensorRT-LLM 的 Roadmap ,旨在幫助用戶更好地規劃產品開發方向。

我們非常高興地能與用戶分享,TensorRT-LLM 的 Roadmap 現已在 GitHub 上公開發布。您可以通過以下鏈接隨時查閱:

https://github.com/NVIDIA/TensorRT-LLM

圖 1. NVIDIA/TensorRT-LLM GitHub 網頁截屏

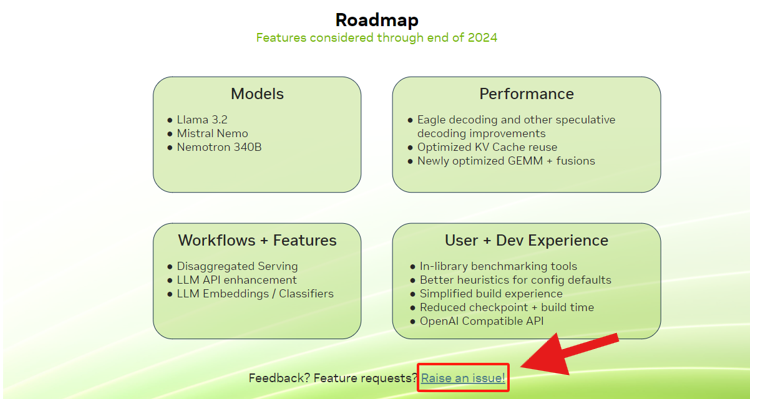

這份 Roadmap 將為您提供關于未來支持的功能、模型等重要信息,助力您提前部署和開發。

同時,在 Roadmap 頁面的底部,您可通過反饋鏈接提交問題。無論是問題報告還是新功能建議,我們都期待收到您的寶貴意見。

圖 2.Roadmap 整體框架介紹

利用 TensorRT-LLM

優化大語言模型推理

TensorRT-LLM 是一個用于優化大語言模型(LLM)推理的庫。它提供最先進的優化功能,包括自定義 Attention Kernel、Inflight Batching、Paged KV Caching、量化技術(FP8、INT4 AWQ、INT8 SmoothQuant 等)以及更多功能,以讓你手中的 NVIDIA GPU 能跑出極致推理性能。

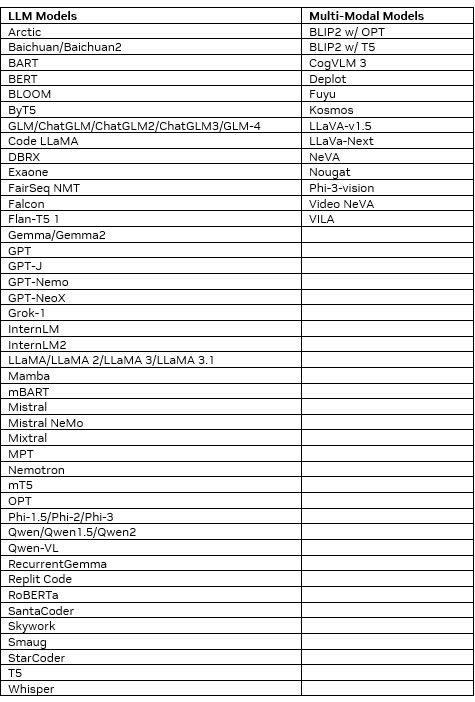

TensorRT-LLM 已適配大量的流行模型。通過類似 PyTorch 的 Python API,可以輕松修改和擴展這些模型以滿足自定義需求。以下是已支持的模型列表。

我們鼓勵所有用戶定期查閱 TensorRT-LLM Roadmap。這不僅有助于您及時了解 TensorRT-LLM 的最新動態,還能讓您的產品開發與 NVIDIA 的技術創新保持同步。

-

NVIDIA

+關注

關注

14文章

5674瀏覽量

110026 -

GitHub

+關注

關注

3文章

489瀏覽量

18745 -

LLM

+關注

關注

1文章

349瀏覽量

1380

原文標題:NVIDIA TensorRT-LLM Roadmap 現已在 GitHub 上公開發布!

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

Google正式發布LLM評測基準Android Bench

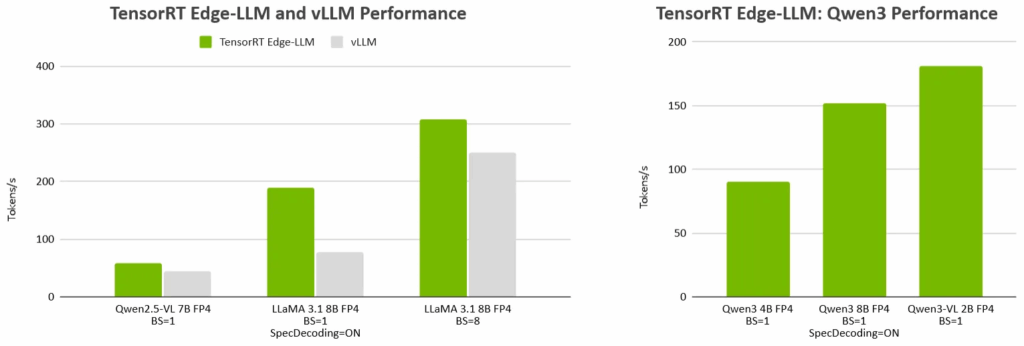

NVIDIA TensorRT Edge-LLM在汽車與機器人行業的落地應用

NVIDIA TensorRT LLM 1.0推理框架正式上線

大規模專家并行模型在TensorRT-LLM的設計

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

TensorRT-LLM中的分離式服務

超過175款游戲和應用現已支持NVIDIA DLSS 4

Votee AI借助NVIDIA技術加速方言小語種LLM開發

NVIDIA RTX AI加速FLUX.1 Kontext現已開放下載

如何在魔搭社區使用TensorRT-LLM加速優化Qwen3系列模型推理部署

NVIDIA Isaac Sim和Isaac Lab現已推出早期開發者預覽版

NVIDIA Blackwell GPU優化DeepSeek-R1性能 打破DeepSeek-R1在最小延遲場景中的性能紀錄

使用NVIDIA Triton和TensorRT-LLM部署TTS應用的最佳實踐

NVIDIA TensorRT-LLM Roadmap現已在GitHub上公開發布

NVIDIA TensorRT-LLM Roadmap現已在GitHub上公開發布

評論