近日,科技巨頭Meta在其X平臺上正式宣布推出了一款革命性的LLM編譯器,這一模型家族基于Meta Code Llama構建,并融合了先進的代碼優化和編譯器功能。LLM編譯器的推出,標志著Meta在人工智能領域的又一重大突破,將為軟件開發和編譯器優化帶來全新的可能性。

LLM編譯器是一個強大而靈活的模型,它能夠模擬編譯器的行為,預測代碼大小的最佳傳遞,并具備反匯編代碼的能力。這一功能使得LLM編譯器在優化代碼和編譯器性能方面具有獨特的優勢。通過精確的預測和智能的優化,LLM編譯器能夠幫助開發者更高效地編寫和編譯代碼,從而提升整個軟件開發流程的效率和質量。

值得一提的是,Meta在HuggingFace平臺上公開了LLM編譯器的7B和13B模型,并采用寬松的許可協議,允許研究人員和商業實體進行廣泛的應用。這一舉措無疑將極大地推動LLM編譯器在各個領域的研究和應用。

在發布的論文中,Meta的研究人員指出,盡管LLM在各種軟件工程和編碼任務中已經展現出了強大的能力,但在代碼和編譯器優化領域的應用仍然處于初級階段。為了解決這一問題,Meta引入了LLM編譯器這一專為代碼優化任務設計的預訓練模型套件。

LLM編譯器的推出,將為軟件開發人員提供一種全新的工具,幫助他們更好地理解和優化代碼。通過利用LLM編譯器的強大功能,開發人員可以更加精確地預測代碼的行為和性能,從而進行更有針對性的優化。這將有助于提高代碼的質量和效率,減少開發和調試的時間和成本。

此外,LLM編譯器還將為編譯器設計和優化帶來新的思路和方法。通過模擬編譯器的行為并進行智能優化,LLM編譯器能夠發現傳統編譯器難以察覺的優化機會,從而推動編譯器技術的進一步發展。

總之,Meta推出的LLM編譯器是一款具有革命性意義的工具,它將為軟件開發和編譯器優化帶來全新的機遇和挑戰。我們期待看到更多研究人員和開發者利用LLM編譯器進行創新和探索,共同推動人工智能在軟件工程領域的發展。

-

Meta

+關注

關注

0文章

322瀏覽量

12453 -

編譯器

+關注

關注

1文章

1672瀏覽量

51589 -

LLM

+關注

關注

1文章

346瀏覽量

1329

發布評論請先 登錄

使用 Keil Studio for Visual Studio Code開發 STM32 設備

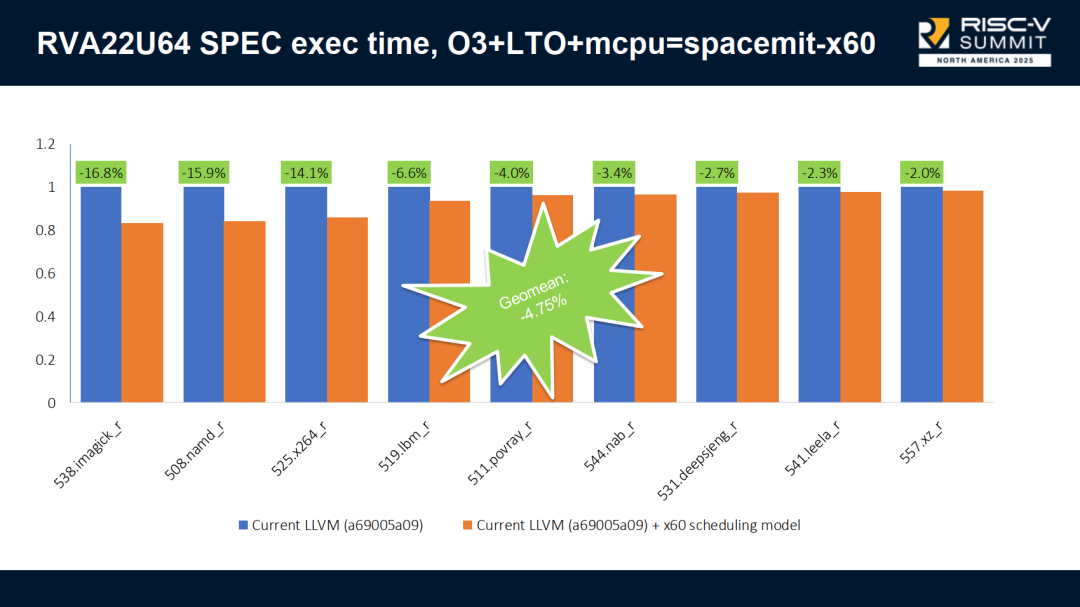

性能突破 | SpacemiT-X60 在 LLVM 編譯器上實現 16% 顯著提升

開源鴻蒙技術大會2025丨編譯器與編程語言分論壇:語言驅動系統創新,編譯賦能生態繁榮

NVIDIA TensorRT LLM 1.0推理框架正式上線

邊緣設備AI部署:編譯器如何實現輕量化與高性能?

編譯器功能安全驗證的關鍵要素

兆松科技發布高性能RISC-V編譯器ZCC 4.0.0版本

使用 NPU 插件對量化的 Llama 3.1 8b 模型進行推理時出現“從 __Int64 轉換為無符號 int 的錯誤”,怎么解決?

兆松科技ZCC編譯器全面支持芯來科技NA系列處理器

RISC-V架構下的編譯器自動向量化

Meta發布基于Code Llama的LLM編譯器

Meta發布基于Code Llama的LLM編譯器

評論