前面有一篇文章詳細(xì)說明了如何在Jetson Nano上安裝YOLOv5,然后運(yùn)行,這里只需在導(dǎo)出的時(shí)候?qū)С鰁ngine模型文件支持。

2022-11-17 09:38:50 5605

5605 前面我們給大家介紹了基于LabVIEW+YOLOv3/YOLOv4的物體識別(對象檢測),今天接著上次的內(nèi)容再來看看YOLOv5。本次主要是和大家分享使用LabVIEW快速實(shí)現(xiàn)yolov5的物體識別

2023-03-13 16:01:07 3160

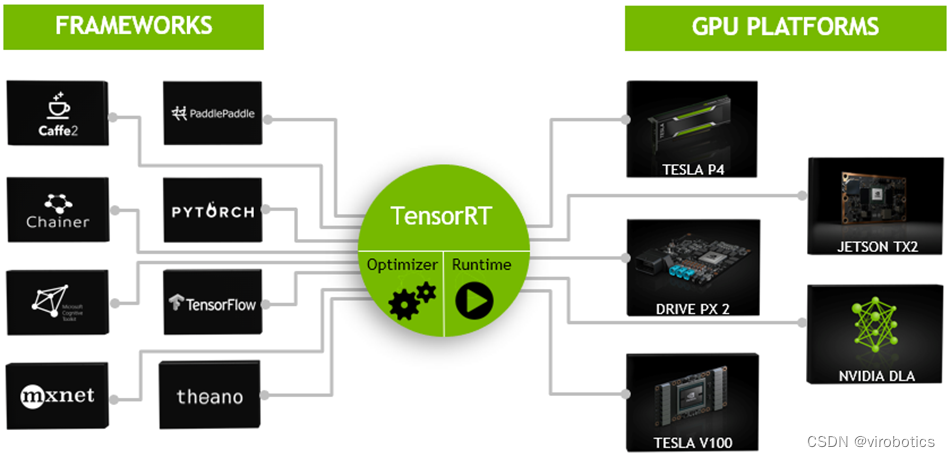

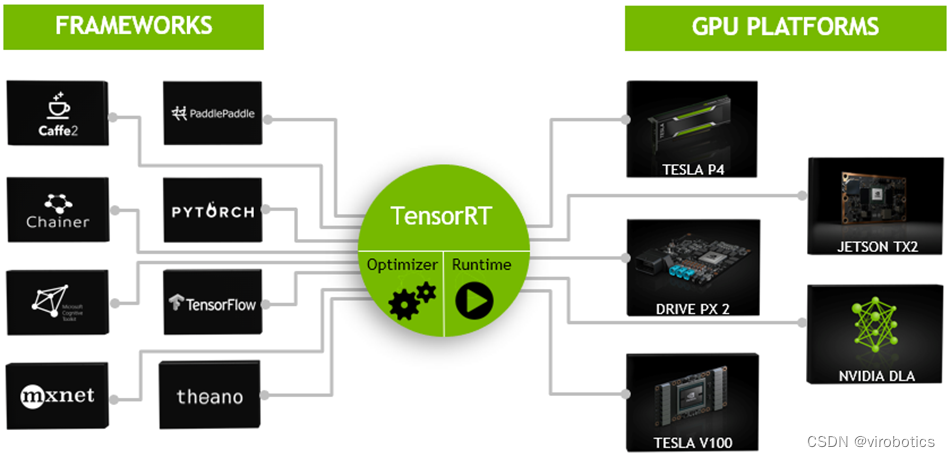

3160 今天我們就一起來看一下如何使用LabVIEW開放神經(jīng)網(wǎng)絡(luò)交互工具包實(shí)現(xiàn)TensorRT加速YOLOv5

2023-03-20 16:36:12 4074

4074

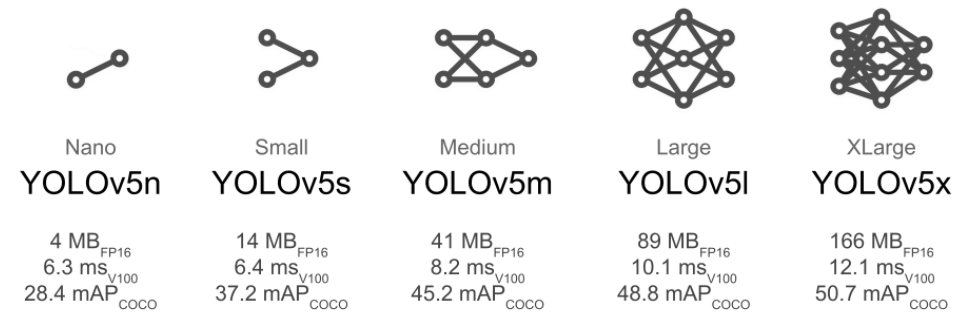

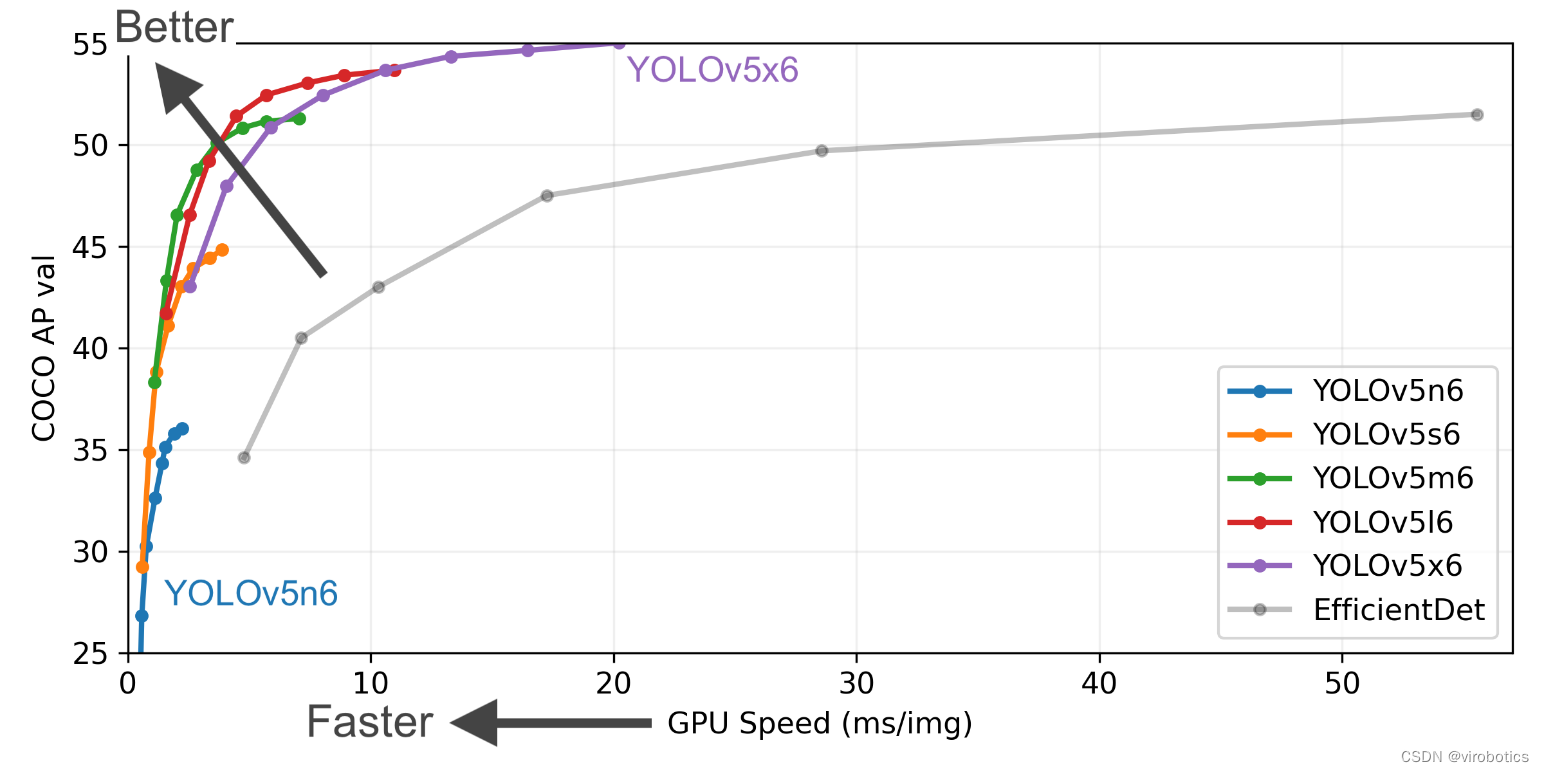

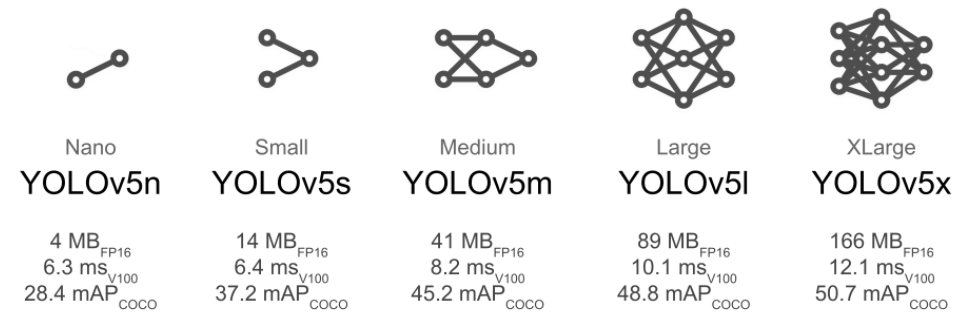

yolov5于2020年由glenn-jocher首次提出,直至今日yolov5仍然在不斷進(jìn)行升級迭代。 Yolov5有YOLOv5s、YOLOv5m、YOLOv5l、YOLOv5x四個(gè)版本。文件中

2023-05-17 16:38:53 13887

13887

今天主要和大家分享在LabVIEW中使用純TensoRT工具包快速部署并實(shí)現(xiàn)yolov5的物體識別

2023-08-21 22:20:21 2090

2090

YOLOv5兼具速度和精度,工程化做的特別好,Git clone到本地即可在自己的數(shù)據(jù)集上實(shí)現(xiàn)目標(biāo)檢測任務(wù)的訓(xùn)練和推理,在產(chǎn)業(yè)界中應(yīng)用廣泛。開源社區(qū)對YOLOv5支持實(shí)例分割的呼聲高漲,YOLOv5在v7.0中正式官宣支持實(shí)例分割。

2023-12-21 10:17:33 3831

3831

):分類器把負(fù)例正確的分類-預(yù)測為負(fù)例(yolov5中沒有應(yīng)用到) yolov5中沒有應(yīng)用TN的原因: TN代表的是所有可能的未正確檢測到的邊界框。然而在yolo在目標(biāo)檢測任務(wù)中,每個(gè)網(wǎng)格會(huì)生成很多的預(yù)測

2022-11-21 16:40:45

YOLOv5類中rgb888p_size這個(gè)參數(shù)要與模型推理和訓(xùn)練的尺寸一致嗎,一致會(huì)達(dá)到更好的效果

2025-03-11 08:12:30

1、YOLOv5 網(wǎng)絡(luò)結(jié)構(gòu)解析 YOLOv5針對不同大小(n, s, m, l, x)的網(wǎng)絡(luò)整體架構(gòu)都是一樣的,只不過會(huì)在每個(gè)子模塊中采用不同的深度和寬度, 分別應(yīng)對yaml文件中

2022-10-31 16:30:17

版本是230501

torch的版本是v1.8.0+cpu

下載yolov5官方的yolov5s.pt

執(zhí)行 python3 export.py --weights ./yolov5

2023-09-18 08:01:25

問題描述:

1. yolov5模型pt轉(zhuǎn)bmodel可以識別出結(jié)果。(轉(zhuǎn)化成功,結(jié)果正確)

2. yolov5模型pt轉(zhuǎn)onnx轉(zhuǎn)bmodel可以無法識別出結(jié)果。(轉(zhuǎn)化成功,結(jié)果沒有)

配置:

1.

2023-09-15 07:30:45

使用自己訓(xùn)練的模型進(jìn)行轉(zhuǎn)換報(bào)錯(cuò),錯(cuò)誤如下:

root@docker-desktop:/workspace/yolov5-hat# python3 -m bmnetp --model=weights

2023-09-18 09:16:36

yolov5 訓(xùn)練的 tflite 模型進(jìn)行對象檢測不適用于 NNStreamer 2.2.0-r0。在之前的 NNStreamer 2.1.1 版本中,我曾經(jīng)獲取檢測框,而當(dāng)前版本顯示框架的標(biāo)簽

2023-05-17 12:44:23

第一個(gè)我是轉(zhuǎn)onnx時(shí) 想把權(quán)重文件變小點(diǎn) 就用了半精度 --half,則說17版本不支持半精度 后面則是沒有縮小的單精度 但是顯示哪里溢出了···· 也不說是哪里、、。。。 到底能不能部署yolov5這種東西啊?? 也沒看見幾個(gè)部署在這上面......................

2024-03-14 06:23:50

第一個(gè)我是轉(zhuǎn)onnx時(shí) 想把權(quán)重文件變小點(diǎn) 就用了半精度 --half,則說17版本不支持半精度 后面則是沒有縮小的單精度 但是顯示哪里溢出了···· 也不說是哪里、 到底能不能部署yolov5這種東西啊?? 也沒看見幾個(gè)部署在這上面......................

2023-08-08 07:55:25

第一個(gè)我是轉(zhuǎn)onnx時(shí) 想把權(quán)重文件變小點(diǎn) 就用了半精度 --half,則說17版本不支持半精度 后面則是沒有縮小的單精度 但是顯示哪里溢出了···· 也不說是哪里、、。。。 到底能不能部署yolov5這種東西啊?? 也沒看見幾個(gè)部署在這上面......................

2025-03-07 11:38:14

本人將yolov5s的pt模型轉(zhuǎn)為onnx模型(不包含detect層),再將onnx模型轉(zhuǎn)為量化的rknn模型,采用相同的圖片進(jìn)行的輸出對比,余弦相似度和輸出數(shù)值基本無偏差,但是將量化的rknn模型

2022-03-16 19:16:02

yolox_bytetrack_osd_encode示例自帶的模型如下,我看示例里面yolox_group.json、yolox_infer.json、yolox

2024-07-05 07:51:04

別人的錯(cuò)誤

cd /home

git clone https://github.com/ultralytics/yolov5.git

cd yolov5

pip3 install ultralytics

2023-10-17 21:24:09

問題描述及復(fù)現(xiàn)步驟:【問題描述】按照rknn sdk linux 1.3.0版本快速上手指南中的指導(dǎo),在ITX-3588J中實(shí)現(xiàn)yolov5的例程。(1)外接PC,通過adb方式,運(yùn)行python

2022-08-25 16:38:19

: NPU幫助機(jī)器完成更高效的翻譯、文本分類和情感分析,推動(dòng)了自然語言處理技術(shù)的發(fā)展。

實(shí)例分享:Yolov5分類檢測

在RK3588處理器上,不僅可以基于Linux系統(tǒng)使用NPU,也可以

2024-08-20 11:13:11

: NPU幫助機(jī)器完成更高效的翻譯、文本分類和情感分析,推動(dòng)了自然語言處理技術(shù)的發(fā)展。

實(shí)例分享:Yolov5分類檢測

在RK3588處理器上,不僅可以基于Linux系統(tǒng)使用NPU,也可以

2024-10-24 10:13:07

我把官方yolov5的demo輸入改成了rtsp視頻流,想測試多路的性能。一共打開了8路相機(jī),開始是正常的,運(yùn)行了一段時(shí)間后開始提示:RgaBlit(1387) RGA_BLIT fail

2022-08-26 16:38:26

./yolox_sail.arm video data/video/1080p_1.mp4 data/models/BM1684/yolox_s_fp32_1b.bmodel 10 0.3 0.5

2023-09-18 08:39:41

= os.getcwd() /root/yolov5/data/voc_label.py

abs_path = \'/root/yolov5/data/\'

def convert(size, box

2024-04-23 15:43:23

YoloV5 ctor ..

*** Run in SOC mode ***

########################

NetName: yolov5s_jit_bmnetp

---- stage 0

2025-04-22 11:29:24

RKNN1 YOLOV5 DEMO及與RKNN2硬件對比

introduct

Rockchip 的 RKNN(Rockchip Neural Network) 是一款 AI 推理框架,能夠在

2023-05-31 21:49:42

= os.getcwd() /root/yolov5/data/voc_label.py

abs_path = \'/root/yolov5/data/\'

def convert(size, box

2025-02-04 18:15:46

ax_ppyoloe_obj365ax_scrfdax_yolov5_faceax_yolov7ax_yolox

ax_glpdepthax_pfldax_pp_person_attribute

2023-11-13 11:04:14

繼上文開箱后,本文主要依托愛芯元智官方的實(shí)例,進(jìn)行官方YOLOV5模型的部署和測試。

一、環(huán)境搭建

由于8核A55的SoC,加上目前Debian OS的工具齊全,所以決定直接在板上編譯程序

2023-12-12 22:58:48

/examples/yolov5/model

./download_model.sh

下載的是一個(gè)ONNX格式的神經(jīng)網(wǎng)絡(luò)模型,但發(fā)現(xiàn)它無法在瑞芯微系統(tǒng)中直接運(yùn)行。為了解決這個(gè)問題,您計(jì)劃使用特定

2025-02-15 13:24:36

的時(shí)機(jī)(yolov5s 模型,輸入為 448x448 ~ 70ms)。 現(xiàn)在我正在嘗試使用 Yolov5(uint8 量化),但我嘗試使用不同的預(yù)訓(xùn)練模型獲得相同的行為,在 CPU 上進(jìn)行良好檢測,在

2023-03-31 07:38:53

] img,img_ori=read_img(img_path) rgb888p_size=[img.shape[2],img.shape[1]] # 初始化YOLOv5實(shí)例 yolo=YOLOv5

2025-06-06 06:23:18

重現(xiàn)步驟

1將yolov5的kmodel放入k230的data數(shù)據(jù)

2使用yolo大作戰(zhàn)里的視頻流推理代碼

3運(yùn)行

期待結(jié)果和實(shí)際結(jié)果

期待的結(jié)果 將目標(biāo)檢測的框圈起來

實(shí)際看到的結(jié)果

2025-05-28 07:47:33

一、實(shí)驗(yàn)?zāi)康?本節(jié)視頻的目的是了解YOLOv5模型的用途及流程,并掌握基于YOLOV5算法實(shí)現(xiàn)物體識別的方法。

二、實(shí)驗(yàn)原理

YOLO(You Only Look Once!)

YOLOv5 是一種

2024-12-03 14:56:59

0.99以上

模型轉(zhuǎn)換指令

再將該模型放到k230設(shè)備上使用yolo大作戰(zhàn)中yolov5檢測示例,檢測就會(huì)卡死,打印出的檢測結(jié)果會(huì)超過1。

目前無從下手,大佬們求救!

2025-08-11 07:41:57

你好:

按Milk-V Duo開發(fā)板實(shí)戰(zhàn)——基于YOLOv5的目標(biāo)檢測 安裝好yolov5環(huán)境,在執(zhí)行main.py的時(shí)候會(huì)出錯(cuò),能否幫忙看下

main.py:

import torch

2023-09-18 07:47:45

【RKNPU2項(xiàng)目實(shí)戰(zhàn)1】:YOLOV5實(shí)時(shí)目標(biāo)分類

https://www.bilibili.com/video/BV1ZN411D7V8/?spm_id_from=333.999.0.0

2024-08-15 10:51:37

使用文檔“使用 YOLOv5 進(jìn)行對象檢測”我試圖從文檔第 10 頁訪問以下鏈接(在 i.MX8MP 上部署 yolov5s 的步驟 - NXP 社區(qū))

...但是這樣做時(shí)會(huì)被拒絕訪問。該文檔沒有說明需要特殊許可才能下載 test.zip 文件。NXP 的人可以提供有關(guān)如何訪問測試代碼的信息嗎?

2023-05-18 06:08:45

將 YOLOv5 ONNX 模型轉(zhuǎn)換為 IR 格式:python /opt/intel/openvino_2021/deployment_tools/model_optimizer/mo.py

2023-08-15 08:14:54

在Python>=3.7.0環(huán)境中安裝requirements.txt,包括PyTorch>=1.7。模型和數(shù)據(jù)集從最新的 YOLOv5版本自動(dòng)下載。簡單示例此示例從

2022-07-22 16:02:42

導(dǎo)出rknn模型使用官方onnx模型使用yolov5官方倉庫導(dǎo)出模型,該demo創(chuàng)建時(shí)yolov5的最新節(jié)點(diǎn)sha碼為

2022-08-19 17:05:51

求大佬分享RK3399運(yùn)行瑞芯微官方yolov5 C++代碼

2022-03-07 06:33:00

在cache的相關(guān)操作中,cache控制器需要根據(jù)需求做出許多不同的選擇。例如:分配策略是否需要將數(shù)據(jù)從主存中分配到cache中;替換策略組相聯(lián)cache中,所有的way都已經(jīng)有填充數(shù)據(jù)了,miss

2022-06-15 16:24:48

用官方的模型不出錯(cuò),用自己的yolov5訓(xùn)練出來的best.pt導(dǎo)出成onnx轉(zhuǎn)化成fp32 bmodel后在Airbox上跑,出現(xiàn)報(bào)錯(cuò):

linaro@bm1684:~/yolov5/python

2024-05-31 08:10:39

請問從yolov5訓(xùn)練出的.pt文件怎么轉(zhuǎn)換為k210可以使用的.kmodel文件?謝謝大家了

2023-09-13 07:31:49

我正在從事 imx8mplus yocto 項(xiàng)目。我已經(jīng)在自定義數(shù)據(jù)集上的 YOLOv5 上訓(xùn)練了對象檢測模型。它在 ubuntu 電腦上運(yùn)行良好。現(xiàn)在我想在我的 imx8mplus 板上運(yùn)行該模型

2025-03-25 07:23:14

步數(shù)的課程,希望學(xué)員學(xué)習(xí)后能在實(shí)際工業(yè)項(xiàng)目中落地應(yīng)用。本次課程將重點(diǎn)講解《YOLOv5》篇,讓沒有任何深度學(xué)習(xí)基礎(chǔ)的小白學(xué)員,通過視頻課程能動(dòng)手配置好yolov5環(huán)境,能利用自己的數(shù)據(jù)集訓(xùn)練模型,能

2021-09-03 09:39:28

YoloV5期望你有兩個(gè)目錄,一個(gè)用于訓(xùn)練,一個(gè)用于驗(yàn)證。在這兩個(gè)目錄中,你需要另外兩個(gè)目錄,“Images”和“Labels”。Images包含實(shí)際的圖像,每個(gè)圖像的標(biāo)簽都應(yīng)該有一個(gè)帶有該圖像標(biāo)注的.txt文件,文本文件應(yīng)該有與其對應(yīng)的圖像相同的名稱。

2021-04-18 10:05:36 7413

7413

本文轉(zhuǎn)自:知乎作者:djh一、環(huán)境準(zhǔn)備1.yolov5[鏈接]1、git clone 改模型。2、下載預(yù)編譯的模型,這里使用yolov5s2.ncnnReleases · Tenc...

2022-01-25 17:49:27 2

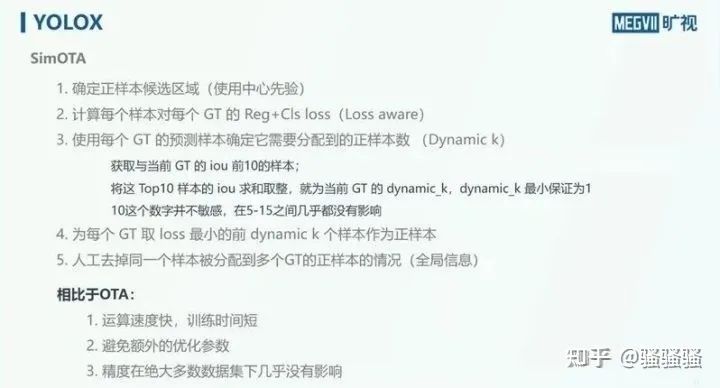

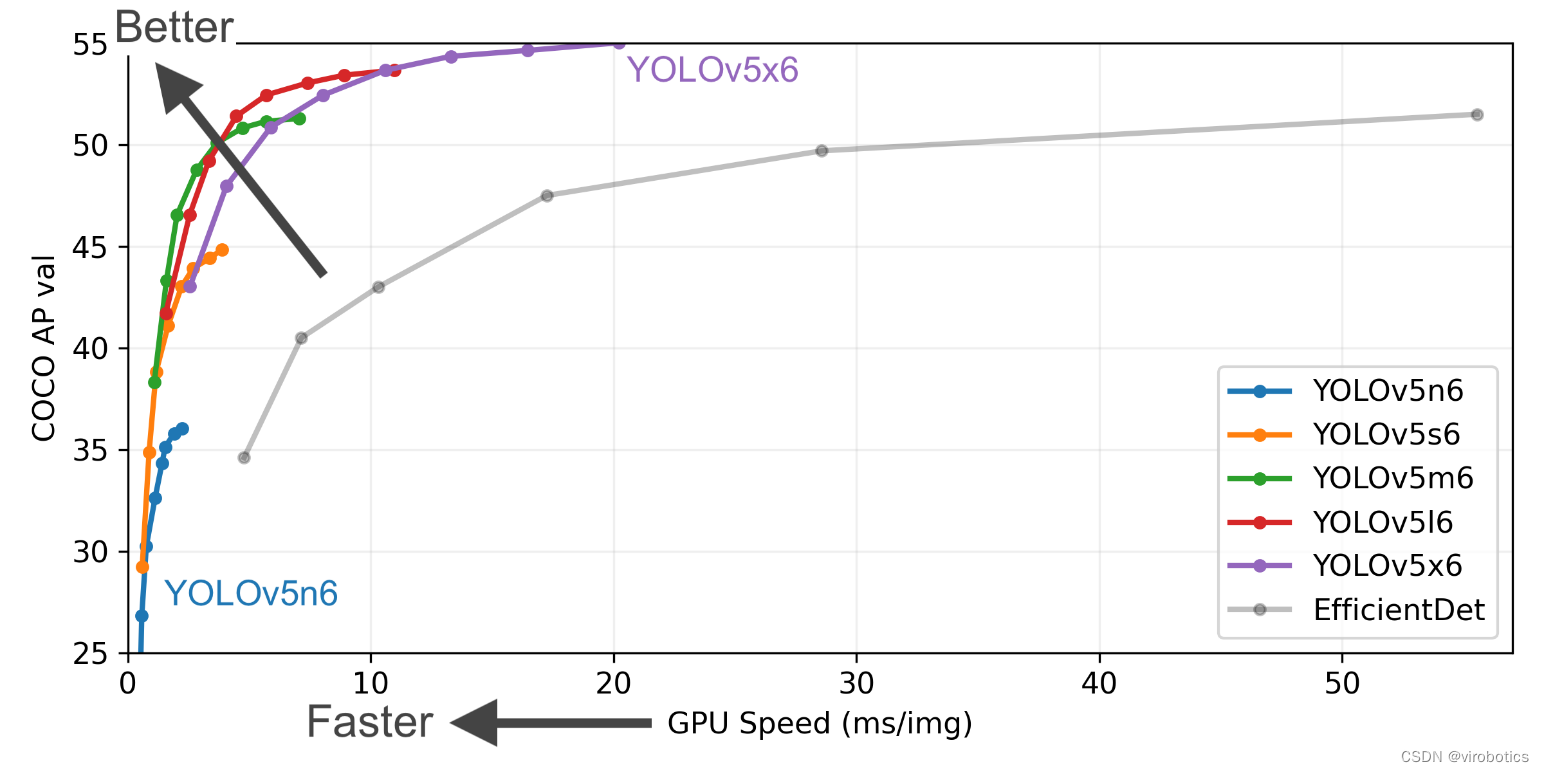

2 曠視科技開源了內(nèi)部目標(biāo)檢測模型-YOLOX,性能與速度全面超越YOLOv5早期版本!

2022-04-16 23:00:27 5123

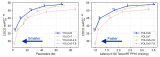

5123 這里主要是對于YOLO系列經(jīng)典化模型的訓(xùn)練對比,主要是對于YOLOv5、YOLOv6、YOLOv7以及YOLOX的對比,部分模型還在訓(xùn)練之中,后續(xù)所有預(yù)訓(xùn)練權(quán)重均會(huì)放出,同時(shí)對應(yīng)的ONNX文件也會(huì)給出,方便大家部署應(yīng)用落地。

2022-07-31 11:47:48 2542

2542 最近小魚又整了一個(gè)開源庫,結(jié)合YOLOV5訂閱圖像數(shù)據(jù)和相機(jī)參數(shù),直接給出一個(gè)可以給出識別物品的坐標(biāo)信息,方便進(jìn)行識別和抓取,目前適配完了2D相機(jī),下一步準(zhǔn)備適配3D相機(jī)。

2022-08-15 11:10:40 4223

4223 整個(gè)算法完全是以YOLOv5的框架進(jìn)行,主要包括的目標(biāo)檢測算法有:YOLOv3、YOLOv4、YOLOv5、YOLOv5-Lite、YOLOv6、YOLOv7、YOLOX以及YOLOX-Lite。

2022-08-16 10:24:27 1534

1534 并歸一化到0~1之間,這部分我寫了一個(gè)腳本來完成label標(biāo)簽的生成,把xml的標(biāo)注信息轉(zhuǎn)換為YOLOv5的labels文件,這樣就完成了數(shù)據(jù)集制作。最后需要?jiǎng)?chuàng)建一個(gè)dataset.ymal文件,放在與data文件夾同一層

2022-09-21 10:10:10 2838

2838 YOLOv5官方給出的YOLOv5在OpenCV上推理的程序相對來說是比較通俗易懂的,條理清晰,有基本的封裝,直接可用!但是我也發(fā)現(xiàn),模型的推理時(shí)間跟前后處理的時(shí)間相差無幾,特別是當(dāng)視頻流有多個(gè)檢測到的對象時(shí)候,整個(gè)幀率會(huì)有明顯下降!官方推薦的參考示例代碼鏈接為:

2022-11-02 10:16:34 3162

3162 /Oneflow-Inc/one-yolov5/blob/734609fca9d844ac48749b132fb0a5777df34167/utils/metrics.py)中。這篇文章是《YOLOv5全面解析教程》四,目標(biāo)檢測模型精確度評估 的補(bǔ)充,希望能幫助到小伙伴們。

2022-11-21 15:27:29 3490

3490 (NITROS),其中包括針對 NVIDIA GPU 和 Jetson 平臺(tái) 高度優(yōu)化的圖像處理和計(jì)算機(jī)視覺功能。 研討內(nèi)容 了解 NVIDIA Isaac ROS DNN推理管道,以及如何通過 YOLOv5

2022-11-25 21:50:03 1301

1301 支持實(shí)例分割了,從此YOLOv5實(shí)現(xiàn)了圖像分類、對象檢測、實(shí)例分割三個(gè)支持,從訓(xùn)練到部署。

2022-11-30 15:55:47 5941

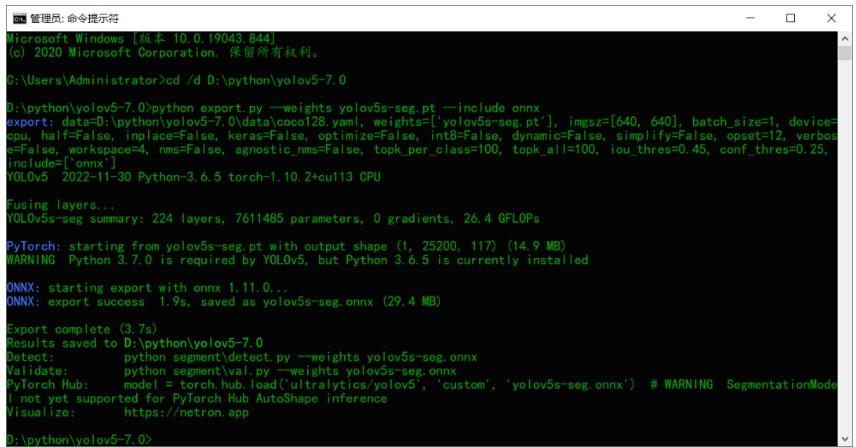

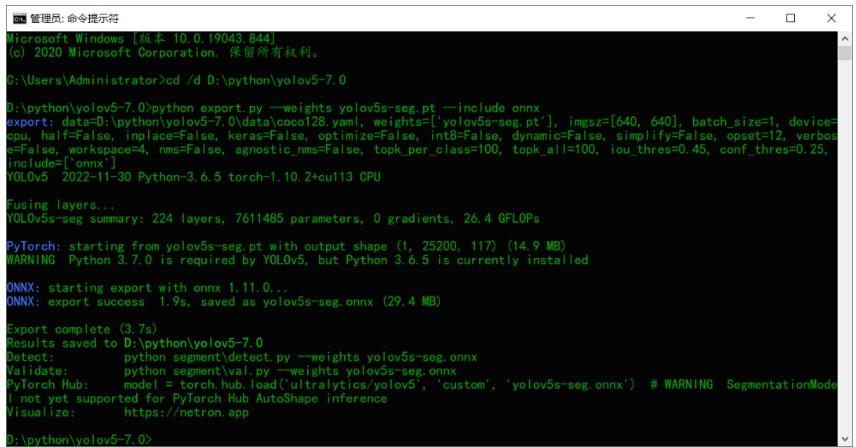

5941 首先需要把yolov5s-seg.pt文件導(dǎo)出為ONNX格式,這個(gè)很簡單,一條命令行搞定

2022-11-30 17:54:01 3639

3639

本文將介紹在基于 OpenVINO 在英特爾獨(dú)立顯卡上部署 YOLOv5 實(shí)時(shí)實(shí)例分割模型的全流程,并提供完整范例代碼供讀者使用。

2022-12-20 11:32:14 5761

5761 本教程針對目標(biāo)檢測算法yolov5的訓(xùn)練和部署到EASY-EAI-Nano(RV1126)進(jìn)行說明。

2023-01-05 18:00:32 4439

4439

下載并轉(zhuǎn)換YOLOv5預(yù)訓(xùn)練模型的詳細(xì)步驟,請參考:《基于OpenVINO?2022.2和蝰蛇峽谷優(yōu)化并部署YOLOv5模型》,本文所使用的OpenVINO是2022.3 LTS版。

2023-02-15 16:53:56 11143

11143 本次主要介紹在旭日x3的BPU中部署yolov5。首先在ubuntu20.04安裝yolov5,并運(yùn)行yolov5并使用pytoch的pt模型文件轉(zhuǎn)ONNX。

2023-04-26 14:20:39 1718

1718

本文以YOLOv5網(wǎng)絡(luò)模型為基礎(chǔ),提出一種改進(jìn)YOLOv5(YOLOv5-BC)深度學(xué)習(xí)滑坡災(zāi)害識別方法,將原有的PANet層替換為BiFPN結(jié)構(gòu),提高網(wǎng)絡(luò)多層特征融合能力

2023-05-17 17:50:37 1230

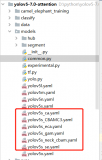

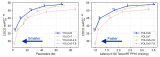

1230

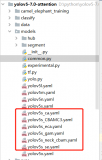

s基礎(chǔ)上實(shí)現(xiàn)五種視覺注意力模塊的改進(jìn),然后訓(xùn)練相同的輪次,橫向比較模型的精度。 YOLOv5添加注意模塊魔改 ?視覺注意力機(jī)制是一個(gè)好東西,即插即用,YOLOv5 7.0版本工程代碼簡潔明了,代碼加入視覺注意力模塊支持異常方便,以SE注意力為例,只要三步即可完成: 1. 修改模型

2023-06-02 14:52:35 2555

2555

模型。支持模型遠(yuǎn)程加載與本地推理、當(dāng)前Pytorch Hub已經(jīng)對接到Torchvision、YOLOv5、YOLOv8、pytorchvideo等視覺框架。

2023-06-09 11:36:27 2201

2201

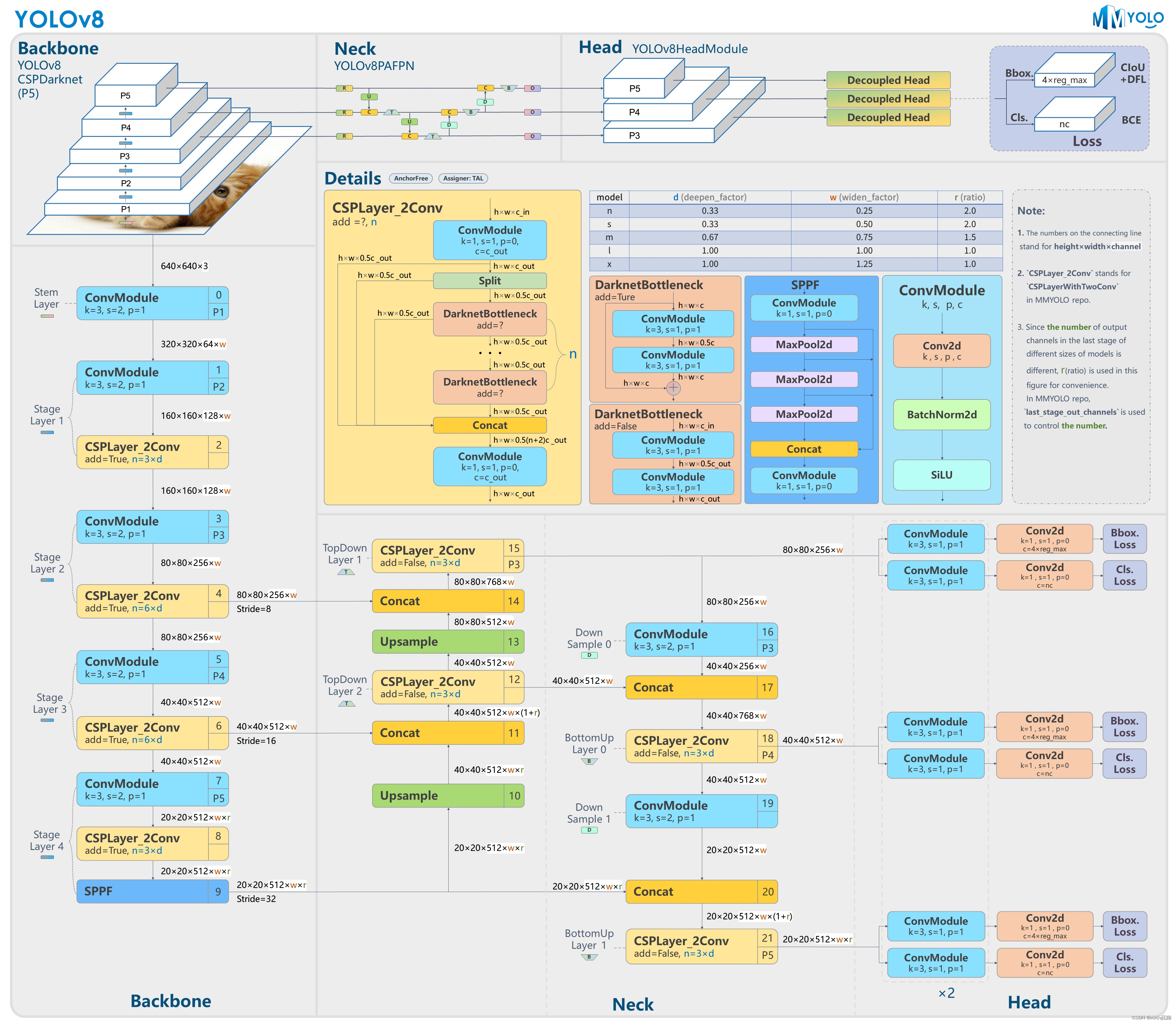

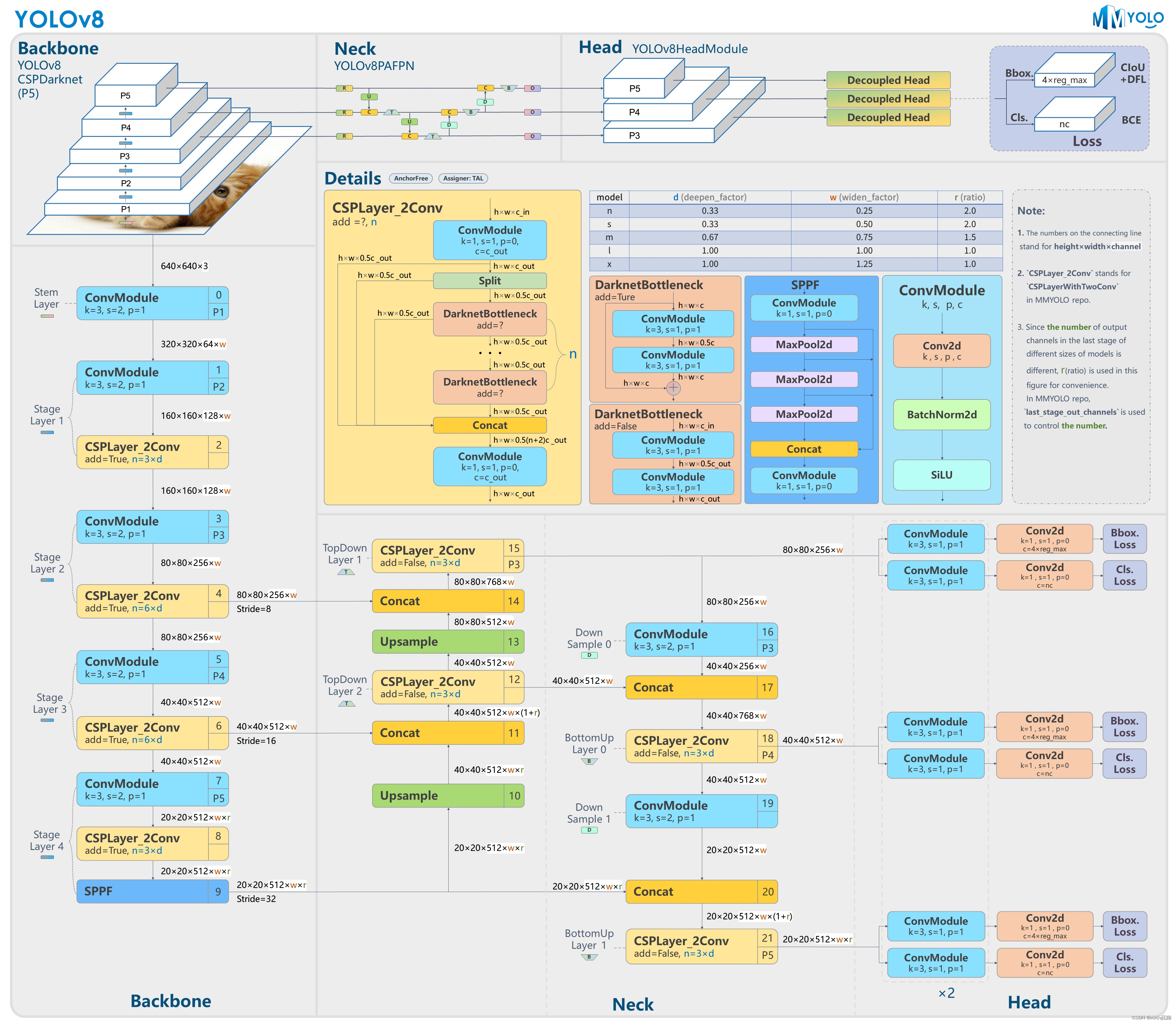

從上面可以看出,YOLOv8 主要參考了最近提出的諸如 YOLOX、YOLOv6、YOLOv7 和 PPYOLOE 等算法的相關(guān)設(shè)計(jì),本身的創(chuàng)新點(diǎn)不多,偏向工程實(shí)踐,主推的還是 ultralytics 這個(gè)框架本身。

2023-06-15 17:15:03 16139

16139

本教程針對目標(biāo)檢測算法yolov5的訓(xùn)練和部署到EASY-EAI-Nano(RV1126)進(jìn)行說明,而數(shù)據(jù)標(biāo)注方法可以參考我們往期的文章《Labelimg的安裝與使用》。

2023-01-29 15:25:22 5085

5085

深度學(xué)習(xí)模型部署有OpenVINO、ONNXRUNTIME、TensorRT三個(gè)主流框架,均支持Python與C++的SDK使用。對YOLOv5~YOLOv8的系列模型,均可以通過C++推理實(shí)現(xiàn)模型

2023-08-06 11:39:17 3784

3784 YOLOv8是YOLO系列模型的最新王者,各種指標(biāo)全面超越現(xiàn)有對象檢測與實(shí)例分割模型,借鑒了YOLOv5、YOLOv6、YOLOX等模型的設(shè)計(jì)優(yōu)點(diǎn),全面提升改進(jìn)YOLOv5的模型結(jié)構(gòu)基礎(chǔ)上實(shí)現(xiàn)同時(shí)保持了YOLOv5工程化簡潔易用的優(yōu)勢。

2023-08-10 11:35:39 2214

2214

很多人也想跟修改YOLOv5源碼一樣的方式去修改YOLOv8的源碼,但是在github上面卻發(fā)現(xiàn)找到的YOLOv8項(xiàng)目下面TAG分支是空的

2023-08-11 14:14:40 9522

9522

很多人也想跟修改YOLOv5源碼一樣的方式去修改YOLOv8的源碼,但是在github上面卻發(fā)現(xiàn)找到的YOLOv8項(xiàng)目下面TAG分支是空的,然后就直接從master/main下面把源碼克隆出來一通

2023-09-04 10:02:54 3739

3739

前面已經(jīng)講過了Yolov5模型目標(biāo)檢測和分類模型訓(xùn)練流程,這一篇講解一下yolov5模型結(jié)構(gòu),數(shù)據(jù)增強(qiáng),以及訓(xùn)練策略。

2023-09-11 11:15:21 5741

5741

網(wǎng)絡(luò)在初始錨框的基礎(chǔ)上 基于訓(xùn)練數(shù)據(jù) 輸出預(yù)測框,因此初始錨框也是比較重要的一部分。見配置文件*.yaml, yolov5預(yù)設(shè)了COCO數(shù)據(jù)集640×640圖像大小的錨定框的尺寸:

2023-09-12 17:08:39 2042

2042

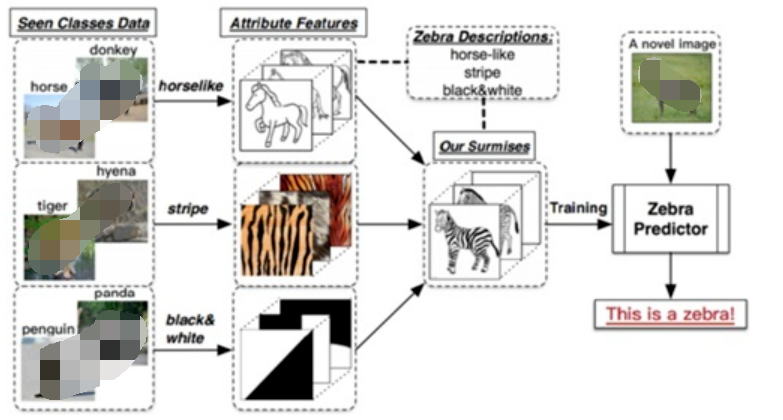

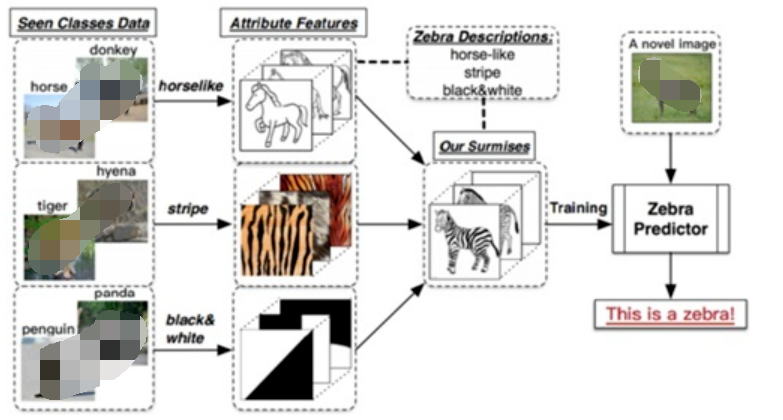

零樣本分類的技術(shù)目前正處于高速發(fā)展時(shí)期, 所涉及的具體應(yīng)用已經(jīng)從最初的圖像分類任務(wù)擴(kuò)展到了其他計(jì)算機(jī)視覺任務(wù)乃至自然語言處理等多個(gè)相關(guān)領(lǐng)域。 對此, 本文將其稱為廣義零樣本分類。 相應(yīng)地, 我們將針對圖像分類任務(wù)的零樣本分類任務(wù)稱為狹義零樣本分類。

2023-09-22 11:10:25 3648

3648

自從YOLOv5更新成7.0版本,YOLOv8推出以后,OpenCV4.6以前的版本都無法再加載導(dǎo)出ONNX格式模型了,只有OpenCV4.7以上版本才可以支持最新版本YOLOv5與YOLOv8模型的推理部署。首先看一下最新版本的YOLOv5與YOLOv8的輸入與輸出格式。

2023-09-27 11:07:05 2396

2396

我用QT C++寫了一個(gè)YOLOv5模型推理演示應(yīng)用。

2024-01-26 10:17:49 3137

3137

YOLOv5(You Only Look Once version 5)是一種基于深度學(xué)習(xí)的實(shí)時(shí)目標(biāo)檢測算法,它屬于卷積神經(jīng)網(wǎng)絡(luò)(CNN)的范疇。下面我將詳細(xì)介紹YOLOv5的原理、結(jié)構(gòu)、特點(diǎn)

2024-07-03 09:23:00 13102

13102 RK3588 技術(shù)分享 | 在Android系統(tǒng)中使用NPU實(shí)現(xiàn)Yolov5分類檢測-迅為電子

2024-08-23 14:58:07 2034

2034

目標(biāo)檢測在計(jì)算機(jī)視覺領(lǐng)域中具有重要意義。YOLOv5(You Only Look One-level)是目標(biāo)檢測算法中的一種代表性方法,以其高效性和準(zhǔn)確性備受關(guān)注,并且在各種目標(biāo)檢測任務(wù)中都表現(xiàn)出

2024-11-11 10:38:57 4873

4873

一、產(chǎn)品簡介TL3568-PlusTEB人工智能實(shí)驗(yàn)箱國產(chǎn)高性能處理器64位4核低功耗2.0GHz超高主頻1T超高算力NPU兼容鴻蒙等國產(chǎn)操作系統(tǒng)二、實(shí)驗(yàn)?zāi)康?、了解YOLOv5模型的用途及流程;2

2024-12-19 19:04:16 1744

1744

YOLOv8 是 ultralytics 公司在 2023 年 1月 10 號開源的基于YOLOV5進(jìn)行更新的 下一個(gè)重大更新版本,目前支持圖像分類、物體檢測和實(shí)例分割任務(wù),鑒于Yolov5的良好表現(xiàn),Yolov8在還沒有開源時(shí)就收到了用戶的廣泛關(guān)注。其主要結(jié)構(gòu)如下圖所示:

2025-04-16 14:53:45 1248

1248

1.Yolov5簡介YOLOv5模型是Ultralytics公司于2020年6月9日公開發(fā)布的。YOLOv5模型是基于YOLOv3模型基礎(chǔ)上改進(jìn)而來的,有YOLOv5s、YOLOv5

2025-07-25 15:22:48 1501

1501

1.Yolov5簡介 YOLOv5 模型是 Ultralytics 公司于 2020 年 6 月 9 日公開發(fā)布的。YOLOv5 模型是基于 YOLOv3 模型基礎(chǔ)上改進(jìn)而來的,有 YOLOv5

2025-09-11 16:43:37 2531

2531

YOLO是一種基于深度神經(jīng)網(wǎng)絡(luò)的目標(biāo)檢測算法,用在圖像或視頻中實(shí)時(shí)識別和定位多個(gè)對象。在其各個(gè)版本的迭代中,YOLOv5憑借易用性和性能平衡在工業(yè)、醫(yī)療、農(nóng)業(yè)、零售等領(lǐng)域被廣泛的應(yīng)用。本文以啟揚(yáng)

2025-09-18 17:27:54 1131

1131

迅為如何在RK3576開發(fā)板上部署YOLOv5;基于RK3576構(gòu)建智能門禁系統(tǒng)

2025-11-25 14:06:16 1559

1559

基于迅為RK3588開發(fā)板實(shí)現(xiàn)高性能機(jī)器狗主控解決方案-?AI能力實(shí)戰(zhàn):YOLOv5目標(biāo)檢測例程

2025-11-28 11:32:48 1288

1288

電子發(fā)燒友App

電子發(fā)燒友App

評論