NLP:關(guān)系抽取到底在乎什么

關(guān)系抽取到底在乎什么?這是來自EMNLP20上清華大學(xué)劉知遠(yuǎn)團(tuán)隊(duì)的“靈魂發(fā)問”~ 關(guān)系抽取是每一位N....

MIND:高質(zhì)量的新聞推薦數(shù)據(jù)集

MIND簡(jiǎn)介 個(gè)性化新聞推薦技術(shù)是諸多在線新聞網(wǎng)站和應(yīng)用的關(guān)鍵技術(shù),可以提升用戶的新聞閱讀體驗(yàn)并減輕....

機(jī)器學(xué)習(xí)中的Multi-Task多任務(wù)學(xué)習(xí)

概念 當(dāng)在一個(gè)任務(wù)中要優(yōu)化多于一個(gè)的目標(biāo)函數(shù)[1] ,就可以叫多任務(wù)學(xué)習(xí) 一些例外 「一個(gè)目標(biāo)函數(shù)的....

深度學(xué)習(xí):知識(shí)蒸餾的全過程

知識(shí)蒸餾的核心思想是通過遷移知識(shí),從而通過訓(xùn)練好的大模型得到更加適合推理的小模型。本文作者介紹了知識(shí)....

AAAI2021 NLP論文各個(gè)細(xì)方向的接收列表

最近整理了下AAAI2021 NLP論文各個(gè)細(xì)方向的接收列表!應(yīng)該還有幾篇漏網(wǎng)之魚,之后發(fā)現(xiàn)了補(bǔ)上~....

如何使用較小的語言模型,并用少量樣本來微調(diào)語言模型的權(quán)重

2020年,GPT-3可謂火出了圈。 不僅講故事的本職工作做得風(fēng)生水起,還跨界玩起了網(wǎng)頁設(shè)計(jì)、運(yùn)維、....

CRSLab對(duì)話推薦系統(tǒng)開源庫 相關(guān)代碼和對(duì)應(yīng)論文目前已經(jīng)開源

? 隨著對(duì)話系統(tǒng)和推薦系統(tǒng)的快速發(fā)展,新方向——對(duì)話推薦系統(tǒng)(Conversational Reco....

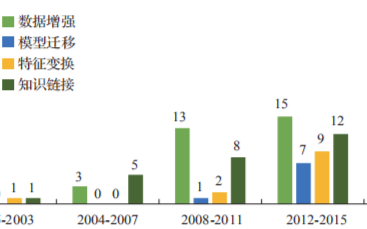

深度學(xué)習(xí):四種利用少量標(biāo)注數(shù)據(jù)進(jìn)行命名實(shí)體識(shí)別的方法

導(dǎo)讀 近年來,深度學(xué)習(xí)方法在特征抽取深度和模型精度上表現(xiàn)優(yōu)異,已經(jīng)超過了傳統(tǒng)方法,但無論是傳統(tǒng)機(jī)器學(xué)....

個(gè)人深度學(xué)習(xí)工作站配置詳細(xì)操作流程

前言 工作原因一直想配置一臺(tái)自己的深度學(xué)習(xí)工作站服務(wù)器,之前自己看完paper想做一些實(shí)驗(yàn)或者復(fù)現(xiàn)模....

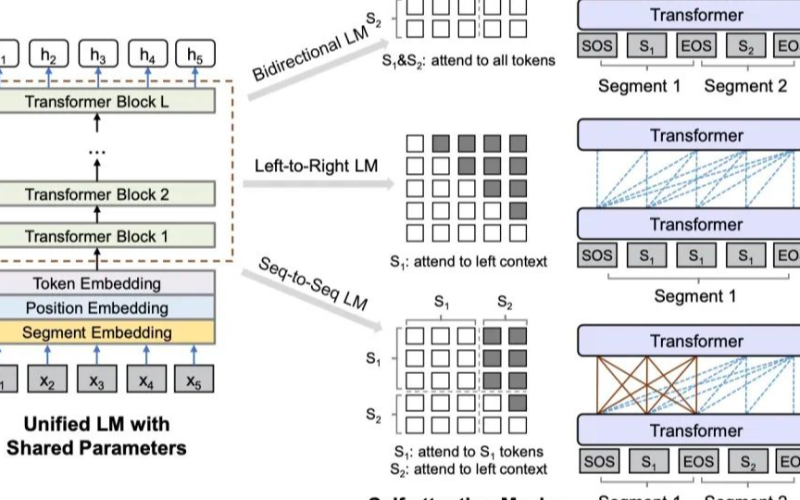

三種LM任務(wù)形式:?jiǎn)蜗騆M,雙向LM,序列到序列LM

今天分享一個(gè)論文UniLM[1],核心點(diǎn)是掌握三種LM任務(wù)形式:?jiǎn)蜗騆M,雙向LM,序列到序列LM;....

查詢服務(wù)器:OS、CPU、內(nèi)存、硬盤信息

一.前言 當(dāng)我們接手了一臺(tái)或者幾臺(tái)服務(wù)器的時(shí)候,首先我們有必要對(duì)服務(wù)器的基本配置有所認(rèn)識(shí),這樣才可以....

如何提高事件檢測(cè)(ED)模型的魯棒性和泛化能力?

論文中指出,以往關(guān)于ED的工作都是考慮如何提升模型的性能,而較少考慮模型的魯棒性和泛化能力,作者將模....

小米在預(yù)訓(xùn)練模型的探索與優(yōu)化

導(dǎo)讀:預(yù)訓(xùn)練模型在NLP大放異彩,并開啟了預(yù)訓(xùn)練-微調(diào)的NLP范式時(shí)代。由于工業(yè)領(lǐng)域相關(guān)業(yè)務(wù)的復(fù)雜性....

認(rèn)知圖譜是人工智能的下一個(gè)瑰寶

AI 的下一次機(jī)遇在哪里? 自 1956 年 AI 的概念首次被提出,至今已有 60 多年的發(fā)展史。....

多模態(tài)中NLP與CV融合的方式有哪些?

最早接觸多模態(tài)是一個(gè)抖音推薦項(xiàng)目,有一些視頻,標(biāo)題,用戶點(diǎn)贊收藏等信息,給用戶推薦作品,我當(dāng)時(shí)在這個(gè)....

從BERT得到最強(qiáng)句子Embedding的打開方式

? 你有嘗試從 BERT 提取編碼后的 sentence embedding 嗎?很多小伙伴的第一反....

機(jī)器學(xué)習(xí)算法那家強(qiáng) 因子分解機(jī)(FM算法)工業(yè)落地能力最強(qiáng)

文 | 石塔西 源 | 夕小瑤的賣萌屋 盡管BERT為代表的預(yù)訓(xùn)練模型大肆流行,但是身處工業(yè)界才會(huì)知....

GBDT是如何用于分類的

? 因?yàn)橛脴淠P吞?xí)以為常了,以至于看到這個(gè)標(biāo)題很容易覺得這很顯然。但越簡(jiǎn)單的東西越容易出現(xiàn)知識(shí)盲區(qū)....

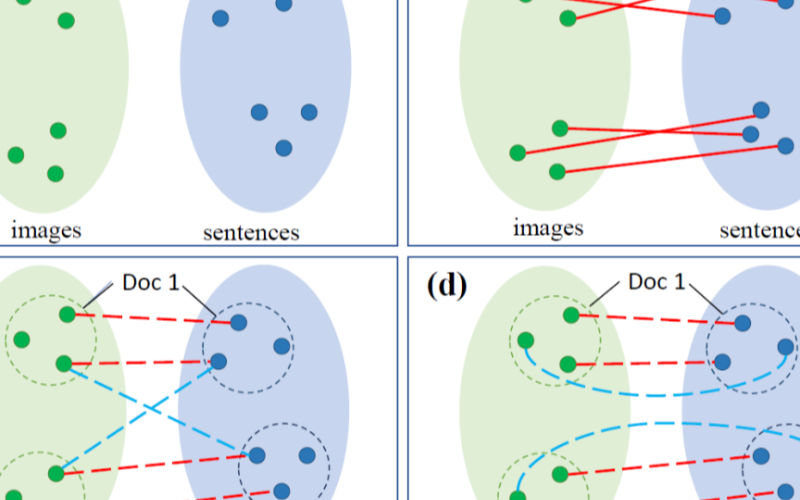

一種無監(jiān)督下利用多模態(tài)文檔結(jié)構(gòu)信息幫助圖片-句子匹配的采樣方法

? 引 言 ? 本文介紹了復(fù)旦大學(xué)數(shù)據(jù)智能與社會(huì)計(jì)算實(shí)驗(yàn)室 (Fudan DISC) 在AAAI 2....

一文帶你讀懂知識(shí)圖譜

1 什么是知識(shí)圖譜? 通俗地講,知識(shí)圖譜就是把所有不同種類的信息(Heterogeneous Inf....

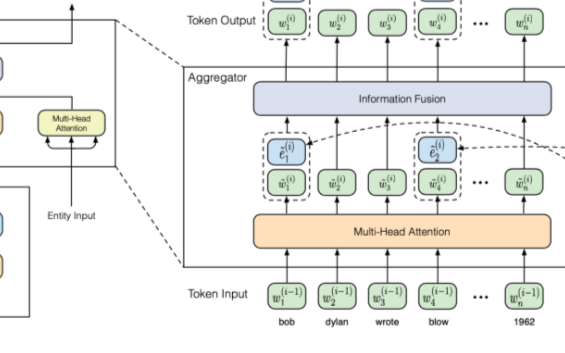

在BERT中引入知識(shí)圖譜中信息的若干方法

引言 隨著BERT等預(yù)訓(xùn)練模型橫空出世,NLP方向迎來了一波革命,預(yù)訓(xùn)練模型在各類任務(wù)上均取得了驚人....

程序員必備公眾號(hào)推薦

今天推薦幾個(gè)優(yōu)質(zhì)的公眾號(hào),他們有態(tài)度、有溫度、有質(zhì)量,值得擁有。 ? ? Java之道 有道無術(shù),術(shù)....

邏輯回歸與GBDT模型各自的原理及優(yōu)缺點(diǎn)

一、GBDT+LR簡(jiǎn)介 協(xié)同過濾和矩陣分解存在的劣勢(shì)就是僅利用了用戶與物品相互行為信息進(jìn)行推薦, 忽....

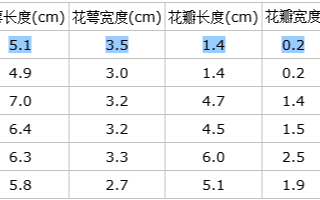

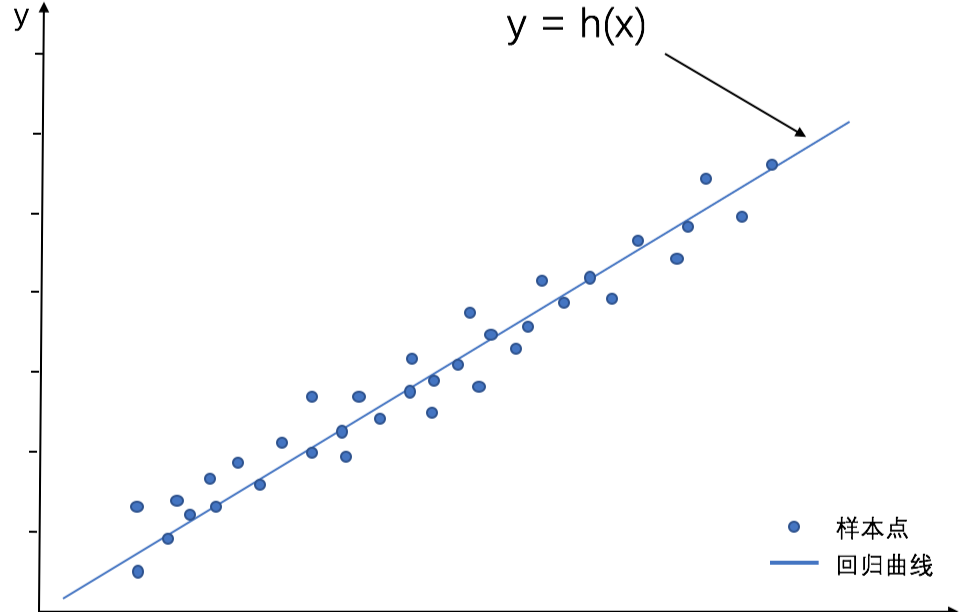

機(jī)器學(xué)習(xí):線性回歸與邏輯回歸的理論與實(shí)戰(zhàn)

1、基本概念 要進(jìn)行機(jī)器學(xué)習(xí),首先要有數(shù)據(jù)。從數(shù)據(jù)中學(xué)得模型的過程稱為“學(xué)習(xí)”或“訓(xùn)練”。其對(duì)應(yīng)的過....

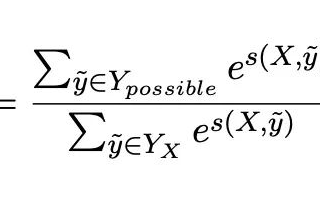

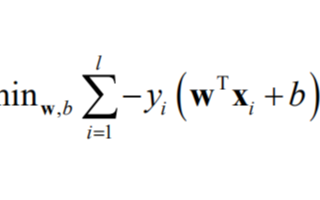

機(jī)器學(xué)習(xí)中若干典型的目標(biāo)函數(shù)構(gòu)造方法

幾乎所有的機(jī)器學(xué)習(xí)算法都?xì)w結(jié)為求解最優(yōu)化問題。有監(jiān)督學(xué)習(xí)算法在訓(xùn)練時(shí)通過優(yōu)化一個(gè)目標(biāo)函數(shù)而得到模型,....

哈工大訊飛聯(lián)合實(shí)驗(yàn)室發(fā)布的中文ELECTRA系列預(yù)訓(xùn)練模型再迎新成員

哈工大訊飛聯(lián)合實(shí)驗(yàn)室發(fā)布的中文ELECTRA系列預(yù)訓(xùn)練模型再迎新成員。我們基于大規(guī)模法律文本訓(xùn)練出中....