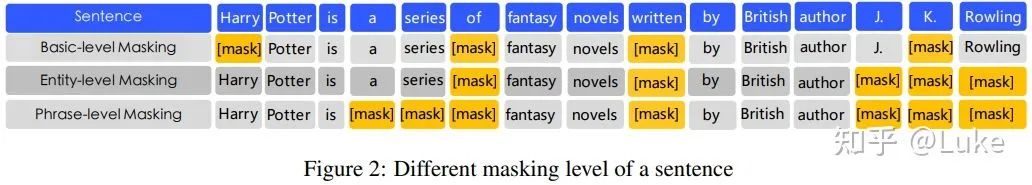

知識圖譜與BERT相結(jié)合助力語言模型

感謝清華大學(xué)自然語言處理實驗室對預(yù)訓(xùn)練語言模型架構(gòu)的梳理,我們將沿此脈絡(luò)前行,探索預(yù)訓(xùn)練語言模型的前....

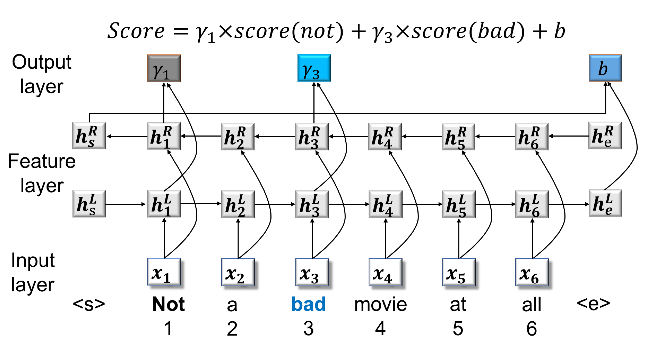

基于Aspect、Target等醫(yī)療領(lǐng)域情感分析的應(yīng)用場景

前言 情感分析是文本分類的一個分支,是對帶有情感色彩(褒義貶義/正向負(fù)向)的主觀性文本進(jìn)行分析,以確....

將淺層神經(jīng)網(wǎng)絡(luò)作為“弱學(xué)習(xí)者”的梯度Boosting框架

1. 簡介 本文提出了一種新的梯度Boosting框架,將淺層神經(jīng)網(wǎng)絡(luò)作為“弱學(xué)習(xí)者”。在此框架下,....

淺談圖神經(jīng)網(wǎng)絡(luò)在自然語言處理中的應(yīng)用簡述

近幾年,神經(jīng)網(wǎng)絡(luò)因其強(qiáng)大的表征能力逐漸取代傳統(tǒng)的機(jī)器學(xué)習(xí)成為自然語言處理任務(wù)的基本模型。然而經(jīng)典的神....

開放域信息抽取和文本知識結(jié)構(gòu)化的3篇論文詳細(xì)解析

開放域信息抽取是信息抽取任務(wù)的另一個分支任務(wù),其中抽取的謂語和實體并不是特定的領(lǐng)域,也并沒有提前定義....

關(guān)于一項改進(jìn)Transformer的工作

NAACL2021中,復(fù)旦大學(xué)大學(xué)數(shù)據(jù)智能與社會計算實驗室(Fudan DISC)和微軟亞洲研究院合....

你們知道國內(nèi)較強(qiáng)的NLP高校實驗室有哪些嗎?

說一下我了解的學(xué)校和實驗室!排名不分先后,名單不全,歡迎補(bǔ)充~ 清華大學(xué):孫茂松老師、劉知遠(yuǎn) @劉知....

13個你一定來看看的PyTorch特性!

作者:MARCIN ZAB?OCKIMARCIN ZAB?OCKI 編譯:ronghuaiyang(....

自然語言模型預(yù)訓(xùn)練的發(fā)展史

自從深度學(xué)習(xí)火起來后,預(yù)訓(xùn)練過程就是做圖像或者視頻領(lǐng)域的一種比較常規(guī)的做法,有比較長的歷史了,而且這....

解讀一下DeBERTa在BERT上有哪些改造

為了解決預(yù)訓(xùn)練和微調(diào)時,因為任務(wù)的不同而預(yù)訓(xùn)練和微調(diào)階段的gap,加入了一個增強(qiáng)decoder端,這....

用幾個深度學(xué)習(xí)框架串起來這些年歷史上的一些有趣的插曲

清明節(jié)這幾天有些時間寫了這篇文章,從我的視角,用幾個深度學(xué)習(xí)框架串起來這些年歷史上的一些有趣的插曲,....

圖神經(jīng)網(wǎng)絡(luò)的解釋性綜述

圖神經(jīng)網(wǎng)絡(luò)的可解釋性是目前比較值得探索的方向,今天解讀的2021最新綜述,其針對近期提出的 GNN ....

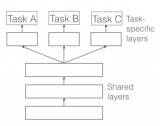

詳解多任務(wù)學(xué)習(xí)的方法與現(xiàn)實

大家在做模型的時候,往往關(guān)注一個特定指標(biāo)的優(yōu)化,如做點擊率模型,就優(yōu)化AUC,做二分類模型,就優(yōu)化f....

詳解一種簡單而有效的Transformer提升技術(shù)

近些年,Transformer[1]逐漸成為了自然語言處理中的主流結(jié)構(gòu)。為了進(jìn)一步提升Transfo....

兩個NLP模型的預(yù)測分析

圖數(shù)據(jù)的天然優(yōu)勢是為學(xué)習(xí)算法提供了豐富的結(jié)構(gòu)化信息,節(jié)點之間鄰接關(guān)系的設(shè)計成為了重要的先驗信息和交互....

讓長短期記憶人工神經(jīng)網(wǎng)絡(luò)重返巔峰

1.開篇 去年年底,各大榜單上風(fēng)起云涌,各路英雄在榜單上為了分?jǐn)?shù)能多個0.01而不停的躁動,迫不及待....