論文中指出,以往關(guān)于ED的工作都是考慮如何提升模型的性能,而較少考慮模型的魯棒性和泛化能力,作者將模型的魯棒性和泛化能力定義為如下三條,并通過設(shè)計模型進行研究:

抗攻擊性能:當(dāng)訓(xùn)練數(shù)據(jù)中被加入擾動,會如何影響模型性能;

新類型的預(yù)測:模型能否預(yù)測出訓(xùn)練集中未見過的事件類型;

事件類型的模糊性: 根據(jù)統(tǒng)計,70%的事件觸發(fā)詞能夠觸發(fā)不同類型的事件,如何正確識別出這些模糊性觸發(fā)詞在各自上下文中所觸發(fā)的具體事件類型。

基于以上問題,作者提出一種新的學(xué)習(xí)方式,主要包括一下兩部分:

Contextselective discriminative learning: 根據(jù)句子內(nèi)部的不同words的重要性得到trigger的上下文表示,目標(biāo)是基于trigger的上下文表示預(yù)測句子中被mask的trigger的事件類型。

Contextualized similarity learning:基于"相同類型的事件觸發(fā)詞應(yīng)當(dāng)具有相似上下文"的假設(shè),以mask-contraining的句子對為輸入,如何輸入中的兩個句子表達的是同一事件類型,則訓(xùn)練目標(biāo)是使他們的masked triggers具有語義相近的上下文表示。

作者分別將本文的模型與以往的SOTA模型進行了對比實驗,證明了本文模型能較好地應(yīng)對對抗攻擊、未知類型預(yù)測和事件模糊性區(qū)分的問題。

原文標(biāo)題:【每日一讀】EMNLP2020:如何提高事件檢測(ED)模型的魯棒性和泛化能力?

文章出處:【微信公眾號:深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

責(zé)任編輯:haq

-

模型

+關(guān)注

關(guān)注

1文章

3752瀏覽量

52111 -

深度學(xué)習(xí)

+關(guān)注

關(guān)注

73文章

5599瀏覽量

124398

原文標(biāo)題:【每日一讀】EMNLP2020:如何提高事件檢測(ED)模型的魯棒性和泛化能力?

文章出處:【微信號:zenRRan,微信公眾號:深度學(xué)習(xí)自然語言處理】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

瞻芯電子G2 650V SiC MOSFET的魯棒性驗證試驗

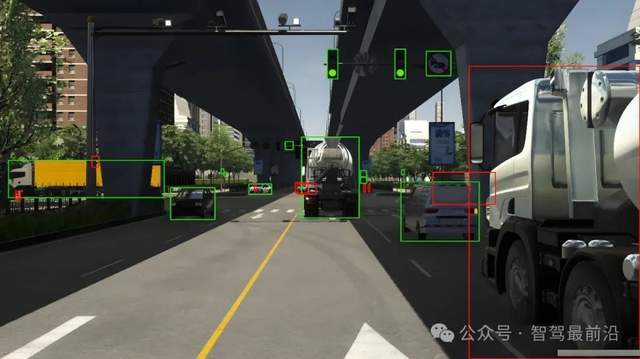

自動駕駛大模型中常提的泛化能力是指啥?

ElfBoard技術(shù)貼|如何在【RK3588】ELF 2開發(fā)板上完成PPOC本地化部署

基于級聯(lián)分類器的人臉檢測基本原理

構(gòu)建CNN網(wǎng)絡(luò)模型并優(yōu)化的一般化建議

海康威視大模型精準檢測守護高速安全

自動駕駛數(shù)據(jù)標(biāo)注主要是標(biāo)注什么?

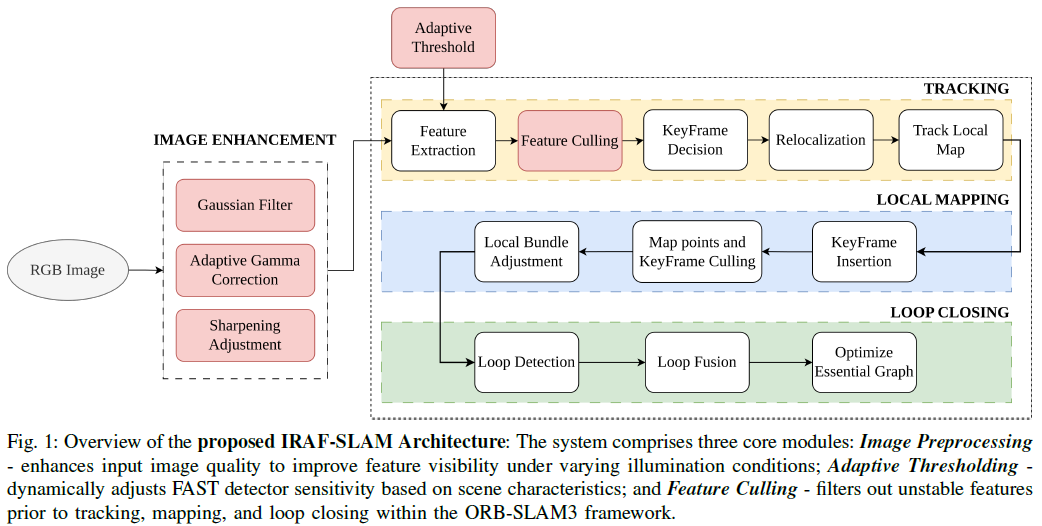

具備光照魯棒和自適應(yīng)特征剔除的VSLAM前端框架

無軸承異步電機轉(zhuǎn)子徑向位移白檢測

明晚開播 |數(shù)據(jù)智能系列講座第7期:面向高泛化能力的視覺感知系統(tǒng)空間建模與微調(diào)學(xué)習(xí)

直播預(yù)約 |數(shù)據(jù)智能系列講座第7期:面向高泛化能力的視覺感知系統(tǒng)空間建模與微調(diào)學(xué)習(xí)

如何提高事件檢測(ED)模型的魯棒性和泛化能力?

如何提高事件檢測(ED)模型的魯棒性和泛化能力?

評論