個人智能體今年的演進出現哪些趨勢?在以OpenClaw(小龍蝦)大熱的當下,芯片廠商如何考慮智能體在終端的應用前景和機會?這些熱點問題在3月27日的CFMS MemoryS 2026 峰會上,來自高通公司AI產品技術中國區負責人萬衛星給出了前瞻的技術分析和AI全棧技術解決方案。

AI應用四大階段演進,端側AI部署面臨三大挑戰

萬衛星指出,AI在行業應用經歷三個重要階段,從感知AI、生成式AI向智能體AI演進,未來將進入物理AI時代。

感知AI主要包括多媒體信號、語音信號的理解,對圖像的分類識別和智能降噪等傳統領域的用例;生成式AI的特點是,在基于大量數據預訓練的情況下,AI可以在有監督的情況下去解決一些具體的問題,比如說OpenAI的ChatGPT模型,以及文生圖模型等等。智能體AI與生成式AI的重要區別是,基本上可以在無監督的情況下,自主的去理解用戶意圖,進行行動和決策,幫我們解決稍微復雜的任務。第四階段物理AI,AI可以真正去理解我們的物理世界,根據真實物理世界的物理規定,對輸入進行反饋和輸出。這一技術還在早期應用階段。

目前行業關注的第二階段和第三階段,我們看到的明顯趨勢是:能夠在端側運行的生成式AI模型,它的智能正在快速的提升。首先,端側設備能夠支持的模型參數量正在變得越來越大,比如在手機上我們已經可以運行10億到100億參數級別的大模型,在PC上可以運行130億到200億參數量的大模型。在車上,我們可以支持的模型參數量可能會更大,達到200~600億的級別。

在更小型的設備上,比如AR眼鏡和低功耗設備,我們也實現了讓參數規模在10億-40億之間的模型完全在端側運行。萬衛星強調,相較于云端大模型,端側模型的參數量仍然相對較小,但行業內的各種技術正在推動端側大模型支持體量的提升,比如內存帶寬提升,量化位寬技術的優化可以進一步壓縮模型尺寸,這都意味著終端設備可以承載更豐富的模型。

尤其值得關注的是,高通已經將具備推理能力的大模型部署到端側。而且在端側大模型對應的各種的各類場景中,其支持的上下文長度也在提升。3年前,端側上下文長度普遍僅限于1k-2k,2年前,大部分場景的上下文已經擴展到2k-4k;而2025年,高通在與合作伙伴的場景探索中,這個區間已提升到4k-8k。在一些特定場景中,甚至已經可以支持32k-128k的上下文長度。

在面對支持更多上下文的端側部署挑戰時,高通認為有三點:一、端側內存規模的限制。雖然我們有很多技術手段能夠壓縮模型體積,但有限的內存終究會對可運行的模型大小設置上限,而模型大小的上限也意味著端側AI能力的上限。二、內存帶寬有限制,有限的帶寬會影響大模型輸出token(詞元)的速度,進而影響到具體場景里面的用戶體驗。三、終端設備部署大模型,能效比和散熱的問題不可避免。在多終端設備中,能效非常重要。我們要避免AI推理在運行時觸發溫控限制,避免引起設備發熱。

智能體演進三大趨勢,從端側AI芯片到AI推理芯片全面覆蓋

萬衛星指出,個人AI將始于端側,我們正在邁向以AI和用戶為中心的多終端體驗,終端側智能體將能夠提供更低時延、更好的個性化以及持續無感的用戶體驗。

當下,智能體從端側智能體、智能體專業化、高度個性化和多模態為主要發展趨勢,終端側智能體不再是以前那種簡單的對話類語音助手,而是變成能夠充分理解用戶意圖、理解上下文、理解用戶感知信息的真正懂你的AI助手。

在過去,個人AI更多是以手機為中心,耳機、眼鏡、手表等其他設備是作為附屬與手機連接。未來,我們正在邁向以AI和用戶為中心的多終端體驗。也就是說AI不再綁定某一個具體的設備,如果是通過個人AI或者智能體去理解用戶的意圖,再去執行用戶的任務。個人AI通過混合架構在終端側進行部署。在終端側、本地邊緣、網絡邊緣和中央云協同工作。

高通在去年也發布了多款可以提供充分算力去支撐個人AI場景的產品,包括第五代驍龍8至尊版移動平臺、驍龍X2 Elite計算平臺等。在數據中心側,高通在MWC2026上正式發布了基于Qualcomm? AI200和AI250芯片的加速卡和機架系統。我們以行業領先的總體擁有成本(TCO)為高速數據中心生成式AI推理提供機架級性能與卓越內存容量。

在演講最后,萬衛星強調:“高通AI全棧能力,從手機、耳機、可穿戴設備、PC等消費電子產品,再到汽車、機器人,甚至到下一代的數據中心,我們都在用統一的AI架構去賦能所有的產品,核心就在于我們能夠通過統一的技術路線,提供高性能、高能效的軟硬件技術底座,讓高通的AI能力得以從單個產品或者單顆芯片擴展成為規模化的跨終端、跨場景的平臺級能力。”

-

高通

+關注

關注

78文章

7742瀏覽量

200090 -

智能體

+關注

關注

1文章

518瀏覽量

11625 -

AI芯片

+關注

關注

17文章

2138瀏覽量

36823

發布評論請先 登錄

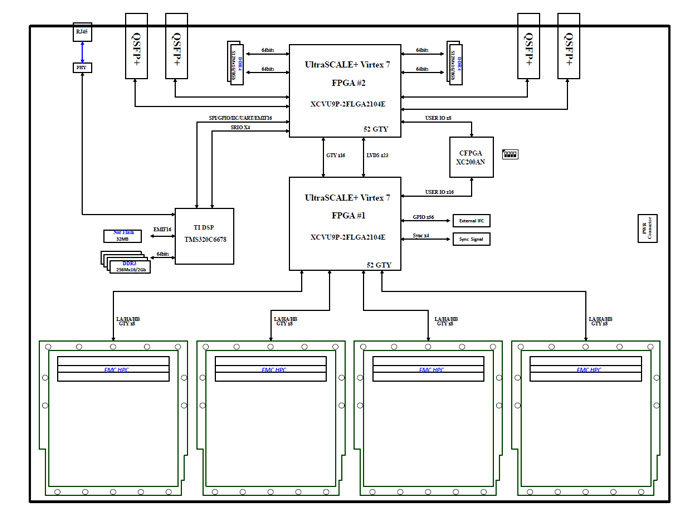

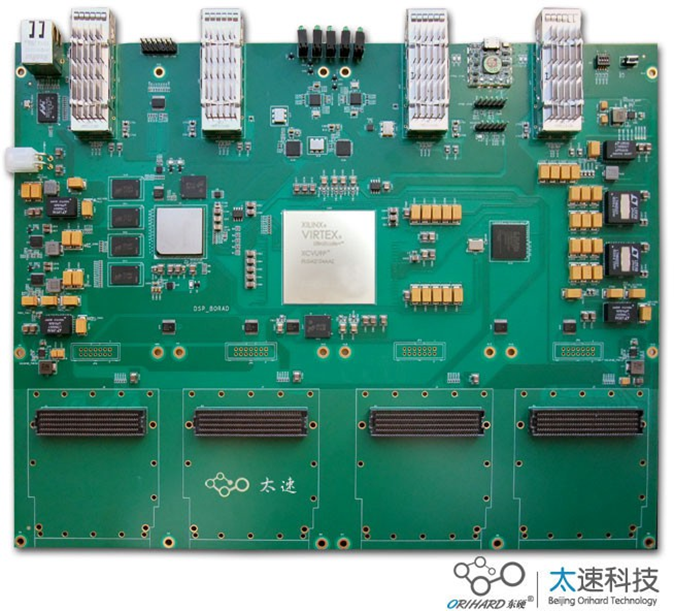

FPGA硬件加速卡設計原理圖:1-基于Xilinx XCKU115的半高PCIe x8 硬件加速卡 PCIe半高 XCKU115-3-FLVF1924-E芯片

推理<2ms!Ultralytics最新YOLO26+樹莓派+國產AI加速卡實現 500 FPS 端側 AI 性能巔峰!

新品 | LLM-8850 Kit,高性能AI加速卡套件 DinMeter v1.1,1/32DIN標準嵌入式開發板

昆侖芯R200 AI加速卡技術規格解析

邁向云端算力巔峰:昆侖芯K200 AI加速卡全面解讀

AI賦能6G與衛星通信:開啟智能天網新時代

虛擬電廠加速卡不是噱頭!萬點規模VPP的性能分水嶺

新品 | LLM-8850 Card, AX8850邊緣設備AI加速卡

智算加速卡是什么東西?它真能在AI戰場上干掉GPU和TPU!

邊緣AI運算革新 DeepX DX-M1 AI加速卡結合Rockchip RK3588多路物體檢測解決方案

AI加速卡到底是個啥?一文讓小白也能看懂AI時代的“超級計算器”!

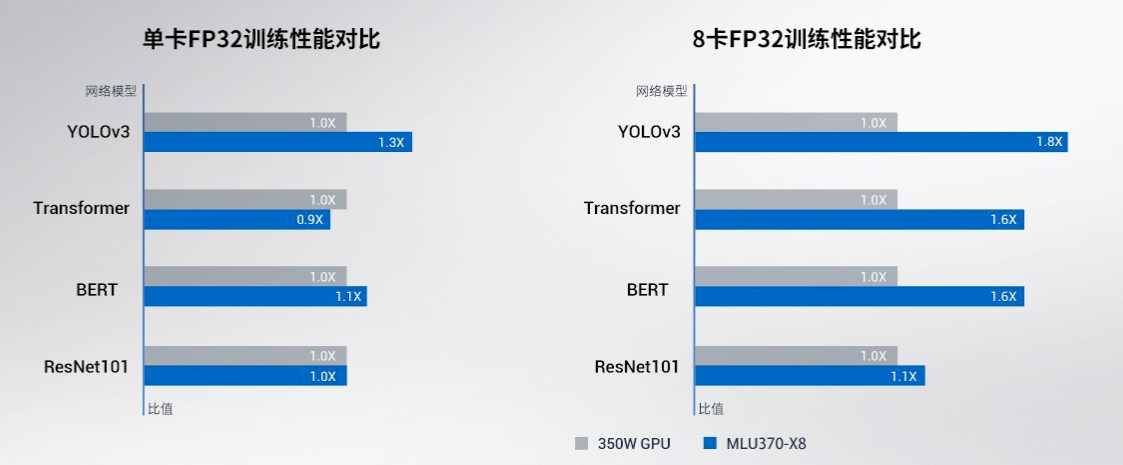

寒武紀基于思元370芯片的MLU370-X8 智能加速卡產品手冊詳解

不止手機!高通AI全面進擊,芯片到加速卡,萬衛星解讀關鍵布局

不止手機!高通AI全面進擊,芯片到加速卡,萬衛星解讀關鍵布局

評論