從邊緣到云端,當(dāng)算力需求躍升至256 TOPS,昆侖芯K200以全高全長(zhǎng)雙槽位的專業(yè)姿態(tài),為企業(yè)級(jí)AI訓(xùn)練與推理場(chǎng)景帶來全新選擇。

在人工智能模型參數(shù)規(guī)模呈指數(shù)級(jí)增長(zhǎng)的今天,云數(shù)據(jù)中心對(duì)高密度算力的渴求日益迫切。昆侖芯科技在成功推出邊緣型K100加速卡后,正式發(fā)布面向云端和高性能計(jì)算場(chǎng)景的K200 AI加速卡,將INT8算力推升至256 TOPS,為大規(guī)模AI訓(xùn)練與推理任務(wù)提供了強(qiáng)有力的國產(chǎn)化算力支撐。

昆侖芯K200技術(shù)架構(gòu)與市場(chǎng)定位分析

近期,昆侖芯完成了從K100到K200的產(chǎn)品迭代,實(shí)現(xiàn)了從邊緣側(cè)到云端數(shù)據(jù)中心的算力覆蓋。本文將從技術(shù)演進(jìn)、應(yīng)用場(chǎng)景及市場(chǎng)影響等角度,對(duì)這一產(chǎn)品布局進(jìn)行分析。

1.算力架構(gòu):在迭代中保持連續(xù)性

K200延續(xù)了前代產(chǎn)品的核心架構(gòu)(XPU-K),并在其基礎(chǔ)上進(jìn)行了深度優(yōu)化,實(shí)現(xiàn)了全面的性能提升。

從核心算力指標(biāo)來看,K200呈現(xiàn)出清晰的精度與性能對(duì)應(yīng)關(guān)系:

INT8:256 TOPS,較前代實(shí)現(xiàn)翻倍,適用于對(duì)量化部署要求較高的大規(guī)模模型。

FP16:64 TFLOPS,為混合精度訓(xùn)練及高精度推理提供支持。

INT16/FP32等精度也實(shí)現(xiàn)了相應(yīng)提升,展現(xiàn)了架構(gòu)設(shè)計(jì)的可擴(kuò)展性。

這種在統(tǒng)一架構(gòu)下的性能躍升,有助于降低用戶在不同部署場(chǎng)景(邊緣至云端)和任務(wù)類型(推理至訓(xùn)練)間的開發(fā)與遷移成本。

- 內(nèi)存系統(tǒng):針對(duì)大模型的優(yōu)化設(shè)計(jì)

K200的顯著升級(jí)體現(xiàn)在其內(nèi)存子系統(tǒng),旨在應(yīng)對(duì)參數(shù)規(guī)模不斷擴(kuò)大的AI模型:

容量與帶寬:配備16GB HBM高帶寬內(nèi)存,容量翻倍;訪存帶寬達(dá)到512 GB/s,提升100%。這為處理大數(shù)據(jù)批次的訓(xùn)練和推理任務(wù)提供了關(guān)鍵支持,有助于緩解“內(nèi)存墻”對(duì)計(jì)算效率的制約。

應(yīng)用價(jià)值:此類配置使其能夠更從容地服務(wù)于千億參數(shù)模型的分布式訓(xùn)練、高并發(fā)在線推理以及多任務(wù)混合負(fù)載等對(duì)內(nèi)存要求較高的場(chǎng)景。

- 應(yīng)用場(chǎng)景:擴(kuò)展至云端訓(xùn)練與推理

K200的定位從邊緣推理擴(kuò)展到了云端的訓(xùn)練與推理,拓寬了其適用場(chǎng)景:

計(jì)算機(jī)視覺:可支持更高分辨率圖像、更復(fù)雜模型(如用于自動(dòng)駕駛、醫(yī)療影像的檢測(cè)與分割模型)的訓(xùn)練與推理。

自然語言處理:大內(nèi)存與高帶寬特性有利于高效處理長(zhǎng)序列Transformer模型,覆蓋從預(yù)訓(xùn)練、精調(diào)到推理的流程。

多模態(tài)任務(wù):其混合精度計(jì)算能力適合處理語音、視頻等時(shí)序數(shù)據(jù)及跨模態(tài)融合任務(wù)。

對(duì)訓(xùn)練任務(wù)的原生支持,使得基于同一硬件平臺(tái)構(gòu)建從模型開發(fā)到服務(wù)部署的完整AI流水線成為可能,有助于簡(jiǎn)化技術(shù)棧。

- 物理規(guī)格:適應(yīng)數(shù)據(jù)中心部署需求

K200采用全高全長(zhǎng)雙槽位設(shè)計(jì),這一變化反映了其面向數(shù)據(jù)中心的產(chǎn)品定位:

更強(qiáng)的供電與散熱設(shè)計(jì)支持持續(xù)高性能運(yùn)算。

豐富的擴(kuò)展接口為多卡互聯(lián)與高速網(wǎng)絡(luò)提供了基礎(chǔ)。

標(biāo)準(zhǔn)化的規(guī)格確保其能兼容主流服務(wù)器。

這與面向邊緣低功耗場(chǎng)景的K100形成了明確區(qū)分,體現(xiàn)了針對(duì)不同市場(chǎng)細(xì)分的產(chǎn)品策略。

- 開發(fā)生態(tài):強(qiáng)調(diào)兼容性與可移植性

對(duì)于開發(fā)者而言,K200的優(yōu)勢(shì)在于其生態(tài)連續(xù)性。其軟件棧保持向前兼容,為原有平臺(tái)(如K100)開發(fā)的模型與應(yīng)用可以較低成本遷移至K200,以利用更強(qiáng)的算力。同時(shí),對(duì)訓(xùn)練的支持允許開發(fā)者在統(tǒng)一平臺(tái)上完成從開發(fā)、訓(xùn)練到邊緣部署的閉環(huán)。 - 市場(chǎng)定位:提供國產(chǎn)化算力選項(xiàng)

在當(dāng)前由少數(shù)國際廠商主導(dǎo)的高端AI加速器市場(chǎng)中,K200的推出為用戶提供了一個(gè)國產(chǎn)化選項(xiàng)。其256 TOPS INT8算力、16GB HBM與512 GB/s帶寬的組合,在特定應(yīng)用場(chǎng)景中形成了具有特點(diǎn)的性能配置。在金融、政務(wù)、科研等對(duì)供應(yīng)鏈安全或數(shù)據(jù)合規(guī)有較高要求的領(lǐng)域,此類國產(chǎn)算力產(chǎn)品正獲得越來越多的關(guān)注與評(píng)估。

總結(jié)與展望

從K100到K200,昆侖芯構(gòu)建了覆蓋邊緣到云端的算力產(chǎn)品序列。兩款產(chǎn)品基于統(tǒng)一的軟件生態(tài),為構(gòu)建協(xié)同的“云邊端”AI基礎(chǔ)設(shè)施提供了技術(shù)路徑上的連續(xù)性。

對(duì)于技術(shù)決策者而言,在規(guī)劃算力平臺(tái)時(shí),仍需緊密結(jié)合實(shí)際業(yè)務(wù)場(chǎng)景的負(fù)載特征、精度要求、擴(kuò)展性及總擁有成本(TCO)進(jìn)行綜合評(píng)估。昆侖芯K200的加入,為市場(chǎng)提供了新的配置選擇,特別是在考慮國產(chǎn)化替代或特定性能需求的場(chǎng)景下,值得納入評(píng)估范圍。

審核編輯 黃宇

-

AI

+關(guān)注

關(guān)注

91文章

40403瀏覽量

301972 -

算力

+關(guān)注

關(guān)注

2文章

1580瀏覽量

16804

發(fā)布評(píng)論請(qǐng)先 登錄

昆侖芯科技亮相2026亞布力中國企業(yè)家論壇并發(fā)表主題演講

邊緣AI算力臨界點(diǎn):深度解析176TOPS香橙派AI Station的產(chǎn)業(yè)價(jià)值

Hailo-8算力卡 + RK3588實(shí)測(cè)!26TOPS加持,助力AI視覺升級(jí)!

Banana Pi開源硬件社區(qū)基于龍芯2K3000+多樣化AI算力卡構(gòu)建的全國產(chǎn)化工業(yè)邊緣AI算力底盤

推理<2ms!Ultralytics最新YOLO26+樹莓派+國產(chǎn)AI加速卡實(shí)現(xiàn) 500 FPS 端側(cè) AI 性能巔峰!

新品 | LLM-8850 Kit,高性能AI加速卡套件 DinMeter v1.1,1/32DIN標(biāo)準(zhǔn)嵌入式開發(fā)板

算力密度翻倍!江原D20加速卡發(fā)布,一卡雙芯重構(gòu)AI推理標(biāo)桿

新品 | LLM-8850 Card, AX8850邊緣設(shè)備AI加速卡

此芯科技發(fā)布“合一”AI加速計(jì)劃,賦能邊緣與端側(cè)AI創(chuàng)新

昆侖芯科技亮相2025中國算力大會(huì)

華為AI UBB解決方案加速網(wǎng)絡(luò)邁向高階智能

智算加速卡是什么東西?它真能在AI戰(zhàn)場(chǎng)上干掉GPU和TPU!

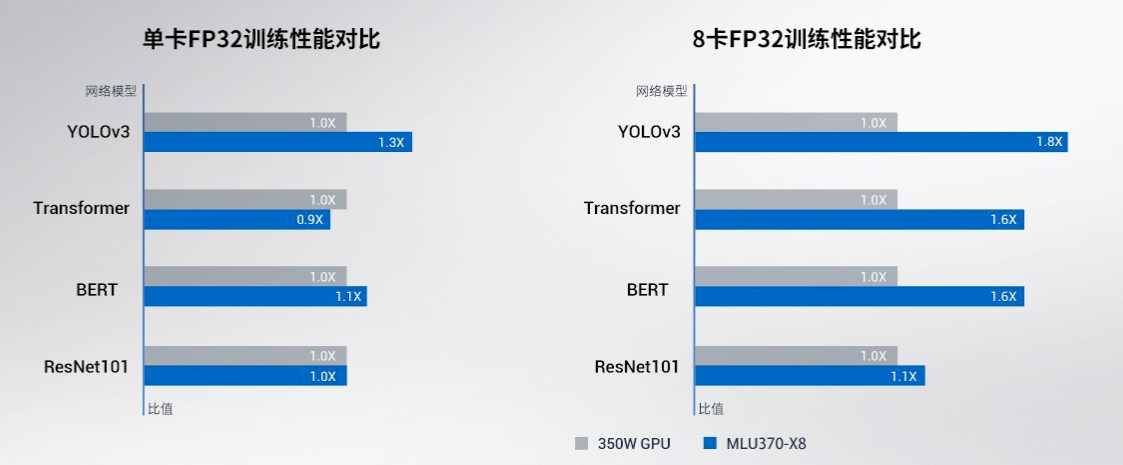

寒武紀(jì)基于思元370芯片的MLU370-X8 智能加速卡產(chǎn)品手冊(cè)詳解

邁向云端算力巔峰:昆侖芯K200 AI加速卡全面解讀

邁向云端算力巔峰:昆侖芯K200 AI加速卡全面解讀

評(píng)論