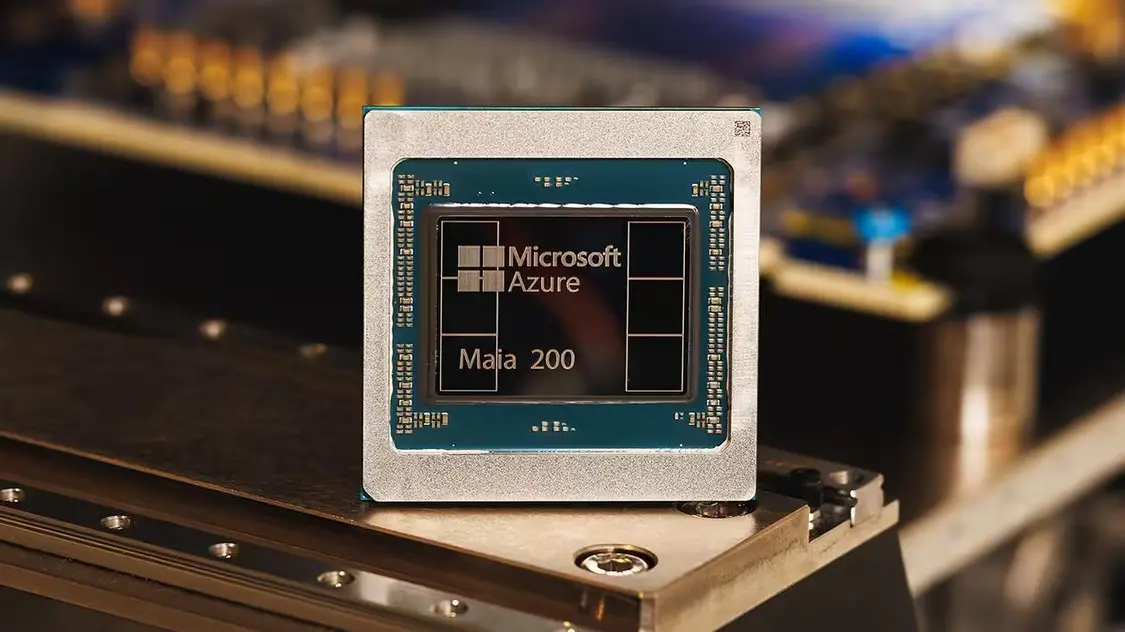

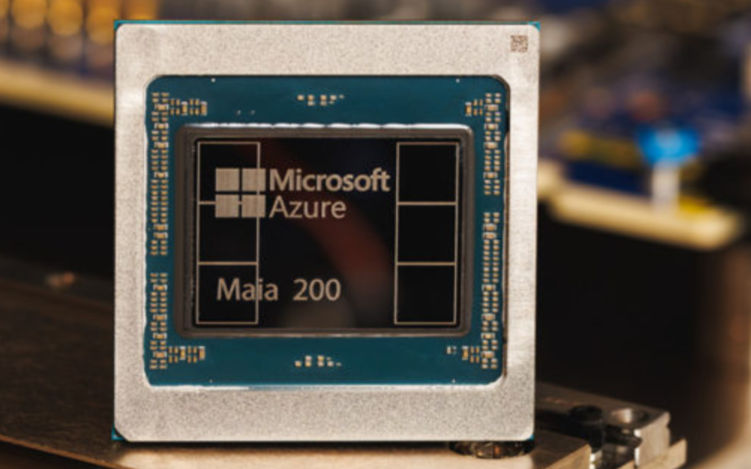

電子發燒友網綜合報道 美東時間1月26日,微軟重磅發布第二代自研人工智能芯片Maia 200,這一舉措成為微軟減少對英偉達芯片依賴、高效驅動自身服務的關鍵一步,也標志著其在自研芯片領域取得重大進展。

Maia 200采用臺積電先進的3納米工藝制造,現已開始部署至愛荷華州的數據中心,后續還將進駐鳳凰城地區。微軟云與AI業務負責人Scott Guthrie在博客文章中宣稱,Maia 200是“微軟有史以來部署的最高效推理系統”,每美元性能相比微軟當前最新一代硬件提升30%。

從性能指標來看,Maia 200表現卓越。在FP4精度下,其性能是第三代亞馬遜Trainium芯片的三倍;FP8性能則超越谷歌第七代TPU。微軟已向開發者、學術界和前沿AI實驗室開放Maia 200軟件開發工具包的預覽版,并計劃未來向更多客戶開放該芯片的云服務租用。

Maia 200被設計為專門的推理加速器,重點優化AI生成內容(如回答用戶提問)這類持續計算任務,旨在降低運行ChatGPT、Copilot等服務的調用成本。它可服務于包括OpenAI最新GPT - 5.2模型在內的多種AI模型,為Microsoft Foundry和Microsoft 365 Copilot帶來成本優勢。

在可持續性方面,微軟執行副總裁斯科特·蓋茨在宣傳視頻中強調,Maia 200采用更高效的水冷設計方案,可實現“零浪費”,有效減少數據中心對當地環境與水資源的壓力。

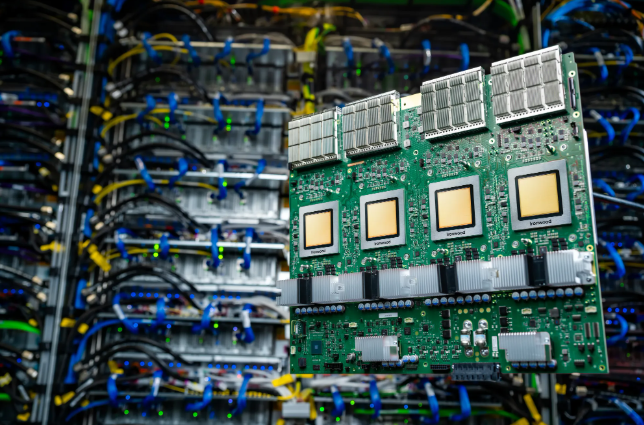

回顧微軟自研AI芯片之路,距離發布第一代人工智能芯片Maia 100已過去兩年。2023年11月,微軟在Ignite大會上發布Maia 100,采用臺積電5納米工藝,運用CoWoS - S封裝技術,擁有1050億個晶體管,略少于AMD MI300(1530億)。它主要用途是AI訓練與推理,側重于大語言模型(LLM),內存配置為64GB HBM2E,帶寬約1.6TB/s - 1.8TB/s,采用液冷散熱方式,專為高密度數據中心設計。

Maia 100并非單純追求極致算力,而是為優化微軟Azure云服務的特定場景而生,用于運行Bing、GitHub Copilot以及OpenAI的模型。微軟采用垂直集成思路,從芯片、服務器主板到機架冷卻系統協同設計。其獨特的“MX”數據類型是一大亮點,微軟引入自定義的MX數據格式,支持亞8位(Sub - 8 - bit)計算,通過軟硬件協同設計,在保持模型精度的同時,顯著提升計算密度和能效,特別適合大語言模型的推理任務。

在設計上,Maia 100有取有舍。短板在于片外內存帶寬(HBM)約為1.6TB/s,略低于英偉達H100和谷歌TPU v5,因其基于LLM熱潮前設計;長板則是擁有強大的片上網絡(NoC)和集群互聯能力,每個芯片內置RDMA以太網接口,集群間互聯帶寬高達4.8 Tbps,可通過極快網絡彌補單點顯存不足,適合大規模分布式訓練。為方便開發者使用,Maia 100支持OpenAI Triton和標準的PyTorch框架,開發者無需重寫大量代碼就能將模型遷移到Maia硬件上。

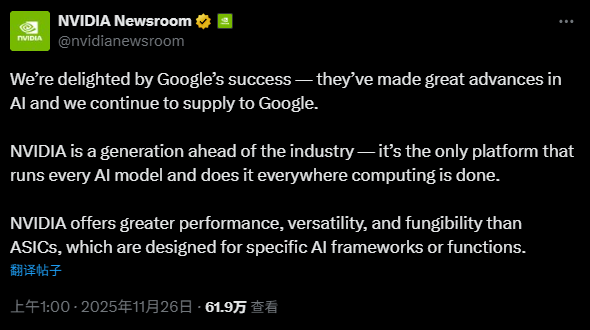

微軟此次發布Maia 200,凸顯了科技巨頭爭奪AI算力自主權的激烈競爭。在英偉達芯片供應緊張且成本高昂的背景下,微軟、亞馬遜和谷歌均加快自研芯片進程,力求為云客戶提供成本更低、集成更順暢的替代方案。微軟已表示正在設計Maia 300后續產品,未來其在AI芯片領域的發展值得期待。

Maia 200采用臺積電先進的3納米工藝制造,現已開始部署至愛荷華州的數據中心,后續還將進駐鳳凰城地區。微軟云與AI業務負責人Scott Guthrie在博客文章中宣稱,Maia 200是“微軟有史以來部署的最高效推理系統”,每美元性能相比微軟當前最新一代硬件提升30%。

從性能指標來看,Maia 200表現卓越。在FP4精度下,其性能是第三代亞馬遜Trainium芯片的三倍;FP8性能則超越谷歌第七代TPU。微軟已向開發者、學術界和前沿AI實驗室開放Maia 200軟件開發工具包的預覽版,并計劃未來向更多客戶開放該芯片的云服務租用。

Maia 200被設計為專門的推理加速器,重點優化AI生成內容(如回答用戶提問)這類持續計算任務,旨在降低運行ChatGPT、Copilot等服務的調用成本。它可服務于包括OpenAI最新GPT - 5.2模型在內的多種AI模型,為Microsoft Foundry和Microsoft 365 Copilot帶來成本優勢。

在可持續性方面,微軟執行副總裁斯科特·蓋茨在宣傳視頻中強調,Maia 200采用更高效的水冷設計方案,可實現“零浪費”,有效減少數據中心對當地環境與水資源的壓力。

回顧微軟自研AI芯片之路,距離發布第一代人工智能芯片Maia 100已過去兩年。2023年11月,微軟在Ignite大會上發布Maia 100,采用臺積電5納米工藝,運用CoWoS - S封裝技術,擁有1050億個晶體管,略少于AMD MI300(1530億)。它主要用途是AI訓練與推理,側重于大語言模型(LLM),內存配置為64GB HBM2E,帶寬約1.6TB/s - 1.8TB/s,采用液冷散熱方式,專為高密度數據中心設計。

Maia 100并非單純追求極致算力,而是為優化微軟Azure云服務的特定場景而生,用于運行Bing、GitHub Copilot以及OpenAI的模型。微軟采用垂直集成思路,從芯片、服務器主板到機架冷卻系統協同設計。其獨特的“MX”數據類型是一大亮點,微軟引入自定義的MX數據格式,支持亞8位(Sub - 8 - bit)計算,通過軟硬件協同設計,在保持模型精度的同時,顯著提升計算密度和能效,特別適合大語言模型的推理任務。

在設計上,Maia 100有取有舍。短板在于片外內存帶寬(HBM)約為1.6TB/s,略低于英偉達H100和谷歌TPU v5,因其基于LLM熱潮前設計;長板則是擁有強大的片上網絡(NoC)和集群互聯能力,每個芯片內置RDMA以太網接口,集群間互聯帶寬高達4.8 Tbps,可通過極快網絡彌補單點顯存不足,適合大規模分布式訓練。為方便開發者使用,Maia 100支持OpenAI Triton和標準的PyTorch框架,開發者無需重寫大量代碼就能將模型遷移到Maia硬件上。

微軟此次發布Maia 200,凸顯了科技巨頭爭奪AI算力自主權的激烈競爭。在英偉達芯片供應緊張且成本高昂的背景下,微軟、亞馬遜和谷歌均加快自研芯片進程,力求為云客戶提供成本更低、集成更順暢的替代方案。微軟已表示正在設計Maia 300后續產品,未來其在AI芯片領域的發展值得期待。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

微軟

+關注

關注

4文章

6750瀏覽量

108039 -

AI芯片

+關注

關注

17文章

2151瀏覽量

36843

發布評論請先 登錄

相關推薦

熱點推薦

直擊英偉達腹地?谷歌TPU v7開放部署,催生OCS產業鏈紅利

Processing Unit, TPU)構建了一套完整的AI算力基礎設施體系。 ? 11月,谷歌宣布第七代 TPU v7(代號 Ironwood)將在后續幾周大規模上市。與此消息同

今日看點:微軟發布新定制 AI 芯片 Maia 200;國芯科技累計出貨2500萬顆創新高

工藝制造,目前已開始部署于微軟數據中心。 ? Maia 200 在特定性能指標上顯著優于同類產品:其 FP4 性能達到了

發表于 01-27 10:23

?1082次閱讀

什么是TPU?萬協通帶你看懂AI算力的“變形金剛”

”——TPU(Tensor Processing Unit)。 今天,作為國產可重構TPU芯片的先行者,萬協通將帶你剝開晦澀的技術外殼,看懂這塊決定AI未來的核心硬件,以及中國

AI芯片大單!Anthropic從博通采購100萬顆TPU v7p芯片

Anthropic供應基于TPU v7p的機架級 AI 系統,繞過TPU芯片的另一開發參與方谷歌。不過

HBM3E反常漲價20%,AI算力競賽重塑存儲芯片市場格局

明年HBM3E價格,漲幅接近20%。 ? 此次漲價背后,是AI算力需求爆發與供應鏈瓶頸的共同作用。隨著英偉達H200、谷歌TPU、 亞馬遜

亞馬遜發布新一代AI芯片Trainium3,性能提升4倍

Trainium 4的開發計劃。亞馬遜表示,這款芯片能夠比英偉達市場領先的圖形處理單元(GPU)更便宜、更高效地驅動AI模型背后的密集計算。 ? ? 作為

谷歌云發布最強自研TPU,性能比前代提升4倍

電子發燒友網報道(文/李彎彎)近日,谷歌云在官方博客上正式宣布,公司成功推出第七代TPU(張量處理器)“Ironwood”,該芯片預計在未來幾周內正式上市。 ? “Ironwood”由谷歌

18A工藝大單!英特爾將代工微軟AI芯片Maia 2

電子發燒友網綜合報道 據科技媒體SemiAccurate報道,微軟已正式向英特爾晶圓代工(Intel Foundry)下達訂單,委托其使用先進的18A工藝節點生產下一代AI加速器Maia 2

微軟Visual Studio 2026 發布!AI 深度融合、性能提升

“ ?微軟發布 Visual Studio 2026 預覽版,新版本以深度融合的 AI Copilot 為核心,結合全新的 Fluent Design 界面與顯著的性能提升,旨在打造前

新思科技攜手微軟借助AI技術加速芯片設計

近日,微軟Build大會在西雅圖盛大開幕,聚焦AI在加速各行業(包括芯片設計行業)科學突破方面的變革潛力。作為Microsoft Discovery平臺發布的啟動合作伙伴,新思科技亮相

AlphaEvolve有望革新AI玩具芯片設計,算法進化驅動能效與成本雙突破

的完整程序生成,解決傳統依賴專家經驗的算法設計難題。 ? 而這款產品的發布,或許會對AI玩具芯片設計將產生多維度革新性幫助。例如在芯片架構上的自動化優化,AlphaEvolve已成功優

Google推出第七代TPU芯片Ironwood

在 Google Cloud Next 25 大會上,我們隆重推出第 7 代 Tensor Processing Unit (TPU) — Ironwood。這不僅是我們迄今為止性能最高、擴展性最佳的定制 AI 加速器,更是第一

谷歌第七代TPU Ironwood深度解讀:AI推理時代的硬件革命

谷歌第七代TPU Ironwood深度解讀:AI推理時代的硬件革命 Google 發布了 Ironwood,這是其第七代張量處理單元 (TPU

谷歌新一代 TPU 芯片 Ironwood:助力大規模思考與推理的 AI 模型新引擎?

電子發燒友網報道(文 / 李彎彎)日前,谷歌在 Cloud Next 大會上,隆重推出了最新一代 TPU AI 加速芯片 ——Ironwood。據悉,該

微軟發布AI芯片Maia 200,性能超越谷歌TPU和亞馬遜Trainium

微軟發布AI芯片Maia 200,性能超越谷歌TPU和亞馬遜Trainium

評論