今天,谷歌宣布推出一個(gè)新的基于Tensorflow的強(qiáng)化學(xué)習(xí)框架,稱為Dopamine,旨在為強(qiáng)化學(xué)習(xí)研究人員提供靈活性、穩(wěn)定性和可重復(fù)性。這個(gè)強(qiáng)大的新框架或?qū)⑼苿?dòng)強(qiáng)化學(xué)習(xí)研究取得根本性的新突破。

最近OpenAI在Dota 2上的表現(xiàn),讓強(qiáng)化學(xué)習(xí)又大大地火了一把,但是OpenAI的強(qiáng)化學(xué)習(xí)訓(xùn)練環(huán)境OpenAI Gym卻一直遭到不少抱怨,比如不太穩(wěn)定、更新沒有及時(shí)……

今天,谷歌宣布開源基于TensorFlow的強(qiáng)化學(xué)習(xí)框架——Dopamine,代碼現(xiàn)在就能在Github查看。

谷歌研究人員表示,他們開源的這個(gè)TensorFlow強(qiáng)化學(xué)習(xí)框架強(qiáng)調(diào)三點(diǎn):靈活、穩(wěn)定和可重復(fù)性(reproducibility)。

為此,配套開源的還包括一個(gè)專用于視頻游戲訓(xùn)練結(jié)果的平臺,以及四種不同的機(jī)器學(xué)習(xí)模型:DQN、C51、簡化版的Rainbow智能體和IQN(Implicit Quantile Network)。

為了實(shí)現(xiàn)可重復(fù)性,Github代碼包括Arcade Learning Environment支持的全部60個(gè)游戲的完整測試和訓(xùn)練代碼,并遵循標(biāo)準(zhǔn)化經(jīng)驗(yàn)評估結(jié)果的最佳實(shí)踐。

除了開源這個(gè)增強(qiáng)學(xué)習(xí)框架,谷歌還推出了一個(gè)網(wǎng)站,允許開發(fā)人員將多個(gè)訓(xùn)練中智能體的運(yùn)行情況快速可視化。其他還有訓(xùn)練好的模型、原始統(tǒng)計(jì)日志和TensorFlow event files,用于TensorBoard動(dòng)態(tài)圖的繪制。

Dopamine框架:靈感來自大腦的多巴胺受體

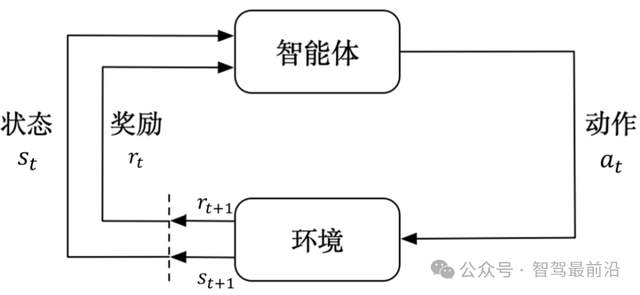

強(qiáng)化學(xué)習(xí)(RL)研究在過去幾年取得了許多重大進(jìn)展。強(qiáng)化學(xué)習(xí)的進(jìn)步使得AI智能體能夠在一些游戲上超過人類,值得關(guān)注的例子包括DeepMind攻破Atari游戲的DQN,在圍棋中獲得矚目的AlphaGo和AlphaGo Zero,以及在Dota2對戰(zhàn)人類職業(yè)玩家的Open AI Five。

具體來說,在DQN中引入重放記憶(replay memories)可以利用先前agent的經(jīng)驗(yàn),大規(guī)模的分布式訓(xùn)練可以在多個(gè)workers之間分配學(xué)習(xí)過程,分布式的方法允許agent建模完整的分布,而不僅僅是建模它們的期望值,從而能夠?qū)W習(xí)更完整的世界。

這類進(jìn)展非常重要,因?yàn)楫a(chǎn)生這些進(jìn)展的算法也適用于其他領(lǐng)域,例如機(jī)器人技術(shù)。

通常,實(shí)現(xiàn)這類進(jìn)展需要快速的迭代設(shè)計(jì)——通常沒有明確的方向——并破壞既定方法的結(jié)構(gòu)。然而,大多數(shù)現(xiàn)有的RL框架不能同時(shí)提供靈活性和穩(wěn)定性,研究人員難以有效地迭代RL方法,進(jìn)而探索新的研究方向,雖然這些新研究方向可能不會(huì)立即帶來明顯的好處。此外,從現(xiàn)有框架中復(fù)制結(jié)果常常太耗時(shí),這可能導(dǎo)致后續(xù)的科學(xué)再現(xiàn)性問題。

今天,谷歌宣布推出一個(gè)新的基于Tensorflow的框架,稱為Dopamine,旨在為RL研究人員提供靈活性、穩(wěn)定性和可重復(fù)性。

這個(gè)平臺的靈感來自于大腦中獎(jiǎng)勵(lì)動(dòng)機(jī)行為的主要組成部分之一(多巴胺受體,dopamine receptor),這反映了神經(jīng)科學(xué)和強(qiáng)化學(xué)習(xí)研究之間強(qiáng)大的歷史聯(lián)系,它的目的是使這種推測性的研究能夠推動(dòng)根本性的發(fā)現(xiàn)。開源框架還包含一組colabs,說明如何使用這個(gè)框架。

易用性

清晰和簡潔是這個(gè)框架設(shè)計(jì)中的兩個(gè)關(guān)鍵考慮因素。谷歌提供了緊湊的代碼(大約15個(gè)Python files),并且有詳細(xì)的文檔記錄。這是通過專注于Arcade Learning環(huán)境(一個(gè)成熟的、易于理解的baseline)和4個(gè)value-based的agent來實(shí)現(xiàn)的,分別是:DQN, C51,Rainbow agent的一個(gè)簡化版本,以及Implicit Quantile Network agent,這是上個(gè)月剛在ICML大會(huì)上發(fā)表的。這種簡單性能幫助研究人員更容易理解agent的內(nèi)部工作原理,并快速嘗試新的想法。

可重復(fù)性

谷歌尤其重視強(qiáng)化學(xué)習(xí)研究的可重復(fù)性(reproducibility)。他們?yōu)榇a提供了完整的測試覆蓋率;這些測試還可以作為文檔的附加形式。此外,他們的實(shí)驗(yàn)框架遵循Machado et al. (2018)給出的建議,使用街機(jī)學(xué)習(xí)環(huán)境(Arcade Learning Environment)進(jìn)行標(biāo)準(zhǔn)化經(jīng)驗(yàn)評估。

基準(zhǔn)測試

對于新的研究人員來說,能夠快速地將他們的想法與已有的方法進(jìn)行對比是很重要的。因此,我們在Arcade Learning Environment支持的60款游戲中提供了4個(gè)agent的完整訓(xùn)練數(shù)據(jù),這些數(shù)據(jù)可以作為Python pickle文件(用于通過我們的框架訓(xùn)練的agent)和JSON數(shù)據(jù)文件(用于與在其他框架中訓(xùn)練的agent進(jìn)行比較);此外,谷歌還開放了一個(gè)網(wǎng)站,在上面可以快速地查看所有60款游戲提供的agent的可視化訓(xùn)練運(yùn)行。

下圖是4個(gè)agent在Seaquest上的訓(xùn)練,這是Arcade Learning Environment支持的Atari 2600游戲之一。

在Seaquest上,4個(gè)agent進(jìn)行了訓(xùn)練。x軸表示迭代,其中每次迭代是100萬幀(4.5小時(shí)的實(shí)時(shí)游戲); y軸表示每場游戲獲得的平均分?jǐn)?shù)。陰影區(qū)域顯示了5次獨(dú)立運(yùn)行的置信區(qū)間。

谷歌還提供了來自這些agent的訓(xùn)練好的深度網(wǎng)絡(luò)、原始統(tǒng)計(jì)日志以及用于使用Tensorboard繪圖的Tensorflow事件文件。這些都可以在官網(wǎng)下載。

開源獲取地址:

https://github.com/google/dopamine

其他主要強(qiáng)化學(xué)習(xí)框架

OpenAI Gym

2016 年 4 月 28 日,OpenAI 對外發(fā)布了強(qiáng)化學(xué)習(xí)開發(fā)平臺 OpenAI Gym。Gym 平臺的基本理念是,研究者建立自己的算法后,可以把該算法置于不同的環(huán)境中進(jìn)行測試,然后把測試后的基本算法發(fā)布在 Gym 的平臺上,讓社區(qū)中的其他人看到。該平臺現(xiàn)在已經(jīng)與一些開放資源人工智能工具,例如谷歌的 TensorFlow 展開合作。

在OpenAI Gym上訓(xùn)練強(qiáng)化學(xué)習(xí)agent

OpenAI Gym 是一款用于研發(fā)和比較強(qiáng)化學(xué)習(xí)算法的工具包,它支持訓(xùn)練智能體(agent)做任何事——從行走到玩Pong或圍棋之類的游戲,都在范圍中。

OpenAI Universe

2016 年 12 月,OpenAI發(fā)布 OpenAI Universe。 根據(jù)其官方博客的介紹,這是一個(gè)能在幾乎所有環(huán)境中衡量和訓(xùn)練 AI 通用智能水平的開源平臺,當(dāng)下的目標(biāo)是讓 AI 智能體能像人一樣使用計(jì)算機(jī)。目前,Universe 已經(jīng)有 1000 種訓(xùn)練環(huán)境,由微軟、英偉達(dá)等公司參與建設(shè)。

Universe AI訓(xùn)練平臺

Universe 通過一個(gè)通用的接口適用于各種場景:智能體通過捕捉屏幕的像素生成對鍵盤和鼠標(biāo)的命令來操作遠(yuǎn)程桌面。場景需要 VNC 服務(wù)器,universe 庫將智能體轉(zhuǎn)換為 VNC 客戶端。

OpenAI Gym Retro

這是OpenAI開源的用于游戲研究的完整版強(qiáng)化學(xué)習(xí)平臺 Gym Retro,支持的游戲從大約 70 多個(gè)Atari游戲和 30 多個(gè)世嘉游戲擴(kuò)展到各種仿真器支持的 1000 多個(gè)游戲。

Gym Retro支持1000多個(gè)游戲

Gym Retro 用于研究強(qiáng)化學(xué)習(xí)算法及其泛化。RL 之前的研究主要集中在優(yōu)化 Agent 解決單個(gè)任務(wù)上。通過 Gym Retro,我們可以研究內(nèi)部概念相似但外觀表現(xiàn)不同的游戲之間泛化的能力。

DeepMind Lab

就在OpenAI 剛剛宣布開源 Universe平臺后,DeepMind 也宣布將其 AI 核心平臺 DeepMind Lab 開源。該平臺將幾個(gè)不同的 AI 研究領(lǐng)域整合至一個(gè)環(huán)境下,方便研究人員測試 AI 智能體的導(dǎo)航、記憶和 3D 成像等能力。

DeepMind Lab

DeepMind Lab 是一個(gè)專為基于智能體的 AI 研究設(shè)計(jì)的,完全像 3D 游戲般的平臺。它從自己的視角,通過模擬智能體的眼睛進(jìn)行觀察。場景呈現(xiàn)的視覺效果是科幻風(fēng)格。可用的操作能讓智能體環(huán)顧四周,并且以 3D 的形式移動(dòng)。示例任務(wù)包括收集水果、走迷宮、穿越危險(xiǎn)的通道且要避免從懸崖上墜落、使用發(fā)射臺在平臺間穿越、玩激光筆、以及快速學(xué)習(xí)并記住隨機(jī)生成的環(huán)境。

阿里Gym StarCraft

阿里去年開源了針對星際AI的研究平臺Gym StarCraft。在 Gym StarCraft 中,AI 和強(qiáng)化學(xué)習(xí)研究者可以非常方便地使用 Python 語言來進(jìn)行深度強(qiáng)化學(xué)習(xí)智能 Agent 的開發(fā),它底層完成了對 TorchCraft 和 OpenAI Gym 的封裝,支持基于 TensorFlow 和 Keras 等主流算法框架進(jìn)行開發(fā),僅需幾十行代碼即可完成一個(gè)基本的智能 Agent 的開發(fā)。

同時(shí),為了便于評測智能 Agent 的有效性,Gym StarCraft 被集成在了 OpenAI Gym 這一主流的強(qiáng)化學(xué)習(xí) AI 評測平臺中,支持世界各地的星際 AI 研究者基于它去進(jìn)行公平、快捷的效果評估。

-

谷歌

+關(guān)注

關(guān)注

27文章

6254瀏覽量

111366 -

強(qiáng)化學(xué)習(xí)

+關(guān)注

關(guān)注

4文章

270瀏覽量

11967

原文標(biāo)題:谷歌用“多巴胺”懟上OpenAI,開源TensorFlow強(qiáng)化學(xué)習(xí)框架

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

自動(dòng)駕駛中常提的離線強(qiáng)化學(xué)習(xí)是什么?

強(qiáng)化學(xué)習(xí)會(huì)讓自動(dòng)駕駛模型學(xué)習(xí)更快嗎?

多智能體強(qiáng)化學(xué)習(xí)(MARL)核心概念與算法概覽

上汽別克至境E7首發(fā)搭載Momenta R6強(qiáng)化學(xué)習(xí)大模型

如何在TensorFlow Lite Micro中添加自定義操作符(1)

NVIDIA 推出 Nemotron 3 系列開放模型

中國研究發(fā)布新型混合微電網(wǎng)系統(tǒng)

谷歌云發(fā)布最強(qiáng)自研TPU,性能比前代提升4倍

今日看點(diǎn):智元推出真機(jī)強(qiáng)化學(xué)習(xí);美國軟件公司SAS退出中國市場

自動(dòng)駕駛中常提的“強(qiáng)化學(xué)習(xí)”是個(gè)啥?

NVIDIA Isaac Lab可用環(huán)境與強(qiáng)化學(xué)習(xí)腳本使用指南

18個(gè)常用的強(qiáng)化學(xué)習(xí)算法整理:從基礎(chǔ)方法到高級模型的理論技術(shù)與代碼實(shí)現(xiàn)

Princetel 推出新的手動(dòng)電纜卷筒在線配置器

用樹莓派搞深度學(xué)習(xí)?TensorFlow啟動(dòng)!

谷歌推出新的基于Tensorflow的強(qiáng)化學(xué)習(xí)框架,稱為Dopamine

谷歌推出新的基于Tensorflow的強(qiáng)化學(xué)習(xí)框架,稱為Dopamine

評論