[首發于智駕最前沿微信公眾號]在談及自動駕駛大模型訓練時,有的技術方案會采用模仿學習,而有些會采用強化學習。同樣作為大模型的訓練方式,強化學習有何不同?又有什么特點呢?

什么是強化學習?

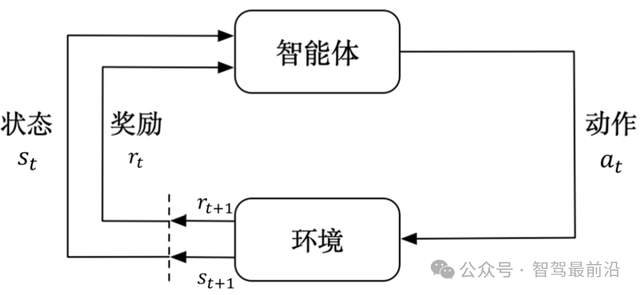

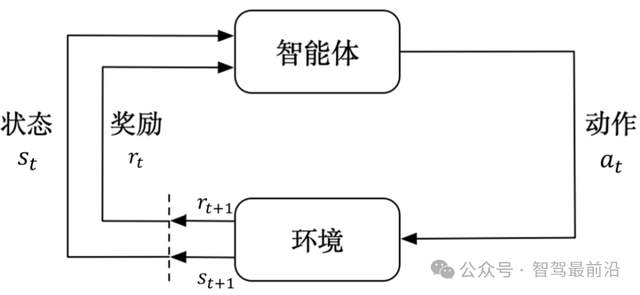

強化學習是一種讓機器通過“試錯”學會決策的辦法。與監督學習不同,監督學習是有人提供示范答案,讓模型去模仿;而強化學習不會把每一步的“正確答案”都告訴你,而是把環境、動作和結果連起來,讓機器自己探索哪個行為長期看起來更有利,便往那個行為中去靠。

強化學習示意圖,圖片源自:網絡

這里的“有利”是通過一個叫做獎勵(reward)的信號來衡量的。獎勵可以是正向的,也可以是負向的,機器的目標是讓長期累計的獎勵盡可能多。把決策過程抽象成在某個狀態下采取某個動作會進入到下一個狀態并獲得相應的獎勵的機制,這種數學化的描述叫做馬爾可夫決策過程。

從定義上看,這個概念有些晦澀難懂,舉個簡單的例子吧。自動駕駛系統在駕駛仿真里開車,順利通過一個路口就可以得到獎勵,但撞到路緣或急剎車將被罰分,這些獎勵和懲罰會引導學習算法偏向于那些帶來更多正向回報的駕駛行為。強化學習把這樣一整套“感知—決策—反饋—調整”的循環自動化,讓模型在沒有人逐條教它規則的情況下也能學出一套安全的駕駛策略。

為什么強化學習會被用到自動駕駛中

自動駕駛汽車會通過各種傳感器識別路況,但它不是簡單識別攝像頭拍攝的圖片或激光雷達探測到的點云這么簡單,它會不斷與環境進行交互。自動駕駛汽車需要在復雜且動態的交通環境里做出連續決策,這些決策不僅影響當前瞬間的安全,也會改變未來的交通態勢。

圖片源自:網絡

強化學習剛好擅長解決這種“序列決策”的問題。相比傳統方案中把每種場景寫成規則的方式,強化學習能夠把環境狀態(來自攝像頭、雷達、激光雷達以及速度、加速度等車載信息)映射成動作(轉向、加速、減速等),并通過長期回報來優化策略。

這種端到端或者半端到端的學習方式讓模型在面對復雜交互、非線性場景時比規則系統更具適應性。很多技術方案中會把強化學習與深度學習結合起來,處理高維輸入,然后再輸出決策。

在安全可控的仿真環境里,強化學習還可以以極大的樣本量去嘗試各種邊緣情況,積累經驗,之后再把模型遷移或微調到真實車輛上,這將極大優化模型的訓練效果。

簡而言之,當問題表現為“連續決策、長期回報、即時反饋”時,強化學習提供了一條比規則更有彈性的途徑。

強化學習如何應用到自動駕駛中

將自動駕駛系統拆分開看,其實是一條連續的系統,其最前端是感知,中間是決策規劃,末端是執行控制。強化學習可以在多個環節發揮作用,但更多是用在決策與控制之間。

感知模塊負責把攝像頭、雷達、激光雷達這些原始數據處理成如周圍車輛的位置和速度、車道線、交通標志等對路況有用的表征信息。決策模塊要基于這些信息決定接下來幾秒鐘內的動作。

圖片源自:網絡

強化學習的優勢在于,它可以把決策看作是一個優化問題,其不只是考慮當前動作的即時好壞,更會衡量動作序列在未來帶來的累計效果。因此在跟車、換道、避障和復雜交叉口應對這類需要考慮連貫動作與長期影響的任務上,強化學習能學出比單步規則更流暢、可預測的行為。

在很多的技術方案中,強化學習不僅可以單獨作為一個端到端控制器,從傳感器輸入直接學習輸出控制命令,也可以作為決策層的一個組件,與傳統規劃器或約束優化器協同工作。前者在學出來后更簡潔,但可解釋性和可驗證性較差;后者能把強化學習產生的策略納入現有安全約束下進行檢查和修正,從而兼顧靈活性和安全性。

現階段很多常見的做法是先用模擬器做大量訓練,得到一個初步策略,再用監督學習的方法做預訓練,把人類駕駛數據用作引導,最后在仿真里用強化學習精調。這樣的復合流程能顯著提升模型訓練效率并降低在真實世界試錯的風險。

強化學習有什么問題?

強化學習的概念看起來的確不錯,可以讓大模型自己學習,并研究出一套可行的駕駛策略。但想把它安全可靠地部署到車輛上,并不是一朝一夕的事情。其最大的問題就是安全與魯棒性。

仿真和真實世界一定會存在差距,這個差距會讓在仿真中表現良好的策略在實車上出現意外行為。環境變化、傳感器噪聲、極端天氣、未見過的交通流模式等都會考驗模型的泛化能力。深度強化學習一般還是黑盒式的,難以解釋模型為什么在某個時刻做出某個決定,這給責任歸屬、事故分析和安全驗證帶來了極大挑戰。

強化學習的訓練成本也是很現實的問題,強化學習需要大量多樣的樣本來覆蓋邊緣情況,光靠真實道路采集不僅危險還很慢,因此很多訓練必須在高質量的仿真中完成,而高保真模擬本身就需要很高的成本投入且需不斷精細化,這無疑提高了成本。

強化學習還會面臨在線學習和離線學習之間的取舍。完全在線學習在真實道路上意味著系統會在行駛過程中不斷試錯,這必然會帶來很多的風險。而長期離線訓練則可能讓模型落后于環境變化,為此,就就需要周期性地遷移學習或進行持續集成。

最后的話

強化學習的核心價值在于為序列決策問題提供系統化的解決框架,尤其在處理長期目標、復雜交互與高維感知方面展現出很強的潛力。但想將其從算法潛力變成可靠應用的轉化,始終面臨可驗證性、安全約束與工程落地的核心挑戰。當前可以將強化學習視為一種強大的優化與決策組件,在明確邊界內與傳統方法進行架構性整合。

審核編輯 黃宇

-

自動駕駛

+關注

關注

793文章

14879瀏覽量

179773

發布評論請先 登錄

自動駕駛端到端為什么會出現黑盒現象?

如何構建適合自動駕駛的世界模型?

Transformer如何讓自動駕駛大模型獲得思考能力?

多智能體強化學習(MARL)核心概念與算法概覽

上汽別克至境E7首發搭載Momenta R6強化學習大模型

如何訓練好自動駕駛端到端模型?

自動駕駛中常提的“強化學習”是個啥?

自動駕駛中Transformer大模型會取代深度學習嗎?

自動駕駛中常提的世界模型是個啥?

新能源車軟件單元測試深度解析:自動駕駛系統視角

18個常用的強化學習算法整理:從基礎方法到高級模型的理論技術與代碼實現

強化學習會讓自動駕駛模型學習更快嗎?

強化學習會讓自動駕駛模型學習更快嗎?

評論