生成式AI掀起的技術革命正在重塑全球產業格局。近期,在國產大模型DeepSeek R1發布后,因其開放性、更低訓練成本等優勢迅速點燃了一場聚焦中國AI的全新熱潮。在AI大模型爆火背后,由AI模組賦能的AI終端側變革和產業升級成為行業焦點。從智能工廠的質檢機器人到社區巡邏的安防無人機,從家庭陪伴機器人到智能座艙的語音交互系統,AI能力的終端化部署正在打開千億級市場空間。

在這場端側智能化的浪潮中,通信模組作為連接物理世界與數字世界的核心紐帶,在AI終端的智能化進程中發揮著至關重要的作用。芯訊通深耕物聯網通信模組領域23年,在AIoT行業有著深厚的技術積淀,不斷拓展著端側AI的邊界。

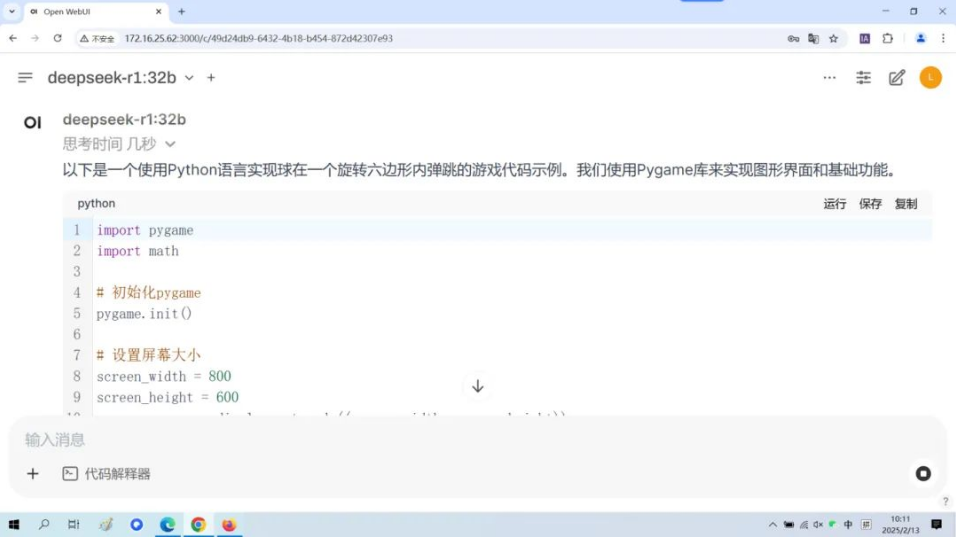

目前,芯訊通高算力AI模組SIM9650L已實測跑通DeepSeek R1模型,能夠高效地幫助客戶終端搭建深度學習體系。

助力端側AI繁榮發展

隨著5G商用,AI大模型的爆火和人工智能技術的高速演進與迭代,使得端側AI蓬勃發展,引領著各產業智能應用的變革,也將重塑智能終端應用生態。相較于云端AI,端側AI能夠顯著降低延遲,實現毫秒級的響應速度,同時保護用戶隱私,減少數據傳輸風險。

此外,搭載高算力AI模組的端側AI還能減輕云端服務器的計算負擔,降低對中心化計算資源的依賴,從而降低成本。隨著算法技術的不斷進步,包括模型量化、剪枝、蒸餾等模型壓縮算法的發展,以及專為端側部署設計的軟硬件平臺的出現,AI大模型在端側設備的部署變得更加高效便捷。

作為全球知名物聯網模組產品及解決方案提供商,芯訊通擁有包括5G、4G、AI、LPWA、GNSS、NTN、V2X等不同領域的豐富產品線。所打造的AI模組產品覆蓋多階梯算力能力,應用功能接口豐富,支持多制式網絡連接和全球不同地區頻段,包括SIM9650L、SIM8965、SIM8973、SIM8970、SIM8950LH、SIM8960、SIM8905、SIM8906、SIM8502、SIM8918、SIM6600等系列模組。

針對不同客戶對算力、功耗、尺寸、成本的要求,均有不同的產品解決方案。這些AI模組產品能夠適應不同應用場景的需求,已在智慧生活、智能制造、智能汽車、智慧城市、智慧農業、智慧醫療、智慧園區、低空經濟等多領域助力AI終端規模化應用。

在AI技術日新月異的今天,為AI終端的智能化升級提供高效且創新的解決方案成為了行業發展的關鍵。目前,芯訊通正在開展相關技術研究接入豆包等其他大模型,積極探索更多深度應用。AI大模型爆火背后,是產業智能化對價值創造的本質需求,芯訊通將以通信模組為支點,通過“模組+算法+場景”的深度融合,讓端側AI真正落地。

芯訊通SIMCom

芯訊通無線科技(上海)有限公司自2002年成立以來,作為模組行業的領導者,一直致力于提供5G,LTE-A,C-V2X,eMTC(CAT-M1),NB-IoT,FDD/TDD-LTE,WCDMA/HSPA/HSPA+,CDMA1xRTT/EV-DO,GSM/GPRS/EDGE無線蜂窩通信以及GNSS衛星定位等多種技術平臺的模塊及解決方案。

芯訊通堅持提供高品質的模組產品和行業解決方案,以22年專業的技術創新和服務能力,不斷滿足物聯網各行各業客戶的需求。我們的產品和服務已覆蓋全球超過180個國家,超過1萬家客戶。在深耕垂直行業的同時,不斷定義優勢產品,構建核心競爭力,我們的產品廣泛應用于智慧城市,無線支付、車載運輸、智慧能源、智慧工業、醫療健康和農業環境等領域。

-

AI

+關注

關注

91文章

39755瀏覽量

301354 -

芯訊通

+關注

關注

3文章

209瀏覽量

14898 -

DeepSeek

+關注

關注

2文章

835瀏覽量

3255

原文標題:芯訊通高算力AI模組SIM9650L實測跑通DeepSeek R1模型

文章出處:【微信號:芯訊通SIMCom,微信公眾號:芯訊通SIMCom】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

日海智能子公司芯訊通正式發布新款AI算力模組SIM9650W

廣和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

如何在NVIDIA Blackwell GPU上優化DeepSeek R1吞吐量

速看!EASY-EAI教你離線部署Deepseek R1大模型

DeepSeek開源新版R1 媲美OpenAI o3

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek R1模型本地部署與產品接入實操

SL1680 SoC本地運行DeepSeek R1 1.5B大模型

如何基于Android 14在i.MX95 EVK上運行Deepseek-R1-1.5B和性能

【幸狐Omni3576邊緣計算套件試用體驗】DeepSeek 部署及測試

顯存也能疊疊樂,雙 Intel Arc A770 顯卡低成本部署 DeepSeek R1 32B 蒸餾模型體驗

如何使用OpenVINO運行DeepSeek-R1蒸餾模型

芯訊通SIM9650L成功運行DeepSeek R1模型

芯訊通SIM9650L成功運行DeepSeek R1模型

評論