廣和通要聞

近日,廣和通在MediaTek MT8893平臺上成功部署并運行了DeepSeek-R1-0528-Qwen3-8B模型,顯著提升了端側AI設備的處理效率與智能化水平,特別是在本地化復雜文本處理的智能會議場景中表現出色。本次部署采用動態控制思維鏈輸出的創新方式,通過實現思維鏈思考過程與輸出結果解耦的技術路徑,在確保模型快速輸出結果的同時,使模型仍能進行深度邏輯推理。

依托MT8893的4nm工藝與第七代APU能效優化,以及Qwen3-8B蒸餾模型的輕量化優勢,本方案在提升推理能力的同時有效降低了功耗,使終端具備低能耗、低發熱與長時間穩定運行的特性,提供了更加可靠與高效的使用體驗。

聯發科技的MT8893芯片是專為邊緣AI計算設計的高性能平臺,擁有八大核的CPU運算能力、高效的能耗控制以及對AI工作負載的專門優化,廣泛適用于需要實時處理的端側AI場景。MT8893集成48 TOPS的NPU,能夠高效執行復雜的神經網絡模型,為像DeepSeek-R1-0528-Qwen3-8B這樣的大模型提供充足的算力支持。在廣和通的優化下,MT8893平臺確保DeepSeek-R1-0528-Qwen3-8B模型在智能會議機等設備上流暢運行,實現低延遲、高精度、低功耗的語音轉寫和內容摘要生成。

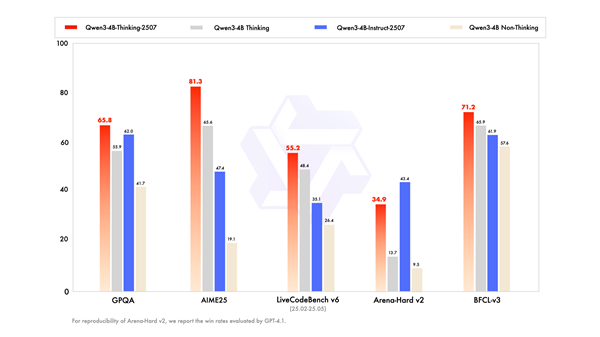

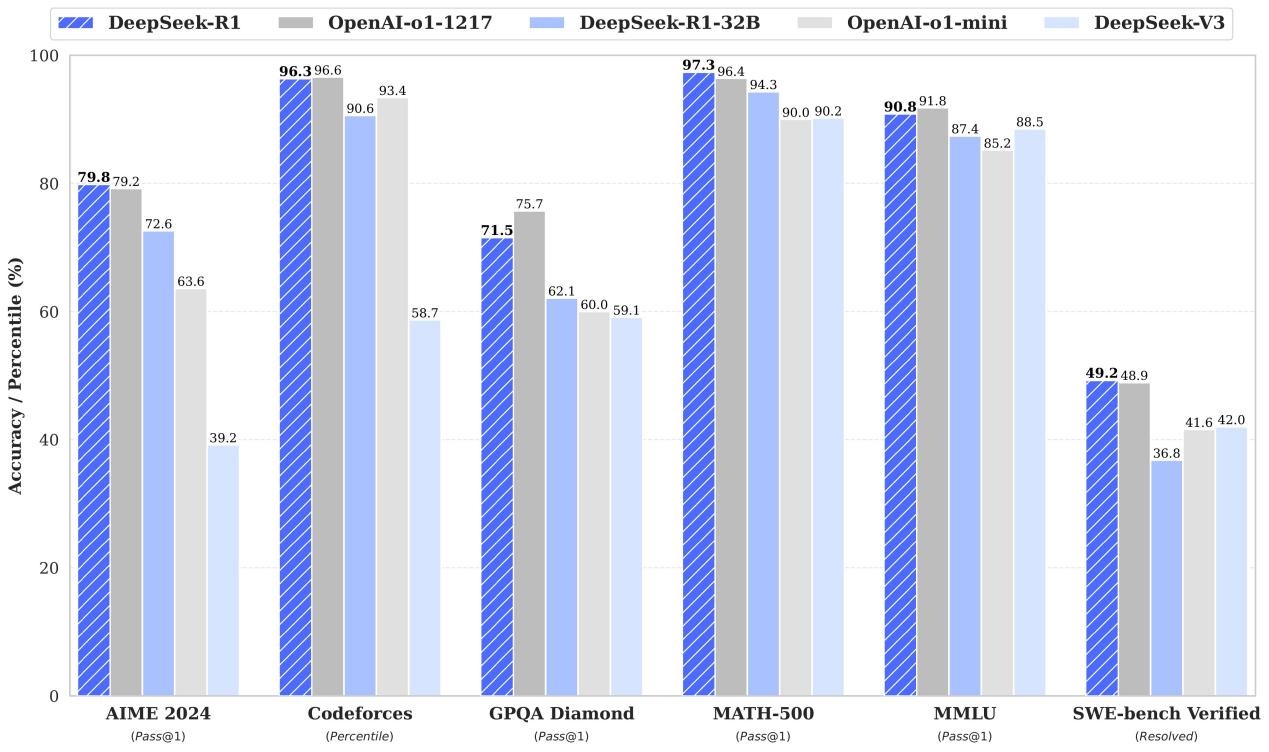

DeepSeek-R1-0528是深度求索(DeepSeek)在2025年5月28日發布的最新升級版本。該模型基于2024年12月發布的DeepSeek V3 Base模型,在后訓練過程中投入了更多算力,顯著提升了模型的思維深度與推理能力。其在數學、編程與通用邏輯等多個基準測評中取得了優異成績,整體表現接近國際頂尖模型。在此基礎上,DeepSeek 還基于 R1-0528 的思維鏈訓練推出了DeepSeek-R1-0528-Qwen3-8B蒸餾模型。該模型以Qwen3-8B Base為底座,在AIME 2024 數學測試中的準確率相比原始Qwen3-8B 提升約 10%,整體表現接近Qwen3-235B,僅次于DeepSeek-R1-0528本體,非常適合端側設備部署,為會議紀要生成、文本摘要和多語言交互等應用提供了兼顧高性能與高效率的解決方案。

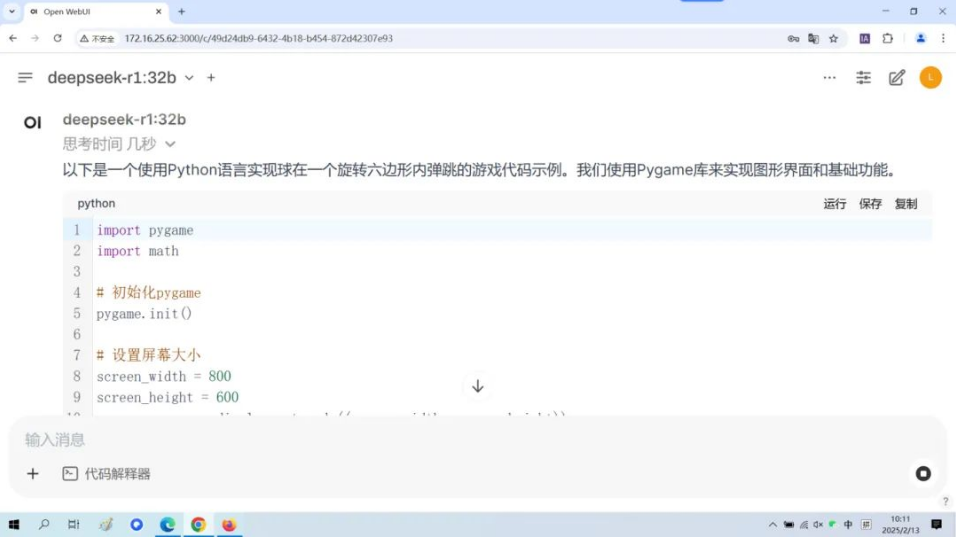

搭載了DeepSeek-R1-0528-Qwen3-8B模型的廣和通AI解決方案將為智能會議機帶來全新的體驗。DeepSeek-R1-0528模型強大的自然語言處理能力,能夠實時、準確地進行語音精準識別和轉寫,并快速生成會議紀要摘要,大大提升了會議效率。結合廣和通在AI語音解決方案方面的技術積累,其AI語音方案具備強抗噪性、離線理解力,助力會議機實現更自然的多語言語音交互,適用于跨國企業或多語種會議環境。雖然DeepSeek-R1-0528-Qwen3-8B關閉了中間思考過程的輸出以提升響應速度,但模型保留了完整的思維鏈,確保了其在處理復雜邏輯和生成高質量文本時的深度和準確性。

本次廣和通在MT8893平臺成功部署DeepSeek-R1-0528-Qwen3-8B模型,并針對智能會議機等場景優化,體現了其軟硬件一體化的全棧式解決方案能力。端側AI正加速滲透千行百業。廣和通持續攜手AI合作伙伴,推動大模型在邊緣側的高效部署,讓智能終端擁有思考能力。

廣和通始創于1999年,是中國首家上市的無線通信模組企業(股票代碼:300638)。作為全球領先的無線通信模組和AI解決方案提供商,廣和通以無線通信與人工智能為技術底座,提供軟硬件一體、賦能行業應用的全棧式解決方案,加速千行百業從“萬物互聯”到“萬物智聯”。

廣和通全棧式解決方案覆蓋AIoT模組、AI模型、智能體、全球資費和云服務,助力智能機器人、消費電子、低空經濟、智能駕駛、智慧零售、智慧能源等行業數智化升級。

-

模型

+關注

關注

1文章

3751瀏覽量

52099 -

Mediatek

+關注

關注

0文章

359瀏覽量

24950 -

廣和通

+關注

關注

4文章

855瀏覽量

14568

原文標題:廣和通成功在MediaTek MT8893上部署DeepSeek-R1-0528-Qwen3-8B模型,全面提升終端推理能力

文章出處:【微信號:Fibocom,微信公眾號:廣和通FIBOCOM】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

百度騰訊搶灘布局!DeepSeek-R1升級和開源背后,國產AI的逆襲之路

NVIDIA ACE現已支持開源Qwen3-8B小語言模型

阿里通義千問發布小尺寸模型Qwen3-4B,手機也能跑

【VisionFive 2單板計算機試用體驗】3、開源大語言模型部署

超低延時重構AI推理體驗!白山云發布“大模型API”產品

DeepSeek開源新版R1 媲美OpenAI o3

NVIDIA RTX 5880 Ada與Qwen3系列模型實測報告

壁仞科技完成阿里巴巴通義千問Qwen3全系列模型支持

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

DeepSeek R1模型本地部署與產品接入實操

廣和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

廣和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

評論