鯤云科技全新一代的可重構數據流 AI 芯片 CAISA 430 成功適配 DeepSeek R1 蒸餾模型推理,這一創新舉措為大模型應用的高效部署帶來了全新的解決方案,標志著可重構數據流 AI 技術與大模型融合發展的又一重要里程碑,也展示了鯤云科技的可重構數據流技術的技術通用性和生態友好。

全新一代可重構數據流 AI 芯片 CAISA 430

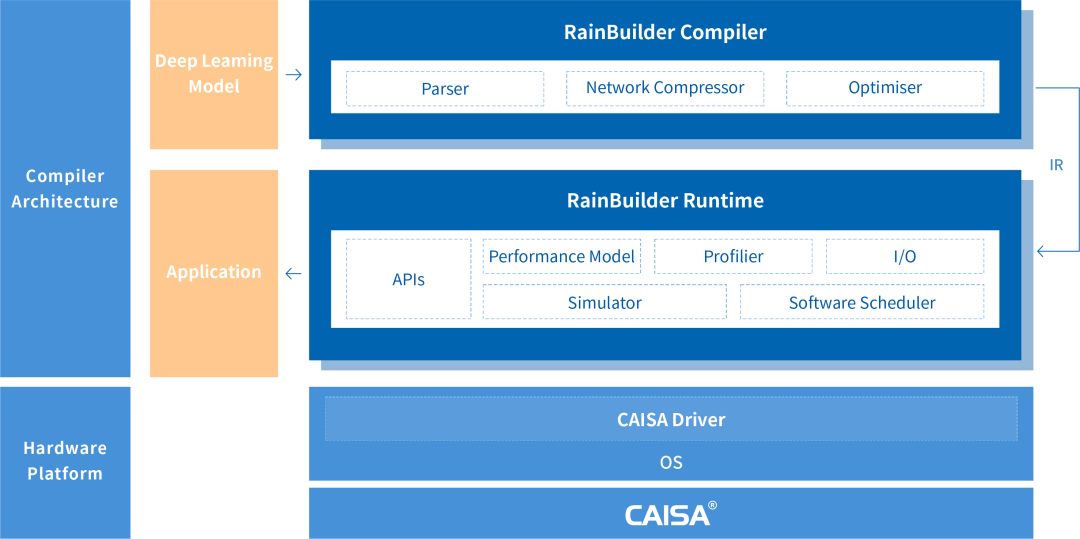

此次適配的 CAISA 430 芯片是鯤云科技基于第四代可重構數據流架構技術研發,于 2023 年底回片,并于 2024 年實現量產,相較于上一代產品,其實測性能、通用性等關鍵指標實現了跨越性提升。該芯片采用國內成熟的 12nm 制程工藝生產,端到端芯片利用率最高可達 90%,有效算力指標表現突出。此外,憑借鯤云自主研發的 RainBuilder 編譯工具鏈,CAISA 430 支持所有常用的 AI 算子和算法模型,展現出強大的通用性,可以滿足不同深度學習算法的推理需求。

▲ Rainbuilder 編譯工具鏈

鯤云科技基于 CAISA 芯片推出了一系列 AI 算力產品,包括面向邊緣端、數據中心進行深度學習推斷的 AI 專用計算加速的星空加速卡 X3、X3A、N460H,面向低算力場景的星空 X6A、N430S/P/E 邊緣小站,以及基于星空加速卡系列推出的智能計算服務器等,為計算機視覺、語音語義及大模型應用提供高性能、低延時、高算力性價比的 AI 算力支持。

高效適配,為 DeepSeek R1 推理提供底層 AI 算力支持

DeepSeek R1 作為一款先進的推理模型,基于 Transformer 架構,其參數規模龐大,對硬件的計算能力和內存容量提出了極高要求。CAISA 430 芯片憑借其高算力性價比和強大的通用性,能夠為 DeepSeek R1 推理提供有力支持。CAISA 430 的高芯片利用率確保了在處理大規模模型時能夠充分利用硬件資源,減少計算資源的浪費,從而提高推理效率。同時,CAISA 430 的可重構數據流架構能夠根據 DeepSeek R1模型的特點進行動態配置,生成面向該模型的高性能定制化流水線,進一步優化推理性能。

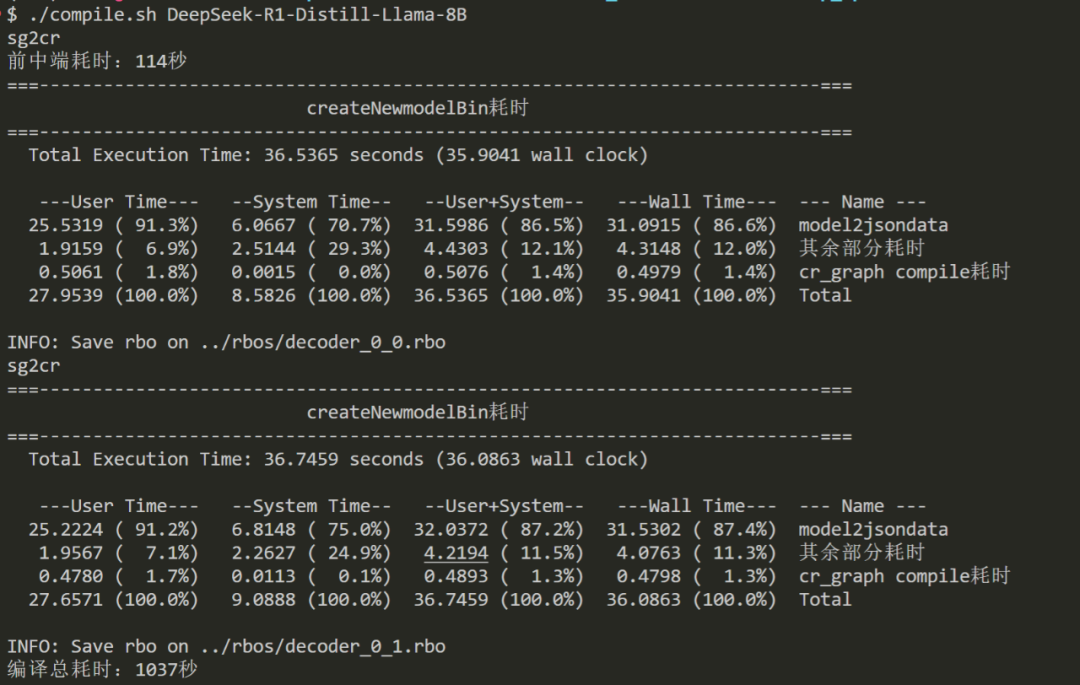

▲ DeepSeek R1 Llama 8B模型在RainBuilder上編譯過程圖示

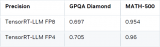

鑒于 CAISA 430 強大的通用性,原生支持 DeepSeek R1 蒸餾模型的開源基礎模型,DeepSeek R1 的QWen和 Llama 模型可直接在 CAISA 430 上運行,不需要復雜的適配工作,技術團隊主要進行了精度驗證和性能優化,適配模型包括已發布的 DeepSeek-R1-Distill-Qwen-1.5B、DeepSeek-R1-Distill-Qwen-7B、DeepSeek-R1-Distill-Qwen-14B、DeepSeek-R1-Distill-Qwen-32B、DeepSeek-R1-Distill-Llama-8B、DeepSeek-R1-Distill-Llama-70B。

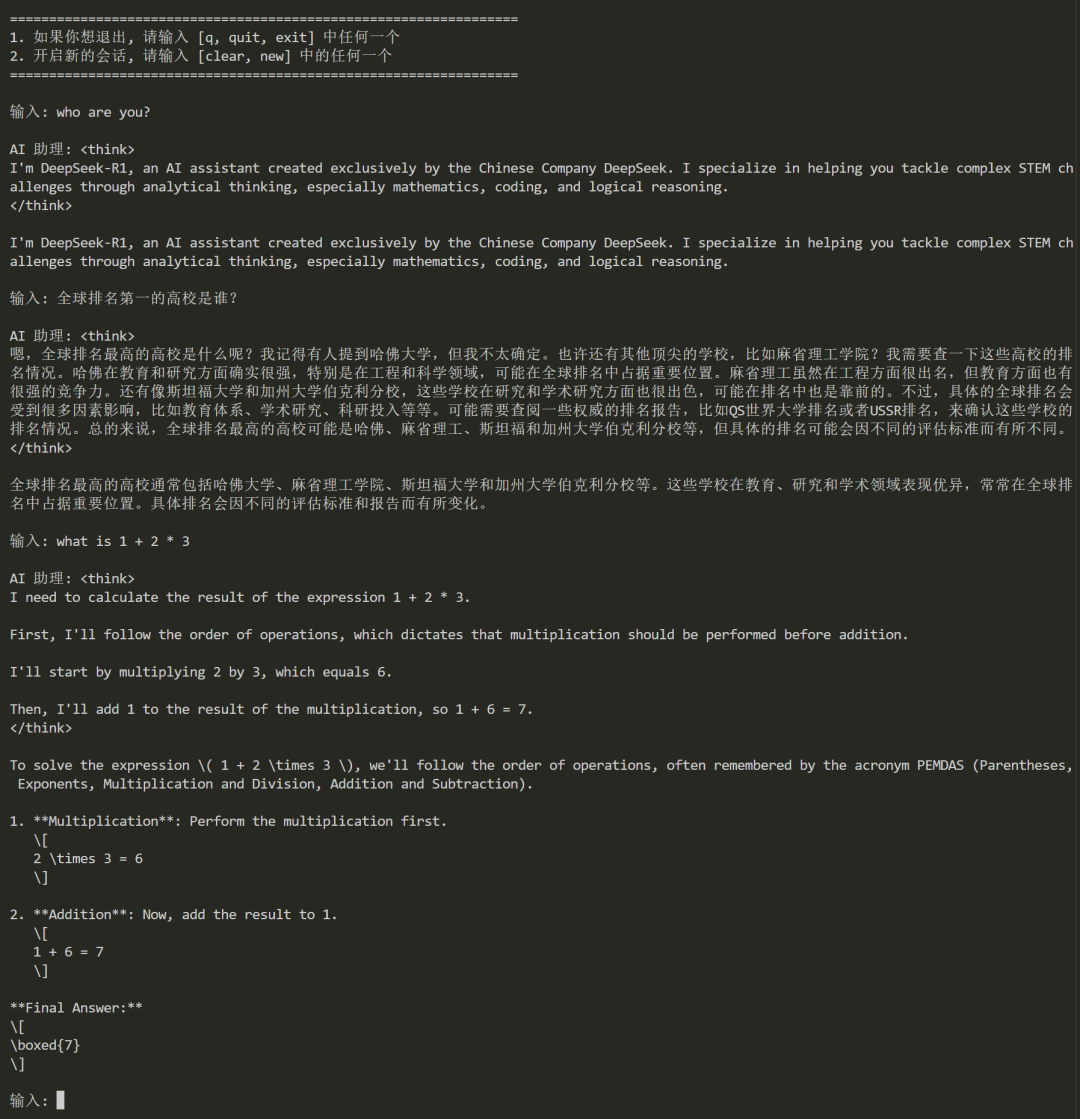

▲ DeepSeek R1 Llama 8B模型運行圖示

大模型友好:助力 AI 應用高效部署,加速人工智能落地

在大模型時代,如何高效地部署和運行這些模型成為了一個關鍵問題。CAISA 430 芯片的適配為 DeepSeek R1 推理提供了更加靈活和高效的解決方案,能夠為不同規模和需求的 AI 項目提供底層算力支持。

對高精度和強大推理能力的應用場景,CAISA 430 能夠充分發揮其高實測性能的優勢,滿足 DeepSeek R1 模型的計算需求。

對資源有限的應用場景,CAISA 430 的通用性和可重構性讓用戶可以根據實際情況對模型進行優化和調整,降低硬件資源的消耗。

基于可重構數據流架構底層優勢,適配后的CAISA430芯片算力產品的優勢主要體現在:

產品形態多樣:支持邊緣盒子、一體機、AI 服務器、算力中心服務器集群等邊緣至中心不同產品形態,適配不客戶不同場景的AI推理需求;

適配算法豐富:配套的星云 AI 開發平臺支持超過 400 種視覺模型、視覺大模型、大語言模型等算法模型,可靈活搭配按需使用,無論是復雜的視覺識別任務還是大規

模的語言處理應用,都能高效運行;

行業方案落地:配套的星空系列算力平臺,提供深入行業、滿足行業需求的 AI 解決方案,當前已落地覆蓋超過 30 個行業,幫助客戶加速落地智能化項目。

截止到目前,CAISA 系列芯片產品已服務上千客戶,落地 5000+項目,實現規模化的業務落地,充分驗證了商業可行性。

CAISA 芯片在短時間內快速完成DeepSeek R1 大模型適配,充分展示了 CAISA 系列可重構數據流架構芯片在高算力利用率的同時,可以做到對于深度學習算法的通用、便捷、快速支持,體現了 CAISA 芯片與工具鏈經過 4 代架構迭代后的深厚積累。未來,鯤云科技將沿著 CAISA 創新架構的全新技術路線,提供下一代計算平臺基座,加速千行百業人工智能產品落地。

-

AI

+關注

關注

91文章

40579瀏覽量

302225 -

鯤云科技

+關注

關注

0文章

61瀏覽量

4597 -

DeepSeek

+關注

關注

2文章

837瀏覽量

3354

原文標題:鯤云科技CAISA 430適配DeepSeek R1推理,開啟高效AI應用新時代

文章出處:【微信號:鯤云科技,微信公眾號:鯤云科技】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

廣和通成功部署DeepSeek-R1-0528-Qwen3-8B模型

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

鯤云科技AI視頻解決方案推動食品安全智慧監管

如何在NVIDIA Blackwell GPU上優化DeepSeek R1吞吐量

【「DeepSeek 核心技術揭秘」閱讀體驗】書籍介紹+第一章讀后心得

信而泰×DeepSeek:AI推理引擎驅動網絡智能診斷邁向 “自愈”時代

超低延時重構AI推理體驗!白山云發布“大模型API”產品

DeepSeek開源新版R1 媲美OpenAI o3

DeepSeek R1模型本地部署與產品接入實操

SL1680 SoC本地運行DeepSeek R1 1.5B大模型

科大訊飛深度解析DeepSeek-V3/R1推理系統成本

鯤云科技AI芯片CAISA 430成功適配DeepSeek R1模型

鯤云科技AI芯片CAISA 430成功適配DeepSeek R1模型

評論