幻方量化旗下組織深度求索發布了國內首個開源 MoE 大模型 ——DeepSeekMoE,全新架構,免費商用。

今年 4 月,幻方量化發布公告稱,公司將集中資源和力量,全力投身到服務于全人類共同利益的人工智能技術之中,成立新的獨立研究組織,探索 AGI 的本質。幻方將這個新組織命名為 “深度求索 (DeepSeek)”。

DeepSeekMoE 的模型、代碼、論文均已同步發布。

模型下載:https://huggingface.co/deepseek-ai

微調代碼:https://github.com/deepseek-ai/DeepSeek-MoE

技術報告:https://github.com/deepseek-ai/DeepSeek-MoE/blob/main/DeepSeekMoE.pdf

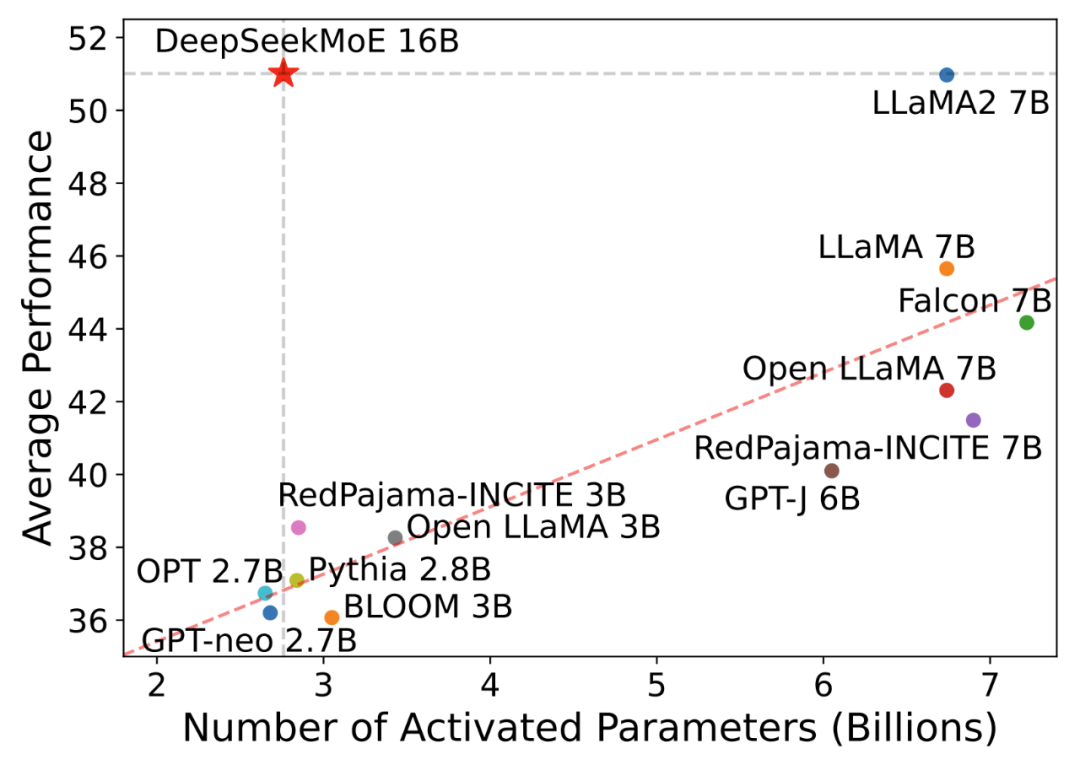

據介紹,DeepSeekMoE 的多尺度(2B->16B->145B)模型效果均領先:

DeepSeekMoE-2B 可接近 MoE 模型的理論上限2B Dense 模型性能(即相同 Attention/FFN 參數配比的 2B Dense 模型),僅用了 17.5% 計算量

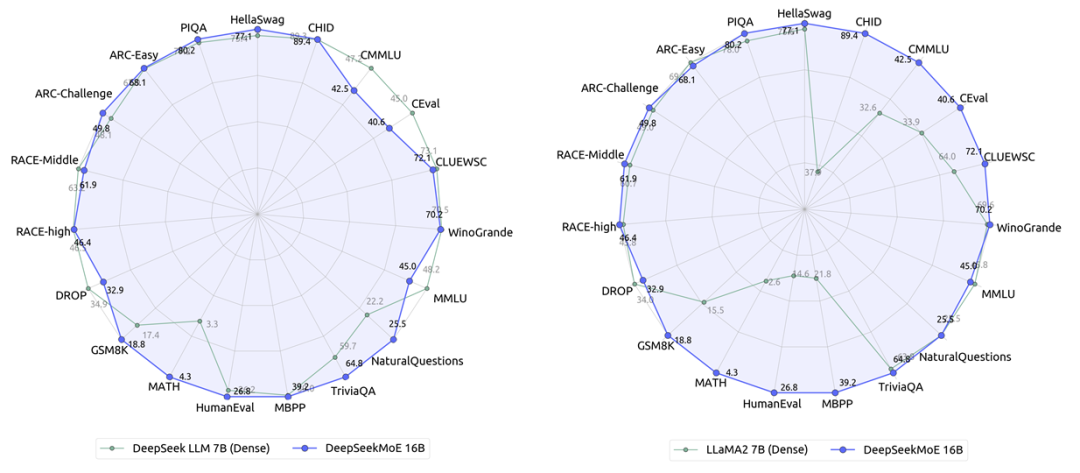

DeepSeekMoE-16B 性能比肩 LLaMA2 7B 的同時,僅用了 40% 計算量,也是本次主力開源模型,40G 顯存可單卡部署

DeepSeekMoE-145B 上的早期實驗進一步證明該 MoE 架構明顯領先于 Google 的 MoE 架構 GShard,僅用 28.5%(甚至 18.2%)計算量即可匹配 67B Dense 模型的性能

混合專家模型 (Mixed Expert Models,簡稱 MoEs)是用于提高大語言模型效率和準確度的技術。這種方法的核心是將復雜任務劃分為更小、更易管理的子任務,每個子任務由專門的小型模型或 “專家” 負責,然后根據輸入數據的特性選擇性地激活這些 “專家”。 MoE 核心組成:

專家 (Experts):訓練有素的小型神經網絡,擅長特定領域。每個專家通常專注于處理一種特定類型的數據或任務。專家的設計可以是多種形式,如完全連接的網絡、卷積網絡等。

門控機制 (Gating Mechanism):MoE 架構決策者,這是一個智能路由系統,負責決定哪些專家應該被激活來處理當前的輸入數據。門控機制基于輸入數據的特性,動態地將數據分配給不同的專家。

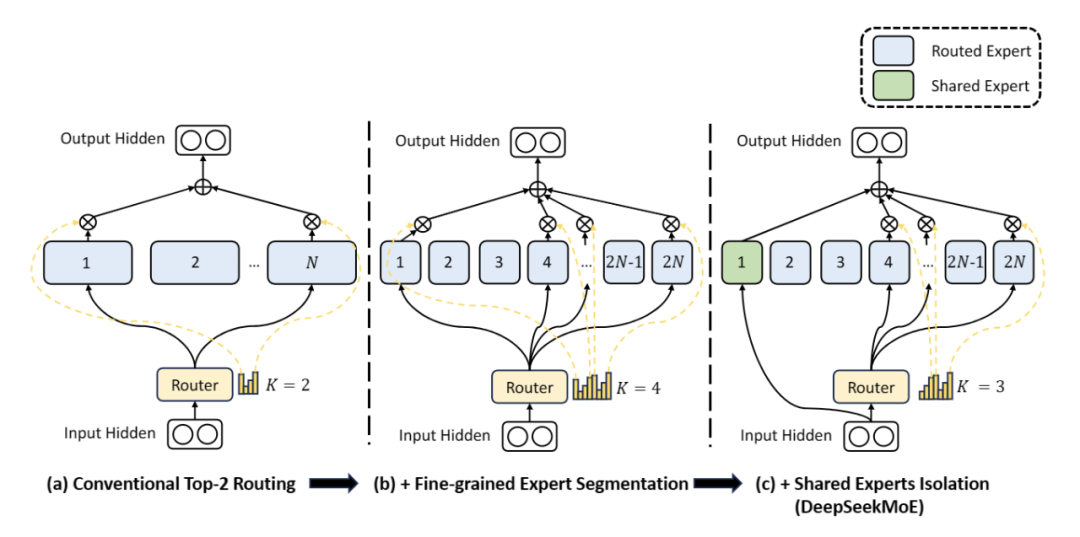

官方稱 DeepSeekMoE 是自研的全新 MoE 框架,主要包含兩大創新:

細粒度專家劃分:不同于傳統 MoE 直接從與標準 FFN 大小相同的 N 個專家里選擇激活 K 個專家(如 Mistral 7B8 采取 8 個專家選 2 專家),DeepSeekMoE把 N 個專家粒度劃分更細,在保證激活參數量不變的情況下,從 mN 個專家中選擇激活 mK 個專家(如 DeepSeekMoE 16B 采取 64 個專家選 8 個專家),如此可以更加靈活地組合多個專家

共享專家分離:DeepSeekMoE 把激活專家區分為共享專家(Shared Expert)和獨立路由專家(Routed Expert),此舉有利于將共享和通用的知識壓縮進公共參數,減少獨立路由專家參數之間的知識冗余

審核編輯:劉清

-

神經網絡

+關注

關注

42文章

4838瀏覽量

107745 -

智能路由

+關注

關注

0文章

9瀏覽量

7229 -

卷積網絡

+關注

關注

0文章

43瀏覽量

3205 -

DeepSeek

+關注

關注

2文章

835瀏覽量

3255

原文標題:幻方量化開源國內首個MoE大模型,全新架構、免費商用

文章出處:【微信號:OSC開源社區,微信公眾號:OSC開源社區】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

今日看點:小米正式發布并開源新模型 MiMo-V2-Flash;磷酸鐵鋰開啟漲價潮

中科曙光發布國內首個開放架構AI超集群系統

華為宣布開源盤古7B稠密和72B混合專家模型

華為正式開源盤古7B稠密和72B混合專家模型

上新:小米首個推理大模型開源 馬斯克:下周推出Grok 3.5

NVIDIA發布全球首個開源人形機器人基礎模型Isaac GR00T N1

首個Mamba系列模型量化方案MambaQuant解讀

幻方量化發布了國內首個開源MoE大模型—DeepSeekMoE

幻方量化發布了國內首個開源MoE大模型—DeepSeekMoE

評論