電子發燒友網綜合報道 2025年6月30日,華為正式宣布開源盤古70億參數的稠密模型、盤古Pro MoE 720億參數的混合專家模型及基于昇騰的模型推理技術,此舉標志著華為在AI技術生態建設領域邁出關鍵一步,為全球開發者、企業及研究人員提供了強大的技術支撐。

華為此次開源行動涵蓋三大核心板塊:盤古Pro MoE 72B模型權重與基礎推理代碼已率先上線開源平臺;基于昇騰的超大規模MoE模型推理代碼同步開放;盤古7B稠密模型相關代碼將于近期完成上線。開發者可通過華為開源社區(https://gitcode.com/ascend-tribe)獲取完整技術資源,參與模型優化與生態共建。

作為70億參數的緊湊型模型,盤古7B在保持高效推理能力的同時,顯著降低部署門檻。其設計聚焦行業場景的快速適配,特別適合資源受限環境下的邊緣計算應用,為中小企業提供高性價比的AI解決方案。

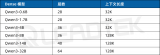

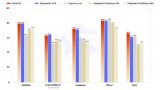

該模型采用創新性的分組混合專家架構(MoGE),通過動態激活機制實現160億參數的高效利用。在SuperCLUE評測中,其以720億總參數量達到59分,與千億級模型持平,展現出“小參數量、大能力”的技術優勢。基于昇騰AI計算平臺的優化,單卡推理吞吐量達2300 Tokens/s,較傳統架構提升4倍,支持384個專家并行推理的超級節點架構,更將算力利用率(MFU)提升50%以上。

華為通過開源構建開放創新生態,吸引全球開發者參與模型優化。目前,盤古大模型已形成覆蓋數據管理、訓練、部署的全生命周期工具鏈,支持企業定制化開發。這種“基礎開源+商業增值”模式,既降低技術使用門檻,又通過商業發行版形成可持續的盈利路徑。

在金融、制造、醫療等領域,盤古模型的動態負載均衡技術使云端推理成本降低30%,支撐高并發實時作業場景。基于MoGE架構的輕量化引擎,可適配昇騰系列芯片,使百億級模型在邊緣設備高效運行,為工業互聯網、智能座艙等場景開辟新應用空間。

作為首個由亞洲企業主導的AI大模型開源項目,華為的實踐正在改變國際技術競爭格局。通過Apache-2.0協議運營,盤古模型已吸引科大訊飛、中國科學院等1300家機構采用,推動中國AI技術從跟跑向并跑乃至領跑轉變。

此次開源行動,是華為“把復雜留給自己,把簡單留給客戶”技術理念的生動實踐。當72B模型的專家網絡在昇騰超節點上高效運轉,當7B模型的輕量化部署突破行業邊界,中國AI產業正以開源為支點,撬動全球技術創新的新范式。

-

華為

+關注

關注

218文章

36003瀏覽量

262081 -

盤古大模型

+關注

關注

1文章

112瀏覽量

1040

發布評論請先 登錄

大模型推理服務的彈性部署與GPU調度方案

基于合眾恒躍rk3576?開發板deepseek-r1-1.5b/7b 部署指南

如何本地部署NVIDIA Cosmos Reason-1-7B模型

華為開發者大會2025(HDC 2025)亮點:華為云發布盤古大模型5.5 宣布新一代昇騰AI云服務上線

在阿里云PAI上快速部署NVIDIA Cosmos Reason-1模型

NVIDIA RTX 5880 Ada與Qwen3系列模型實測報告

【幸狐Omni3576邊緣計算套件試用體驗】CPU部署DeekSeek-R1模型(1B和7B)

利用英特爾OpenVINO在本地運行Qwen2.5-VL系列模型

華為宣布開源盤古7B稠密和72B混合專家模型

華為宣布開源盤古7B稠密和72B混合專家模型

評論