Top 10 最智能開源模型均使用混合專家模型架構(gòu)。

Kimi K2 Thinking、DeepSeek-R1、Mistral Large 3 等模型在 NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)上運(yùn)行速度提升 10 倍。

如今,幾乎任一前沿模型的內(nèi)部結(jié)構(gòu)都采用混合專家(MoE) 模型架構(gòu),這種架構(gòu)旨在模擬人腦的高效運(yùn)作機(jī)制。

正如大腦會(huì)根據(jù)任務(wù)激活特定區(qū)域,MoE 模型將工作分配給各個(gè)專門的專家,并在每個(gè)AI token的生成過程中只激活與之相關(guān)的專家。這樣一來,無需成比例增加計(jì)算量,就能夠?qū)崿F(xiàn)更快速、更高效的 token 生成。

業(yè)界已認(rèn)識(shí)到這一優(yōu)勢(shì)。在獨(dú)立 AI 基準(zhǔn)測(cè)試機(jī)構(gòu)Artificial Analysis (AA) 的榜單上,Top 10 最智能開源模型均采用 MoE 架構(gòu),包括深度求索的 DeepSeek-R1、月之暗面的 Kimi K2 Thinking、OpenAI 的 gpt-oss-120B 以及 Mistral AI 的 Mistral Large 3。

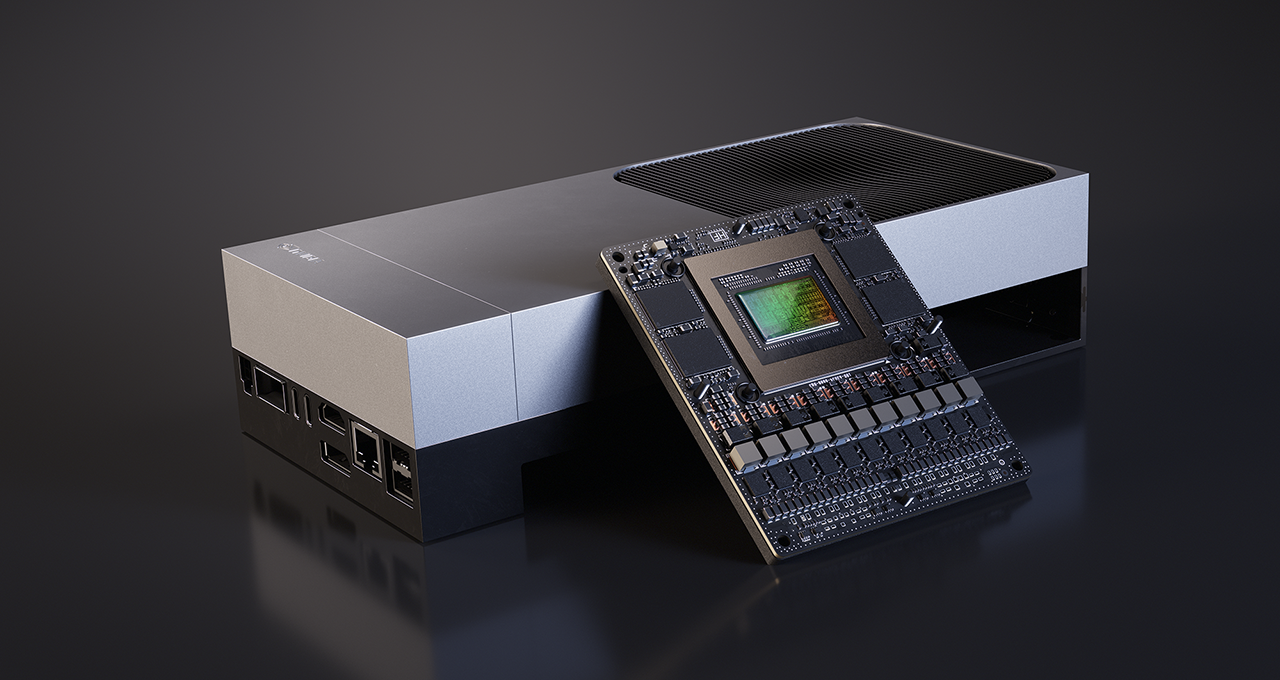

然而,大規(guī)模部署 MoE 模型并同時(shí)保持高性能向來極具挑戰(zhàn)。NVIDIA Grace Blackwell機(jī)架級(jí)擴(kuò)展系統(tǒng)通過軟硬件的極致協(xié)同設(shè)計(jì),將硬件與軟件優(yōu)化相結(jié)合,以實(shí)現(xiàn)性能和效率最大化,從而使規(guī)模化部署 MoE 模型變得切實(shí)可行且簡(jiǎn)便直接。

Kimi K2 Thinking MoE 模型在 AA 榜單被評(píng)為當(dāng)前最智能的開源模型。它在 NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)上的性能較在 NVIDIA HGX Hopper 上實(shí)現(xiàn)了 10 倍的飛躍。基于DeepSeek-R1和 Mistral Large 3 MoE 模型展現(xiàn)的卓越性能,這一突破性進(jìn)展表明 MoE 架構(gòu)正在成為前沿模型的首選架構(gòu),同時(shí)也印證了 NVIDIA 全棧推理平臺(tái)是釋放其全部潛力的關(guān)鍵所在。

什么是 MoE,為何它已成為前沿模型的標(biāo)準(zhǔn)

直到最近,構(gòu)建更智能 AI 的行業(yè)標(biāo)準(zhǔn)還只是打造更大、更稠密的模型,這些模型會(huì)調(diào)用所有參數(shù) (當(dāng)今最強(qiáng)大的模型往往擁有數(shù)千億參數(shù)) 來生成每個(gè) token。雖然很強(qiáng)大,但這種方法需要巨大的計(jì)算能力和能源,使其難以擴(kuò)展。

正如人類大腦在處理不同認(rèn)知任務(wù) (無論是語言處理、物體識(shí)別還是數(shù)學(xué)解題) 時(shí)會(huì)調(diào)用不同的特定區(qū)域,MoE 模型也由多個(gè)專業(yè)化的“專家”組成。針對(duì)每一個(gè)輸入的 token,路由器僅激活其中最相關(guān)的專家。這種設(shè)計(jì)意味著,盡管整體模型可能包含數(shù)千億參數(shù),但生成單個(gè) token 僅需使用其中一小部分參數(shù)——通常只需數(shù)百億參數(shù)參與計(jì)算。

正如人腦通過不同區(qū)域處理不同任務(wù),MoE 模型也通過路由器選擇最相關(guān)的專家來生成每個(gè) token。

通過有選擇性地僅調(diào)用最重要的專家模型,MoE 模型在不增加計(jì)算成本的前提下實(shí)現(xiàn)了更高的智能水平和適應(yīng)性。這使其成為高效 AI 系統(tǒng)的基石,這類系統(tǒng)專為”每美元性能”與”每瓦特性能”而優(yōu)化,能夠在單位資金和單位能耗下產(chǎn)出顯著更高的智能價(jià)值。

鑒于這些優(yōu)勢(shì),MoE 迅速成為前沿模型的首選架構(gòu)也就不足為奇。今年以來,已有超過 60% 的開源 AI 模型采用這一架構(gòu)。自 2023 年初至今,該架構(gòu)更推動(dòng)模型智能水平實(shí)現(xiàn)近 70 倍的飛躍式增長(zhǎng),不斷推動(dòng) AI 突破能力疆界。

自 2025 年初以來,幾乎所有領(lǐng)先的前沿模型都采用了 MoE 設(shè)計(jì)。

“我們兩年前從 Mixtral 8x7B 開始,在開源 MoE 模型架構(gòu)領(lǐng)域開展的開創(chuàng)性工作,確保了先進(jìn)智能技術(shù)廣泛應(yīng)用于各類場(chǎng)景變得可行并且可持續(xù)。”Mistral AI 聯(lián)合創(chuàng)始人兼首席科學(xué)家 Guillaume Lample 表示,“Mistral Large 3 的 MoE 架構(gòu)使我們能夠擴(kuò)展 AI 系統(tǒng)至更高的性能與效率,同時(shí)大幅降低能耗和計(jì)算需求。”

通過極致協(xié)同設(shè)計(jì)突破 MoE 擴(kuò)展瓶頸

前沿的 MoE 模型體量龐大且結(jié)構(gòu)復(fù)雜,無法部署在單塊 GPU 上。要運(yùn)行這些模型,必須將專家分布在多塊 GPU 上,這種技術(shù)稱為“專家并行”。即使在 NVIDIA Hopper 這樣的高性能平臺(tái)上,部署 MoE 模型仍會(huì)遇到一些挑戰(zhàn),比如:

內(nèi)存限制:對(duì)于每個(gè) token,GPU 必須從高帶寬內(nèi)存中動(dòng)態(tài)加載被選中專家的參數(shù),導(dǎo)致內(nèi)存帶寬頻繁承受巨大壓力。

延遲:專家子網(wǎng)絡(luò)必須執(zhí)行近乎瞬時(shí)的 all-to-all 通信模式,以交換信息并形成最終完整的答案。然而在 Hopper 平臺(tái)上,當(dāng)專家組分布于超過八塊 GPU 時(shí),通信需通過高延遲的橫向擴(kuò)展網(wǎng)絡(luò)進(jìn)行,這限制了專家并行計(jì)算的優(yōu)勢(shì)。

解決方案:極致協(xié)同設(shè)計(jì)

NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng),搭載了 72 塊 NVIDIA Blackwell GPU 協(xié)同工作,如同單一系統(tǒng)般運(yùn)行,提供 1.4 ExaPLOPS AI 性能和 30 TB 高速共享內(nèi)存。這 72 塊 GPU 通過 NVLink Switch 連接成單一龐大的 NVLink 互連結(jié)構(gòu),使每塊 GPU 都能以 130 TB 每秒的 NVLink 連接速度相互通信。

MoE 模型能夠利用這種設(shè)計(jì)將專家并行擴(kuò)展到遠(yuǎn)超以往的極限——將專家分布在多達(dá) 72 塊 GPU 的更大規(guī)模集群中。

這種架構(gòu)方法通過以下方式直接解決了 MoE 的擴(kuò)展瓶頸:

減少每塊 GPU 上的專家數(shù)量:將專家分布在最多 72 塊 GPU 上,可減少每塊 GPU 承載的專家數(shù)量,從而最大限度減輕對(duì)每塊 GPU 高帶寬內(nèi)存的參數(shù)加載壓力。每塊 GPU 上較少的專家數(shù)量還釋放了內(nèi)存空間,使各 GPU 能夠服務(wù)更多并發(fā)用戶并支持更長(zhǎng)的輸入序列。

加速專家通信:分布于不同 GPU 的專家可通過 NVLink 即時(shí)通信。NVLink Switch 還具備執(zhí)行部分計(jì)算所需的算力以整合來自不同專家的信息,從而加速最終結(jié)果的生成。

其他全棧優(yōu)化措施同樣對(duì)釋放 MoE 模型的卓越推理性能至關(guān)重要。NVIDIA Dynamo框架通過將預(yù)填充和解碼任務(wù)分配至不同 GPU 來協(xié)調(diào)分離服務(wù),使解碼任務(wù)得以采用大規(guī)模專家并行處理,而預(yù)填充任務(wù)則采用更契合其工作負(fù)載的并行技術(shù)。NVFP4格式在保持精度的同時(shí),進(jìn)一步提升了性能與效率。

開源推理框架(如 NVIDIA TensorRT-LLM、SGLang 和 vLLM)均支持針對(duì) MoE 模型的這些優(yōu)化方案。其中,SGLang 在推動(dòng)在 Grace Blackwell 平臺(tái)上實(shí)現(xiàn)大規(guī)模 MoE 模型部署方面發(fā)揮了重要作用,助力驗(yàn)證并完善了當(dāng)前廣泛采用的諸多技術(shù)方案。

為了讓全球企業(yè)都能獲得這一卓越性能,Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng) 正通過主要云服務(wù)提供商及NVIDIA 云合作伙伴進(jìn)行部署。

CoreWeave 聯(lián)合創(chuàng)始人兼首席技術(shù)官 Peter Salanki 表示:“在 CoreWeave 平臺(tái)上,客戶正通過構(gòu)建智能工作流,將 MoE 模型實(shí)現(xiàn)大規(guī)模部署。通過與 NVIDIA 的緊密合作,我們得以打造出一個(gè)高度集成的平臺(tái),能夠?qū)?MoE 模型的性能、可擴(kuò)展性和可靠性融為一體。只有在專為 AI 打造的云平臺(tái)上,才能實(shí)現(xiàn)這樣的突破。”

DeepL 等客戶正采用 Grace Blackwell 機(jī)架級(jí)擴(kuò)展設(shè)計(jì)來構(gòu)建和部署其新一代 AI 模型。

DeepL 研究團(tuán)隊(duì)負(fù)責(zé)人 Paul Busch 表示:“DeepL 正借助 NVIDIA Grace Blackwell 硬件訓(xùn)練 MoE 模型,通過推進(jìn)模型架構(gòu)提升訓(xùn)練與推理階段的效率,為 AI 性能樹立新標(biāo)桿。”

性能體現(xiàn)在每瓦特性能上

NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)能夠高效擴(kuò)展復(fù)雜的元學(xué)習(xí)模型,實(shí)現(xiàn)每瓦性能 10 倍的提升。這一性能飛躍不僅是標(biāo)準(zhǔn)上的突破,它使 token 收入可以實(shí)現(xiàn) 10 倍增長(zhǎng),徹底改變了 AI 在能效受限、成本敏感型數(shù)據(jù)中心中的規(guī)模化經(jīng)濟(jì)模型。

在華盛頓特區(qū) NVIDIA GTC 大會(huì)上,NVIDIA 創(chuàng)始人兼首席執(zhí)行官黃仁勛重點(diǎn)展示了 Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)如何使 DeepSeek-R1 的性能達(dá)到相較在 NVIDIA Hopper 架構(gòu)上實(shí)現(xiàn) 10 倍的提升,且這樣的性能提升同樣適用于其他 DeepSeek 模型。

Together AI 聯(lián)合創(chuàng)始人兼首席執(zhí)行官 Vipul Ved Prakash 表示:“憑借 Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)和 Together AI 的定制化優(yōu)化方案,我們?cè)?DeepSeek-V3 等 MoE 模型的大規(guī)模推理工作負(fù)載表現(xiàn)已超越客戶預(yù)期。這些性能提升源于 NVIDIA 的全棧優(yōu)化技術(shù),結(jié)合了 Together AI 在內(nèi)核、運(yùn)行時(shí)引擎和推測(cè)解碼等領(lǐng)域的推理技術(shù)突破性進(jìn)展。”

這種性能優(yōu)勢(shì)在其他前沿模型中同樣顯而易見。

Kimi K2 Thinking 作為最智能的開源模型,再次印證了其卓越性能——在 Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)部署時(shí),其代際性能提升達(dá) 10 倍。

Fireworks AI 當(dāng)前在 NVIDIA Blackwell 平臺(tái)部署 Kimi K2 使其在Artificial Analysis (AA) 的榜單上取得最高排名。

Fireworks AI 聯(lián)合創(chuàng)始人兼首席執(zhí)行官喬琳表示:“NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展設(shè)計(jì)使 MoE 模型運(yùn)行效率大幅提升,展望未來,其 有望徹底改變我們運(yùn)行大規(guī)模 MoE 模型的方式,其相較于 Hopper 平臺(tái)實(shí)現(xiàn)的重大性能飛躍,為前沿模型的運(yùn)行速度和效率樹立了全新標(biāo)桿。”

Mistral Large 3 在 Grace Blackwell 機(jī)架級(jí)擴(kuò)展架構(gòu)上實(shí)現(xiàn)了相較前代 Hopper 10 倍的性能提升。這種代際飛躍為這款新型 MoE 模型帶來了更優(yōu)的用戶體驗(yàn)、更低的每 token 成本以及更高的能效表現(xiàn)。

大規(guī)模驅(qū)動(dòng)智能

NVIDIA Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)意在為除 MoE 模型之外的工作負(fù)載也提供強(qiáng)大的性能。

當(dāng)我們審視 AI 的發(fā)展方向時(shí),原因便不言而喻:新一代多模態(tài) AI 模型擁有處理語言、視覺、音頻等不同模態(tài)的專門化組件,并且僅會(huì)激活與當(dāng)前任務(wù)相關(guān)的部分。

在智能體系統(tǒng)中,不同的”智能體”分別專精于規(guī)劃、感知、推理、工具使用或搜索等任務(wù),而編排器則統(tǒng)籌這些智能體以實(shí)現(xiàn)單一目標(biāo)。這兩種模式的核心邏輯都與 MoE 相呼應(yīng):將相關(guān)問題各部分分配給最相關(guān)的專家處理,再協(xié)調(diào)各環(huán)節(jié)輸出以達(dá)成最終結(jié)果。

將這一原理擴(kuò)展至大規(guī)模部署——即多個(gè)應(yīng)用程序和智能體為眾多用戶提供服務(wù)的情境——將釋放出全新的效率水平。這種方法無需為每個(gè)智能體或應(yīng)用程序重復(fù)構(gòu)建龐大的 AI 模型,而是建立一個(gè)共享的專家池供所有系統(tǒng)調(diào)用,確保每個(gè)請(qǐng)求都能精準(zhǔn)路由至對(duì)應(yīng)的專家。

MoE 模型是一種強(qiáng)大的架構(gòu),正引領(lǐng)行業(yè)邁向大規(guī)模能力、效率與規(guī)模并存的未來。Grace Blackwell 機(jī)架級(jí)擴(kuò)展系統(tǒng)現(xiàn)已解鎖這種潛力,而基于 NVIDIA Vera Rubin 架構(gòu)的 NVIDIA 的路線圖將持續(xù)拓展前沿模型的邊界。

深入了解 Grace Blackwell如何擴(kuò)展復(fù)雜的 MoE 模型,請(qǐng)參閱技術(shù)深度解讀。本文屬于Think SMART系列,該系列分享領(lǐng)先的 AI 服務(wù)提供商、開發(fā)者和企業(yè)如何借助NVIDIA 全棧式推理平臺(tái)的最新技術(shù)突破,提升其推理性能并提高投資回報(bào)率。

-

NVIDIA

+關(guān)注

關(guān)注

14文章

5513瀏覽量

109200 -

AI

+關(guān)注

關(guān)注

90文章

38414瀏覽量

297711 -

模型

+關(guān)注

關(guān)注

1文章

3658瀏覽量

51804

原文標(biāo)題:混合專家模型驅(qū)動(dòng)前沿 AI 模型,在 NVIDIA Blackwell 系統(tǒng)上運(yùn)行速度提升 10 倍

文章出處:【微信號(hào):NVIDIA_China,微信公眾號(hào):NVIDIA英偉達(dá)】歡迎添加關(guān)注!文章轉(zhuǎn)載請(qǐng)注明出處。

發(fā)布評(píng)論請(qǐng)先 登錄

NVIDIA RTX PRO 2000 Blackwell GPU性能測(cè)試

NVIDIA DGX Spark助力構(gòu)建自己的AI模型

NVIDIA RTX PRO 4500 Blackwell GPU測(cè)試分析

基于 NVIDIA Blackwell 的 Jetson Thor 現(xiàn)已發(fā)售,加速通用機(jī)器人時(shí)代的到來

NVIDIA從云到邊緣加速OpenAI gpt-oss模型部署,實(shí)現(xiàn)150萬TPS推理

NVIDIA Blackwell GPU優(yōu)化DeepSeek-R1性能 打破DeepSeek-R1在最小延遲場(chǎng)景中的性能紀(jì)錄

Cadence 利用 NVIDIA Grace Blackwell 加速AI驅(qū)動(dòng)的工程設(shè)計(jì)和科學(xué)應(yīng)用

英偉達(dá)GTC2025亮點(diǎn):NVIDIA Blackwell加速計(jì)算機(jī)輔助工程軟件,實(shí)現(xiàn)實(shí)時(shí)數(shù)字孿生性能數(shù)量級(jí)提升

NVIDIA Blackwell白皮書:NVIDIA Blackwell Architecture Technical Brief

NVIDIA Blackwell數(shù)據(jù)手冊(cè)與NVIDIA Blackwell架構(gòu)技術(shù)解析

新思科技攜手英偉達(dá)加速芯片設(shè)計(jì),提升芯片電子設(shè)計(jì)自動(dòng)化效率

NVIDIA 宣布推出 DGX Spark 個(gè)人 AI 計(jì)算機(jī)

NVIDIA Grace Blackwell平臺(tái)實(shí)現(xiàn)MoE模型性能十倍提升

NVIDIA Grace Blackwell平臺(tái)實(shí)現(xiàn)MoE模型性能十倍提升

評(píng)論