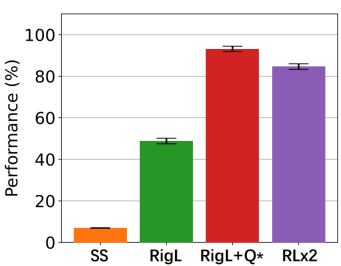

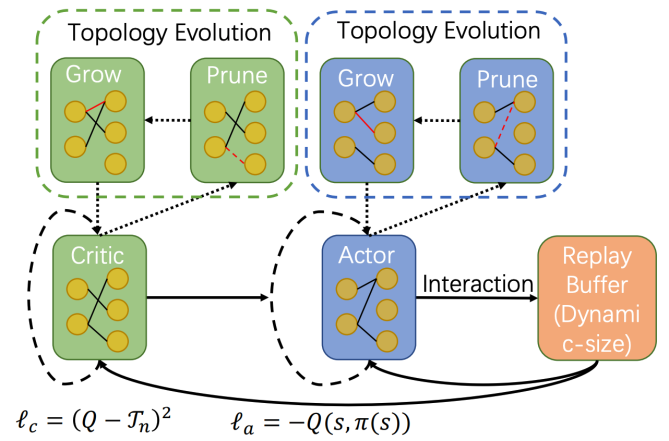

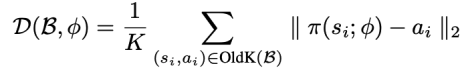

深度強化學習模型的訓練通常需要很高的計算成本,因此對深度強化學習模型進行稀疏化處理具有加快訓練速度和拓展模型部署的巨大潛力。然而現有的生成小型模型的方法主要基于知識蒸餾,即通過迭代訓練稠密網絡,訓練過程仍需要大量的計算資源。另外,由于強化學習自舉訓練的復雜性,訓練過程中全程進行稀疏訓練在深度強化學習領域尚未得到充分的研究。 清華大學黃隆波團隊提出了一種強化學習專用的動態稀疏訓練框架,“Rigged Reinforcement Learning Lottery”(RLx2),可適用于多種離策略強化學習算法。它采用基于梯度的拓撲演化原則,能夠完全基于稀疏網絡訓練稀疏深度強化學習模型。RLx2 引入了一種延遲多步差分目標機制,配合動態容量的回放緩沖區,實現了在稀疏模型中的穩健值學習和高效拓撲探索。在多個 MuJoCo 基準任務中,RLx2 達到了最先進的稀疏訓練性能,顯示出 7.5 倍至 20 倍的模型壓縮,而僅有不到 3% 的性能降低,并且在訓練和推理中分別減少了高達 20 倍和 50 倍的浮點運算數。大模型時代,模型壓縮和加速顯得尤為重要。傳統監督學習可通過稀疏神經網絡實現模型壓縮和加速,那么同樣需要大量計算開銷的強化學習任務可以基于稀疏網絡進行訓練嗎?本文提出了一種強化學習專用稀疏訓練框架,可以節省至多 95% 的訓練開銷。

- 論文主頁:https://arxiv.org/abs/2205.15043

- 論文代碼:https://github.com/tyq1024/RLx2

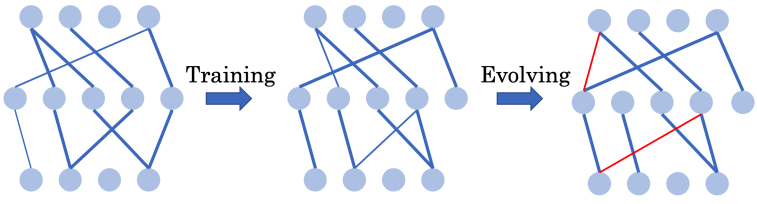

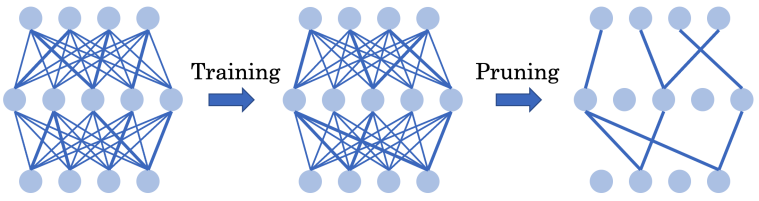

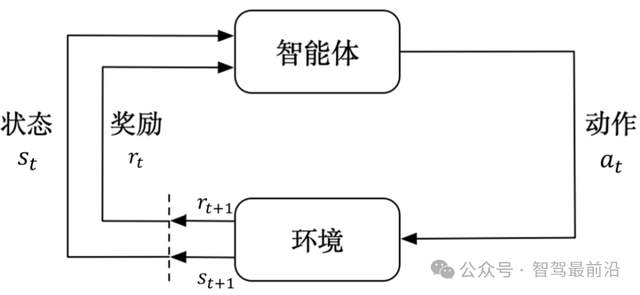

圖:基于強化學習的 AlphaGo-Zero 在圍棋游戲中擊敗了已有的圍棋 AI 和人類專家 高昂的資源消耗限制了深度強化學習在資源受限設備上的訓練和部署。為了解決這一問題,作者引入了稀疏神經網絡。稀疏神經網絡最初在深度監督學習中提出,展示出了對深度強化學習模型壓縮和訓練加速的巨大潛力。在深度監督學習中,SET [Mocanu et al. 2018] 和 RigL [Evci et al. 2020] 等常用的基于網絡結構演化的動態稀疏訓練(Dynamic sparse training - DST)框架可以從頭開始訓練一個 90% 稀疏的神經網絡,而不會出現性能下降。

能否通過全程使用超稀疏網絡從頭訓練出高效的深度強化學習智能體?

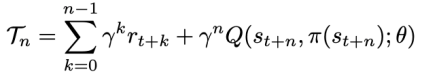

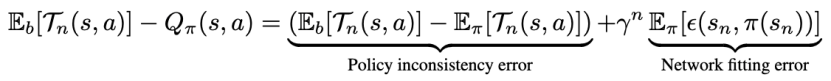

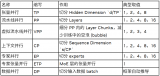

方法 清華大學黃隆波團隊對這一問題給出了肯定的答案,并提出了一種強化學習專用的動態稀疏訓練框架,“Rigged Reinforcement Learning Lottery”(RLx2),用于離策略強化學習(Off-policy RL)。這是第一個在深度強化學習領域以 90% 以上稀疏度進行全程稀疏訓練,并且僅有微小性能損失的算法框架。RLx2 受到了在監督學習中基于梯度的拓撲演化的動態稀疏訓練方法 RigL [Evci et al. 2020] 的啟發。然而,直接應用 RigL 無法實現高稀疏度,因為稀疏的深度強化學習模型由于假設空間有限而導致價值估計不可靠,進而干擾了網絡結構的拓撲演化。 因此,RLx2 引入了延遲多步差分目標(Delayed multi-step TD target)機制和動態容量回放緩沖區(Dynamic capacity buffer),以實現穩健的價值學習(Value learning)。這兩個新組件解決了稀疏拓撲下的價值估計問題,并與基于 RigL 的拓撲演化準則一起實現了出色的稀疏訓練性能。為了闡明設計 RLx2 的動機,作者以一個簡單的 MuJoCo 控制任務 InvertedPendulum-v2 為例,對四種使用不同價值學習和網絡拓撲更新方案的稀疏訓練方法進行了比較。

原文標題:ICLR 2023 Spotlight|節省95%訓練開銷,清華黃隆波團隊提出強化學習專用稀疏訓練框架RLx2

文章出處:【微信公眾號:智能感知與物聯網技術研究所】歡迎添加關注!文章轉載請注明出處。

聲明:本文內容及配圖由入駐作者撰寫或者入駐合作網站授權轉載。文章觀點僅代表作者本人,不代表電子發燒友網立場。文章及其配圖僅供工程師學習之用,如有內容侵權或者其他違規問題,請聯系本站處理。

舉報投訴

-

物聯網

+關注

關注

2945文章

47819瀏覽量

414853

原文標題:ICLR 2023 Spotlight|節省95%訓練開銷,清華黃隆波團隊提出強化學習專用稀疏訓練框架RLx2

文章出處:【微信號:tyutcsplab,微信公眾號:智能感知與物聯網技術研究所】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

相關推薦

熱點推薦

自動駕駛中常提的離線強化學習是什么?

,圖片源自:網絡 但強化學習本身是需要不斷試錯的,如果采用這種學習方式在真實道路中不斷嘗試,一定會導致不可控的事故。于是就有人提出一種猜測,能不能利用已經存在的大量行駛日志、仿真記錄和人類駕駛數據,在

多智能體強化學習(MARL)核心概念與算法概覽

訓練單個RL智能體的過程非常簡單,那么我們現在換一個場景,同時訓練五個智能體,而且每個都有自己的目標、只能看到部分信息,還能互相幫忙。這就是多智能體強化學習

如何訓練好自動駕駛端到端模型?

[首發于智駕最前沿微信公眾號]最近有位小伙伴在后臺留言提問:端到端算法是怎樣訓練的?是模仿學習、強化學習和離線強化學習這三類嗎?其實端到端(end-to-end)算法在自動駕駛、智能體

今日看點:智元推出真機強化學習;美國軟件公司SAS退出中國市場

智元推出真機強化學習,機器人訓練周期從“數周”減至“數十分鐘” ? 近日,智元機器人宣布其研發的真機強化學習技術,已在與龍旗科技合作的驗證產線中成功落地。據介紹,此次落地的真機強化學習

發表于 11-05 09:44

?1090次閱讀

自動駕駛中常提的“強化學習”是個啥?

[首發于智駕最前沿微信公眾號]在談及自動駕駛時,有些方案中會提到“強化學習(Reinforcement Learning,簡稱RL)”,強化學習是一類讓機器通過試錯來學會做決策的技術。簡單理解

在Ubuntu20.04系統中訓練神經網絡模型的一些經驗

本帖欲分享在Ubuntu20.04系統中訓練神經網絡模型的一些經驗。我們采用jupyter notebook作為開發IDE,以TensorFlow2為訓練框架,目標是

發表于 10-22 07:03

借助NVIDIA Megatron-Core大模型訓練框架提高顯存使用效率

隨著模型規模邁入百億、千億甚至萬億參數級別,如何在有限顯存中“塞下”訓練任務,對研發和運維團隊都是巨大挑戰。NVIDIA Megatron-Core 作為流行的大模型訓練框架,提供了靈

NVIDIA Isaac Lab多GPU多節點訓練指南

NVIDIA Isaac Lab 是一個適用于機器人學習的開源統一框架,基于 NVIDIA Isaac Sim 開發,其模塊化高保真仿真適用于各種訓練環境,可提供各種物理 AI 功能和由 GPU 驅動的物理仿真,縮小仿真與現實世

如何在Ray分布式計算框架下集成NVIDIA Nsight Systems進行GPU性能分析

在大語言模型的強化學習訓練過程中,GPU 性能優化至關重要。隨著模型規模不斷擴大,如何高效地分析和優化 GPU 性能成為開發者面臨的主要挑戰之一。

NVIDIA Isaac Lab可用環境與強化學習腳本使用指南

Lab 是一個適用于機器人學習的開源模塊化框架,其模塊化高保真仿真適用于各種訓練環境,Isaac Lab 同時支持模仿學習(模仿人類)和強化學習

【書籍評測活動NO.62】一本書讀懂 DeepSeek 全家桶核心技術:DeepSeek 核心技術揭秘

與 PPO 對比示意圖

03.獎勵模型的創新

在強化學習的訓練過程中,DeepSeek 研究團隊選擇面向結果的獎勵模型 ,而不是通常的面向過程的獎勵模型。這種方式可以較好地避免獎勵欺騙,同時,由于

發表于 06-09 14:38

OCR識別訓練完成后給的是空壓縮包,為什么?

OCR識別 一共弄了26張圖片,都標注好了,點擊開始訓練,顯示訓練成功了,也將壓縮包發到郵箱了,下載下來后,壓縮包里面是空的

OCR圖片20幾張圖太少了。麻煩您多添加點,參考我們的ocr識別訓練數據集

請問

發表于 05-28 06:46

海思SD3403邊緣計算AI數據訓練概述

AI數據訓練:基于用戶特定應用場景,用戶采集照片或視頻,通過AI數據訓練工程師**(用戶公司****員工)** ,進行特征標定后,將標定好的訓練樣本,通過AI訓練服務器,進行AI

發表于 04-28 11:11

用PaddleNLP為GPT-2模型制作FineWeb二進制預訓練數據集

,使用PaddleNLP將FineWeb數據集中文本形式的數據,經過分詞化(Tokenize),轉換為大語言模型能直接使用的二進制數據,以便提升訓練效果。 ChatGPT發布后,當代大語言模型(LLM)的訓練流程基本遵循OpenAI提出

ICLR 2023 Spotlight|節省95%訓練開銷,清華黃隆波團隊提出強化學習專用稀疏訓練框架RLx2

ICLR 2023 Spotlight|節省95%訓練開銷,清華黃隆波團隊提出強化學習專用稀疏訓練框架RLx2

評論