1.摘要

最近將學習的方式引入點云配準中取得了成功,但許多工作都側(cè)重于學習特征描述符,并依賴于最近鄰特征匹配和通過RANSAC進行離群值過濾,以獲得姿態(tài)估計的最終對應(yīng)集合。在這項工作中,我們推測注意機制可以取代顯式特征匹配和RANSAC的作用,從而提出一個端到端的框架來直接預(yù)測最終的對應(yīng)集。我們使用主要由自注意力和交叉注意力的transformer層組成的網(wǎng)絡(luò)架構(gòu)并對其訓(xùn)練,以預(yù)測每個點位于重疊區(qū)域的概率及其在其他點云中的相應(yīng)位置。然后,可以直接根據(jù)預(yù)測的對應(yīng)關(guān)系估計所需的剛性變換,而無需進一步的后處理。盡管簡單,但我們的方法在3DMatch和ModelNet基準測試中取得了一流的性能。我們的源代碼可以在https://github.com/yewzijian/RegTR.

2.引言

剛性點云配準指找到對齊兩個點云的最佳旋轉(zhuǎn)和平移參數(shù)的問題。點云配準的通用解決方案流程如下:1)檢測關(guān)鍵點,2)計算這些關(guān)鍵點的特征描述符,3)通過最近鄰匹配獲得假定的對應(yīng)關(guān)系,4)通常使用RANSAC以穩(wěn)健的方式估計剛性變換。近年來,研究人員將學習的方式應(yīng)用于點云配準,這些工作中有許多側(cè)重于學習特征描述符,也有包括關(guān)鍵點檢測,且最后兩個步驟通常保持不變,因為這些方法仍然需要最近鄰匹配和RANSAC來獲得最終轉(zhuǎn)換。這些算法在訓(xùn)練過程中沒考慮后處理,其性能對后處理的選擇很敏感,以選擇正確的對應(yīng)關(guān)系,如RANSAC中采樣的興趣點或距離閾值。

一些方法通過使用從局部特征相似性得分計算的軟對應(yīng)來估計對齊方式,從而避免了不可微的最近鄰匹配和RANSAC步驟。在這項工作中,我們采用了稍微不同的方法。我們注意到,這些工作中學習到的局部特色主要用于建立對應(yīng)關(guān)系。因此,讓網(wǎng)絡(luò)直接預(yù)測一組清晰的對應(yīng)關(guān)系,而不是學習好的特征。受到最近一系列工作的激勵,這些工作利用transformer注意力層,以最少的后處理來預(yù)測各種任務(wù)的最終輸出。雖然注意機制以前曾被用于點云和圖像的配準中,但這些工作主要是利用注意力層來聚集上下文信息,以學習更多的區(qū)分性的特征描述符,后續(xù)的RANSAC或最優(yōu)轉(zhuǎn)換步驟仍然經(jīng)常用來獲得最終的對應(yīng)關(guān)系。相比之下,Regis-tration Transformer(REGTR)利用注意力層直接輸出一組一致的最終點對應(yīng)關(guān)系,如圖1所示。由于網(wǎng)絡(luò)輸出清晰的對應(yīng)關(guān)系,可以直接估計所需的剛性轉(zhuǎn)換,而不需要額外的近鄰匹配和RANSAC步驟。

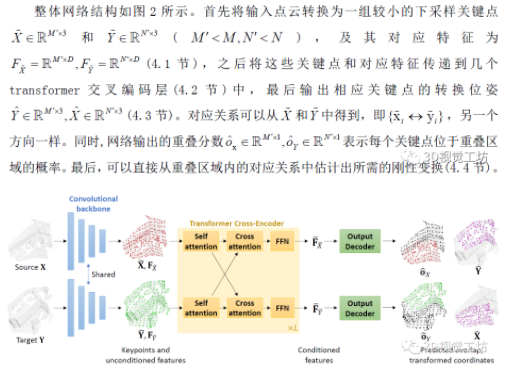

圖1 REGTR網(wǎng)絡(luò)流程圖

首先,REGTR主干使用點卷積來提取一組特征,同時對輸入的點云進行下采樣。這兩個點云的特征被傳遞到多個transformer層,這些transformer層包含多頭自注意力和交叉注意力,方便全局信息聚合。同時通過位置編碼考慮點的位置,以允許網(wǎng)絡(luò)利用剛性約束糾正不好的對應(yīng)關(guān)系。然后,使用生成的特征預(yù)測下采樣點的相應(yīng)變換位置。此外,通過預(yù)測重疊概率分數(shù)來計算剛性變換時預(yù)測的對應(yīng)關(guān)系。與常見的通過最近鄰特征匹配計算對應(yīng)關(guān)系的方法不同,該方法要求興趣點位于兩個點云中的相同位置,本文提出的網(wǎng)絡(luò)經(jīng)過訓(xùn)練可以直接預(yù)測出相應(yīng)的點位置。因此,不需要對大量興趣點或產(chǎn)生可重復(fù)點的關(guān)鍵點檢測器進行采樣,而是在簡單的網(wǎng)格下采樣點上建立對應(yīng)關(guān)系。

盡管REGTR設(shè)計簡單,但它在3DMatch和ModelNet數(shù)據(jù)集上實現(xiàn)了最先進的性能。由于不需要在大量假對應(yīng)上運行RANSAC,因此運行時間也很快。總之,我們的貢獻是:

?通過自注意力和交叉關(guān)注力直接預(yù)測一組一致的最終點對應(yīng),而不使用常用的RANSAC或最優(yōu)轉(zhuǎn)換層。

?對多個數(shù)據(jù)集進行了評估,雖然使用了少量對應(yīng)關(guān)系,但仍實現(xiàn)了精確配準,并展示了最先進的性能。

3.定義問題

4.方法設(shè)計

圖2 REGTR網(wǎng)絡(luò)整體結(jié)構(gòu)

4.1 下采樣和特征提取

4.2 交叉編碼的transformer層

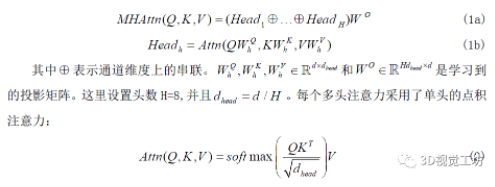

前一節(jié)中的KPConv特征會線性投影到低維(d=256),然后饋入交叉編碼的transformer層(L=6)。每個交叉編碼的transformer有三個子層:1)分別在兩個點云上運行的多頭自注意力層;2)使用其他點云信息更新特征的多頭交叉注意力層;3)位置型前饋網(wǎng)絡(luò)。交叉注意力使網(wǎng)絡(luò)能夠比較來自兩個不同點云的點,而自注意力允許點在預(yù)測其自身變換位置時與同一點云內(nèi)的其他點交互。值得注意的是網(wǎng)絡(luò)權(quán)重在兩個點云之間共享,但在層之間不共享。

子層注意力。每個子層中多頭注意力定義為:

每個子層都應(yīng)用殘差連接和層歸一化,并使用pre-LN排序,因為更容易優(yōu)化。query,key,value設(shè)置在相同點云的自注意力層中,這能夠關(guān)注到同一點云的其余部分。對于交叉注意力層,key和value被設(shè)置為來自其他點云的特征,這可以讓每個點與其他點云中的點交互。

位置型前饋網(wǎng)絡(luò)。該子層分別對每個關(guān)鍵點的特征進行操作。和通常的實現(xiàn)方式一樣,在第一層后使用帶ReLU激活函數(shù)的兩層前饋網(wǎng)絡(luò),還應(yīng)用了殘差連接和層歸一化。

位置編碼。與以往使用注意力來學習區(qū)分特征的方案不同,本文的transformer層取代了RANSAC,即向每個transformer層的輸入添加正弦位置編碼來合并位置信息。

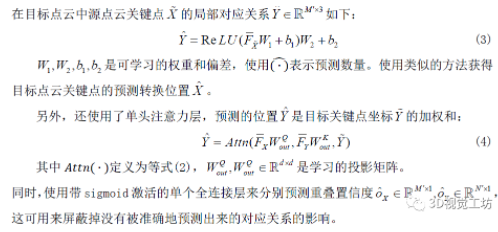

4.3解碼輸出

現(xiàn)在約束特征可用于預(yù)測出轉(zhuǎn)換的關(guān)鍵點坐標,因此使用兩層MLP獲取需要的坐標。

4.4估計剛性變換

4.5損失函數(shù)

使用ground truth位姿進行端對端的訓(xùn)練網(wǎng)絡(luò),采用如下?lián)p失進行監(jiān)督:

圖3一對點云(左),密集點對應(yīng)的ground truth標簽(中),下采樣關(guān)鍵點(右)

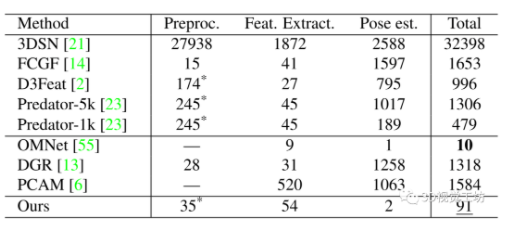

對應(yīng)關(guān)系損失。對重疊區(qū)域中關(guān)鍵點的預(yù)測變換位置應(yīng)用L1損失:

5.實驗

本文以3DMatch和ModelNet40數(shù)據(jù)集進行實驗與測試,以配準召回率(RR),相對旋轉(zhuǎn)誤差(RRE)和相對平移誤差(RTE)為評價指標。配準結(jié)果

5.1數(shù)據(jù)集和結(jié)果

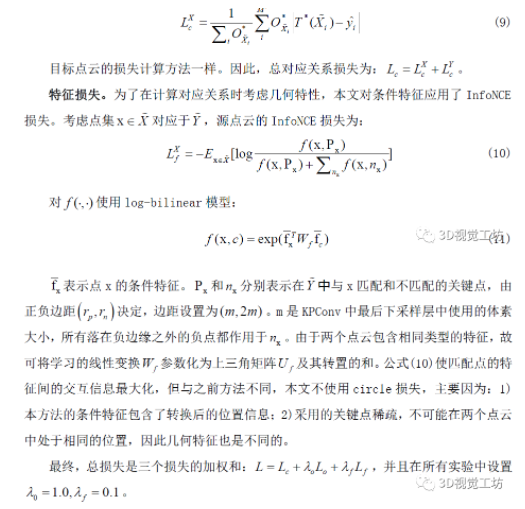

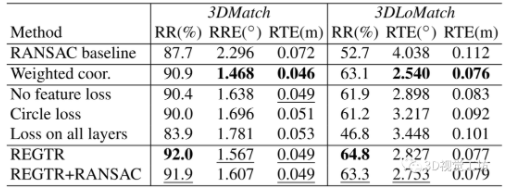

3DMatch。對比結(jié)果如表1所示,可以看出本文方法實現(xiàn)了跨場景的最高平均配準召回率,在3DMatch和3DLoMatch基準上都達到了最低的RTE和RRE,雖然只使用了少量的點進行位姿估計。

表1 在3DMatch和3DLoMatch數(shù)據(jù)集上的性能對比

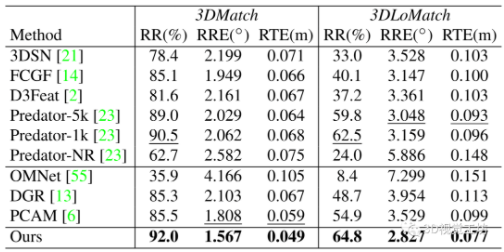

ModelNet40。跟基于對應(yīng)關(guān)系的端對端的配準方法進行比較,在正常重疊(ModelNet)和低重疊(ModelLoNet)下, REGTR在所有指標上都大大優(yōu)于所有對比方法。本文的注意力機制能夠超越最佳轉(zhuǎn)換(RPM-Net)和RANSAC步驟(Predator)。定性結(jié)果如圖4所示。

表2 ModelNet40數(shù)據(jù)集評估結(jié)果

圖4 定性分析結(jié)果((a,b)為3DMatch,(c,d)為3DLoMatch, (e)為ModelNet40, (f)為ModelLoNet)

5.2分析對比

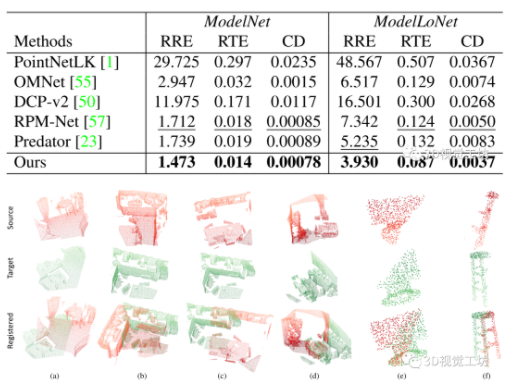

運行時間。將本文方法和表3中的方法進行對比,可以發(fā)現(xiàn)本文方法在100ms以下運行,可以應(yīng)用于許多實時程序中。

表3 3DMatch測試集的運行時間對比(ms)

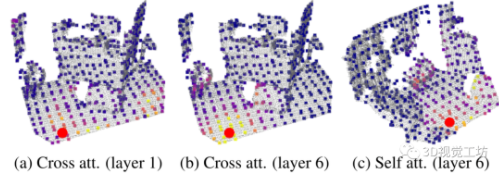

注意力可視化。如圖5所示,當該點位于非信息區(qū)域,因此該點會關(guān)注第一個transformer層中其他點云中的多個類似外觀區(qū)域(圖5a)。在第六層,該點確信其位置,并且主要關(guān)注其正確的對應(yīng)位置(圖5b)。自注意力(圖5c)顯示了利用豐富特征區(qū)域幫助定位到正確位置。

圖5 注意力權(quán)重可視化

5.3消融實驗

本節(jié)進一步對3DMatch數(shù)據(jù)集進行消融實驗研究,以了解各種成分的作用,結(jié)果如表4所示。

與RANSAC的比較。嘗試將RANSAC應(yīng)用于REGTR進行預(yù)測對應(yīng),以確定性能是否進一步提高。表4第7行顯示的配準召回情況稍差。這表明RANSAC對已經(jīng)與剛性變換一致的預(yù)測對應(yīng)不再有益。

解碼方案。將坐標解碼為坐標的加權(quán)和(公式4)與使用MLP回歸坐標的方法相比,將坐標計算為加權(quán)和可以獲得更好的RTE和RRE,但配準召回率更低,見表4第2行和第6行。

消融損失。表4第3-6行顯示了配置不同損失函數(shù)時的配準性能。在沒有特征損失來指導(dǎo)網(wǎng)絡(luò)輸出的情況下,3DMatch和3DLoMatch的注冊召回率分別降低了1.6%和2.9%,使用circle損失也表現(xiàn)不佳,因為網(wǎng)絡(luò)無法有效地將位置信息合并到特征中。

表4 消融實驗對比結(jié)果

6.局限性

本文使用具有二次復(fù)雜度的transformer層阻止了它在大規(guī)模點云上使用,并且只能將其應(yīng)用于下采樣后的點云。雖然直接預(yù)測對應(yīng)關(guān)系減輕了分辨率問題,但更精細的分辨率可能會導(dǎo)致更高的性能。我們嘗試了具有線性復(fù)雜度的transformer層,但其性能較差,可能替代的解決方法包括使用稀疏注意力,或執(zhí)行從粗到細的配準。

7.結(jié)論

本文提出了用于剛性點云配準的REGTR網(wǎng)絡(luò),它使用多個transformer層直接預(yù)測清晰的點對應(yīng)關(guān)系,無需進一步的最近鄰特征匹配或RANSAC步驟,即可根據(jù)對應(yīng)關(guān)系估計剛性變換。直接預(yù)測對應(yīng)關(guān)系克服了使用下采樣特征帶來的分辨率問題,并且我們的方法在場景和對象點云數(shù)據(jù)集上都達到了最先進的性能。

審核編輯:郭婷

-

檢測器

+關(guān)注

關(guān)注

1文章

932瀏覽量

49943 -

數(shù)據(jù)集

+關(guān)注

關(guān)注

4文章

1236瀏覽量

26194

原文標題:REGTR:帶有transformer的端對端點云對應(yīng)(CVPR2022)

文章出處:【微信號:3D視覺工坊,微信公眾號:3D視覺工坊】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

端到端下半場,如何做好高保真虛擬數(shù)據(jù)集的構(gòu)建與感知?

Nullmax感知規(guī)劃端到端大模型進化提速

端到端智駕模擬軟件推薦——為什么選擇Keymotek的aiSim?

Nullmax端到端軌跡規(guī)劃論文入選AAAI 2026

自動駕駛中端到端仿真與基于規(guī)則的仿真有什么區(qū)別?

蔚來端到端模型化架構(gòu)如何大幅提升安全上限

Transformer在端到端自動駕駛架構(gòu)中是何定位?

Nullmax端到端自動駕駛最新研究成果入選ICCV 2025

為什么自動駕駛端到端大模型有黑盒特性?

為何端到端成為各車企智駕布局的首要選擇?

一文帶你厘清自動駕駛端到端架構(gòu)差異

小米汽車端到端智駕技術(shù)介紹

動量感知規(guī)劃的端到端自動駕駛框架MomAD解析

采用帶有transformer的端到端框架獲取對應(yīng)集合結(jié)果

采用帶有transformer的端到端框架獲取對應(yīng)集合結(jié)果

評論