端到端自動駕駛框架實現了感知與規劃的無縫集成,但通常依賴于一次性軌跡預測,這可能導致控制不穩定,并且對單頓感知中的遮擋問題較為敏感。為解決這一問題,我們提出了動量感知駕駛框架Momentum-Aware Driving(MomAD),該框架引I入了軌跡動量和感知動量,以穩定和優化軌跡預測。

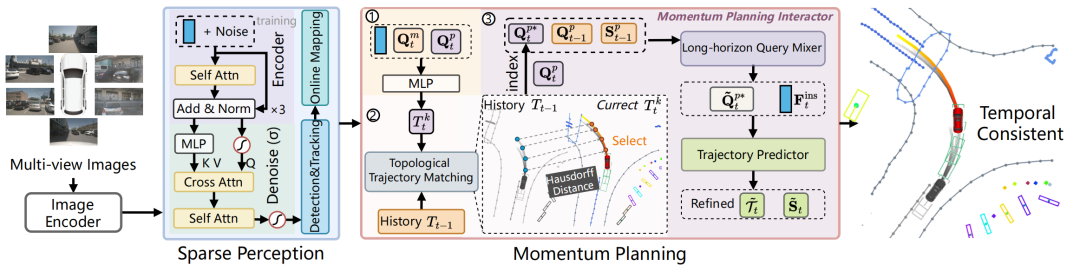

MomAD包含兩個核心組件:一是拓撲軌跡匹配(TTM),采用豪斯多夫距離選擇與先前路徑一致的最優規劃查詢,以確保連貫性;二是動量規劃交互器(MPI),通過交叉注意力機制將選定的規劃查詢與歷史查詢相結合,擴展靜態和動態感知文件。這種豐富的查詢反過來有助于重新生成長時間跨度的軌跡,并降低碰撞風險。為了減輕動態環境和檢測誤差帶來的噪聲,我們在訓練過程中引入了魯棒的實例去噪,使規劃模型能夠專注于關鍵信號并提高其魯棒性。我們還提出了一種新的軌跡預測一致性(TPC)指標,用于定量評估規劃的穩定性。

在nuScenes數據集上的實驗表明,MomAD在長期一致性(>3s)方面優于現有的最先進方法。此外,在精心設計的Turning-nuScenes數據集上的評估顯示,MomAD在6秒預測時間范圍內將碰撞率降低了26%,并將TPC提高了0.97米(33.45%),而在Bench2Drive上的閉環測試中,成功率提高了16.3%。

? 論文鏈接:

https://arxiv.org/abs/2503.03125

?論文代碼:

https://github.com/adept-thu/MomAD

研究背景

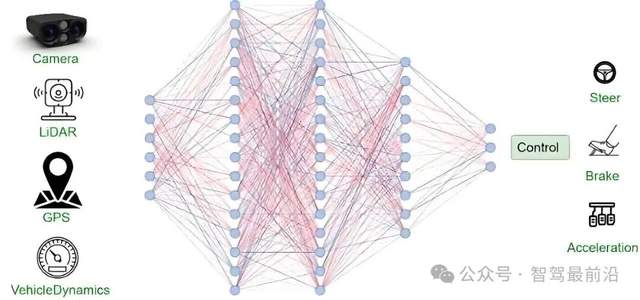

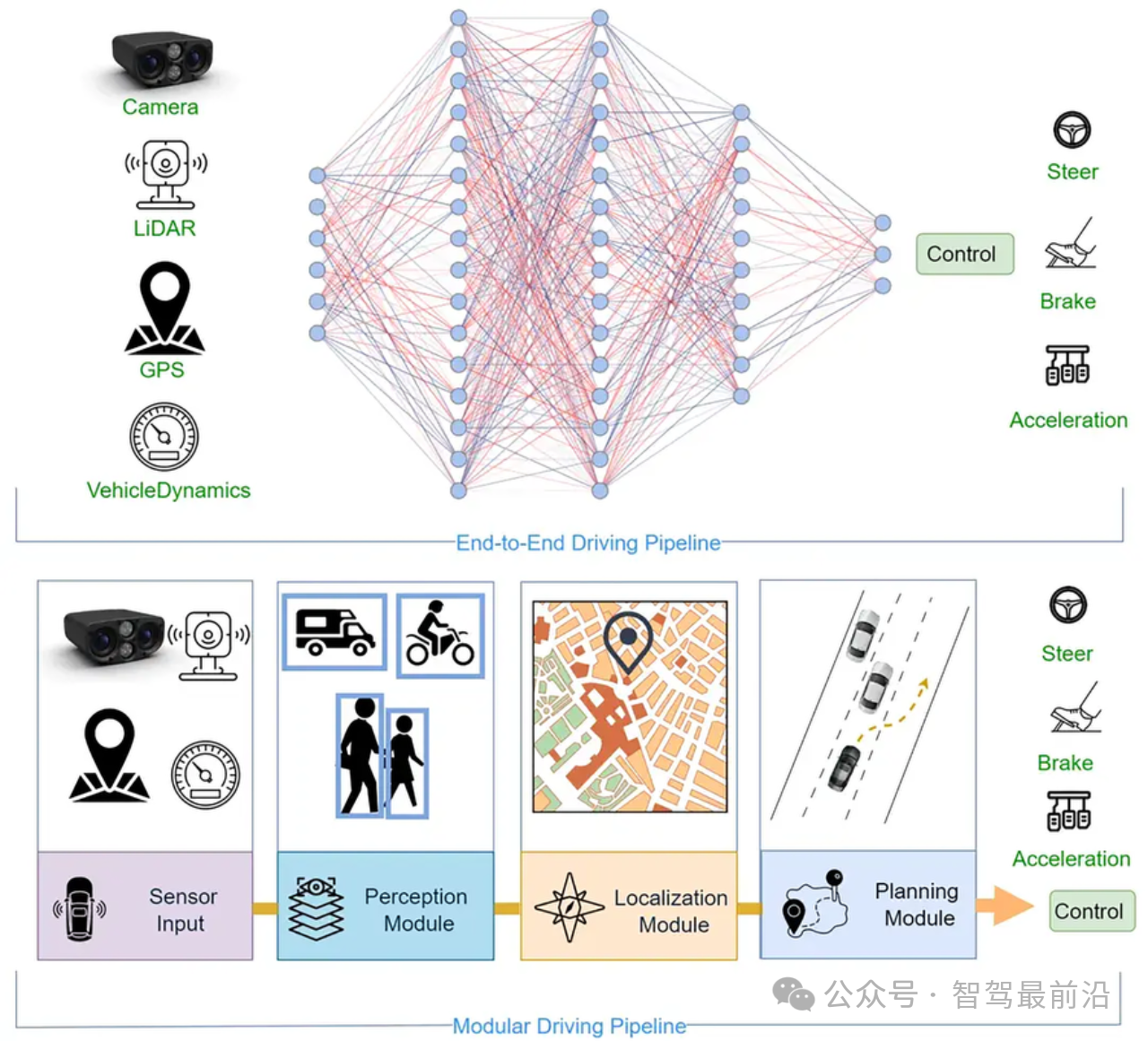

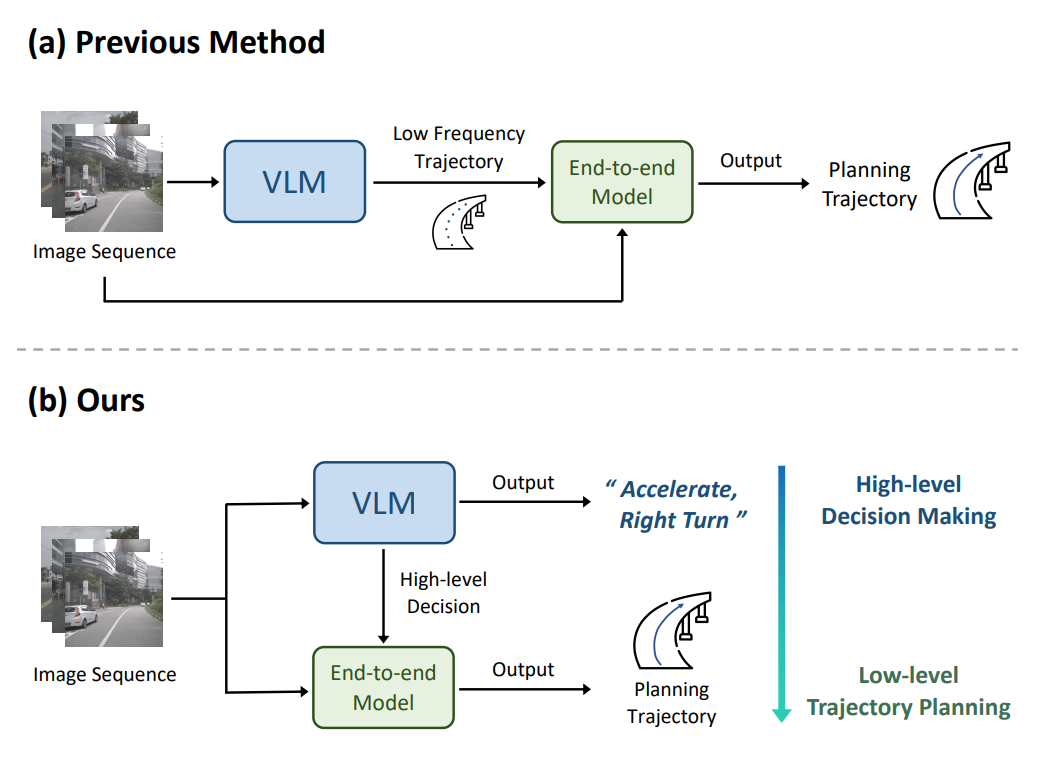

自動駕駛技術經歷了從模塊化到更集成化的端到端范式的轉變。傳統方法將檢測、跟蹤、地圖構建、運動預測和規劃等任務分開處理,而端到端框架則強調這些任務的無縫集成。通過優先考慮規劃,端到端框架能夠戰略性地引導來自上游感知模塊的信息,從而增強動態駕駛環境中的魯棒性和可靠性。高質量的規劃依賴于準確預測自車未來的軌跡,這需要對靜態和動態環境因素(如地圖元素和與周圍交通參與者的交互)有長遠的理解。

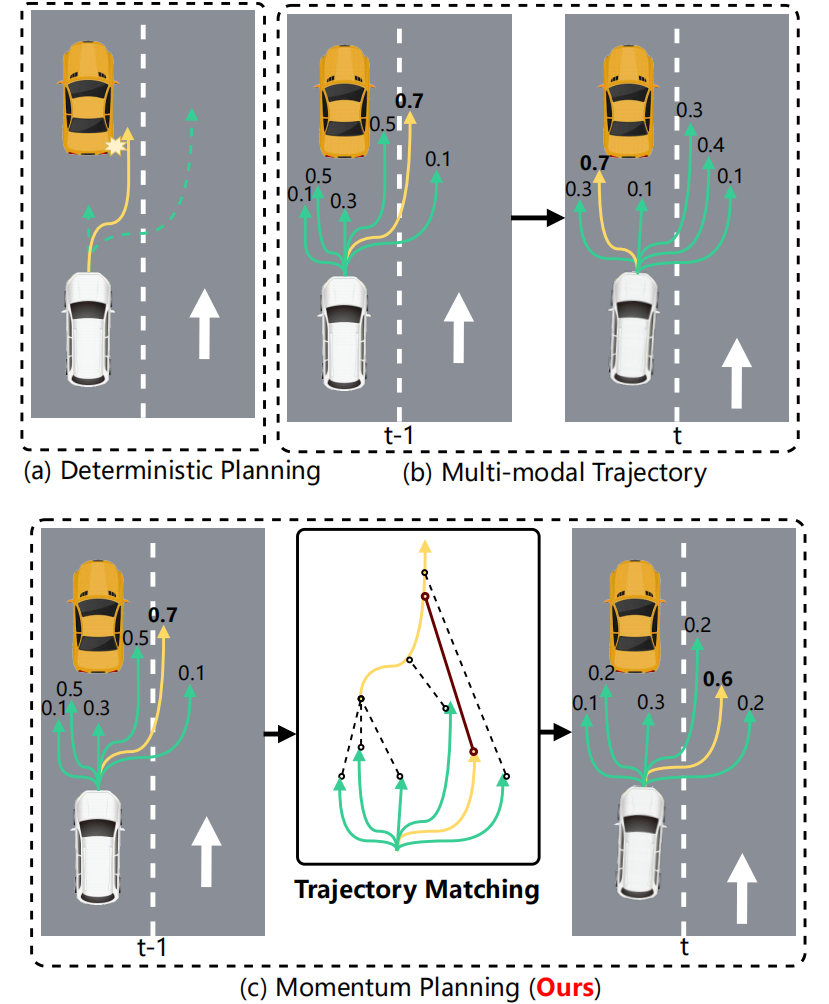

然而,由于其他道路使用者意圖的不確定性、道路條件的變化以及人類駕駛行為引入的模糊性,軌跡預測本質上是隨機的,這使得確定性預測變得次優甚至具有風險。現有的多模態軌跡規劃方法雖然能夠考慮多種可能的交通參與者行為,但它們通常是基于當前感知幀的一次性預測,容易受到遮擋或關鍵視覺線索丟失的影響,導致軌跡質量下降。此外,缺乏時間一致性可能導致連續軌跡缺乏連貫性,引發不穩定的車輛控制。為了解決這些問題,本文提出了動量感知駕駛框架 (MomAD) ,通過引入軌跡動量和感知動量來穩定和優化軌跡預測,從而在動態駕駛環境中實現更平滑和一致的規劃結果。

根據上圖對比我們可以看到,(a) 確定性規劃的方案,缺乏動作多樣性,存在安全風險;(b)多模態軌跡規劃方案,通過選擇最高分軌跡,但存在最大分數偏移問題導致穩定性不足;(c)我們提出的MomAD巧妙利用“慣性”的思想,通過動量規劃,利用歷史和感知動量提升時序一致性,解決端到端自動駕駛中不穩定行駛的問題。

研究方法

Topological Trajectory Matching

該模塊通過Hausdorff距離選擇與歷史路徑最匹配的多模態軌跡提案,以確保時序一致性和軌跡的連續性。具體來說,TTM模塊通過最小化不同時間步之間的規劃差異,防止軌跡偏離歷史軌跡。

Momentum Planning Interactor

該模塊通過長時查詢混合器將當前最佳規劃查詢與歷史規劃查詢進行交叉注意力處理,擴展靜態和動態感知文件,從而豐富當前查詢的上下文信息。MPI模塊通過結合歷史查詢和當前查詢,生成改進的軌跡預測,增強了對周圍環境的感知能力。

Robust Instance Denoising via

Perturbation

在訓練過程中引入受控噪聲擾動,使模型能夠區分關鍵和無關特征,提高對感知噪聲的魯棒性。通過這種方式,模型在測試時能夠更好地應對實例特征的波動,生成更穩定和平滑的軌跡。

結果與分析

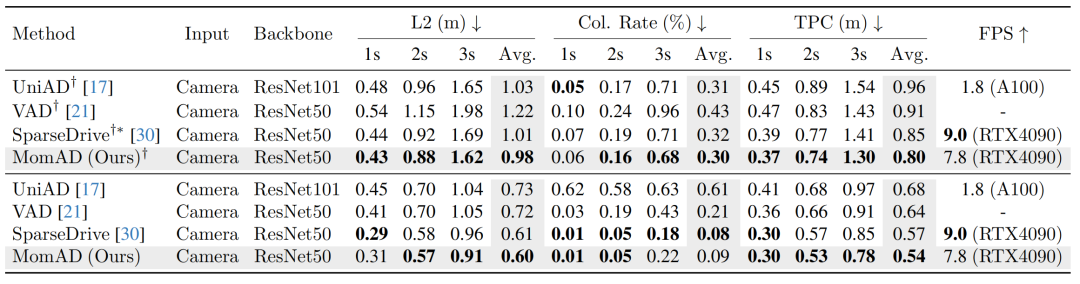

如表所示,MomAD在L2誤差、碰撞率和TPC(軌跡預測一致性)上分別達到了0.60米、0.09%和0.54米。與UniAD、VAD和SparseDrive等最先進方法相比,我們的方法在規劃結果上表現出色。值得注意的是,我們在TPC指標上取得了顯著改進,在nuScenes數據集上1秒、2秒和3秒的TPC分別提升了0.30米、0.53米和0.78米,直接證明了我們在時間一致性方面的有效性。

總體而言,MomAD有效利用了動量的平滑優勢,在提升時間一致性方面效果顯著。

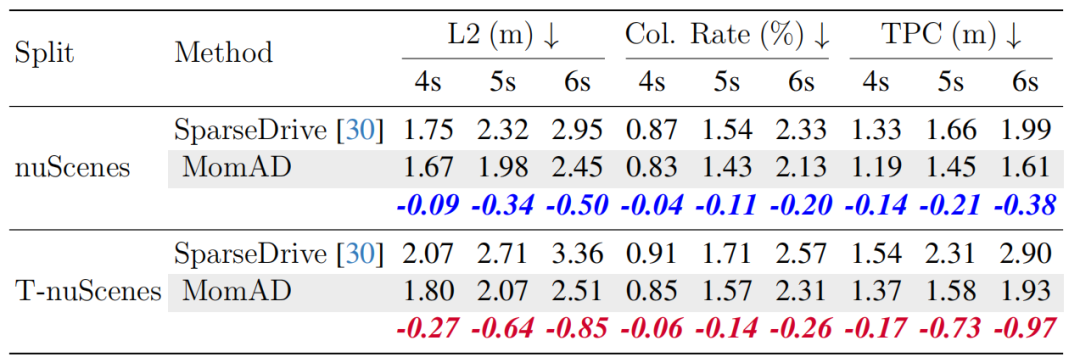

準確的長軌跡預測對于提升自動駕駛的穩定性至關重要,同時也有助于評估模型解決多模態軌跡規劃中時間一致性問題的能力。如表所示,我們在nuScenes和Turning-nuScenes數據集上對比了SparseDrive和MomAD在4-6秒長軌跡預測中的表現,結果顯示MomAD在性能上有顯著提升。

具體而言,在nuScenes數據集中,與SparseDrive相比,MomAD在4秒、5秒和6秒的L2誤差分別降低了0.09米(5.14%)、0.34米(14.66%)和0.50米(16.95%),碰撞率分別降低了0.04%、0.11%和0.20%,TPC(軌跡預測一致性)分別降低了0.14米(10.53%)、0.21米(12.65%)和0.38米(19.10%)。

此外,在Turning-nuScenes數據集中,與SparseDrive相比,MomAD在4秒、5秒和6秒的L2誤差分別降低了0.27米(13.04%)、0.64米(23.62%)和0.85米(25.30%),碰撞率分別降低了0.06%、0.14%和0.26%,TPC分別降低了0.17米(11.04%)、0.73米(31.60%)和0.97米(32.45%)。

可以觀察到,MomAD在更遠距離的軌跡預測上表現顯著提升,尤其是在6秒時的改進幅度最大。總體而言,MomAD提升了長軌跡預測的性能,進一步證明了其能夠有效緩解時間一致性問題。

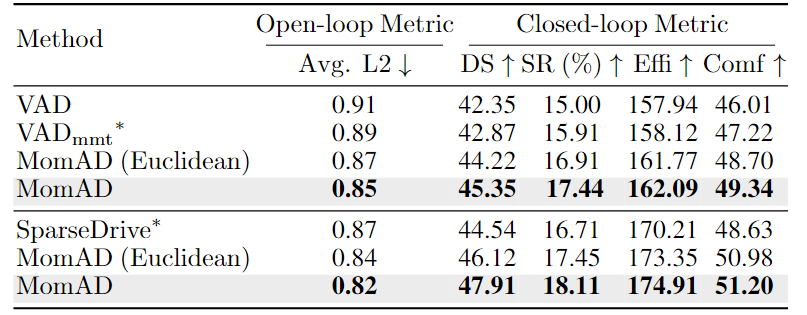

我們已在Bench2Drive數據集上進行了具有挑戰性的閉環評估,結果如表所示。該數據集涵蓋44個交互場景,例如切入、超車、繞行,以及220條路線,覆蓋多種天氣條件和地點。我們的MomAD框架在成功率上分別比VAD多模態變體和SparseDrive分別提高了16.3%和8.4%,并在舒適度評分(軌跡平滑度)上分別提升了7.2%和5.3%,證明了其有效性。

結論

MomAD框架通過引入軌跡動量和感知動量,顯著提高了端到端自動駕駛系統在軌跡規劃中的穩定性和魯棒性。未來工作將探索擴散模型和推測解碼方法,以進一步提高軌跡多樣性和效率。

.

-

模型

+關注

關注

1文章

3781瀏覽量

52200 -

數據集

+關注

關注

4文章

1238瀏覽量

26241 -

自動駕駛

+關注

關注

794文章

14931瀏覽量

180694

原文標題:CVPR 2025|MomAD:動量感知規劃的端到端自動駕駛

文章出處:【微信號:horizonrobotics,微信公眾號:地平線HorizonRobotics】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

自動駕駛技術的實現

基于矢量化場景表征的端到端自動駕駛算法框架

端到端自動駕駛技術研究與分析

Nullmax端到端自動駕駛最新研究成果入選ICCV 2025

端到端自動駕駛相較傳統自動駕駛到底有何提升?

一文讀懂特斯拉自動駕駛FSD從輔助到端到端的演進

動量感知規劃的端到端自動駕駛框架MomAD解析

動量感知規劃的端到端自動駕駛框架MomAD解析

評論