訓(xùn)練數(shù)據(jù)仍然需要大量的人工,為進一步減少這一部分的人工,我們對弱標(biāo)注數(shù)據(jù)下的深度學(xué)習(xí)進行了一些探索。隨著所要求監(jiān)督信息的減弱,可用訓(xùn)練數(shù)據(jù)會大量增加。同時,深度模型已經(jīng)具有了很好的推廣能力,我們用深度

2017-03-22 17:16:00

深度學(xué)習(xí)的概念源于人工神經(jīng)網(wǎng)絡(luò)的研究。含多隱層的多層感知器就是一種深度學(xué)習(xí)結(jié)構(gòu)。深度學(xué)習(xí)通過組合低層特征形成更加抽象的高層表示屬性類別或特征,以發(fā)現(xiàn)數(shù)據(jù)的分布式特征表示。晦澀難懂的概念,略微有些難以

2018-07-04 16:07:53

算法性能。換而言之,開發(fā)集和測試集的使命就是引導(dǎo)你的團隊對機器學(xué)習(xí)系統(tǒng)做出最重要的改變?。所以你應(yīng)當(dāng)這樣處理:合理地選擇開發(fā)集和測試集,使之能夠代表將來實際數(shù)據(jù)的情況,并期望算法能夠運行良好。也就是說你

2018-11-30 16:58:52

深度學(xué)習(xí)入門 中根據(jù)源代碼下載到mnist數(shù)據(jù)集,訓(xùn)練識別率超級低問題

2020-07-08 16:53:17

深度學(xué)習(xí)常用模型有哪些?深度學(xué)習(xí)常用軟件工具及平臺有哪些?深度學(xué)習(xí)存在哪些問題?

2021-10-14 08:20:47

深度融合模型的特點,背景深度學(xué)習(xí)模型在訓(xùn)練完成之后,部署并應(yīng)用在生產(chǎn)環(huán)境的這一步至關(guān)重要,畢竟訓(xùn)練出來的模型不能只接受一些公開數(shù)據(jù)集和榜單的檢驗,還需要在真正的業(yè)務(wù)場景下創(chuàng)造價值,不能只是為了PR而

2021-07-16 06:08:20

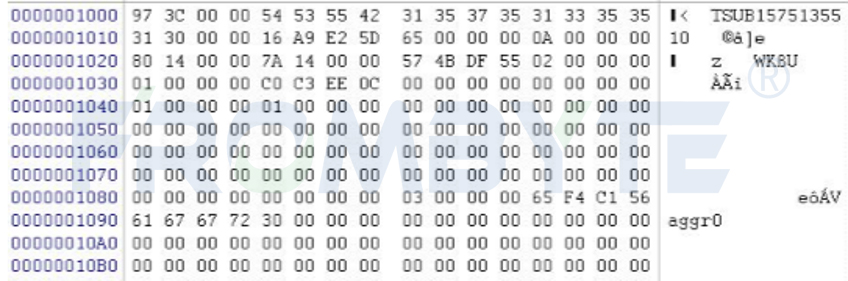

在串口控制中,如果想用read把緩存全部的數(shù)據(jù)讀取出來,用圖中的結(jié)構(gòu)即可。開始當(dāng)用GPIB控制時,應(yīng)該用什么方法把緩存的數(shù)據(jù)全部讀出來呢?求教!

2016-10-28 11:27:30

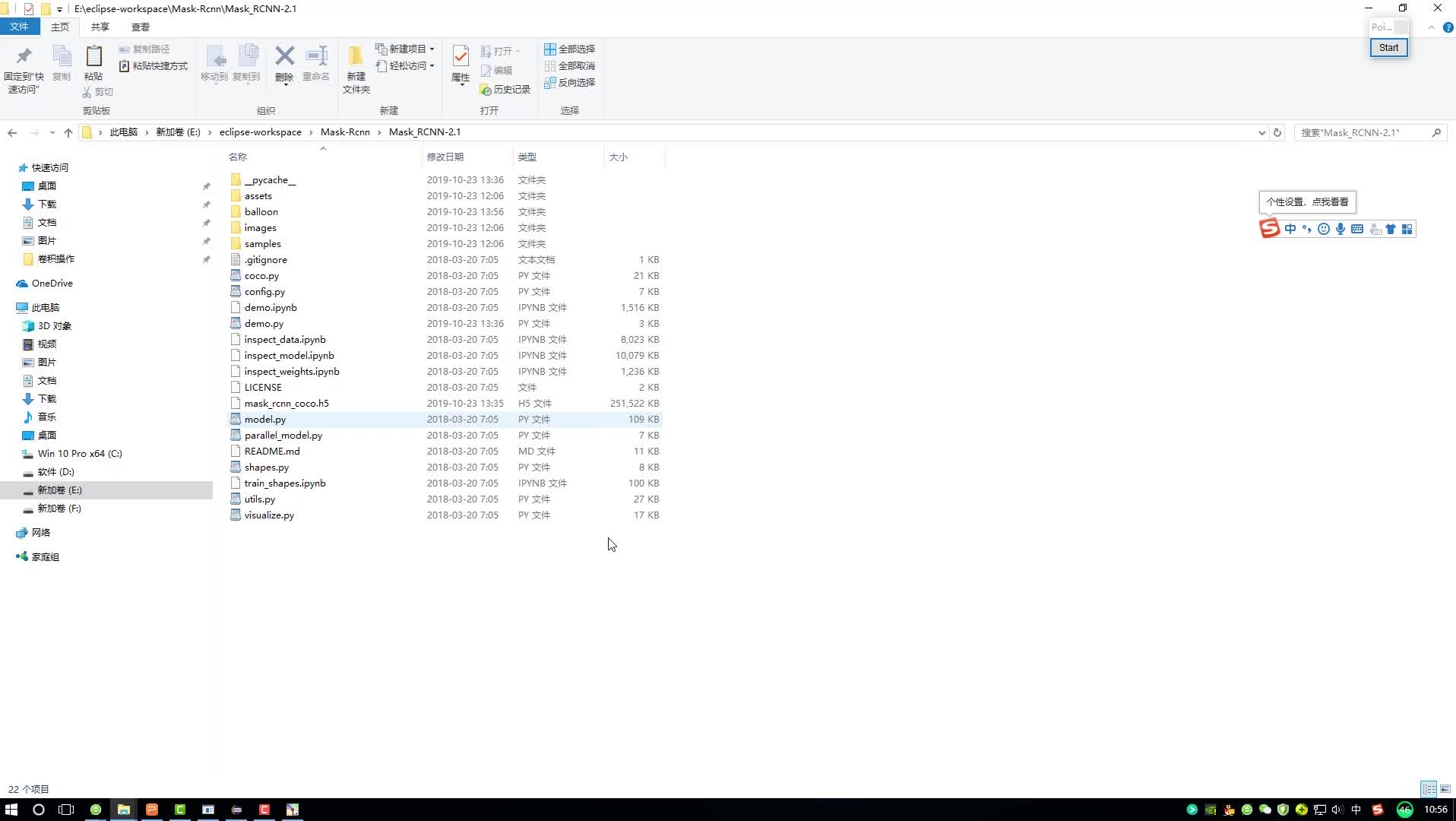

CV之YOLOv3:深度學(xué)習(xí)之計算機視覺神經(jīng)網(wǎng)絡(luò)Yolov3-5clessses訓(xùn)練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:51:47

CV之YOLO:深度學(xué)習(xí)之計算機視覺神經(jīng)網(wǎng)絡(luò)tiny-yolo-5clessses訓(xùn)練自己的數(shù)據(jù)集全程記錄

2018-12-24 11:50:57

LabVIEW讀取示波器發(fā)過來的數(shù)據(jù),每次只能讀去1000個點,但是示波器數(shù)據(jù)的存儲深度遠(yuǎn)遠(yuǎn)大于1000,請問怎樣可以改變LabVIEW讀取示波器數(shù)據(jù)的存儲深度?

2012-07-14 08:58:32

《實戰(zhàn)Google深度學(xué)習(xí)框架》之RNN學(xué)習(xí)筆記2 LSTM對PTB數(shù)據(jù)集的建模

2019-09-26 16:21:19

的網(wǎng)絡(luò)結(jié)構(gòu)。當(dāng)然,深度學(xué)習(xí)的方法用來檢測,也有自己的很多缺點。例如:數(shù)據(jù)量要求大,工業(yè)數(shù)據(jù)收集成本高。但是隨著數(shù)據(jù)增強技術(shù),無監(jiān)督學(xué)習(xí)的不斷進步,在某些應(yīng)用場景上,這些缺點漸漸被隱藏了。例如學(xué)術(shù)界正在研究

2021-05-10 22:33:46

算法。其編程特點是上手快,開發(fā)效率高,兼容性強,能快速調(diào)用c++,c#等平臺的dll類庫。如何將labview與深度學(xué)習(xí)結(jié)合起來,來解決視覺行業(yè)越來越復(fù)雜的應(yīng)用場景所遇到的困難。下面以開關(guān)面板為例講解

2020-07-23 20:33:10

計算的研究者,二是希望為現(xiàn)實世界中的新應(yīng)用來部署這些模型的應(yīng)用科學(xué)家。然而,他們都面臨著一個限制條件,即硬件加速能力仍需加強,才可能滿足擴大現(xiàn)有數(shù)據(jù)和算法規(guī)模的需求。對于深度學(xué)習(xí)來說,目前硬件加速

2018-08-13 09:33:30

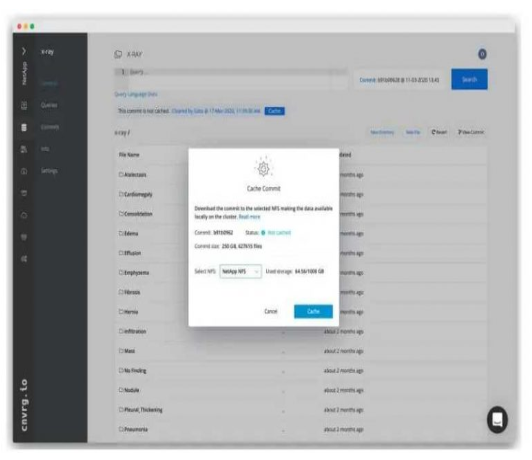

起因是現(xiàn)在平臺限制了圖片數(shù)量,想要本地訓(xùn)練下載數(shù)據(jù)集時發(fā)現(xiàn)只會跳出網(wǎng)絡(luò)異常的錯誤,請問這有什么解決辦法?

2025-07-22 06:03:52

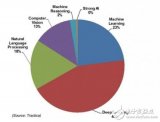

人工智能、數(shù)據(jù)挖掘、機器學(xué)習(xí)和深度學(xué)習(xí)之間,主要有什么關(guān)系?

2020-03-16 11:35:54

準(zhǔn)確的模型。有了上述機制,現(xiàn)在可以通過讓神經(jīng)網(wǎng)絡(luò)模型學(xué)習(xí)各種問題來自動解決問題,創(chuàng)建高精度模型,并對新數(shù)據(jù)進行推理。然而,由于單個神經(jīng)網(wǎng)絡(luò)只能解決簡單的問題,人們嘗試通過構(gòu)建深度神經(jīng)網(wǎng)絡(luò) (DNN

2023-02-17 16:56:59

,labview訓(xùn)練和調(diào)用的編程方法,還講解了大量的案例,手把手幫助學(xué)員學(xué)會如何在labview中應(yīng)用深度學(xué)習(xí)6、課程贈送相關(guān)工業(yè)圖像數(shù)據(jù)集,其價值遠(yuǎn)遠(yuǎn)大于課程本身。2、用戶購買后,將會獲得哪些收益?1

2020-08-10 10:38:12

應(yīng)用程序,能夠處理包括跨大型數(shù)據(jù)集的交互式查詢,來自傳感器或金融系統(tǒng)的流數(shù)據(jù)以及機器學(xué)習(xí)任務(wù),且Spark將數(shù)據(jù)集緩存在內(nèi)存中的能力大大加快了迭代數(shù)據(jù)處理速度,使得Spark成為實現(xiàn)迭代

2018-04-10 16:05:02

支持labview的便攜手持終端有哪些?想弄個計算系統(tǒng)(只計算用,不采集數(shù)據(jù))想用labview開發(fā),但不知道哪些終端好用,用過的朋友給些建議!野外勘探輸出大約9個數(shù)據(jù),計算出3個數(shù)據(jù),如果有其他易開發(fā)的其他平臺終端也行。

2013-08-22 15:27:10

想使用labview弄一個數(shù)據(jù)庫和串口通信,把怎么樣把它們連接到一起.就是可以用串口緩存的數(shù)據(jù)放入數(shù)據(jù)庫!本人菜鳥,求大神!

2015-04-30 12:30:22

使得實現(xiàn)復(fù)雜的 DNN 結(jié)構(gòu)成為可能,而不需要深入復(fù)雜的數(shù)學(xué)細(xì)節(jié),大數(shù)據(jù)集的可用性為 DNN 提供了必要的數(shù)據(jù)來源。TensorFlow 成為最受歡迎的深度學(xué)習(xí)庫,原因如下:TensorFlow 是一個

2020-07-28 14:34:04

`深度學(xué)習(xí)領(lǐng)域的“Hello World!”,入門必備!MNIST是一個手寫數(shù)字數(shù)據(jù)庫,它有60000個訓(xùn)練樣本集和10000個測試樣本集,每個樣本圖像的寬高為28*28。此數(shù)據(jù)集是以二進制存儲

2018-08-29 10:36:45

,我們在創(chuàng)建新磁盤以及映射物理分區(qū)時,都會看到設(shè)置緩存大小的地方,這里就是深度無盤程序里面自帶的IO讀緩存,這里說下讀緩存的作用:服務(wù)端讀緩存提升了服務(wù)器數(shù)據(jù)吞讀能力,有效提高了客戶機數(shù)據(jù)讀取速度,使

2011-07-15 13:24:41

在這些存儲技術(shù)中使用最廣的就是高速緩存(Cache)和磁盤冗余陣列(RAID)了,本文就將探討緩存和磁盤陣列提高存儲IO性能的方法。

2011-03-28 11:56:49 3590

3590 為幫助數(shù)據(jù)科學(xué)家和開發(fā)人員充分利用深度學(xué)習(xí)領(lǐng)域中的機遇,NVIDIA為其深度學(xué)習(xí)軟件平臺發(fā)布了三項重大更新,它們分別是NVIDIA DIGITS 4、CUDA深度神經(jīng)網(wǎng)絡(luò)庫(cuDNN)5.1和全新的GPU推理引擎(GIE)。

NVIDIA深度學(xué)習(xí)軟件平臺推三項重大更新

2016-08-06 15:00:26 2307

2307 NetApp_FAS62000_系列數(shù)據(jù)手冊

2016-12-28 14:54:09 0

0 NetApp_FlexPod_Datacenter_平臺的總體經(jīng)濟影響

2016-12-28 14:54:09 0

0 利用_NetApp_存儲改善數(shù)據(jù)庫環(huán)境

2016-12-28 11:13:11 0

0 現(xiàn)在都在談?wù)撊斯ぶ悄芑蛘叽?b class="flag-6" style="color: red">數(shù)據(jù)相關(guān)的知識,但是與之相關(guān)的機器學(xué)習(xí)、深度學(xué)習(xí)等你能分清嗎?數(shù)據(jù)科學(xué)比機器學(xué)習(xí)范圍大得多,數(shù)據(jù)科學(xué)實際上涵蓋了整個數(shù)據(jù)處理的范圍,而不只是算法或者統(tǒng)計學(xué)方面。

2017-12-18 16:28:50 1096

1096

從Python菜鳥到Python Kaggler的旅程(譯注:kaggle是一個數(shù)據(jù)建模和數(shù)據(jù)分析競賽平臺)

假如你想成為一個數(shù)據(jù)科學(xué)家,或者已經(jīng)是數(shù)據(jù)科學(xué)家的你想擴展你的技能,那么你已經(jīng)來對地

2018-01-25 17:03:15 0

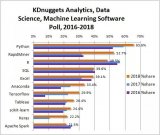

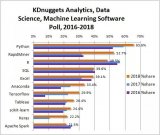

0 近日,kdnuggets做了一個關(guān)于數(shù)據(jù)科學(xué)、機器學(xué)習(xí)語言使用情況的問卷調(diào)查,他們分析了954個回答,得出結(jié)論——Python已經(jīng)打敗R語言,成為分析、數(shù)據(jù)科學(xué)和機器學(xué)習(xí)平臺中使用頻率最高的語言。

2018-06-28 08:33:00 2349

2349 用Redis作Mysql數(shù)據(jù)庫緩存,必須解決2個問題。首先,應(yīng)該確定用何種數(shù)據(jù)結(jié)構(gòu)存儲來自Mysql的數(shù)據(jù);在確定數(shù)據(jù)結(jié)構(gòu)之后,還要考慮用什么標(biāo)識作為該數(shù)據(jù)結(jié)構(gòu)的鍵。

2018-02-09 15:42:09 4462

4462 在小數(shù)據(jù)上能更好地工作:為了實現(xiàn)高性能,深度學(xué)習(xí)需要非常大的數(shù)據(jù)集。之前提到的預(yù)訓(xùn)練的網(wǎng)絡(luò)在120萬張圖像上進行了訓(xùn)練。對于許多應(yīng)用來說,這樣大的數(shù)據(jù)集是不容易獲得的,花費昂貴而且耗時。對于較小的數(shù)據(jù)集,經(jīng)典的ML算法通常優(yōu)于深度學(xué)習(xí)。

2018-04-10 17:34:29 27195

27195

這是用于開發(fā)物體檢測算法的真實世界圖像數(shù)據(jù)集。這些只需要最少的數(shù)據(jù)預(yù)處理。它與本列表中提到的MNIST數(shù)據(jù)集類似,但擁有更多標(biāo)簽數(shù)據(jù)(超過600,000個圖像)。這些數(shù)據(jù)是從谷歌街景中查看的房屋號碼中收集的。

2018-04-27 16:28:25 13255

13255 渲染涉及大量的緩存,這里緩存只是一個簡單的存有像素數(shù)據(jù)的矩形內(nèi)存塊,最重要緩存是幀緩存和深度緩存。

2018-05-14 11:44:45 7753

7753

比較深入學(xué)習(xí)算法的IO模式,可以發(fā)現(xiàn)它與傳統(tǒng)工程師、HPC和企業(yè)應(yīng)用程序的做法幾乎完全相反。深度學(xué)習(xí)非常重讀IO導(dǎo)向,數(shù)據(jù)在設(shè)計和訓(xùn)練模型時被重復(fù)使用。即使在模型被訓(xùn)練之后,仍然需要用新數(shù)據(jù)來增加現(xiàn)有的訓(xùn)練數(shù)據(jù)集,特別是模型輸出中的誤差。這是為了隨著時間的推移對模型進行的改進。

2018-05-23 11:19:40 4840

4840 近日,數(shù)據(jù)科學(xué)網(wǎng)站KDnuggets發(fā)布 2018年數(shù)據(jù)科學(xué)和機器學(xué)習(xí)工具調(diào)查結(jié)果。

2018-06-07 17:05:45 4989

4989

機器學(xué)習(xí)和數(shù)據(jù)科學(xué)的專家Emmanuel Ameisen分享了自己對深度學(xué)習(xí)的理解,用簡明扼要的方式為大家講述了深度學(xué)習(xí)的基本概念。

2018-06-12 19:00:20 5538

5538 Airbnb資深機器學(xué)習(xí)科學(xué)家Shijing Yao、前Airbnb數(shù)據(jù)科學(xué)負(fù)責(zé)人Qiang Zhu、Airbnb機器學(xué)習(xí)工程師Phillippe Siclait分享了在Airbnb產(chǎn)品上大規(guī)模應(yīng)用深度學(xué)習(xí)技術(shù)的經(jīng)驗。

2018-07-07 09:24:03 4413

4413 很多人意識到了創(chuàng)建項目的價值,但很多人碰到的問題是從哪里得到有趣的數(shù)據(jù)集,得到之后做什么。Airbnb的數(shù)據(jù)科學(xué)家Jason Goodman,在他的博客文章Advice on Building

2018-08-02 09:14:31 4340

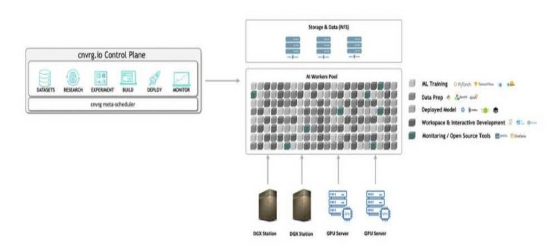

4340 NetApp宣布推出NetApp? ONTAP?AI架構(gòu),該架構(gòu)基于NVIDIA DGX?超級計算機和NetApp AFF A800云互聯(lián)全閃存存儲,可簡化、加速并擴展邊緣、核心及云端的數(shù)據(jù)管道以助力深度學(xué)習(xí)部署,并助力客戶通過AI在業(yè)務(wù)方面真正收獲成效。

2018-08-03 16:33:15 5199

5199 深度學(xué)習(xí),有太多令人驚嘆的能力!從12年的圖像識別開始,深度學(xué)習(xí)的一個個突破,讓人們一次又一次的刷新對它的認(rèn)知。然而,應(yīng)用深度學(xué)習(xí),一直有一個巨大的前提:大量標(biāo)注數(shù)據(jù)。但是難道數(shù)據(jù)少,就享受不到深度

2018-08-12 11:49:53 20301

20301 在無監(jiān)督式學(xué)習(xí)中,深度學(xué)習(xí)模型會收到某個數(shù)據(jù)集,但對于如何處理該數(shù)據(jù)集卻未獲得明確的指示。訓(xùn)練數(shù)據(jù)集是沒有特定預(yù)期結(jié)果或正確答案的示例的集合。然后,神經(jīng)網(wǎng)絡(luò)嘗試通過提取有用的特征并分析其結(jié)構(gòu)來自動發(fā)現(xiàn)數(shù)據(jù)結(jié)構(gòu)。

2018-09-06 16:15:14 3920

3920 本文檔的主要內(nèi)容詳細(xì)介紹的是Python工具包合集包括了:網(wǎng)頁爬蟲工具集,文本處理工具集,Python科學(xué)計算工具包,Python機器學(xué)習(xí)和數(shù)據(jù)挖掘 工具包

2018-09-07 17:14:42 39

39 在研究基于大數(shù)據(jù)框架將深度學(xué)習(xí)的分布式實現(xiàn)后,王萬良指出,人工智能是大數(shù)據(jù)分析領(lǐng)域的研究主流,基于深度學(xué)習(xí)的大數(shù)據(jù)分析方法發(fā)展最為迅速,GPU成為深度學(xué)習(xí)的更高效的硬件平臺,研究分布式計算智能優(yōu)化算法將解決大數(shù)據(jù)優(yōu)化問題,能夠提升算法的效果并降低計算復(fù)雜度。

2018-09-26 16:56:13 9587

9587 本文通過使用部署在多接入邊緣計算(MEC)結(jié)構(gòu)上的深度學(xué)習(xí)方法,為自動駕駛汽車提出了基于深度學(xué)習(xí)的緩存。通過仿真測試,結(jié)果發(fā)現(xiàn)該方法可以最大限度地減少延遲。

2018-10-10 09:26:32 5007

5007 2018年10月,IBM宣布計劃將全新RAPIDS? 開源軟件納入到其企業(yè)級數(shù)據(jù)科學(xué)平臺中,涵蓋本地預(yù)置、混合云和多云環(huán)境。憑借其龐大的深度學(xué)習(xí)與機器學(xué)習(xí)解決方案組合,IBM能為偏好不同部署模型的數(shù)據(jù)科學(xué)家提供這一開源技術(shù)。

2018-10-20 09:43:08 3409

3409 硬盤緩存一般指高速緩沖存儲器。本視頻主要詳細(xì)介紹了硬盤緩存有什么用,分別有預(yù)讀取、是對寫入動作進行緩存以及是臨時存儲最近訪問過的數(shù)據(jù)。

2018-11-10 10:31:44 23140

23140 典型的深度學(xué)習(xí)工作流程:數(shù)據(jù)從各個終端(或其他來源)匯聚到數(shù)據(jù)湖中。數(shù)據(jù)科學(xué)家可以使用筆記本進行數(shù)據(jù)探索,創(chuàng)建 pipelines 來進行特征提取/分割訓(xùn)練/測試數(shù)據(jù)集。 并開展深度學(xué)習(xí)和訓(xùn)練工作。 這些過程可以重復(fù)進行。因此,在同一個集群上運行深度學(xué)習(xí)作業(yè)可以顯著提高數(shù)據(jù)/計算資源共享的效率。

2019-01-15 16:29:19 4854

4854

本文介紹了包括圖像分類、交易預(yù)測、情感分類、推薦系統(tǒng)、股票預(yù)測等在內(nèi)的若干個機器學(xué)習(xí)應(yīng)用及數(shù)據(jù)集。

2019-04-21 11:01:14 4699

4699 具體來看,對于傳統(tǒng)的機器學(xué)習(xí)算法,模型的表現(xiàn)先是遵循冪定律(power law),之后趨于平緩;而對于深度學(xué)習(xí),該問題還在持續(xù)不斷地研究中,不過圖一為目前較為一致的結(jié)論,即隨著數(shù)據(jù)規(guī)模的增長,深度

2019-05-05 11:03:31 7090

7090 為什么要權(quán)衡這些問題其實不難理解,我們需要保持一致的環(huán)境,避免大型數(shù)據(jù)集跨不同集群之間的傳遞。此外,從現(xiàn)有的基礎(chǔ)設(shè)施中移動專有數(shù)據(jù)集也有安全風(fēng)險與隱患。早期時解決這些問題的方法是在 Spark 上直接加入深度學(xué)習(xí)框架

2019-07-18 14:21:38 4720

4720 如果你需要深度學(xué)習(xí)模型,那么 PyTorch 和 TensorFlow 都是不錯的選擇。

并非每個回歸或分類問題都需要通過深度學(xué)習(xí)來解決。甚至可以說,并非每個回歸或分類問題都需要通過機器學(xué)習(xí)來解決。畢竟,許多數(shù)據(jù)集可以用解析方法或簡單的統(tǒng)計過程進行建模。

2019-09-14 10:57:00 3931

3931 MathWorks與世界領(lǐng)先的在線學(xué)習(xí)平臺 Coursera今日宣布,雙方將攜手為彌補數(shù)據(jù)科學(xué)技能差距而共同努力。

2019-11-01 15:57:52 3467

3467 CORE通過端到端AI模型跟蹤和監(jiān)視來促進機器學(xué)習(xí)工作流管理。其內(nèi)置的群集編排支持混合云和多云配置,其計算查詢和自動擴展(可從儀表板進行微調(diào))可確保充分利用所有可用資源。

2020-04-09 14:32:37 2444

2444 作為云數(shù)據(jù)服務(wù)領(lǐng)域的領(lǐng)導(dǎo)者,NetApp宣布推出 Project Astra,其愿景是攜手 Kubernetes 社區(qū),開發(fā)軟件定義的平臺。

2020-04-30 11:53:14 3444

3444 百度飛槳是自主研發(fā)、開源開放、功能最完備的產(chǎn)業(yè)級深度學(xué)習(xí)平臺,集深度學(xué)習(xí)核心框架、基礎(chǔ)模型庫、端到端開發(fā)套件、工具組件和服務(wù)平臺于一體,包含完整的開發(fā)、訓(xùn)練、推理的端到端深度學(xué)習(xí)AI模型開發(fā)工具鏈。

2020-05-29 14:59:40 3477

3477 作為一門逐漸成熟的新興領(lǐng)域,與數(shù)據(jù)科學(xué)相關(guān)的很多領(lǐng)域開始變得備受青睞,比如數(shù)據(jù)工程,數(shù)據(jù)分析以及機器學(xué)習(xí)和深度學(xué)習(xí)。數(shù)據(jù)科學(xué)家們必須帶著具有科學(xué)性、創(chuàng)造性和研究性的思維,從各路數(shù)據(jù)集中提取有用信息,以解決客戶面臨的潛在挑戰(zhàn)。

2020-06-30 11:28:52 2880

2880 cnvrg.io用于機器學(xué)習(xí)的AI OS宣布將NVIDIA多實例GPU(MIG)技術(shù)與其數(shù)據(jù)科學(xué)平臺進行了原生集成。cnvrg.io是第一個集成MIG的ML平臺,這是一項突破性的新功能

2020-09-16 16:53:39 3013

3013 機器學(xué)習(xí)一詞經(jīng)常與AI互換使用,盡管有明顯的區(qū)別。機器學(xué)習(xí)算法使用機器來了解給定的數(shù)據(jù)集。機器學(xué)習(xí)的一個子集包括深度學(xué)習(xí),它在網(wǎng)絡(luò)安全領(lǐng)域顯示出了巨大的希望

2020-09-16 17:05:24 2663

2663 據(jù)國外媒體報道,英特爾繼續(xù)通過收購優(yōu)質(zhì)的初創(chuàng)公司,深耕機器學(xué)習(xí)和人工智能領(lǐng)域。該公司近日收購了一家以色列公司 Cnvrg.io——建立和運營一個供數(shù)據(jù)科學(xué)家構(gòu)建和運行機器學(xué)習(xí)模型的平臺,平臺可以追蹤和培訓(xùn)多個模型并對其進行比較,創(chuàng)建推薦等等。

2020-11-04 16:26:42 2507

2507 介紹并給出了顯著性圖,同時對三種類型方法進行了定性分析比較;然后簡單介紹了基于深度學(xué)習(xí)的顯著性目標(biāo)檢測常用的欻據(jù)集和評估準(zhǔn)則;接著對所提基于深度學(xué)習(xí)的昰著性目標(biāo)檢測方法在多個數(shù)據(jù)集上進行了性能比較,包括定量比較、

2021-04-01 14:58:13 0

0 機器學(xué)習(xí)是一門通過數(shù)據(jù)來教計算機解決問題的科學(xué),而不是編寫序列算法,讓指令逐個執(zhí)行。 一般來說,數(shù)據(jù)準(zhǔn)備是機器學(xué)習(xí)的首要任務(wù),通常包括兩個子步驟:創(chuàng)建數(shù)據(jù)集和轉(zhuǎn)換數(shù)據(jù)。 如果想構(gòu)建一個類似人類

2021-08-25 11:09:15 2187

2187 用Python學(xué)習(xí)科學(xué)編程,Python經(jīng)典教材。

2022-03-09 15:00:07 0

0 深度學(xué)習(xí)在軌跡數(shù)據(jù)挖掘中的應(yīng)用研究綜述 來源:《?計算機科學(xué)與應(yīng)用》?,作者 李旭娟 等 摘要:? 在過去十年,深度學(xué)習(xí)已被證明在很多領(lǐng)域應(yīng)用非常成功,如視覺圖像、自然語言處理、語音識別等,同時也

2022-03-08 17:24:10 2585

2585

Kubeflow是一個基于K8S的機器學(xué)習(xí)平臺,為開發(fā)者提供了從實驗(Notebook)、訓(xùn)練(MLOps流水線)、調(diào)優(yōu)以及部署、監(jiān)控的端到端能力,也是當(dāng)前排名第一的開源MlOps工具。

2022-10-26 10:20:44 1496

1496 和艾倫人工智能研究院(AI2)提出了首個標(biāo)注詳細(xì)解釋的多模態(tài)科學(xué)問答數(shù)據(jù)集 ScienceQA,用于測試模型的多模態(tài)推理能力。在 ScienceQA 任務(wù)中,作者提出 GPT-3 (CoT) 模型

2022-11-01 16:30:14 2336

2336 期待已久的機器學(xué)習(xí)時代終于到來了。深度學(xué)習(xí)技術(shù)對作戰(zhàn)人員的潛在好處既巨大又深遠(yuǎn)。隨著防御系統(tǒng)趨向于更大的應(yīng)用程序自主性,深度學(xué)習(xí)技術(shù)過于復(fù)雜,無法用更傳統(tǒng)的處理技術(shù)實現(xiàn),現(xiàn)在可以幫助顯著推動流

2022-11-02 09:48:53 1329

1329 機器學(xué)習(xí)應(yīng)用從開發(fā)到上線全流程(MLOps) OpenMLDB 是一個開源機器學(xué)習(xí)數(shù)據(jù)庫,提供線上線下一致的特征平臺

2023-03-31 15:43:35 0

0 其次,機器

學(xué)習(xí)和

深度學(xué)習(xí)的

數(shù)據(jù)傳輸需求也非常高。大規(guī)模的

數(shù)據(jù)集需要被傳輸?shù)接嬎銠C中進行處理,這對

數(shù)據(jù)傳輸?shù)乃俣群涂煽啃蕴岢隽藰O高的要求。傳統(tǒng)的

數(shù)據(jù)傳輸技術(shù),如以太網(wǎng)、PCIe等高速SerDes接口,已經(jīng)變成主流以滿足大量

數(shù)據(jù)傳輸及資料傳輸?shù)男枨蟆?/div>

2023-04-21 14:07:06 2198

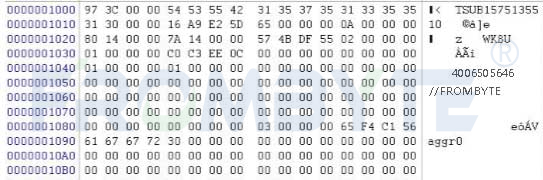

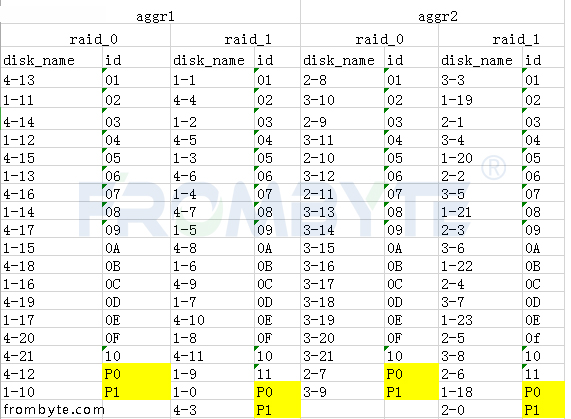

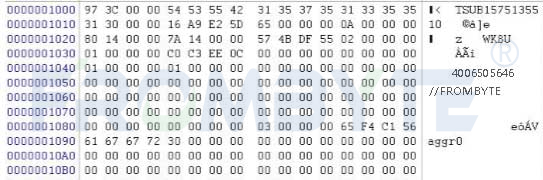

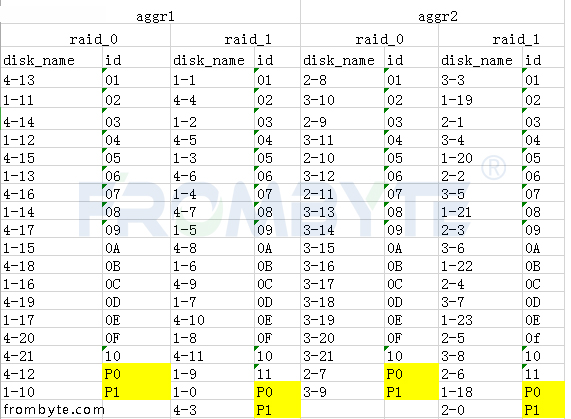

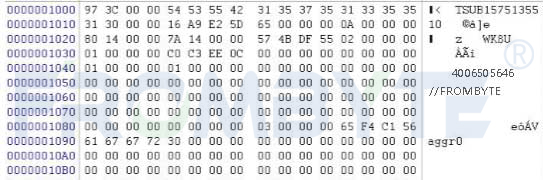

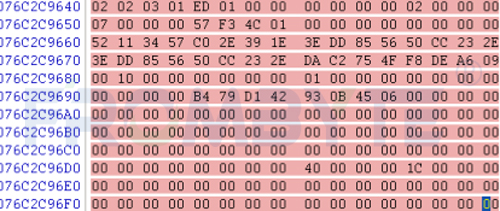

2198 存儲數(shù)據(jù)恢復(fù)環(huán)境:

NetApp存儲設(shè)備,WAFL文件系統(tǒng),底層是由多塊硬盤組建的raid磁盤陣列。

存儲故障:

工作人員誤操作導(dǎo)致NetApp存儲內(nèi)部分重要數(shù)據(jù)被刪除。

2023-05-08 13:58:38 1164

1164 深度學(xué)習(xí)框架的作用是什么 深度學(xué)習(xí)是一種計算機技術(shù),它利用人工神經(jīng)網(wǎng)絡(luò)來模擬人類的學(xué)習(xí)過程。由于其高度的精確性和精度,深度學(xué)習(xí)已成為現(xiàn)代計算機科學(xué)領(lǐng)域的重要工具。然而,要在深度學(xué)習(xí)中實現(xiàn)高度復(fù)雜

2023-08-17 16:10:57 2407

2407 混合和多云部署模型是企業(yè)IT組織的新常態(tài)。隨著這些復(fù)雜的環(huán)境,圍繞數(shù)據(jù)管理的新挑戰(zhàn)出現(xiàn)了。NetApp的數(shù)據(jù)管理愿景是一種無縫連接不同的數(shù)據(jù)結(jié)構(gòu)云,無論它們是私有環(huán)境、公共環(huán)境還是混合環(huán)境。數(shù)據(jù)

2023-08-25 17:15:02 0

0 電子發(fā)燒友網(wǎng)站提供《可用性和業(yè)務(wù)連續(xù)性與NetApp的數(shù)據(jù)結(jié)構(gòu)和NetApp-Brocade 7840擴展的解決方案.pdf》資料免費下載

2023-08-30 09:37:47 0

0 Netapp存儲數(shù)據(jù)恢復(fù)環(huán)境:

北京某公司一臺netAPP存儲,72塊SAS硬盤劃分了若干個lun。

Netapp存儲故障:

工作人員誤操作刪除了12個lun。

2023-10-13 16:13:55 998

998

某單位一臺Netapp存儲,該Netapp存儲內(nèi)共有數(shù)十塊SAS硬盤。

工作人員誤操作刪除了Netapp存儲中12個lun,刪除的數(shù)據(jù)包括客戶信息和其他重要數(shù)據(jù)。

2024-01-04 15:26:55 992

992

NetApp數(shù)據(jù)恢復(fù)環(huán)境:

NetApp某型號存儲,存儲中有數(shù)十塊SAS硬盤,該型號NetApp存儲硬盤是扇區(qū)大小是520字節(jié)。存儲中的lun都映射給小型機使用,存放Oracle數(shù)據(jù)庫文件,采用

2024-01-11 11:40:52 951

951

隨著科技的飛速發(fā)展,物聯(lián)網(wǎng)平臺已經(jīng)成為了我們生活中不可或缺的一部分。IO數(shù)據(jù)采集物聯(lián)網(wǎng)平臺作為一種高效的數(shù)據(jù)采集和分析工具,在越來越多行業(yè)場景得到應(yīng)用。對此,數(shù)之能提供具備IO數(shù)據(jù)采集的軟硬件一體化

2024-01-25 17:09:56 962

962 NetApp存儲數(shù)據(jù)恢復(fù)環(huán)境:

北京某公司的一臺NetApp某型號存儲,通過96塊磁盤組建了兩組存儲池,這2組存儲池互為鏡像。存儲池內(nèi)劃分卷并映射到ESXI作為數(shù)據(jù)存儲使用,卷內(nèi)有幾百臺虛擬機

2024-03-07 15:42:59 870

870

NetApp存儲數(shù)據(jù)恢復(fù)環(huán)境:

NetApp FAS某型號存儲,該NetApp存儲中有96塊扇區(qū)大小是520字節(jié)的SAS硬盤。存儲中的lun都映射給小型機使用,存放Oracle數(shù)據(jù)庫文件,采用

2024-04-18 15:52:58 925

925

某公司NetApp存儲設(shè)備,人為誤操作導(dǎo)致NetApp存儲內(nèi)部分重要數(shù)據(jù)被刪除,該NetApp存儲采用WAFL文件系統(tǒng),底層是由多塊硬盤組成的raid陣列。

2024-05-13 10:50:46 819

819 IO數(shù)據(jù)采集物聯(lián)網(wǎng)平臺是一種結(jié)合了物聯(lián)網(wǎng)技術(shù)的數(shù)據(jù)采集系統(tǒng),它能夠連接到互聯(lián)網(wǎng)并進行雙向通信。這種平臺不僅能夠從各種傳感器和設(shè)備收集數(shù)據(jù)(輸入),還能夠基于這些數(shù)據(jù)產(chǎn)生控制信號并發(fā)送到這些設(shè)備(輸出

2024-06-13 10:12:10 1054

1054 PyTorch是一個廣泛使用的深度學(xué)習(xí)框架,它以其靈活性、易用性和強大的動態(tài)圖特性而聞名。在訓(xùn)練深度學(xué)習(xí)模型時,數(shù)據(jù)集是不可或缺的組成部分。然而,很多時候,我們可能需要使用自己的數(shù)據(jù)集而不是現(xiàn)成

2024-07-02 14:09:41 4635

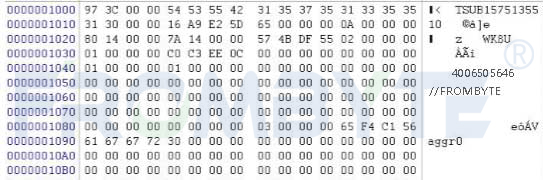

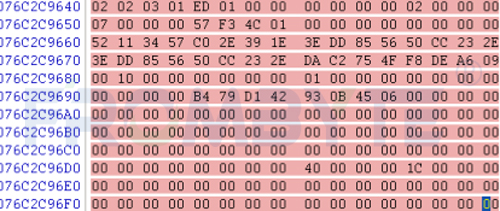

4635 某公司一臺NetApp存儲,該存儲中有24塊磁盤。

工作人員誤刪除了NetApp存儲中一個文件夾,文件夾中有非常重要的數(shù)據(jù)。

數(shù)據(jù)恢復(fù)工程師在現(xiàn)場對該存儲進行了初檢。雖然這個文件夾被刪除很長時間,但是根據(jù)NetApp存儲中的WAFL文件系統(tǒng)的特性,刪除數(shù)據(jù)被覆蓋的可能性不大,可以嘗試恢復(fù)數(shù)據(jù)。

2024-08-12 13:35:13 759

759

NetApp某型號存儲,WAFL文件系統(tǒng)。

工作人員誤操作將該NetApp存儲中的重要數(shù)據(jù)刪除。

2024-10-11 14:17:45 728

728 MLOps平臺在提升機器學(xué)習(xí)模型的開發(fā)與部署效率、可擴展性與靈活性、透明度與可重復(fù)性以及降低風(fēng)險和持續(xù)改進方面具有顯著優(yōu)點。

2024-11-06 10:10:11 690

690 云原生MLOps平臺,是指利用云計算的基礎(chǔ)設(shè)施和開發(fā)工具,來構(gòu)建、部署和管理機器學(xué)習(xí)模型的全生命周期的平臺。以下,是對云原生MLOps平臺的介紹,由AI部落小編整理。

2024-12-12 13:13:39 902

902 MLOps平臺作為機器學(xué)習(xí)開發(fā)運維一體化的重要工具,其發(fā)展方向?qū)⑸羁逃绊懭斯ぶ悄芗夹g(shù)的普及和應(yīng)用。下面,是對MLOps平臺發(fā)展方向的探討,由AI部落小編整理。

2024-12-31 11:51:09 900

900 MLOps托管服務(wù)以其卓越的性能和顯著的優(yōu)勢,成為企業(yè)加速機器學(xué)習(xí)應(yīng)用落地的理想選擇。以下,是對MLOps托管服務(wù)優(yōu)勢的介紹,由AI部落小編整理。

2025-01-22 10:21:15 507

507 在MLOps平臺的選擇上,開源平臺因其成本效益、靈活性以及社區(qū)支持等優(yōu)勢,受到了越來越多開發(fā)者和企業(yè)的青睞。那么,開源MLOps平臺真的好用嗎?下面,AI部落小編帶您了解。

2025-03-05 11:09:56 581

581 IO數(shù)據(jù)采集物聯(lián)網(wǎng)平臺是一種專門用于采集、處理、分析和管理來自各種物聯(lián)網(wǎng)設(shè)備的輸入輸出(IO)數(shù)據(jù)的軟件平臺。以下是對其功能、架構(gòu)、應(yīng)用的詳細(xì)介紹: 主要功能 數(shù)據(jù)采集:支持多種通信協(xié)議,如

2025-04-10 09:22:56 771

771 NetApp存儲數(shù)據(jù)恢復(fù)環(huán)境:

NetApp某型號存儲存儲上有96塊SAS接口硬盤,硬盤扇區(qū)大小是520字節(jié)。所有l(wèi)un映射到小型機使用,存放Oracle數(shù)據(jù)庫文件,采用ASM裸設(shè)備存儲方式

2025-11-25 14:33:01 135

135

已全部加載完成

電子發(fā)燒友App

電子發(fā)燒友App

評論