編輯:祝鑫泉

概述

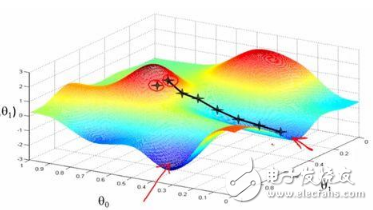

梯度下降算法(Gradient Descent Optimization)是神經網絡模型訓練最常用的優化算法。對于深度學習模型,基本都是采用梯度下降算法來進行優化訓練的。梯度下降算法背后的原理:目標函數

關于參數的梯度將是目標函數上升最快的方向。對于最小化優化問題,只需要將參數沿著梯度相反的方向前進一個步長,就可以實現目標函數的下降。這個步長又稱為學習速率。參數更新公式如下:

其中

是參數的梯度,根據計算目標函數采用數據量的不同,梯度下降算法又可以分為批量梯度下降算法(Batch Gradient Descent),隨機梯度下降算法(Stochastic GradientDescent)和小批量梯度下降算法(Mini-batch Gradient Descent)。對于批量梯度下降算法,其是在整個訓練集上計算的,如果數據集比較大,可能會面臨內存不足問題,而且其收斂速度一般比較慢。隨機梯度下降算法是另外一個極端,是針對訓練集中的一個訓練樣本計算的,又稱為在線學習,即得到了一個樣本,就可以執行一次參數更新。所以其收斂速度會快一些,但是有可能出現目標函數值震蕩現象,因為高頻率的參數更新導致了高方差。小批量梯度下降算法是折中方案,選取訓練集中一個小批量樣本計算,這樣可以保證訓練過程更穩定,而且采用批量訓練方法也可以利用矩陣計算的優勢。這是目前最常用的梯度下降算法。

對于神經網絡模型,借助于BP算法可以高效地計算梯度,從而實施梯度下降算法。但梯度下降算法一個老大難的問題是:不能保證全局收斂。如果這個問題解決了,深度學習的世界會和諧很多。梯度下降算法針對凸優化問題原則上是可以收斂到全局最優的,因為此時只有唯一的局部最優點。而實際上深度學習模型是一個復雜的非線性結構,一般屬于非凸問題,這意味著存在很多局部最優點(鞍點),采用梯度下降算法可能會陷入局部最優,這應該是最頭疼的問題。這點和進化算法如遺傳算法很類似,都無法保證收斂到全局最優。因此,我們注定在這個問題上成為“高級調參師”。可以看到,梯度下降算法中一個重要的參數是學習速率,適當的學習速率很重要:學習速率過小時收斂速度慢,而過大時導致訓練震蕩,而且可能會發散。理想的梯度下降算法要滿足兩點:收斂速度要快;能全局收斂。為了這個理想,出現了很多經典梯度下降算法的變種,下面將分別介紹它們。

01

Momentum optimization

沖量梯度下降算法是BorisPolyak在1964年提出的,其基于這樣一個物理事實:將一個小球從山頂滾下,其初始速率很慢,但在加速度作用下速率很快增加,并最終由于阻力的存在達到一個穩定速率。對于沖量梯度下降算法,其更新方程如下:

可以看到,參數更新時不僅考慮當前梯度值,而且加上了一個積累項(沖量),但多了一個超參

02

NAG

NAG算法全稱Nesterov Accelerated Gradient,是YuriiNesterov在1983年提出的對沖量梯度下降算法的改進版本,其速度更快。其變化之處在于計算“超前梯度”更新沖量項,具體公式如下:

既然參數要沿著

圖1 NAG效果圖

03

AdaGrad

AdaGrad是Duchi在2011年提出的一種學習速率自適應的梯度下降算法。在訓練迭代過程,其學習速率是逐漸衰減的,經常更新的參數其學習速率衰減更快,這是一種自適應算法。其更新過程如下:

其中是梯度平方的積累量,在進行參數更新時,學習速率要除以這個積累量的平方根,其中加上一個很小值是為了防止除0的出現。由于是該項逐漸增加的,那么學習速率是衰減的。考慮如圖2所示的情況,目標函數在兩個方向的坡度不一樣,如果是原始的梯度下降算法,在接近坡底時收斂速度比較慢。而當采用AdaGrad,這種情況可以被改觀。由于比較陡的方向梯度比較大,其學習速率將衰減得更快,這有利于參數沿著更接近坡底的方向移動,從而加速收斂。

圖2 AdaGrad效果圖

前面說到AdaGrad其學習速率實際上是不斷衰減的,這會導致一個很大的問題,就是訓練后期學習速率很小,導致訓練過早停止,因此在實際中AdaGrad一般不會被采用,下面的算法將改進這一致命缺陷。不過TensorFlow也提供了這一優化器:tf.train.AdagradOptimizer。

04

RMSprop

RMSprop是Hinton在他的課程上講到的,其算是對Adagrad算法的改進,主要是解決學習速率過快衰減的問題。其實思路很簡單,類似Momentum思想,引入一個超參數,在積累梯度平方項進行衰減:

可以認為僅僅對距離時間較近的梯度進行積累,其中一般取值0.9,其實這樣就是一個指數衰減的均值項,減少了出現的爆炸情況,因此有助于避免學習速率很快下降的問題。同時Hinton也建議學習速率設置為0.001。RMSprop是屬于一種比較好的優化算法了,在TensorFlow中當然有其身影:tf.train.RMSPropOptimizer(learning_rate=learning_rate,momentum=0.9, decay=0.9, epsilon=1e-10)。

不得不說點題外話,同時期還有一個Adadelta算法,其也是Adagrad算法的改進,而且改進思路和RMSprop很像,但是其背后是基于一次梯度近似代替二次梯度的思想,感興趣的可以看看相應的論文,這里不再贅述。

05

AdamAdam全稱Adaptive moment estimation,是Kingma等在2015年提出的一種新的優化算法,其結合了Momentum和RMSprop算法的思想。相比Momentum算法,其學習速率是自適應的,而相比RMSprop,其增加了沖量項。所以,Adam是兩者的結合體:

可以看到前兩項和Momentum和RMSprop是非常一致的,由于和的初始值一般設置為0,在訓練初期其可能較小,第三和第四項主要是為了放大它們。最后一項是參數更新。其中超參數的建議值是

學習速率

前面也說過學習速率的問題,對于梯度下降算法,這應該是一個最重要的超參數。如果學習速率設置得非常大,那么訓練可能不會收斂,就直接發散了;如果設置的比較小,雖然可以收斂,但是訓練時間可能無法接受;如果設置的稍微高一些,訓練速度會很快,但是當接近最優點會發生震蕩,甚至無法穩定。不同學習速率的選擇影響可能非常大,如圖3所示。

圖3 不同學習速率的訓練效果

理想的學習速率是:剛開始設置較大,有很快的收斂速度,然后慢慢衰減,保證穩定到達最優點。所以,前面的很多算法都是學習速率自適應的。除此之外,還可以手動實現這樣一個自適應過程,如實現學習速率指數式衰減:

在TensorFlow中,你可以這樣實現:

initial_learning_rate = 0.1

decay_steps = 10000

decay_rate = 1/10

global_step = tf.Variable(0, trainable=False)

learning_rate = tf.train.exponential_decay(initial_learning_rate,

global_step, decay_steps, decay_rate)

# decayed_learning_rate = learning_rate *

# decay_rate ^ (global_step / decay_steps)

optimizer = tf.train.MomentumOptimizer(learning_rate, momentum=0.9)

training_op = optimizer.minimize(loss, global_step=global_step)

總結

本文簡單介紹了梯度下降算法的分類以及常用的改進算法,總結來看,優先選擇學習速率自適應的算法如RMSprop和Adam算法,大部分情況下其效果是較好的。還有一定要特別注意學習速率的問題。其實還有很多方面會影響梯度下降算法,如梯度的消失與爆炸,這也是要額外注意的。最后不得不說,梯度下降算法目前無法保證全局收斂還將是一個持續性的數學難題。

參考文獻

Anoverview of gradient descent optimization algorithms: .

Hands-OnMachine Learning with Scikit-Learn and TensorFlow, Aurélien Géron, 2017.

NAG:.

Adagrad:.

RMSprop:~tijmen/csc321/slides/lecture_slides_lec6.pdf.

Adadelta:https://arxiv.org/pdf/1212.5701v1.pdf.

Adam:https://arxiv.org/pdf/1412.6980.pdf.

不同的算法的效果可視化:https://imgur.com/a/Hqolp.

歡迎大家加群在群中探討

歡迎留言或贊賞。

推

薦

閱

讀

Object Detection R-CNN

掃描個人微信號,

拉你進機器學習大牛群。

福利滿滿,名額已不多…

80%的AI從業者已關注我們微信公眾號

電子發燒友App

電子發燒友App

評論