智譜AI正式上線并開源全新一代大模型 GLM-5,沐曦股份實現Day 0 深度適配。 GLM-5目前可于曦云 C 系列(C500/C550/C588)上穩定高效運行。

近期,智譜AI相繼發布GLM-4.6V系列多模態大模型及GLM-OCR,沐曦股份均在第一時間完成全面適配。

此次高效適配依托于沐曦股份全棧自研的MXMACA軟件棧——該棧原生兼容PyTorch、TensorFlow等主流AI框架,支持模型“零代碼”或極低改造成本遷移。MXMACA已于2025年2月正式開源,目前用戶規模已突破25萬人。

曦云C系列GPU基于沐曦股份自主核心GPU IP打造,兼具高能效比與高通用性,可高效支撐千億參數級大模型的訓練與推理任務。通過深度協同MXMACA軟件棧,硬件算力得以充分釋放,實現“軟硬一體”的極致性能優化。

此次適配再次印證了國產AI“算力+算法”協同發展的可行性與先進性。未來,沐曦股份將持續深耕全棧技術研發,強化軟硬協同與生態共建,為國產算力高質量發展提供強勁動能。

關于GLM-5

在 Coding與 Agent 能力上,GLM-5 取得開源 SOTA 表現,在真實編程場景的使用體感逼近 Claude Opus 4.5,擅長復雜系統工程與長程 Agent 任務。

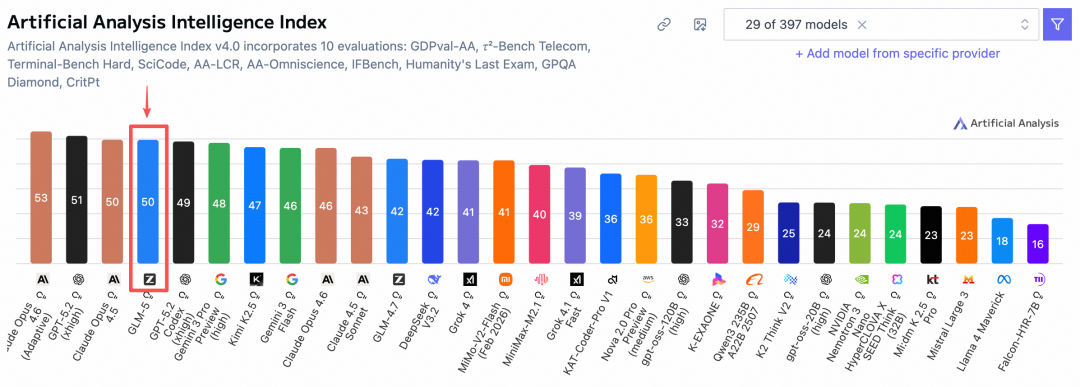

在全球權威的 Artificial Analysis 榜單中,GLM-5 位居全球第四、開源第一。

GLM-5 全新基座為從“寫代碼”到“寫工程”的能力演進提供了堅實基礎:

參數規模擴展:從 355B(激活 32B))擴展至 744B(激活 40B),預訓練數據從 23T 提升至 28.5T,更大規模的預訓練算力顯著提升了模型的通用智能水平

異步強化學習:構建全新的"Slime"框架,支持更大模型規模及更復雜的強化學習任務,提升強化學習后訓練流程效率;提出異步智能體強化學習算法,使模型能夠持續從長程交互中學習,充分激發預訓練模型的潛力

稀疏注意力機制:首次集成 DeepSeek Sparse Attention,在維持長文本效果無損的同時,大幅降低模型部署成本,提升 Token Efficiency

GLM-5 在編程能力上實現了對齊 Claude Opus 4.5,在業內公認的主流基準測試中取得開源模型 SOTA。在 SWE-bench-Verified 和 Terminal Bench 2.0 中分別獲得 77.8 和 56.2 的開源模型最高分數,性能超過 Gemini 3 Pro。

GLM-5開源與使用方式

即日起,GLM-5 在 Hugging Face 與 ModelScope 平臺同步開源,模型權重遵循 MIT License。

GLM-5 已納入 GLM Coding Plan Max套餐,Pro 也即將上線。開發者可一鍵兼容 Claude Code、OpenCode、KiloCode 等主流開發工具。接下來智譜將逐步擴大范圍,盡力讓更多用戶體驗并使用 GLM-5。

-

gpu

+關注

關注

28文章

5235瀏覽量

135900 -

人工智能

+關注

關注

1819文章

50206瀏覽量

266401 -

大模型

+關注

關注

2文章

3715瀏覽量

5238

原文標題:曦云C系列GPU Day 0 適配智譜全新一代大模型GLM-5

文章出處:【微信號:沐曦MetaX,微信公眾號:沐曦MetaX】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

沐曦股份曦云C系列GPU全面適配通義千問Qwen3.5三款新模型

沐曦股份曦云C系列GPU深度適配通義千問Qwen3.5模型

沐曦曦云C500/C550 GPU產品深度適配MiniMax M2.5模型

寒武紀實現對GLM-5的Day 0適配

智譜AI正式上線并開源全新一代大模型GLM-5

Day-0支持|摩爾線程MTT S5000率先完成對GLM-5的適配

硬件與應用同頻共振,英特爾Day 0適配騰訊開源混元大模型

曦云C系列GPU Day 0 適配智譜全新一代大模型GLM-5

曦云C系列GPU Day 0 適配智譜全新一代大模型GLM-5

評論