今日,騰訊正式發(fā)布新一代混元開(kāi)源大語(yǔ)言模型。英特爾憑借在人工智能領(lǐng)域的全棧技術(shù)布局,現(xiàn)已在英特爾? 酷睿? Ultra 平臺(tái)上完成針對(duì)該模型的第零日(Day 0)部署與性能優(yōu)化。值得一提的是, 依托于OpenVINO? 構(gòu)建的 AI 軟件平臺(tái)的可擴(kuò)展性,英特爾助力ISV生態(tài)伙伴率先實(shí)現(xiàn)應(yīng)用端Day 0 模型適配,大幅加速了新模型的落地進(jìn)程,彰顯了 “硬件 + 模型 + 生態(tài)” 協(xié)同的強(qiáng)大爆發(fā)力。

混元新模型登場(chǎng):多維度突破,酷睿Ultra平臺(tái)Day0適配

騰訊混元宣布開(kāi)源四款小尺寸模型,參數(shù)分別為 0.5B、1.8B、4B、7B,消費(fèi)級(jí)顯卡即可運(yùn)行,適用于筆記本電腦、手機(jī)、智能座艙、智能家居等低功耗場(chǎng)景。新開(kāi)源的4 個(gè)模型均屬于融合推理模型,具備推理速度快、性價(jià)比高的特點(diǎn),用戶可根據(jù)使用場(chǎng)景靈活選擇模型思考模式——快思考模式提供簡(jiǎn)潔、高效的輸出;而慢思考涉及解決復(fù)雜問(wèn)題,具備更全面的推理步驟。

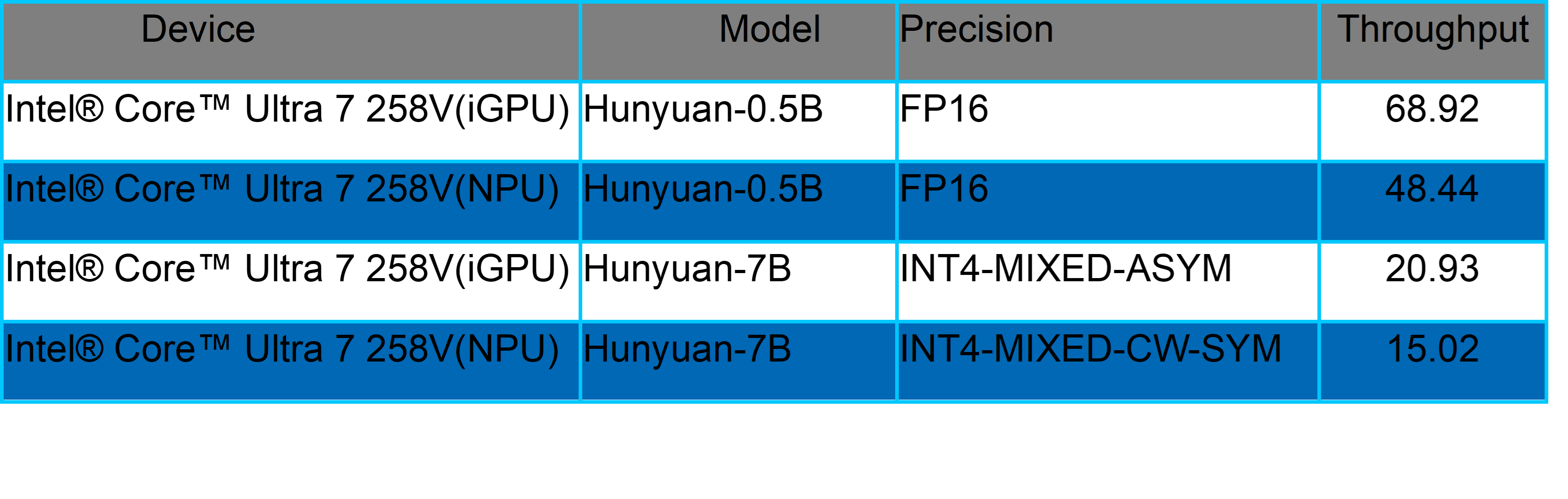

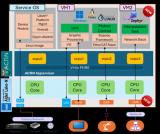

這些模型已在英特爾酷睿 Ultra 平臺(tái)實(shí)現(xiàn)全面適配,其在 CPU、GPU、NPU 三大 AI 運(yùn)算引擎上都展現(xiàn)了卓越的推理性能表現(xiàn)1。以酷睿 Ultra 2 代 iGPU 平臺(tái)為例,7B 參數(shù)量模型在 INT4 精度下,吞吐量達(dá) 20.93token/s;0.5B 小尺寸模型在 FP16 精度下吞吐量達(dá) 68.92token/s。值得一提的是,英特爾對(duì)新模型的 NPU 第零日支持已形成常態(tài)化能力,為不同參數(shù)量模型匹配精準(zhǔn)硬件方案,滿足從個(gè)人終端到邊緣設(shè)備的多樣化需求。

OpenVINO:新模型快速落地的“關(guān)鍵引擎”

作為英特爾推出的開(kāi)源深度學(xué)習(xí)工具套件,OpenVINO 以 “性能優(yōu)化 + 跨平臺(tái)部署” 為核心優(yōu)勢(shì),可充分釋放英特爾硬件資源潛力,廣泛應(yīng)用于 AI PC、邊緣 AI 等場(chǎng)景。其核心價(jià)值在于能將深度學(xué)習(xí)模型的推理性能最大化,同時(shí)實(shí)現(xiàn)跨 CPU、GPU、NPU 等異構(gòu)硬件的無(wú)縫部署。

目前,OpenVINO已支持超過(guò) 900 個(gè)人工智能模型,涵蓋生成式 AI 領(lǐng)域主流模型結(jié)構(gòu)與算子庫(kù)。這樣的模型支持體系,使其能在新模型發(fā)布的Day 0,即完成英特爾硬件平臺(tái)的適配部署。此次混元模型的快速落地,正是 OpenVINO 技術(shù)實(shí)力的直接體現(xiàn) —— 通過(guò)其優(yōu)化能力,混元模型在酷睿 Ultra 平臺(tái)的性能得到充分釋放,為用戶帶來(lái)即發(fā)即用的 AI 體驗(yàn)。

生態(tài)共創(chuàng):AI技術(shù)到應(yīng)用的“最后一公里”加速

生態(tài)合作是英特爾 AI 戰(zhàn)略的核心支柱,驅(qū)動(dòng)人生作為其長(zhǎng)期合作伙伴,專(zhuān)注于互聯(lián)網(wǎng)客戶端軟件研發(fā)及運(yùn)營(yíng),本著“以用戶為中心,以技術(shù)為根本,以開(kāi)放為原則”的理念,長(zhǎng)期致力于技術(shù)研發(fā)和技術(shù)創(chuàng)新,為用戶提供優(yōu)質(zhì)的服務(wù)。其 AIGC 助手軟件,實(shí)現(xiàn)本地部署,離線使用,支持文字輸入、語(yǔ)音轉(zhuǎn)譯,將大模型裝進(jìn)背包,可隨時(shí)隨地與它進(jìn)行智能對(duì)話,還能讓它幫忙解讀文檔,編撰方案。

該應(yīng)用采用 OpenVINO推理框架,借助其快速適配能力,在混元模型發(fā)布當(dāng)日即完成應(yīng)用層適配,成為首批支持新模型的應(yīng)用之一。

目前,驅(qū)動(dòng)人生 AIGC 助手、英特爾AIPC應(yīng)用專(zhuān)區(qū)和多家OEM 應(yīng)用商店的 AI PC專(zhuān)區(qū)均已上線,搭載混元模型的新版本也將在近期推出,用戶可第一時(shí)間體驗(yàn)更智能的交互與服務(wù)。這種 “模型發(fā)布 - 硬件適配 - 應(yīng)用落地” 的全鏈條第零日響應(yīng),正是英特爾生態(tài)協(xié)同能力的生動(dòng)寫(xiě)照。

AI 的發(fā)展離不開(kāi)模型創(chuàng)新與軟硬件生態(tài)協(xié)同 —— 模型如同燃料,生態(tài)則是驅(qū)動(dòng)前進(jìn)的引擎。英特爾通過(guò)硬件平臺(tái)、軟件工具與生態(tài)網(wǎng)絡(luò)的深度協(xié)同,實(shí)現(xiàn)對(duì)新模型的第零日適配,不僅加速了技術(shù)到應(yīng)用的轉(zhuǎn)化,更推動(dòng)著整個(gè) AI 產(chǎn)業(yè)的高效創(chuàng)新。未來(lái),英特爾將持續(xù)深化與合作伙伴的協(xié)同,讓 AI 創(chuàng)新更快走進(jìn)千行百業(yè)與大眾生活。

快速上手指南

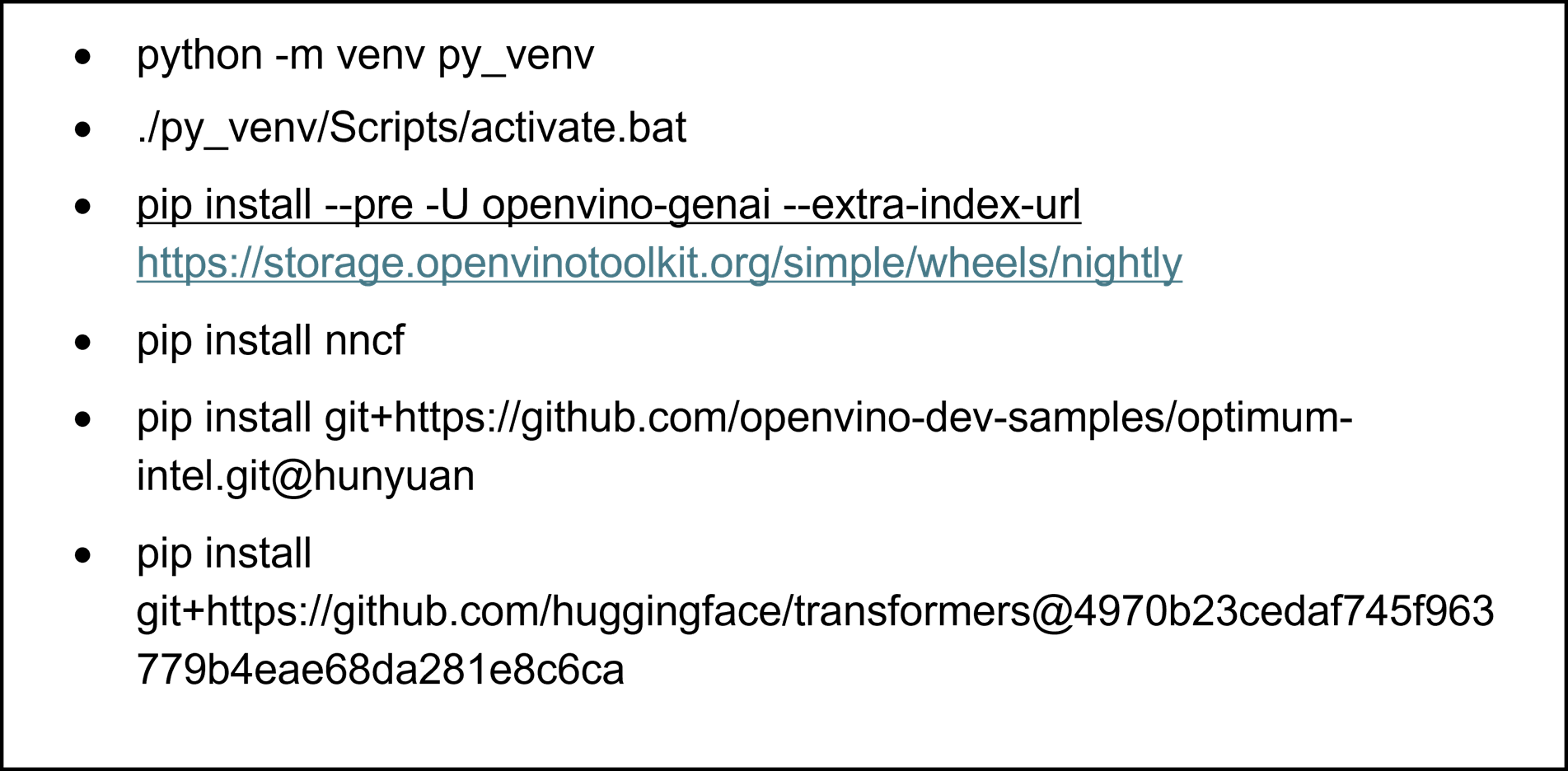

第一步,環(huán)境準(zhǔn)備

通過(guò)以下命令可以搭建基于Python的模型部署環(huán)境。

該示例在以下環(huán)境中已得到驗(yàn)證:

硬件環(huán)境:

Intel? Core? Ultra 7 258V

iGPU Driver:32.0.101.6972

NPU Driver:32.0.100.4181

Memory: 32GB

Windows 11 24H2 (26100.4061)

OpenVINO版本:

openvino 2025.2.0

openvino-genai 2025.2.0.0

openvino-tokenizers 2025.2.0.0

Transformers版本:

https://github.com/huggingface/transformers@4970b23cedaf745f963779b4eae68da281e8c6ca

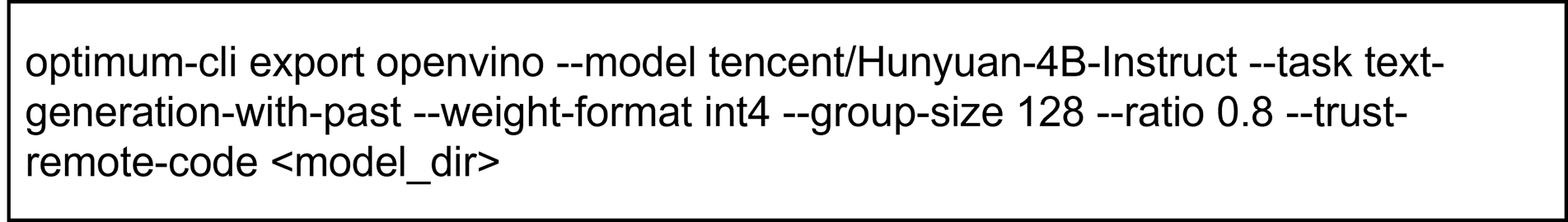

第二步,模型下載和轉(zhuǎn)換

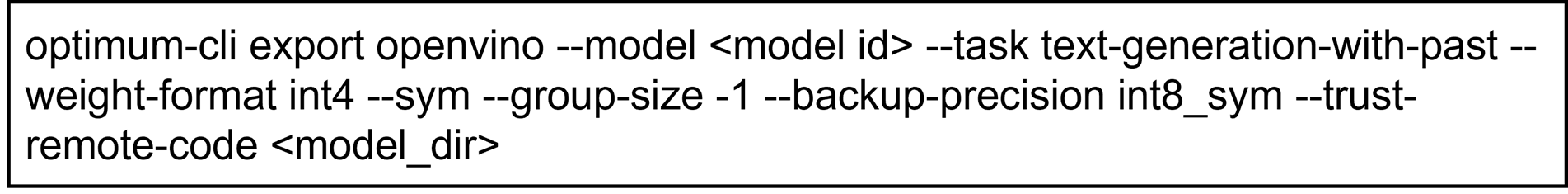

在部署模型之前,我們首先需要將原始的PyTorch模型轉(zhuǎn)換為OpenVINOTM的IR靜態(tài)圖格式,并對(duì)其進(jìn)行壓縮,以實(shí)現(xiàn)更輕量化的部署和最佳的性能表現(xiàn)。通過(guò)Optimum提供的命令行工具optimum-cli,我們可以一鍵完成模型的格式轉(zhuǎn)換和權(quán)重量化任務(wù):

開(kāi)發(fā)者可以根據(jù)模型的輸出結(jié)果,調(diào)整其中的量化參數(shù),包括:

--model:為模型在HuggingFace上的model id,這里我們也提前下載原始模型,并將model id替換為原始模型的本地路徑,針對(duì)國(guó)內(nèi)開(kāi)發(fā)者,推薦使用ModelScope魔搭社區(qū)作為原始模型的下載渠道,具體加載方式可以參考ModelScope官方指南:https://www.modelscope.cn/docs/models/download

--weight-format:量化精度,可以選擇fp32,fp16,int8,int4,int4_sym_g128,int4_asym_g128,int4_sym_g64,int4_asym_g64

--group-size:權(quán)重里共享量化參數(shù)的通道數(shù)量

--ratio:int4/int8權(quán)重比例,默認(rèn)為1.0,0.6表示60%的權(quán)重以int4表,40%以int8表示

--sym:是否開(kāi)啟對(duì)稱(chēng)量化

此外我們建議使用以下參數(shù)對(duì)運(yùn)行在NPU上的模型進(jìn)行量化,以達(dá)到性能和精度的平衡。

這里的--backup-precision是指混合量化精度中,8bit參數(shù)的量化策略。

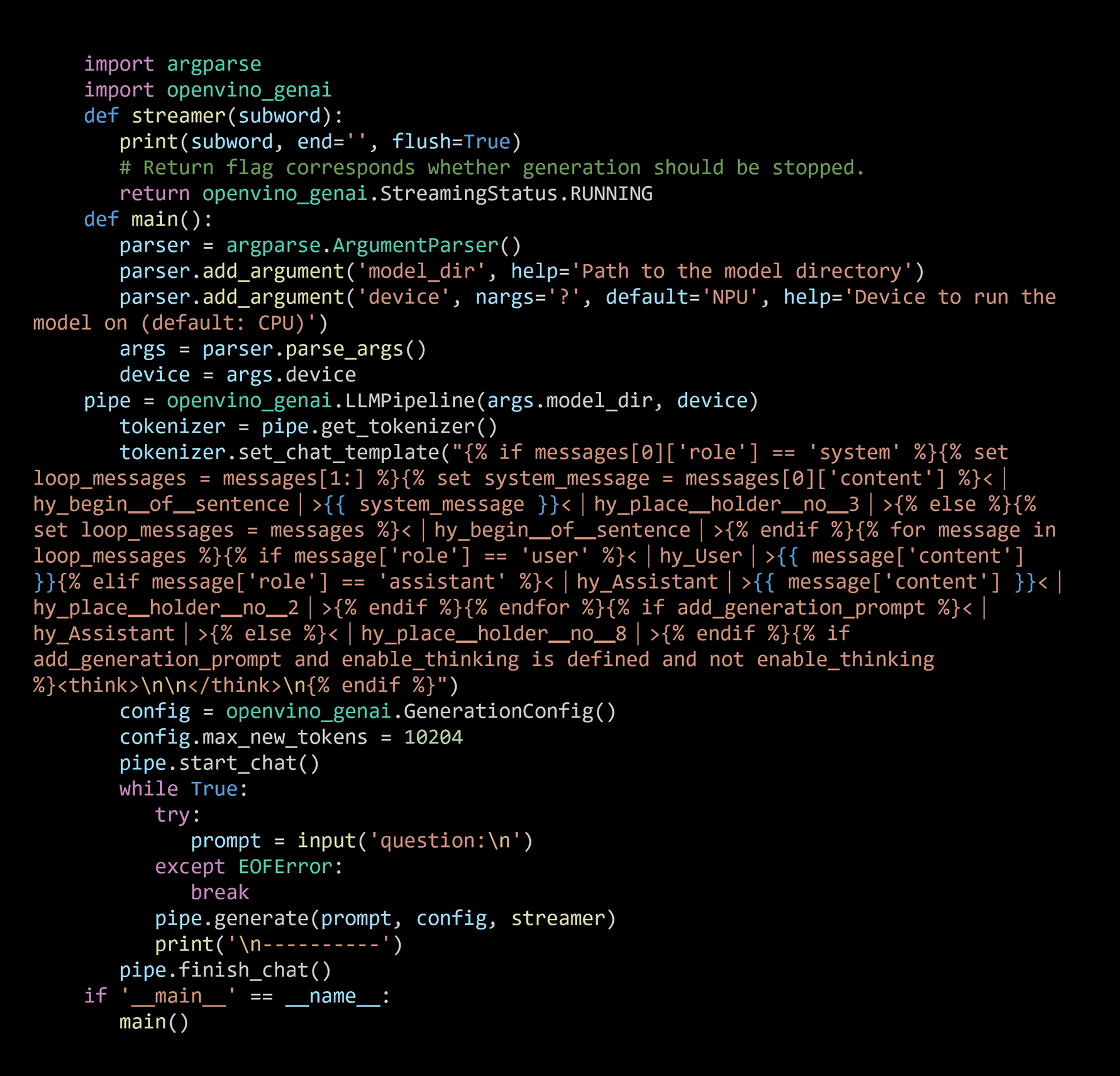

第三步,模型部署

目前我們推薦是用openvino-genai來(lái)部署大語(yǔ)言以及生成式AI任務(wù),它同時(shí)支持Python和C++兩種編程語(yǔ)言,安裝容量不到200MB,支持流式輸出以及多種采樣策略。

GenAI API部署示例

其中,'model_dir'為OpenVINOTM IR格式的模型文件夾路徑,'device'為模型部署設(shè)備,支持CPU,GPU以及NPU。此外,openvino-genai提供了chat模式的構(gòu)建方法,通過(guò)聲明pipe.start_chat()以及pipe.finish_chat(),多輪聊天中的歷史數(shù)據(jù)將被以kvcache的形態(tài),在內(nèi)存中進(jìn)行管理,從而提升運(yùn)行效率。

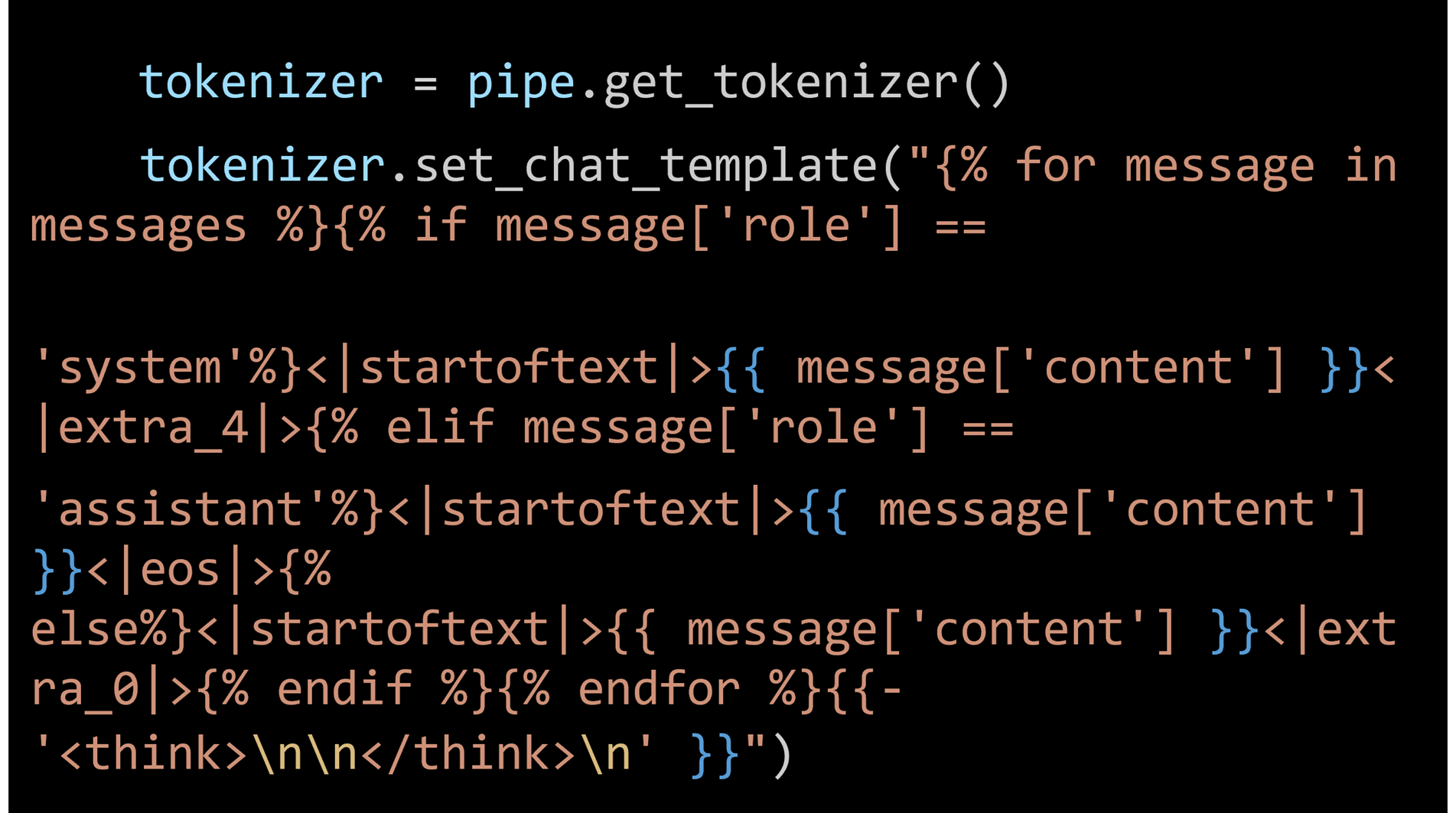

開(kāi)發(fā)者可以通過(guò)該該示例的中方法調(diào)整chat template,以關(guān)閉和開(kāi)啟thinking模式,具體方式可以參考官方文檔(https://huggingface.co/tencent/Hunyuan-4B-Instruct)。由于目前OpenVINOTM Tokenizer還沒(méi)有完全支持Hunyuan-7B-Instruct模型默認(rèn)的chat template格式,因此我們需要手動(dòng)替換原始的chat template,對(duì)其進(jìn)行簡(jiǎn)化,具體方法如下:

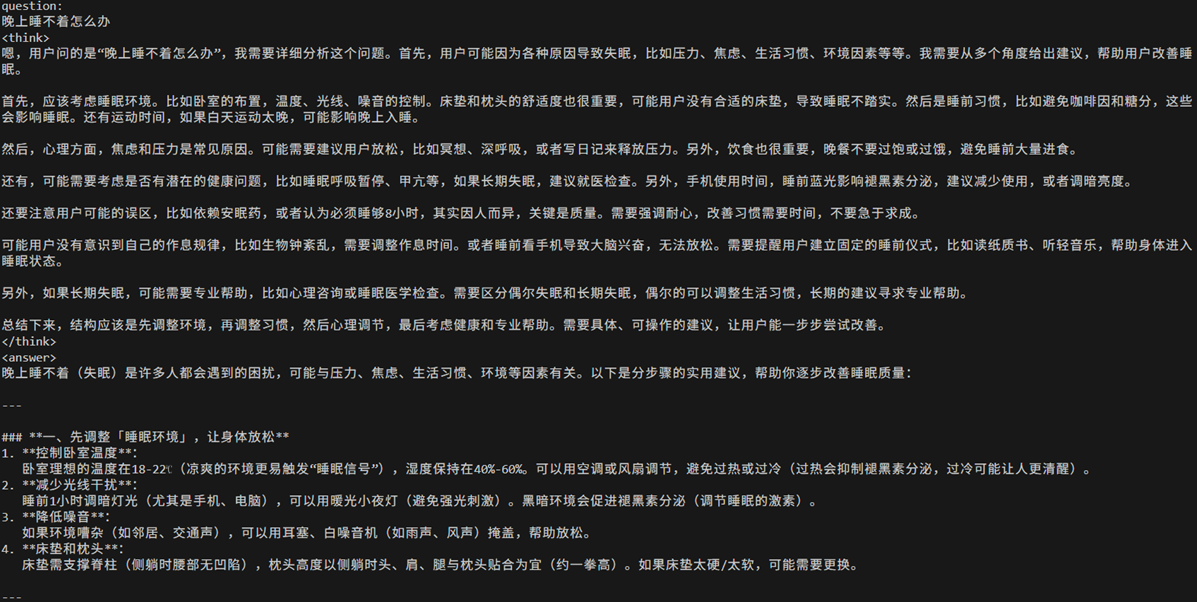

chat模式輸出結(jié)果示例:

關(guān)于該示例的后續(xù)更新,可以關(guān)注OpenVINO notebooks倉(cāng)庫(kù):https://github.com/openvinotoolkit/openvino_notebooks/tree/latest/notebooks/llm-chatbot

驅(qū)動(dòng)人生應(yīng)用獲取方式:

驅(qū)動(dòng)人生 AIGC 助手(https://www.160.com/aigc/index.html)

英特爾AIPC應(yīng)用專(zhuān)區(qū)(intel.cn/aipc)

1.通過(guò)使用 OpenVINO 框架版本 2025.2.0 在 英特爾? 酷睿? Ultra 7 258V 和 英特爾? 酷睿? Ultra 9 285H 上進(jìn)行測(cè)試獲得了性能數(shù)據(jù),計(jì)算過(guò)程發(fā)生在 iGPU 或 NPU 上。測(cè)試評(píng)估了首 Token 的延遲以及在 int4-mixed、int4-mixed-cw-sym 和 fp16 精度設(shè)置下 1K 輸入的平均吞吐量。每項(xiàng)測(cè)試在預(yù)熱階段后執(zhí)行三次,并選擇平均值作為報(bào)告數(shù)據(jù)。

性能因使用方式、配置和其他因素而異。請(qǐng)?jiān)L問(wèn)www.Intel.com/PerformanceIndex了解更多信息。

性能結(jié)果基于測(cè)試時(shí)的配置狀態(tài),可能未反映所有公開(kāi)可用的更新內(nèi)容。請(qǐng)參閱相關(guān)文檔以獲取配置詳情。沒(méi)有任何產(chǎn)品或組件能夠保證絕對(duì)安全。

您的實(shí)際成本和結(jié)果可能會(huì)有所不同。

相關(guān)英特爾技術(shù)可能需要啟用相關(guān)硬件、軟件或激活服務(wù)。

審核編輯 黃宇

-

英特爾

+關(guān)注

關(guān)注

61文章

10309瀏覽量

180740 -

人工智能

+關(guān)注

關(guān)注

1819文章

50160瀏覽量

266012 -

大模型

+關(guān)注

關(guān)注

2文章

3687瀏覽量

5213

發(fā)布評(píng)論請(qǐng)先 登錄

華為昇騰深度適配智譜AI全新開(kāi)源模型GLM-5

寒武紀(jì)實(shí)現(xiàn)對(duì)GLM-5的Day 0適配

智譜AI正式上線并開(kāi)源全新一代大模型GLM-5

曦云C系列GPU Day 0 適配智譜全新一代大模型GLM-5

Arm率先適配騰訊混元HY-1.8B-2Bit模型

沐曦曦云C500/C550 GPU產(chǎn)品適配騰訊混元圖像3.0圖生圖模型

沐曦曦云C500/C550 GPU產(chǎn)品適配騰訊混元開(kāi)源翻譯模型1.5版本

壁仞科技壁礪166M產(chǎn)品適配騰訊混元開(kāi)源翻譯模型1.5版本

沐曦股份曦云C系列GPU Day 0適配智譜GLM-4.6V多模態(tài)大模型

向新而生,同“芯”向上!2025英特爾技術(shù)創(chuàng)新與產(chǎn)業(yè)生態(tài)大會(huì)在重慶舉行

Arm率先適配騰訊混元開(kāi)源模型,助力端側(cè)AI創(chuàng)新開(kāi)發(fā)

摩爾線程率先支持騰訊混元-A13B模型

Zephyr RTOS在英特爾處理器N系列的應(yīng)用

更高效更安全的商務(wù)會(huì)議:英特爾聯(lián)合海信推出會(huì)議領(lǐng)域新型垂域模型方案

在英特爾酷睿Ultra AI PC上部署多種圖像生成模型

硬件與應(yīng)用同頻共振,英特爾Day 0適配騰訊開(kāi)源混元大模型

硬件與應(yīng)用同頻共振,英特爾Day 0適配騰訊開(kāi)源混元大模型

評(píng)論