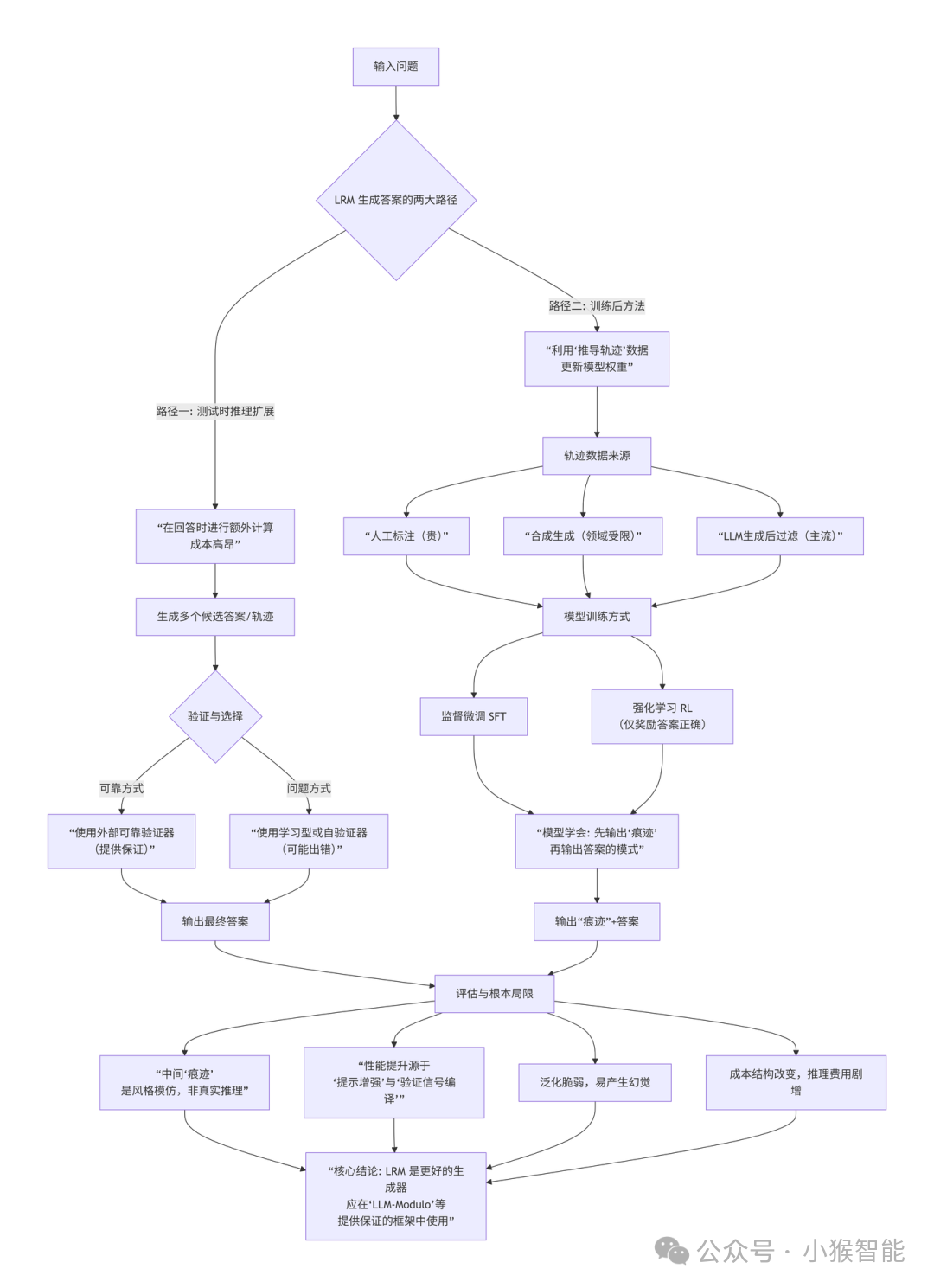

這篇文章《(How) Do Reasoning Models Reason?》對當前大型推理模型(LRM)進行了深刻的剖析,超越了表面的性能宣傳,直指其技術本質和核心局限。以下是基于原文的詳細技術原理、關鍵過程與核心見解拆解。

一、核心論點與總覽

LRM(如 o1, R1)的“推理”能力提升,并非源于模型學會了人類式的邏輯推理,而是通過兩類主要技術手段,優化了生成過程,使其在輸出最終答案前,模仿并生成看似合理的推導過程。其本質是在“生成-測試”框架中,將外部驗證信號逐步“編譯”進生成模型參數中。

二、兩大技術路徑的詳細原理與過程

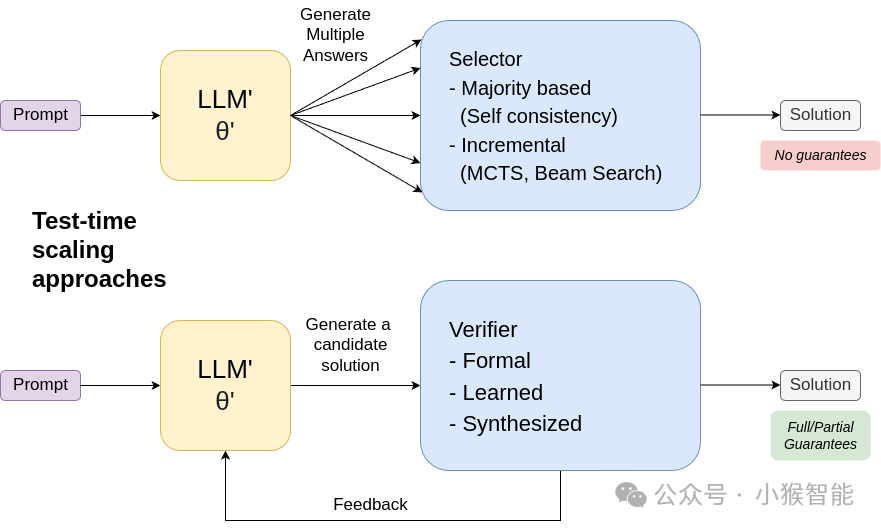

Figure 1:Test-time scaling approaches for teasing out reasoning

核心思想:在推理(回答用戶問題)時,讓模型做比“直接生成答案”更多的工作,相當于在測試時進行可擴展的、問題自適應的計算。

關鍵過程:

(1)生成:使用LLM為同一個問題生成多個候選答案或解軌跡。

(2)驗證/選擇:通過某種機制篩選出最優答案。

2.1)簡單選擇:如“自我一致性”,選擇出現頻率最高的答案(假設模型誤差是隨機的)。

2.2)驗證驅動:引入“驗證器”對候選答案進行檢驗。這是性能提升的關鍵。

驗證器類型:

(a)外部可靠驗證器:使用傳統求解器或可證明正確的程序(如數學計算器、規劃器)。這是最可靠的方式,能提供正確性保證(如LLM-Modulo框架)。

(b)學習型驗證器:訓練另一個模型來判斷答案正確性(問題:驗證器也可能出錯)。

(c)LLM自我驗證:讓LLM自我評估(已被證明存在問題,容易產生過度自信)。

迭代改進:如果驗證失敗,可以將錯誤信息反饋給生成器,讓其重新生成,形成“生成-測試-修正”循環。

核心見解: 這本質上是將搜索或規劃過程外包給了測試時的計算循環,而非內化于模型權重中。

根本問題:成本爆炸。計算成本不再與輸出長度成正比,而是與問題的內在計算復雜度成正比,顛覆了LLM按token計費的傳統商業模式。

2. 訓練后方法(基于推導軌跡,Post-Training on Derivational Traces)

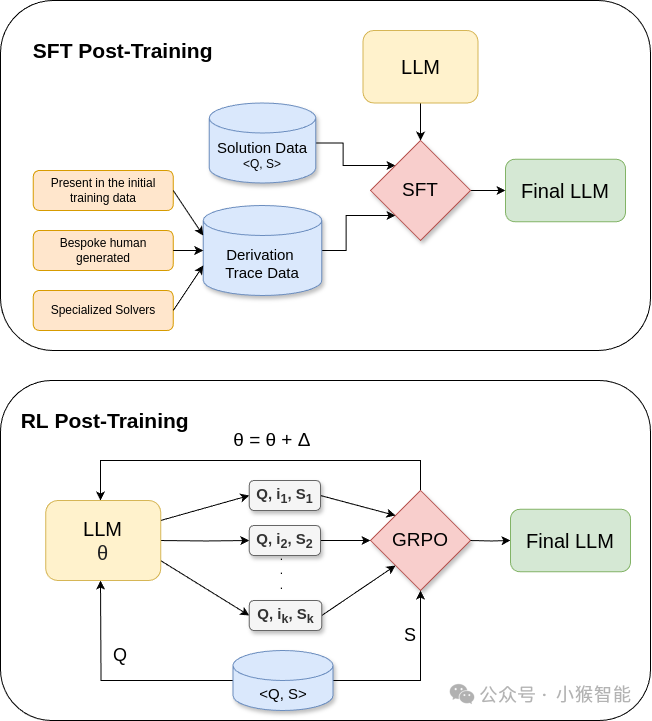

Figure 2:Post-training Approaches for teasing out reasoning

核心思想:在標準預訓練后,使用包含“解題步驟”(推導軌跡)的數據對模型進行進一步訓練,教會模型在輸出答案前,先輸出類似的中間步驟。

關鍵過程:

(1)軌跡數據獲取(最大難點):

1)人工標注:高質量但代價極高(如GSM8K數據集)。

2)合成生成:使用傳統求解器(如A*搜索)自動生成問題解及其完整的搜索軌跡(如SearchFormer)。軌跡準確但領域受限。

3)LLM生成后過濾:讓LLM自己生成步驟(利用其預訓練中已有的“步驟示范”數據),然后通過驗證器過濾出最終答案正確的軌跡(無論中間步驟是否真正合理)。這是當前主流方法。

模型訓練:

(1)監督微調:直接在(問題,推導軌跡,答案)數據上微調。

(2)強化學習:更先進的方法(如DeepSeek R1)。

2.1)過程:對于可驗證的問題,讓模型生成多條帶“痕跡”的答案。

2.2)獎勵:僅根據最終答案的正確與否給予獎勵/懲罰。

2.3)效果:模型參數被調整,使得能導致正確答案的輸出模式(包括其前面的“痕跡”)概率增大。

2.4)知識蒸餾:將經過RL訓練的“教師模型”的輸出作為數據,去訓練一個更小的“學生模型”,可以免去昂貴的RL過程。

(3)核心見解:

痕跡的語義虛假性:訓練目標只關心最終答案正確。模型學會的是一種能“討好”獎勵信號的輸出格式(先輸出一堆token,然后輸出答案),這些中間token不一定構成邏輯推理,而可能是任何有助于提高最終答案正確率的模式。

本質是編譯驗證信號:該過程可以理解為將外部驗證器(在訓練時使用)的“測試”能力,部分地編譯到了生成模型的“生成”傾向中。即“智能是將‘生成-測試’中的測試部分轉移到生成部分”(明斯基)。

三、對LRM的批判性見解(打破誤解)

1. 中間token不是“思考痕跡”

模型生成的“讓我們一步步思考…”等文本,是對預訓練數據中人類解題風格的模仿,而非內部計算過程的反映。作者戲稱為“大型喃喃自語模型”。

證據:即使在專門訓練輸出求解器軌跡的模型(如SearchFormer)中,其輸出的“步驟”也常包含違反基本算法規則的操作(如從開放列表中刪除不存在的節點),但這些錯誤軌跡有時仍能“蒙對”最終答案。這說明軌跡的正確性并非必要。

2. 性能提升的來源是“提示增強”,而非獲得推理能力:

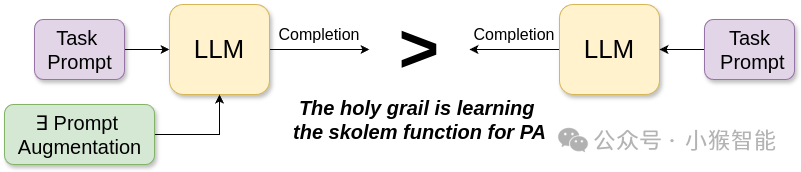

Figure 4: Augmenting a task prompt with additional tokens often seems to improve the accuracy of LLM completion even if the tokens don’t have human-parseable meaning.

給LLM一個更長的、特定格式的提示詞(如包含“步驟”),即使這些附加token對人類毫無意義,也能提高其答案準確性。

LRM的訓練后方法,實質上是將這種有效的“提示增強”動態地、內化地置于每次生成的開頭。模型學會了自己為自己“鋪墊”一段有利于解題的上下文。

3. 泛化能力脆弱

在簡單規劃任務(Blocksworld)上表現尚可,但一旦對對象和動作進行重命名(Mystery Blocksworld),性能就大幅下降。這表明模型嚴重依賴表面詞匯的匹配,而非抽象的邏輯結構理解。

面對不可解問題時,LRM會自信地生成虛假計劃并配上看似合理的解釋,存在“ gas lighting ”(誤導)用戶的風險。

4. 與LLMs沒有根本性架構區別

僅經過訓練后的LRMs,在推理時仍然是接收提示,自回歸地生成token。其架構與普通LLM完全相同。

唯一改變的是模型輸出token序列的概率分布:它現在更傾向于先生成一段“類推導痕跡”的token,再生成答案。沒有自適應計算,生成長度在訓練時已大致確定。

四、核心流程圖解:LRMs的工作原理與本質

以下圖表概括了上述所有關鍵過程和見解:

五、未來方向與建議

去擬人化:放棄讓中間token像人類“思考”,轉而探索高效、壓縮、符號化的中間表示,純粹以提升最終準確性為目標進行優化(類似AlphaZero學習價值函數)。

混合系統定位:LRMs不應被視為獨立的“推理者”,而應作為增強型的提議生成器,集成在如LLM-Modulo的框架中,由外部驗證器提供可靠性保證。

重新審視評估:需要超越最終答案準確率的基準測試,設計能測評推理過程穩健性、泛化性和成本效率的評估體系。

總而言之,本文揭示了LRMs“推理”能力背后的工程本質,對其過度擬人化的解讀提出了有力批判,并為更穩健、可靠的AI系統設計指明了方向。

本文轉自:小猴智能,由小猴翻譯校對

源文:(How) Do Reasoning Models Reason?2025.4.14

-

測試

+關注

關注

9文章

6299瀏覽量

131535 -

LLM

+關注

關注

1文章

348瀏覽量

1371

發布評論請先 登錄

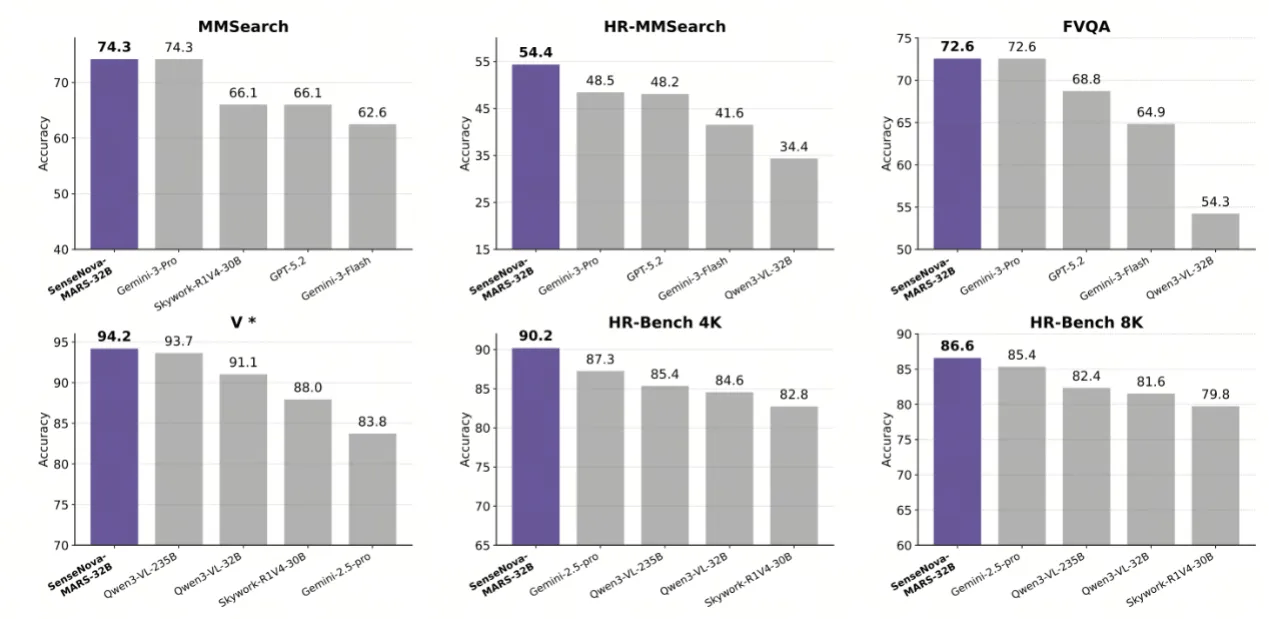

商湯科技正式開源多模態自主推理模型SenseNova-MARS

商湯開源SenseNova-MARS:突破多模態搜索推理天花板

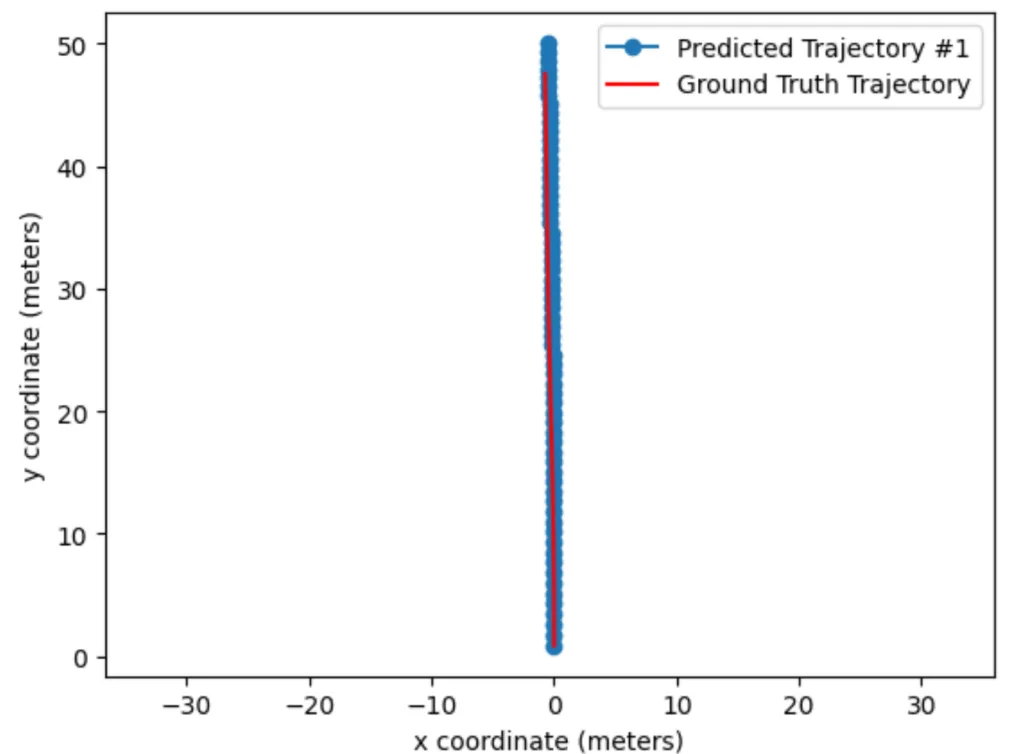

基于NVIDIA Alpamayo構建具備推理能力的輔助駕駛汽車

NVIDIA TensorRT LLM 1.0推理框架正式上線

什么是AI模型的推理能力

澎峰科技完成OpenAI最新開源推理模型適配

請問如何在RK3588上使用npu,用onnx模型來推理

如何在魔搭社區使用TensorRT-LLM加速優化Qwen3系列模型推理部署

大模型推理顯存和計算量估計方法研究

邏輯推理AI智能體的實際應用

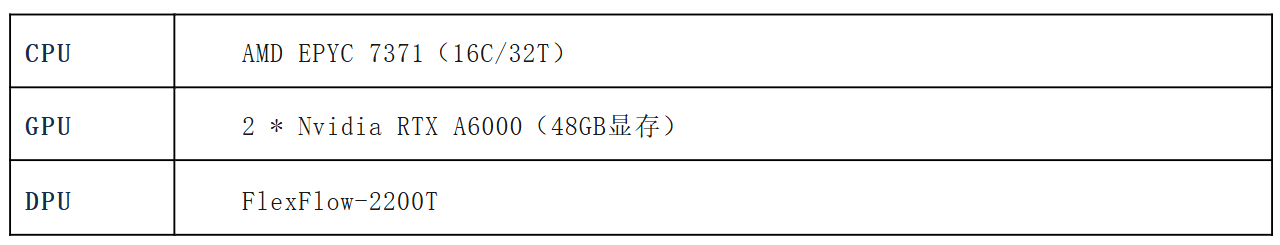

中科馭數高性能網卡產品 成就DeepSeek推理模型網絡底座

LLM推理模型是如何推理的?

LLM推理模型是如何推理的?

評論