輔助駕駛研究領域正經歷一場快速變革。視覺-語言-動作推理模型(Reasoning VLA) 的出現正重塑該領域,這些模型為輔助駕駛決策賦予了類人的思維能力。這類模型可視為在語義空間中運行的隱式世界模型,使輔助駕駛能夠逐步解決復雜問題,并生成反映人類思維過程的推理軌跡。這種變革不僅體現在模型本身:傳統的開環評估已不足以嚴謹地檢驗此類模型,因此需要開發新的評估工具。

近期,NVIDIA 推出了 Alpamayo 系列,該系列包含模型、仿真工具及數據集,旨在推動安全可靠的推理型輔助駕駛汽車開發。我們的目標是為研究人員和開發者提供一個靈活、快速且可擴展的平臺,用于在真實的閉環環境中評估并最終訓練新一代基于推理的輔助駕駛架構。

在這篇博客中,我們將介紹 Alpamayo 以及如何快速啟動基于推理的輔助駕駛開發:

第一部分:NVIDIA Alpamayo 1——具備 100 億參數的開源 VLA 推理模型,以及如何利用該模型生成軌跡預測結果并查看對應的推理路徑。

第二部分:物理 AI 數據集——當前規模大、地域分布廣的輔助駕駛開放數據集,可用于訓練和評估此類模型。

第三部分:NVIDIA AlpaSim——專為評估端到端模型設計的開源端到端仿真框架。

這三個關鍵組件為構建 VLA 推理模型提供了必要的基礎要素:基礎模型、用于訓練的大規模數據集,以及用于測試和評估的仿真器。

第一部分:Alpamayo 1——面向輔助駕駛的開源 VLA 推理模型

只需三步,即可開始使用 Alpamayo VLA 推理模型。

步驟 1:獲取 Alpamayo 模型權重和代碼

Hugging Face 倉庫包含預訓練的模型權重,可通過GitHub 上的對應代碼加載。

步驟 2:環境準備

Alpamayo GitHub 倉庫包含設置開發環境的步驟,包括安裝 uv(如果尚未安裝)以及創建 Python 虛擬環境。

# Install uv curl -LsSf https://astral.sh/uv/install.sh | sh export PATH="$HOME/.local/bin:$PATH" # Setup the virtual environment uv venv ar1_venv source ar1_venv/bin/activate # Install pip in the virtual environment (if missing) ./ar1_venv/bin/python -m ensurepip # Install Jupyter notebook package ./ar1_venv/bin/python -m pip install notebook uv sync --active

最后,由于該模型需要訪問 Hugging Face 的部分受限資源,請在此處申請訪問權限:

●PhysicalAI-AV Dataset

●Alpamayo-R1-10B Model Weights

●物理 AI – 輔助駕駛數據集

●Alpamayo-R1-10B 模型權重

然后,使用以下方式進行身份驗證:

hf auth login

并在此獲取 Hugging Face token。

步驟 3:運行 Alpamayo VLA 推理模型

模型倉庫包含一個notebook文件,用于下載 Alpamayo 模型的權重參數,加載 NVIDIA 物理 AI 輔助駕駛數據集示例數據,運行模型,最后可視化輸出軌跡及其關聯的推理路徑。

具體而言,示例數據包含自車駛過施工區域的場景,下圖展示了來自四個攝像頭(分別位于前排左側、前排廣角、前排右側、前排遠攝位置,對應下圖各行)的四個時間步(列)。

圖 1. 示例數據樣本的可視化展示,其中包含施工區域,該數據將被輸入模型。具體展示了來自 4 個攝像頭(前左、前廣角、前右、前遠攝)的 4個時間步(列)。

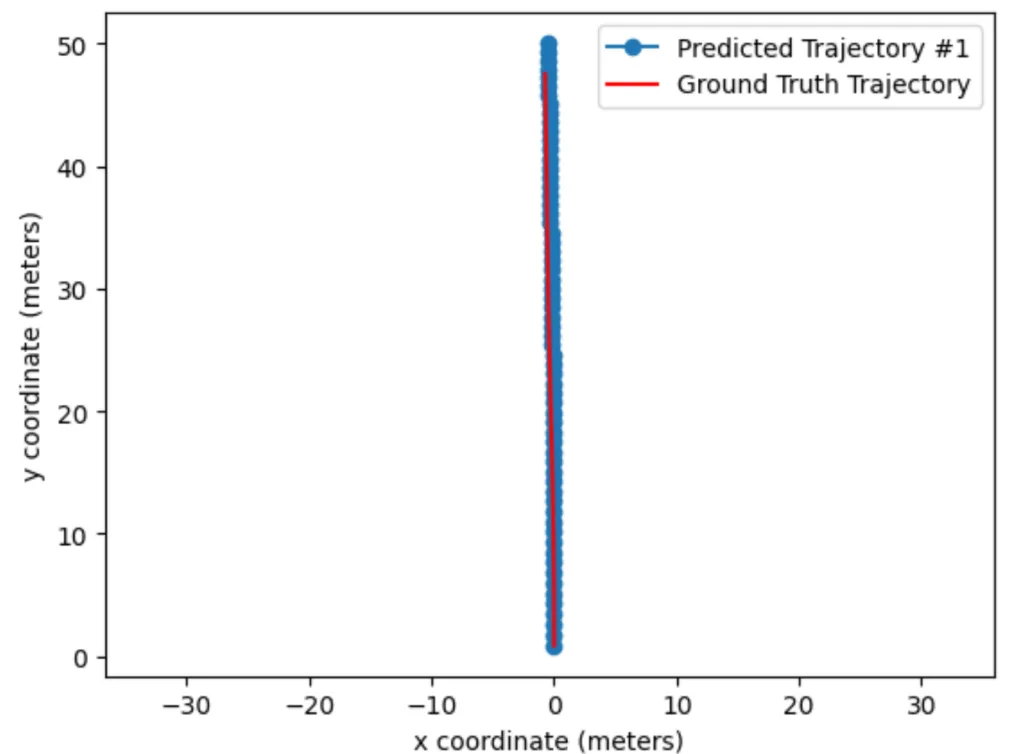

在 Alpamayo 模型運行后,notebook 中可能出現的示例輸出為:“向左微調方向,避開侵占車道的施工路錐,擴大通行間距”,對應的預測軌跡與實際軌跡如下圖所示。

圖 2. 模型輸出軌跡(藍色)與實際軌跡(紅色)的可視化對比圖。

若需生成更多軌跡和推理路徑,請將推理調用中的 num_traj_samples=1 參數修改為更大的數值。

第二部分:面向大規模多樣化輔助駕駛數據的物理AI 數據集

物理 AI 輔助駕駛數據集是目前規模較大、地域分布廣的多傳感器數據集,助力輔助駕駛研究人員構建新一代基于物理 AI 的端到端駕駛系統。

圖 3. 物理 AI 輔助駕駛數據集片段,該數據集是規模較大、地域分布廣的多傳感器輔助駕駛數據集。

該數據集包含了 25 個國家、超過 2,500 座城市共計 1,727 小時的駕駛視頻數據(覆蓋范圍如下圖所示,顏色深淺代表各國收錄的片段數量)。數據采集范圍涵蓋多樣化的交通狀況、天氣條件、道路障礙物及行人活動。整體數據集由 310,895 段獨立視頻片段構成,每段時長均為 20 秒。所有片段均包含多攝像頭與激光雷達的傳感器數據,其中 163,850 個片段還同步收錄了毫米波雷達數據。

圖 4. 物理 AI 輔助駕駛數據集的地理覆蓋范圍。該數據集總計收錄了 25 個國家、超過 2,500 座城市共計 1727 小時的駕駛視頻數據(顏色深淺表示各國收錄的片段數量)。

如需使用以上物理 AI 輔助駕駛數據集,請訪問physical_ai_av GitHub代碼倉庫,其提供了 Python 開發工具包及文檔(以知識庫形式呈現)。事實上,本系列第一部分中用于加載 Alpamayo 1 示例數據的工具,正是基于此資源包實現。

第三部分:AlpaSim——面向輔助駕駛評估的閉環仿真框架

AlpaSim 概述

圖 5. 圍繞核心運行時的 AlpaSim 微服務架構高層概覽。各服務運行在獨立進程中,以實現靈活的擴展性和模塊化設計。

AlpaSim 基于微服務架構構建,其核心是運行時(見圖 5),該組件負責協調所有仿真活動。各獨立服務如驅動程序、渲染器、交通仿真器、控制器和物理引擎均在獨立進程中運行,且可分配至不同 GPU。此設計具備兩大優勢:

基于 gRPC 提供清晰的模塊化 API,能夠輕松集成新服務且有效避免依賴沖突。

支持任意水平擴展,使研究人員能將計算資源分配到最關鍵的環節。例如:若驅動程序推理成為瓶頸,只需啟動更多驅動進程;若渲染成為瓶頸,則為渲染分配更多 GPU。當渲染進程無法同時處理多個場景時,可在同一 GPU 上運行多個渲染器實例以最大化資源利用率。

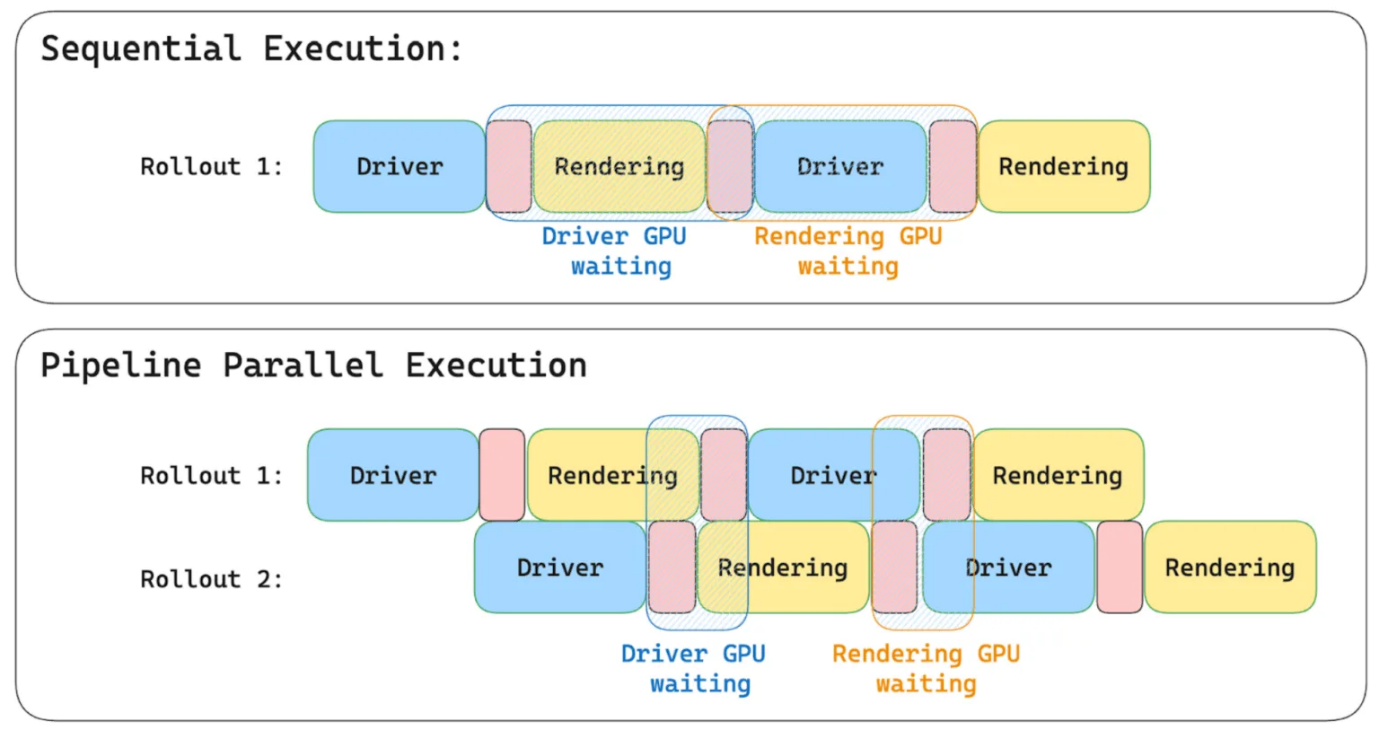

但橫向擴展并非全部,AlpaSim 的真正優勢在于運行時如何實現流水線并行(見圖 6)。

在傳統的順序執行中,各組件必須相互等待。例如,驅動程序在每次推理步驟后必須暫停,直至渲染器生成下一個感知輸入。AlpaSim 消除了這一瓶頸:當一個場景正在渲染時,驅動程序可同時為另一個場景運行推理。這種重疊處理顯著提升了 GPU 利用率和吞吐量。在進一步擴展時,驅動程序推理可跨多個場景進行批量處理,而多個渲染進程則并行生成感知輸入。

圖 6. AlpaSim 通過實現流水線并行執行,以優化 GPU 利用率并提高吞吐量。

共享生態系統

目前已為所有核心服務提供初始實現方案,包括通過 NVIDIA OmniverseNuRec 3DGUT算法進行渲染、參考控制器以及驅動程序基準。 Alpamayo 1 和 CAT-K 等更多驅動程序模型將于未來幾周內上線。

該平臺還預裝了約900 個重建場景(每個場景時長 20 秒)以及物理 AI 輔助駕駛數據集,使研究人員能夠在真實的閉環場景中即時評估端到端模型。此外,AlpaSim 具備高度可配置性,支持從攝像頭參數、渲染頻率到人工延遲等眾多仿真設置。

除了內置組件外, AlpaSim 將發展為更廣泛的協作生態系統。未來,實驗室將能夠無縫接入自研的駕駛、渲染或交通模型,并基于共享基準測試平臺直接對比不同方案。

AlpaSim 實際應用

AlpaSim 已為多項內部研究工作提供支持。

首先,我們近期提出的Sim2Val框架,證明了 AlpaSim 的推演結果足夠真實,能夠顯著提升實車驗證的有效性。通過將仿真軌跡整合至評估流程,關鍵現實世界指標的方差降低了高達 83%,使模型評估更快速、更可靠。

其次,我們借助 AlpaSim 對 Alpamayo 1 模型進行閉環評估。通過回放重建場景并讓策略驅動端到端駕駛,我們可計算出反映真實交通條件下性能的駕駛評分(DrivingScore)。

除評估功能外,我們正結合同期發布的 RoaD 算法,將 AlpaSim 應用于閉環訓練。該算法能有效緩解開環訓練與閉環部署間的協變量偏移問題,同時數據效率顯著優于傳統強化學習。

圖 7. 真實駕駛(x 軸)與重模擬駕駛(y 軸)之間的指標相關性。我們測量了與附近物體的最近距離(左)以及車輛偏離車道中心的距離(右)。

Alpasim 入門指南

只需三個步驟,即可開始使用 AlpaSim 進行模型評估。

步驟 1:訪問 AlpaSim

該開源倉庫包含所需軟件,場景重建文件可從NVIDIA 物理 AI 開放數據集獲取。

步驟 2:環境準備

首先,請確保遵循ONBOARDING.md中的入門步驟。

然后,使用以下命令執行初始設置/安裝:

source setup_local_env.sh

此操作將編譯原語文件,下載示例駕駛模型,從 Hugging Face下載示例場景,并安裝 alpasim_wizard 命令行工具。

步驟3:運行模擬

使用向導來構建、運行和評估模擬部署:

alpasim_wizard +deploy=local wizard.log_dir=$PWD/tutorial

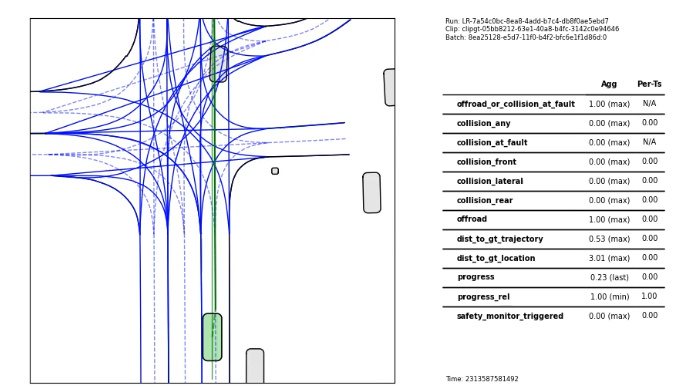

仿真日志、輸出文件位于已創建的 tutorial 目錄下。如需查看可視化呈現結果,系統會在 tutorial/eval/videos/clipgt-05bb8212…_0.mp4 路徑下生成一個 mp4 文件,其內容將與以下示例類似:

圖 8. AlpaSim 輸出可視化:展示了包含智能體邊界框與地圖(若可用)的俯視語義視圖、平均及逐時間步指標,以及疊加預測軌跡及真實軌跡的前置攝像頭視圖。

如需了解輸出結果以及 AlpaSim 的使用信息,請參閱TUTORIAL.md文件。

總體而言,本示例展示了如何通過端到端策略重現真實駕駛場景,包括原始場景中的所有靜態和動態目標物。在此基礎上,利用 AlpaSim 靈活的即插即用架構,用戶可調整干擾車輛的行為、修改攝像頭參數,從而對策略進行迭代優化。

策略集成

借助通用 API,策略模型可輕松切換,支持開發人員測試其先進的實現方案。

步驟 1:gRPC 集成

AlpaSim 采用 gRPC 作為組件間的接口:驅動組件的示例實現可作為參考,以確保符合驅動程序接口規范。

步驟 2:重新配置并運行

AlpaSim 支持通過 YAML 文件描述進行高度定制,包括指定仿真器在運行時所需的組件。您可為自己的模型創建新的配置文件(部分示例如下所示)。

# driver_configs/my_model.yaml

# @package _global_

services:

driver:

image:

command:

- ""

運行:

alpasim_wizard +deploy=local wizard.log_dir=$PWD/my_model +driver_configs=my_model.yaml

使用命令行界面(CLI)進行自定義配置的示例:

運行向導示例時,可更改配置:

# Different scene alpasim_wizard +deploy=local wizard.log_dir=$PWD/custom_run \ scenes.scene_ids=['clipgt-02eadd92-02f1-46d8-86fe-a9e338fed0b6'] # More rollouts alpasim_wizard +deploy=local wizard.log_dir=$PWD/custom_run \ runtime.default_scenario_parameters.n_rollouts=8 # Different simulation length alpasim_wizard +deploy=local wizard.log_dir=$PWD/custom_run \ runtime.default_scenario_parameters.n_sim_steps=200

配置通過Hydra進行管理——請參閱src/wizard/configs/base_config.yaml文件查看所有可用選項。

如需下載圖 8 所示的場景,可運行以下命令:

hf download --repo-type=dataset \ --local-dir=data/nre-artifacts/all-usdzs \ nvidia/PhysicalAI-Autonomous-Vehicles-NuRec \ sample_set/25.07_release/Batch0001/02eadd92-02f1-46d8-86fe-a9e338fed0b6/02eadd92-02f1-46d8-86fe-a9e338fed0b6.usdz

擴展運行規模

AlpaSim 能夠通過協同與并行化服務來適配各類硬件配置,高效支持大型測試套件、擾動測試和模型訓練。

alpasim_wizard +deploy=local wizard.log_dir=$PWD/test_suite +experiment=my_test_suite.yaml runtime.default_scenario_parameters.n_rollouts=16

結論:綜合分析

強大的端到端模型是輔助駕駛未來的關鍵,而 AlpaSim 提供了快速測試和迭代這些模型的能力,從而加速研究進程。本文介紹了 Alpamayo 1 模型、物理 AI 數據集以及 Alpasim 仿真架構。它們共同構成了一套完整的基于推理的輔助駕駛系統開發框架,包含模型、海量訓練數據以及用于評估的仿真器。

綜合來看,以下視頻展示了 Alpamayo 1 在 AlpaSim 仿真環境中穿越施工區域的閉環駕駛實例,既呈現了該模型的推理與駕駛能力,同時也彰顯了AlpaSim 在多種真實駕駛場景中評估輔助駕駛模型的能力。視頻 3. Alpamayo 1 在 AlpaSim 中執行閉環駕駛,穿越施工區域時,其推理路徑與軌跡預測均通過可視化呈現。

關于作者

Marco Pavone 是 NVIDIA 自動駕駛汽車研究總監。他的主要研究興趣是開發自動駕駛系統的分析、設計和控制方法,重點關注自動駕駛汽車、自動駕駛航空航天車輛和未來移動系統。他目前正在斯坦福大學部分請假,擔任航空航天系副教授。在斯坦福大學,他還是自動駕駛系統實驗室主任兼汽車研究中心聯合主任。他于 2010 年獲得麻省理工學院航空航天專業博士學位。他獲得了多個獎項,包括美國總統巴拉克?奧巴馬頒發的總統科學家和工程師早期職業獎、美國海軍研究辦公室青年研究員獎、美國國家科學基金會早期職業獎 (CAREER)、NASA 早期職業教師獎,以及機器人科學和系統基金會頒發的早期職業聚焦獎。他被美國工程教育協會 (ASEE) 評為美國 20 位 40 歲以下最有前途的研究人員之一。他目前擔任 IEEE Control Systems 雜志的副編輯。

-

NVIDIA

+關注

關注

14文章

5592瀏覽量

109720 -

輔助駕駛

+關注

關注

1文章

416瀏覽量

15807

原文標題:CES 2026 | 基于 NVIDIA Alpamayo 構建具備推理能力的輔助駕駛汽車

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

今日看點|黃仁勛:物理AI的ChatGPT時刻已然到來;波士頓動力發布Atlas人形機器人量產版本

從先進駕駛輔助系統到無人駕駛

Nvidia 無人駕駛汽車招聘

高級安全駕駛員輔助系統助力自動駕駛

自動駕駛汽車的處理能力怎么樣?

NVIDIA 在首個AI推理基準測試中大放異彩

駕駛輔助技術的一些常見功能介紹

基于FPGA平臺構建汽車輔助駕駛系統算法

NVIDIA企業級解決方案賦能汽車輔助駕駛

NVIDIA推動面向數字與物理AI的開源模型發展

NVIDIA 推出 Alpamayo 系列開源 AI 模型與工具,加速安全可靠的推理型輔助駕駛汽車開發

基于NVIDIA Alpamayo構建具備推理能力的輔助駕駛汽車

基于NVIDIA Alpamayo構建具備推理能力的輔助駕駛汽車

評論