2025年初,DeepSeek-V3與DeepSeek-R1推理模型的開源引爆了AI社區(qū),這兩款產(chǎn)品作為通用千億級模型與專用推理優(yōu)化模型,為全球AI技術(shù)生態(tài)帶來重大變革,不僅展示了中國AGI技術(shù)的突破性進(jìn)展,而且開源模型發(fā)展帶來部署成本的極速下降,為定制化AGI服務(wù),推理本地化部署,帶來發(fā)展機(jī)遇,也掀起了新的一輪智算基礎(chǔ)設(shè)施建設(shè)浪潮。

與按Token生成數(shù)量計費(fèi)的AI云服務(wù)模式不同,出于數(shù)據(jù)安全的考慮,很多用戶選擇采用本地化部署推理集群的方式將AI能力集成到當(dāng)前業(yè)務(wù)流中。由于整個推理應(yīng)用的業(yè)務(wù)鏈條非常長,本地化部署需要綜合考慮如下各個方面與需求的匹配度:

硬件與基礎(chǔ)設(shè)施規(guī)劃:包括GPU與專用芯片選型、網(wǎng)絡(luò)架構(gòu)優(yōu)化與隔離、存儲方案評估

模型優(yōu)化與部署策略:包括量化壓縮等推理加速技術(shù)選型、資源動態(tài)調(diào)度技術(shù)等

安全與合規(guī)性:需要綜合考慮數(shù)據(jù)使用的便捷性與合規(guī)要求

高可用與容災(zāi)設(shè)計:包括故障自愈方案、數(shù)據(jù)備份等

成本控制:根據(jù)業(yè)務(wù)使用模式合理制定需求規(guī)格,嚴(yán)控成本

為了更好地服務(wù)客戶完成本地化推理集群的選型與部署工作,近期中科馭數(shù)作為國內(nèi)AI網(wǎng)絡(luò)的頭部DPU芯片產(chǎn)品供應(yīng)商,從網(wǎng)絡(luò)選型對推理集群性能影響的角度出發(fā),設(shè)計與執(zhí)行了一系列實驗并收集了翔實的一手材料數(shù)據(jù)。

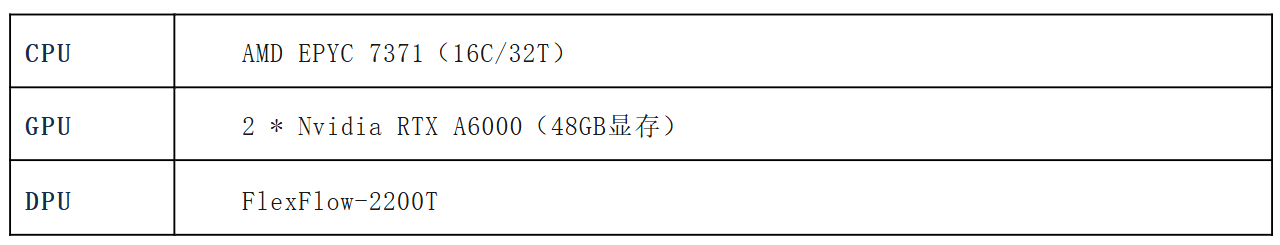

本實驗環(huán)境共采用了DeepSeek-R1-Distill-Qwen-32B未量化版本作為基礎(chǔ)模型,基于vLLM搭建了推理集群,并采用evalscope對推理效果完成了評估。本次時延共使用了兩臺雙GPU服務(wù)器,服務(wù)器基本配置如下:

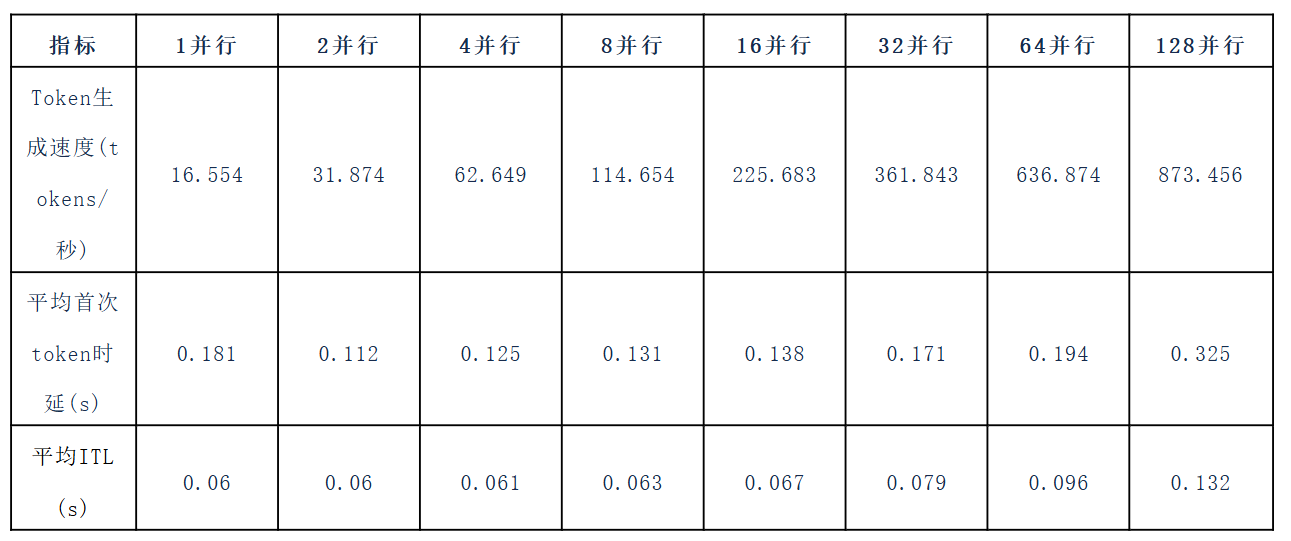

首先,我們關(guān)注采用TCP方式作為底層推理網(wǎng)絡(luò)基礎(chǔ)時,進(jìn)行了如下測試:

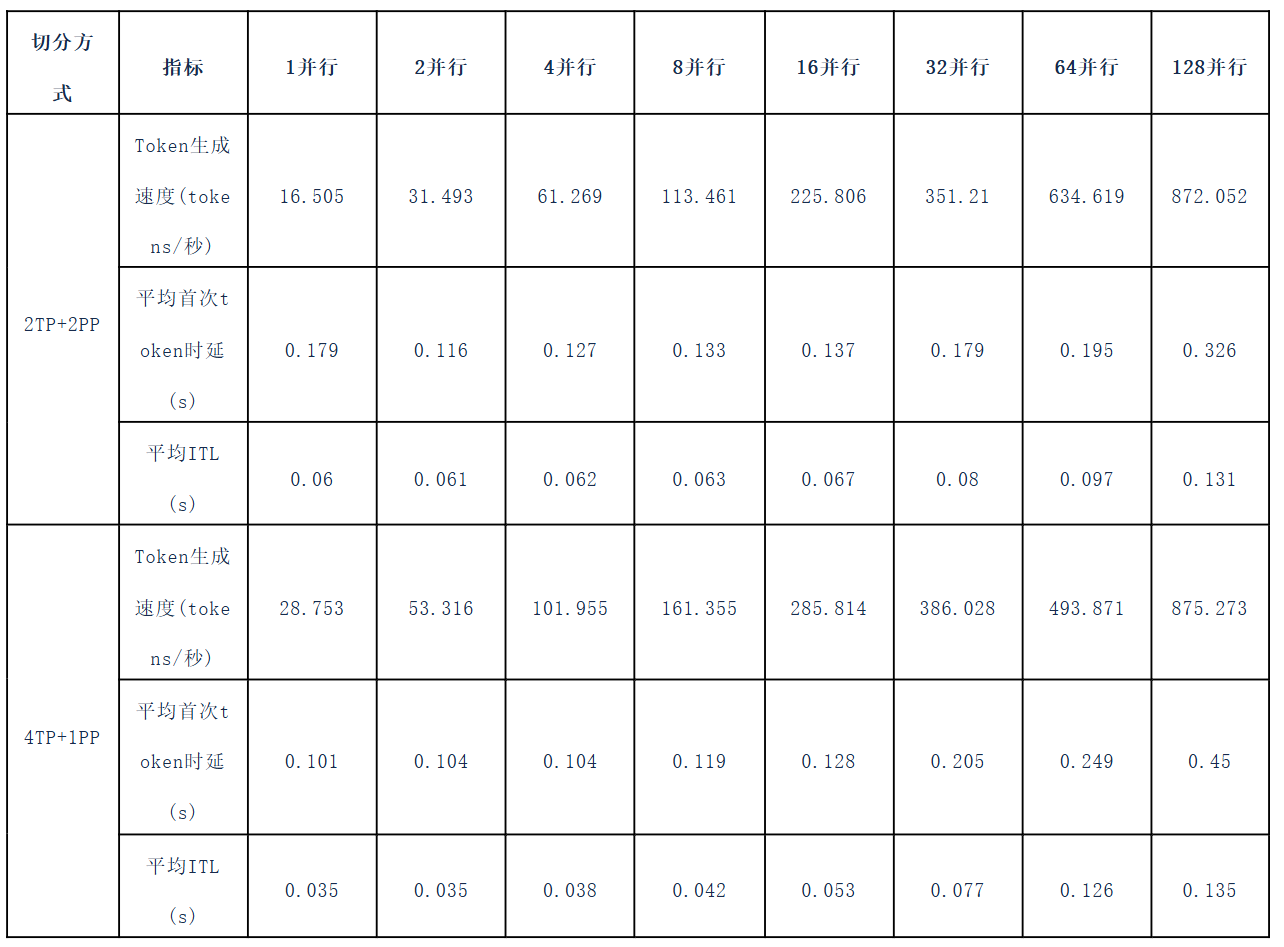

當(dāng)采用2TP+2PP的模型切割方式時,獲得了如下基礎(chǔ)數(shù)據(jù):

隨后切換到4TP+1PP模型切割模式,加大了不同節(jié)點(diǎn)間的矩陣數(shù)據(jù)交換需求,得到如下數(shù)據(jù):

為了更好的體現(xiàn)測試數(shù)據(jù)的公平性,本測試隨后選擇行業(yè)領(lǐng)導(dǎo)企業(yè)的成熟網(wǎng)卡產(chǎn)品進(jìn)行了實驗,得出了基本一致的數(shù)據(jù)測試結(jié)果。并且在TCP模式下,中科馭數(shù)FlexFlow-2200T設(shè)備基本達(dá)到了與國際一線廠商相同的能力水平。

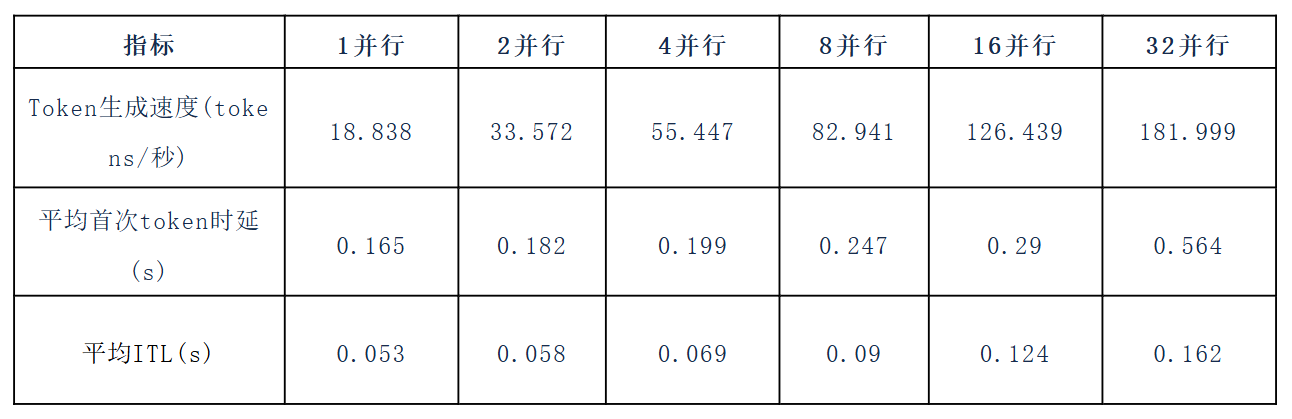

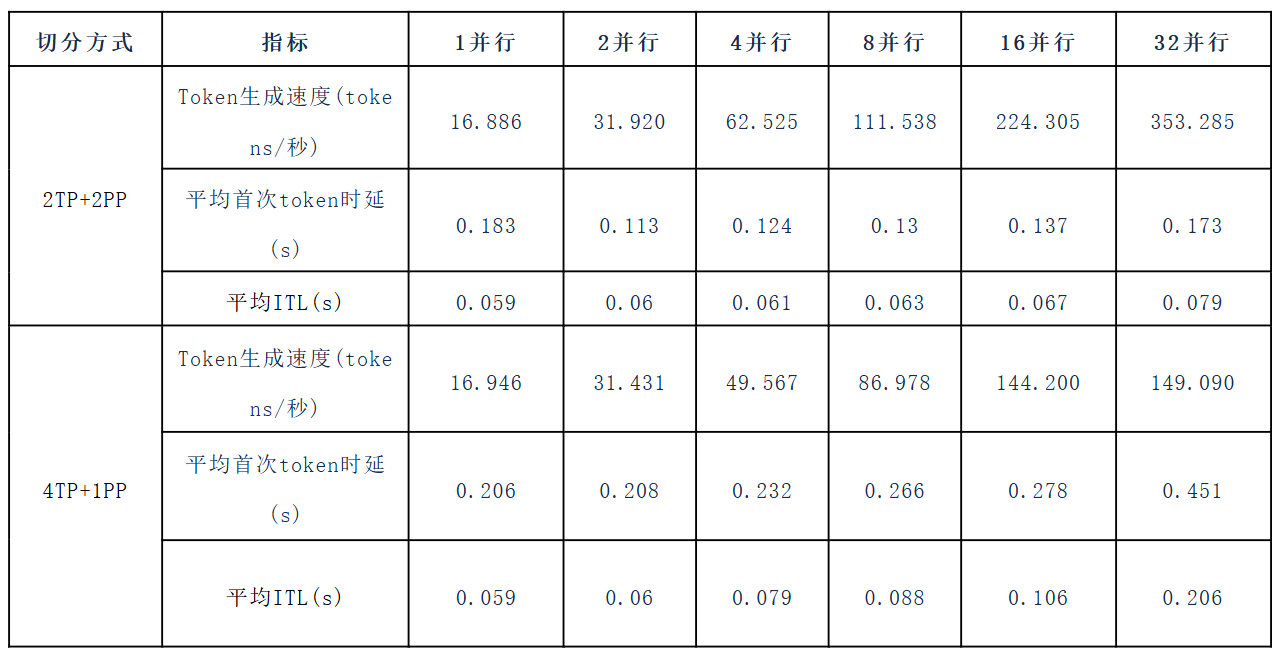

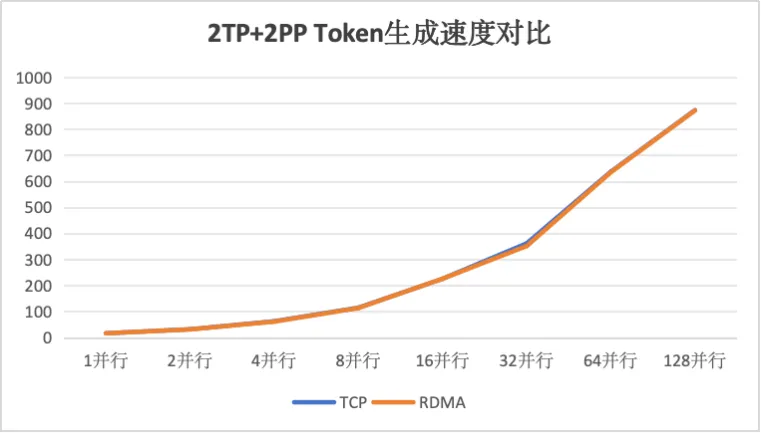

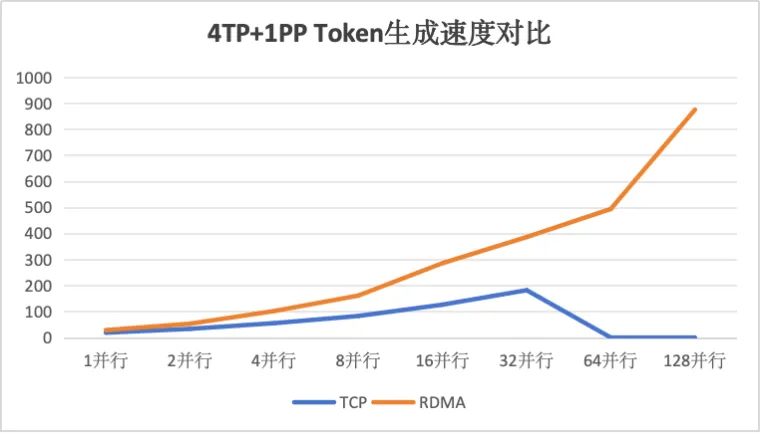

隨后,本實驗將底層基礎(chǔ)網(wǎng)絡(luò)技術(shù)切換為RDMA網(wǎng)絡(luò),進(jìn)行了測試驗證并收集到如下數(shù)據(jù):

通過對比可以得知在模型進(jìn)行良好切分設(shè)計的情況下,RDMA網(wǎng)絡(luò)并未能提升整體推理性能,但是在節(jié)點(diǎn)間需要傳遞張量數(shù)據(jù)的情況下,RDMA網(wǎng)絡(luò)可大幅提升模型推理性能,同時在大并發(fā)規(guī)模時,能夠更好的保持推理集群的服務(wù)穩(wěn)定性。

通過一系列的實驗結(jié)果,我們可以得出如下結(jié)論:

一、良好的模型切分設(shè)計可以大幅提升模型性能,此時無需引入復(fù)雜的RDMA網(wǎng)絡(luò)運(yùn)維,即可獲得最佳的推理性能體驗,從而獲得最高的投入產(chǎn)出比。

二、在單臺服務(wù)器GPU算力受限,不得不在節(jié)點(diǎn)間進(jìn)行張量切分時,可以使用RDMA網(wǎng)絡(luò)保證推理模型的服務(wù)性能與穩(wěn)定性。但是引入RDMA帶來性能提升的同時,成本的提升比例也是一致的。大家可以按照實際應(yīng)用場景,考慮多方因素后綜合選擇。

中科馭數(shù)的作為國內(nèi)全品種網(wǎng)卡的研發(fā)企業(yè),基于全自研、國產(chǎn)芯片K2-Pro打造的FlexFlow-2200T網(wǎng)卡,可以承擔(dān)智算大模型的網(wǎng)絡(luò)底座,為您的智算模型增加一顆“中國芯”。

審核編輯 黃宇

-

網(wǎng)卡

+關(guān)注

關(guān)注

4文章

344瀏覽量

29028 -

DPU

+關(guān)注

關(guān)注

0文章

415瀏覽量

27128 -

DeepSeek

+關(guān)注

關(guān)注

2文章

837瀏覽量

3366

發(fā)布評論請先 登錄

阿里巴巴發(fā)布通義千問旗艦推理模型Qwen3-Max-Thinking

LLM推理模型是如何推理的?

彰顯硬科技實力 中科馭數(shù)榮登VENTURE50硬科技榜 構(gòu)建DPU“運(yùn)力”底座

中科馭數(shù)西南總部落地成都天府新區(qū)

什么是AI模型的推理能力

NVIDIA Nemotron Nano 2推理模型發(fā)布

中科馭數(shù)亮相2025 CCF全國高性能計算學(xué)術(shù)大會

澎峰科技完成OpenAI最新開源推理模型適配

利用NVIDIA推理模型構(gòu)建AI智能體

速看!EASY-EAI教你離線部署Deepseek R1大模型

中科馭數(shù)高性能網(wǎng)卡產(chǎn)品 成就DeepSeek推理模型網(wǎng)絡(luò)底座

中科馭數(shù)高性能網(wǎng)卡產(chǎn)品 成就DeepSeek推理模型網(wǎng)絡(luò)底座

評論