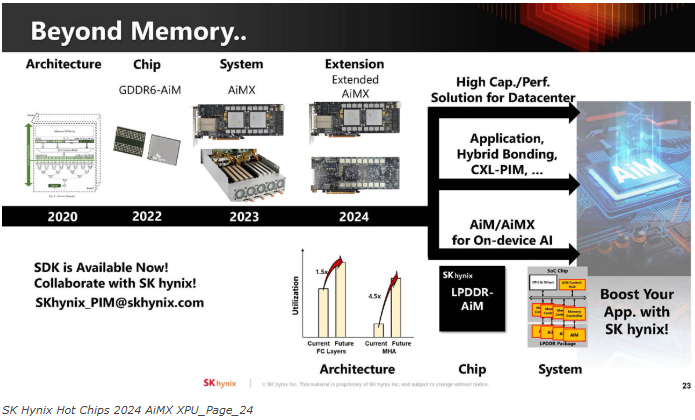

在Hot Chips 2024上,海力士專注于AI加速器的標準DRAM之外的產品。該公司展示了其在內存計算方面的最新進展,這次是用其AiMX-xPU和LPDDR-AiM進行LLM推理。其理念是,無需將數據從內存移動到計算以執行與內存相關的轉換,這些轉換可以直接在內存中完成,而無需遍歷互連。這使得它更節能,而且可能更快。

海力士在Hot Chips 2024上展示AI專用計算內存解決方案AiMX-xPU

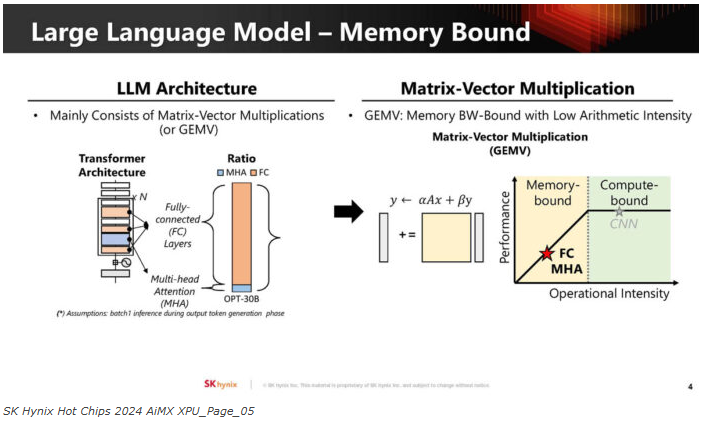

海力士表示,由于LLM的存儲空間有限,因此對LLM非常有用。

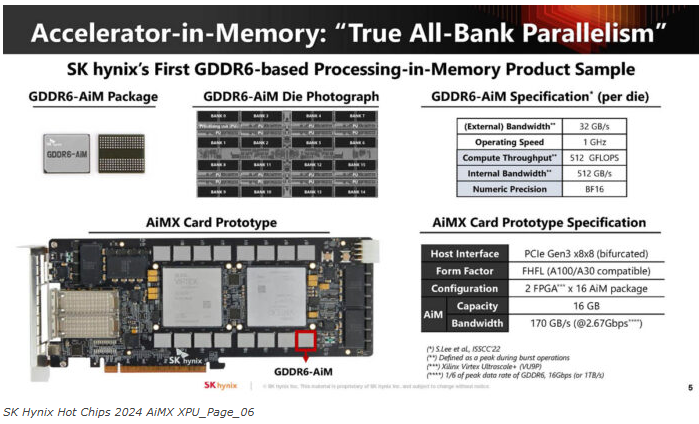

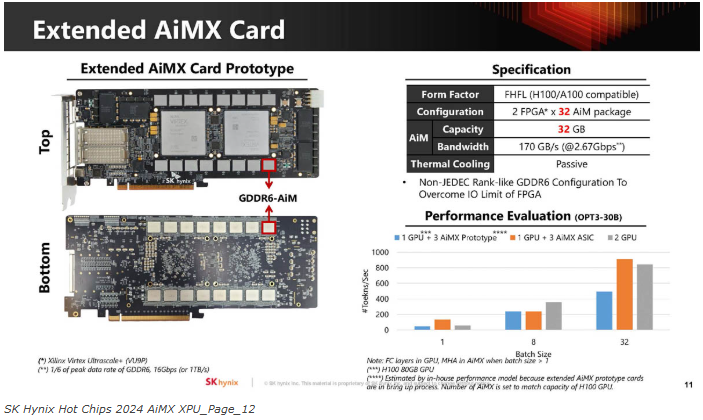

該公司展示了采用Xilinx VirtexFPGA和特殊GDDR6 AiM封裝的GDDR6內存加速器卡。

看下AiMX card:

下面是GDDR6芯片的外觀。

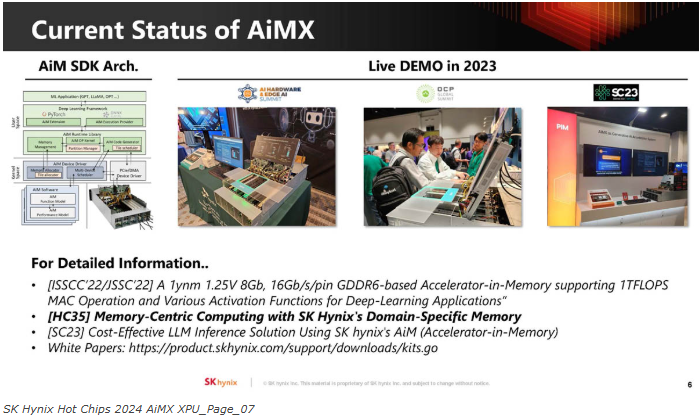

另外,海力士提到了OCP 2023的現場演示。

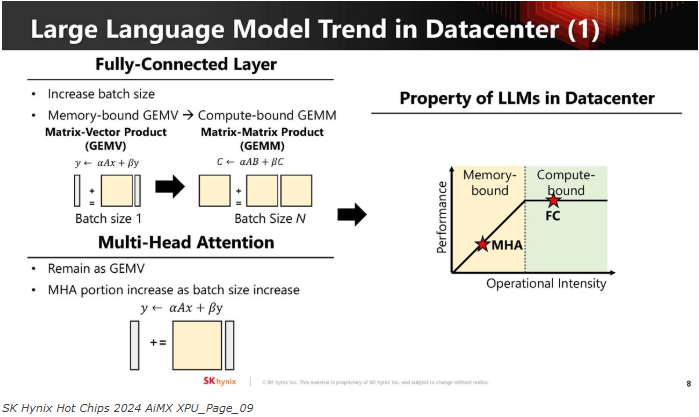

這是LLM的全連接層、Multi-Head Attention以及計算綁定部分。

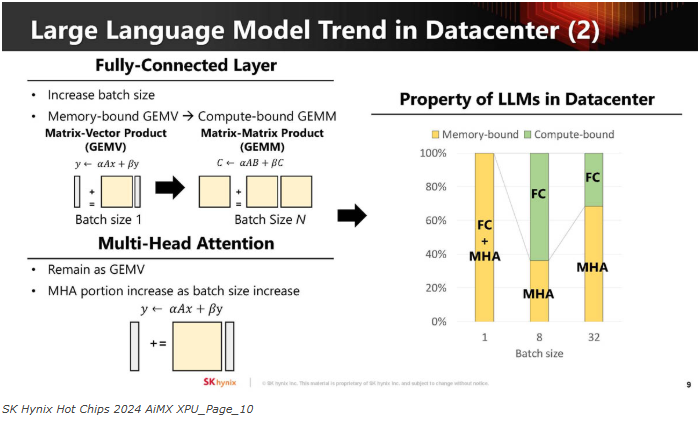

下圖展示壓力如何根據批量大小變化。

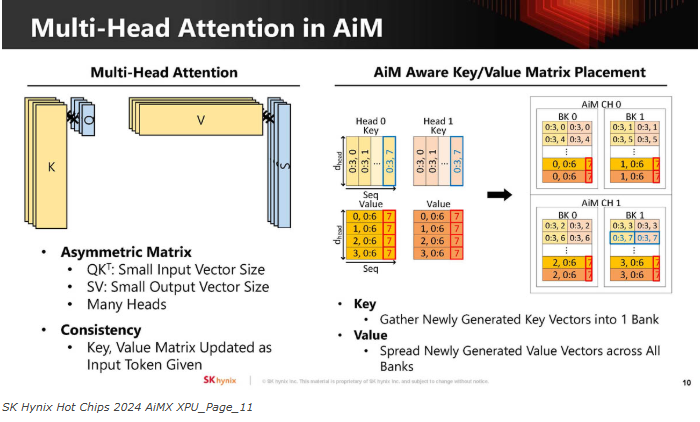

海力士將Multi-Head Attention映射到了AiM。

該公司還將內存容量增加了一倍,使用32個AIM軟件包,從16GB增加到32GB。32GB對于一款產品來說可能不夠,但對于一個原型機來說就足夠了。盡管如此,該公司還是展示了這項技術的性能。

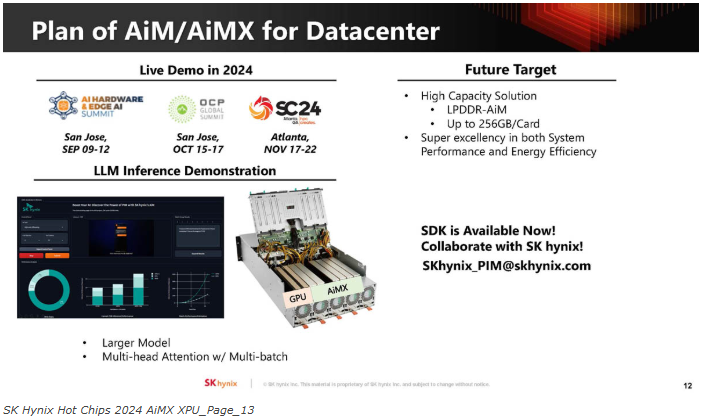

下一代演示將展示像Llama-3這樣的東西,該公司也在考慮將每張卡的容量從32GB擴展到256GB。

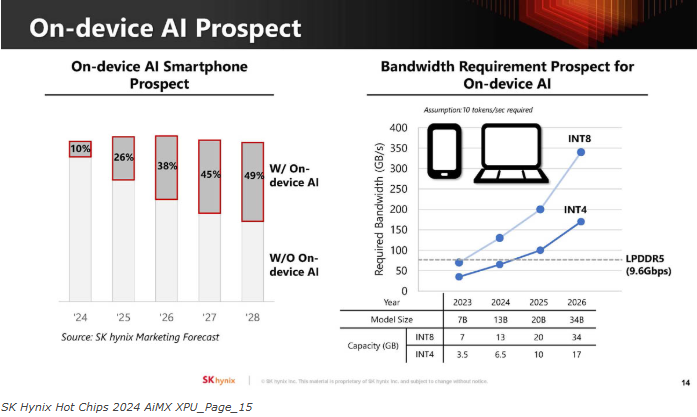

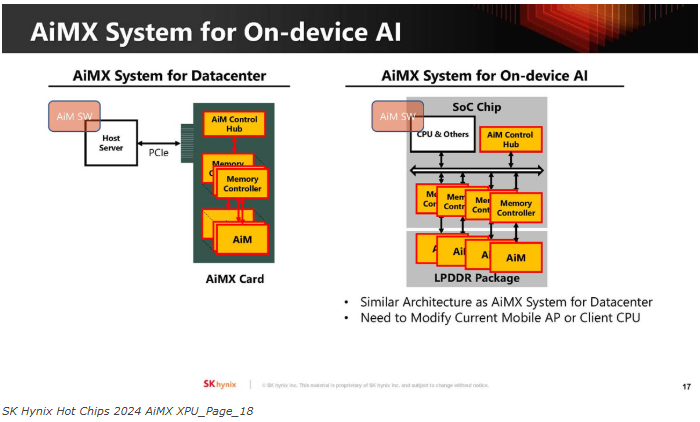

除了關注數據中心的AI,該公司還在關注設備上的AI。我們已經看到蘋果、英特爾、AMD和高通等公司在為人工智能推出NPU。

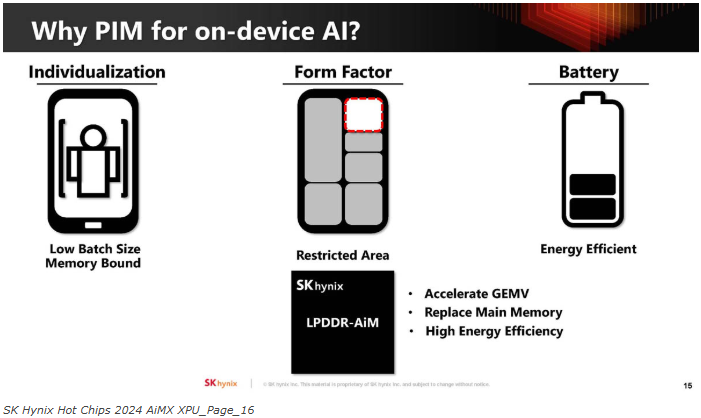

設備上的AI通常會降低批處理大小,因為這些工作負載受到內存限制。將計算移出SoC意味著它可以更節能,并且不會占用SoC上的計算芯片面積。

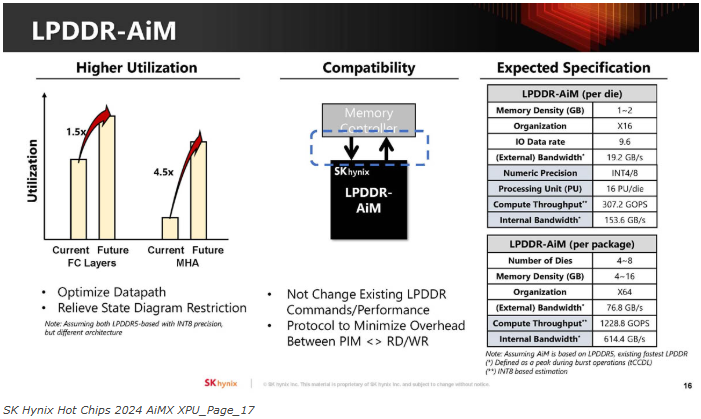

目標是在未來針對LPDDR5-AiM的產品中優化AiM。我們的目標是不更改現有的LPDDR命令,也不產生負面的性能影響。下表上的規格是預估的。

通過LPDDR5,它可以集成到移動設備的SoC上。

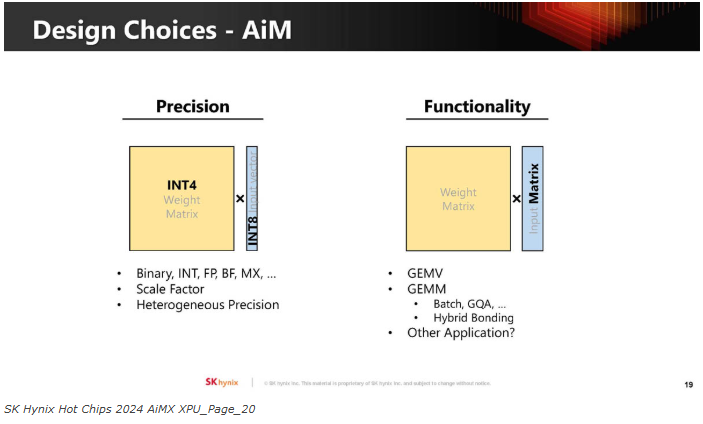

可能需要針對不同的應用程序進行不同的權衡。

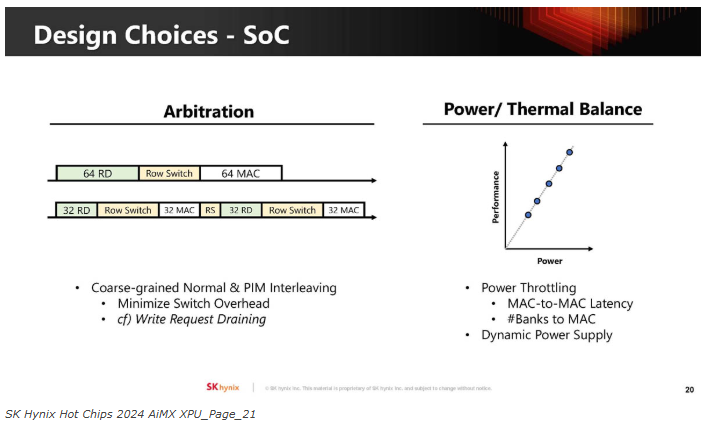

其中一個挑戰是在LPDDR內存的正常使用和計算需求之間進行仲裁。此外,還有可能改變芯片的熱/功率要求。

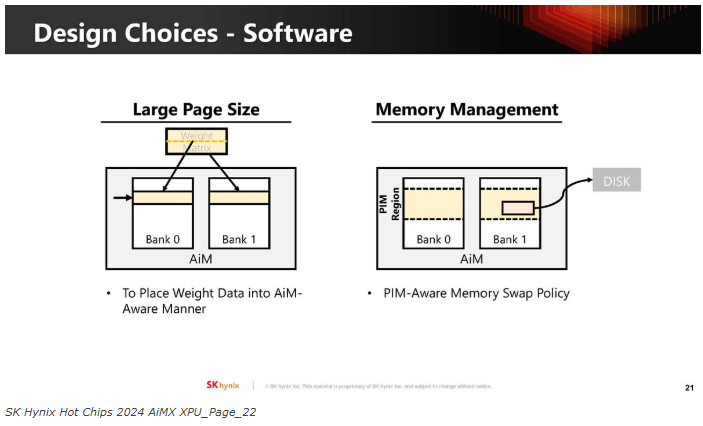

另一個挑戰是如何對AiM進行編程。

海力士似乎正在擴大AiM/ AiMX的使用范圍和種類。

海力士表示,在GDDR6中,AiM占據了約20%的芯片面積。

總結

內存計算在成為主流之前。仍然是一個主要的SoC/芯片供應商必須選擇和集成的東西。在許多方面,內存計算可能是有意義的。我們將拭目以待,看看這款產品能否從原型變成產品。

原文鏈接:

https://www.servethehome.com/sk-hynix-ai-specific-computing-memory-solution-aimx-xpu-at-hot-chips-2024/

-

海力士

+關注

關注

2文章

137瀏覽量

27124 -

soc

+關注

關注

40文章

4606瀏覽量

229710 -

內存

+關注

關注

9文章

3222瀏覽量

76448

原文標題:揭秘!海力士的推理和端側大模型加速卡

文章出處:【微信號:SSDFans,微信公眾號:SSDFans】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

慧榮科技于Embedded World 2026展示AI優化的啟動存儲與企業級解決方案

SK海力士與閃迪公司啟動HBF全球標準化制定工作

SK海力士在CES 2026展示面向AI的下一代存儲器解決方案

SK海力士HBS存儲技術,基于垂直導線扇出VFO封裝工藝

Credo發布業界首款內存扇出Gearbox

SK海力士發布未來存儲路線圖

SK海力士ZUFS 4.1閃存,手機端AI運行時間縮短47%!

SK海力士HBM技術的發展歷史

SK海力士攜HBM4及面向AI的存儲器產品組合亮相2025國際電腦展

海力士展示AI專用計算內存解決方案AiMX-xPU

海力士展示AI專用計算內存解決方案AiMX-xPU

評論