大語言模型(LLM)與多模態(tài)推理系統(tǒng)正迅速突破數(shù)據(jù)中心的局限。越來越多的汽車與機(jī)器人領(lǐng)域的開發(fā)者希望將對話式 AI 智能體、多模態(tài)感知系統(tǒng)和高級規(guī)劃功能直接部署在端側(cè),因?yàn)樵谶@些場景中,低延遲、高可靠性以及離線運(yùn)行能力至關(guān)重要。

目前主流的 LLM 和視覺語言模型(VLM)推理框架主要圍繞數(shù)據(jù)中心需求設(shè)計(jì),例如應(yīng)對大量并發(fā)用戶請求并最大化其吞吐量,而嵌入式推理場景則需要一套專用的定制化解決方案。

本文介紹了 NVIDIA TensorRT Edge-LLM——一個用于 LLM 和 VLM 推理的新型開源 C++ 框架,旨在滿足日益增長的高性能邊緣端推理需求。該框架專為嵌入式汽車平臺 NVIDIA DRIVE AGX Thor 及機(jī)器人平臺 NVIDIA Jetson Thor 上的實(shí)時應(yīng)用而打造。該框架已在 GitHub 上隨 NVIDIA JetPack 7.1 版本發(fā)布并開源。

TensorRT Edge-LLM 依賴項(xiàng)很少,專為實(shí)現(xiàn)量產(chǎn)級邊緣端應(yīng)用部署而設(shè)計(jì)。其精簡輕量化的設(shè)計(jì)專注于嵌入式場景的特定功能,能夠顯著降低框架的資源占用。

此外,TensorRT Edge-LLM 所具備的先進(jìn)功能——如 EAGLE-3 投機(jī)采樣、NVFP4 量化支持以及分塊預(yù)填充技術(shù),能夠滿足高要求的實(shí)時應(yīng)用場景所需的前沿的性能需求。

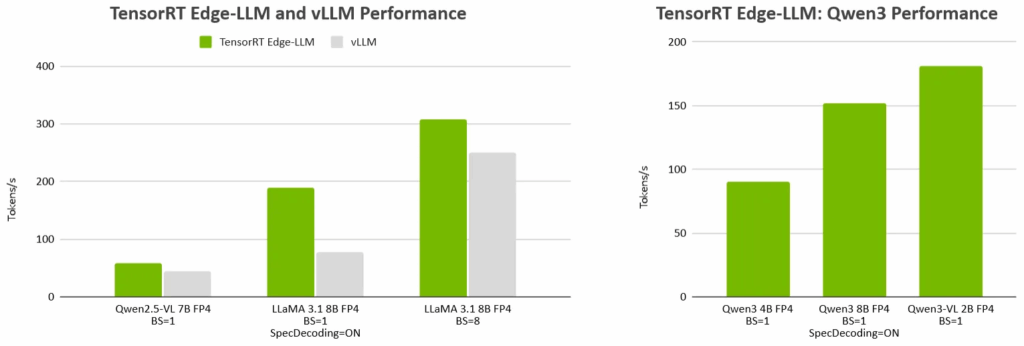

圖 1. 與主流 LLM 和 VLM 推理框架 vLLM 相比,TensorRT Edge-LLM 性能表現(xiàn)卓越。

面向?qū)崟r邊緣端應(yīng)用的 LLM 與 VLM 推理

邊緣端 LLM 推理任務(wù)和 VLM 推理任務(wù)具有以下特征:

請求來自少數(shù)或單一用戶

批處理規(guī)模較小,通常需跨多個攝像頭輸入

面向關(guān)鍵任務(wù)應(yīng)用的量產(chǎn)級部署

支持離線運(yùn)行且無需更新

因此,機(jī)器人和汽車領(lǐng)域的實(shí)時應(yīng)用提出了以下特定要求:

延遲低且可預(yù)測

最小化磁盤、內(nèi)存和計(jì)算資源的占用

符合量產(chǎn)標(biāo)準(zhǔn)

高魯棒性和高可靠性

TensorRT Edge-LLM 旨在滿足并優(yōu)先處理這些嵌入式場景的特定需求,為嵌入式 LLM 和 VLM 的推理提供堅(jiān)實(shí)基礎(chǔ)。

TensorRT Edge-LLM 在汽車行業(yè)的落地應(yīng)用

合作伙伴已開始將 TensorRT Edge-LLM 作為其車用 AI 產(chǎn)品的基礎(chǔ),其中博世、中科創(chuàng)達(dá)和 MediaTek 等企業(yè)在 CES 2026 上展示了其相關(guān)技術(shù)。

博世與 NVIDIA 及微軟共同開發(fā)新一代博世智能座艙,該座艙搭載的車載 AI 助手具備自然語音交互能力。該解決方案集成了嵌入式自動語音識別(ASR)與文本轉(zhuǎn)語音(TTS)AI 模型,并通過 TensorRT Edge-LLM 實(shí)現(xiàn) LLM 推理,從而構(gòu)建了一個強(qiáng)大的車載 AI 系統(tǒng)。同時,該系統(tǒng)還可通過精密協(xié)調(diào)器與云端的大型 AI 模型協(xié)同運(yùn)作。

中科創(chuàng)達(dá)將 TensorRT Edge-LLM 集成至其即將推出的 AIBOX 平臺,該平臺基于 NVIDIA DRIVE AGX Orin 架構(gòu),旨在為車內(nèi)提供響應(yīng)迅速的車端 LLM 及多模態(tài)推理能力。通過整合中科創(chuàng)達(dá)的汽車軟件棧與 TensorRT Edge-LLM 的輕量級 C++ 運(yùn)行時及優(yōu)化解碼路徑,該 AIBOX 能在嚴(yán)苛的功耗和內(nèi)存限制下,提供低延遲的語音交互與座艙輔助體驗(yàn)。

MediaTek 在其 CX1 系統(tǒng)級芯片中基于 TensorRT Edge-LLM 進(jìn)行開發(fā),以支持先進(jìn)的座艙 AI 與人機(jī)交互應(yīng)用。TensorRT Edge-LLM 加速了 LLM 和 VLM 的推理過程,適用于多種應(yīng)用場景,包括駕駛員和座艙活動監(jiān)測。同時,MediaTek 通過開發(fā)新型嵌入式專用推理方法,持續(xù)反哺 TensorRT Edge-LLM 的技術(shù)演進(jìn)。

隨著 TensorRT Edge-LLM 的發(fā)布,這些 LLM 和 VLM 的推理能力現(xiàn)已面向 NVIDIA Jetson 生態(tài)系統(tǒng)開放,可為機(jī)器人技術(shù)提供基礎(chǔ)支撐。

TensorRT Edge-LLM 技術(shù)解析

TensorRT Edge-LLM 旨在為 LLM 和 VLM 的推理提供一個端到端工作流。該流程涵蓋三個階段:

將 Hugging Face 模型導(dǎo)出為 ONNX 格式

針對目標(biāo)硬件構(gòu)建優(yōu)化的 NVIDIA TensorRT 引擎

在目標(biāo)硬件上運(yùn)行推理任務(wù)

圖 2. TensorRT Edge-LLM 工作流及關(guān)鍵組件

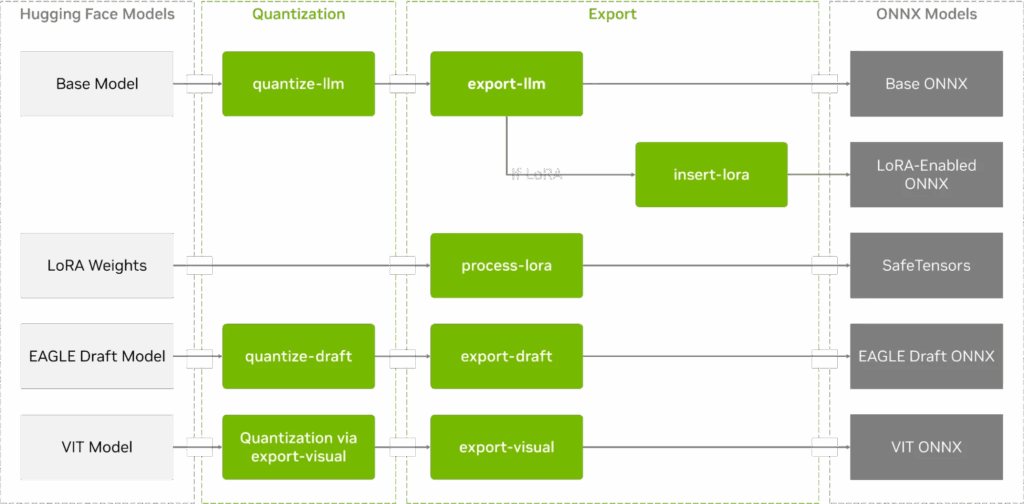

Python 導(dǎo)出流程能夠?qū)?Hugging Face 模型轉(zhuǎn)換為 ONNX 格式,并支持量化、LoRA 適配器和 EAGLE-3 投機(jī)采樣(圖 3)。

圖 3. TensorRT Edge-LLM Python導(dǎo)出流程階段與工具

引擎構(gòu)建器負(fù)責(zé)構(gòu)建專為嵌入式目標(biāo)硬件優(yōu)化的 TensorRT(圖 4)。

圖 4. TensorRT Edge-LLM 引擎構(gòu)建器工作流

C++ 運(yùn)行時負(fù)責(zé)在目標(biāo)硬件上執(zhí)行 LLM 和 VLM 的推理任務(wù)。它利用 TensorRT 引擎來實(shí)現(xiàn)自回歸模型解碼循環(huán):即基于輸入和先前生成 token 進(jìn)行迭代式的 token 生成。用戶應(yīng)用程序通過與該運(yùn)行時交互,來處理 LLM 和 VLM 的工作負(fù)載。

圖 5. TensorRT Edge-LLM C++ 運(yùn)行時的預(yù)填充與解碼階段

如需了解上述各組件的更多說明,請參閱 TensorRT Edge-LLM 的完整文檔。

開始使用 TensorRT Edge-LLM

準(zhǔn)備好在您的 Jetson AGX Thor 開發(fā)套件上開始 LLM 和 VLM 推理了嗎?

下載 JetPack 7.1 版本

克隆 NVIDIA/TensorRT-Edge-LLM GitHub 倉庫的 JetPack 7.1 發(fā)布分支:

git clone https://github.com/NVIDIA/TensorRT-Edge-LLM.git

查閱 TensorRT Edge-LLM 快速入門指南,了解如何從 Hugging Face 獲取開箱即用的支持模型、并將其轉(zhuǎn)換為 ONNX 格式、為 Jetson AGX Thor 平臺構(gòu)建 TensorRT 引擎,以及最終通過 C++ 運(yùn)行時進(jìn)行運(yùn)行的完整步驟。

參閱 TensorRT Edge-LLM 示例,了解更多特性和功能。

若需根據(jù)自身需求定制 TensorRT Edge-LLM,請參閱 TensorRT Edge-LLM 定制指南。

對于 NVIDIA DRIVE AGX Thor 用戶,TensorRT Edge-LLM 已作為 NVIDIA DriveOS 發(fā)行包的標(biāo)準(zhǔn)組件提供。后續(xù) DriveOS 版本將通過 GitHub 倉庫進(jìn)行發(fā)布。

隨著 LLM 和 VLM 快速向邊緣端遷移,TensorRT Edge-LLM 提供了一條清晰可靠的路徑,能夠?qū)?Hugging Face 模型直接部署至 NVIDIA 汽車和機(jī)器人平臺,實(shí)現(xiàn)實(shí)時、量產(chǎn)級落地。

探索工作流,充分測試模型效果,并著手構(gòu)建下一代智能端側(cè)應(yīng)用。了解更多信息,請?jiān)L問 NVIDIA/TensorRT-Edge-LLM GitHub 倉庫。

致謝

感謝 Michael Ferry、Nicky Liu、Martin Chi、Ruo Cheng Jia、Charl Li、Maggie Hu、Krishna Sai Chemudupati、Frederik Kaster、XiangGuo、Yuan Yao、Vincent Wang、Levi Chen、Chen Fu、Le An、Josh Park、Xinru Zhu、Chengming Zhao、Sunny Gai、Ajinkya Rasani、Zhijia Liu、Ever Wong、Wenting Jiang、Jonas Li、Po-Han Huang、Brant Zhao、Yiheng張和 Ashwin Nanjappa,感謝你們對 TensorRT Edge-LLM 的貢獻(xiàn)和支持。

關(guān)于作者

Lin Chai 是 NVIDIA 的高級產(chǎn)品經(jīng)理,負(fù)責(zé)領(lǐng)導(dǎo) TensorRT 和 TensorRTEdge-LLM,這是 NVIDIA 跨數(shù)據(jù)中心和嵌入式平臺深度學(xué)習(xí)的 AI 推理平臺。憑借在自動駕駛和汽車原始設(shè)備制造商 (OEM) 方面的背景,她受到啟發(fā),想要構(gòu)建生產(chǎn)級推理系統(tǒng),為數(shù)據(jù)中心、邊緣和物理 AI 應(yīng)用中的深度學(xué)習(xí)工作負(fù)載提供一流的性能,使系統(tǒng)能夠在現(xiàn)實(shí)世界中感知、推理和行動。

Felix Friedmann 是 NVIDIA DRIVE 平臺的產(chǎn)品和工程主管,涵蓋 NVIDIA 嵌入式 AI 推理和 NVIDIA DriveWorks。他將嵌入式視覺語言模型等最新技術(shù)創(chuàng)新與汽車軟件平臺所需的可靠性和安全性相結(jié)合。自 NVIDIA DRIVE 平臺問世以來,F(xiàn)elix 一直在前一個職位上與之合作,當(dāng)時他在奧迪將早期的深度學(xué)習(xí)模型引入嵌入式應(yīng)用程序,并為 atVW 的 AID 智能汽車和后來的 Argo AI 設(shè)計(jì)了感知和系統(tǒng)架構(gòu)。

Luxiao Zheng 是 NVIDIA 的高級系統(tǒng)軟件工程師。他是 TensorRT 一般性能團(tuán)隊(duì)的成員,專門從事大語言模型推理工作流程。他從事 x86_64 和 aarch64 平臺的端到端 LLM 軟件開發(fā)、性能測量、分析和改進(jìn)。陸曉持有理科碩士學(xué)位。計(jì)算機(jī)科學(xué)專業(yè),理學(xué)學(xué)士學(xué)位。計(jì)算機(jī)科學(xué)和理學(xué)學(xué)士學(xué)位。華盛頓大學(xué)化學(xué)工程專業(yè)的博士學(xué)位。

Fan Shi 是 NVIDIA TensorRT 團(tuán)隊(duì)的高級系統(tǒng)軟件工程師,專門負(fù)責(zé)在邊緣平臺上高效部署先進(jìn)的 AI 模型。他的工作重點(diǎn)是優(yōu)化深度學(xué)習(xí)推理的性能和可用性。風(fēng)扇擁有 M.S。卡耐基梅隆大學(xué)計(jì)算數(shù)據(jù)科學(xué)博士學(xué)位和理學(xué)學(xué)士學(xué)位。來自伊利諾伊大學(xué)的統(tǒng)計(jì)學(xué)和計(jì)算機(jī)科學(xué)博士學(xué)位。

Amber Liu 是 NVIDIA 的高級系統(tǒng)軟件工程師,專注于邊緣 AI 和大語言模型應(yīng)用。她與中國的客戶和合作伙伴密切合作,在自動駕駛、AI 駕駛艙和機(jī)器人領(lǐng)域?qū)崿F(xiàn) LLM 用例,幫助團(tuán)隊(duì)構(gòu)建生產(chǎn)就緒型邊緣 AI 系統(tǒng)。作為 TensorRT Edge? LLM 的核心貢獻(xiàn)者,她致力于開發(fā)高性能推理解決方案,將先進(jìn)的大語言模型引入嵌入式平臺。

-

機(jī)器人

+關(guān)注

關(guān)注

213文章

31263瀏覽量

223188 -

NVIDIA

+關(guān)注

關(guān)注

14文章

5674瀏覽量

110022 -

AI

+關(guān)注

關(guān)注

91文章

40578瀏覽量

302201

原文標(biāo)題:CES 2026 | NVIDIA TensorRT Edge-LLM 加速汽車與機(jī)器人領(lǐng)域的 LLM 和 VLM 推理

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達(dá)企業(yè)解決方案】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

DeepSeek R1 MTP在TensorRT-LLM中的實(shí)現(xiàn)與優(yōu)化

使用NVIDIA Triton和TensorRT-LLM部署TTS應(yīng)用的最佳實(shí)踐

中國機(jī)器人行業(yè)的現(xiàn)狀——行業(yè)***

中國工業(yè)機(jī)器人行業(yè)發(fā)展和未來趨勢分析

2016年工業(yè)機(jī)器人行業(yè)前瞻

工業(yè)機(jī)器人行業(yè)分析

機(jī)器人行業(yè)周報-政策與園區(qū)

無線模塊在機(jī)器人行業(yè)中需求量不斷增長

機(jī)器人行業(yè),我從哪里入手

新松眼中的機(jī)器人行業(yè)是怎么樣的?

現(xiàn)已公開發(fā)布!歡迎使用 NVIDIA TensorRT-LLM 優(yōu)化大語言模型推理

NVIDIA TensorRT-LLM Roadmap現(xiàn)已在GitHub上公開發(fā)布

解鎖NVIDIA TensorRT-LLM的卓越性能

在NVIDIA TensorRT-LLM中啟用ReDrafter的一些變化

NVIDIA TensorRT Edge-LLM在汽車與機(jī)器人行業(yè)的落地應(yīng)用

NVIDIA TensorRT Edge-LLM在汽車與機(jī)器人行業(yè)的落地應(yīng)用

評論