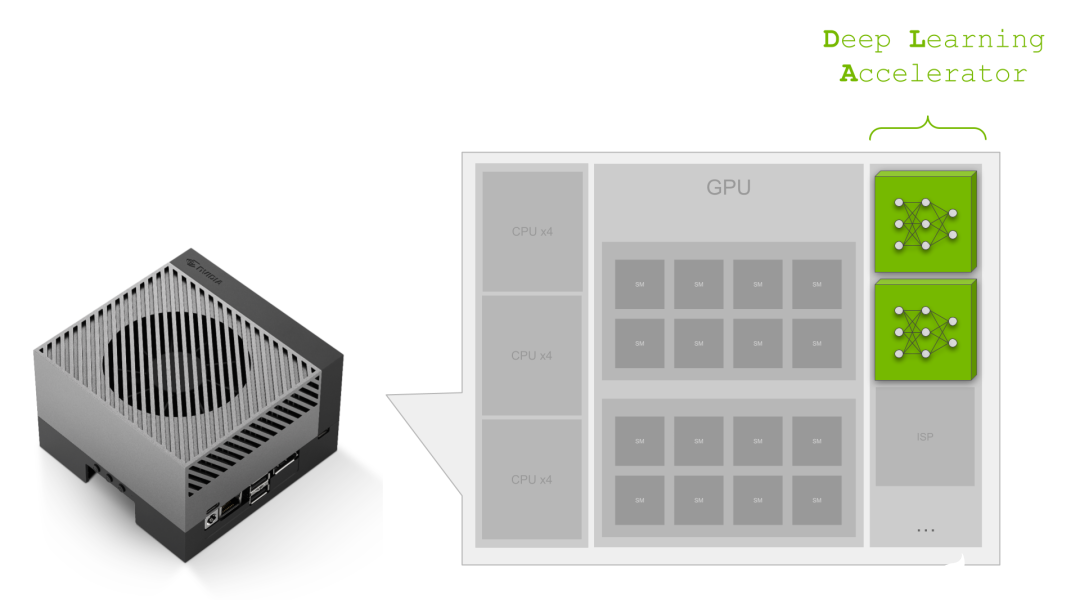

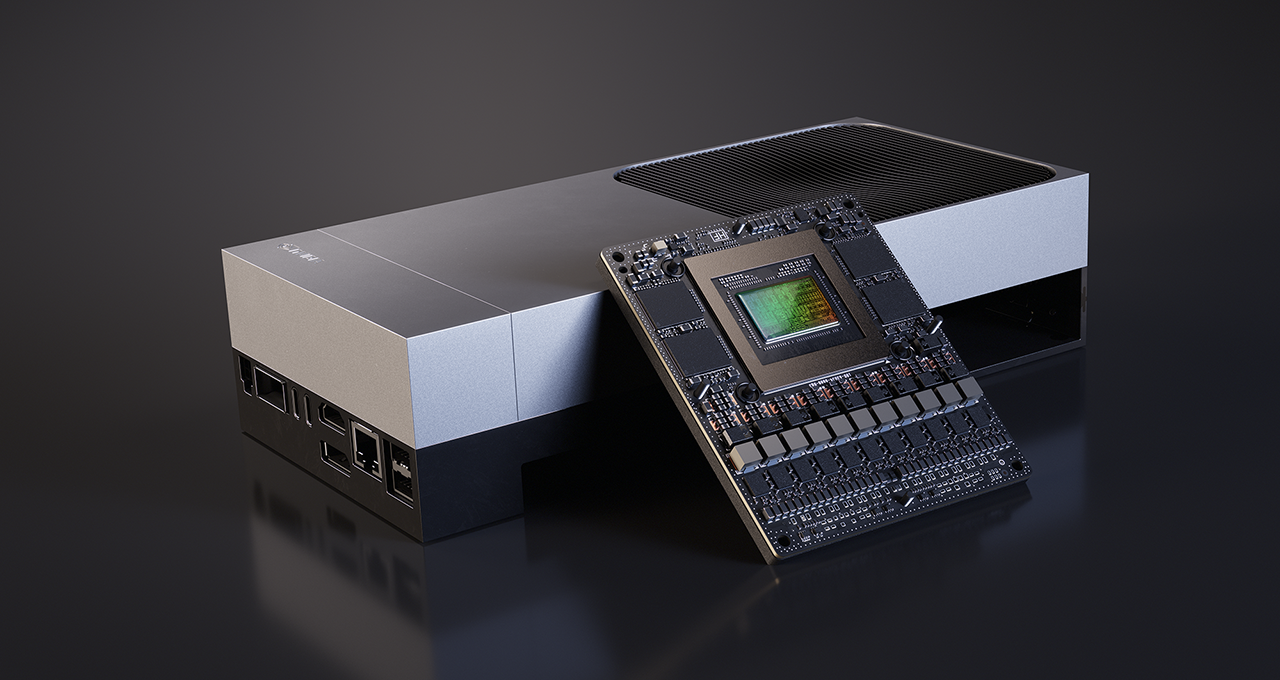

NVIDIA Jetson Orin 是同類嵌入式人工智能平臺中的翹楚。Jetson Orin SoC 模塊以 NVIDIA Ampere 架構 GPU 為核心,但 SoC 上還有更多的計算功能:

NVIDIA Orin SoC 的功能非常強大,擁有 275 個峰值 AI TOPs,是最佳的嵌入式和汽車 AI 平臺。您知道嗎,這些 AI TOPs 中近 40% 來自 NVIDIA Orin 上的兩個 DLA?NVIDIA Ampere GPU 擁有同類產品中最佳的吞吐量,而第二代 DLA 則擁有同類產品中最佳的能效。近年來,隨著 AI 應用的快速增長,對更高效計算的需求也在不斷增長。在能效始終是關鍵 KPI 的嵌入式方面尤其如此。

這就是 DLA 的用武之地。DLA 專門為深度學習推理而設計,可以比 CPU 更有效地執行卷積等計算密集型深度學習操作。

當集成到 SoC(如Jetson AGX Orin 或 NVIDIA DRIVE Orin)中時, GPU 和 DLA 的組合可以為您的嵌入式 AI 應用程序提供一個完整的解決方案。我們將在這篇文章中討論深度學習加速器,讓您不再錯過。我們將介紹涵蓋汽車和機器人領域的幾個案例研究,以展示 DLA 如何幫助 AI 開發者為其應用程序添加更多功能和性能。最后,我們將介紹視覺 AI 開發者如何使用 DeepStream SDK 構建應用工作流,使用 DLA 和整個 Jetson SoC 實現最佳性能。

以下是 DLA 會產生重大影響的一些關鍵性能指標。

關鍵性能指標

在設計應用程序時,您需要滿足一些關鍵性能指標或 KPI。例如最大性能和能效之間的設計權衡,這需要開發團隊仔細分析和設計應用程序,以便在 SoC 上使用不同的 IP。

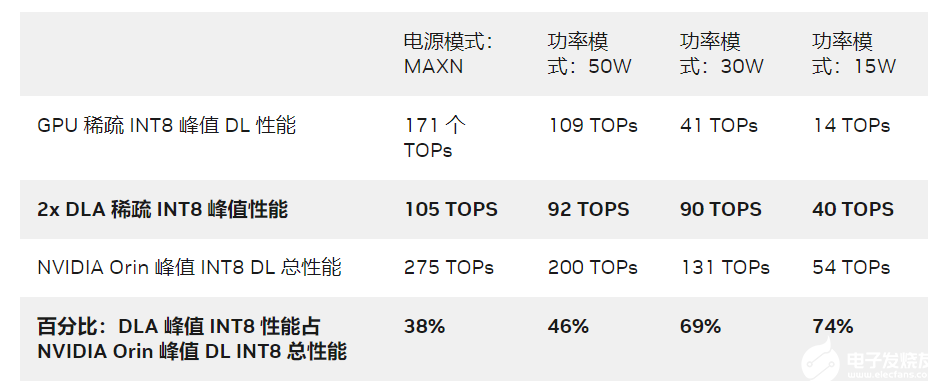

如果應用程序的關鍵 KPI 是延遲,則必須在一定的延遲預算下在應用程序中安排任務。您可以將 DLA 作為加速器,用于與運行在 GPU 上的計算密集型任務并行的任務。DLA 峰值性能對 NVIDIA Orin 整體深度學習(DL)性能的貢獻率在 38% 至 74% 之間,具體取決于電源模式。

表 1. DLA 吞吐量

Jetson AGX Orin 64GB 上 30W 和 50W 功率模式的 DLA TOPs 與 NVIDIA DRIVE Orin 汽車平臺上的最大時鐘相當。

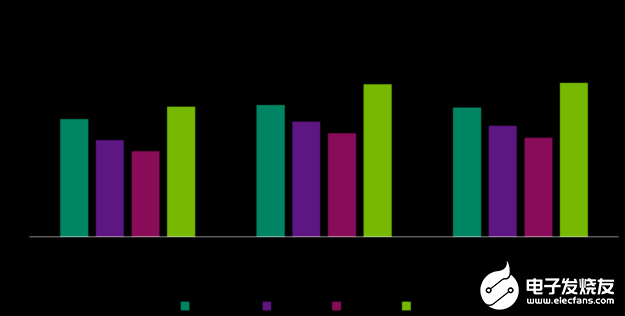

如果功耗是您的關鍵 KPI 之一,那么就應該考慮使用 DLA 來利用其功耗效率方面的優勢。與 GPU 相比,每瓦 DLA 的性能平均高出 3–5 倍,這具體取決于電源模式和工作負載。以下圖表顯示了代表常見用例的三個模型的每瓦性能。

圖 1. DLA 能效

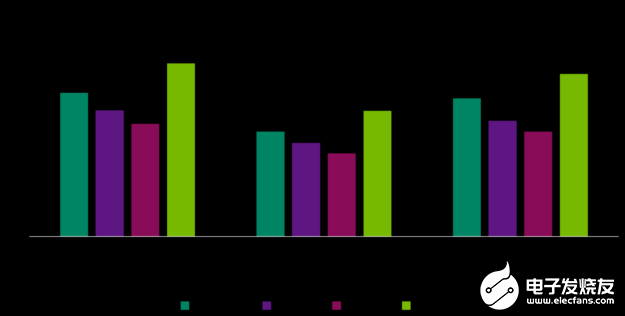

圖 2. 結構化稀疏性和每瓦性能優勢

換句話說,如果沒有 DLA 的能效,就不可能在給定的平臺功率預算下在 NVIDIA Orin 上實現高達 275 個峰值的 DL TOPs。想要了解更多信息和更多型號的測量結果,請參閱 DLA-SW GitHub 庫。

以下是 NVIDIA 內部如何在汽車和機器人領域使用 DLA 提供的 AI 計算的一些案例研究。

案例研究:汽車

NVIDIA DRIVE AV是端到端的自動駕駛解決方案堆棧,可幫助汽車原始設備制造商在其汽車產品組合中添加自動駕駛和映射功能。它包括感知層、映射層和規劃層,以及基于高質量真實駕駛數據訓練的各種 DNN。

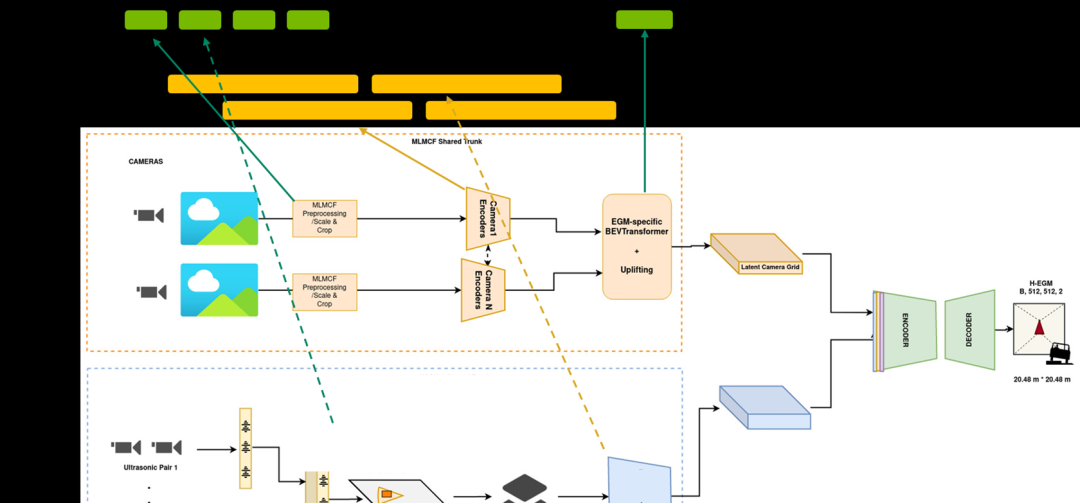

NVIDIA DRIVE AV 團隊的工程師致力于設計和優化感知、映射,并通過利用整個 NVIDIA Orin SoC 平臺規劃工作流。考慮到自動駕駛堆棧中需要處理大量的神經網絡和其他非 DNN 任務,它們會依靠 DLA 作為 NVIDIA Orin SoC 上的專用推理引擎來運行 DNN 任務。這一點至關重要,因為 GPU 計算能力是為處理非 DNN 任務而保留的。如果沒有 DLA 計算,團隊將無法達到 KPI。

圖3.感知管線的一部分

想要了解更多信息,請訪問Near-Range Obstacle Perception with Early Grid Fusion:https://developer.nvidia.cn/zh-cn/blog/near-range-obstacle-perception-with-early-grid-fusion/

例如,在感知工作流中,它們有來自八個不同相機傳感器的輸入,整個工作流的延遲必須低于某個閾值。感知堆棧是 DNN 的重頭戲,占所有計算的 60% 以上。

為了達到這些 KPI,并行工作流任務被映射到 GPU 和 DLA,其中幾乎所有的 DNN 都在 DLA 上運行,而非 DNN 任務則在 GPU 上運行,以實現總體工作流的延遲目標。然后,其他 DNN 在映射和規劃等其他工作流中按順序或并行消耗輸出。您可以將工作流視為一個巨大的圖形,其中的任務在 GPU 和 DLA 上并行運行。通過使用 DLA,該團隊將延遲降低了 2.5 倍。

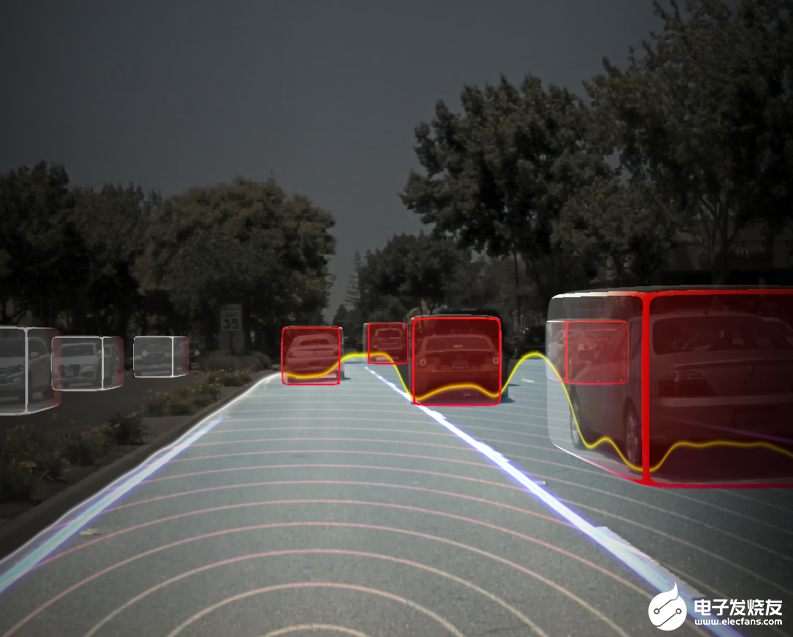

圖 4. 作為感知堆棧一部分的對象檢測

NVIDIA 自動駕駛團隊工程經理 Abhishek Bajarger 表示:“利用整個 SoC,特別是 DLA 中專用的深度學習推理引擎,使我們能夠在滿足延遲要求和 KPI 目標的同時,為軟件堆棧添加重要功能。只有 DLA 才能做到這一點。”

案例研究:機器人

NVIDIA Isaac 是一個功能強大的端到端平臺,用于開發、仿真和部署機器人開發者使用的 AI 機器人。特別是對于移動機器人來說,可用的 DL 計算、確定性延遲和電池續航能力是非常重要的因素。這就是為什么將 DL 推理映射到 DLA 非常重要的原因。

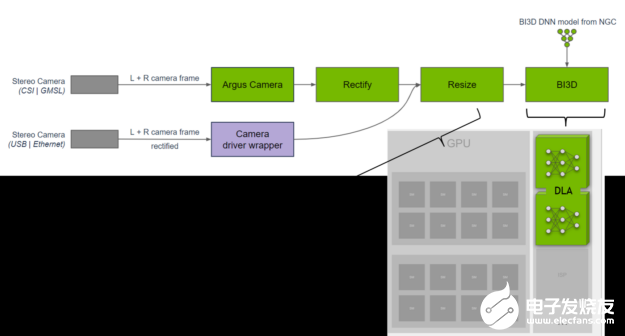

NVIDIA Isaac 團隊的一組工程師開發了一個使用 DNN 進行臨近分割的庫。鄰近分割可用于確定障礙物是否在鄰近場內,并避免在導航過程中與障礙物發生碰撞。他們在 DLA 上實現了 BI3D 網絡,該網絡可通過立體攝像頭執行二進制深度分類。

圖 5. 近距離分割流水線

一個關鍵的 KPI 是確保從立體攝像頭輸入進行 30 幀/秒的實時檢測。NVIDIA Isaac 團隊將這些任務分配到 SoC 上,并將 DLA 用于 DNN,同時為在 GPU 上運行的硬件和軟件提供功能安全多樣性。想要了解更多信息,請訪問NVIDIA Isaac ROS 鄰近分割:https://github.com/NVIDIA-ISAAC-ROS/isaac_ros_proximity_segmentation

圖 6. 使用 BI3D 對立體輸入進行鄰近分割

將 NVIDIA DeepStream 用于 DLA

探索 DLA 最快捷的方式是通過 NVIDIA DeepStream SDK,一個完整的流分析工具包。

如果你是一名視覺 AI 開發者,正在構建 AI 驅動的應用程序來分析視頻和傳感器數據,那么 DeepStream SDK 可以幫助您構建最佳的端到端工作流。對于零售分析、停車管理、物流管理、光學檢測、機器人技術和體育分析等云端或邊緣用例,DeepStream 可讓您不費吹灰之力就能使用整個 SoC,特別是 DLA。

例如,您可以使用下表中突出顯示的 Model Zoo 中的預訓練模型在 DLA 上運行。在 DLA 上運行這些網絡就像設置一個標志一樣簡單。想要了解更多信息,請訪問如何使用 DLA 進行推理:https://docs.nvidia.com/metropolis/deepstream/dev-guide/text/DS_Quickstart.html#using-dla-for-inference

表 2. Model Zoo 網絡樣本

及其在 DLA 上的吞吐量

開始使用深度學習加速器

準備好深入了解了嗎?有關詳細信息,請參閱以下資源:

-

Jetson DLA 教程演示了基本的 DLA 工作流,幫助您開始將 DNN 部署到 DLA:https://github.com/NVIDIA-AI-IOT/jetson_dla_tutorial

-

DLA-SW GitHub存儲庫中有一系列參考網絡,您可以使用它們來探索在 Jetson Orin DLA 上運行 DNN:https://github.com/NVIDIA/Deep-Learning-Accelerator-SW/tree/main/scripts/prepare_models

-

示例頁面提供了關于如何使用 DLA 充分利用 Jetson SoC 的其他示例和資源:https://github.com/NVIDIA/Deep-Learning-Accelerator-SW/

-

DLA 論壇有其他用戶的想法和反饋:https://forums.developer.nvidia.com/tag/dla

SIGGRAPH 2023

NVIDIA 精彩發布

SIGGRAPH 2023 | NVIDIA 主題演講重磅發布精彩回顧,探索 AI 無限未來!

敬請持續關注...

SIGGRAPH 2023 NVIDIA 主題演講中文字幕版已上線 !掃描下方海報二維碼,或點擊“閱讀原文”即可觀看,與 NVIDIA 創始人兼首席執行官黃仁勛一起探索 AI 的未來!

原文標題:使用 DLA 在 NVIDIA Jetson Orin 上最大限度地提高深度學習性能

文章出處:【微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

-

英偉達

+關注

關注

23文章

4086瀏覽量

99169

原文標題:使用 DLA 在 NVIDIA Jetson Orin 上最大限度地提高深度學習性能

文章出處:【微信號:NVIDIA_China,微信公眾號:NVIDIA英偉達】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

如何在NVIDIA Jetson AGX Thor上部署1200億參數大模型

如何在NVIDIA Jetson Thor上提升機器人感知效率

NVIDIA Jetson系列開發者套件助力打造面向未來的智能機器人

如何在NVIDIA Jetson AGX Thor上通過Docker高效部署vLLM推理服務

NVIDIA Jetson AGX Thor Developer Kit開發環境配置指南

通過NVIDIA Jetson AGX Thor實現7倍生成式AI性能

NVIDIA Jetson AGX Thor開發者套件重磅發布

基于 NVIDIA Blackwell 的 Jetson Thor 現已發售,加速通用機器人時代的到來

使用u-blox NORA-W4 Wi-Fi 6模塊提高工業物聯網性能

NVIDIA Jetson AGX Thor開發者套件概述

Jetson平臺核心組件BOM清單概覽

NVIDIA Jetson + Isaac SDK 在人形機器人領域的方案詳解

Made with KiCad(126):Antmicro OV5640 雙攝像頭子板

邊緣AI MPU深度盤點:品牌、型號與技術特性全解析

研華NVIDIA Jetson Orin Nano系統支持Super Mode

使用 DLA 在 NVIDIA Jetson Orin 上最大限度地提高深度學習性能

使用 DLA 在 NVIDIA Jetson Orin 上最大限度地提高深度學習性能

評論