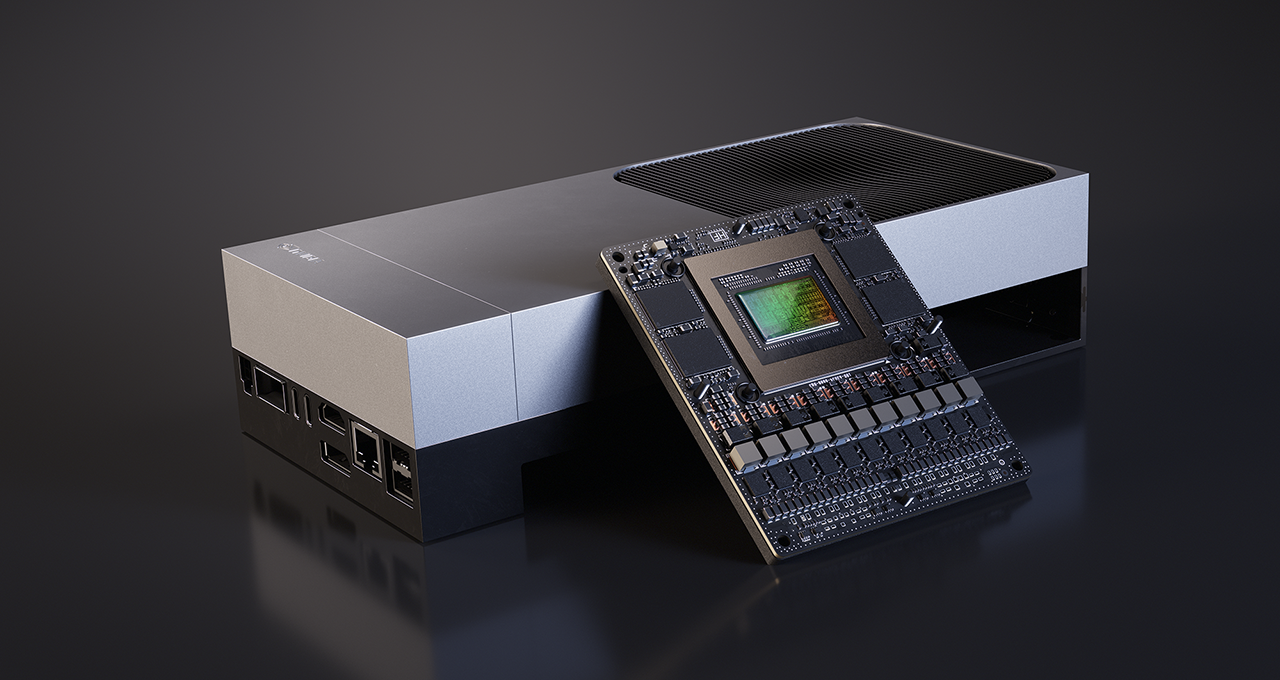

NVIDIA 軟件生態系統的一大顯著優勢,在于其始終堅持持續優化。今年 8 月,NVIDIA Jetson AGX Thor正式開售,與上一代產品Jetson AGX Orin相比,生成式 AI 性能最高提升至 5 倍。通過發布后的軟件更新優化,Jetson Thor 的生成式 AI 吞吐量提升至 7 倍。開發者可以在 Llama、DeepSeek 等模型上體驗到性能的提升,未來推出的新模型預計也能帶來類似的優勢。除了持續優化軟件外,NVIDIA 還會為主流模型提供支持,并且往往能在新模型發布后的幾天內完成適配,以便開發者能夠盡早嘗試和測試最新的 AI 模型。

Jetson Thor 平臺還支持多種主流量化格式,包括 NVIDIA Blackwell GPU 架構的新 NVFP4 格式,有助于進一步優化推理性能。該平臺同時支持推測解碼等新技術,為在邊緣端加速生成式 AI 工作負載提供了新的途徑。

本文將介紹 NVIDIA 如何通過持續優化其 Jetson 平臺的軟件生態系統,提升生成式 AI 的性能,并說明了實現這些性能提升的關鍵技術,如量化和預測性解碼。

持續性軟件優化:隨著近期 vLLM 容器的發布,Jetson Thor 在相同模型和量化配置的情況下,性能相比 8 月底首發時提升了最高達 3.5 倍。Jetson Thor 現已支持在 vLLM 容器中運行 Eagle 3 預測性解碼,進一步提升了生成式 AI 模型的性能。

借助 Jetson Thor 提升生成式 AI 性能:Jetson Thor 在邊緣端生成式 AI 應用中表現出強大的性能,但要充分發揮其潛力,必須采用合適的技術方案。量化與預測解碼兩種關鍵技術能夠顯著加速大語言模型(LLM)和視覺語言模型(VLM)的推理過程。

量化:減小模型體積,提升推理速度。量化的核心在于降低包括權重和激活值等模型數據的數值精度。通常,會將標準的 16 位格式,如 FP16 或 BF16,轉換為 8 位或 4 位等更低位的格式,這會帶來兩大優勢:更小的顯存占用和更快的內存訪問速度。

預測解碼:通過草稿驗證解碼方法提升推理速度。該技術通過結合兩個模型來加速推理過程:一個快速的小型“草稿”模型和一個高精度的大型“目標”模型。該“起草和驗證”過程在每個周期內生成多個 token,同時確保最終輸出與目標模型獨立生成的結果保持一致。其效能核心取決于接受率。接受率過低會顯著增加延遲,而接受率過高則可能導致計算資源消耗上升,因此使用能夠反映實際工作負載的提示進行基準測試尤為關鍵。

-

NVIDIA

+關注

關注

14文章

5671瀏覽量

110000 -

AI

+關注

關注

91文章

40538瀏覽量

302148 -

模型

+關注

關注

1文章

3785瀏覽量

52208

原文標題:通過 NVIDIA Jetson AGX Thor 實現 7 倍生成式 AI 性能,解鎖更快速、更智能的邊緣模型

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

如何在NVIDIA Jetson AGX Thor上部署1200億參數大模型

NVIDIA Jetson系列開發者套件助力打造面向未來的智能機器人

如何在NVIDIA Jetson AGX Thor上通過Docker高效部署vLLM推理服務

BPI-AIM7 RK3588 AI與 Nvidia Jetson Nano 生態系統兼容的低功耗 AI 模塊

全新QNX OS for Safety 8集成至NVIDIA DRIVE AGX Thor開發者套件

奧比中光3D相機矩陣接入NVIDIA Jetson Thor平臺

研華科技推出基于NVIDIA Jetson Thor平臺的邊緣AI新品MIC-743

ADI借助NVIDIA Jetson Thor平臺加速人形機器人研發進程

NVIDIA Jetson AGX Thor開發者套件重磅發布

NVIDIA三臺計算機解決方案如何協同助力機器人技術

基于 NVIDIA Blackwell 的 Jetson Thor 現已發售,加速通用機器人時代的到來

通過NVIDIA Jetson AGX Thor實現7倍生成式AI性能

通過NVIDIA Jetson AGX Thor實現7倍生成式AI性能

評論