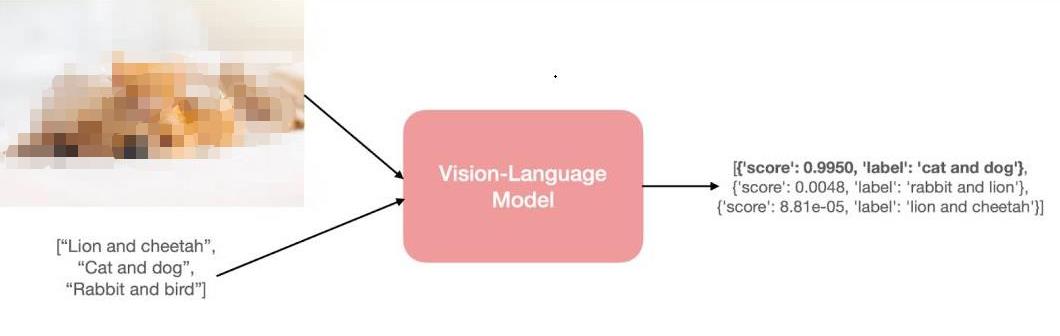

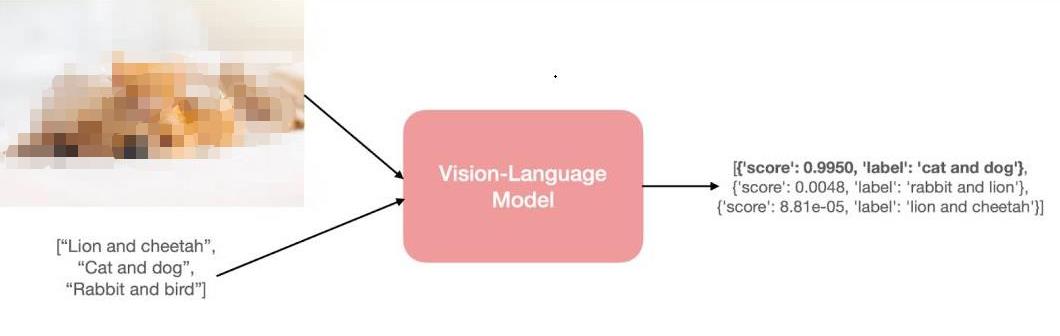

將模型稱為 “視覺語言” 模型是什么意思?一個結合了視覺和語言模態的模型?但這到底是什么意思呢?

2023-03-03 09:49:37 1578

1578

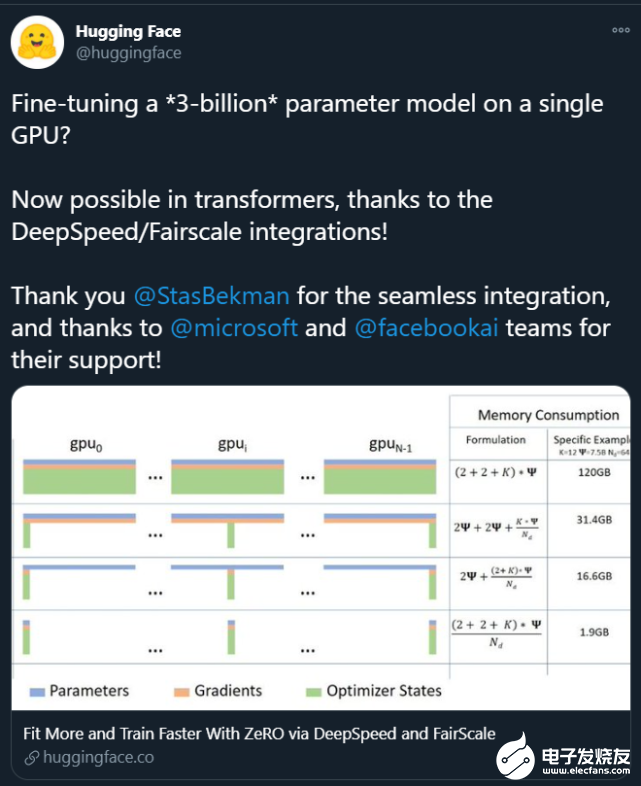

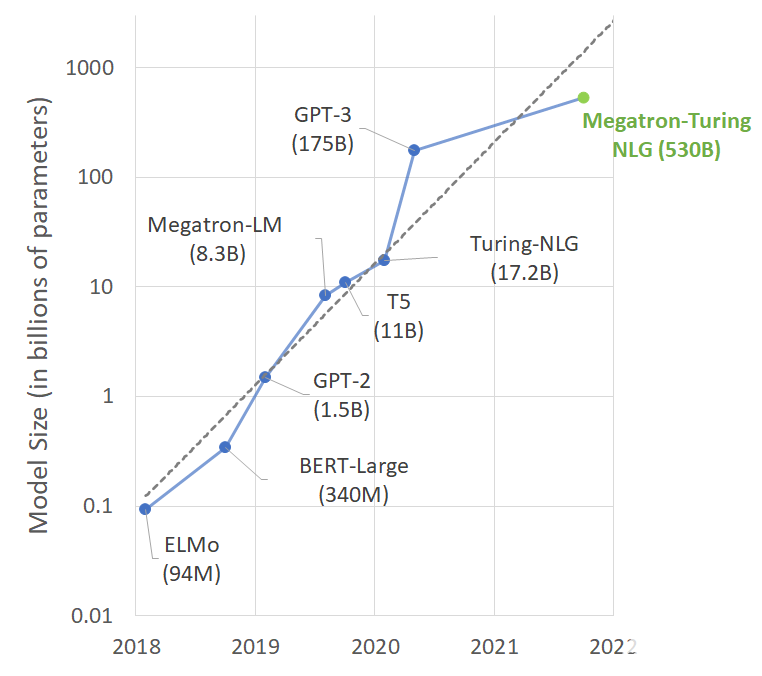

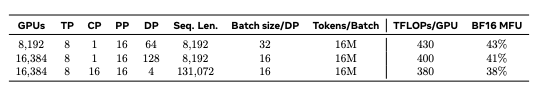

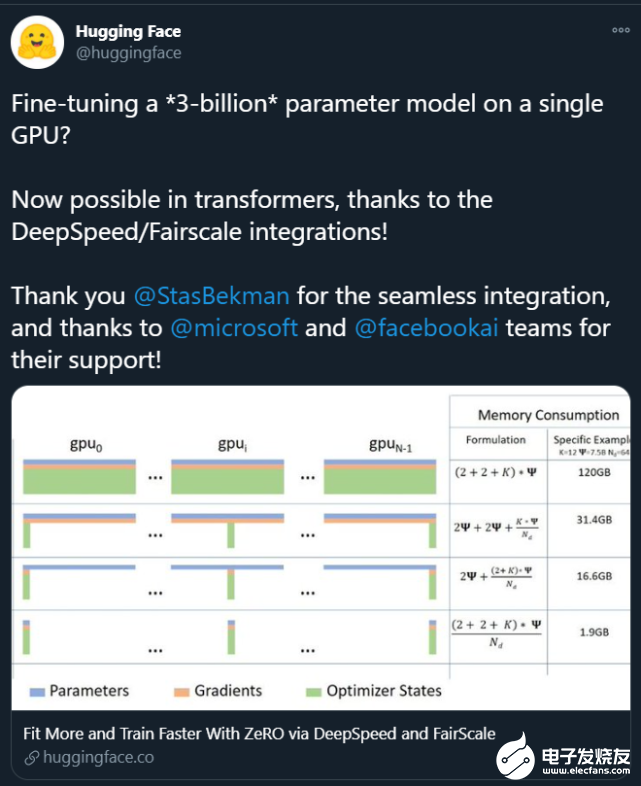

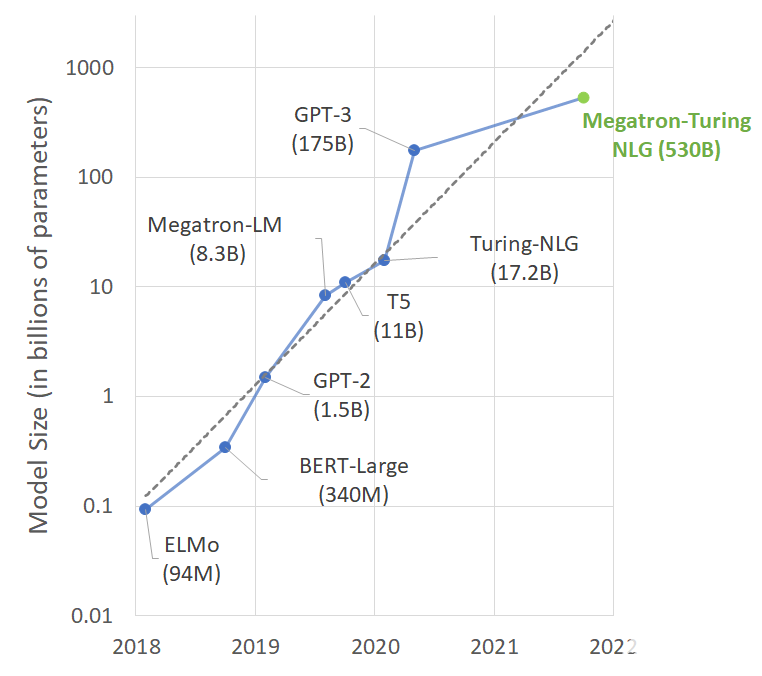

參數規模大,訓練數據規模大。以GPT3為例,GPT3的參數量為1750億,訓練數據量達到了570GB。進而,訓練大規模語言模型面臨兩個主要挑戰:顯存效率和計算效率。 現在業界的大語言模型都是

2023-07-10 09:13:57 14746

14746

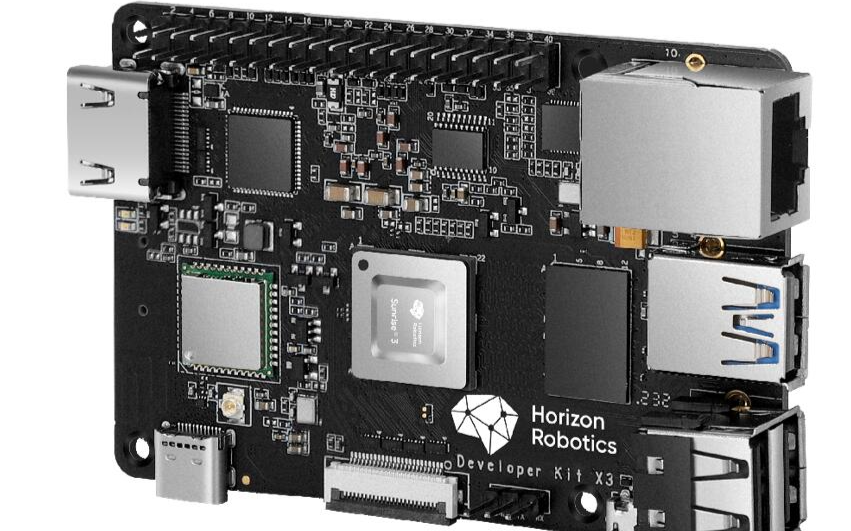

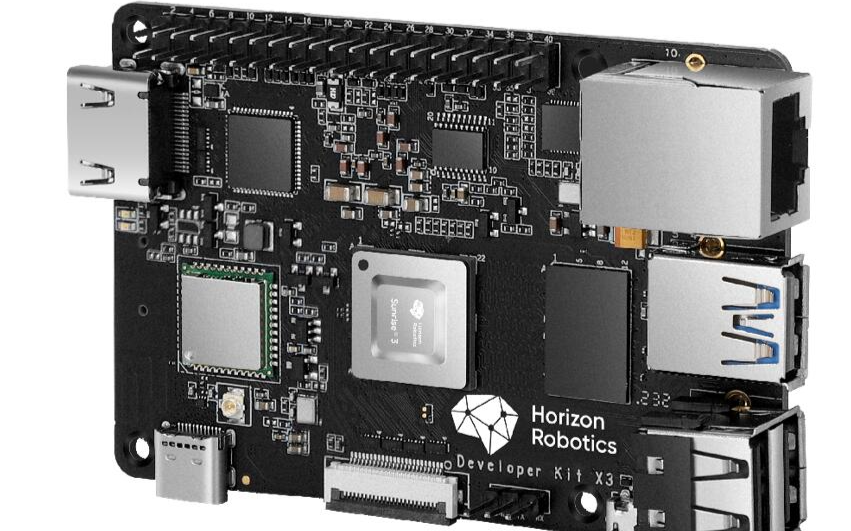

近日,地平線成功在旭日3中的BPU??計算單元上,部署運行參數規模高達14億的大語言模型(Large Language Model , LLM)。這不僅是業界在端側成功部署大模型的一次突破性實踐,更驗證了BPU??對先進神經網絡算法的高效支持,為大模型在端側實現產品級應用拓展了更廣闊的想象空間。

2023-09-12 13:36:00 2467

2467

多方位全面升級,并宣布在該體系下一系列的大模型產品更新和落地成果。 ? “日日新SenseNova ”全面升級及應用落地 ? 商湯科技發布的“商量”2.0版本,是一個千億級參數的自然語言處理模型,它突破了大語言模型輸入長度的限制,推出不同參數量級的模型版本,可完

2023-07-13 00:13:00 3935

3935

曼·卡頓等其他品牌。

毫無意外,微軟在2017年Build開發者大會上推出了智能音箱。這也意味著,繼亞馬遜和谷歌之后,另一個科技巨頭試圖在智能音箱領域手握風云。

美國當地時間5月10日

2017-05-21 09:33:09

輸入。

5月12日消息,在Build 2017開發者大會上,微軟推出了Fluent Design,它是一個設計系統,可以方便開發者跨設備開發用戶界面。從許多方面看,Fluent Design

2017-05-13 09:28:46

Smith表示,他為了這個消息一直等到凌晨2點,很高興看到商務部宣布的結果。 Brad Smith表示,這次中國商務部的審批有兩點重要意義。其一這對微軟諾基亞來說是有里程碑意義的事件,“因為只有中國批準

2017-11-27 11:30:06

微軟開源了 Checked C[1] ,這是一個 C 語言的擴展版本,可以用于解決 C 語言中的一系列安全相關的隱患。正如其名字所示,Checked C 為 C 語言增加了檢查。這個檢查可以幫助

2016-06-20 17:26:16

發表的微博稱,微軟計劃在2013年推出Surface RT 2平板電腦。這款平板電腦的顯示屏尺寸比10.6英寸Windows RT平板電腦稍微小一些。傳言稱,這種平板電腦將配置高通的芯片組,目前

2012-12-03 09:32:54

`微軟近日宣布與戴爾達成一項合作協議,從下個月起,企業客戶可以通過戴爾的企業銷售部門購買Surface Pro平板電腦和Surface配件。這是微軟與惠普、埃森哲等公司合作后,在企業市場推廣其平板

2017-06-23 14:44:04

導讀:微軟今天宣布,其會話語音識別系統的誤率達到了5.1%,是目前為止最低的。

[img][/img]

這一數據超過了微軟人工智能和研究團隊去年5.9%的誤差率,并將其準確性與專業的人

2017-08-23 09:18:35

MathWorks日前宣布推出 2011b版 (R2011b) MATLAB 和 Simulink 產品系列。此版本新引入了 Simulink Code Inspector,它可以實現

2011-09-08 15:45:03

特定任務對模型進行微調。這種方法的成功不僅是自然語言處理發展的一個轉折點,還為許多現實世界的應用場帶來了前所未有的性能提升。從廣為人知的GPT到BERT,預訓練的模型參數量越來越大預訓練數據越來越多

2024-05-05 12:17:03

類任務上表現出色,甚至在零樣本條件下也能取得良好效果。另一類則需要逐步推理才能完成的任務,類似于人類的系統2,如數字推理等。然而,隨著參數量的增加,大語言模型在這類任務上并未出現質的飛躍,除非有精心

2024-05-07 17:21:45

度、多角度的解釋或回答。通過這些評測任務,我們能夠全面而深入地了解模型在中文語言理解方面的實際能力。

常識百科類評測任務:此類評測任務主要評估大語言模型在知識覆蓋廣度方面的表現。一個優秀的大語言模型

2024-05-07 17:12:40

具有以下三個非常顯著的特點,一個就是模型參數規模更大,訓練數據更多。當然,對計算資源的要求也會更高。

構建強大的語言模型時,模型的選型至關重要,涉及模型的基本架構,包括模型的主要結構,表策策略,激活

2024-05-07 17:10:27

維基百科、網頁內容和書籍等,不僅掌握了語言的語法、語義和上下文信息,還能生成結構連貫、語義合理的句子和段落。大語言模型的一個顯著特點是其龐大的參數量,已達數億甚至數十億級別。這種規模賦予模型強大的表示和學習

2024-05-04 23:55:44

前夕宣布換標也證明了微軟對這款新品的支持力度。微軟前后兩代Logo對比(圖片來自網絡) 我們注意到,和之前傳聞不同的是微軟的新Logo左側帶有四個色塊,最后的f和t字相連接,而之前的Logo則將o和s連接。新的Logo將逐漸在微軟各個新品中開始使用,而舊版Logo依舊會繼續沿用一段時間。`

2012-08-28 09:18:48

的一系列變革。

大語言模型是深度學習的應用之一,可以認為,這些模型的目標是模擬人類交流,為了理解和生成人類語言。為此,模型需要在大量文本數據上訓練,用來理解人類語言,進而,實現與人類的無障礙對話交流

2024-05-13 00:09:37

解鎖

我理解的是基于深度學習,需要訓練各種數據知識最后生成自己的的語言理解和能力的交互模型。

對于常說的RNN是處理短序列的數據時表現出色,耳真正厲害的是Transformer,此框架被推出后直接

2024-05-12 23:57:34

8推進造成正常放緩。 根據文件記錄顯示,比爾·蓋MAX3232EUE+T茨正在不斷減持手中的微軟股票 2007年,比爾·蓋茨一共售出微軟股票8000萬股,價值達25.4億美元。 2008年8月

2012-10-25 16:21:19

耦合電感有2種模型1.告知耦合電感的2個自感、互感以及耦合系數2.匝數比、自感量、漏感量(相當于一個理想變壓器原邊和副邊的電感量)請問我已知耦合電感的模型2的三個參數如何將其轉換為耦合電感模型1的3個參數2種模型間參數是如何轉換的呢?求求大佬幫助

2020-01-03 14:55:51

部真正具有可用性的PC。當然售價仍然保持35刀。下面來一段有RS的DesignSpark團隊發布的樹莓派2的介紹視頻:同時微軟同時推出了Windows 10 for Raspberry Pi 2,它將

2015-02-02 21:56:26

發生了什么?跟小麥一起來看看:1、寒武紀完成數億美元B輪融資,投后估值25億美元全球智能芯片領域首個獨角獸寒武紀宣布完成數億美元的B輪融資,投后整體估值達25億美元。寒武紀科技是全球第一個成功流片并

2018-06-25 11:32:52

在2016年10月發布Surface Book 2-in-1之后,微軟推出了一個“Mcabook到Surface Book”網站,為考慮切換的用戶提供切換指南。微軟現在已更新該網站上Mcabook到Surface遷移助手的詳細信息。有了這個小幫手,你會考慮拋棄蘋果轉投微軟的懷抱嗎?

2017-03-22 15:41:00 1227

1227 今年微軟帶來了Azure IoT Edge Runtime的開源并宣布與高通、大疆的合作;推出Project Kinect for Azure微軟新一代深度攝像頭在內的傳感器套件以及混合現實技術。

2018-05-11 16:41:22 6180

6180 史上最強“通用”NLP模型來襲:今天OpenAI在官博介紹了他們訓練的一個大規模無監督NLP模型,可以生成連貫的文本段落,刷新了7大數據集基準,并且能在未經預訓練的情況下,完成閱讀理解、問答、機器翻譯等多項不同的語言建模任務。

2019-02-16 08:43:21 4744

4744 能有這樣出色的表現,不是沒有原因的,GPT-2各種特定領域的語言建模任務中都取得了很好的分數。作為一個沒有經過任何領域數據專門訓練的模型,它的表現,比那些專為特定領域數據集(例如維基百科,新聞,書籍)上訓練的模型。有圖有真相:

2019-03-07 14:45:20 9268

9268 本模型的實現基于Grover模型,并修改其代碼庫以匹配GPT-2的語言建模訓練目標。由于他們的模型是在類似的大型語料庫上進行訓練的,因此大部分代碼和超參數都可以重復使用。本模型沒有從Grover中大幅改變超參數。

2019-09-01 07:11:00 3776

3776 就在本周,OpenAI宣布,發布了7.74億參數GPT-2語言模型,15.58億的完整模型也有望于幾個月內發布,并將GPT-2這6個月的進展情況在博客上和大家做了介紹,本文將為大家梳理。

2019-09-01 09:10:44 3515

3515 微軟宣布推出安全核心PC,這是目前最安全的Windows 10設備,具有集成的硬件,固件,軟件和身份保護功能。Windows OEM產品必須滿足微軟列出的嚴格安全要求才能獲得此認證。

2019-11-01 14:44:05 780

780 微軟近日宣布,未來將不再發展Visual Basic(以下簡稱VB)這門編程語言,只會做一些穩定性、兼容性的維護工作。

2020-03-16 15:56:30 3312

3312 今天,微軟宣布了Windows 10 20H2的一個新的里程碑。它現在被推廣到發布預覽通道,這是發布給大眾之前的最后一道測試流程。 此外,該公司還宣布了功能更新的正式名稱,它將被稱為Windows 10 October 2020更新。

2020-09-22 11:08:10 4526

4526 微軟已經與OpenAI合作,建立一個超級計算機,用于測試大規模模型。

2020-12-17 09:25:37 2838

2838 剛剛,Google Brain 高級研究科學家 Barret Zoph 發帖表示,他們設計了一個名叫「Switch Transformer」的簡化稀疏架構,可以將語言模型的參數量擴展至 1.6 萬億

2021-01-13 16:50:49 4200

4200 參數是機器學習算法的關鍵。它們是從歷史訓練數據中學到的模型的一部分。一般來說,在語言領域,參數的數量和復雜性之間的相關性非常好。例如,OpenAI的GPT-3是有史以來訓練了1750億個參數的最大語言模型之一,它可以進行原始類比、生成配方,甚至完成基本代碼。

2021-01-18 16:19:54 2206

2206 ? 古諺道:“熟讀唐詩三百首,不會作詩也會吟。” 這句話放在目前的人工智能語言模型中也非常適用。 此前,OpenAI 的研究人員開發出 “GPT-3”,這是一個由 1750 億個參數組成的 AI

2021-01-18 17:16:07 2765

2765 視覺語言(Vision-Language,VL)系統允許為文本查詢搜索相關圖像(或反之),并使用自然語言描述圖像的內容。一般來說,一個VL系統使用一個圖像編碼模塊和一個視覺語言融合模塊。微軟研究部門

2021-01-19 14:32:09 2047

2047 的AI模型GPT-3。GPT-3就是在570 GB的文本數據上訓練的語言模型,因此,就訓練數據和生成能力而言,GPT-3截至2020年都是最龐大的公開發布的語言模型。 此外,OpenAI的GPT-3一反之前死守基礎研究的思路,將 GPT-3 做成了一個服務,提供可以調用的 OpenAI API,并且

2021-01-19 15:29:31 2241

2241 現在的模型動輒數百、數千億參數,普通人訓不動怎么辦? 前不久,谷歌發布了參數量為 1.6 萬億的語言模型Swith Transformer,將 GPT-3 創下的參數量記錄(1750 億)推至新高

2021-02-11 09:04:00 2966

2966

繼GPT-3問世僅僅不到一年的時間,Google重磅推出Switch Transformer,直接將參數量從GPT-3的1750億拉高到1.6萬億,并比之前最大的、由google開發的語言模型

2021-01-27 16:26:56 2850

2850

在最新的 NLU 測試基準 SuperGLUE 中,微軟提出的 DeBERTa 登頂榜單,并超越人類。 去年 6 月,來自微軟的研究者提出一種新型預訓練語言模型 DeBERTa,該模型使用兩種新技術

2021-02-05 09:25:13 2039

2039

據悉,微軟上一次宣布 Win10用戶達到9億是在2019年9月,自那以后,個人電腦市場出現了顯著增長,在過去的6個月里,Win10新增了1億月活躍設備,使總數達到10億。

2021-02-24 11:30:54 2159

2159 Turing-NLG相繼出現。 ? 2020年6月OpenAI在發布了GPT-3,這是當時訓練的最大模型,具有1750億個參數。近段時間,浪潮、英偉達與微軟相繼發布2500億參數、5300億參數的巨量模型,超過GPT-3。 ? 中國工程院院士王恩東認為,人工智能的大模型時代已經到來,利用先進算法,整

2021-10-18 14:41:09 4369

4369

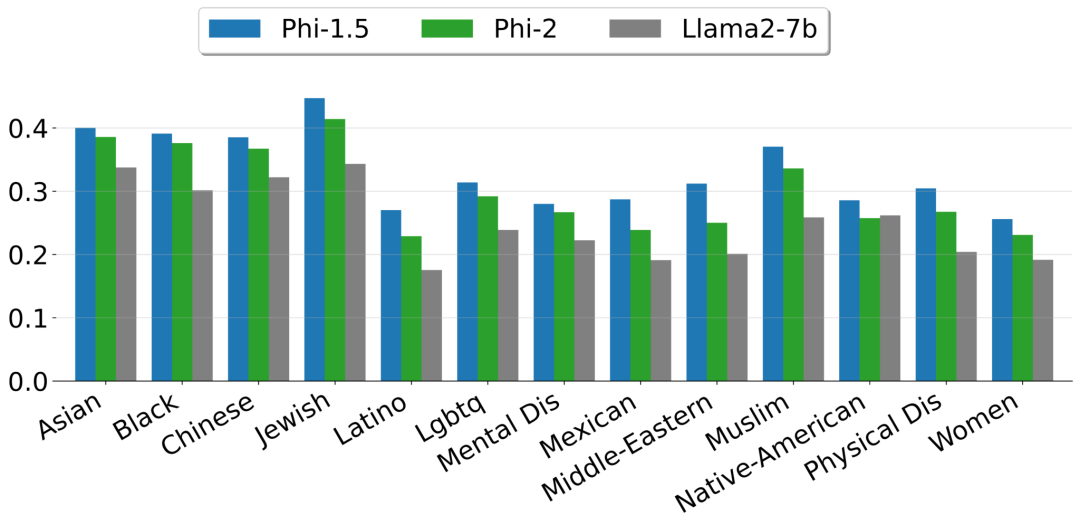

盡管巨型語言模型正在推動語言生成技術的發展,但它們也面臨著偏見和毒性等問題。人工智能社區正在積極研究如何理解和消除語言模型中的這些問題,包括微軟和 NVIDIA 。

2022-04-17 11:25:34 2959

2959

今天,我們高興地宣布推出 Surface Laptop Go 2。這款產品經過精心打造,以超便攜的形態展示 Surface 標志性的優質設計和功能。

2022-06-02 10:38:07 2271

2271 BigCode 是一個開放的科學合作組織,致力于開發大型語言模型。近日他們開源了一個名為 SantaCoder 的語言模型,該模型擁有 11 億個參數

2023-01-17 14:29:53 1365

1365 在本文中,我們將展示如何使用 大語言模型低秩適配 (Low-Rank Adaptation of Large Language Models,LoRA) 技術在單 GPU 上微調 110 億參數的 FLAN-T5 XXL 模型。

2023-04-14 17:37:40 3420

3420 微軟增加了對大型語言模型(llm)的支持。openai推出chatgpt后,llm的使用大幅增加,微軟持有openai的股份,許多類型的公司爭相在llm上構建功能。

2023-06-08 10:35:43 1345

1345 日前,由微軟和湛廬合辦的以 GPT 將如何改變世界為主題的新書共讀會上,有關以 GPT 為代表的 大語言模型 提升社會生產力,打破傳統人機交互模式的話題引起了與會者的廣泛思考。 作為一種重要的推動力

2023-07-12 00:10:01 1185

1185

獲得專業級的語言處理能力。該模型是目前最大的中文預訓練語言模型,其參數量超過2.6十億,實現了對超過60億字的語料庫的理解和生成。 該模型最初發布于2020年2月,而隨著文本數據的增長和模型優化,該模型的參數量也不斷增加。截至2021年春季,PanGu-α的參數量已

2023-08-17 11:28:18 4754

4754 騰訊發布混元大語言模型 騰訊全球數字生態大會上騰訊正式發布了混元大語言模型,參數規模超千億,預訓練語料超2萬億tokens。 作為騰訊自研的通用大語言模型,混元大語言模型具有中文創作能力、任務執行

2023-09-07 10:23:54 1586

1586 ? 世界最強開源大模型 Falcon 180B 忽然火爆全網,1800億參數,Falcon 在 3.5 萬億 token 完成訓練,性能碾壓 Llama 2,登頂 Hugging Face 排行榜

2023-09-18 09:29:05 2713

2713

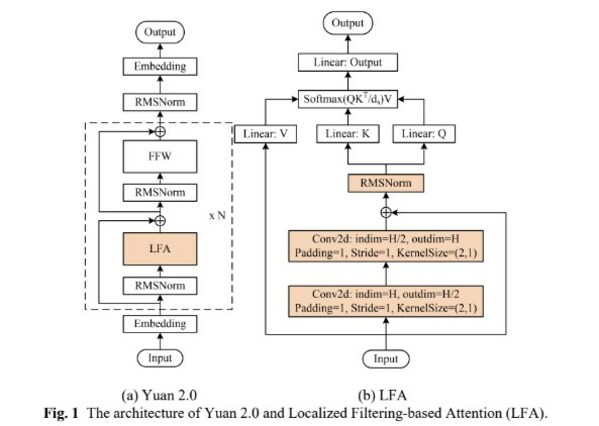

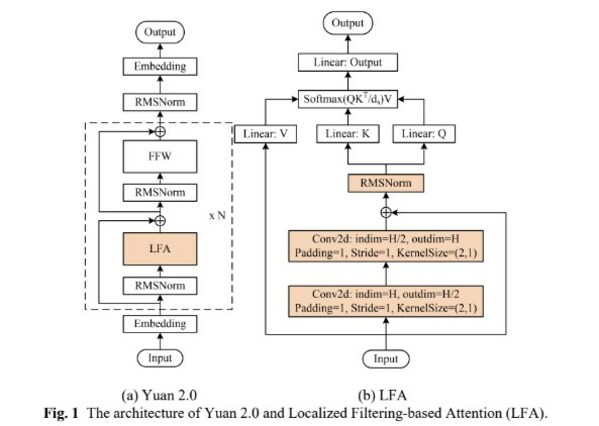

11月27日,浪潮信息發布"源2.0"基礎大模型,并宣布全面開源。源2.0基礎大模型包括1026億、518億、21億等三種參數規模的模型,在編程、推理、邏輯等方面展示出了先進的能力。

2023-11-28 09:10:14 1359

1359

12月1日,阿里云通義千問720億參數模型Qwen-72B宣布開源。與此同時,他們還開源了18億參數模型Qwen-1.8B和音頻大模型Qwen-Audio。

2023-12-01 17:08:08 2247

2247 本文基于亞馬遜云科技推出的大語言模型與生成式AI的全家桶:Bedrock對大語言模型進行介紹。大語言模型指的是具有數十億參數(B+)的預訓練語言模型(例如:GPT-3, Bloom, LLaMA)。這種模型可以用于各種自然語言處理任務,如文本生成、機器翻譯和自然語言理解等。

2023-12-04 15:51:46 1470

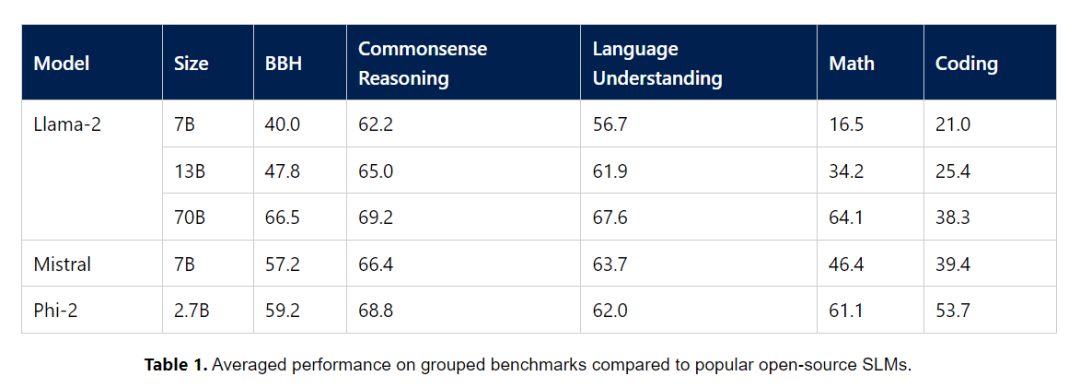

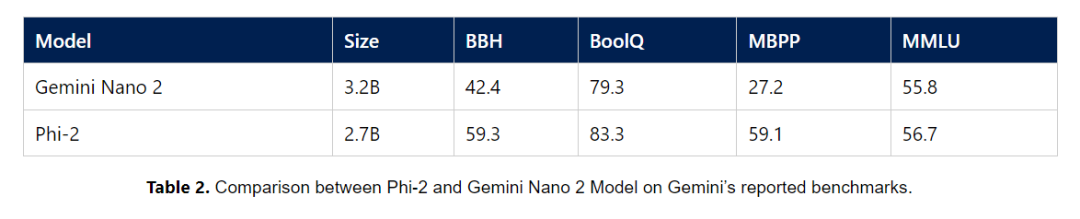

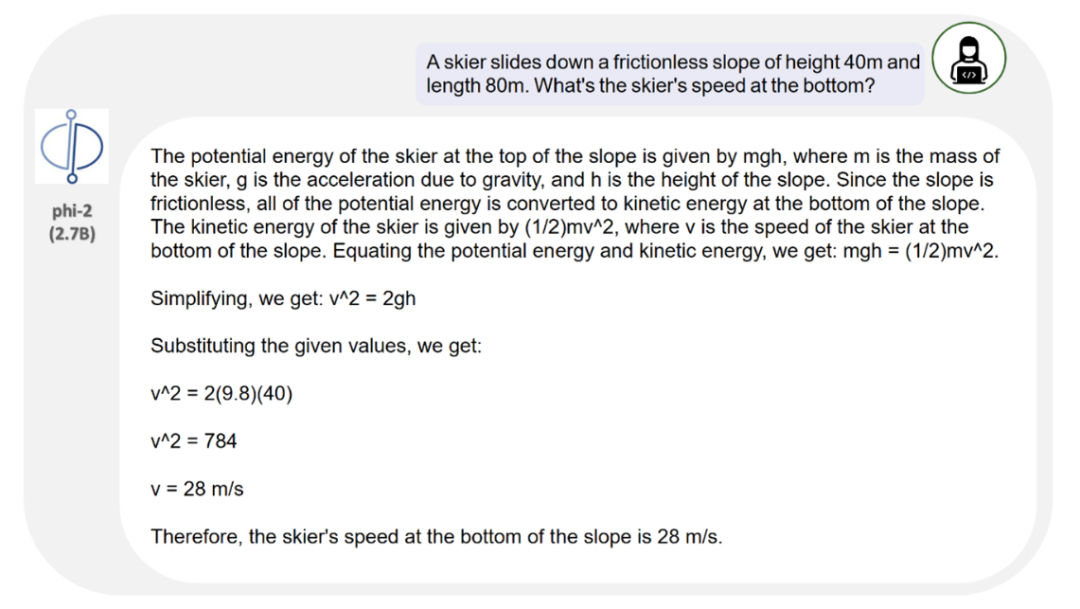

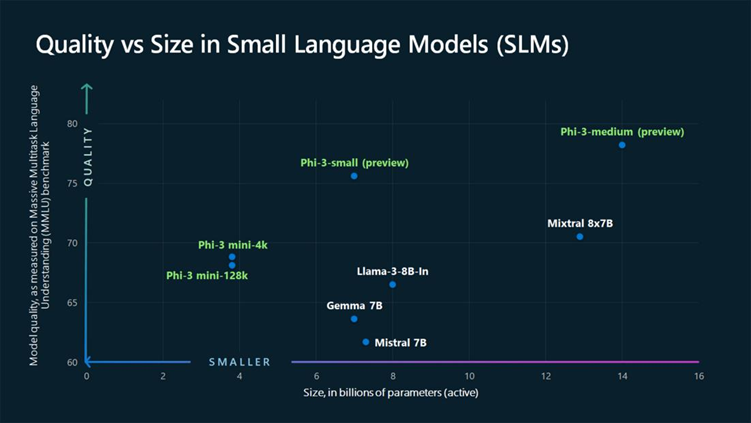

1470 今年九月份,微軟又進一步推出了Phi-1.5版,盡管依舊僅含13億元參數,但已可創作詩歌、電子郵件及故事,甚至可以對大量文本進行總結概括。在常識、語言理解以及推理的基準測試中,該版本的模型在部分領域已經可以媲美甚至超越含有高達100億參數的同類模型。

2023-12-13 11:05:34 1339

1339 先后和 OpenAI、Meta 牽手推動大模型發展的微軟,也正在加快自家小模型的迭代。

2023-12-14 15:45:11 1397

1397

微軟發布 Orca 2 LLM,這是 Llama 2 的一個調優版本,性能與包含 10 倍參數的模型相當,甚至更好。

2023-12-26 14:23:16 1097

1097 韓國互聯網巨頭Kakao最近宣布開發了一種名為“蜜蜂”(Honeybee)的多模態大型語言模型。這種創新模型能夠同時理解和處理圖像和文本數據,為更豐富的交互和查詢響應提供了可能性。

2024-01-19 16:11:20 1271

1271 Stability AI 宣布推出迄今為止最強大的小語言模型之一 Stable LM 2 1.6B。

2024-01-23 10:11:21 1645

1645

2022 年開始,我們發現 Multilingual BERT 是一個經過大規模跨語言訓練驗證的模型實例,其展示出了優異的跨語言遷移能力。具

2024-02-20 14:51:35 1993

1993

據了解,負責開發的百靈團隊利用自身擁有的19億遙感影像數據集進行了預訓練,從而生成了具有20.6億參數的SkySense大模型。官方稱其為全球范圍內參數規模最大、任務覆蓋最全且識別精度最高的多模態遙感大模型。

2024-02-28 15:53:12 1441

1441 近日,螞蟻集團聯合武漢大學宣布成功研發出20億參數多模態遙感基礎模型SkySense。這一創新模型由螞蟻集團的AI創新研發部門NextEvo與武漢大學共同完成,是迄今為止國際上參數規模最大、覆蓋任務最全、識別精度最高的多模態遙感大模型。

2024-03-04 11:22:23 1538

1538 微軟近日宣布向人工智能初創公司Inflection AI支付高達6.5億美元的巨額資金,這一舉動在業內引起了廣泛關注。據悉,這筆資金主要用于獲得Inflection AI的AI模型授權,并額外支付約3000萬美元,以確保該公司放棄與微軟大規模雇傭相關的一切法律權益。

2024-03-25 10:39:59 890

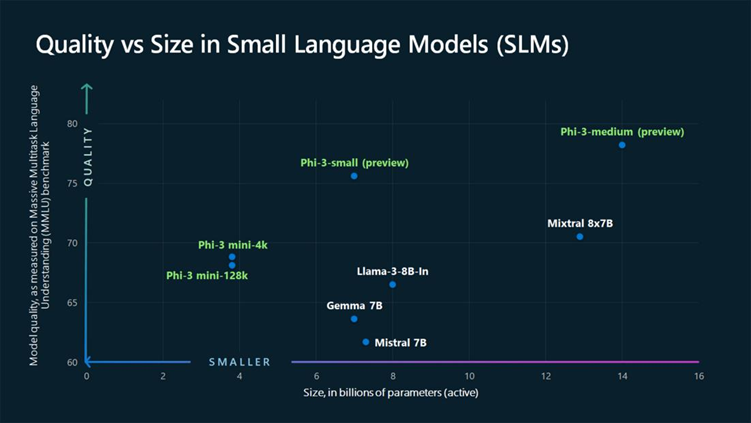

890 微軟稱,帶有38億參數的phi-3-mini經過3.3萬億token的強化學習,其基礎表現已經超過Mixtral 8x7B及GPT-3.5;此外,該模型可在手機等移動設備上運行,并在phi-2模型(27億參數)的基礎上,進一步融合了嚴格篩選的網絡數據與合成數據。

2024-04-23 14:32:05 1078

1078 NVIDIA 宣布使用 NVIDIA TensorRT-LLM 加速微軟最新的 Phi-3 Mini 開源語言模型。TensorRT-LLM 是一個開源庫,用于優化從 PC 到云端的 NVIDIA GPU 上運行的大語言模型推理。

2024-04-28 10:36:08 1584

1584 通義千問近日震撼發布1100億參數的開源模型Qwen1.5-110B,這一舉措標志著通義千問在AI領域邁出了重大步伐。該模型成為通義千問全系列首個千億級參數開源模型,充分展現了其強大的技術實力和創新精神。

2024-05-06 10:49:20 1325

1325 微軟近期傳出消息,正在秘密研發一款全新的人工智能語言模型,這款模型在規模上預計將具備與谷歌和OpenAI等業界巨頭相抗衡的實力。據悉,這款新模型在微軟內部被命名為“MAI-1”,由微軟AI部門

2024-05-08 09:30:58 787

787 微軟近日曝光了其內部正在秘密研發的巨型AI模型——MAl-1,這款模型擁有驚人的5000億參數。據微軟首席技術官Kevin Scott確認,MAl-1的研發工作確實在穩步推進中,并且該模型并非簡單繼承自之前的Inflection模型,而是在其基礎上進行了全新的研發。

2024-05-08 09:56:08 796

796 據最新消息,微軟正積極開發一款新型AI語言模型MAI-1,以提升在快速發展的AI市場中的競爭力。

2024-05-08 10:27:53 1022

1022 據報道,微軟在向OpenAI投資超過100億美元后,首次成功訓練了一個名為“MAI-1”的內部人工智能模型。這一模型規模龐大,足以與谷歌、Anthropic和OpenAI自身的前沿模型相抗衡。

2024-05-08 10:45:49 979

979 The Information 5月6日的報道,微軟公司即將推出一款全新的AI模型產品,內部代號為MAI-1,其參數數量達到了驚人的5000億。值得一提的是,這款大模型產品由微軟獨自研發推出。換句話說,微軟正式開始了與一眾行業巨頭的競爭,這其中也包括OpenAI。 微軟的獨

2024-05-11 11:47:55 1003

1003

微軟正在緊鑼密鼓地訓練一款全新的自研人工智能大模型——“MAI-1”。據悉,這款模型規模龐大,足以與谷歌的Gemini和OpenAI的ChatGPT相媲美。

2024-05-13 11:30:54 1033

1033 5 月 22 日,微軟Build 2024大會在美正式開幕。薩提亞·納德拉CEO、董事長宣布,OpenAI新款旗艦模型GPT-4o已經在Azure AI Studio上線,并開放API服務。

2024-05-22 11:18:38 1072

1072 近日,英特爾針對微軟的多個Phi-3家族的開放模型,驗證并優化了其跨客戶端、邊緣和數據中心的AI產品組合。

2024-05-27 11:15:33 1162

1162 近日,英特爾宣布針對微軟的Phi-3家族開放模型,成功驗證并優化了其跨客戶端、邊緣及數據中心的AI產品組合。這一重要舉措旨在提供更為靈活和高效的AI解決方案。

2024-05-27 11:47:43 1113

1113 據悉,Phi-3-vision 作為微軟 Phi-3 家族的首款多模態模型,繼承自 Phi-3-mini 的文本理解能力,兼具輕巧便攜特性,適用于移動平臺/嵌入式終端;模型參數規模達 42 億,遠超 Phi-3-mini(3.8B)

2024-05-27 15:56:22 1144

1144 據報道,微軟于4月至5月間相繼推出了多款Phi-3小型語言模型(SLM),這些模型以其“輕便易攜且能在移動設備中運行”以及強大的視覺處理能力而備受矚目。這種語言模型專用于低消耗的計算環境。

2024-05-27 15:59:35 746

746 Phi-3-vision 是一種小型多模式語言模型(SLM),主要適用于本地人工智能場景。其模型參數高達 42 億,上下文序列包含 128k 個符號,可滿足各種視覺推理和其他任務需求。

2024-05-28 11:35:12 986

986 近日,英偉達宣布開源了一款名為Nemotron-4 340B的大型模型,這一壯舉為開發者們打開了通往高性能大型語言模型(LLM)訓練的新天地。該系列模型不僅包含高達3400億參數,而且通過其獨特的架構,為醫療保健、金融、制造、零售等多個行業的商業應用提供了強大的支持。

2024-06-17 14:53:49 1203

1203 在人工智能領域,大語言模型一直是研究的熱點。近日,全球科技巨頭谷歌宣布,面向全球研究人員和開發人員,正式發布了其最新研發的大語言模型——Gemma 2。這款模型以其高效能和低成本的特點,引起了業界的廣泛關注。

2024-06-29 09:48:32 966

966 在人工智能與語言處理領域,DeepL再次以其創新實力引領潮流,宣布成功推出新一代面向翻譯與編輯應用的大型語言模型。這一里程碑式的進展,不僅鞏固了DeepL作為頂尖語言人工智能公司的地位,更標志著機器翻譯技術向更高質量、更智能化方向邁出了堅實的一步。

2024-07-19 15:56:41 1228

1228 7月22日最新資訊,Hugging Face科技公司在語言模型領域再創新高,正式推出了SmolLM系列——一款專為適應多樣計算資源而設計的緊湊型語言模型家族。該系列包含三個版本,分別搭載了1.35億、3.6億及17億參數,旨在以高效能應對不同應用場景。

2024-07-23 16:35:16 1138

1138 2024年4月23日,微軟研究院公布Phi-3系列AI大模型,包含三個版本:mini(3.8B參數)、small(7B參數)以及medium(14B參數)。phi-3-mini是一個擁有3.8B參數

2024-08-30 16:58:43 1913

1913

蘋果近日推出了全新的多模態AI大模型MM1.5,該模型擁有高達300億的參數規模,是在前代MM1架構的基礎上進一步發展而來的。

2024-10-14 15:50:14 910

910 大語言模型的開發是一個復雜且細致的過程,涵蓋了數據準備、模型架構設計、訓練、微調和部署等多個階段。以下是對大語言模型開發步驟的介紹,由AI部落小編整理發布。

2024-11-04 10:14:43 955

955 近日,騰訊公司宣布成功推出業界領先的開源MoE(Mixture of Experts,專家混合)大語言模型——Hunyuan-Large。這款模型不僅在參數量上刷新了業界紀錄,更在效果上展現出了卓越

2024-11-06 10:57:13 1014

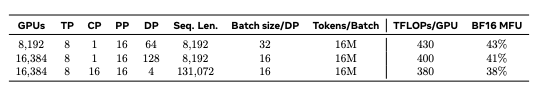

1014 一,前言 ? 在AI領域,訓練一個大型語言模型(LLM)是一個耗時且復雜的過程。幾乎每個做大型語言模型(LLM)訓練的人都會被問到:“從零開始,訓練大語言模型需要多久和花多少錢?”雖然網上有很多

2024-11-08 14:15:54 1630

1630

AMD公司近日宣布了一項重大進展,推出了首個完全開放的10億參數語言模型系列——AMD OLMo。這一舉措為開發者和研究人員提供了強大的AI研究工具,有助于推動AI技術的進一步發展。

2024-11-12 18:08:52 1024

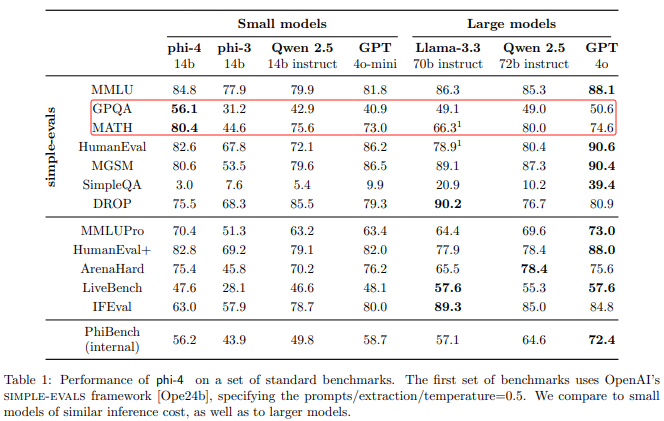

1024 擔心企業用戶在使用365 Copilot時面臨的成本和速度問題,因此正在尋求更多樣化的技術來源。盡管微軟與OpenAI之間有著緊密的合作關系,并允許微軟定制OpenAI的模型,但微軟仍在努力尋找其他選擇。 據稱,微軟不僅在訓練自己的小型模型,包括最新的Phi-4,還在努力定制其他

2024-12-25 10:41:08 873

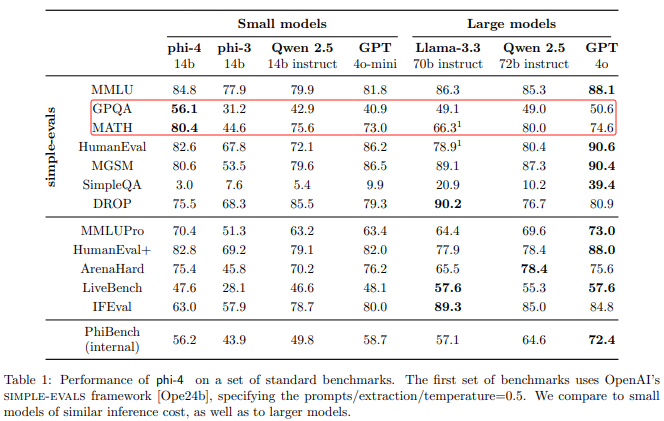

873 智能水平上的一大飛躍。它不僅達到了之前只有Llama 3.1 405B模型才具備的智能水平,而且還超越了11月發布的GPT-4o模型。 本文我們將分享微軟剛剛發布的Phi-4模型,其模型參數只有14B

2025-01-15 11:05:29 831

831

,SmolVLM-256M-Instruct僅有2.56億參數,是有史以來發布的最小視覺語言模型,可在內存低于1GB的PC上運行并提供卓越性能。SmolVLM-500M-Instruct有5億參數,主要針對硬件資源

2025-01-24 14:15:24 1492

1492 你是否想過在自己的設備上運行自己的大型語言模型(LLMs)或視覺語言模型(VLMs)?你可能有過這樣的想法,但是一想到要從頭開始設置、管理環境、下載正確的模型權重,以及你的設備是否能處理這些模型

2025-03-25 09:32:38 807

807

日本航空(JAL)攜手微軟,率先將AI應用引I入客艙管理。通過基于微軟Phi-4小型語言模型(SLM)開發的JAL-AI報告系統,空乘人員報告航班事件的效率提升高達2/3,即使離線也能流暢運行。不僅

2025-07-18 11:12:44 1227

1227 我們很榮幸發布與耶魯大學合作研究的 Cell2Sentence-Scale 27B (C2S-Scale),這是一個新的 270 億參數基礎模型,旨在理解單個細胞的 "語言"。C2S-Scale 建立在 Gemma 開放模型系列的基礎上,代表著單細胞分析領域的新前沿。

2025-11-06 10:35:16 649

649

電子發燒友App

電子發燒友App

評論