一、背景

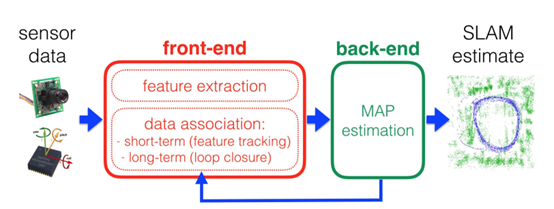

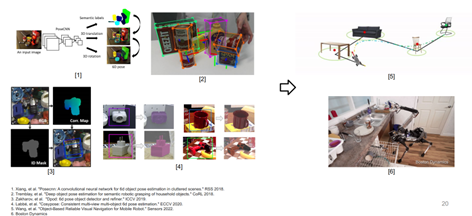

Object-based SLAM: SLAM就是機(jī)器人同步定位與建圖,通過(guò)一些傳感器的測(cè)量數(shù)據(jù)同時(shí)去建立環(huán)境的地圖,且利用這個(gè)地圖對(duì)于機(jī)器人的狀態(tài)進(jìn)行估計(jì),機(jī)器人的狀態(tài)包括機(jī)器人的位姿、速度和機(jī)器人的參數(shù),比如內(nèi)參。環(huán)境地圖包括比如點(diǎn)的位置,線(xiàn)的位置,面的位置。常見(jiàn)的SLAM系統(tǒng)由前端和后端組成,如圖1所示,前端一般從一些原始的傳感器數(shù)據(jù)中采集一些特征,后端利用概率的推斷模型對(duì)采集的模型進(jìn)行融合生成全局一致的環(huán)境地圖。

圖1 SLAM結(jié)構(gòu)

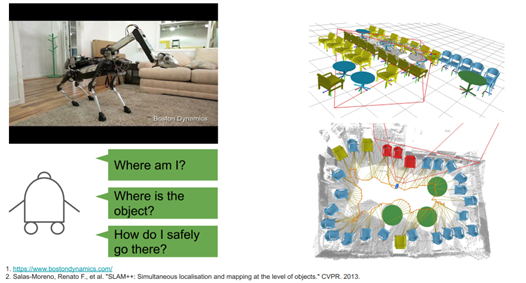

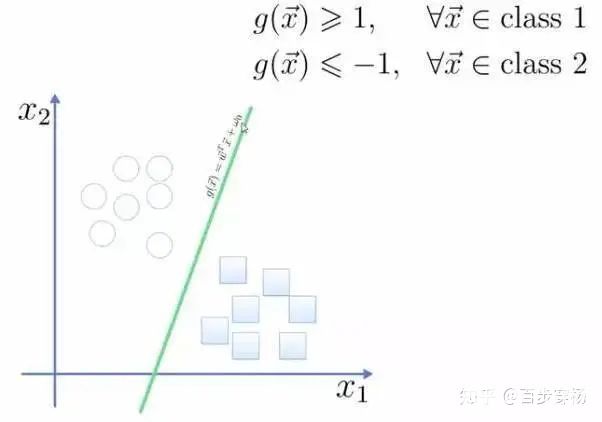

要知道環(huán)境中有哪些物體,就需要進(jìn)行物體級(jí)SLAM,簡(jiǎn)單而言就是以物體為目標(biāo)的SLAM系統(tǒng),對(duì)物體和機(jī)器人的狀態(tài)進(jìn)行估計(jì),如圖2所示。一個(gè)是對(duì)空間中的幾何體加上語(yǔ)義信息,對(duì)下游的任務(wù)有作用,另一個(gè)是非常節(jié)省存儲(chǔ)空間的表示。如果用稠密點(diǎn)云就需要用很多的存儲(chǔ)空間,但是基于物體級(jí)的SLAM形成的表示是非常輕量化的描述。

圖2 物體級(jí)SLAM

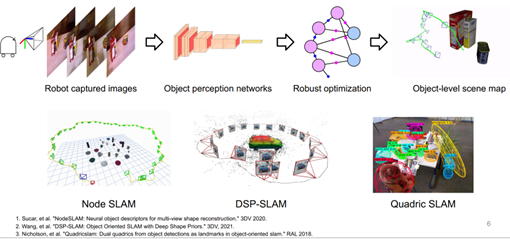

如何做Object SLAM? 和廣泛SLAM類(lèi)似,首先要在原始的測(cè)量數(shù)據(jù)中提取特征,使用物體的感知模型,包括二維的目標(biāo)檢測(cè),也包括實(shí)例分割。今天涉及的是六自由度物體估計(jì)目標(biāo)檢測(cè),后端也是用概率推斷模型對(duì)于多幀進(jìn)行融合生成全局一致的地圖。圖3列舉了一些目標(biāo)SLAM的文章和方法。

圖3 相關(guān)SLAM方法和文章

為什么object SLAM是比較困難的問(wèn)題? 因?yàn)橛幸恍V泛的SLAM具有的挑戰(zhàn),也面臨一些新的挑戰(zhàn)。廣泛的challenge包括ambiguous data assosiation的問(wèn)題,比如在一個(gè)停車(chē)場(chǎng)檢測(cè)到一輛車(chē),那么怎么把真的觀(guān)測(cè)和地圖里面的進(jìn)行關(guān)聯(lián),那么哪一輛車(chē)是當(dāng)前被觀(guān)測(cè)的車(chē)呢?另外一個(gè)問(wèn)題就是動(dòng)態(tài)的問(wèn)題,比如有一個(gè)車(chē)在行進(jìn),如何判斷這輛車(chē)是在行進(jìn),如何防止這個(gè)行進(jìn)的車(chē)對(duì)相機(jī)跟蹤產(chǎn)生影響,然后如何根據(jù)這個(gè)車(chē)的行進(jìn)去不斷地更新地圖,這些問(wèn)題是比較難解決的。新的挑戰(zhàn)主要是源于引入了object perception model,這兩個(gè)模型結(jié)合的過(guò)程中就會(huì)產(chǎn)生一些information瓶頸,比如在deep learning model做出一些預(yù)測(cè)的時(shí)候,很難對(duì)不確定性進(jìn)行量化,很難知道預(yù)測(cè)是好是壞。 在這種情況下如何去使用深度學(xué)習(xí)的model,如何給觀(guān)測(cè)賦權(quán)重是一個(gè)比較困難的問(wèn)題。

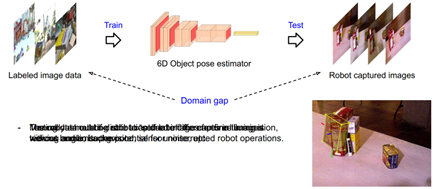

另外,一個(gè)比較重要的在object SLAM領(lǐng)域中的問(wèn)題就是domain gap問(wèn)題,在新的環(huán)境中會(huì)有性能下降的問(wèn)題。就是在訓(xùn)練perception model的時(shí)候,一般在特定環(huán)境中采取數(shù)據(jù),給數(shù)據(jù)添加標(biāo)注,用這些標(biāo)注的數(shù)據(jù)訓(xùn)練網(wǎng)絡(luò)。但當(dāng)使用或測(cè)試這個(gè)網(wǎng)絡(luò)時(shí),往往在一個(gè)新環(huán)境中測(cè)試,訓(xùn)練和測(cè)試環(huán)境之間很可能有一些區(qū)別,比如光照的不同,背景的不同,噪聲情況的不同,這個(gè)差異會(huì)使測(cè)試數(shù)據(jù)和訓(xùn)練數(shù)據(jù)造成分布不匹配的問(wèn)題,這個(gè)問(wèn)題就是一個(gè)domain gap的問(wèn)題。還會(huì)導(dǎo)致perception model性能下降的問(wèn)題。合成數(shù)據(jù)在真實(shí)情況中使用時(shí),它的效果會(huì)大打折扣。 希望能夠做到的表現(xiàn)是機(jī)器人在探索不同環(huán)境的時(shí)候,能夠自動(dòng)的適應(yīng)當(dāng)前的環(huán)境,把它的perception model調(diào)整到比較好的性能狀態(tài)。這里對(duì)于object SLAM的介紹告一段落,如果感興趣可以在面4的主頁(yè)中關(guān)注。

圖4 主頁(yè)

二、方法介紹

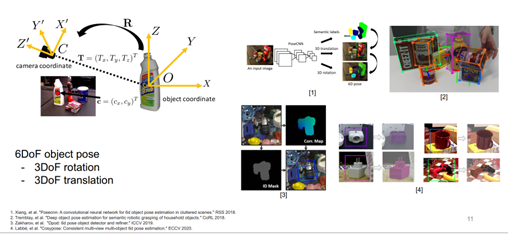

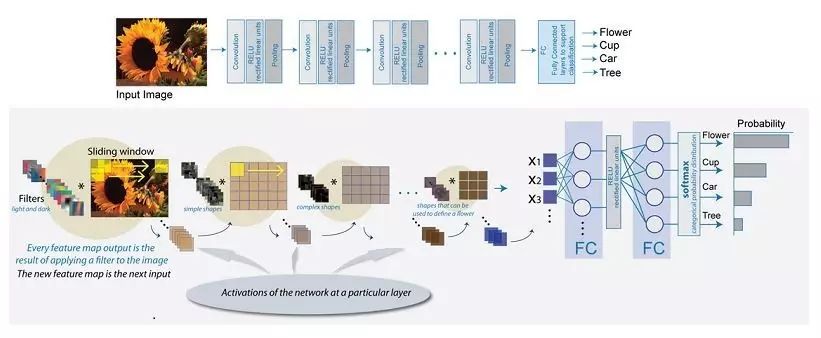

什么是6自由度物體位姿估計(jì)? 如圖5所示,圖片中有物體,然后通過(guò)模型計(jì)算物體相對(duì)于相機(jī)的位姿,這個(gè)位姿包括3自由度的旋轉(zhuǎn)和3自由度的平移,所以稱(chēng)它為6自由度的物體位姿估計(jì)。具有代表性的工作,比如說(shuō)CNN和今天會(huì)涉及到的方法。

圖5 6自由度的物體位姿估計(jì)

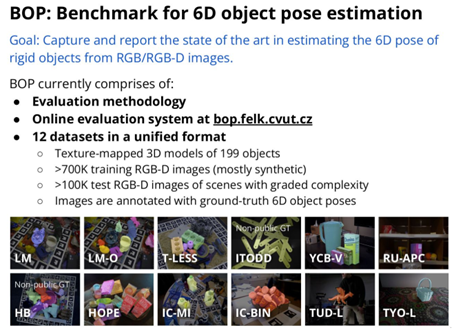

今天要探討的不是如何去設(shè)計(jì)一個(gè)更好的6自由度位姿估計(jì),而是在真實(shí)場(chǎng)景中的表現(xiàn)如何,把它從文章中拿出來(lái),和其他的位姿模型在同樣的benchmark中進(jìn)行對(duì)比它們的表現(xiàn)最終如何。 BOP方法進(jìn)行6自由度位姿估計(jì),然后這個(gè)benchmark它的目標(biāo)就是這樣的表現(xiàn),模型對(duì)應(yīng)的物體是剛性物體,它們的輸入是RGB和RGBD的圖像。BOP challenge根據(jù)指標(biāo)對(duì)不同的model進(jìn)行打分,然后分?jǐn)?shù)比較高的就可以獲得獎(jiǎng)項(xiàng),每年的會(huì)議上都有BOP challenge的workshop,介紹如圖6所示。

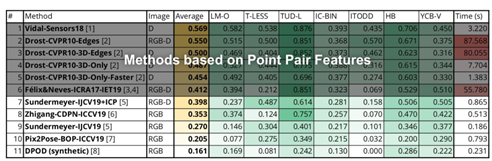

圖6 BOP六維物體位姿估計(jì) BOP challenge在2019年的結(jié)果,在這一年有很多方法在一些task上去競(jìng)爭(zhēng),表1列舉了不同方法的性能比較,按照性能從高到低排列。可以看到這一年的經(jīng)典方法就是基于這種特征的方法是由于基于深度學(xué)習(xí)方法的。 表1 BOP challenge性能比較

針對(duì)上面的問(wèn)題給出解釋?zhuān)紫热狈υ谡鎸?shí)世界中訓(xùn)練的圖片,還有真實(shí)的測(cè)試圖片和通常使用的合成的訓(xùn)練圖片之間有比較大的domain gap。這兩個(gè)原因?qū)儆谝粋€(gè)問(wèn)題,就是缺少在真實(shí)環(huán)境或者測(cè)試環(huán)境中帶有6自由度物體標(biāo)注的數(shù)據(jù)。 為了解決這個(gè)問(wèn)題,有哪些方案呢?一種解決方案就是去提高合成數(shù)據(jù)的真實(shí)性,生成更加成熟的數(shù)據(jù),另一種方案是可以利用test devirament沒(méi)有標(biāo)注的數(shù)據(jù)去提高表現(xiàn)。需要用到文章使用的self-training。Semi-supervised learning結(jié)合一些帶有標(biāo)簽和數(shù)據(jù)和不帶有標(biāo)簽的數(shù)據(jù)去提高模型的預(yù)測(cè)性能。 為什么這樣的事情能夠成功呢?

為什么能夠用不帶有標(biāo)簽的數(shù)據(jù)去提高性能呢?因?yàn)椴粠?biāo)簽的數(shù)據(jù)上往往攜帶了對(duì)于預(yù)測(cè)的task有用的一些信息。比如霧天的數(shù)據(jù)是不帶標(biāo)簽的數(shù)據(jù)的話(huà),那它就攜帶了這種background的信息,這樣的信息有可能被提出的semi-supervised learning的方法學(xué)習(xí)到,提高模型的表現(xiàn)。不幸的是,Semi-supervised learning大部分的方法都沒(méi)有對(duì)于收斂的一個(gè)保證,很可能越去訓(xùn)練它這個(gè)模型的表現(xiàn)越差,因?yàn)轭A(yù)報(bào)的一些錯(cuò)誤的在這個(gè)訓(xùn)練過(guò)程中會(huì)不斷的加強(qiáng)自身導(dǎo)致的。

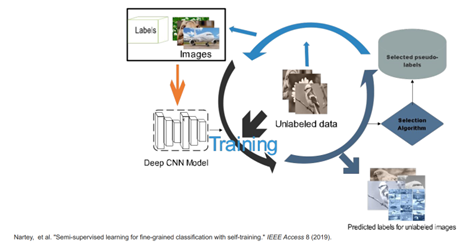

什么是self-training? self-training是比較早期的方法,用學(xué)習(xí)模型的預(yù)測(cè)去提高模型預(yù)測(cè)的能力。圖7是具體的流程圖,首先從一些帶有標(biāo)簽的數(shù)據(jù)開(kāi)始去訓(xùn)練Deep CNN model,然后用模型在不帶標(biāo)簽的數(shù)據(jù)上預(yù)測(cè),再把這些預(yù)測(cè)當(dāng)做新的標(biāo)簽,這些標(biāo)簽就叫做偽標(biāo)簽,并不是真實(shí)的標(biāo)簽,是模型的預(yù)測(cè)。這些偽標(biāo)簽可能會(huì)有好有壞,為了選出好的偽標(biāo)簽,需要使用selection algorithm選出里面高質(zhì)量的label形成一些帶有偽標(biāo)簽的數(shù)據(jù)。把這些帶有偽標(biāo)簽的數(shù)據(jù)和原始的帶有真實(shí)標(biāo)簽的預(yù)訓(xùn)練的數(shù)據(jù)結(jié)合在一起,微調(diào)或重新訓(xùn)練網(wǎng)絡(luò)。 可以看到,整個(gè)流程圖中比較重要的一環(huán)就是選擇算法,如果通過(guò)這個(gè)算法能夠成功的選擇出高質(zhì)量的數(shù)據(jù)的話(huà),就可以提高性能表現(xiàn),反之可能會(huì)降低性能表現(xiàn)。

圖7 self-training流程圖 對(duì)于文章SLAM-supported self-training for 6D object pose estimation,首先是一些動(dòng)機(jī),為什么要做6自由度物體的位姿估計(jì),因?yàn)樗梢越o出這些環(huán)境中的幾何和語(yǔ)義的信息,如圖8所示。

圖8 環(huán)境的幾何和語(yǔ)義信息

在一個(gè)環(huán)境中訓(xùn)練,在另外一個(gè)環(huán)境中測(cè)試,就會(huì)存在domain gap問(wèn)題。這個(gè)問(wèn)題的表現(xiàn)展示了一個(gè)video可視化問(wèn)題,在合成數(shù)據(jù)上訓(xùn)練,有了真實(shí)數(shù)據(jù)再測(cè)試,可以看到它很難對(duì)這些物體進(jìn)行正確的預(yù)測(cè)。那么如何去解決這樣的問(wèn)題呢?一種最簡(jiǎn)單的方式就是在測(cè)試數(shù)據(jù)中采集一些數(shù)據(jù),給這些數(shù)據(jù)加上物體位姿的標(biāo)注,然后微調(diào)6自由度位姿估計(jì)器。

但是,整個(gè)6自由度物體位姿標(biāo)注的過(guò)程非常費(fèi)時(shí)費(fèi)力,更重要的一點(diǎn)是希望機(jī)器人在探索不同環(huán)境的時(shí)候是不被打斷的,假如機(jī)器人進(jìn)入到新的環(huán)境,還要去標(biāo)注這個(gè)新環(huán)境的數(shù)據(jù),那它對(duì)機(jī)器人的自主運(yùn)行就是一個(gè)很不利的事情。所以希望做的就是機(jī)器人能夠自己去給它采集到的數(shù)據(jù)進(jìn)行標(biāo)注,做一個(gè)self label。

圖9 domain gap問(wèn)題

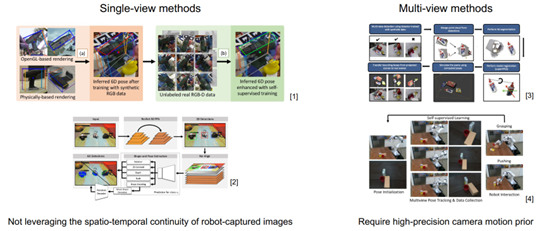

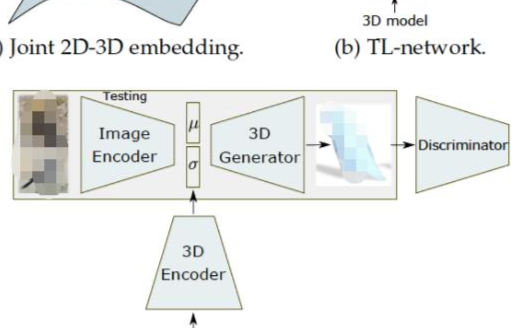

應(yīng)運(yùn)而生,有一些方法來(lái)解決問(wèn)題,一般用合成帶有標(biāo)簽的數(shù)據(jù)和一些真實(shí)不帶標(biāo)簽的數(shù)據(jù)一起去提高位姿估計(jì)的性能。如圖10所示,它們可以分為single-view methods和Multi-view methods,前者輸入的數(shù)據(jù)是無(wú)序的,但是一般機(jī)器人采集的數(shù)據(jù)都是按照一定的次序采集的,會(huì)有時(shí)間和空間上的連續(xù)性。single-view不能利用連續(xù)性,于是利用Multi-view方法,融合不同視角對(duì)于物體位姿的估計(jì)來(lái)形成更加可靠的對(duì)于物體的理解,用這個(gè)更加可靠的位姿對(duì)一些數(shù)據(jù)做標(biāo)注,再微調(diào),但大部分需要高精度相機(jī)的運(yùn)動(dòng)信息。

圖10 single-view方法和multi-view方法

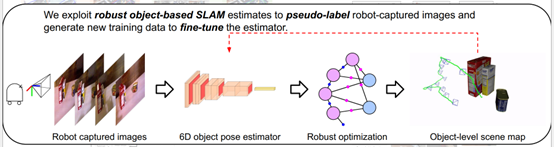

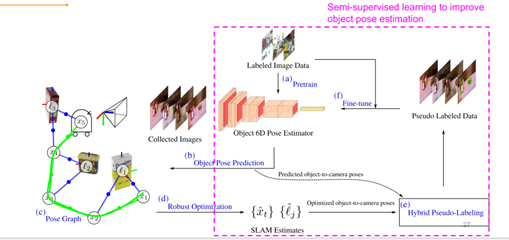

于是,提出了一種用SLAM來(lái)支持的方法,通過(guò)機(jī)器人采集的數(shù)據(jù)把它放到一個(gè)這種魯棒的物體級(jí)SLAM的系統(tǒng)里面,然后生成一個(gè)全局一致的,包括相機(jī)的位姿和物體的位姿,然后生成一些偽標(biāo)簽,利用一致性的標(biāo)簽作為新的訓(xùn)練數(shù)據(jù)去微調(diào)位姿估計(jì)模型,如圖11所示。

圖11 SLAM支持的方法

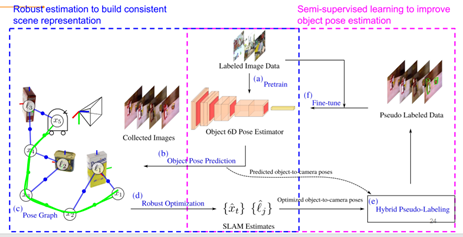

方法的流程圖如圖12所示,從帶有標(biāo)簽的圖片數(shù)據(jù)入手,預(yù)訓(xùn)練一個(gè)6D的物體位姿估計(jì)器,把這個(gè)估計(jì)器放在機(jī)器人上,在行進(jìn)過(guò)程中對(duì)物體的位姿進(jìn)行估計(jì),然后聯(lián)合物體的位姿估計(jì)和機(jī)器人的里程計(jì)形成位姿圖。用提出的一些魯棒的優(yōu)化方法求解SLAM估計(jì),包括機(jī)器人的位姿和物體的位姿,從這些模型所預(yù)測(cè)的物體位姿和優(yōu)化的位姿物體之中選出比較高質(zhì)量的物體位姿作為偽標(biāo)簽,把它和原始的帶有真實(shí)標(biāo)簽的數(shù)據(jù)進(jìn)行融合。整個(gè)流程圖和self-training是一樣的過(guò)程,從宏觀(guān)上來(lái)看,方法左半邊是在做一個(gè)魯棒的狀態(tài)估計(jì),形成全局一致的場(chǎng)景地圖,右半邊實(shí)際上是在用semi-supervised learning提高物體位姿估計(jì)的性能,方法結(jié)合了兩方面的一個(gè)成果。

圖12 方法流程圖

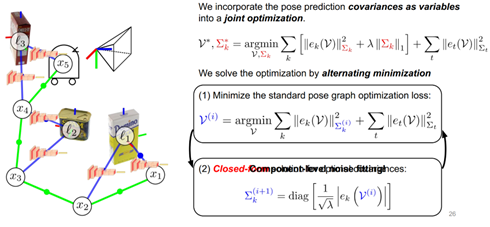

如何進(jìn)行魯棒的位姿圖優(yōu)化來(lái)得到比較可靠的SLAM估計(jì)?提出了一種自動(dòng)協(xié)方差調(diào)整的位姿圖優(yōu)化,這里如果展開(kāi)講可能需要很長(zhǎng)時(shí)間,在這邊只做一個(gè)比較宏觀(guān)的介紹。如果大家有興趣,可以去文章中的相關(guān)章節(jié)看到比較細(xì)節(jié)的公式推導(dǎo)。 首先要考慮為什么要做這樣一個(gè)自動(dòng)協(xié)方差的調(diào)整,一般在做位姿圖估計(jì)的過(guò)程中會(huì)假設(shè)觀(guān)測(cè)是符合高斯分布的,這樣就能把問(wèn)題轉(zhuǎn)換為一個(gè)非線(xiàn)性最小二乘問(wèn)題去求解,為了指定這樣的高斯分布,需要兩個(gè)量,一個(gè)是期望,一個(gè)是方差,對(duì)于高維的高斯分布需要一個(gè)期望和一個(gè)協(xié)方差矩陣。

期望很好得到,可以通過(guò)SLAM估計(jì)還有測(cè)量模型計(jì)算每個(gè)測(cè)量的期望值,但協(xié)方差一般都是經(jīng)驗(yàn)性的給出一個(gè)值,在實(shí)際中根據(jù)對(duì)于傳感器噪聲大小的一個(gè)理解去制定這樣的協(xié)方差值,比如傳感器的噪聲比較大,給一個(gè)比較大的協(xié)方差矩陣,反之給一個(gè)比較小的協(xié)方差矩陣。 現(xiàn)在對(duì)于物體位姿的估計(jì)都是從深度學(xué)習(xí)模型得到的,也就是說(shuō)傳感器變成了模型,對(duì)噪聲沒(méi)有非常可靠的理解,預(yù)測(cè)沒(méi)有辦法很好的量化。

在這種情況下,如何指定協(xié)方差矩陣?提出的方案是不指定協(xié)方差矩陣,把協(xié)方差矩陣和SLAM的變量進(jìn)行聯(lián)合優(yōu)化,如圖13所示,在公式里展示。第一項(xiàng)代表物體位姿的損失值,最后一項(xiàng)是機(jī)器人里程計(jì)的損失值,第一項(xiàng)是正則化項(xiàng),目的是防止值跑到正無(wú)窮,像零這個(gè)方向去正則化。 求解聯(lián)合優(yōu)化的問(wèn)題是用的alternating minimization方法,這個(gè)方法有兩個(gè)優(yōu)勢(shì),第一個(gè)優(yōu)勢(shì)是對(duì)最優(yōu)的協(xié)方差矩陣有一個(gè)解析解,第二個(gè)好處是可以在分量級(jí)別對(duì)協(xié)方差矩陣進(jìn)行擬合。得到位姿預(yù)測(cè)時(shí),對(duì)六個(gè)自由度的分量進(jìn)行不同程度的擬合,與傳統(tǒng)方法相比更加靈活,也能夠擬合更廣泛的噪聲模型。

圖13 自動(dòng)協(xié)方差調(diào)整公式推導(dǎo)

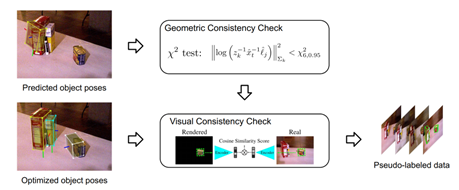

如圖14所示是hybrid pseudo-labeling方法,在兩種位姿中選取高質(zhì)量的偽標(biāo)簽。

圖14 hybrid pseudo-labeling方法

如圖15所示,Hybrid model利用了兩種數(shù)據(jù),一種數(shù)據(jù)是模型直接在圖片上預(yù)測(cè)的物體位姿,另一種是通過(guò)優(yōu)化得到的物體位姿,為了對(duì)位姿進(jìn)行好壞的評(píng)估,有兩種評(píng)估方法,一種利用幾何信息,另一種利用視覺(jué)信息,幾何信息使用卡方測(cè)試,預(yù)測(cè)的物體位姿是否和優(yōu)化的物體位姿有顯著的差異,如果有顯著差異可能是比較差的位姿估計(jì),反之是比較好的位姿估計(jì)。視覺(jué)檢查根據(jù)物體位姿估計(jì)生成一個(gè)渲染圖片,把渲染物體和真實(shí)物體對(duì)比,轉(zhuǎn)換到特征空間,在特征空間上的向量看它們是不是相似。經(jīng)過(guò)這兩個(gè)check,就能得到比較高質(zhì)量的位姿標(biāo)簽數(shù)據(jù)。

圖15 Hybrid model 提出方法的結(jié)果

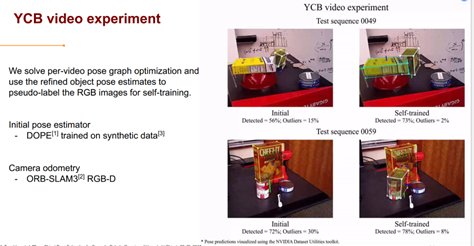

如圖16所示,在兩個(gè)數(shù)據(jù)集上進(jìn)行實(shí)驗(yàn),并測(cè)試方法。第一個(gè)數(shù)據(jù)集是一個(gè)公開(kāi)數(shù)據(jù)集,叫做YCB video experiment。首先用一些合成數(shù)據(jù)去預(yù)訓(xùn)練,然后拿到模型上進(jìn)行self-training。值得強(qiáng)調(diào)的是,在進(jìn)行self-training時(shí),不去使用這些label標(biāo)注,完全通過(guò)self-training生成標(biāo)注,最后一步就是把self-training后的放在上面去評(píng)估表現(xiàn)。Video展示的是它們?cè)跍y(cè)試集的表現(xiàn),就是在self-training之前和之后進(jìn)行的對(duì)比,可以看到self-training后性能更加穩(wěn)定,能夠檢測(cè)出更多物體,也有更少離群的位姿估計(jì)。

圖16 提出方法的結(jié)果

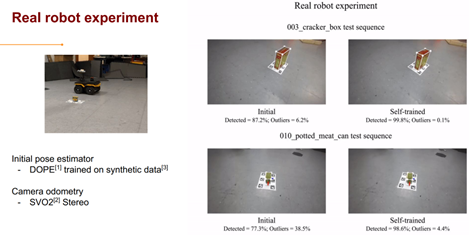

如圖17所示,第二個(gè)實(shí)驗(yàn)是在真實(shí)車(chē)上面做的實(shí)驗(yàn),把相機(jī)放在機(jī)器人上,圍繞物體進(jìn)行導(dǎo)航。做真實(shí)機(jī)器人實(shí)驗(yàn)的目的就是為了測(cè)試方法對(duì)于挑戰(zhàn)的可行性,提出方法在運(yùn)動(dòng)模糊等情況下依然可以得到比較好的性能,比較多的提高訓(xùn)練后的表現(xiàn),離群值很少。

圖17 真實(shí)車(chē)實(shí)驗(yàn)

三、總結(jié)和未來(lái)展望

提出的方法是魯棒性SLAM所支持的6自由度物體位姿估計(jì)的自訓(xùn)練方法,目的是希望做優(yōu)化,方法能夠適應(yīng)新的環(huán)境。最重要的一環(huán)是提出的自動(dòng)協(xié)方差調(diào)整的位姿圖優(yōu)化方法,最后通過(guò)實(shí)驗(yàn)驗(yàn)證了方法的表現(xiàn)。如圖18所示,右上角有文章和代碼的鏈接,感興趣可以去看一下。

?

?最后就是如何去延伸工作,首先可以給系統(tǒng)加入對(duì)動(dòng)態(tài)物體的處理,如何考慮它的影響,或者某些物體有對(duì)稱(chēng)性的物體位姿如何處理,以及魯棒性的半監(jiān)督學(xué)習(xí),還有很多更新的方法進(jìn)一步提高表現(xiàn),最后可以把對(duì)于物體級(jí)別的性能提升擴(kuò)展到對(duì)于物體位姿形狀和類(lèi)別進(jìn)行估計(jì),用更加可靠的結(jié)果訓(xùn)練,然后估計(jì)。當(dāng)然可以很多其他的方面,由于時(shí)間的分享,討論告一段落。

四、問(wèn)題:

1.深度學(xué)習(xí)對(duì)于堆疊物體位姿估計(jì)有什么建議嗎? 可以看一些對(duì)于這塊研究的設(shè)計(jì)方法的文章,如果對(duì)這塊理解的不是特別深入,也可以看一下深藍(lán)學(xué)院的相關(guān)課程。

2.在利用深度學(xué)習(xí)的方法進(jìn)行6自由度物體位姿估計(jì)時(shí),如果要建立RGBD數(shù)據(jù)集的話(huà),有什么好的方法推薦嗎? 我的理解是如何選擇采集到的RGBD圖片對(duì)不對(duì),可以在網(wǎng)上找一些圖,然后放在tool中進(jìn)行學(xué)習(xí)產(chǎn)生標(biāo)注。可以使用優(yōu)化方法只采用標(biāo)注關(guān)鍵幀的方法,利用優(yōu)化進(jìn)行復(fù)制,有效快速的標(biāo)注。

3.得到偽標(biāo)簽以后,再訓(xùn)練網(wǎng)絡(luò)是不是需要離線(xiàn)進(jìn)行?這樣SLAM是否就要停下了? 是的,這個(gè)說(shuō)法是正確的,采集到偽標(biāo)簽數(shù)據(jù)時(shí),需要訓(xùn)練位姿估計(jì)的模型,需要較長(zhǎng)的時(shí)間,當(dāng)前大多數(shù)模型都需要較長(zhǎng)時(shí)間,如果未來(lái)有更好的方法在短時(shí)間內(nèi)進(jìn)行訓(xùn)練,也希望可以在線(xiàn)進(jìn)行。

4.實(shí)驗(yàn)小車(chē)的處理器什么配置?方法實(shí)現(xiàn)在線(xiàn)實(shí)時(shí)嗎? 在實(shí)驗(yàn)中采取的小車(chē)是jerk robot,只是去用它作為一個(gè)相機(jī)支架?chē)@物體變成目標(biāo),如果要了解的話(huà)可以了解這個(gè)機(jī)器人的內(nèi)部構(gòu)造。

5.實(shí)現(xiàn)的方法是單目還是rgbd的? 方法是單目的。

6.如果SLAM需要停止的話(huà),那么SLAM的作用不就相當(dāng)于收集數(shù)據(jù)集嗎? 是的,這個(gè)方法的提出自動(dòng)收集數(shù)據(jù)集的過(guò)程,可能傳到云端,有服務(wù)的話(huà)可以很快的訓(xùn)練,也就不需要停止很久。

7.最后檢測(cè)的物體仍然是預(yù)訓(xùn)練里面已有的物體嗎? 是的。

8.即使不使用SLAM,手動(dòng)收集數(shù)據(jù)集也可以,另外方法對(duì)SLAM的過(guò)程有哪些提高? 手動(dòng)收集是可以的,但大部分都是在公開(kāi)數(shù)據(jù)集中進(jìn)行分析,然后對(duì)它進(jìn)行使用。它的問(wèn)題在于在真實(shí)環(huán)境中對(duì)機(jī)器人環(huán)境探索,很難有人一直跟著機(jī)器人,希望機(jī)器人自主做label的。提高主要是自動(dòng)的產(chǎn)生標(biāo)簽,可以用這個(gè)過(guò)程優(yōu)化協(xié)方差模型。

編輯:黃飛

?

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論