自然語(yǔ)言處理技術(shù),用于計(jì)算機(jī)中模擬人類的對(duì)話和文本理解。主要源于AI大模型化的NLP技術(shù)突破是將深度學(xué)習(xí)技術(shù)與傳統(tǒng)的NLP方法結(jié)合在一起,從而更好地提高NLP技術(shù)的準(zhǔn)確性和效率。大模型化的NLP技術(shù)能夠更好地支持企業(yè)進(jìn)行大規(guī)模的語(yǔ)料內(nèi)容分析,并為企業(yè)更好地進(jìn)行文本分析提供幫助。 語(yǔ)言是人類區(qū)

2023-02-13 09:47:00 3892

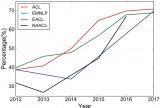

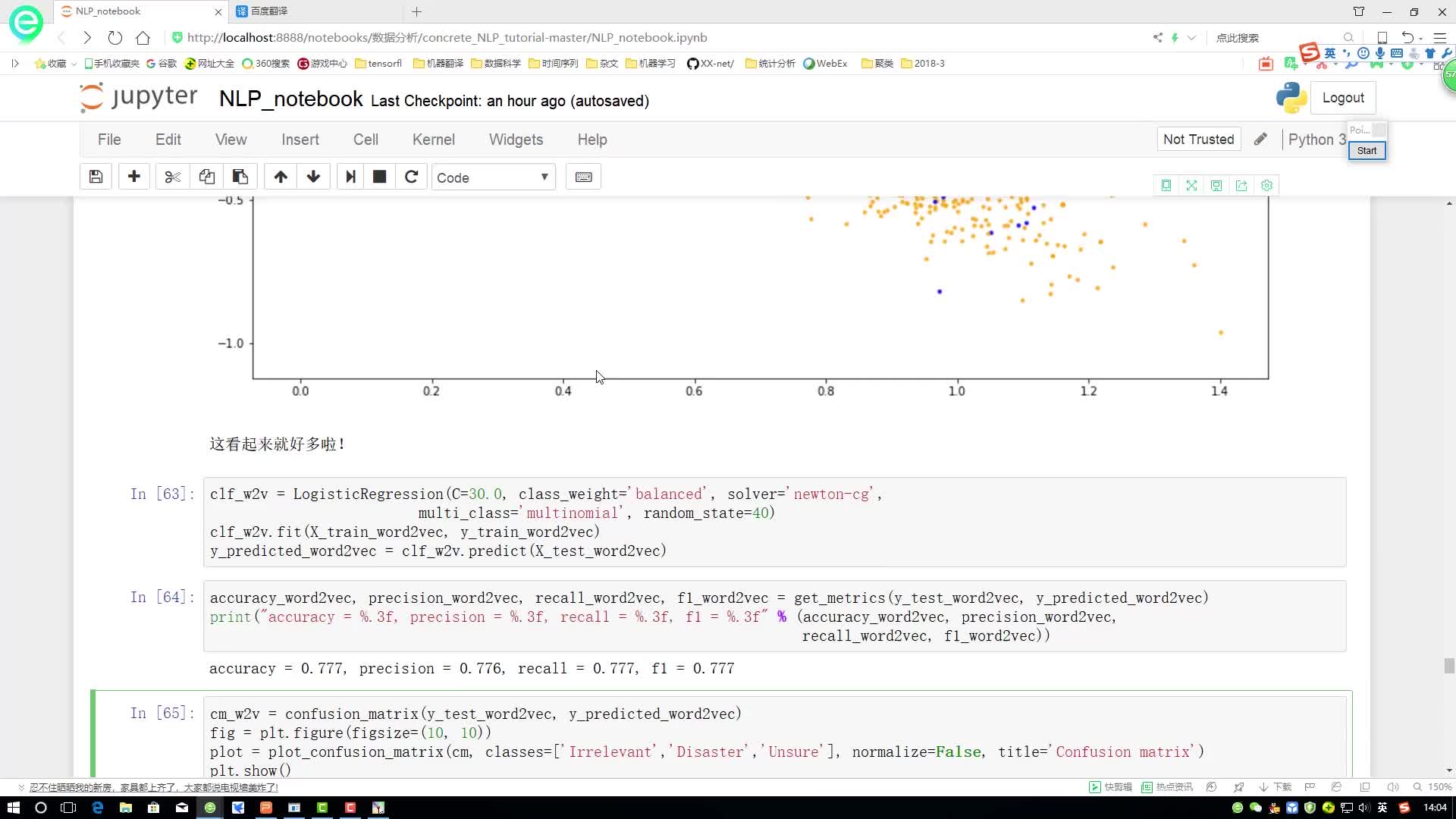

3892 本文通過(guò)深度學(xué)習(xí)技術(shù)來(lái)闡述2017年NLP領(lǐng)域所取得的一系列進(jìn)步

2017-12-16 07:59:00 7584

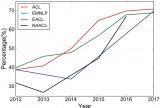

7584 英特爾人工智能產(chǎn)品事業(yè)部,數(shù)據(jù)科學(xué)主任 Yinyin Liu 近日撰寫(xiě)了一篇文章,介紹了深度學(xué)習(xí)為自然語(yǔ)言處理帶來(lái)的種種變化。有趣的大趨勢(shì)是首先產(chǎn)生在 CV 領(lǐng)域的技術(shù)也不斷用于 NLP,而深度學(xué)習(xí)解決方案的構(gòu)建方式也隨著時(shí)間在進(jìn)化。

2018-05-02 10:00:25 6569

6569

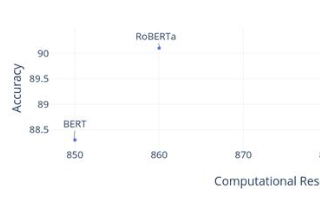

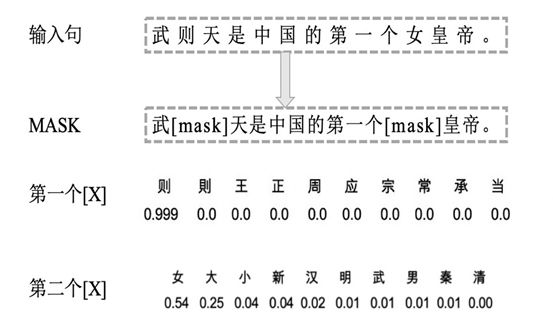

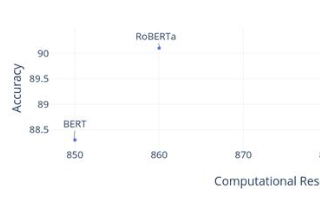

基于神經(jīng)網(wǎng)絡(luò)中層信息量指標(biāo),分析不同神經(jīng)網(wǎng)絡(luò)模型的處理能力。我們分析比較了四種在 NLP 中常用的深度學(xué)習(xí)模型,即 BERT, Transformer, LSTM, 和 CNN。在各 NLP 任務(wù)中,BERT 模型往往表現(xiàn)最好,Transformer 模型次之。

2020-09-11 16:56:24 1545

1545

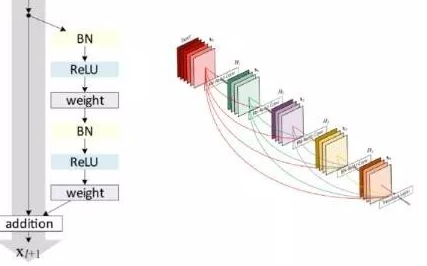

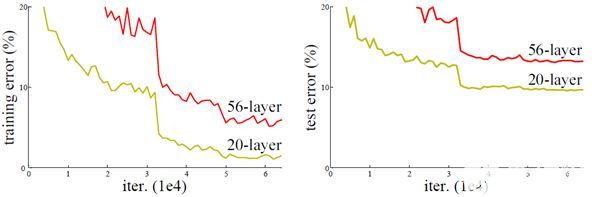

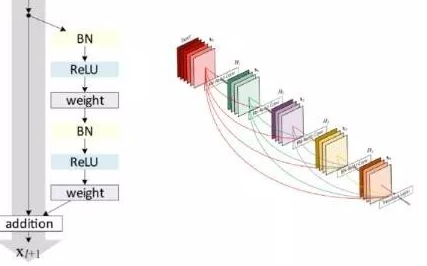

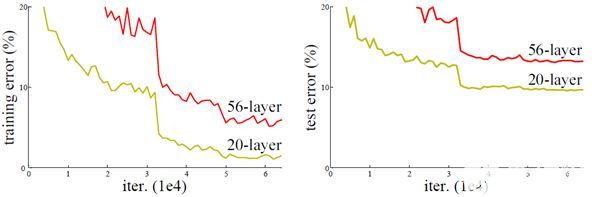

深度學(xué)習(xí)與圖神經(jīng)網(wǎng)絡(luò)學(xué)習(xí)分享:CNN 經(jīng)典網(wǎng)絡(luò)之-ResNet resnet 又叫深度殘差網(wǎng)絡(luò) 圖像識(shí)別準(zhǔn)確率很高,主要作者是國(guó)人哦 深度網(wǎng)絡(luò)的退化問(wèn)題 深度網(wǎng)絡(luò)難以訓(xùn)練,梯度消失,梯度爆炸

2022-10-12 09:54:42 1641

1641

一:深度學(xué)習(xí)DeepLearning實(shí)戰(zhàn)時(shí)間地點(diǎn):1 月 15日— 1 月18 日二:深度強(qiáng)化學(xué)習(xí)核心技術(shù)實(shí)戰(zhàn)時(shí)間地點(diǎn): 1 月 27 日— 1 月30 日(第一天報(bào)到 授課三天;提前環(huán)境部署 電腦

2021-01-09 17:01:54

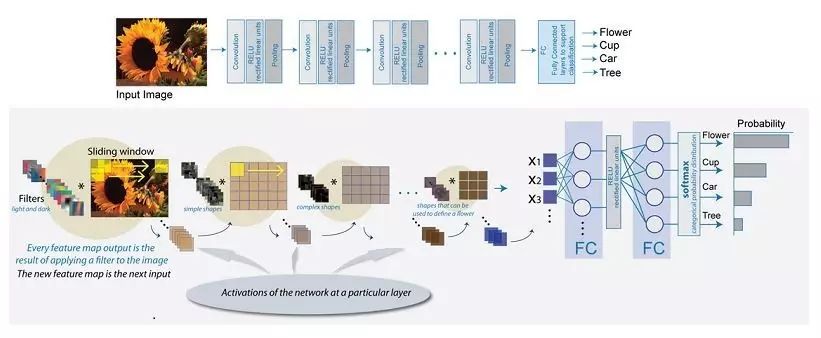

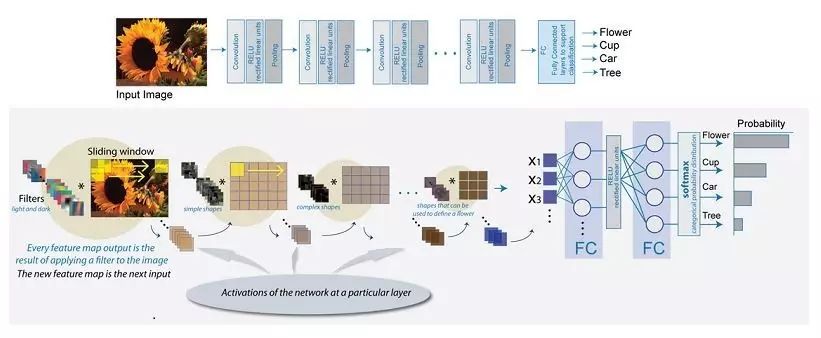

的網(wǎng)絡(luò)最終來(lái)實(shí)現(xiàn)更通用的識(shí)別。這些多層的優(yōu)點(diǎn)是各種抽象層次的學(xué)習(xí)特征。例如,若訓(xùn)練深度卷積神經(jīng)網(wǎng)絡(luò)(CNN)來(lái)對(duì)圖像進(jìn)行分類,則第一層學(xué)習(xí)識(shí)別邊緣等最基本的東西…

2022-11-11 07:55:50

最終來(lái)實(shí)現(xiàn)更通用的識(shí)別。這些多層的優(yōu)點(diǎn)是各種抽象層次的學(xué)習(xí)特征。例如,若訓(xùn)練深度卷積神經(jīng)網(wǎng)絡(luò)(CNN)來(lái)對(duì)圖像進(jìn)行分類,則第一層學(xué)習(xí)識(shí)別邊緣等最基本的東西。下一層學(xué)習(xí)識(shí)別成形的邊緣的集合。后續(xù)圖層學(xué)習(xí)

2019-03-13 06:45:03

深度學(xué)習(xí)常用模型有哪些?深度學(xué)習(xí)常用軟件工具及平臺(tái)有哪些?深度學(xué)習(xí)存在哪些問(wèn)題?

2021-10-14 08:20:47

CPU優(yōu)化深度學(xué)習(xí)框架和函數(shù)庫(kù)機(jī)器學(xué)***器

2021-02-22 06:01:02

一:深度學(xué)習(xí)DeepLearning實(shí)戰(zhàn)時(shí)間地點(diǎn):1 月 15日— 1 月18 日二:深度強(qiáng)化學(xué)習(xí)核心技術(shù)實(shí)戰(zhàn)時(shí)間地點(diǎn): 1 月 27 日— 1 月30 日(第一天報(bào)到 授課三天;提前環(huán)境部署 電腦

2021-01-10 13:42:26

學(xué)習(xí),也就是現(xiàn)在最流行的深度學(xué)習(xí)領(lǐng)域,關(guān)注論壇的朋友應(yīng)該看到了,開(kāi)發(fā)板試用活動(dòng)中有【NanoPi K1 Plus試用】的申請(qǐng),介紹中NanopiK1plus的高大上優(yōu)點(diǎn)之一就是“可運(yùn)行深度學(xué)習(xí)算法的智能

2018-06-04 22:32:12

傳統(tǒng)的視覺(jué)算法受打光以及圖像的邊緣對(duì)比度影響,無(wú)法做到人眼的分辨效果,而且人具有學(xué)習(xí)能力,經(jīng)過(guò)大量樣本的學(xué)習(xí),人就可以找到不同物體之間的細(xì)微差別,從而分辨出物體的類別。CNN就是模擬人的大腦

2020-07-23 20:33:10

,非線性回歸,手寫(xiě)數(shù)字分類模型開(kāi)始講起。逐步講到一些深度學(xué)習(xí)網(wǎng)絡(luò)的應(yīng)用如CNN,LSTM。最后會(huì)帶著大家完成一些實(shí)際的應(yīng)用案例如圖像識(shí)別,圖片風(fēng)格轉(zhuǎn)換,seq2seq模型的應(yīng)用,情感分類,生成對(duì)抗網(wǎng)絡(luò)等。下面

2018-07-17 11:40:31

1 CNN簡(jiǎn)介

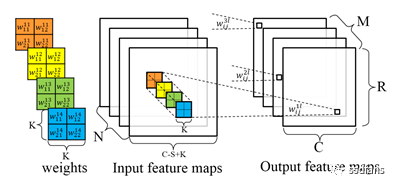

CNN即卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks),是一類包含卷積計(jì)算的神經(jīng)網(wǎng)絡(luò),是深度學(xué)習(xí)(deep learning)的代表算法之一,在圖像識(shí)別

2023-08-18 06:56:34

深度學(xué)習(xí)(Deep Learning)核心技術(shù)開(kāi)發(fā)與應(yīng)用1,Deep Learning—循環(huán)神經(jīng)網(wǎng)絡(luò)2,Deep Learning—CNN應(yīng)用案例3,Deep Learning—對(duì)抗性生成網(wǎng)絡(luò)4

2018-09-05 10:22:34

深度學(xué)習(xí)是什么意思

2020-11-11 06:58:03

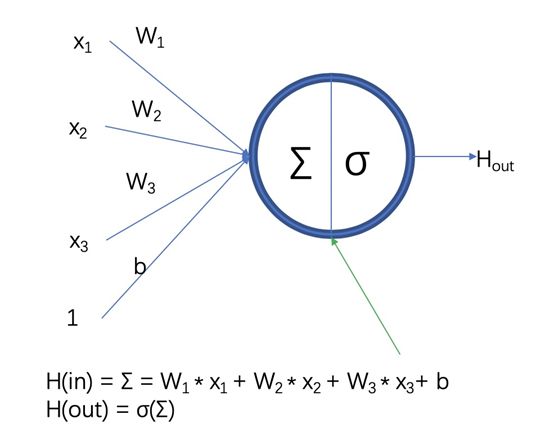

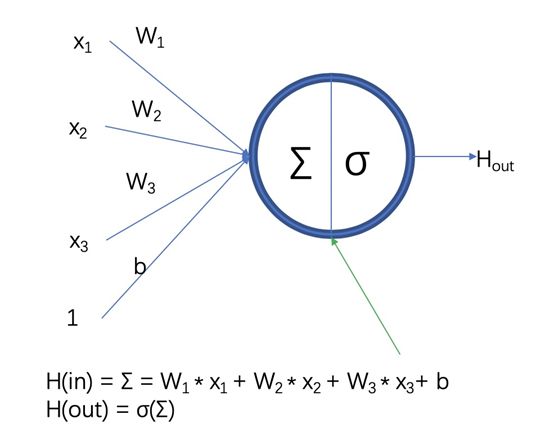

什么是深度學(xué)習(xí)為了解釋深度學(xué)習(xí),有必要了解神經(jīng)網(wǎng)絡(luò)。神經(jīng)網(wǎng)絡(luò)是一種模擬人腦的神經(jīng)元和神經(jīng)網(wǎng)絡(luò)的計(jì)算模型。作為具體示例,讓我們考慮一個(gè)輸入圖像并識(shí)別圖像中對(duì)象類別的示例。這個(gè)例子對(duì)應(yīng)機(jī)器學(xué)習(xí)中的分類

2023-02-17 16:56:59

【深度學(xué)習(xí)】卷積神經(jīng)網(wǎng)絡(luò)CNN

2020-06-14 18:55:37

ABSTRACT1.基于深度學(xué)習(xí)的異常檢測(cè)的研究方法進(jìn)行結(jié)構(gòu)化和全面的概述2.回顧這些方法在各個(gè)領(lǐng)域這個(gè)中的應(yīng)用情況,并評(píng)估他們的有效性。3.根據(jù)基本假設(shè)和采用的方法將最先進(jìn)的深度異常檢測(cè)技術(shù)分為

2021-07-12 06:36:22

異常檢測(cè)的深度學(xué)習(xí)研究綜述原文:arXiv:1901.03407摘要異常檢測(cè)是一個(gè)重要的問(wèn)題,在不同的研究領(lǐng)域和應(yīng)用領(lǐng)域都得到了很好的研究。本文的研究目的有兩個(gè):首先,我們對(duì)基于深度學(xué)習(xí)的異常檢測(cè)

2021-07-12 07:10:19

單片機(jī)(Cortex-M內(nèi)核,無(wú)操作系統(tǒng))可以跑深度學(xué)習(xí)嗎? ——Read Air 2019.8.20Xu_CNN框架待處理:1.需要設(shè)計(jì)一個(gè)可讀寫(xiě)的消息棧 ()2.函數(shù)的類型參數(shù)使用結(jié)構(gòu)體傳入 (已實(shí)現(xiàn))3.動(dòng)態(tài)...

2021-12-09 08:02:27

的方式,取代了特徵提取這個(gè)環(huán)節(jié),如下圖說(shuō)明機(jī)器學(xué)習(xí)與深度學(xué)習(xí)的主要差異。 卷積神經(jīng)網(wǎng)路(Convolutional Neural Network, CNN ),為具代表性的深度學(xué)習(xí)算法之一,是由類神經(jīng)網(wǎng)

2019-09-20 09:05:05

紋理就能被更準(zhǔn)確地捕捉和分類。 在基于紋理的分類任務(wù)重,紋理分析對(duì)于深度學(xué)習(xí)的重要性 由于紋理基于局部模式,而傳統(tǒng)的深度學(xué)習(xí)方法強(qiáng)調(diào)復(fù)雜的特征,對(duì)紋理分類沒(méi)有幫助,因此,傳統(tǒng)的CNN架構(gòu)不能很好

2022-10-26 16:57:26

基于特征的遷移學(xué)習(xí)基于分類器適配的遷移學(xué)習(xí)章節(jié)目標(biāo):掌握遷移學(xué)習(xí)的思想與基本形式,了解傳統(tǒng)遷移學(xué)習(xí)的基本方法,對(duì)比各種方法的優(yōu)缺點(diǎn),掌握遷移學(xué)習(xí)的適用范圍。四、深度遷移學(xué)習(xí)介紹深度遷移學(xué)習(xí)概述基于距離

2022-04-21 15:15:11

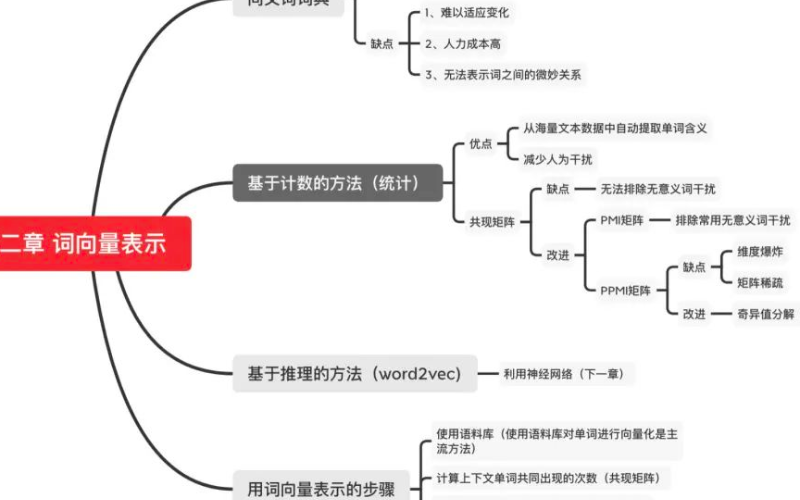

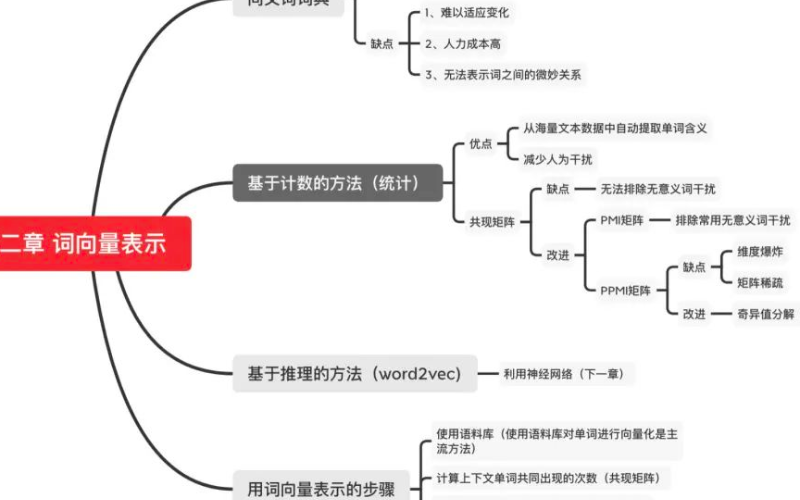

從分詞、詞性等基礎(chǔ)模塊,到機(jī)器翻譯、知識(shí)問(wèn)答等領(lǐng)域,本文列舉并分析一些深度學(xué)習(xí)在 NLP 領(lǐng)域的具體運(yùn)用,希望對(duì)大家研究深度學(xué)習(xí)和 NLP 有所幫助。

2017-08-18 17:06:58 8062

8062

本文從兩篇論文出發(fā)先簡(jiǎn)要介紹了自然語(yǔ)言處理的基本分類和基本概念,再向讀者展示了深度學(xué)習(xí)中的 NLP。這兩篇論文都是很好的綜述性入門論文,希望詳細(xì)了解自然語(yǔ)言處理的讀者可以進(jìn)一步閱讀這兩篇論文。

2017-08-22 14:56:36 7139

7139 深度學(xué)習(xí)的出現(xiàn)使得算法對(duì)圖像的語(yǔ)義級(jí)操作成為可能。本文即是介紹深度學(xué)習(xí)技術(shù)在圖像超清化問(wèn)題上的最新研究進(jìn)展。 深度學(xué)習(xí)最早興起于圖像,其主要處理圖像的技術(shù)是卷積神經(jīng)網(wǎng)絡(luò),關(guān)于卷積神經(jīng)網(wǎng)絡(luò)的起源,業(yè)界

2017-09-30 11:15:17 1

1 CNN是目前自然語(yǔ)言處理中和RNN并駕齊驅(qū)的兩種最常見(jiàn)的深度學(xué)習(xí)模型。圖1展示了在NLP任務(wù)中使用CNN模型的典型網(wǎng)絡(luò)結(jié)構(gòu)。一般而言,輸入的字或者詞用Word Embedding的方式表達(dá),這樣

2017-11-15 17:59:19 17395

17395

通過(guò)深度學(xué)習(xí)技術(shù),物聯(lián)網(wǎng)(IoT)設(shè)備能夠得以解析非結(jié)構(gòu)化的多媒體數(shù)據(jù),智能地響應(yīng)用戶和環(huán)境事件,但是卻伴隨著苛刻的性能和功耗要求。本文作者探討了兩種方式以便將深度學(xué)習(xí)和低功耗的物聯(lián)網(wǎng)設(shè)備成功整合

2017-12-01 11:22:01 1563

1563 文本實(shí)體提取是自然語(yǔ)言處理(NLP)的主要任務(wù)之一。隨著近期深度學(xué)習(xí)領(lǐng)域快速發(fā)展,我們可以將這些算法應(yīng)用到 NLP 任務(wù)中,并得到準(zhǔn)確率遠(yuǎn)超傳統(tǒng)方法的結(jié)果。我嘗試過(guò)分別使用深度學(xué)習(xí)和傳統(tǒng)方法來(lái)提取文章信息,結(jié)果非常驚人:深度學(xué)習(xí)的準(zhǔn)確率達(dá)到了 85%,遠(yuǎn)遠(yuǎn)領(lǐng)先于傳統(tǒng)算法的 65%。

2018-07-13 08:33:00 7111

7111

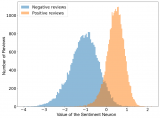

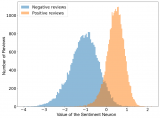

微軟數(shù)據(jù)科學(xué)家Ilia Karmanov最新測(cè)試的結(jié)果顯示,亞馬遜MXNet在CNN、RNN與NLP情感分析任務(wù)上性能強(qiáng)勁,而TensorFlow僅擅長(zhǎng)于特征提取。

2017-12-06 16:04:40 9154

9154 現(xiàn)在都在談?wù)撊斯ぶ悄芑蛘叽髷?shù)據(jù)相關(guān)的知識(shí),但是與之相關(guān)的機(jī)器學(xué)習(xí)、深度學(xué)習(xí)等你能分清嗎?數(shù)據(jù)科學(xué)比機(jī)器學(xué)習(xí)范圍大得多,數(shù)據(jù)科學(xué)實(shí)際上涵蓋了整個(gè)數(shù)據(jù)處理的范圍,而不只是算法或者統(tǒng)計(jì)學(xué)方面。

2017-12-18 16:28:50 1096

1096

本文作者Javier Couto是tryo labs公司的一名研發(fā)科學(xué)家,專注于NLP技術(shù)。這篇文章是他對(duì)2017年NLP領(lǐng)域中深度學(xué)習(xí)技術(shù)應(yīng)用的總結(jié),也許并不全面,但都是他認(rèn)為有價(jià)值、有意義的成果。Couto表示,2017年是對(duì)NLP領(lǐng)域非常有意義的一年,隨著深度學(xué)習(xí)的應(yīng)用,NLP技術(shù)也將繼續(xù)發(fā)展下去。

2017-12-28 10:02:28 6043

6043

用深度學(xué)習(xí)模型——Mask R-CNN,自動(dòng)從視頻中制作目標(biāo)物體的GIF動(dòng)圖。

2018-02-03 14:19:27 12206

12206 本文用簡(jiǎn)潔易懂的語(yǔ)言,講述了自然語(yǔ)言處理(NLP)的前世今生。從什么是NLP到為什么要學(xué)習(xí)NLP,再到如何利用機(jī)器學(xué)習(xí)進(jìn)行NLP,值得一讀。這是該系列的第一部分,介紹了三種NLP技術(shù):文本嵌入、機(jī)器翻譯、Dialogue 和 Conversations。

2018-06-10 10:26:10 78625

78625

深度學(xué)習(xí),有太多令人驚嘆的能力!從12年的圖像識(shí)別開(kāi)始,深度學(xué)習(xí)的一個(gè)個(gè)突破,讓人們一次又一次的刷新對(duì)它的認(rèn)知。然而,應(yīng)用深度學(xué)習(xí),一直有一個(gè)巨大的前提:大量標(biāo)注數(shù)據(jù)。但是難道數(shù)據(jù)少,就享受不到深度

2018-08-12 11:49:53 20302

20302 本深度學(xué)習(xí)是什么?了解深度學(xué)習(xí)難嗎?讓你快速了解深度學(xué)習(xí)的視頻講解本文檔視頻讓你4分鐘快速了解深度學(xué)習(xí)

深度學(xué)習(xí)的概念源于人工智能的人工神經(jīng)網(wǎng)絡(luò)的研究。含多隱層的多層感知器就是一種深度學(xué)習(xí)結(jié)構(gòu)。深度學(xué)習(xí)通過(guò)組合低層特征形成更加抽象的高層表示屬性類別或特征,以發(fā)現(xiàn)數(shù)據(jù)的分布式特征表示。

2018-08-23 14:36:16 16

16 該視頻概述了Apache Spark *的BigDL分布式深度學(xué)習(xí)框架。

2018-10-30 06:41:00 3939

3939 用深度學(xué)習(xí)對(duì)自然語(yǔ)言處理(NLP)進(jìn)行分類

2018-11-05 06:51:00 3963

3963 Sebastian Ruder 是一位 NLP 方向的博士生、研究科學(xué)家,目前供職于一家做 NLP 相關(guān)服務(wù)的愛(ài)爾蘭公司 AYLIEN,同時(shí),他也是一位活躍的博客作者,發(fā)表了多篇機(jī)器學(xué)習(xí)、NLP 和深度學(xué)習(xí)相關(guān)的文章。

2019-01-08 11:25:32 3970

3970 深度卷積神經(jīng)網(wǎng)絡(luò)(CNN)是一種特殊類型的神經(jīng)網(wǎng)絡(luò),在各種競(jìng)賽基準(zhǔn)上表現(xiàn)出了當(dāng)前最優(yōu)結(jié)果。本綜述將最近的 CNN 架構(gòu)創(chuàng)新分為七個(gè)不同的類別,分別基于空間利用、深度、多路徑、寬度、特征圖利用、通道提升和注意力。

2019-01-27 11:01:13 4739

4739

在信號(hào)處理、圖像處理和其它工程/科學(xué)領(lǐng)域,卷積都是一種使用廣泛的技術(shù)。在深度學(xué)習(xí)領(lǐng)域,卷積神經(jīng)網(wǎng)絡(luò)(CNN)這種模型架構(gòu)就得名于這種技術(shù)。但是,深度學(xué)習(xí)領(lǐng)域的卷積本質(zhì)上是信號(hào)/圖像處理領(lǐng)域內(nèi)的互相關(guān)(cross-correlation)。這兩種操作之間存在細(xì)微的差別。

2019-02-26 10:01:05 3944

3944

該項(xiàng)目是對(duì)基于深度學(xué)習(xí)的自然語(yǔ)言處理(NLP)的概述,包括用來(lái)解決不同 NLP 任務(wù)和應(yīng)用的深度學(xué)習(xí)模型(如循環(huán)神經(jīng)網(wǎng)絡(luò)、卷積神經(jīng)網(wǎng)絡(luò)和強(qiáng)化學(xué)習(xí))的理論介紹和實(shí)現(xiàn)細(xì)節(jié),以及對(duì) NLP 任務(wù)(機(jī)器翻譯、問(wèn)答和對(duì)話系統(tǒng))當(dāng)前最優(yōu)結(jié)果的總結(jié)。

2019-03-01 09:13:57 5598

5598

這篇文章是一名自然語(yǔ)言處理(nlp)的初學(xué)者,在nlp里摸爬滾打了許久的一些心得,推薦了nlp的學(xué)習(xí)路線和資料合集,本站極力推薦。

2019-03-03 11:05:05 6295

6295 對(duì)于深度學(xué)習(xí)本人也是半路出家. 現(xiàn)在的工作內(nèi)容主要就是使用CNN做CV任務(wù). 干調(diào)參這種活也有兩年時(shí)間了. 我的回答可能更多的還是側(cè)重工業(yè)應(yīng)用, 技術(shù)上只限制在CNN這塊.

2019-06-08 14:41:00 2669

2669 此在線課程涵蓋從基礎(chǔ)到高級(jí)NLP,它是Coursera上高級(jí)機(jī)器學(xué)習(xí)專業(yè)化的一部分。你可以免費(fèi)注冊(cè)本課程,你將學(xué)習(xí)情緒分析、總結(jié)、對(duì)話狀態(tài)跟蹤等。你將學(xué)習(xí)的主題包括文本分類介紹、語(yǔ)言建模和序列標(biāo)記、語(yǔ)義向量空間模型、序列到序列任務(wù)等等。

2019-07-07 07:44:00 8552

8552 訓(xùn)練 CNN 需要相當(dāng)大量的數(shù)據(jù),因?yàn)閷?duì)于典型的圖像分類問(wèn)題,其需要學(xué)習(xí)幾百萬(wàn)個(gè)權(quán)值。從頭開(kāi)始訓(xùn)練 CNN 的另一個(gè)常見(jiàn)做法是使用預(yù)先訓(xùn)練好的模型自動(dòng)從新的數(shù)據(jù)集提取特征。這種方法稱為遷移學(xué)習(xí),是一種應(yīng)用深度學(xué)習(xí)的便捷方式,其無(wú)需龐大的數(shù)據(jù)集以及長(zhǎng)時(shí)間的訓(xùn)練。

2019-09-16 15:11:20 6344

6344

深度學(xué)習(xí)技術(shù)成為機(jī)器視覺(jué)的熱門話題之一。深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一個(gè)領(lǐng)域,它使計(jì)算機(jī)能夠通過(guò)卷積神經(jīng)網(wǎng)絡(luò)(CNN)等體系結(jié)構(gòu)進(jìn)行訓(xùn)練和學(xué)習(xí)。

2019-08-23 17:02:03 1136

1136 深度學(xué)習(xí)和機(jī)器學(xué)習(xí)已經(jīng)變得無(wú)處不在,那它們之間到底有什么區(qū)別呢?本文我們?yōu)榇蠹铱偨Y(jié)了深度學(xué)習(xí)VS機(jī)器學(xué)習(xí)的六大本質(zhì)區(qū)別。

2019-11-30 11:17:02 15876

15876 隨著人類技術(shù)的不斷發(fā)展,人工智能,深度學(xué)習(xí),機(jī)器學(xué)習(xí)和NLP都是受歡迎的搜索熱詞。

2020-05-03 18:09:00 3321

3321 自然語(yǔ)言處理(NLP)最近取得了巨大的進(jìn)步,每隔幾天就會(huì)發(fā)布最新的結(jié)果。排行榜瘋狂是指最常見(jiàn)的NLP基準(zhǔn),如GLUE和SUPERGLUE,它們的得分越來(lái)越接近人類的水平。這些結(jié)果大多是通過(guò)超大(數(shù)十億個(gè)參數(shù))模型從大規(guī)模數(shù)據(jù)集中遷移學(xué)習(xí)得到的。

2020-05-04 12:03:00 3596

3596

由CNN驅(qū)動(dòng)的深度學(xué)習(xí)模型現(xiàn)在無(wú)處不在,你會(huì)發(fā)現(xiàn)它們已散布到全球的各種計(jì)算機(jī)視覺(jué)應(yīng)用程序中

2020-07-28 10:08:16 1496

1496 學(xué)習(xí)。” 在這 5 堂課中,學(xué)生將可以學(xué)習(xí)到深度學(xué)習(xí)的基礎(chǔ),學(xué)會(huì)構(gòu)建神經(jīng)網(wǎng)絡(luò),并用在包括吳恩達(dá)本人在內(nèi)的多位業(yè)界頂尖專家指導(dǎo)下創(chuàng)建自己的機(jī)器學(xué)習(xí)項(xiàng)目。Deep Learning Specialization 對(duì)卷積神經(jīng)網(wǎng)絡(luò) (CNN)、遞歸神經(jīng)網(wǎng)絡(luò) (RNN)、長(zhǎng)短期

2020-09-01 08:00:00 5

5 本文針對(duì)NLP項(xiàng)目給出了4種常見(jiàn)的解題思路,其中包含1種基于機(jī)器學(xué)習(xí)的思路和3種基于深度學(xué)習(xí)的思路。

2020-09-24 10:33:33 2903

2903

隨著近期深度學(xué)習(xí)領(lǐng)域快速發(fā)展,我們可以將這些算法應(yīng)用到 NLP 任務(wù)中,并得到準(zhǔn)確率遠(yuǎn)超傳統(tǒng)方法的結(jié)果。我嘗試過(guò)分別使用深度學(xué)習(xí)和傳統(tǒng)方法來(lái)提取文章信息,結(jié)果非常驚人:深度學(xué)習(xí)的準(zhǔn)確率達(dá)到了 85%,遠(yuǎn)遠(yuǎn)領(lǐng)先于傳統(tǒng)算法的 65%。

2020-12-25 19:15:13 1108

1108 Abstract 主動(dòng)學(xué)習(xí)試圖通過(guò)標(biāo)記最少量的樣本使得模型的性能收益最大化。而深度學(xué)習(xí)則對(duì)數(shù)據(jù)比較貪婪,需要大量的數(shù)據(jù)供給來(lái)優(yōu)化海量的參數(shù),從而使得模型學(xué)會(huì)如何提取高質(zhì)量的特征。近年來(lái),由于互聯(lián)網(wǎng)

2021-02-17 11:55:00 4176

4176

手把手教你,從如何實(shí)現(xiàn)梯度下降開(kāi)始到手磕一個(gè)CNN經(jīng)典網(wǎng)絡(luò),讓你不再對(duì)深度學(xué)習(xí)框架的內(nèi)部機(jī)制感到神秘。 短短幾年,這位大佬再度出了“續(xù)集”—《深度學(xué)習(xí)進(jìn)階:自然語(yǔ)言處理》[1]!(可以說(shuō)是NLP入門必讀的經(jīng)典著作了!) 小齋這次的寫(xiě)作風(fēng)格和前作一樣,都是

2021-01-18 16:09:46 5664

5664

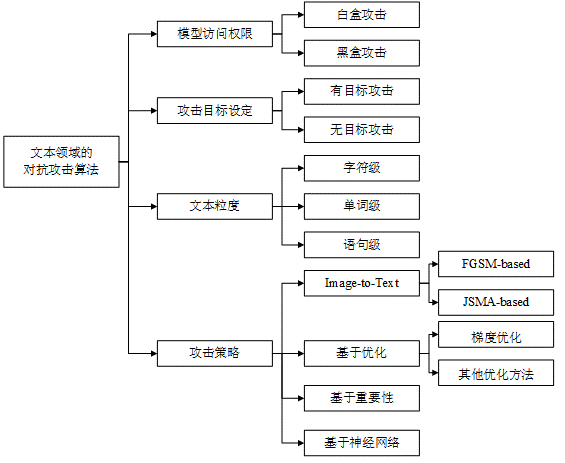

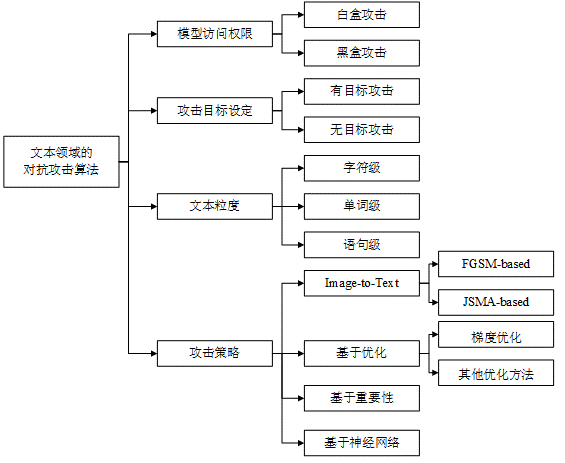

當(dāng)視覺(jué)領(lǐng)域中的對(duì)抗攻擊研究很難再有重大突破的時(shí)候(坑已滿,請(qǐng)換坑),研究人員便把目光轉(zhuǎn)移到了NLP領(lǐng)域。其實(shí)就NLP領(lǐng)域而言,垃圾郵件檢測(cè)、有害文本檢測(cè)、惡意軟件查殺等實(shí)用系統(tǒng)已經(jīng)大規(guī)模部署了深度學(xué)習(xí)模型

2021-03-05 16:01:54 4550

4550

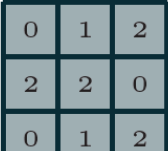

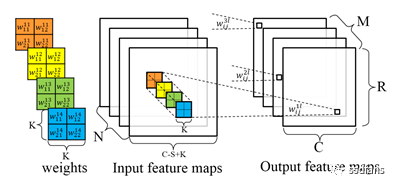

概述 深度學(xué)習(xí)中CNN網(wǎng)絡(luò)是核心,對(duì)CNN網(wǎng)絡(luò)來(lái)說(shuō)卷積層與池化層的計(jì)算至關(guān)重要,不同的步長(zhǎng)、填充方式、卷積核大小、

2021-04-06 15:13:25 3356

3356

隨著深度學(xué)習(xí)的不斷發(fā)展,卷積神經(jīng)網(wǎng)絡(luò)(CNN)在目標(biāo)檢測(cè)與圖像分類中受到研究者的廣泛關(guān)注。CNN從 Lenet5網(wǎng)絡(luò)發(fā)展到深度殘差網(wǎng)絡(luò),其層數(shù)不斷增加。基于神經(jīng)網(wǎng)絡(luò)中“深度”的含義,在確保感受野相同

2021-05-19 16:11:00 5

5 機(jī)器學(xué)習(xí)領(lǐng)域是巨大的,為了學(xué)習(xí)不迷路,可以從以下列表幫助學(xué)習(xí)。它概述深度學(xué)習(xí)的一些學(xué)習(xí)細(xì)節(jié)。 階段1:入門級(jí)入門級(jí)能夠掌握以下技能: 能夠處理小型數(shù)據(jù)集 理解經(jīng)典機(jī)器學(xué)習(xí)技術(shù)的關(guān)鍵概念 理解經(jīng)典網(wǎng)絡(luò)

2021-06-10 15:27:48 2962

2962 基于CNN分類回歸聯(lián)合學(xué)習(xí)等的左心室檢測(cè)方法

2021-06-25 11:15:02 33

33 數(shù)學(xué)和理論細(xì)節(jié)。雖然數(shù)學(xué)術(shù)語(yǔ)有時(shí)是必要的,并且可以進(jìn)一步理解,但這些文章盡可能使用類比和圖像來(lái)提供易于理解的信息,包括對(duì)深度學(xué)習(xí)領(lǐng)域的直觀概述。

2022-04-28 16:59:03 4393

4393 LeNet 卷積神經(jīng)網(wǎng)絡(luò)是由深度學(xué)習(xí)三巨頭之一的 Yan Le Cun于 1994 年提出來(lái)的。其對(duì)構(gòu)建的 MNIST手寫(xiě)字符數(shù)據(jù)集進(jìn)行分類。LeNet 的提出確立了 CNN 的基本網(wǎng)絡(luò)架構(gòu)。

2022-07-05 11:50:09 2994

2994 深度學(xué)習(xí)主要包含卷積神經(jīng)網(wǎng)絡(luò)和Faster R-CNN兩種網(wǎng)絡(luò)模型,通過(guò)利用算法模型自動(dòng)學(xué)習(xí)的特點(diǎn),不再受限于復(fù)雜多變的環(huán)境,可自動(dòng)提取缺陷特征,最終實(shí)現(xiàn)自動(dòng)檢測(cè)。

2022-10-19 15:08:48 3766

3766 R-CNN 算法在 2014 年提出,可以說(shuō)是歷史性的算法,將深度學(xué)習(xí)應(yīng)用于目標(biāo)檢測(cè)領(lǐng)域,相較于之前的目標(biāo)檢測(cè)方法,提升多達(dá) 30% 以上

2022-10-31 10:08:05 2662

2662 鑒于科學(xué)的快速增長(zhǎng)和發(fā)展,了解使用哪些人工智能技術(shù)來(lái)推進(jìn)項(xiàng)目可能具有挑戰(zhàn)性。本文概述了機(jī)器學(xué)習(xí)和深度學(xué)習(xí)之間的差異,以及如何確定何時(shí)應(yīng)用這兩種方法。

2022-11-30 14:22:00 1422

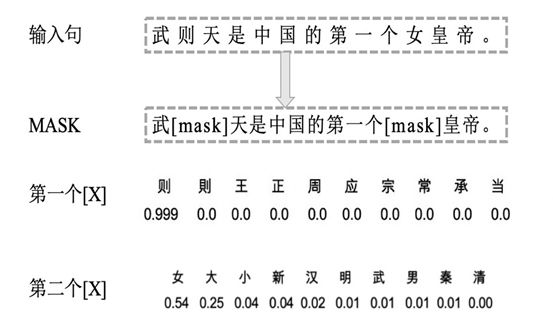

1422 在Bert和GPT模型出現(xiàn)之前,NLP領(lǐng)域流行的技術(shù)是深度學(xué)習(xí)模型,而NLP領(lǐng)域的深度學(xué)習(xí),主要依托于以下幾項(xiàng)關(guān)鍵技術(shù):以大量的改進(jìn)LSTM模型及少量的改進(jìn)CNN模型作為典型的特征抽取器;以

2023-01-11 14:33:51 2905

2905 ,深入淺出地介紹了深度學(xué)習(xí)在 NLP 領(lǐng)域進(jìn)展,并結(jié)合工業(yè)界給出了未來(lái)的 NLP 的應(yīng)用方向,相信讀完這篇文章,你對(duì)深度學(xué)習(xí)的整體脈絡(luò)會(huì)有更加深刻認(rèn)識(shí)。

2023-02-22 09:54:49 870

870

,深入淺出地介紹了深度學(xué)習(xí)在 NLP 領(lǐng)域進(jìn)展,并結(jié)合工業(yè)界給出了未來(lái)的 NLP 的應(yīng)用方向,相信讀完這篇文章,你對(duì)深度學(xué)習(xí)的整體脈絡(luò)會(huì)有更加深刻認(rèn)識(shí)。

2023-02-22 09:54:59 687

687

,深入淺出地介紹了深度學(xué)習(xí)在 NLP 領(lǐng)域進(jìn)展,并結(jié)合工業(yè)界給出了未來(lái)的 NLP 的應(yīng)用方向,相信讀完這篇文章,你對(duì)深度學(xué)習(xí)的整體脈絡(luò)會(huì)有更加深刻認(rèn)識(shí)。

2023-02-22 09:55:10 719

719

深度學(xué)習(xí)可以學(xué)習(xí)視覺(jué)輸入的模式,以預(yù)測(cè)組成圖像的對(duì)象類。用于圖像處理的主要深度學(xué)習(xí)架構(gòu)是卷積神經(jīng)網(wǎng)絡(luò)(CNN),或者是特定的CNN框架,如AlexNet、VGG、Inception和ResNet。計(jì)算機(jī)視覺(jué)的深度學(xué)習(xí)模型通常在專門的圖形處理單元(GPU)上訓(xùn)練和執(zhí)行,以減少計(jì)算時(shí)間。

2023-05-05 11:35:28 2022

2022 卷積神經(jīng)網(wǎng)絡(luò)(CNN)是一種用于對(duì)目標(biāo)進(jìn)行重建、分類等處理的深度學(xué)習(xí)方法。自2016年深度學(xué)習(xí)被首次應(yīng)用于散射成像,該研究一直是光學(xué)成像領(lǐng)域的熱門方向。

2023-05-24 09:51:21 703

703

Studio 實(shí)驗(yàn)室在 SageMaker Studio Lab 中打開(kāi)筆記本

除了第 14.7 節(jié)中描述的單次多框檢測(cè)之外,基于區(qū)域的 CNN 或具有 CNN 特征的區(qū)域 (R-CNN) 也是將深度學(xué)習(xí)

2023-06-05 15:44:37 1318

1318

因?yàn)?b class="flag-6" style="color: red">CNN的特有計(jì)算模式,通用處理器對(duì)于CNN實(shí)現(xiàn)效率并不高,不能滿足性能要求。 因此,近來(lái)已經(jīng)提出了基于FPGA,GPU甚至ASIC設(shè)計(jì)的各種加速器來(lái)提高CNN設(shè)計(jì)的性能。

2023-06-14 16:03:43 3135

3135

什么是深度學(xué)習(xí)算法?深度學(xué)習(xí)算法的應(yīng)用 深度學(xué)習(xí)算法被認(rèn)為是人工智能的核心,它是一種模仿人類大腦神經(jīng)元的計(jì)算模型。深度學(xué)習(xí)是機(jī)器學(xué)習(xí)的一種變體,主要通過(guò)變換各種架構(gòu)來(lái)對(duì)大量數(shù)據(jù)進(jìn)行學(xué)習(xí)以及分類處理

2023-08-17 16:03:04 3075

3075 的。PyTorch是一個(gè)開(kāi)源的深度學(xué)習(xí)框架,在深度學(xué)習(xí)領(lǐng)域得到了廣泛應(yīng)用。本文將介紹PyTorch框架的基本知識(shí)、核心概念以及如何在實(shí)踐中使用PyTorch框架。 一、PyTorch框架概述 PyTorch是一個(gè)Facebook開(kāi)源項(xiàng)目,是一個(gè)動(dòng)態(tài)計(jì)算圖的深度學(xué)習(xí)框架。與靜態(tài)計(jì)算圖的T

2023-08-17 16:03:06 2335

2335 深度學(xué)習(xí)框架是什么?深度學(xué)習(xí)框架有哪些?? 深度學(xué)習(xí)框架是一種軟件工具,它可以幫助開(kāi)發(fā)者輕松快速地構(gòu)建和訓(xùn)練深度神經(jīng)網(wǎng)絡(luò)模型。與手動(dòng)編寫(xiě)代碼相比,深度學(xué)習(xí)框架可以大大減少開(kāi)發(fā)和調(diào)試的時(shí)間和精力,并提

2023-08-17 16:03:09 3886

3886 ,CNTK框架是非常重要的一部分。本篇文章將介紹CNTK框架的概覽、起源、結(jié)構(gòu)以及應(yīng)用等內(nèi)容,更深入了解CNTK框架。 一、CNTK框架的概述 CNTK(Microsoft Cognitive Toolkit)框架是微軟公司開(kāi)發(fā)的一個(gè)深度學(xué)習(xí)工具箱,由微軟亞洲研究院研發(fā),是目前市

2023-08-17 16:11:23 2191

2191 深度學(xué)習(xí)框架和深度學(xué)習(xí)算法教程 深度學(xué)習(xí)是機(jī)器學(xué)習(xí)領(lǐng)域中的一個(gè)重要分支,多年來(lái)深度學(xué)習(xí)一直在各個(gè)領(lǐng)域的應(yīng)用中發(fā)揮著極其重要的作用,成為了人工智能技術(shù)的重要組成部分。許多深度學(xué)習(xí)算法和框架提供了

2023-08-17 16:11:26 1829

1829 是一種非常流行的編程語(yǔ)言,因?yàn)樗哂蟹浅?qiáng)大的數(shù)據(jù)分析和科學(xué)計(jì)算庫(kù)。Python可以被用來(lái)完成一系列的任務(wù),包括機(jī)器學(xué)習(xí)、數(shù)據(jù)分析、圖像處理、自然語(yǔ)言處理和深度學(xué)習(xí)等任務(wù)。 本篇文章旨在介紹Python機(jī)器學(xué)習(xí)的概述,包括機(jī)器學(xué)習(xí)的基本概

2023-08-17 16:11:43 1672

1672 python卷積神經(jīng)網(wǎng)絡(luò)cnn的訓(xùn)練算法? 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,CNN)一直是深度學(xué)習(xí)領(lǐng)域重要的應(yīng)用之一,被廣泛應(yīng)用于圖像、視頻、語(yǔ)音等領(lǐng)域

2023-08-21 16:41:37 2376

2376 卷積神經(jīng)網(wǎng)絡(luò)概述 卷積神經(jīng)網(wǎng)絡(luò)的特點(diǎn) cnn卷積神經(jīng)網(wǎng)絡(luò)的優(yōu)點(diǎn)? 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional neural network,CNN)是一種基于深度學(xué)習(xí)技術(shù)的神經(jīng)網(wǎng)絡(luò),由于其出色的性能

2023-08-21 16:41:48 4333

4333 cnn卷積神經(jīng)網(wǎng)絡(luò)簡(jiǎn)介 cnn卷積神經(jīng)網(wǎng)絡(luò)代碼 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,簡(jiǎn)稱CNN)是目前深度學(xué)習(xí)領(lǐng)域中應(yīng)用廣泛的一種神經(jīng)網(wǎng)絡(luò)模型。CNN的出現(xiàn)

2023-08-21 17:16:13 3817

3817 的語(yǔ)音合成技術(shù)的現(xiàn)狀 基于深度學(xué)習(xí)的語(yǔ)音合成技術(shù)以其強(qiáng)大的表示能力和學(xué)習(xí)能力,在語(yǔ)音合成領(lǐng)域取得了突破性的進(jìn)展。深度學(xué)習(xí)模型如循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)、卷積神經(jīng)網(wǎng)絡(luò)(CNN)和長(zhǎng)短時(shí)記憶網(wǎng)絡(luò)(LSTM)等被廣泛應(yīng)用于語(yǔ)音合

2023-09-16 14:48:21 2114

2114 卷積神經(jīng)網(wǎng)絡(luò)(CNN 或 ConvNet)是一種直接從數(shù)據(jù)中學(xué)習(xí)的深度學(xué)習(xí)網(wǎng)絡(luò)架構(gòu)。

CNN 特別適合在圖像中尋找模式以識(shí)別對(duì)象、類和類別。它們也能很好地對(duì)音頻、時(shí)間序列和信號(hào)數(shù)據(jù)進(jìn)行分類。

2023-10-12 12:41:49 2398

2398

卷積神經(jīng)網(wǎng)絡(luò) (CNN) 由各種類型的層組成,這些層協(xié)同工作以從輸入數(shù)據(jù)中學(xué)習(xí)分層表示。每個(gè)層在整體架構(gòu)中都發(fā)揮著獨(dú)特的作用。

2024-04-06 05:51:00 3594

3594

深度神經(jīng)網(wǎng)絡(luò)模型CNN(Convolutional Neural Network)是一種廣泛應(yīng)用于圖像識(shí)別、視頻分析和自然語(yǔ)言處理等領(lǐng)域的深度學(xué)習(xí)模型。 引言 深度學(xué)習(xí)是近年來(lái)人工智能領(lǐng)域的研究熱點(diǎn)

2024-07-02 10:11:59 12242

12242 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks,簡(jiǎn)稱CNN)是一種深度學(xué)習(xí)模型,廣泛應(yīng)用于圖像識(shí)別、視頻分析、自然語(yǔ)言處理等領(lǐng)域。 CNN的基本概念 1.1 卷積層

2024-07-02 15:24:42 1732

1732 隨著人工智能技術(shù)的飛速發(fā)展,深度學(xué)習(xí)和卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network, CNN)作為其中的重要分支,已經(jīng)在多個(gè)領(lǐng)域取得了顯著的應(yīng)用成果。從圖像識(shí)別、語(yǔ)音識(shí)別

2024-07-02 18:19:17 1853

1853 卷積神經(jīng)網(wǎng)絡(luò)概述 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Network,簡(jiǎn)稱CNN)是一種深度學(xué)習(xí)模型,由多層卷積層和池化層堆疊而成。CNN通過(guò)卷積操作提取圖像特征,并通過(guò)池化操作降低特征維度,從而實(shí)現(xiàn)對(duì)圖像的分類、檢測(cè)和分割等任務(wù)。 1.2 卷積神經(jīng)網(wǎng)絡(luò)

2024-07-03 09:28:41 2079

2079 在自然語(yǔ)言處理(NLP)領(lǐng)域,循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)與卷積神經(jīng)網(wǎng)絡(luò)(CNN)是兩種極為重要且廣泛應(yīng)用的網(wǎng)絡(luò)結(jié)構(gòu)。它們各自具有獨(dú)特的優(yōu)勢(shì),適用于處理不同類型的NLP任務(wù)。本文旨在深入探討RNN與CNN

2024-07-03 15:59:04 1504

1504 在計(jì)算機(jī)視覺(jué)領(lǐng)域,目標(biāo)檢測(cè)一直是研究的熱點(diǎn)和難點(diǎn)之一。特別是在小目標(biāo)檢測(cè)方面,由于小目標(biāo)在圖像中所占比例小、特征不明顯,使得檢測(cè)難度顯著增加。隨著深度學(xué)習(xí)技術(shù)的快速發(fā)展,尤其是卷積神經(jīng)網(wǎng)絡(luò)(CNN

2024-07-04 17:25:28 2655

2655 深度學(xué)習(xí)和自然語(yǔ)言處理(NLP)是計(jì)算機(jī)科學(xué)領(lǐng)域中兩個(gè)非常重要的研究方向。它們之間既有聯(lián)系,也有區(qū)別。本文將介紹深度學(xué)習(xí)與NLP的區(qū)別。 深度學(xué)習(xí)簡(jiǎn)介 深度學(xué)習(xí)是一種基于人工神經(jīng)網(wǎng)絡(luò)的機(jī)器學(xué)習(xí)

2024-07-05 09:47:28 2121

2121 卷積神經(jīng)網(wǎng)絡(luò)(Convolutional Neural Networks, CNN)作為深度學(xué)習(xí)領(lǐng)域的核心成員,不僅在學(xué)術(shù)界引起了廣泛關(guān)注,更在工業(yè)界尤其是計(jì)算機(jī)視覺(jué)領(lǐng)域展現(xiàn)出了巨大的應(yīng)用價(jià)值。關(guān)于

2024-07-05 17:37:17 7478

7478 深度識(shí)別算法是深度學(xué)習(xí)領(lǐng)域的一個(gè)重要組成部分,它利用深度神經(jīng)網(wǎng)絡(luò)模型對(duì)輸入數(shù)據(jù)進(jìn)行高層次的理解和識(shí)別。深度識(shí)別算法涵蓋了多個(gè)方面的內(nèi)容,主要包括以下幾種類型: 1. 卷積神經(jīng)網(wǎng)絡(luò)(CNN) 概述

2024-09-10 15:28:42 1257

1257 能力,可以顯著提高圖像識(shí)別模型的訓(xùn)練速度和準(zhǔn)確性。例如,在人臉識(shí)別、自動(dòng)駕駛等領(lǐng)域,GPU被廣泛應(yīng)用于加速深度學(xué)習(xí)模型的訓(xùn)練和推理過(guò)程。 二、自然語(yǔ)言處理 自然語(yǔ)言處理(NLP)是深度學(xué)習(xí)的另一個(gè)重要應(yīng)用領(lǐng)域。GPU可以加速NLP模型的訓(xùn)練,提

2024-10-27 11:13:45 2283

2283

電子發(fā)燒友App

電子發(fā)燒友App

評(píng)論