cnn卷積神經網絡簡介 cnn卷積神經網絡代碼

卷積神經網絡(Convolutional Neural Network,簡稱CNN)是目前深度學習領域中應用廣泛的一種神經網絡模型。CNN的出現以解決圖像識別問題為主要目標,但它的應用已經滲透到了各種領域,從自然語言處理、語音識別、到物體標記以及醫療影像分析等。在此,本文將對CNN的原理、結構以及基礎代碼進行講解。

1. CNN的原理

CNN是一種能夠自動提取特征的神經網絡結構,它的每個層次在進行特征提取時會自動適應輸入數據的特點和模式。最重要的原理是卷積操作,卷積操作使得神經網絡能夠自動在數據中提取有用的特征。

卷積的過程可以概括為:將一個卷積核與數據進行卷積運算,計算出對應特征圖,其中卷積核是一組可以學習的參數。卷積核在每個位置的計算結果都是相同的,因此可以共享參數,減少網絡需要學習的參數數量。通過多次卷積和池化操作,不斷提取特征,最終使用全連接層對提取的特征進行分類和預測。

2. CNN的結構

CNN主要包括卷積層、池化層、全連接層和激活函數。

(1)卷積層:卷積層通過對輸入數據進行卷積操作來提取特征。在卷積層中,每個節點與前一層的局部節點進行連接,并使用權重參數來進行卷積計算。這些連接以及卷積核參數可以在訓練過程中進行學習和優化。

(2)池化層:池化層通常用于特征降維和空間平移不變性,它通過對輸入的局部區域進行取樣,并根據取樣結果生成對應的特征圖。常見的池化方式有最大池化和平均池化。

(3)全連接層:全連接層將上一層的特征映射與權重進行正常的向量乘法運算,并添加一個偏置項,輸出下一層的特征向量。

(4)激活函數:激活函數對原始輸入進行非線性變換,使得神經網絡可以更好地擬合非線性模式和特征。目前常用的激活函數有ReLU、sigmoid、tanh等。

3. CNN的常見代碼實現

下面是一個基礎的CNN代碼實現,使用Python和TensorFlow進行編寫:

```python

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

mnist = input_data.read_data_sets('MNIST_data', one_hot=True)

# 定義網絡節點

x = tf.placeholder(tf.float32, shape=[None, 28*28])

y_ = tf.placeholder(tf.float32, shape=[None, 10])

W_conv1 = weight_variable([5, 5, 1, 32])

b_conv1 = bias_variable([32])

x_image = tf.reshape(x, [-1, 28, 28, 1])

h_conv1 = tf.nn.relu(conv2d(x_image, W_conv1) + b_conv1)

h_pool1 = max_pool_2x2(h_conv1)

W_conv2 = weight_variable([5, 5, 32, 64])

b_conv2 = bias_variable([64])

h_conv2 = tf.nn.relu(conv2d(h_pool1, W_conv2) + b_conv2)

h_pool2 = max_pool_2x2(h_conv2)

W_fc1 = weight_variable([7 * 7 * 64, 1024])

b_fc1 = bias_variable([1024])

h_pool2_flat = tf.reshape(h_pool2, [-1, 7*7*64])

h_fc1 = tf.nn.relu(tf.matmul(h_pool2_flat, W_fc1) + b_fc1)

keep_prob = tf.placeholder(tf.float32)

h_fc1_drop = tf.nn.dropout(h_fc1, keep_prob)

W_fc2 = weight_variable([1024, 10])

b_fc2 = bias_variable([10])

y_conv=tf.nn.softmax(tf.matmul(h_fc1_drop, W_fc2) + b_fc2)

# 定義損失函數

cross_entropy = tf.reduce_mean(-tf.reduce_sum(y_ * tf.log(y_conv), reduction_indices=[1]))

# 訓練模型

train_step = tf.train.AdamOptimizer(1e-4).minimize(cross_entropy)

correct_prediction = tf.equal(tf.argmax(y_conv,1), tf.argmax(y_,1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

sess = tf.Session()

sess.run(tf.global_variables_initializer())

for i in range(20000):

batch = mnist.train.next_batch(50)

if i % 100 == 0:

train_accuracy = accuracy.eval(session=sess, feed_dict={x:batch[0], y_: batch[1], keep_prob: 1.0})

print("step %d, training accuracy %g"%(i, train_accuracy))

train_step.run(session=sess, feed_dict={x: batch[0], y_: batch[1], keep_prob: 0.5})

print("test accuracy %g"%accuracy.eval(session=sess, feed_dict={

x: mnist.test.images, y_: mnist.test.labels, keep_prob: 1.0}))

```

上述代碼實現了一個可用于MNIST手寫數字分類的CNN模型。其中,輸入的手寫數字圖像尺寸為28x28,共有10個分類類別。在代碼實現中,通過定義正確的節點,自定義權重初始化、卷積、池化等操作函數,定義激活函數,一個基本的CNN模型就被創建出來。訓練時,通過對權重進行優化和學習,CNN可以逐漸實現對手寫數字圖像的自動分類。

總結:

CNN是目前廣泛運用于深度學習領域的優秀卷積神經網絡模型,其不可替代的優勢在于其自適應特征提取、空間不變性、共享參數、長期依賴等特點。了解CNN的基本原理、結構和代碼實現有助于進一步理解和應用神經網絡模型,可以應用于圖像識別、物體標記、自然語言處理、醫療影像分析等多個領域。

-

神經網絡

+關注

關注

42文章

4840瀏覽量

108081 -

cnn

+關注

關注

3文章

355瀏覽量

23505 -

卷積神經網絡

+關注

關注

4文章

373瀏覽量

12907

發布評論請先 登錄

卷積神經網絡如何讓自動駕駛識別障礙物?

CNN卷積神經網絡設計原理及在MCU200T上仿真測試

NMSISI庫的使用

NMSIS神經網絡庫使用介紹

在Ubuntu20.04系統中訓練神經網絡模型的一些經驗

CICC2033神經網絡部署相關操作

液態神經網絡(LNN):時間連續性與動態適應性的神經網絡

神經網絡的并行計算與加速技術

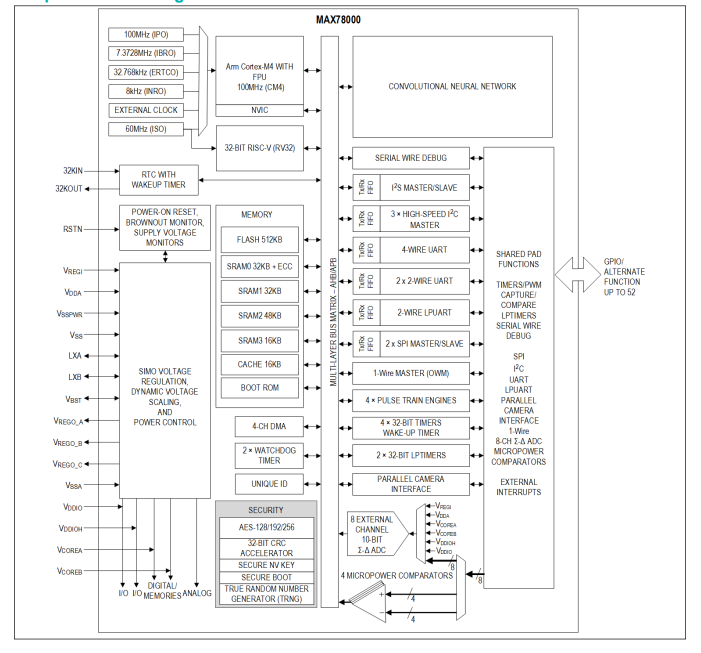

MAX78000采用超低功耗卷積神經網絡加速度計的人工智能微控制器技術手冊

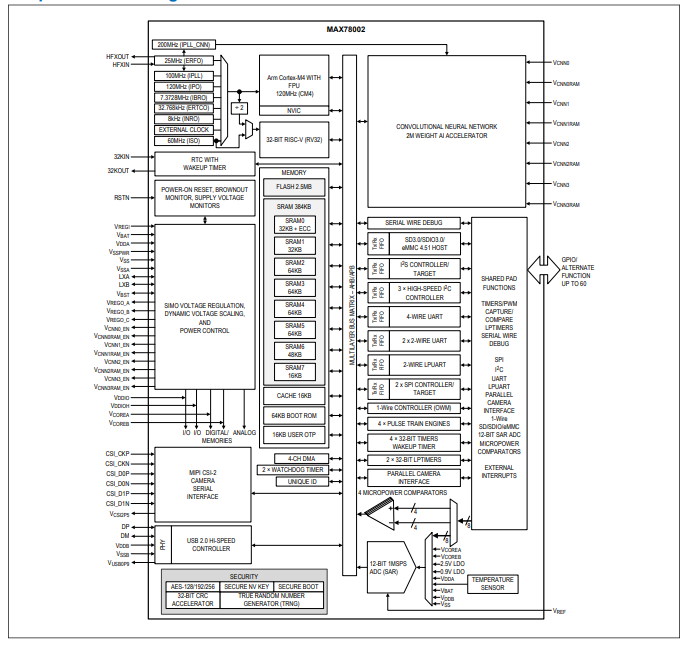

MAX78002帶有低功耗卷積神經網絡加速器的人工智能微控制器技術手冊

cnn卷積神經網絡簡介 cnn卷積神經網絡代碼

cnn卷積神經網絡簡介 cnn卷積神經網絡代碼

評論