本文從硬件加速的視角考察深度學(xué)習(xí)與FPGA,指出有哪些趨勢和創(chuàng)新使得這些技術(shù)相互匹配,并激發(fā)對FPGA如何幫助深度學(xué)習(xí)領(lǐng)域發(fā)展的探討。

2016-03-24 13:41:06 2819

2819 相比GPU和GPP,F(xiàn)PGA在滿足深度學(xué)習(xí)的硬件需求上提供了具有吸引力的替代方案。憑借流水線并行計算的能力和高效的能耗,F(xiàn)PGA將在一般的深度學(xué)習(xí)應(yīng)用中展現(xiàn)GPU和GPP所沒有的獨特優(yōu)勢。同時,算法

2016-07-28 12:16:38 7665

7665 深度學(xué)習(xí)在這十年,甚至是未來幾十年內(nèi)都有可能是最熱門的話題。雖然深度學(xué)習(xí)已是廣為人知了,但它并不僅僅包含數(shù)學(xué)、建模、學(xué)習(xí)和優(yōu)化。算法必須在優(yōu)化后的硬件上運行,因為學(xué)習(xí)成千上萬的數(shù)據(jù)可能需要長達(dá)幾周的時間。因此,深度學(xué)習(xí)網(wǎng)絡(luò)亟需更快、更高效的硬件。接下來,讓我們重點來看深度學(xué)習(xí)的硬件架構(gòu)。

2016-11-18 16:00:37 6007

6007 英偉達(dá)在 2016 年的強勢崛起,GPGPU (GPU 通用計算)功不可沒。有許多原因使 2016 稱得上是 GPU 之年。但事實上,除了在核心領(lǐng)域(深度學(xué)習(xí)、VR、自動駕駛),為什么把 GPU 用于通用計算仍然很模糊。

2017-03-14 10:07:45 3528

3528 目前大多數(shù)的機器學(xué)習(xí)是在處理器上完成的,大多數(shù)機器學(xué)習(xí)軟件會針對GPU進(jìn)行更多的優(yōu)化,甚至有人認(rèn)為學(xué)習(xí)加速必須在GPU上才能完成,但事實上無論是運行機器學(xué)習(xí)的處理器還是優(yōu)化的深度學(xué)習(xí)框架,都不

2018-03-14 18:29:09 8738

8738 3GPP的目標(biāo)是實現(xiàn)由2G網(wǎng)絡(luò)到3G網(wǎng)絡(luò)的平滑過渡,保證未來技術(shù)的后向兼容性,支持輕松建網(wǎng)及系統(tǒng)間的漫游和兼容性。

2019-09-20 09:10:03

理解,但是在其高冷的背后,卻有深遠(yuǎn)的應(yīng)用場景和未來。深度學(xué)習(xí)是實現(xiàn)機器學(xué)習(xí)的一種方式或一條路徑。其動機在于建立、模擬人腦進(jìn)行分析學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò),它模仿人腦的機制來解釋數(shù)據(jù)。比如其按特定的物理距離連接

2018-07-04 16:07:53

的數(shù)據(jù)可以對未來的數(shù)據(jù)進(jìn)行推測與模擬,因此都是使用歷史數(shù)據(jù)建立模型,即使用已經(jīng)產(chǎn)生的數(shù)據(jù)去訓(xùn)練,然后使用該模型去擬合未來的數(shù)據(jù)。 在我們機器學(xué)習(xí)和深度學(xué)習(xí)的訓(xùn)練過程中,經(jīng)常會出現(xiàn)過擬合和欠擬合的現(xiàn)象。訓(xùn)練一開始,模型通常會欠擬合,所以會對模型進(jìn)行優(yōu)化,然而等到訓(xùn)練到一定程度的時候,就需要解決過擬合的問題了。

2021-01-28 06:57:47

在未來的某個時候,人們必定能夠相對自如地運用人工智能,安全地駕車出行。這個時刻何時到來我無法預(yù)見;但我相信,彼時“智能”會顯現(xiàn)出更“切實”的意義。與此同時,通過深度學(xué)習(xí)方法,人工智能的實際應(yīng)用能夠在

2022-11-11 07:55:50

深度學(xué)習(xí)常用模型有哪些?深度學(xué)習(xí)常用軟件工具及平臺有哪些?深度學(xué)習(xí)存在哪些問題?

2021-10-14 08:20:47

摘要與深度學(xué)習(xí)算法的進(jìn)步超越硬件的進(jìn)步,你如何確保算法明天是一個很好的適合現(xiàn)有的人工智能芯片下發(fā)展?,這些人工智能芯片大多是為今天的人工智能算法算法進(jìn)化,這些人工智能芯片的許多設(shè)計都可能成為甚至在

2020-11-01 09:28:57

TensorFlow&TensorFlow-GPU:深度學(xué)習(xí)框架TensorFlow&TensorFlow-GPU的簡介、安裝、使用方法詳細(xì)攻略

2018-12-25 17:21:10

CPU優(yōu)化深度學(xué)習(xí)框架和函數(shù)庫機器學(xué)***器

2021-02-22 06:01:02

的合著者之一,說:“深度學(xué)習(xí)是AI中最令人興奮的領(lǐng)域,因為我們已經(jīng)看到了深度學(xué)習(xí)帶來的巨大進(jìn)步和大量應(yīng)用。雖然AI 和DNN 研究傾向于使用 GPU,但我們發(fā)現(xiàn)應(yīng)用領(lǐng)域和英特爾下一代FPGA 架構(gòu)之間

2017-04-27 14:10:12

。FPGA的優(yōu)勢就是可編程可配置,邏輯資源多,功耗低,而且賽靈思等都在極力推廣。不知道用FPGA做深度學(xué)習(xí)未來會怎樣發(fā)展,能走多遠(yuǎn),你怎么看。

A:FPGA 在深度學(xué)習(xí)領(lǐng)域具有獨特的優(yōu)勢和潛力,未來

2024-09-27 20:53:31

現(xiàn)場可編程門陣列 (FPGA) 解決了 GPU 在運行深度學(xué)習(xí)模型時面臨的許多問題

在過去的十年里,人工智能的再一次興起使顯卡行業(yè)受益匪淺。英偉達(dá) (Nvidia) 和 AMD 等公司的股價也大幅

2024-03-21 15:19:45

Mali GPU 支持tensorflow或者caffe等深度學(xué)習(xí)模型嗎? 好像caffe2go和tensorflow lit可以部署到ARM,但不知道是否支持在GPU運行?我希望把訓(xùn)練

2022-09-16 14:13:01

最耳熟能詳?shù)木褪荰ensorFlow,但再稍有了解的,會知道TensorFlow太過于底層,實現(xiàn)深度學(xué)習(xí)的過程復(fù)雜,但其框架是相當(dāng)好的,Keras相比TensorFlow,具有簡單易用的特點,更適合深度學(xué)習(xí)

2018-06-04 22:32:12

]`labview調(diào)用高性能YOLOV5:http://t.elecfans.com/c1659.html 讓你的CPU也可以運行最新深度學(xué)習(xí)模型labview調(diào)用高性能Tensorflow+YOLOV4:http://t.elecfans.com/c1553.html 讓你的GPU也可以運行最新深度學(xué)習(xí)模型

2021-06-03 16:38:25

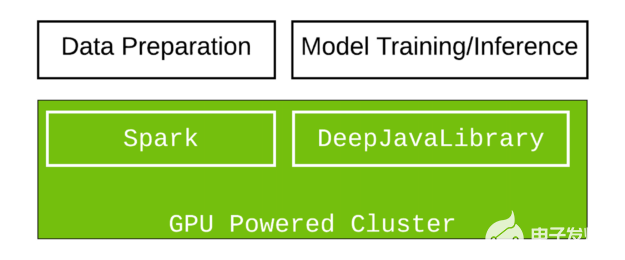

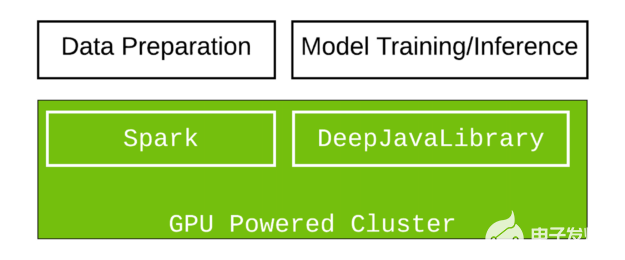

。由于深度學(xué)習(xí)需要使用海量數(shù)據(jù)來進(jìn)行業(yè)務(wù)訓(xùn)練,因此計算資源需求很大,動則幾十上百個GPU,甚至上千GPU等等;同時訓(xùn)練時間也很長,每次訓(xùn)練都是以天、周或甚至月年為單位。但是,開源的分布式訓(xùn)練框架,在保證

2018-08-02 20:44:09

的參數(shù)空間已從百萬級上升到百億級,這對計算能力提出了新的挑戰(zhàn)。相比CPU,GPU更適合深度學(xué)習(xí)的神經(jīng)網(wǎng)絡(luò)模型,可進(jìn)行高度統(tǒng)異構(gòu)計算明星規(guī)格族“GN5”。阿里云異構(gòu)計算通用實例“GN5”規(guī)格族就是一款

2017-12-26 11:22:09

的未來方向提出關(guān)鍵建議,幫助解決今后深度學(xué)習(xí)所面臨的問題。2. FPGA傳統(tǒng)來說,在評估硬件平臺的加速時,必須考慮到靈活性和性能之間的權(quán)衡。一方面,通用處理器(GPP)可提供高度的靈活性和易用性,但性能

2018-08-13 09:33:30

都出現(xiàn)了重大突破。深度學(xué)習(xí)是這些領(lǐng)域中所最常使用的技術(shù),也被業(yè)界大為關(guān)注。然而,深度學(xué)習(xí)模型需要極為大量的數(shù)據(jù)和計算能力,只有更好的硬件加速條件,才能滿足現(xiàn)有數(shù)據(jù)和模型規(guī)模繼續(xù)擴(kuò)大的需求。 FPGA

2019-10-10 06:45:41

深度學(xué)習(xí)是什么意思

2020-11-11 06:58:03

頻率低于 CPU 和 GPU,除非設(shè)計實現(xiàn),否則性能往往較差。與 CPU 和 GPU 相比實施成本高,F(xiàn)PGA 上支持深度學(xué)習(xí)的軟件較少很多DNN參數(shù)量大,很難在FPGA上簡單實現(xiàn)需要高數(shù)據(jù)精度

2023-02-17 16:56:59

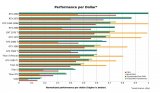

怎么為自己的深度學(xué)習(xí)機器選擇合適的GPU配置呢?對于那些一直想進(jìn)行深度學(xué)習(xí)研究的同學(xué)來說,一直是個比較糾結(jié)的問題,既要考慮到使用的場景,又要考慮到價格等各方面因素。如何選擇深度學(xué)習(xí)的組件?這真的很

2018-09-19 13:56:36

四大旗艦處理器相繼曝光,華為、蘋果、三星、高通誰才是SOC的無冕之王?

2020-06-03 14:41:27

本文由回映電子整理分享,歡迎工程老獅們參與學(xué)習(xí)與評論內(nèi)容? 射頻系統(tǒng)中的深度學(xué)習(xí)? Deepwave Digital技術(shù)? 信號檢測和分類示例? GPU的實時DSP基準(zhǔn)測試? 總結(jié)回映電子是一家

2022-01-05 10:00:58

現(xiàn)場總線、以太網(wǎng)、無線技術(shù)各有優(yōu)劣,那么誰才會是未來的主流呢?顯然對所有生產(chǎn)商或機器并非只有一種技術(shù)才是“正確的”方案?生產(chǎn)商必須權(quán)衡各類方案帶來的價值。有沒有比采用普通方案帶來的利益更有

2019-09-29 09:49:13

新手小白想用GPU云服務(wù)器跑深度學(xué)習(xí)應(yīng)該怎么做?

用個人主機通常pytorch可以跑但是LexNet,AlexNet可能就直接就跑不動,如何實現(xiàn)更經(jīng)濟(jì)便捷的實現(xiàn)GPU云服務(wù)器深度學(xué)習(xí)?

2024-06-11 17:09:28

機器學(xué)習(xí)的未來在工業(yè)領(lǐng)域采用機器學(xué)習(xí)機器學(xué)習(xí)和大數(shù)據(jù)

2021-01-27 06:02:18

本帖最后由 會飛的鴨子 于 2014-4-2 16:59 編輯

選出誰才是真正的高手,誰才是大牛!吳鑒鷹單片機項目詳細(xì)解析系列(連載)之基于單片機的實戰(zhàn)項目社區(qū)之星-單片機達(dá)人-吳鑒鷹社區(qū)之星

2014-04-01 13:29:41

怎樣從傳統(tǒng)機器學(xué)習(xí)方法過渡到深度學(xué)習(xí)?

2021-10-14 06:51:23

請問一下什么是深度學(xué)習(xí)?

2021-08-30 07:35:21

有時候你會想弄清楚某位工程師的基本技術(shù)能力與背景,到底誰才是擁有“真才實料”的真正工程師,誰又只會在那里自我吹噓。

2012-02-07 10:27:09 1772

1772 為幫助數(shù)據(jù)科學(xué)家和開發(fā)人員充分利用深度學(xué)習(xí)領(lǐng)域中的機遇,NVIDIA為其深度學(xué)習(xí)軟件平臺發(fā)布了三項重大更新,它們分別是NVIDIA DIGITS 4、CUDA深度神經(jīng)網(wǎng)絡(luò)庫(cuDNN)5.1和全新的GPU推理引擎(GIE)。

NVIDIA深度學(xué)習(xí)軟件平臺推三項重大更新

2016-08-06 15:00:26 2307

2307 FPGA是深度學(xué)習(xí)的未來,學(xué)習(xí)資料,感興趣的可以看看。

2016-10-26 15:29:04 0

0 2017年美國拉斯維加斯國際消費類電子產(chǎn)品展覽會CES 2017上,OLED平板電視和激光電視成為電視行業(yè)最大亮點。對于未來電視的走向,也劃分為OLED和激光電視兩個陣營,OLED和激光電視誰才是客廳的霸主?

2017-01-10 15:26:50 1702

1702 處理器、內(nèi)存、GPU誰才是決定手機卡頓的關(guān)鍵安卓手機使用一段時間后會出現(xiàn)卡頓,相信不少用戶都遇到過。

2017-04-01 10:43:39 15356

15356 項目組基于深度學(xué)習(xí)實現(xiàn)了視頻風(fēng)格化和人像摳圖的功能,但這是在PC/服務(wù)端上跑的,現(xiàn)在需要移植到移動端,因此需要一個移動端的深度學(xué)習(xí)的計算框架。 同類型的庫 caffe-Android-lib 目前

2017-09-28 20:02:26 0

0 NVIDIA創(chuàng)始人黃仁勛表示TITAN V GPU擁有210億個晶體管,基于Volta 架構(gòu)設(shè)計,110 TFLOP 的深度學(xué)習(xí)運算能力是上一代的9 倍,可以說是全球最強的PC級GPU。

2017-12-15 13:38:38 2210

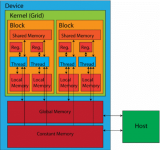

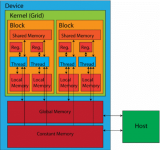

2210 本文談了談gpu的一些重要的硬件組成,就深度學(xué)習(xí)而言,我覺得對內(nèi)存的需求還是比較大的,core多也并不是能夠全部用上,但現(xiàn)在開源的庫實在完整,想做卷積運算有cudnn,想做卷積神經(jīng)網(wǎng)絡(luò)caffe

2018-01-06 12:01:09 4197

4197

隨著深度學(xué)習(xí)不斷取得進(jìn)展,開發(fā)者們對在移動設(shè)備上的部署神經(jīng)網(wǎng)絡(luò)的需求也與日俱增。和我們之前在桌面級GPU上做過的嘗試類似,把深度學(xué)習(xí)框架移植到移動端需要做到這兩點:夠快的inference速度和合

2018-01-18 13:38:00 11626

11626 幾乎所有深度學(xué)習(xí)的研究者都在使用GPU,但是對比深度學(xué)習(xí)硬鑒方案,ASIC、FPGA、GPU三種究竟哪款更被看好?主要是認(rèn)清對深度學(xué)習(xí)硬件平臺的要求。

2018-02-02 15:21:40 10933

10933

近年來,深度學(xué)習(xí)作為機器學(xué)習(xí)中比較火的一種方法出現(xiàn)在我們面前,但是和非深度學(xué)習(xí)的機器學(xué)習(xí)相比(我將深度學(xué)習(xí)歸于機器學(xué)習(xí)的領(lǐng)域內(nèi)),還存在著幾點很大的不同,具體來說,有以下幾點.

2018-05-02 10:30:00 4657

4657 與NIPS展示的研究類似,多模態(tài)圖像轉(zhuǎn)換依賴于無監(jiān)督式學(xué)習(xí)和生成式對抗網(wǎng)絡(luò) (GAN) 這兩項深度學(xué)習(xí)技術(shù),賦予設(shè)備更多“想象力”,例如“想象”一條陽光普照的街道在暴風(fēng)雨或冬季時的景象。

2018-04-27 11:12:59 5215

5215 本文是推出的人工智能深度學(xué)習(xí)綜述,也是Hinton、LeCun和Bengio三位大神首次合寫同一篇文章。該綜述在深度學(xué)習(xí)領(lǐng)域的重要性不言而喻,可以說是所有人入門深度學(xué)習(xí)的必讀作品。

2018-07-30 16:40:37 10077

10077 本深度學(xué)習(xí)是什么?了解深度學(xué)習(xí)難嗎?讓你快速了解深度學(xué)習(xí)的視頻講解本文檔視頻讓你4分鐘快速了解深度學(xué)習(xí)

深度學(xué)習(xí)的概念源于人工智能的人工神經(jīng)網(wǎng)絡(luò)的研究。含多隱層的多層感知器就是一種深度學(xué)習(xí)結(jié)構(gòu)。深度學(xué)習(xí)通過組合低層特征形成更加抽象的高層表示屬性類別或特征,以發(fā)現(xiàn)數(shù)據(jù)的分布式特征表示。

2018-08-23 14:36:16 16

16 是GPU計算發(fā)展的關(guān)鍵,誰能找到最適合深度學(xué)習(xí)的模式,誰就是勝利者。結(jié)語:深度學(xué)習(xí)經(jīng)過這么長時間的發(fā)展,在網(wǎng)絡(luò)的種類、復(fù)雜程度和處理的信息量上都發(fā)生了天翻地覆的變化。當(dāng)前,網(wǎng)絡(luò)種類上,從早

2019-07-29 18:21:24 1780

1780 在很多人眼里,深度學(xué)習(xí)是一個非常神奇的技術(shù),是人工智能的未來,是機器學(xué)習(xí)的圣杯。今天大恒圖像帶您一起揭開他神秘的面紗,了解什么才是深度學(xué)習(xí)。

2019-04-20 09:36:55 4264

4264 未來的深度學(xué)習(xí)能夠在微型的、低功耗的芯片上自由地奔跑。換句話說,單片機 (MCU) ,有一天會成為深度學(xué)習(xí)最肥沃的土壤。這里面的邏輯走得有些繞,但好像還是有點道理的。

2019-06-04 17:52:00 1

1 從 2016 年 AlphaGo 戰(zhàn)勝李世石掀起深度學(xué)習(xí)的熱潮,到如今深度學(xué)習(xí)寒冬論甚囂塵上,短短兩三年時間,深度學(xué)習(xí)被唱衰,如今在產(chǎn)業(yè)互聯(lián)網(wǎng)的高速發(fā)展下深度學(xué)習(xí)又該走向何方?未來的發(fā)展方向在何方?

2019-07-12 11:04:42 4101

4101 GPU與CPU比較,GPU為什么更適合深度學(xué)習(xí)?

2019-08-26 15:32:00 5901

5901 近來,隨著新能源汽車補貼下坡、電池技術(shù)發(fā)展等引發(fā)的爭議越來越多。華車網(wǎng)注意到,在爭議中,關(guān)于何種動力電池才是“未來”的爭議最為激烈,有說氫能源才是“未來”,也有說鋰電池更加“環(huán)保”。

2019-09-20 08:55:52 2181

2181 近十年來,人工智能又到了一個快速發(fā)展的階段。深度學(xué)習(xí)在其發(fā)展中起到了中流砥柱的作用,盡管擁有強大的模擬預(yù)測能力,深度學(xué)習(xí)還面臨著超大計算量的問題。在硬件層面上,GPU,ASIC,F(xiàn)PGA都是解決龐大計算量的方案。

2019-10-22 15:26:21 1338

1338 深度學(xué)習(xí)的最新成功是由于大量數(shù)據(jù)(大數(shù)據(jù))的可用性增加以及圖形處理單元(GPU)的出現(xiàn),顯著增加了用于訓(xùn)練計算機的數(shù)據(jù)的廣度和深度,并減少了所需的時間用于訓(xùn)練深度學(xué)習(xí)算法。

2020-04-02 09:20:18 3001

3001 與其他機器學(xué)習(xí)技術(shù)相比,深度學(xué)習(xí)的主要優(yōu)勢在于它能夠自動學(xué)習(xí)輸入數(shù)據(jù)的抽象表示。

2020-05-03 18:02:00 2530

2530 事實上,今天在汽車行業(yè),GPU的用例幾乎涵蓋了從ADAS到自動駕駛,從儀表到中控信息娛樂等等多個車載系統(tǒng)。而在實際大規(guī)模量產(chǎn)落地領(lǐng)域,基于深度學(xué)習(xí)的ADAS系統(tǒng),是GPU的主力市場。

2020-08-22 09:48:51 2963

2963

在 AI 算力爆炸式增長的過程中,英偉達(dá)的 GPU 功不可沒。廣為人知的一個故事就是 2012 年,來自多倫多大學(xué)的 Alex 和他的團(tuán)隊設(shè)計了 AlexNet 的深度學(xué)習(xí)算法,并用了 2 個英偉達(dá)

2020-10-09 16:10:17 3002

3002 提出來。不過,總的來說,現(xiàn)代深度學(xué)習(xí)可以分為三種基本的學(xué)習(xí)范式。每一種都有自己的學(xué)習(xí)方法和理念,提升了機器學(xué)習(xí)的能力,擴(kuò)大了其范圍。 本文最初發(fā)布于 Towards Data Science 博客,由 InfoQ 中文站翻譯并分享。 深度學(xué)習(xí)的未來在于這三種學(xué)習(xí)模式,而且它們

2020-10-23 09:37:25 2666

2666

在很多人眼里,深度學(xué)習(xí)是一個非常神奇的技術(shù),是人工智能的未來,是機器學(xué)習(xí)的圣杯。今天致瑞圖像帶您一起揭開他神秘的面紗,了解什么才是深度學(xué)習(xí)。 當(dāng)我們在網(wǎng)絡(luò)上搜索深度學(xué)習(xí)的時候往往還能搜到人工智能

2020-10-31 11:03:15 3100

3100

最近一段時間,隨著特斯拉的輪番降價,新能源汽車的普及顯得越來越容易,面對著新能源汽車的發(fā)展,一個重要的問題擺在大家的問題,從充電樁到換電站,誰才是新能源汽車的真正未來?

2020-11-16 16:33:27 4707

4707 當(dāng)前機器學(xué)習(xí)訓(xùn)練中,使用GPU提供算力已經(jīng)非常普遍,對于GPU-based AI system的研究也如火如荼。在這些研究中,以提高資源利用率為主要目標(biāo)的GPU共享(GPU sharing)是當(dāng)下

2020-11-27 10:06:21 4427

4427 隨著人工智能浪潮席卷現(xiàn)代社會,不少人對于機器學(xué)習(xí)、深度學(xué)習(xí)、計算機視覺、自然語言處理等名詞已經(jīng)耳熟能詳。可以預(yù)見的是,在未來的幾年里,無論是在業(yè)界還是學(xué)界,擁有深度學(xué)習(xí)和機器學(xué)習(xí)能力的企業(yè)都將扮演重要角色。

2021-02-02 10:56:32 11557

11557 到底誰才是頂級旗艦?自從驍龍888手機上市之后,這個問題就很難有答案。因為不少人強調(diào),驍龍888真的翻車了,驍龍865依然能打。那真是這樣嗎?其實看看跑分就有答案,安兔兔公布了今年1月的旗艦手機跑分,從跑分情況來看,驍龍888穩(wěn)坐第一還是沒懸念的,只不過最大的問題,也許是沒有想象中那么強而已。

2021-02-04 17:08:01 2028

2028 早期的機器學(xué)習(xí)以搜索為基礎(chǔ),主要依靠進(jìn)行過一定優(yōu)化的暴力方法。但是隨著機器學(xué)習(xí)逐漸成熟,它開始專注于加速技術(shù)已經(jīng)很成熟的統(tǒng)計方法和優(yōu)化問題。同時深度學(xué)習(xí)的問世更是帶來原本可能無法實現(xiàn)的優(yōu)化方法。本文

2021-02-26 06:11:43 5

5 覺信息的理解可以被再現(xiàn)甚至超越。借助深度學(xué)習(xí),作為機器學(xué)習(xí)的一部分,可以在應(yīng)用實例的基礎(chǔ)上學(xué)習(xí)和訓(xùn)練復(fù)雜的關(guān)系。 機器學(xué)習(xí)中的另一種技術(shù)是例如“超級矢量機”。與深度學(xué)習(xí)相比,必須手動定義和驗證功能。在深度學(xué)習(xí)中

2021-03-12 16:11:00 8984

8984

你還在為神經(jīng)網(wǎng)絡(luò)模型里的冗余信息煩惱嗎? 或者手上只有CPU,對一些只能用昂貴的GPU建立的深度學(xué)習(xí)模型“望眼欲穿”嗎? 最近,創(chuàng)業(yè)公司Neural Magic帶來了一種名叫新的稀疏化方法,可以幫你

2021-06-10 15:33:02 2848

2848

深度學(xué)習(xí)是推動當(dāng)前人工智能大趨勢的關(guān)鍵技術(shù)。在 MATLAB 中可以實現(xiàn)深度學(xué)習(xí)的數(shù)據(jù)準(zhǔn)備、網(wǎng)絡(luò)設(shè)計、訓(xùn)練和部署全流程開發(fā)和應(yīng)用。聯(lián)合高性能 NVIDIA GPU 加快深度神經(jīng)網(wǎng)絡(luò)訓(xùn)練和推斷。

2022-02-18 13:31:44 2702

2702 隨著人們對深度學(xué)習(xí)( deep learning , DL )興趣的日益濃厚,越來越多的用戶在生產(chǎn)環(huán)境中使用 DL 。由于 DL 需要強大的計算能力,開發(fā)人員正在利用 gpu 來完成他們的訓(xùn)練和推理工作。

2022-04-27 09:54:47 2887

2887

部署到嵌入式 GPU 也很受歡迎,因為它可以在部署的環(huán)境中提供快速的推理速度。GPU Coder 支持從 MATLAB 中的深度學(xué)習(xí)模型生成代碼,該模型利用來自 Intel、NVIDIA

2022-07-08 15:23:34 2027

2027 三維圖形是 GPU 擁有如此大的內(nèi)存和計算能力的根本原因,它與 深度神經(jīng)網(wǎng)絡(luò) 有一個共同之處:都需要進(jìn)行大量矩陣運算。

2022-08-06 15:56:02 1247

1247 GPU 引領(lǐng)的深度學(xué)習(xí)

2023-01-04 11:17:16 1202

1202 與傳統(tǒng)機器學(xué)習(xí)相比,深度學(xué)習(xí)是從數(shù)據(jù)中學(xué)習(xí),而大模型則是通過使用大量的模型來訓(xùn)練數(shù)據(jù)。深度學(xué)習(xí)可以處理任何類型的數(shù)據(jù),例如圖片、文本等等;但是這些數(shù)據(jù)很難用機器完成。大模型可以訓(xùn)練更多類別、多個級別的模型,因此可以處理更廣泛的類型。另外:在使用大模型時,可能需要一個更全面或復(fù)雜的數(shù)學(xué)和數(shù)值計算的支持。

2023-02-16 11:32:37 2829

2829 基于深度學(xué)習(xí)的車牌識別,其中,車輛檢測網(wǎng)絡(luò)直接使用YOLO偵測。而后,才是使用網(wǎng)絡(luò)偵測車牌與識別車牌號。

2023-02-19 10:37:23 1281

1281 基于深度學(xué)習(xí)的車牌識別,其中,車輛檢測網(wǎng)絡(luò)直接使用YOLO偵測。而后,才是使用網(wǎng)絡(luò)偵測車牌與識別車牌號。

2023-02-19 11:35:57 3175

3175 當(dāng)今的深度學(xué)習(xí)應(yīng)用如此廣泛,它們能夠為醫(yī)療保健、金融、交通、軍事等各行各業(yè)提供支持,但是大規(guī)模的深度學(xué)習(xí)計算對于傳統(tǒng)的中央處理器(CPU)和圖形處理器(GPU)來說是非常耗時和資源密集的。

2023-03-09 09:35:24 3524

3524 深度學(xué)習(xí)可以學(xué)習(xí)視覺輸入的模式,以預(yù)測組成圖像的對象類。用于圖像處理的主要深度學(xué)習(xí)架構(gòu)是卷積神經(jīng)網(wǎng)絡(luò)(CNN),或者是特定的CNN框架,如AlexNet、VGG、Inception和ResNet。計算機視覺的深度學(xué)習(xí)模型通常在專門的圖形處理單元(GPU)上訓(xùn)練和執(zhí)行,以減少計算時間。

2023-05-05 11:35:28 2020

2020 早期的機器學(xué)習(xí)以搜索為基礎(chǔ),主要依靠進(jìn)行過一定優(yōu)化的暴力方法。但是隨著機器學(xué)習(xí)逐漸成熟,它開始專注于加速技術(shù)已經(jīng)很成熟的統(tǒng)計方法和優(yōu)化問題。同時深度學(xué)習(xí)的問世更是帶來原本可能無法實現(xiàn)的優(yōu)化方法。本文將介紹現(xiàn)代機器學(xué)習(xí)如何找到兼顧規(guī)模和速度的新方法。

2023-05-09 09:58:33 1337

1337 NVIDIA的標(biāo)準(zhǔn)庫使在CUDA中建立第一個深度學(xué)習(xí)庫變得非常容易。早期的優(yōu)勢加上NVIDIA強大的社區(qū)支持意味著如果使用NVIDIA GPU,則在出現(xiàn)問題時可以輕松得到支持。

2023-07-12 11:49:28 916

916

什么是深度學(xué)習(xí)算法?深度學(xué)習(xí)算法的應(yīng)用 深度學(xué)習(xí)算法被認(rèn)為是人工智能的核心,它是一種模仿人類大腦神經(jīng)元的計算模型。深度學(xué)習(xí)是機器學(xué)習(xí)的一種變體,主要通過變換各種架構(gòu)來對大量數(shù)據(jù)進(jìn)行學(xué)習(xí)以及分類處理

2023-08-17 16:03:04 3074

3074 深度學(xué)習(xí)框架是什么?深度學(xué)習(xí)框架有哪些?? 深度學(xué)習(xí)框架是一種軟件工具,它可以幫助開發(fā)者輕松快速地構(gòu)建和訓(xùn)練深度神經(jīng)網(wǎng)絡(luò)模型。與手動編寫代碼相比,深度學(xué)習(xí)框架可以大大減少開發(fā)和調(diào)試的時間和精力,并提

2023-08-17 16:03:09 3886

3886 深度學(xué)習(xí)框架和深度學(xué)習(xí)算法教程 深度學(xué)習(xí)是機器學(xué)習(xí)領(lǐng)域中的一個重要分支,多年來深度學(xué)習(xí)一直在各個領(lǐng)域的應(yīng)用中發(fā)揮著極其重要的作用,成為了人工智能技術(shù)的重要組成部分。許多深度學(xué)習(xí)算法和框架提供了

2023-08-17 16:11:26 1827

1827 近年來,深度學(xué)習(xí)技術(shù)在語音合成領(lǐng)域取得了顯著的進(jìn)展。基于深度學(xué)習(xí)的語音合成技術(shù)能夠生成更加自然、真實的語音,提高了用戶體驗。本文將介紹基于深度學(xué)習(xí)的語音合成技術(shù)的進(jìn)展以及未來趨勢。 一、基于深度學(xué)習(xí)

2023-09-16 14:48:21 2110

2110 GPU最初是為圖形渲染而設(shè)計的,但是由于其卓越的并行計算能力,它們很快被引入深度學(xué)習(xí)中。深度學(xué)習(xí)的迅速發(fā)展離不開計算機圖形處理單元(GPU)的支持,而GPU中的張量核心則被譽為深度學(xué)習(xí)的秘密武器

2023-09-26 08:29:54 1745

1745

在很多人眼里,深度學(xué)習(xí)是一個非常神奇的技術(shù),是人工智能的未來,是機器學(xué)習(xí)的圣杯。今天深視創(chuàng)新帶您一起揭開他神秘的面紗,了解什么才是深度學(xué)習(xí)。

2023-11-09 10:58:02 1095

1095

人工智能的飛速發(fā)展,深度學(xué)習(xí)作為其重要分支,正在推動著諸多領(lǐng)域的創(chuàng)新。在這個過程中,GPU扮演著不可或缺的角色。就像超級英雄電影中的主角一樣,GPU在深度學(xué)習(xí)中擁有舉足輕重的地位。那么,GPU在深度

2023-12-06 08:27:37 2443

2443

的發(fā)展,基于深度學(xué)習(xí)的TSC方法逐漸展現(xiàn)出其強大的自動特征提取和分類能力。本文將從多個角度對深度學(xué)習(xí)在時間序列分類中的應(yīng)用進(jìn)行綜述,探討常用的深度學(xué)習(xí)模型及其改進(jìn)方法,并展望未來的研究方向。

2024-07-09 15:54:05 2906

2906 圖形處理器(GPU)憑借其強大的并行計算能力,成為加速深度學(xué)習(xí)任務(wù)的理想選擇。

2024-10-17 10:07:03 1019

1019 GPU在深度學(xué)習(xí)中的應(yīng)用廣泛且重要,以下是一些GPU深度學(xué)習(xí)應(yīng)用案例: 一、圖像識別 圖像識別是深度學(xué)習(xí)的核心應(yīng)用領(lǐng)域之一,GPU在加速圖像識別模型訓(xùn)練方面發(fā)揮著關(guān)鍵作用。通過利用GPU的并行計算

2024-10-27 11:13:45 2278

2278 設(shè)計的硬件加速器,它在深度學(xué)習(xí)中的應(yīng)用日益廣泛。 1. NPU的基本概念 NPU是一種專門針對深度學(xué)習(xí)算法優(yōu)化的處理器,它與傳統(tǒng)的CPU和GPU有所不同。NPU通常具有高度并行的處理能力,能夠高效地執(zhí)行深度學(xué)習(xí)中的大規(guī)模矩陣運算和數(shù)據(jù)傳輸。這種設(shè)計使得NPU在處理深度學(xué)習(xí)任務(wù)時,

2024-11-14 15:17:39 3171

3171 隨著人工智能技術(shù)的飛速發(fā)展,深度學(xué)習(xí)作為其核心部分,已經(jīng)成為推動技術(shù)進(jìn)步的重要力量。GPU(圖形處理單元)在深度學(xué)習(xí)中扮演著至關(guān)重要的角色,其強大的并行處理能力使得訓(xùn)練復(fù)雜的神經(jīng)網(wǎng)絡(luò)模型成為可能

2024-11-19 10:55:52 2371

2371 ,一個新的競爭力量——LPU(Language Processing Unit,語言處理單元)已悄然登場,LPU專注于解決自然語言處理(NLP)任務(wù)中的順序性問題,是構(gòu)建AI應(yīng)用不可或缺的一環(huán)。 本文旨在探討深度學(xué)習(xí)工作負(fù)載中GPU與LPU的主要差異,并深入分析它們的架構(gòu)、

2024-12-09 11:01:18 4019

4019

技術(shù)的不斷進(jìn)步,尤其是GPU性能的顯著提升,越來越多的行業(yè)專家和從業(yè)者開始預(yù)測未來的渲染工作將逐步轉(zhuǎn)向GPU渲染。然而,CPU渲染真的會被GPU渲染逐漸取代乃至消失

2025-02-06 11:04:45 1373

1373

電子發(fā)燒友App

電子發(fā)燒友App

評論