強化學習之父Richard Sutton總結AI研究“苦澀教訓”,認為利用算力才是王道,不應依靠人類知識。對此,著名機器人專家Rodney Brooks 撰文反駁,闡述了Sutton觀點錯誤的六大原因。

The Bitter Lesson還是A Better Lesson?

近日,強化學習之父、加拿大計算機科學家 Richard S. Sutton 在其個人網(wǎng)站上發(fā)文The Bitter Lesson,指出了過去 70 年來 AI 研究方面的苦澀教訓:我們過于依靠人類知識了。

參考閱讀:

強化學習之父:AI研究70年教訓深刻,未來探索要靠智能體自己

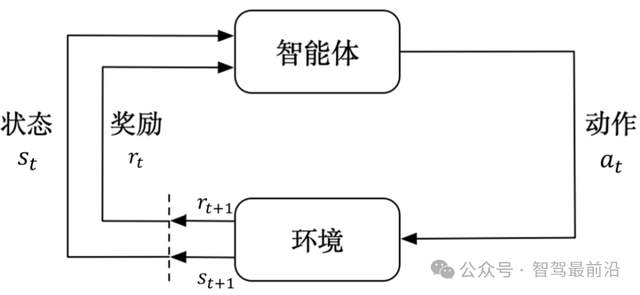

他認為,過去 70 年來,AI 研究走過的最大彎路,就是過于重視人類既有經驗和知識,研究人員在訓練 AI 模型時,往往想將人類知識灌輸給智能體,而不是讓智能體自己去探索。這實際上只是個記錄的過程,并未實現(xiàn)真正的學習。

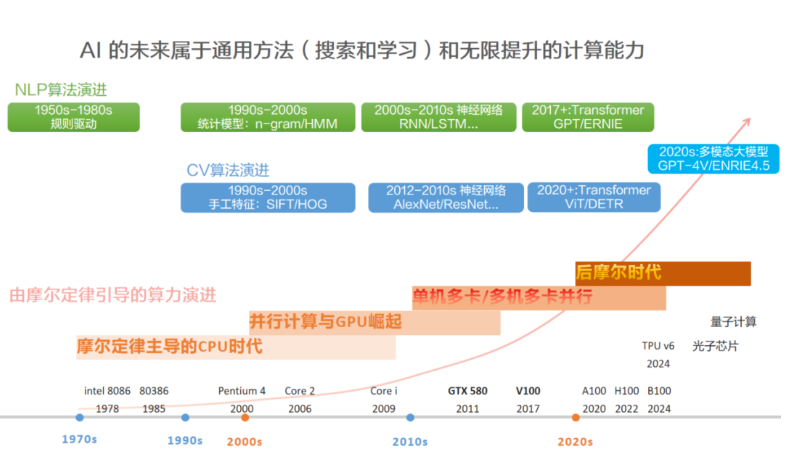

Sutton說,事實證明,這種基于人類知識的所謂 “以人為本” 的方法,并未收到很好的效果,尤其是在可用計算力迅猛增長的大背景下,在國際象棋、圍棋、計算機視覺等熱門領域,智能體本身已經可以自己完成 “規(guī)模化搜索和學習”,取得的效果要遠好于傳統(tǒng)方法。

由此,Sutton認為利用算力才是王道,過去的教訓必須總結,未來的研究中,應該讓 AI 智能體自己去發(fā)現(xiàn),而不是將我們發(fā)現(xiàn)的東西記下來。

這番言論引來許多反對的聲音,比如,牛津大學計算機科學教授 Shimon Whiteson 寫道:“Sutton 說 AI 的發(fā)展歷程告訴我們,利用計算力要勝過利用人類知識。我認為這是對歷史的一種很奇怪的解釋。AI 的成功不僅取決于豐富的計算資源,還取決于沒有被拋棄的人類知識。”

近日,著名 AI 專家 Rodney Brooks 也加入反對Sutton的隊伍,他撰文 “A Better Lesson”,闡述Rich Sutton的觀點錯誤的六大原因。

Rodney Brooks 被譽為機器人教父,機器人領域祖師爺級別的學者,他還是澳洲科學院院士,美國國家工程院院士,前 MIT 計算機科學和人工智能實驗室主任。

Rodney Brooks

新智元對 Rodney Brooks 的評論文章翻譯如下:

Sutton觀點錯誤的六大原因

就在上周,Rich Sutton 發(fā)表了一篇題為《苦澀的教訓》(The Bitter Lesson) 的短文。我打算盡量把這篇評論寫得比他的帖子更短。Sutton 在強化學習領域有著長期而持續(xù)的貢獻。

在他的文章中,Sutton 用了很多很好的例子來論證,在人工智能 70 年的歷史中,更多的計算和更少的內置知識總是構建 AI 系統(tǒng)的最佳方式。這與許多新進入 AI 領域的人們目前的思維模式產生了共鳴,他們認為,設計學習網(wǎng)絡并投入大量計算能力,要比為某個任務專門設計一個計算架構更好。然而,我必須要說的是,上周在美國國家科學院 (National Academy of Science) 舉辦的為期兩天的深度學習研討會上,后一種觀點更為流行,某種程度上這與 Sutton 的觀點正好相反。

我認為 Sutton 錯了,原因有很多。

1.深度學習最著名的成功之一就是圖像標注 (image labeling),使用 CNN,即卷積神經網(wǎng)絡,但 CNN 的本質是網(wǎng)絡的前端由人類設計來處理平移不變性,即對象可以出現(xiàn)在框架的任何地方。使用深度學習網(wǎng)絡也必須學習那些看起來學究氣十足的東西,并且會使學習的計算成本提高許多個數(shù)量級。

2.在圖像標記方面,還有其他一些東西受到了極大的影響,因為目前的 CNN 中缺乏某些眾所周知對人類表現(xiàn)很重要的內置功能。例如,顏色恒常性 (color constancy)。

有這么一個著名的例子:一個停車標志上被貼了一些膠帶,就被一個為自動駕駛訓練的 CNN 誤認為是一個 “限速 45 英里” 的限速標志了。

人類不會犯這樣的錯誤,因為他們知道停車標志是紅色的,限速標志是白色的。CNN 并不知道這一點,因為相機中的像素顏色和物體的實際顏色之間的關系是一種非常復雜的關系,而這種關系并沒有被訓練算法使用的區(qū)區(qū)數(shù)千萬張訓練圖像所闡明。

未來可行的訓練集可以是將人類的工作負載轉移為創(chuàng)建大量的訓練集,并編碼我們希望系統(tǒng)學習的標簽。這就像直接構建一個顏色恒常性階段一樣需要內置知識。這是把人類的智力工作轉移到其他地方的花招。

3.事實上,對于今天的大多數(shù)機器學習問題,都需要人來設計一個特定的網(wǎng)絡架構才能使學習順利進行。所以,我們現(xiàn)在期望的不是由人類構建特定的知識,而是由人類構建特定的、適當?shù)木W(wǎng)絡,以及構建需要使用的特定訓練機制。再說一次,說 AI 在沒有人類參與的情況下取得成功,這是一種花招。相反,我們要求人類將他們的智慧以一種不同的形式注入算法中。

4. 大量的數(shù)據(jù)集根本不是人類學習東西所需要的,所以這里缺失了某些東西。今天的數(shù)據(jù)集可以有數(shù)十億個樣本,但一個人可能只需要少數(shù)幾個樣本就能學會同樣的東西。但更糟糕的是,訓練我們今天所看到的大多數(shù)網(wǎng)絡所需的計算量只能由預算非常龐大的大公司提供,AI 的成本過高使得個人甚至大學院系難以推動。對于智能系統(tǒng),這不是一個可持續(xù)發(fā)展的模式。對于一些機器學習問題,由于在訓練過程中需要消耗大量能耗,我們已經開始看到一些明顯節(jié)約的方法。

5. 摩爾定律 (Moore’s Law) 正在放緩,因此,一些計算機架構師報告稱,單個芯片上計算量倍增的時間正在從一年延長到 20 年。此外,登納德縮放定律 (Dennard scaling) 在 2006 年的崩潰意味著機器的功耗隨著性能提升而提高,因此我們甚至可能無法承受在小型機器上提高機器學習的結果 (更不用說實際的學習),例如,自動駕駛汽車可能需要 2500 瓦的電力來進行計算 —— 而人腦只需要 20 瓦。因此,Sutton 的觀點只會讓情況變得更糟,讓 AI 和 ML 的使用變得不切實際。

6.計算機架構師現(xiàn)在正試圖通過為訓練好的網(wǎng)絡構建專用芯片來解決這些問題。但他們需要將硬件鎖定到特定的網(wǎng)絡結構,并利用人工分析,在不改變計算結果的情況下大幅降低電力預算。這有兩個缺點。首先,它鎖定了特定于特定解決方案的硬件,因此每當我們遇到新的 ML 問題,我們都需要設計新的硬件。其次,它只是簡單地轉移了應用人類智能的地方,而不是完全消除人類參與設計的需要。

因此,我對 Rich Sutton 這篇文章的看法是,我們應該從過去 70 年的 AI 研究中吸取的教訓,根本不是只要使用更多的計算力就總能成功。相反,我認為應該吸取的更好的教訓是,我們必須考慮任何解決方案的總成本,而且到目前為止,這些都需要大量的人類智慧。

這篇評論,包括這句話,比 Sutton 的帖子短了 78 個詞。

-

機器人

+關注

關注

213文章

31096瀏覽量

222361 -

智能體

+關注

關注

1文章

479瀏覽量

11608 -

強化學習

+關注

關注

4文章

270瀏覽量

11970

原文標題:算力不是王道,強化學習之父Rich Sutton的六點錯誤

文章出處:【微信號:AI_era,微信公眾號:新智元】歡迎添加關注!文章轉載請注明出處。

發(fā)布評論請先 登錄

自動駕駛中常提的離線強化學習是什么?

強化學習會讓自動駕駛模型學習更快嗎?

多智能體強化學習(MARL)核心概念與算法概覽

上汽別克至境E7首發(fā)搭載Momenta R6強化學習大模型

思必馳俞凱與圖靈獎得主Richard Sutton進行學術交流

今日看點:智元推出真機強化學習;美國軟件公司SAS退出中國市場

自動駕駛中常提的“強化學習”是個啥?

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+AI的科學應用

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+化學或生物方法實現(xiàn)AI

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+可期之變:從AI硬件到AI濕件

【「AI芯片:科技探索與AGI愿景」閱讀體驗】+內容總覽

【書籍評測活動NO.64】AI芯片,從過去走向未來:《AI芯片:科技探索與AGI愿景》

NVIDIA Isaac Lab可用環(huán)境與強化學習腳本使用指南

18個常用的強化學習算法整理:從基礎方法到高級模型的理論技術與代碼實現(xiàn)

AI演進的核心哲學:使用通用方法,然后Scale Up!

強化學習之父Richard Sutton總結AI研究“苦澀教訓”

強化學習之父Richard Sutton總結AI研究“苦澀教訓”

評論