Baseten、DeepInfra、Fireworks AI 和 Together AI 正通過在 NVIDIA Blackwell 平臺上運行優化的推理堆棧,幫助各行業降低每 token 成本。

一次醫療領域的診斷洞察、一次互動游戲中角色的對話、一次來自客服代理的自主解決方案——這些由 AI 驅動的交互,皆基于同一智能單元:一個token。

要擴展這些 AI 交互,企業需要考慮是否能夠承擔更多 token 成本。答案在于更優的 Token 經濟學(tokenomics)——其核心在于降低每個 token 的成本。這種下降趨勢正在各行各業中顯現。

近期麻省理工學院研究發現,基礎設施與算法效率的提升使前沿水平性能的推理成本正逐年降低至原來的 1/10。

要理解基礎設施效率如何提升 tokenomics,可以把它類比為一臺高速印刷機。如果這臺印刷機只需在油墨、能源和設備本身上進行小幅追加投資,就能實現 10 倍的產出,那么每頁印刷成本自然會下降。同理,對 AI 基礎設施的投資如果能帶來遠超預期的 token 產出,就會顯著降低每個 token 的成本。

當 token 的產出增長超過基礎設施成本增長時,每個 token 的成本就會下降。

正因如此,包括 Baseten、DeepInfra、Fireworks AI 和 Together AI 在內的領先推理服務提供商紛紛采用NVIDIA Blackwell 平臺。Blackwell 平臺幫助這些企業將每個 token 的成本最多可降至 NVIDIA Hopper 平臺的 1/10。

這些提供商托管著先進的開源模型,其智能水平現已達前沿級別。通過融合開源的前沿智能、NVIDIA Blackwell 極致的軟硬件協同設計以及自主優化的推理堆棧,這些服務商正助力各行各業的企業實現 token 成本的大幅降低。

醫療領域——Baseten 與 Sully.ai 將 AI 推理成本降低 9 成

在醫療領域,諸如醫療編碼、病歷記錄和保險表格管理等繁瑣耗時的任務,會占用醫生與患者交流的時間。

Sully.ai通過開發能夠處理醫療編碼和記錄筆記等常規任務的”AI 員工”來解決這一問題。隨著公司平臺規模擴大,其自有的閉源模型面臨著三大瓶頸:實時臨床工作流程中的延遲不可預測、推理成本增長速度比收入增長更快,以及對模型質量和更新的控制不足。

Sully.ai 打造 AI 員工,幫助醫生處理日常事務。

為突破這些瓶頸,Sully.ai 采用了 Baseten 的模型 API,該 API 可在 NVIDIA Blackwell GPU 上部署 gpt-oss-120b 等開源模型。Baseten 采用低精度NVFP4數據格式、NVIDIA TensorRT-LLM 庫及NVIDIA Dynamo推理框架以實現優化的推理。該公司選擇 NVIDIA Blackwell 運行 Model API,因其每美元投入的吞吐量較 NVIDIA Hopper 平臺提升 2.5 倍。

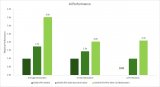

結果顯示,Sully.ai的推理成本因此降低了 90%,成本降低至原來的閉源實現方案的 1/10。同時在病歷生成等關鍵工作流的響應速度提升了 65%。該公司已為醫生節省了超過 3000 萬分鐘的時間,這些時間原本耗費在數據錄入及其他手動操作上。

游戲領域——DeepInfra 與 Latitude 將每 token 成本降至原來的 1/4

Latitude正通過其 AI 冒險故事游戲AI Dungeon及即將推出的 AI 驅動角色扮演游戲平臺 Voyage,打造 AI 原生游戲的未來。玩家可在這些平臺中自由創建或探索世界,選擇任何行動,書寫專屬故事。

該公司的平臺采用大型語言模型響應玩家操作——但這帶來了擴展難題,因為每次玩家操作都會觸發推理請求。成本隨玩家參與度增長而攀升,而響應速度必須保持足夠快才能確保游戲體驗的流暢性。

Latitude 開發了一款名為 AI Dungeon 的文字冒險故事游戲,該游戲能在玩家探索動態故事時實時生成敘事文本與圖像。

Latitude 運行的大型開源模型基于由 NVIDIA Blackwell GPU 和 TensorRT-LLM 驅動的DeepInfra 推理平臺。對于大規模混合專家模型(MoE),DeepInfra 將每百萬 token 的成本從 NVIDIA Hopper 平臺的 0.20 美元降至 Blackwell 平臺的 0.10 美元。通過遷移至 Blackwell 原生低精度 NVFP4 格式,其成本進一步降至每百萬 token 0.05 美元——現每 token 成本降至之前的 1/4,同時保持了客戶期望的準確性。

在 DeepInfra 基于 Blackwell 的平臺上運行這些大型 MoE 模型,使 Latitude 能夠以經濟高效的方式提供快速可靠的響應。DeepInfra 的推理平臺在保證性能的同時,還能穩定應對流量峰值,讓 Latitude 得以部署更強大的模型而不影響玩家體驗。

智能體聊天代理——Fireworks AI 與 Sentient Foundation 合作,將 AI 成本降低高達 50%

Sentient Labs 致力于匯聚 AI 開發者,共同構建強大的開源推理 AI 系統。其目標是通過在安全自主性、智能體架構和持續學習領域開展研究,加速 AI 解決更復雜的推理難題。

Sentient Labs 的首款應用 Sentient Chat 能夠編排復雜的多智能體工作流,并整合來自社區的十余個專業 AI 智能體。正因如此,Sentient Chat 面臨著巨大的計算需求——單個用戶查詢可能觸發一系列自主交互,通常會導致高昂的基礎設施開銷。

為應對這種規模和復雜性任務,Sentient 采用基于 NVIDIA Blackwell 運行的 Fireworks AI 推理平臺。借助 Fireworks 針對 Blackwell 優化的推理堆棧,Sentient 的成本效率相比之前基于 Hopper 的部署方案提升了 25% 到 50%。

Sentient Chat 編排復雜的多智能體工作流,并整合來自社區的十余個專業 AI 智能體。

更高的每 GPU 吞吐量使該公司能夠以相同成本服務更多并發用戶。該平臺的可擴展性支持了病毒式傳播的用戶增長——24 小時內新增 180 萬候補用戶,單周處理 560 萬次查詢,同時保持了穩定的低延遲表現。

客戶服務——Together AI 與 Decagon 實現成本降至原來的 1/6

使用語音 AI 的客服服務通話往往令人感到挫敗,因為哪怕是輕微的延遲都可能導致用戶打斷語音助手、掛斷電話或失去信任。

Decagon 為企業客戶支持構建 AI 智能體,其中 AI 驅動的語音服務要求最為苛刻。Decagon 需要一套能夠在不可預測的流量負載下實現亞秒級響應的基礎設施,并具備支持全天候語音部署的 tokenomics。

Decagon 為客戶支持構建 AI 智能體,其中語音服務要求最為苛刻。

Together AI 在 NVIDIA Blackwell GPU 上為 Decagon 的多模型語音技術棧運行生產級推理。兩家公司在多項關鍵優化上展開合作:采用推測解碼技術,通過訓練小型模型實現更快的響應速度,同時在后臺由大模型驗證準確性;緩存重復對話元素以加速響應;構建自動擴展機制,在應對流量激增時保持性能穩定。

Decagon 即使在每條查詢處理數千個 token 的情況下,也能實現低于 400 毫秒的響應時間。與使用閉源專有模型相比,每條查詢的成本(即完成一次語音交互的總成本)降低至原來的 1/6。這一成果得益于 Decagon 的多模型方案(部分采用開源模型,部分在 NVIDIA GPU 上自主訓練)、NVIDIA Blackwell 芯片的極致協同設計以及 Together 平臺的優化推理堆棧的協同作用。

通過極致協同設計優化 tokenomics

在醫療、游戲和客戶服務等領域取得的顯著成本節省,得益于 NVIDIA Blackwell 的高性能。NVIDIA Grace Blackwell 機架式解決方案進一步擴大了這一優勢,其推理 MoE 模型的每 token 成本降至 NVIDIA Hopper 的 1/10,實現了成本的突破性降低。

NVIDIA 涵蓋了計算、網絡和軟件等跨各個層級堆棧的極致協同設計,以及其合作伙伴生態系統,正在大幅度降低每 token 成本。

這一勢頭延續至NVIDIA Rubin 平臺上——通過將六款全新芯片集成于一臺 AI 超級計算機中,其性能較 Blackwell 提升 10 倍,token 成本降至 Blackwell 的 1/10。

探索NVIDIA 的全棧推理平臺,深入了解其如何為 AI 推理提供更優的 tokenomics。

-

NVIDIA

+關注

關注

14文章

5592瀏覽量

109711 -

AI

+關注

關注

91文章

39755瀏覽量

301347 -

開源

+關注

關注

3文章

4203瀏覽量

46120

原文標題:領先推理提供商借助基于 NVIDIA Blackwell 平臺的開源模型,將 AI 成本削減至 1/10

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

NVIDIA DGX SuperPOD為Rubin平臺橫向擴展提供藍圖

NVIDIA在CES 2026發布新一代Rubin AI平臺

NVIDIA RTX PRO 5000 Blackwell GPU的深度評測

NVIDIA RTX PRO 4000 Blackwell GPU性能測試

NVIDIA RTX PRO 5000 72GB Blackwell GPU現已全面上市

NVIDIA RTX PRO 2000 Blackwell GPU性能測試

DeepSeek R1 MTP在TensorRT-LLM中的實現與優化

NVIDIA RTX PRO 4500 Blackwell GPU測試分析

OpenAI與NVIDIA共同開發全新開放模型

NVIDIA Blackwell GPU優化DeepSeek-R1性能 打破DeepSeek-R1在最小延遲場景中的性能紀錄

NVIDIA Blackwell平臺助力企業實現token成本的大幅降低

NVIDIA Blackwell平臺助力企業實現token成本的大幅降低

評論