具身智能走向真實世界規模化應用,離不開可復現、可擴展、可協同演進的數據基礎設施。圍繞真實物理交互能力構建這一核心工程目標,1月26日,國家地方共建人形機器人創新中心聯合上海緯鈦科技有限公司正式發布全球首個最大規模跨本體視觸覺多模態數據集——白虎-VTouch(Vision-Based Tactile Sensor),總規模超過60,000分鐘。

近日,白虎-VTouch數據集首批6,000分鐘數據在OpenLoong開源社區和AtomGit平臺同步開放下載,并躍居AtomGit平臺數據集分類下載量第一。歡迎掃描二維碼或點擊閱讀原文下載使用,誠邀全球開發者與產業伙伴使用與共建。

白虎-VTouch的開源選擇

在OpenLoong社區的定位中,白虎-VTouch并不是一個“單點能力領先”的數據集,而是一次對具身智能數據范式的系統性補位。過去幾年,具身智能領域的快速發展更多依賴視覺、多模態語言以及仿真環境中的策略學習。但在真實世界任務中,機器人仍然普遍面臨“看得見卻做不好”的困境,其根源并不在模型規模,而在于真實物理交互數據的長期缺位。

白虎-VTouch的獨特指出在于其首次將高分辨率視觸覺信息、真實物理接觸過程以及跨機器人本體的一致標注體系放在同一個數據框架中進行系統性構建。這類數據本身具有高工程成本特性:高帶寬同步采集、復雜標定流程、多機器人平臺協同、真實場景反復復現,幾乎不具備被單一團隊長期獨占和閉源演進的可持續性。由此可見,若這類數據未能融入開源生態,其價值會被極大限制。

OpenLoong開源社區承載了白虎-VTouch的開源發布,并不只是簡單提供一個下載入口,而是將其作為社區級基礎能力的一部分進行組織。一方面,白虎-VTouch本身補足了具身智能Scaling Law中長期缺失的“觸覺與接觸”維度,使模型訓練首次能夠系統性學習接觸狀態、力控反饋與動作調整之間的關系;另一方面,通過開源,它也為不同研究路線、不同機器人平臺、不同控制范式提供了一個可以被反復驗證、復現和對比的公共基準。

白虎-VTouch被設計為一個可被持續擴展、持續復用的具身基礎語料庫。它的意義不止在于“已經采集了多少分鐘的數據”,而在于為整個社區建立了一種可復制的工程方法:如何在真實世界中穩定采集高質量視觸覺數據,如何保證多模態時序對齊,如何在不同本體之間保持語義一致性。這些能力,只有通過開源,才能真正沉淀為行業公共資產。

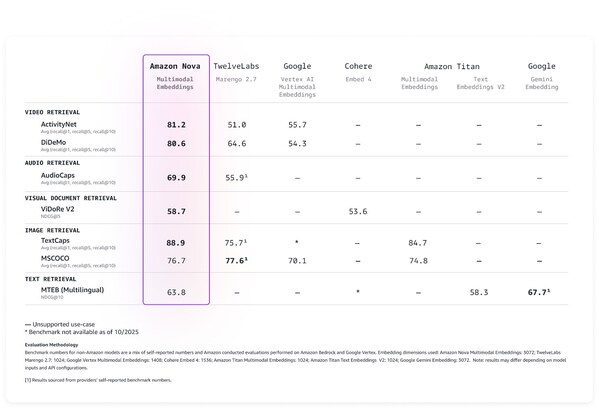

不同數據集對比

跨本體視觸覺多模態數據體系的工程突破

白虎-VTouch(Vision-Based Tactile Sensor)包含視觸覺傳感器數據、RGB-D數據、關節位姿數據等多模態信息,覆蓋輪臂機器人(D-Wheel)、雙足人形機器人(青龍)及手持智能終端等多種機器人本體結構,以真實物理交互過程為核心對象,將視觸覺傳感器數據、RGB-D視覺信息與機器人關節位姿狀態進行系統整合,構建覆蓋感知、接觸與動作全過程的多模態訓練語料體系。

跨層次交互理解具身標注體系

基于真實物理交互與多模態感知數據,團隊構建了跨層次交互理解具身標注體系,通過視覺、語言、動作與觸覺等多模態語義的聯合建模與對齊,實現跨模態表征學習與統一理解,為下一代具身VTLA提供數據標準。白虎-VTouch數據標注體系將分批次開源。

抽象思維層:理解“為什么”。通過將任務抽象意圖推演成通用化維度交叉思維鏈,模型直接學習背后的思維鏈規律組合。

動作邏輯層:明白“怎么做”。創建完備獨立的原子動作元語,結合自然語言指令將復雜長流程任務操作拆解為動作步驟序列,涵蓋操作邏輯與步驟內涵。

物理狀態層:感受“做什么”。通過視觸覺增強的物理交互信息深化智能體對自身狀態的掌握,同時確保物理真實一致性和多模態同步對齊。

“矩陣式”任務構建新范式

來源:OpenLoong開源社區

在任務構建方法上,白虎-VTouch并未沿用傳統的“人工定義單任務”路徑,而是提出“矩陣式”任務構建新范式。該范式以雙臂協同結構、原子操作類型、接觸與觸覺模式作為核心維度,并結合物體與幾何屬性、感知模態組合及任務層級結構等輔助維度進行系統性交叉,每一個維度交點,均對應一個可執行的最小任務單元。基于這一構建邏輯,白虎-VTouch覆蓋了家居家政、工業制造、餐飲服務與特殊作業四大真實應用領域,形成380+任務類型、100+原子技能、500+真實物品的高密度任務空間。同時,通過光照變化、遮擋干擾與姿態擾動等方式顯式引入泛化條件,使任務設計從一開始即面向真實部署環境。

補齊具身智能Scaling Law中缺失的“觸覺維度”

具身智能的Scaling Law,與大模型語境下的Scaling并不完全等價,其中長期缺失的一環,正是“接觸與觸覺”。

白虎-VTouch的核心價值之一,在于其系統性的引入了真實物理交互中的觸覺與接觸信息。白虎-VTouch所采用的視觸覺傳感器支持最高640×480分辨率與120Hz刷新率,在物體接觸過程可穩定記錄細粒度接觸變化,包含約9072萬對視觸覺接觸圖像真實物體接觸樣本。視觸覺接觸數據占本數據集規模的比重為57%,顯著擴展了真實物理交互場景的接觸范圍。基于視觸覺傳感器的高空間分辨率與多維力感知能力,數據集能夠以圖像級形式記錄接觸過程中的微觀形變、壓力分布與滑移狀態,使觸覺信息具備與視覺同等級別的可學習表征密度。

這類數據服務于對接觸狀態高度敏感的任務場景,補足了具身智能Scaling Law所缺失的“觸覺與接觸”維度,為模型建立“接觸前—接觸中—接觸后”的完整物理理解提供了必要基礎,也為機器人從“能看”走向“能觸、能控、能穩態泛化”奠定了關鍵語料支撐。

在任務層面,視觸覺信息重點覆蓋260+接觸密集型任務,其中,68%的任務在引入視觸覺感知后獲得了更完整、連續的接觸狀態描述,為精細操作、力控調整與失敗恢復等關鍵環節提供了直接增益,充分體現了視觸覺數據在提升復雜操作任務成功率方面的實際價值。

開發者使用路徑

在設計構想里,白虎-VTouch的使用路徑并不是“下載即結束”,而是應被嵌入到一個完整的開發閉環之中。針對不同階段的開發者,其需承擔的角色也有所差異。

對于初入具身智能領域的研究者或工程師而言,白虎-VTouch提供的是一個真實世界對齊的起點。開發者可以直接基于已開源的子集數據,快速理解視觸覺融合在真實操作中的作用方式,驗證純視覺策略與視觸覺策略在成功率和穩定性上的差異。這一階段,數據集更多承擔的是“認知校準”的作用,讓開發者盡早意識到真實物理交互與仿真或純視覺任務之間的本質差異。

對于已有一定算法積累的團隊,白虎-VTouch則是一個可復現實驗與泛化驗證的平臺。通過矩陣式任務構建,開發者可以有意識地選擇訓練子空間,并在未見組合上測試模型的泛化能力,而不是簡單追求單任務指標。這種使用方式尤其適合研究跨本體遷移、雙臂協同策略以及力控相關問題,也是該數據集設計時重點考慮的核心場景。

對于希望將算法落地到真實機器人系統中的開發者,白虎-VTouch與OpenLoong現有的本體平臺、控制框架及仿真工具形成了天然銜接。數據、模型與真實本體之間保持一致的接口與語義,使“訓練—推理—部署”不再是割裂的三個階段,而是一條可反復迭代的工程流水線。這一點,也是白虎-VTouch被選擇在OpenLoong開源社區開源發布的重要原因之一。

任務詞云

白虎-VTouch在OpenLoong開源社區開源后,其視觸覺融合數據集、模型實現與任務組織方式已作為公共資源向社區開放,支持開發者直接下載、復現實驗并開展二次開發。圍繞統一的數據結構與基線設置,不同團隊可以在同一操作語境下進行方法對比與系統驗證,降低雙臂操作研究與工程實踐的起步成本。

OpenLoong開源社區將持續匯聚來自不同機器人構形、任務場景與應用方向的實踐反饋,推動數據集與模型在真實使用中不斷完善,歡迎更多開發者與研究者加入OpenLoong開源社區,基于白虎-VTouch數據集開展實驗、提出改進并共同擴展雙臂機器人視觸覺融合的能力邊界。

-

開源

+關注

關注

3文章

4203瀏覽量

46120 -

數據集

+關注

關注

4文章

1236瀏覽量

26188 -

具身智能

+關注

關注

0文章

389瀏覽量

857

原文標題:首個跨本體視觸覺多模態數據集白虎-VTouch正式在OpenLoong社區開源

文章出處:【微信號:開放原子,微信公眾號:開放原子】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

聯想集團史上最大規模Tech World科技盛會成功舉辦

格靈深瞳多模態大模型榮登InfoQ 2025中國技術力量年度榜單

格靈深瞳多模態大模型Glint-ME讓圖文互搜更精準

亞馬遜云科技上線Amazon Nova多模態嵌入模型

中科曙光助力紫東太初4.0大模型重磅發布

米爾RK3576部署端側多模態多輪對話,6TOPS算力驅動30億參數LLM

Cognizant籌辦最大規模氛圍編程活動

全球首個胃癌影像篩查AI模型發布

薄型、多頻段、大規模物聯網前端模塊 skyworksinc

全球首個最大規模跨本體視觸覺多模態數據集白虎-VTouch發布

全球首個最大規模跨本體視觸覺多模態數據集白虎-VTouch發布

評論