H-RDT人類的“本能”,機(jī)器人的“捷徑利用人類數(shù)據(jù)增強(qiáng)機(jī)器人操作能力

近年來,機(jī)器人操作領(lǐng)域的VLA模型普遍基于跨本體機(jī)器人數(shù)據(jù)集預(yù)訓(xùn)練,這類方法存在兩大局限:不同機(jī)器人本體和動(dòng)作空間的差異導(dǎo)致統(tǒng)一訓(xùn)練困難;現(xiàn)有大規(guī)模機(jī)器人演示數(shù)據(jù)稀缺且質(zhì)量參差不齊。得益于近年來VR/AR頭顯和3D視覺技術(shù)的顯著進(jìn)步,當(dāng)前只需極低成本即可采集大量帶有精確人手關(guān)節(jié)標(biāo)注的第一人稱人類操作視頻。

為此,我們提出基于大規(guī)模人類操作數(shù)據(jù)預(yù)訓(xùn)練的VLA模型H-RDT(Human to Robotics Diffusion Transformer)。實(shí)驗(yàn)表明,H-RDT在仿真和真實(shí)場景中的多種本體上表現(xiàn)優(yōu)異,對比主流VLA模型具有明顯優(yōu)勢。H-RDT模型曾參加CVPR 2025 RoboTwin雙臂機(jī)器人比賽獲真機(jī)賽冠軍和仿真賽亞軍。

? 論文題目:

H-RDT: Human Manipulation Enhanced Bimanual Robotic Manipulation

?論文鏈接:

https://arxiv.org/abs/2507.23523

?項(xiàng)目主頁:

https://embodiedfoundation.github.io/hrdt

H-RDT 架構(gòu)

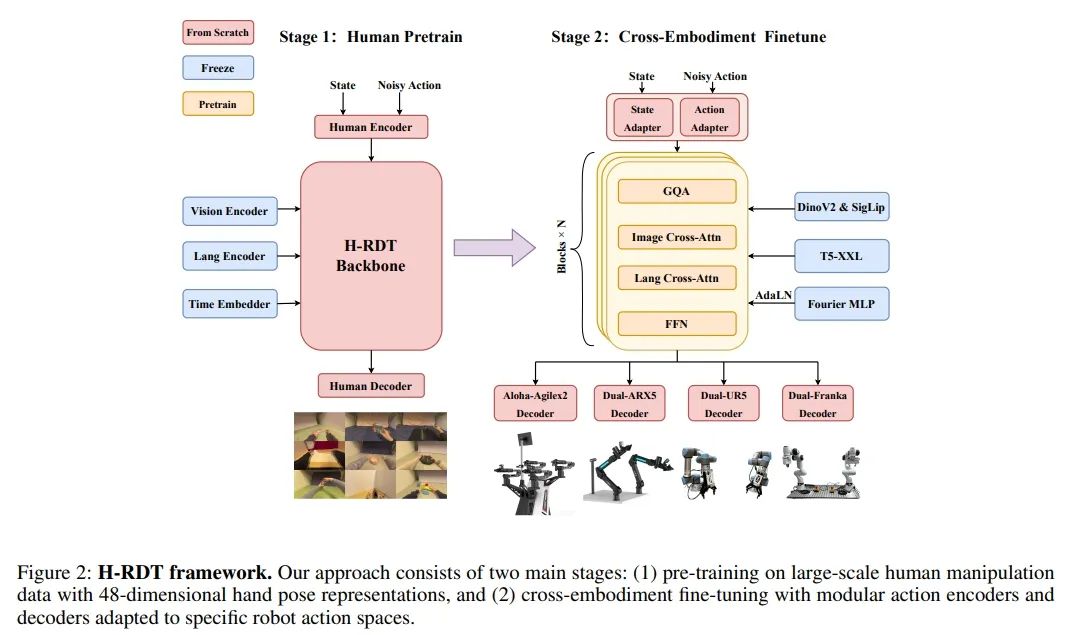

H-RDT是一個(gè)具有20億參數(shù)的擴(kuò)散Transformer,使用流匹配來建模雙臂機(jī)器人的復(fù)雜動(dòng)作分布。H-RDT采用兩階段訓(xùn)練范式:1)在大規(guī)模第一人稱人類數(shù)據(jù)上預(yù)訓(xùn)練;2)通過模塊化動(dòng)作編解碼器在機(jī)器人數(shù)據(jù)上進(jìn)行微調(diào),實(shí)現(xiàn)跨本體遷移。

人類動(dòng)作表征設(shè)計(jì)

我們采用較為精細(xì)的3D手部姿態(tài)表示方法,將動(dòng)作編碼為緊湊的48維向量,以捕捉關(guān)鍵的雙手靈巧操作信息:

雙手手腕位姿 (Bilateral Wrist Pose) :

(1)左右手的3D位置(3×2)與6D姿態(tài)(6×2),共計(jì)18維;

(2)與機(jī)器人控制中的末端執(zhí)行器 (End-Effector) 控制參數(shù)對齊;

十個(gè)手指的指尖位置 (Fingertip Position) :

(1)每個(gè)手五根手指,各提取一個(gè)三維坐標(biāo),總共10×3=30維;

(2)用于表達(dá)手指張合、握持形態(tài)等細(xì)粒度操作意圖。

總計(jì):18(手腕)+30(指尖)=48維動(dòng)作表示

這種表征策略的優(yōu)勢體現(xiàn)在三個(gè)方面:

(1)動(dòng)作通用性強(qiáng):該表示可以視作覆蓋大多數(shù)操作型機(jī)器人的“上層動(dòng)作空間”,能覆蓋如雙臂7-DoF機(jī)械臂、并聯(lián)夾爪等控制參數(shù);

(2)保留人類操作的關(guān)鍵特征:指尖相對位置、手腕旋轉(zhuǎn)、抓取姿態(tài)等都被編碼在其中,保留了對操控幾何和力學(xué)要素的刻畫能力;

(3)提供顯式的動(dòng)力學(xué)參數(shù):相比于point flow等表征方式,無需額外增加動(dòng)力學(xué)映射,更為聚焦操作語義。

模型結(jié)構(gòu)

H-RDT構(gòu)建了一個(gè)五模塊組成的DiT (Diffusion Transformer) 框架,負(fù)責(zé)從多模態(tài)感知輸入生成機(jī)器人控制序列:

視覺編碼器 (DinoV2+SigLIP) :提取RGB觀測的視覺特征;配有MLP Adapter映射到transformer嵌入空間。

語言編碼器 (T5-XXL) :編碼自然語言任務(wù)指令;同樣通過MLP Adapter接入主干。

模塊化動(dòng)作編/解碼器:編碼器對機(jī)器人狀態(tài)向量與噪聲動(dòng)作軌跡分別編碼;解碼器將輸出特征解碼為Action Chunk,其在微調(diào)階段對不同本體重新初始化。

Transformer主干(類LLaMA3架構(gòu)):使用SwiGLU激活與RMSNorm;使用解耦交叉注意力分別對視覺和語言信息進(jìn)行融合;流時(shí)間 (τ) 通過AdaLN注入。

兩階段訓(xùn)練范式

階段一:人類數(shù)據(jù)預(yù)訓(xùn)練

第一階段使用EgoDex數(shù)據(jù)集,以48維人手動(dòng)作表征對H-RDT進(jìn)行預(yù)訓(xùn)練。EgoDex數(shù)據(jù)集包括338 K+條軌跡、涵蓋194項(xiàng)不同操作任務(wù),全面覆蓋了人類操作策略、物體交互方式以及雙手協(xié)作。

階段二:跨本體微調(diào)

第二階段對特定機(jī)器人本體微調(diào)時(shí),需重新初始化動(dòng)作編碼器和解碼器子模塊以適應(yīng)不同本體,其余模塊使用預(yù)訓(xùn)練權(quán)重進(jìn)行微調(diào)。

“

流匹配訓(xùn)練方法

H-RDT采用流匹配 (Flow Matching) 來生成動(dòng)作,相較于傳統(tǒng)的擴(kuò)散建模,該方法提供了更優(yōu)的訓(xùn)練穩(wěn)定性和推理效率。

①訓(xùn)練目標(biāo):學(xué)習(xí)一個(gè)將高斯噪聲連續(xù)映射為目標(biāo)動(dòng)作序列的向量場;

②流程設(shè)計(jì):

其中

表示當(dāng)前“動(dòng)作點(diǎn)”在高斯噪聲與真實(shí)動(dòng)作之間線性插值。

③訓(xùn)練損失:

其中是要學(xué)習(xí)的向量場,

是圖像、狀態(tài)和語言的上下文條件。

④推理階段:使用ODE求解器積分向量場路徑,實(shí)現(xiàn)穩(wěn)定高效的動(dòng)作生成。

實(shí)驗(yàn)結(jié)果

真機(jī)實(shí)驗(yàn)

我們在三種真實(shí)機(jī)器人上進(jìn)行多任務(wù)訓(xùn)練,用于驗(yàn)證模型的跨本體遷移能力與實(shí)際部署的魯棒性。

1)Aloha-Agilex-2.0實(shí)驗(yàn)

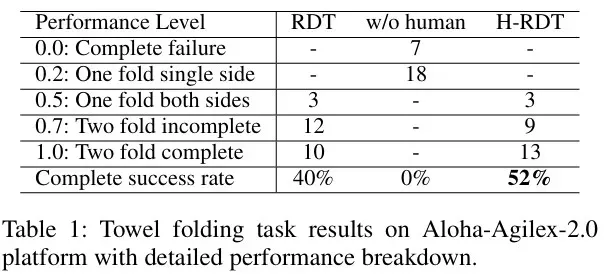

兩項(xiàng)任務(wù)均采用基于子任務(wù)的評分體系,全部完成視為完全成功。各方法各任務(wù)均測試25次。

任務(wù)1疊毛巾:測試模型連續(xù)折疊柔性物體的能力。

實(shí)驗(yàn)結(jié)果如下表所示,H-RDT的完全成功率為52%,RDT為40%,未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的模型成功率為0。

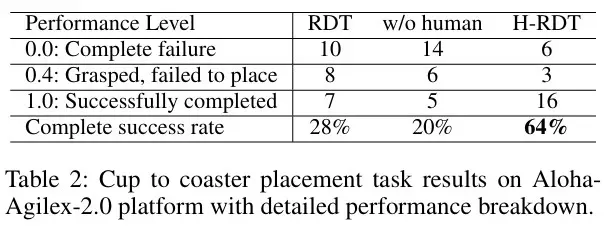

任務(wù)2將杯子放到杯墊上:該任務(wù)測試模型的空間推理能力,要求模型根據(jù)杯子的自動(dòng)選擇合適的手去抓杯子(左側(cè)杯子必須用左手抓,右側(cè)杯子必須用右手抓)。

實(shí)驗(yàn)結(jié)果如下表所示,H-RDT的完全成功率為64%,RDT為28%,未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的模型成功率為20%。

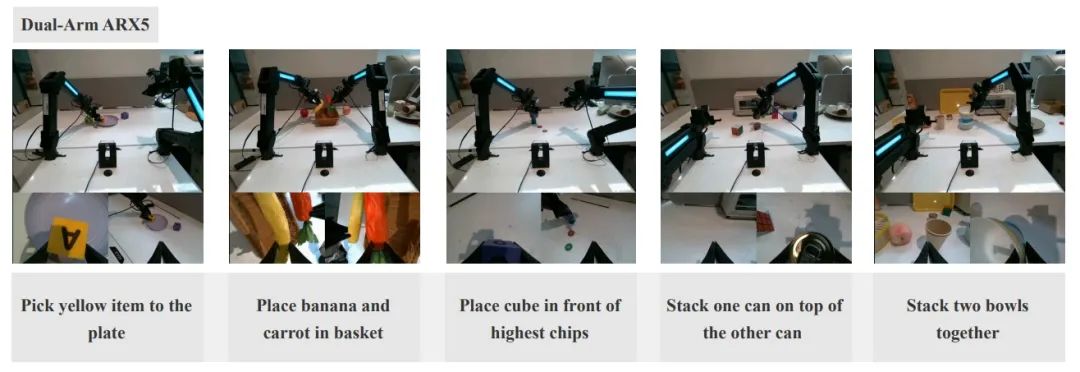

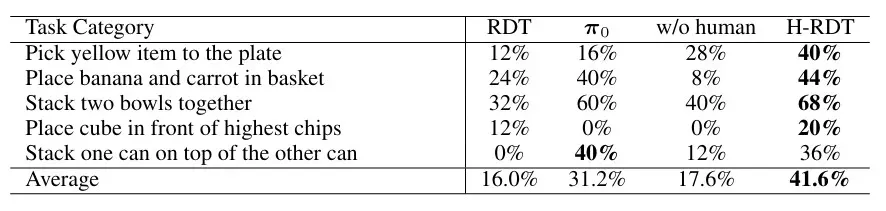

2)雙臂ARX5小樣本實(shí)驗(yàn)

我們設(shè)計(jì)了一個(gè)極具挑戰(zhàn)的任務(wù):在雙臂ARX5機(jī)器人上完成113個(gè)不同的抓取放置任務(wù),每個(gè)任務(wù)僅提供1到5個(gè)示范樣本。

實(shí)驗(yàn)結(jié)果如下表所示,H-RDT成功率達(dá)到了41.6%,而π0僅為31.2%,RDT為16%,未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的模型17.6%。

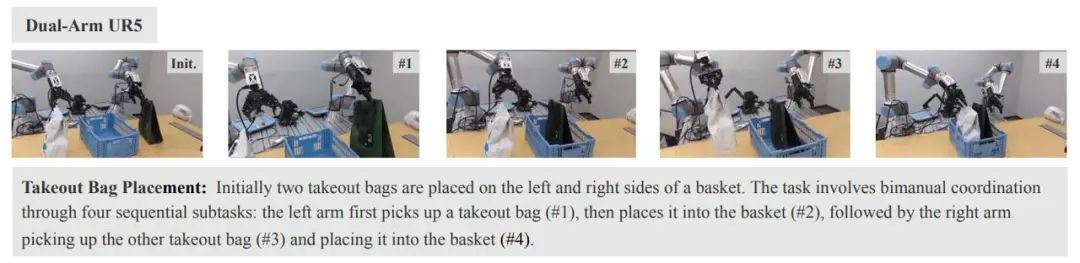

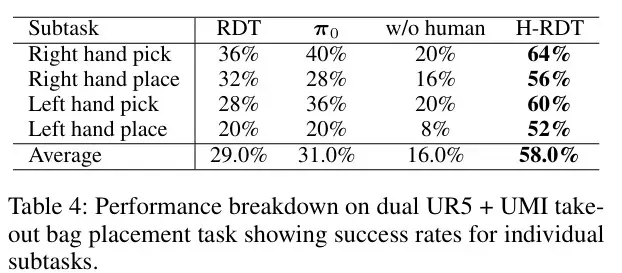

3)雙臂UR5+UMI實(shí)驗(yàn)

我們在雙臂UR5機(jī)器人上評估了H-RDT,人類演示數(shù)據(jù)通過UMI收集。任務(wù)為雙手協(xié)作放置外賣袋,細(xì)分為四個(gè)連續(xù)步驟:右手抓取 → 右手放置 → 左手抓取 → 左手放置。

實(shí)驗(yàn)結(jié)果如下表所示,H-RDT完全成功率達(dá)到58.0%,遠(yuǎn)超RDT(29%)、 π0(31%)、未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的版本(16%)。

“

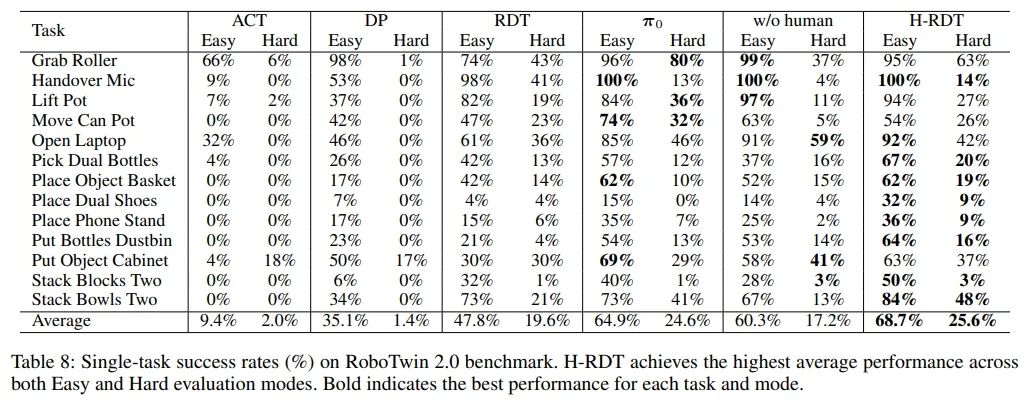

仿真測試

我們在仿真環(huán)境RoboTwin 2.0上進(jìn)行了全面測試,包括單任務(wù)和多任務(wù)設(shè)置:

單任務(wù)實(shí)驗(yàn):在RoboTwin 2.0基準(zhǔn)測試的13項(xiàng)操作任務(wù)上評估單任務(wù)性能。每項(xiàng)任務(wù)使用簡單模式下收集的50個(gè)演示樣本進(jìn)行訓(xùn)練,并在兩種模式下評估:包括簡單模式(干凈桌面)與困難模式(隨機(jī)光照、雜亂環(huán)境)。

H-RDT在簡單模式下取得了最高68.7%的平均成功率,在困難模式下為25.6%,顯著優(yōu)于其他方法;且在簡單和困難模式下均大幅超越未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的版本 (w/o human) ,證明了利用人類操作數(shù)據(jù)預(yù)訓(xùn)練的有效性。

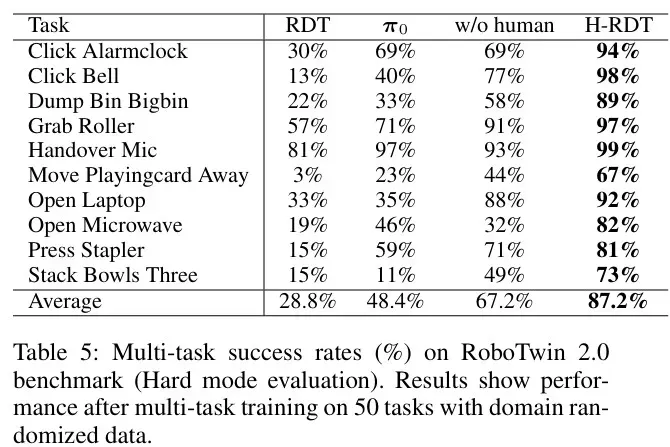

多任務(wù)實(shí)驗(yàn):在RoboTwin 2.0的45項(xiàng)任務(wù)上進(jìn)行多任務(wù)實(shí)驗(yàn),使用在困難模式下收集的約2250個(gè)演示樣本進(jìn)行訓(xùn)練,評估了10項(xiàng)任務(wù)子集。實(shí)驗(yàn)結(jié)果如下表所示。

在多任務(wù)場景中,H-RDT取得了高達(dá)87.2%的平均成功率,顯著優(yōu)于RDT(28.8%)、π0(48.4%)和未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練的版本w/o human(67.2%)。H-RDT相較于未經(jīng)人類數(shù)據(jù)預(yù)訓(xùn)練版本w/o human平均成功率提高了20.0%,明顯大于在單任務(wù)場景。這表明,在多任務(wù)場景中,利用人類操作數(shù)據(jù)進(jìn)行預(yù)訓(xùn)練能提供更好的性能。

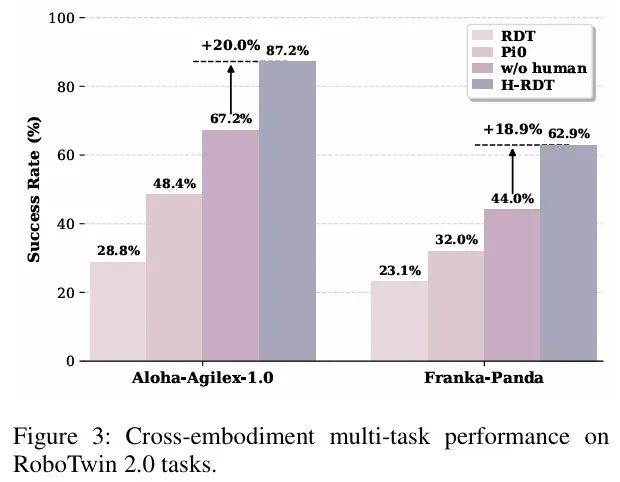

跨本體泛化:為進(jìn)一步驗(yàn)證H-RDT的跨本體遷移能力,在仿真環(huán)境中對兩種不同的機(jī)器人本體Aloha-Agilex-1.0和Franka-Panda進(jìn)行了多任務(wù)實(shí)驗(yàn),實(shí)驗(yàn)結(jié)果如下圖所示。

H-RDT在兩種機(jī)器人上均表現(xiàn)出很強(qiáng)的性能,在 Aloha-Agilex-1.0上達(dá)到87.2%的成功率,在Franka-Panda上達(dá)到62.9%的成功率,在兩個(gè)機(jī)器人上均顯著優(yōu)于基線方法。

總結(jié)與展望

本文提出H-RDT模型,使用具有3D手部位姿標(biāo)注的第一人稱人類操作視頻預(yù)訓(xùn)練以增強(qiáng)雙臂機(jī)器人的操作能力。展望未來,面對數(shù)據(jù)采集成本高、模型泛化困難等挑戰(zhàn),人類操作數(shù)據(jù)憑借其極低的采集成本和豐富的操作語義,將成為機(jī)器人策略學(xué)習(xí)不可忽視的新“寶藏”。

-

機(jī)器人

+關(guān)注

關(guān)注

213文章

31243瀏覽量

223090 -

仿真

+關(guān)注

關(guān)注

55文章

4508瀏覽量

138533 -

模型

+關(guān)注

關(guān)注

1文章

3782瀏覽量

52201

原文標(biāo)題:開發(fā)者說|H-RDT:基于人類操作數(shù)據(jù)的跨本體機(jī)器人學(xué)習(xí)

文章出處:【微信號:horizonrobotics,微信公眾號:地平線HorizonRobotics】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

【大語言模型:原理與工程實(shí)踐】大語言模型的預(yù)訓(xùn)練

使用ADO操作數(shù)據(jù)庫

使用DAO操作數(shù)據(jù)庫

駕駛操作數(shù)據(jù)采集系統(tǒng)設(shè)計(jì)研究

《Dot.NET數(shù)據(jù)庫開發(fā)技術(shù)》操作數(shù)據(jù)庫

單片機(jī)尋找操作數(shù)存放單元地址的方法解析

附加固件下載固件以操作數(shù)據(jù)記錄器其他數(shù)據(jù)范圍。

PLC編程中的操作數(shù)是什么

PyTorch教程11.9之使用Transformer進(jìn)行大規(guī)模預(yù)訓(xùn)練

基于大規(guī)模人類操作數(shù)據(jù)預(yù)訓(xùn)練的VLA模型H-RDT

基于大規(guī)模人類操作數(shù)據(jù)預(yù)訓(xùn)練的VLA模型H-RDT

評論