作者 / 語言模型可解釋性團隊

大語言模型 (LLM) 具備令人驚嘆的推理能力,但其內部決策過程在很大程度上仍然不透明。如果系統未按預期運行,對其內部運作機制缺乏可見性將難以準確定位問題根源。過去,我們通過發布Gemma Scope工具包推動了可解釋性科學的發展,該工具旨在幫助研究人員理解我們輕量級開放模型系列 Gemma 2 的內部運作機制。

近期我們正式發布了Gemma Scope 2: 這是一套全面且開放的可解釋性工具套件,適用于從 2.7 億到 270 億參數的所有Gemma 3模型規模。借助這套工具,我們可以追蹤模型整個 "大腦" 中的潛在風險。

據我們了解,這是迄今為止 AI 實驗室發布的最大規模可解釋性工具開源項目。構建 Gemma Scope 2 共涉及存儲約 110PB 數據,訓練的參數量更是超過了 1 萬億。

隨著 AI 持續發展,我們期待 AI 研究社區運用 Gemma Scope 2 來調試模型涌現行為,借助這些工具更有效地審計與調試 AI 智能體,最終實現加速開發實用且穩健的安全干預方案,以應對越獄攻擊、幻覺生成及諂媚傾向等問題。

我們與 Neuronpedia 合作推出的Gemma Scope 2 交互式演示現已開放體驗。

Gemma Scope 2 新功能

可解釋性研究旨在揭示 AI 模型的內部運作機制及其訓練中習得的算法。隨著 AI 的能力日益增強、系統日趨復雜,可解釋性對于構建安全可靠的 AI 至關重要。

與上一代工具類似,Gemma Scope 2 如同為 Gemma 系列語言模型配備的顯微鏡。通過結合稀疏自編碼器 (SAEs) 與轉碼器,研究人員得以深入模型內部,觀察其思考內容,溯源這些思維如何形成并與模型行為產生關聯。由此,這種洞察力進一步推動對越獄攻擊等 AI 安全相關問題的更深入研究,例如揭示模型對外表述的推理過程與其內部真實狀態之間的差異。

初代 Gemma Scope 已在模型幻覺、識別模型已知機密信息、訓練更安全模型等關鍵安全研究領域發揮作用,而 Gemma Scope 2 則通過以下重大升級來支持更具雄心的研究:

全規模覆蓋: 我們為整個 Gemma 3 系列 (參數規模最高達 270 億) 提供了一整套完整的工具,這對于研究僅在大規模模型中顯現的涌現行為至關重要。例如,此前270 億參數的 C2S Scale 模型曾協助科研人員發現潛在的新型癌癥治療路徑。盡管 Gemma Scope 2 并未在該模型上進行訓練,但這一案例體現了此工具套件未來有望解析的涌現行為類型。

更精細的復雜內部行為解析工具: Gemma Scope 2 包含針對 Gemma 3 模型系列每一層訓練的稀疏自編碼器與轉碼器。通過引入跳躍轉碼器和跨層轉碼器,讓解析貫穿在模型中的多步驟計算與算法變得更加輕松。

先進的訓練技術: 我們采用最前沿的訓練技術,特別是Matryoshka 訓練技術,該技術能幫助稀疏自編碼器識別更有價值的概念,并修正了在初代 Gemma Scope 中發現的部分缺陷。

對話機器人行為分析工具: 對于針對聊天場景微調的 Gemma 3 版本,我們還專門提供定制化的可解釋性工具。這些工具有助于分析復雜、多步驟的行為模式,例如越獄攻擊、拒絕響應機制以及思維鏈的忠實度。

推動領域發展

我們希望通過發布 Gemma Scope 2 為 AI 安全研究社區提供一套前沿的可解釋性工具,以推動該領域發展。針對那些僅在更大、更先進的大語言模型中出現的現實安全問題,這種全新的開放程度提供了至關重要的解決途徑。歡迎您持續關注 "谷歌開發者" 微信公眾號,及時了解更多開發技術和產品更新等資訊動態。

-

谷歌

+關注

關注

27文章

6255瀏覽量

111710 -

AI

+關注

關注

91文章

40431瀏覽量

302035 -

模型

+關注

關注

1文章

3778瀏覽量

52195

原文標題:Gemma Scope 2: 賦能 AI 安全社區,深度洞察大語言模型復雜行為

文章出處:【微信號:Google_Developers,微信公眾號:谷歌開發者】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

谷歌推出TranslateGemma全新開放翻譯模型系列

解鎖谷歌FunctionGemma模型的無限潛力

借助谷歌FunctionGemma模型構建下一代端側智能體

每年10億美元,蘋果與谷歌官宣合作,Gemini大模型注入Siri

泰凌微:布局端側AI,產品支持谷歌LiteRT、TVM開源模型

谷歌與耶魯大學合作發布最新C2S-Scale 27B模型

谷歌AlphaEarth和維智時空AI大模型的技術路徑

谷歌推出AI模型Gemma 3 270M

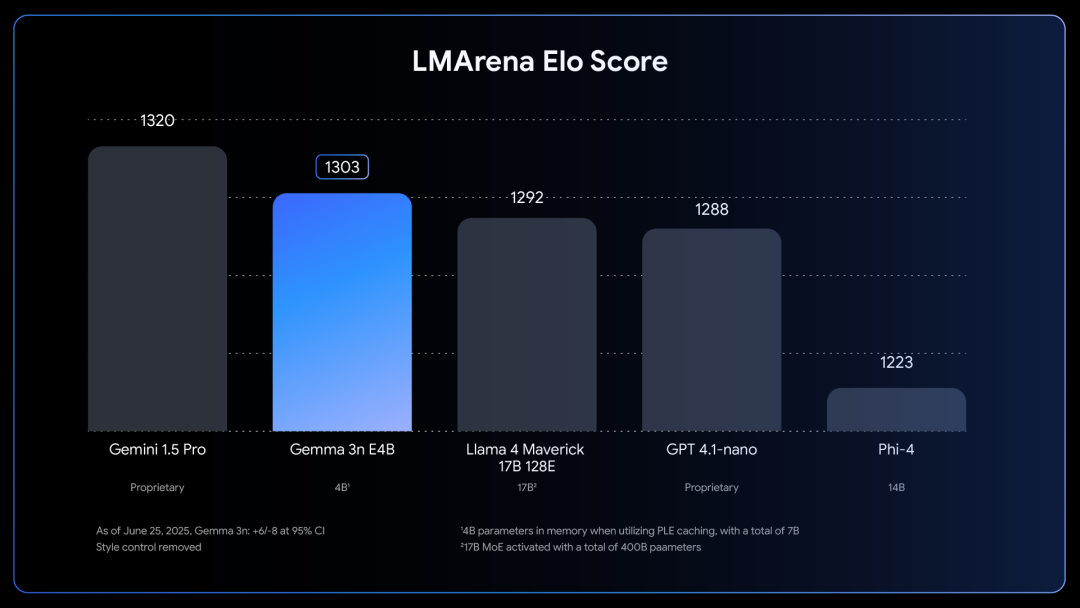

谷歌Gemma 3n模型的新功能

Liquid AI發布邊緣AI模型LFM2,實現毫秒級實時推理與離線運行

谷歌Gemma 3n預覽版全新發布

樹莓派5上的Gemma 2:如何打造高效的邊緣AI解決方案?

Google Gemma 3開發者指南

谷歌正式發布Gemma Scope 2模型

谷歌正式發布Gemma Scope 2模型

評論