近期,上海 AI 實驗室 DeepLink 團隊推出的 DLInfer 通過支持 LMDeploy 主流模型推理,助力沐曦股份曦云 C500 落地 MinerU 多模態數據生成場景,Graph 模式下實現性能加速 60%。DLInfer 是一套專為國產硬件適配大模型推理框架的中間件解決方案,其核心功能在于通過標準化的融合算子接口,打通上層大模型推理框架與底層硬件廠商的異構計算能力。目前,DLInfer 已實現軟硬適配工程中的有效解耦,支持包括 InternLM 系列、InternVL 系列、Qwen 系列、DeepSeek 系列在內的多款主流模型在多元硬件上的推理適配,支撐包括沐曦股份曦云 C500 在內的超 5 款主流硬件接入。

DLInfer GitHub:

https://github.com/DeepLink-org/dlinfer

Metax算子庫:

https://github.com/orgs/MetaXMACA/repositories

LMDeploy GitHub:

https://github.com/InternLM/lmdeploy

MinerU GitHub:

https://github.com/opendatalab/MinerU

聯手沐曦股份實現數據生成場景的實際落地,Graph 模式下性能加速超 60%

為了驗證 DLInfer 在真實場景中的效能,科研團隊與沐曦股份展開了深度合作,通過接入通用推理框架與賦能垂類應用兩個維度,全面展示了 DLInfer 助力沐曦股份芯片釋放潛能的實戰成果。其中,Dlinfer + LMDeploy 推理部署方案表現突出。不僅能有效降低端到端延遲、提升吞吐性能,更憑借其出色的加速效果,為其成為國產主流硬件在推理場景下的重要選擇提供了有力支撐。

Graph 模式下精確的算子匹配加速推理效率

DLInfer 通過分層設計,在 Eager 模式下直接調用各廠商優化后的融合算子,在 Graph 模式下則對接硬件廠商的圖編譯引擎,獲取更加精確匹配,實現端到端性能優化。其接口設計不僅將框架與硬件適配工程解耦,降低多平臺開發成本,還能在 Graph 模式下通過精確的算子匹配提升推理效率。

Graph 模式是 DLInfer 實現性能躍遷的核心,它融合了兩種關鍵的優化路徑:

一方面全面支持類似 CUDA Graph 的“執行流捕獲”技術,支持將整個計算流程固化,消除 CPU 調度開銷,實現近乎零開銷的執行;對于那些算子本身已經足夠優化但 CPU 與 GPU 交互成為主要性能瓶頸的場景,這種技術能帶來立竿見影的加速效果。

另一方面對于擁有豐富圖編譯生態的硬件平臺,DLInfer 將 Attention、MoE 等關鍵子圖整體映射到硬件廠商提供的圖優化器上,這種做法能最大化利用硬件特性,實現深度的算子融合與內存優化。

DLInfer 架構圖

沐曦股份算子優化核心突破

沐曦股份算子庫提供的針對性適配優化,進一步補全了 DLInfer 在硬件底層的性能調用能力,讓芯片算力與軟件框架的適配更精準、資源損耗更少。

在訪存延遲掩蓋方面,沐曦股份通過多重技術組合實現高效數據流轉。采用64/128bit 寬位顯存 load 指令提升帶寬利用率,針對非 2 的冪次對齊數據定制loop展開邏輯,借助運行時mask實現顯存數據高效加載。通過預發射shared memory讀取指令、采用swizzle布局消除bank沖突,搭配多stage等機制讓計算指令精準掩蓋訪存延遲,全方位突破訪存瓶頸。

生態兼容層面,沐曦股份以降低用戶遷移成本為核心,實現全方位適配。全面兼容 cuBlas 和 cuBlasLt 接口,完美適配官方 FlashAttention 與 FlashMLA,新增 Attention mask實現、KV cache 反量化融合支持、多 page size 選項等實用特性,讓用戶無需重構代碼即可無縫銜接現有生態,加速業務落地進程。

無縫接入 LMDeploy,釋放通用推理框架潛力

LMDeploy是業界領先的大模型推理引擎,為開發者提供了靈活高效的部署方案。DLInfer作為橋梁,讓異構芯片能夠無縫融入此生態,用戶無需修改業務代碼即可享受硬件性能紅利。

一鍵切換的集成方式,實現零成本適配。DLInfer 作為“翻譯官”和“優化器”,LMDeploy 與沐曦股份的對接變得非常簡單。用戶只需在 LMDeploy 的配置中指定后端為沐曦股份(--device maca),即可完成整個部署鏈路的切換。上層應用(LMDeploy)依然調用 DLInfer API,便可在底層將計算任務精準地分發到沐曦股份硬件上。

通用模型推理吞吐可實現 30%的提升。科研團隊在 C500 上對多個主流大模型進行了性能測試。測試結果表明,相較于算子模式,通過 DLInfer + LMDeploy 的部署方案,端到端延遲顯著降低,模型推理吞吐量提升了 30%以上,為高并發推理服務提供了堅實的性能保障。

加速 MinerU 文檔處理,彰顯垂類模型應用價值

如果說接入 LMDeploy 證明了 DLInfer 方案的“廣度”,那么賦能類似 MinerU 的復雜垂類應用,則彰顯了其“深度”和解決特定領域難題的能力。MinerU 是上海AI實驗室研發的一款開源的一站式文檔解析工具,目前GitHub星標數近50K,在文檔解析領域有著重要的影響力,其核心任務是將 PDF 等復雜文檔轉換為結構化的 Markdown,這是一個典型的多模態數據生成場景。DLInfer 通過 Mineru-LMDeploy-DLInfer 的技術路線,將 MinerU 無縫運行在了曦云 C500 上,并實現 Graph 模式性能相比 Eager 模式提升了 60%。通過雙方技術優勢的互補,實現了此次復雜垂類場景的性能加速突破,為推理任務的高效運行再添一重保障。

"芯片 + DLInfer + LMDepLoy + MinerU" 技術路線

多元硬件接入推理框架的通用方案

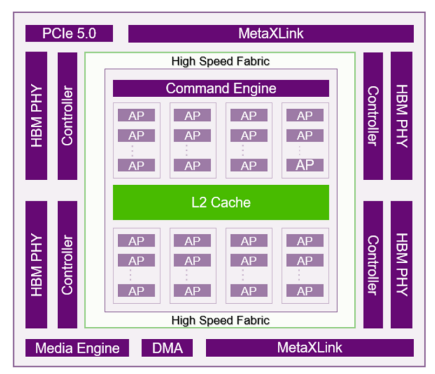

DLInfer 對上承接大模型推理框架,對下通過一套接口靈活支持各廠商不同粒度的融合算子與廠商自研圖引擎,將對接框架與對接廠商融合算子在適配工程中有效解耦。在 DLInfer 中,根據主流大模型推理框架與主流硬件廠商的融合算子粒度,定義了大模型推理的融合算子接口。同時,DLInfer 兼顧了 LLM(大語言模型)與 VLM(視覺語言模型)兩類主流多模態模型的推理需求,為國產硬件生態融入大模型技術棧提供了統一的中間層支持。

DLInfer 的核心架構可以概括為“統一前端 + 可插拔后端”的模式:

統一前端:DLInfer 的頂層算子接口為上層應用提供了一套與硬件無關的算子加載與執行接口。開發者無需關心底層硬件,只需聚焦于業務邏輯本身。

可插拔后端: 每個硬件平臺都是一個獨立的“后端”模塊,而每個后端都負責實現兩套執行路徑,即適合模型調試和新算子的快速驗證 Eager 模式和 最大化利用硬件特性 Graph 模式。在 DLInfer 的vendor目錄下,可以清晰地看到這種解耦設計。

結語

DeepLink 聚焦多元芯片生態建設,深耕編譯優化、異構通信等核心技術,全力推進國產 AI 工具鏈研發與安全高效的方案落地。針對國產芯片特性優化算子性能、構建統一計算通信中間表達,打造兼容主流框架的開發環境,降低開發者國產芯片遷移門檻,不斷提高國產芯片的易用性和端到端性能。同時通過構建多場景支撐平臺和垂域標桿應用,為科研和產業界提供更為強大的支持,推動 AI 全行業自主可控、可持續發展。

關于沐曦股份

沐曦股份致力于自主研發全棧高性能GPU芯片及計算平臺,為智算、通用計算、云渲染等前沿領域提供高能效、高通用性的算力支撐,助力數字經濟發展。

-

AI

+關注

關注

91文章

40346瀏覽量

301921 -

沐曦

+關注

關注

1文章

83瀏覽量

1849 -

大模型

+關注

關注

2文章

3696瀏覽量

5216

原文標題:DLInfer助力沐曦股份曦云C500推理落地MinerU多模態場景,實現性能加速60%!

文章出處:【微信號:沐曦MetaX,微信公眾號:沐曦MetaX】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

沐曦股份北京AI研究院暨企業開源中心正式揭牌啟動

沐曦股份GPU產品正式接入華佗開源生態

沐曦股份長沙生態創新中心正式揭牌

沐曦股份正式推出曦索X系列全新GPU品牌與產品線

沐曦股份與江南大學建立聯合研究中心

大曉機器人與沐曦股份簽署戰略合作協議

沐曦股份MXMACA軟件棧3.3.0.X版本技術解析

DLInfer聯手沐曦股份實現數據生成場景的實際落地

DLInfer聯手沐曦股份實現數據生成場景的實際落地

評論