在 AI 基礎架構中,數據為計算引擎提供關鍵燃料。隨著代理式 AI 系統的持續演進,多個模型與服務相互協作,需要獲取外部上下文并實時做出決策,企業面臨如何高效、智能且可靠地處理大規模數據流的挑戰。無論是從持久化存儲中加載模型、檢索知識以支持查詢,還是協調智能體對工具的調用,數據的高效流轉始終是決定 AI 系統性能的核心因素。

GPU 與 GPU 之間的東西向通信長期以來一直是優化的重點。然而,負責模型加載、存儲 I/O 和推理請求的南北向網絡同樣關鍵,其性能瓶頸會直接影響 AI 系統的響應速度。

NVIDIA 企業參考架構(Enterprise RA)可指導企業高效部署 AI 工廠及南北向網絡,為構建可擴展、安全且高性能的 AI 基礎設施提供系統性的設計方法。企業參考架構凝練了 NVIDIA 豐富的實踐經驗,涵蓋服務器與網絡配置、軟件堆棧到運維最佳實踐等各個方面,為部署復雜的 AI 基礎設施提供了清晰且經過驗證的實施路徑。

在企業參考架構的眾多組件中,NVIDIA Spectrum-X 以太網在加速南北向數據流方面發揮著重要作用,尤其是搭載 NVIDIA BlueField-3 DPU 助力數據密集型 AI 應用場景。

傳統以太網存儲網絡并非專為滿足 AI 和 HPC 工作負載在可擴展、數據流和敏感性方面的需求而設計,常因延遲和網絡擁塞影響整體性能。每次 AI 模型在訓練過程中進行檢查點操作時,都會將大量數據流通過南北向網絡傳輸至持久化存儲。對于當前擁有數十億參數的模型而言,這些檢查點文件可能達到數 TB 級別,確保在系統發生故障時訓練進度不會丟失。

推理工作負載同樣高度依賴高效的南北向網絡。在 AI 智能體檢索數據時,無論是從檢索增強生成(RAG)系統的向量數據庫中獲取嵌入,還是從外部工具或數據庫中調取與客戶查詢相關的信息,這些過程都需要快速、低延遲的南北向連接。隨著企業逐步從靜態的單次推理演進為動態的多輪次、多智能體協同推理,南北向網絡的需求也隨之呈指數級增長。這種增長源于智能體在持續與用戶、外部數據源及云服務交互的過程中,不斷執行數據的提取、處理與更新操作。

通過采用 NVIDIA Spectrum-X 以太網加速企業參考架構中的數據傳輸,這些網絡可轉化為無損的 AI 數據存儲與傳輸平臺,專為滿足現代 AI 工作負載的性能需求而設計。該企業級架構支持打造面向可預測性、高吞吐量和低延遲數據訪問優化的 AI 工廠,從而充分釋放現代 AI 工作流的潛力。

融合網絡:企業 AI 工作負載簡化的基礎

企業 AI 工廠通常為解決特定應用場景而構建,其網絡規模一般從 4 到 16 個服務器節點起步。在此場景下,融合架構將東西向流量(如計算任務)與南北向流量(如存儲訪問和外部服務通信)整合至統一的交換網絡中,有助于簡化運維。該架構通過減少布線需求和硬件擴展可以有效降低系統復雜性,同時在訓練、推理和檢索等各類工作負載中保持高吞吐性能。但融合的東西向與南北向網絡需要具備充足帶寬和良好服務質量(QoS)能力,以可靠地支持這兩類流量的并發運行。

Spectrum-X 以太網是企業參考架構的核心,發揮著關鍵作用。該架構最初針對 GPU 與 GPU 之間以及節點與節點之間的東西向通信進行了優化,同時借助動態路由和遙測技術,有效避免網絡擁塞,提升吞吐量,并降低 AI 運行時及檢索密集型工作負載中的延遲。因而它也為南北向的網絡和存儲數據路徑提供了顯著的帶寬與性能優勢。

Spectrum-X 的以太網功能同樣至關重要,例如虛擬路由和轉發(VRF)實現的服務隔離以及 QoS 對流量的優先級管理。虛擬路由和轉發能夠在無需依賴物理網絡劃分的情況下,從邏輯上將東西向通信與南北向流量(如用戶接入或存儲訪問)進行分隔。QoS則通過在以太網幀或 IP 數據包頭添加標簽,確保特定類型的流量(如存儲流量相對于基于 HTTPS 的用戶流量)獲得相應的優先級處理。當多個 AI 智能體或工作負載在共享基礎設施上并發運行時,這些機制結合一些高級功能例如噪聲隔離等,實現進一步的功能強化,從而保障系統性能的穩定性與一致性。

需要注意的是,盡管融合架構非常適合中小規模的企業級 AI 工廠,但它并非適用于所有場景的通用方案。在大規模多租戶環境中,例如由 NVIDIA 云合作伙伴(NCP)運營的環境,采用具有物理連接網絡的分離式架構可能是更優選擇,這既能提供更高的有效帶寬,又能實現租戶之間及不同流量類型之間的嚴格隔離。

融合網絡是一項經過周密考量的設計選擇,契合企業級 AI 基礎設施在專用場景下的應用需求,同時兼顧性能與可管理性。企業參考架構通過提供一系列指導方案,能夠覆蓋從小型基礎集群到擴展至 1000 個 GPU 的中型部署,有效簡化了為特定用例確定理想網絡架構的復雜過程。

了解 NVIDIA 以太網 SuperNIC 與BlueField-3 DPU 的功能與應用

了解 AI 工廠中的網絡編排時,有必要區分 NVIDIA 以太網 SuperNIC 與 DPU 的不同角色。NVIDIA SuperNIC 專為處理 GPU 間東西向通信流量而設計,面向超大規模 AI 環境時,可為每個 GPU 提供高達 800 Gb/s 的帶寬,確保在分布式訓練和推理過程中實現高效、快速的數據連接。

而 BlueField-3 DPU 則負責處理南北向流量。它能夠將存儲管理、遙測和網絡安全等任務從主機 CPU 卸載、加速并實現隔離,從而為核心 AI 處理釋放寶貴的計算資源。實際上,它充當了專用的云基礎設施處理器,確保數據在 AI 工廠與外部生態系統(包括網絡存儲)之間高效流動。

SuperNIC 與 BlueField-3 DPU 共同構建了強大的 AI 網絡協同體系。SuperNIC 為 AI 工廠內部的計算提供動力與路徑支持,而 BlueField-3 DPU 則確保外部數據能夠順利、大規模地接入。這種組合拳使企業能夠全面優化 AI 基礎設施各層級的性能表現。

對企業的影響:向量數據庫與實時檢索

代理式 AI 和 RAG 系統的日益普及是南北向網絡應用的一個典型示例。以 NVIDIA RAG 2.0 Blueprint 為代表的架構,通過整合外部知識(如文檔、圖像、日志和視頻),擴展了大語言模型(LLM)的能力。該架構利用 NVIDIA NeMo Retriever 和 NVIDIA NIM 微服務,將這些內容通過向量數據庫進行嵌入、索引和檢索,從而提供更加準確且符合上下文的響應。

當用戶提交查詢時,LLM 會生成相應的向量嵌入,并利用該嵌入在向量數據庫(如外部存儲中的 Milvus)中快速檢索相關性較高的上下文信息。這一過程依賴于高效、低延遲的南北向數據流動。系統越早完成外部知識的檢索與整合,其響應速度就越快,結果也越準確。Spectrum-X 以太網絡優化了這一數據路徑,在模型實時獲取嵌入信息方面,確保了最小的延遲和最大的吞吐量。

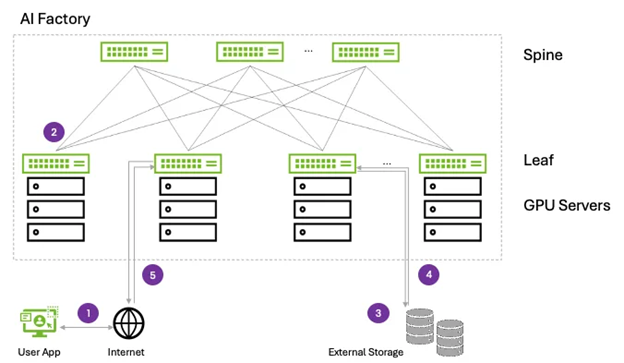

圖 1. 在 RAG 增強型 LLM 用戶查詢中,NVIDIA Spectrum-X 以太網中的數據流步驟示意

下面來分析一下南北向用戶的計算與存儲流程:

用戶查詢入口(用戶到互聯網到 leaf):用戶提示或任務通過入口網關流入 AI 工廠,到達 leaf 交換機,然后進入集群。企業參考架構通過 Spectrum-X 以太網優化了這一路徑,縮短了依賴外部數據的應用程序的首 token 時延(Time to First Token,TTFT),并避免了手動網絡配置調整。

請求路由到 GPU 服務器(通過 DPU 優化 leaf 到 GPU路由):請求通過 leaf 交換機定向到 GPU 節點,BlueField-3 DPU 在此處理數據包解析、卸載網絡棧,并將請求路由到正確的推理引擎(例如 NVIDIA NIM)。該請求流經 leaf-spine Spectrum-X 以太網交換機,通過動態路由,避免擁塞。Spectrum-X 以太網使用交換機實時狀態或隊列占用來動態地保持流量高效流動,類似于地圖應用在交通堵塞時為用戶重新安排路線。

外部上下文獲取(服務器到 leaf 到 spine 再到 leaf 到存儲):對于上下文查詢(例如向量數據庫),請求通過 RoCE(RDMA over Converged Ethernet)流經 leaf-spine 網絡到達基于 NVMe 的存儲系統。Spectrum-X 以太網的無縫互操作性和為 AI 優化的性能,助力 DDN、VAST Data 和 WEKA 等合作伙伴平臺上的數據訪問,可將存儲性能提升高達 1.6 倍。

數據返回到 GPU(存儲到 leaf 到 spine 再到 leaf 到 server):相關向量和嵌入式內容通過 RoCE 在同一融合網絡上返回。Spectrum-X 以太網可實現此路徑的擁塞感知,并通過 DPU 處理數據包重排序來保持 GPU 的高效供給。在這里,QoS 標記可以確保優先處理延遲敏感型存儲數據,尤其是當多個 AI 智能體通過南北向流量查詢多個工具時。

LLM 推理和最終響應(GPU 到 leaf 到用戶):利用內存中的原始提示和相關外部上下文,GPU 完成推理。最終響應會向上路由,并退出基礎設施返回至用戶應用。基于 VRF 的網絡隔離可確保存儲、推理和用戶流量在邏輯上保持獨立,從而確保大規模運行時的性能穩定。

在多個 AI 智能體同時運行(如協作處理復雜任務或響應多用戶查詢)的環境中,高效的南北向網絡能夠有效避免瓶頸,保障系統的流暢性與響應速度。通過優化數據檢索流程,企業可顯著提升決策效率并改善用戶體驗。無論應用于客戶聊天機器人、金融咨詢工具,還是內部知識管理平臺,基于高效南北向網絡的 AI 代理與 RAG 架構均能切實創造可觀的業務價值。

AI 工作負載已不再局限于隔離環境中的大型訓練集群,而是越來越多地融入日常企業運營,需要與數據湖、外部服務以及面向用戶的應用實現無縫交互。在此新范式下,南北向網絡正重新崛起,成為 AI 工廠的關鍵支撐。憑借 NVIDIA Spectrum-X 以太網、NVIDIA BlueField 以及基于 NVIDIA 企業參考架構的精細架構設計,企業能夠打造具備高彈性、高性能且可隨 AI 工作負載持續擴展的 AI 工廠。

-

負載

+關注

關注

2文章

665瀏覽量

36511 -

NVIDIA

+關注

關注

14文章

5592瀏覽量

109722 -

AI

+關注

關注

91文章

39768瀏覽量

301370

原文標題:南北向網絡:加速企業 AI 工作負載的關鍵

文章出處:【微信號:NVIDIA-Enterprise,微信公眾號:NVIDIA英偉達企業解決方案】歡迎添加關注!文章轉載請注明出處。

發布評論請先 登錄

生命科學領先企業采用 NVIDIA BioNeMo 平臺加速 AI 驅動的藥物研發

多家領先軟件平臺現已與NVIDIA企業AI工廠驗證設計相集成

NVIDIA 收購開源工作負載管理提供商 SchedMD

NVIDIA技術助力企業創建主權AI智能體

NVIDIA攜手合作伙伴提升AI智能體的交互能力

NVIDIA加速的Apache Spark助力企業節省大量成本

英偉達GTC2025亮點:NVIDIA認證計劃擴展至企業存儲領域,加速AI工廠部署

英偉達GTC2025亮點:Oracle與NVIDIA合作助力企業加速代理式AI推理

英偉達GTC2025亮點:NVIDIA與行業領先存儲企業共同推出面向AI時代的新型企業基礎設施

Oracle 與 NVIDIA 合作助力企業加速代理式 AI 推理

NVIDIA 與行業領先的存儲企業共同推出面向 AI 時代的新型企業基礎設施

NVIDIA 推出開放推理 AI 模型系列,助力開發者和企業構建代理式 AI 平臺

NVIDIA如何簡化企業AI工作負載

NVIDIA如何簡化企業AI工作負載

評論