RoboTransfer

幾何約束&條件可控視頻生成

具身數(shù)據(jù)合成新范式

在機器人操作領(lǐng)域,模仿學(xué)習(xí)是推動具身智能發(fā)展的關(guān)鍵路徑,但高度依賴大規(guī)模、高質(zhì)量的真實演示數(shù)據(jù),面臨高昂采集成本與效率瓶頸。仿真器雖提供了低成本數(shù)據(jù)生成方案,但顯著的“模擬到現(xiàn)實”(Sim2Real)鴻溝,制約了仿真數(shù)據(jù)訓(xùn)練策略的泛化能力與落地應(yīng)用。

我們提出RoboTransfer一基于擴散模型的視頻生成框架,旨在合成高保真且符合物理規(guī)律的機器人操作演示數(shù)據(jù)。該框架創(chuàng)新性地融合深度-表面法向的幾何約束與多視角特征建模,確保生成視頻具備高度幾何一致性與真實感。通過拆分控制條件設(shè)計,實現(xiàn)對操作場景元素(如背景替換、物體外觀)的精細(xì)控制。結(jié)合物理仿真器重構(gòu)空間布局與交互狀態(tài),實現(xiàn)多樣化、可拓展的高保真數(shù)據(jù)合成。

RoboTransfer通過數(shù)據(jù)驅(qū)動的生成式Ai技術(shù),建立機器人操作數(shù)據(jù)合成新范式,提供高質(zhì)量、可擴展的演示數(shù)據(jù),助力具身智能突破通用性與泛化性邊界。

近年來,隨著人工智能從感知智能向決策智能演進,世界模型 (World Models)逐漸成為機器人領(lǐng)域的重要研究方向。世界模型旨在讓智能體對環(huán)境進行建模并預(yù)測未來狀態(tài),從而實現(xiàn)更高效的規(guī)劃與決策。

與此同時,具身數(shù)據(jù)也迎來了爆發(fā)式關(guān)注。因為目前具身算法高度依賴于大規(guī)模的真實機器人演示數(shù)據(jù),而這些數(shù)據(jù)的采集過程往往成本高昂、耗時費力,嚴(yán)重限制了其可擴展性和泛化能力。盡管仿真平臺提供了一種相對低成本的數(shù)據(jù)生成方式,但由于仿真環(huán)境與真實世界之間存在顯著的視覺和動力學(xué)差異 (即sim-to-real gap) ,導(dǎo)致在仿真中訓(xùn)練的策略難以直接遷移到真實機器人上,從而限制了其實際應(yīng)用效果。因此如何高效獲取、生成和利用高質(zhì)量的具身數(shù)據(jù),已成為當(dāng)前機器人學(xué)習(xí)領(lǐng)域的核心挑戰(zhàn)之一。

近日,地平線、極佳科技與中國科學(xué)院自動化研究所等單位提出RoboTransfer,基于擴散模型的視頻生成框架,可以用于擴充機器人策略模型的訓(xùn)練數(shù)據(jù)。得益于合成數(shù)據(jù)的多樣性,下游策略模型能夠在新場景下取得251%的顯著提升,大幅提升策略模型的泛化性,為具身智能的通用性與泛化性奠定了堅實的基礎(chǔ)。

?論文鏈接:

https://arxiv.org/pdf/2505.23171

? 項目主頁:

https://horizonrobotics.github.io/robot_lab/robotransfer/

模仿學(xué)習(xí) (Imitation Learning) 已成為機器人操作領(lǐng)域的重要方法之一。通過讓機器人“模仿”專家示教的行為,可以在復(fù)雜任務(wù)中快速構(gòu)建有效的策略模型。然而,這類方法通常依賴大量高質(zhì)量的真實機器人演示數(shù)據(jù),而數(shù)據(jù)采集過程成本高、周期長,嚴(yán)重制約了其擴展性和泛化能力。

為了解決上述問題,本項工作提出了RoboTransfer,一種基于擴散模型 (diffusion model) 的視頻生成框架,旨在實現(xiàn)高質(zhì)量的機器人操作場景數(shù)據(jù)合成。不同于傳統(tǒng)的仿真方法或現(xiàn)有生成模型,RoboTransfer融合了多視角幾何信息,并對場景中的關(guān)鍵組成成分(如背景、物體屬性等)實現(xiàn)了顯式控制。具體而言,RoboTransfer通過引入跨視角特征交互機制以及全局深度圖與法向圖作為條件輸入,確保生成視頻在多個視角下的幾何一致性。此外,該框架支持細(xì)粒度的編輯控制,例如更換背景、替換目標(biāo)物體等,從而能夠靈活地生成多樣化、結(jié)構(gòu)合理的視覺數(shù)據(jù)。

實驗結(jié)果表明,RoboTransfer能夠生成具有高幾何一致性和視覺質(zhì)量的多視角視頻序列。此外,使用RoboTransfer合成數(shù)據(jù)訓(xùn)練的機器人視覺策略模型,在標(biāo)準(zhǔn)測試任務(wù)中表現(xiàn)出顯著提升的性能:在更換前景物體的場景下取得了33.3%的成功率相對提升,在更具挑戰(zhàn)性的場景下(同時更換前景背景)更是達到了251%的顯著提升。

RoboTransfer的整體框圖如下,為了在視頻生成過程中保證多視角之間的一致性,RoboTransfer引入了多視角一致性建模機制,使得生成過程能夠聯(lián)合不同視角的信息進行推理,從而提升生成結(jié)果的空間連貫性與視覺合理性。

此外,在控制條件的設(shè)計方面,RoboTransfer通過將控制信號解耦為幾何信息與外觀(紋理)信息兩個部分,實現(xiàn)了對生成內(nèi)容的細(xì)粒度控制。具體來說,在幾何控制方面,采用深度圖 (depth map) 和表面法向圖 (surface normal map) 等具有強結(jié)構(gòu)約束的表示方式,來引導(dǎo)生成視頻中物體的三維空間結(jié)構(gòu),確保在不同視角下生成內(nèi)容的幾何一致性。而在外觀控制方面,模型利用參考背景圖像和目標(biāo)物體的參考圖像作為輸入條件,這些圖像經(jīng)過編碼后能夠有效保留原始場景的色彩、紋理以及上下文信息,從而在生成過程中維持物體外觀的細(xì)節(jié)還原能力。

在實驗部分,RoboTransfer證明可以通過real-to-real,以及sim-to-real兩種方式實現(xiàn)數(shù)據(jù)增廣,并訓(xùn)練下游的策略模型提升其性能。

real-to-real數(shù)據(jù)增廣

基于真機采集的真實視頻數(shù)據(jù),可從中提取結(jié)構(gòu)化信息作為控制條件,通過調(diào)整背景桌面與前景物體的控制參數(shù),實現(xiàn)新場景數(shù)據(jù)的合成。如下圖所示,左側(cè)為真實采集的數(shù)據(jù)及其對應(yīng)的結(jié)構(gòu)化信息,右側(cè)為合成結(jié)果,實驗表明RoboTransfer能夠靈活地實現(xiàn)背景桌布的替換。

改變前景:下圖所示第一行為真機采集數(shù)據(jù),第二行為深度圖,第三行為法向圖,第四行為前景物體的控制條件,第五行為合成數(shù)據(jù),第六行為背景桌布控制條件。以下實驗結(jié)果表明RoboTransfer可以實現(xiàn)對前景物體外表編輯的功能,豐富生成數(shù)據(jù)的多樣性,提升策略模型的訓(xùn)練質(zhì)量。

sim-to-real數(shù)據(jù)增廣

RoboTransfer不僅可以改變真機數(shù)據(jù)的前景和背景,還可以實現(xiàn)對仿真數(shù)據(jù)的重新渲染。利用仿真數(shù)據(jù)中的結(jié)構(gòu)化信息以及真實場景的物體和背景作為控制條件,RoboTransfer可以將仿真數(shù)據(jù)的轉(zhuǎn)化為逼真的真實數(shù)據(jù),極大地降低sim-to-real之間的gap,為通用機器人的訓(xùn)練提供了一個新的范式。以下是兩個不同的仿真場景重新渲染的實驗結(jié)果,左側(cè)是疊碗,右側(cè)是放置杯子,其中第一行為仿真采集數(shù)據(jù),第二行為深度圖,第三行為法向圖,第四行為合成數(shù)據(jù),第五行為背景參考圖。

對比實驗結(jié)果

與其他SOTA方法的對比可以發(fā)現(xiàn),RoboTransfer在時序一致性以及多視角之間的一致性上都要顯著優(yōu)于其他方法。

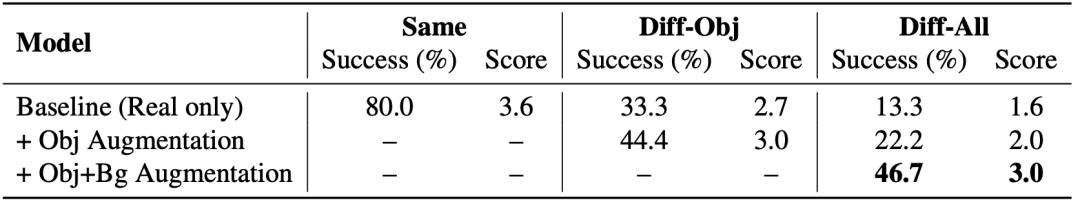

定量實驗的實驗結(jié)果如下表所示,實驗表明對于生成數(shù)據(jù)的前背景增廣可以顯著提升策略模型在新場景下的成功率,其中對于前背景完全改變的新場景,前背景的數(shù)據(jù)增廣能夠讓策略模型獲得251%的性能提升。

表1:數(shù)據(jù)增廣對于策略模型在不同setting下的提升

總體來說,該方法構(gòu)建了數(shù)據(jù)處理流程,可以生成包含幾何和外觀控制條件的三元組數(shù)據(jù),以訓(xùn)練基于擴散模型的機器人數(shù)據(jù)合成框架RoboTransfer。實驗和評估結(jié)果顯示,RoboTransfer能夠生成具有多視角一致、幾何一致的數(shù)據(jù),并且可以根據(jù)參考圖像修改前景和背景紋理。生成的數(shù)據(jù)用于訓(xùn)練機器人操作策略,從而顯著提升了策略模型的泛化能力。

-

機器人

+關(guān)注

關(guān)注

213文章

31073瀏覽量

222162 -

視頻

+關(guān)注

關(guān)注

6文章

2005瀏覽量

74956 -

模型

+關(guān)注

關(guān)注

1文章

3751瀏覽量

52099

原文標(biāo)題:開發(fā)者說|RoboTransfer:幾何一致視頻世界模型,突破機器人操作泛化邊界

文章出處:【微信號:horizonrobotics,微信公眾號:地平線HorizonRobotics】歡迎添加關(guān)注!文章轉(zhuǎn)載請注明出處。

發(fā)布評論請先 登錄

商湯科技日日新Seko系列模型與寒武紀(jì)成功適配

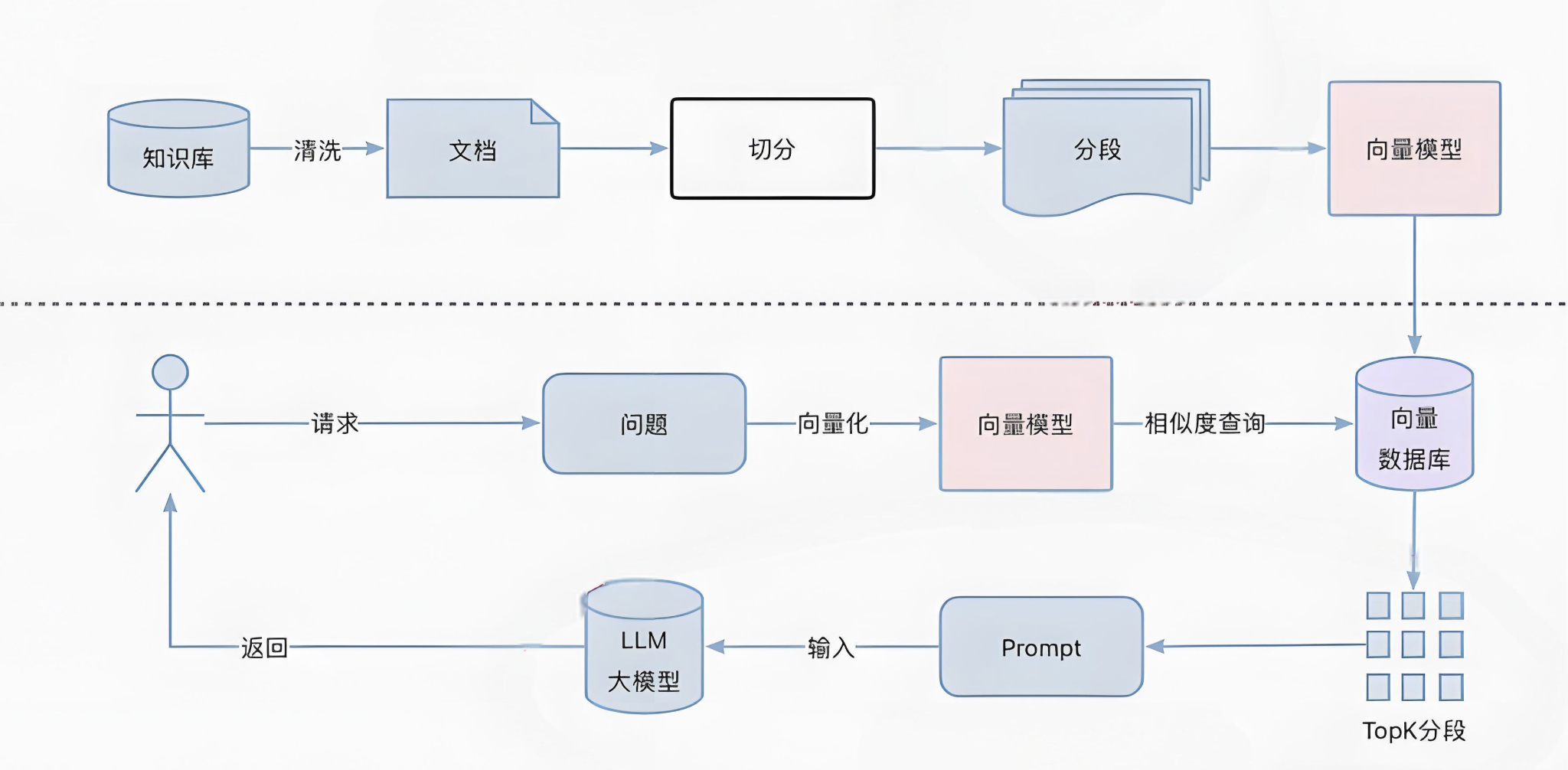

RAG實踐:一文掌握大模型RAG過程

OpenAI Sora 2模型上線微軟Azure AI Foundry國際版

全球首個動漫專屬AI視頻生成平臺Animon,國內(nèi)版"萌動AI"正式發(fā)布

一種適用于動態(tài)環(huán)境的自適應(yīng)先驗場景-對象SLAM框架

百度重磅發(fā)布!全球首創(chuàng)中文音視頻模型

4K、多模態(tài)、長視頻:AI視頻生成的下一個戰(zhàn)場,誰在領(lǐng)跑?

AKOOL發(fā)布全球首款實時攝像頭

寬調(diào)速范圍低轉(zhuǎn)矩脈動的一種新型內(nèi)置式永磁同步電機的設(shè)計與分析

FA模型訪問Stage模型DataShareExtensionAbility說明

一種實時多線程VSLAM框架vS-Graphs介紹

一種多模態(tài)駕駛場景生成框架UMGen介紹

?VLM(視覺語言模型)?詳細(xì)解析

一種基于擴散模型的視頻生成框架RoboTransfer

一種基于擴散模型的視頻生成框架RoboTransfer

評論